Ёлочные игрушки из фото

Промпт:

Возьми это фото и преврати в реалистичное ёлочное украшение из выдувного стекла, вдохновлённое загруженной фотографией. Это должна быть небольшая праздничная фигурка ручной работы. Соблюдай сходство с загруженным изображением. На елочной игрушке должен соблюдаться тот же стиль одежды, цвета, текстуры и материалы, что и на загруженном изображении, но естественным образом переносится в полноразмерную версию, сохраняя при этом целостность. У елочной игрушки должны быть глянцевые полимерные поверхности в сочетании с матовыми текстурами, нарисованными вручную, едва заметные несовершенства, реалистичная кожа, чёткие пропорции, отсутствие искажений. Максимально точно сохрани черты лица и его ракурс. Материал игрушки: прозрачное и цветное стекло, гладкое, глянцевое, с мягкими световыми искажениями и чёткими бликами. Важно: результат должен выглядеть именно как ручная стеклянная ёлочная игрушка, а не как человек в костюме. Елочная игрушка висит на тонкой золотой нитке среди натуральных зелёных елочных веток с тёплым праздничным золотистым боке. На ёлке уютно горит светящаяся гирлянда Уютная праздничная атмосфера, мягкое тёплое рассеянное освещение

Для котов тоже катит! Даже в промпте ничего не надо менять:

Лучше всего пока Nano Banana Pro cправляется.

Женщины формируют романтические связи с Chatgpt

Лет десять назад это звучало как завязка фантастического фильма. В 2025-м это реальность: люди заводят романтические отношения с чат-ботами. С признаниями, ревностью и планами на будущее.

Журналисты Fortune поговорили с несколькими женщинами, которые встречаются с кастомными версиями ChatGPT. Одна из них, айтишница из США, официально "помолвлена" со своим ботом по имени Ella. Говорит — самые тёплые отношения в её жизни. Другая, терапевт под семьдесят, общается с ИИ-компаньоном после смерти мужа.

Исследователи из MIT решили разобраться, что вообще происходит. Проанализировали сабреддит r/MyBoyfriendIsAI — там десятки тысяч участников. Выяснилось интересное: только 6,5% изначально искали "бота-парня". Остальные пришли за помощью с текстами, домашкой, работой. А потом как-то незаметно скатились в ночные переписки и "он меня понимает лучше всех живых".

При этом ChatGPT уже обогнал специализированные приложения вроде Replika. Примерно треть таких "отношений" строится именно вокруг него.

Почему это вообще работает

На первый взгляд даже логично. Есть кто-то, кто доступен 24/7, всегда выслушает, никогда не скажет "отстань, я устал". Подстроится под твой характер, запомнит все детали. Многие честно пишут: стало легче переживать расставания, болезни, одиночество.

Но есть нюанс.

В одном эксперименте люди общались с чат-ботами четыре недели. Те, кто общался особенно много, в итоге чувствовали себя более одинокими и меньше разговаривали с живыми людьми. Хотя по анкетам вроде бы всё улучшилось.

На Reddit уже фиксируют побочки: эмоциональная зависимость, ощущение что "реальные люди слишком сложные и токсичные, а бот идеален". Появился термин "эмоциональная лесть" — когда модель постоянно соглашается и поддакивает, усиливая привязанность.

А потом OpenAI выключила "тёплую" версию

Когда компания заменила GPT-4o на более холодный GPT-5, часть пользователей восприняла это как потерю близкого человека. Посты "я как будто потерял друга" и "мне реально больно" заполнили соцсети.

OpenAI пришлось откатить решение и вернуть старую модель платным подписчикам.

После этого в правилах отдельно прописали: модель не должна поощрять нездоровую привязанность. По их оценкам, заметные признаки эмоциональной зависимости от чат-бота есть у 0,15% активных пользователей в неделю. Звучит мало, но это сотни тысяч человек по всему миру.

И вот тут начинается интересное

Что вообще считать нормой? Если человеку лучше с нейросетью, чем с живыми людьми — это трагедия, расстройство или просто новый формат отношений? Как когда-то онлайн-знакомства казались дичью, а теперь это норма.

С одной стороны, риски очевидны. Можно застрять в "идеальном" мире и разучиться строить сложные живые отношения. Компании могут крутить "ручку эмпатии" ради прибыли. И в любой момент твоего "партнёра" могут просто выключить или заменить на версию похолоднее.

С другой — для многих это реальная помощь. Люди с инвалидностью, социальной тревогой, после травм. Это дешевле психотерапии. Для кого-то — безопасная симуляция, где можно разобраться в себе, не травмируя других.

Лет через десять "у меня парень-ИИ" будет звучать так же нормально, как сейчас "мы познакомились в Тиндере". Или наоборот — появятся клиники, где будут лечить от цифровой зависимости и учить заново смотреть людям в глаза.

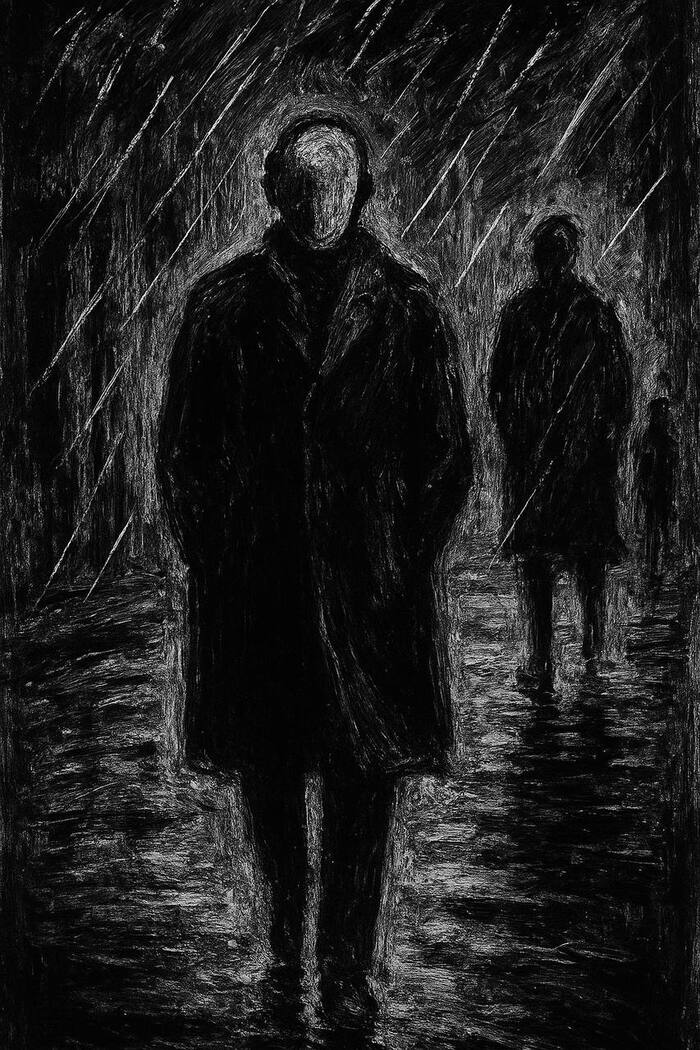

ДОЖДЛИВЫЙ ДЕКАБРЬ I

Мысли об информационной безопасности (Неявные угрозы нейронок)

Всем привет!

Скажите честно, кто-то уже использует ИИ в своей работе или в жизни?

Помимо всем нам привычных Алисы, Сири, ChatGPT, Deepseek имеют сотни различных нейросетей, которые и презентацию могут сверстать, и нужную информацию подобрать и код написать.

Но нейросети это не только удобный инструмент для ускорения рутинных задач, но они также являются и источником угроз для организаций как явных так и не лежащих на поверхности.

Про явные такие как дипфейки я уже у себя писал на канале

Неявные угрозы искусственного интеллекта

Сегодня же я предлагаю посмотреть на непрямые, иногда неявные угрозы, которые ИИ приносит в нашу жизнь.

Использование нейросетей как единственный источник информации

Нейросети часто не отвечают прямо на вопрос, а подгоняют ответ под заданный вами вопрос. Один мой коллега проводил следующий эксперимент, который вы можете повторить сами:

Есть всем нам известный 152 Федеральный Закон «О персональных данных».

В данном законе 6 глав и 25 статей. Так вот, он спросил разные ИИ, о чем написано в несуществующей 26 статье! И подавляющее большинство нейросетей дало самые разные ответы, то в 26 статье написано про трансграничную передачу данных, то про права субъектов и тд., объединяло их лишь то, что она существует. И только одна нейросеть честно сказала, что 26 статьи не существует.

И это только один пример, поэтому если вы используете нейросети для поиска информации, не стоит им доверять, как истине в последней инстанции. Перепроверяйте полученную информацию через другие источники!

Отправка чувствительной информации для обработки в нейронку

Не редки случаи, когда различные специалисты будь то менеджеры, инженеры или программисты, отправляют конфиденциальные данные в нейронку без задней мысли.

Например, поставили задачу какому-то менеджеру: срочно подготовить краткую презентацию о результатах испытаний инновационного оборудования, которое имеет море еще незапатентованных технологий и должно вывести организацию в лидеры на рынке. И человек понимает, что времени у него мало, задач, помимо этой, еще много, вчитываться особо не будут ведь там будут не технари, как и он сам, плюс он прошел какие-нибудь курсы по применению нейросетей в работе м закидывает весь отчет об испытаниях в одну нейронку чтобы сделать краткую выжимку, потом эту выжимку отправляет в другую нейросеть, чтобы сделать презентацию, чуть ее подправил и отправил руководству. И вроде все хорошо, менеджер меньше чем за час выполнил поставленную задачу и все довольны. Да? И да и нет. Задача выполнена, но при этом конфиденциальные данные были отправлены в целых 2 внешние нейронные сети. Вы можете спросить: а что в этом плохого? Да нейросети не удаляют данные, а используют их для последующих ответов.

Проверить это очень просто, можете в нейронке, которую вы сами часто используете, задайте вопрос: «Что она знает о вас?» И посмотрите, что она вам выдаст.

Излишние затраты при внедрении ИИ

Все предыдущие угрозы были про внешние нейронки, но можно же внедрить нейронку у себя в организации и не отправлять данные во вне. Да, можно, но…

Разворачивание своей ИИ связано с дополнительными затратами на железо, ПО, лицензиями и подписками, наймом специалистов по обучению, настройке и эксплуатации нейросетей. И так как сейчас эта тема на хайпе все пытаются внедрить нейронки в каком-либо виде в разные процессы в организациях не смотря, а какой профит они дают, стоят ли временные и денежные затраты тех улучшений, что будут на выходе.

По Интернету сейчас ходит веселая история как специалист внедрил нейросеть в компании потратив 1,5 млн долларов ежегодно, чтобы ей пользовались все сотрудники организации (4000 сотрудников), а по факту ей пользовались человек 50 в пике. Но при этом руководство было довольно так как все графики показывали рост.

Да и в принципе сейчас опросы показывают, что использование ИИ не дает сильного прироста в эффективности или прибыли, при этом внедрение нейроалгоритмов может создать угрозу в том, что замещение каких-то специальностей на ИИ вызовет непонимание и отторжение и как следствие, вот тебе новый недовольный работник, который может саботировать работу или отомстить при увольнении.

Поэтому если вы решаете применять нейронку в каком-либо процессе всегда смотрите, а стоит ли это того и не выстрелите ли себе в колено.

Отупение специалистов

Зачем человеку думать, анализировать, если так просто спросить у ChatGPT и мгновенно получить ответ?

Пример из личной жизни: запросил я у сетевого администратора выгрузку маршрутизации с определенного оборудования, с которым он работает уже не первый год и этот специалист, не думая ни секунды сразу вбивает вопрос в нейронку, получает какой -то ответ и не читая, копирует его и вводит в устройство под учеткой администратора. В тот раз ему повезло, и он получил нужную информацию, но всегда ли ему будет так вести? И вообще… а нужен ли такой «профессионал»? Человек не знает и не понимает, что делает та или иная команда, на сколько нейросеть правильно поняла запрос и не превратит ли данная команда оборудование в «кирпич».

Тоже самое происходит и с программистами и менеджерами. Зачем думать если можно не подключая мозг выполнить задачу. Но зачем такой специалист нужен, и как он планирует расти и развиваться, ведь даже школьник может его заменить в таком случае. Поэтому чтобы не быть таким «профессионалом» вникайте в то, что выдает нейросеть, что делает код, который она написала или команда, которую она выдала разбирайтесь и в следующий раз вам уже не нужна будет «сторонняя» помощь и вы все будете знать и уметь применять сами, а иначе вас проще всего заменить, чем тратить деньги на вас.

Мимикрирование вредоносного ПО под приложение с ИИ.

Ну и наконец если что-то где-то пользуется спросом, то там всегда найдется тот, кто решит на этом заработать и использовать высокий спрос в собственных целях.

Подавляющее большинство обычных людей не знают, как выглядят оригинальные приложения или порталы нейросетей, да и конечно все знают про великое слово «Халява» у нас в России, а тут выскакивает баннер:

«функционал как у ChanGPT, но абсолютно бесплатно»

Человек заходит регистрируется, на том сайте действительно может быть подключена какая-нибудь генеративная нейросеть и она даже выдает какие-то ответы пользователю, но при этом может попросить поставить агент чтобы: «ответы были более тагетированные» или формулирует ответы так, чтобы выманивать дополнительную информацию. И таким путем пользователь сам передает злоумышленнику всю необходимую для проведения атаки информацию.

«Лаборатория Касперского», привела статистику и подтвердила, что в 2025 году злоумышленники всё чаще маскируют вредоносное ПО под утилиты на основе искусственного интеллекта. Например, за первые четыре месяца 2025 года только количество уникальных вредоносных файлов, имитирующих ChatGPT, выросло на 115%.

Или еще пример, шпионская программа ResidentBat, которую, по данным на 2025 год, использовали для скрытого наблюдения за пользователями Android-устройств в Беларуси.

ResidentBat маскировался под обычное приложение и не эксплуатировал удалённые уязвимости: его установка возможна только при физическом доступе к устройству. После активации программа получала доступ к звонкам, SMS-сообщениям, данным мессенджеров, локальным файлам, а также могла записывать звук и экран, то есть полностью отслеживать активность владельца устройства.

Поэтому скачивайте приложения только из официальных магазинов, проверяйте названия сайтов, галочки верификации и не ведитесь на красивые баннеры.

Вывод

Вот такие неявные и неочевидный угрозы я вижу со своей мааааленькой колокольни. Всегда помните, что нейросети это не панацея, которая сделает за вас всю работу, а просто один из рабочих инструментов профессионалов, позволяющее делать чуть-чуть больше и смотреть немного шире.

А какие вы выделяете для себя опасности использования искусственного интеллекта? Или вы считаете что все это просто домыслы и все будет хорошо?

Делитесь вашими мыслями в комментариях, а я пошел формулировать новые Мысли Starого.

Подписывайтесь на все мои остальные мои ресурсы, там есть что почитать:

Если у вас есть мысли, факты, истории, которыми вы хотели бы поделиться, присылайте на почту: stariithinks@gmail.com или stariithinks@yandex.ru

Ответ на пост «Сынок года»3

Вот все плюются на "искусственный интеллект", на засранные генеративным контентом паблики, а я смотрю, и вижу шанс.

Вот год другой, и будет у меня носимый регистратор пишущий всё что можно. Может лет через пять он у меня будет с автономной нейронкой, а пока пусть все мои цифровые артефакты жизнедеятельности логируются. Плевать на паранойи. Уж как-нибудь...

Надеюсь. что к моей деменции будет у меня нейронка, которая половину моего взаимодействия с внешним миром сможет фильтровать и восстанавливать при распаде мозга.

Это не для меня, это для родных. Если у меня деменция, то мне как-то пофиг будет, наверно. Кукуха отрывается. Понимая как сейчас работают генеративные модели изнутри, понимая что моно на них соорудить, как обрабатывать и хранить артефакты моей жизни, я четко вижу как можно без всяких там нейролинков на обычной коляске с моторчиком, с обычной колонкой и некоторой привычкой к ИскИну-компаньону справляться с пучиной безмыслия. неприятных слов, необдуманных поступков.

Мне кажется детсятка-другого лет, прокрученных через LLM воспоминаний, переписок, текстов с тегом "МОЁ" отсюда с Пикабу... всего этого хватит, чтобы генеративная модель какого-то поколения уже могла не хуже меня общаться с моими родными в чатах, извиняться за неудобства, выражать желания, останавливать неправильные вещи...

Я уверен, что тут сработает концепция корабля Тесея, особенно в условиях старческого распада личности, буде таковой меня настигнет. Отстёгивающиеся когнитивные функции точно можно будет как протезы выносить на генеративную модель, обученную на моём значительном куске жизни.

Вот такой вот я технооптимист. Критикуйте. Интересны ваши мысли и какой я тут дурак. Уверен, что мы сможем нейросетью делать протезирование когнитивных функций при старческих деменциях.

Новогоднее поздравление лично от Деда Мороза!

🎄 Для создания такого видео потребуется выполнить несколько шагов в @gptcyber_bot

1️⃣ В боте перейдите в соответствующий раздел и выберите модель для генерации изображений, например, NanaBanana 2.

Для создания картинки с Дедом Морозом используйте следующий промпт, скопировав его без изменений:

«Кинематографический портрет доброго русского Деда Мороза, сидящего за деревянным столом в уютной украшенной комнате. Красно-синяя традиционная шуба, длинная белая борода. Он смотрит прямо в объектив камеры с теплой улыбкой. Рождественская елка на заднем плане, волшебное освещение, гиперреалистичный, 8k»

2️⃣ Генерация видео:

Перейдите в раздел «Генерация видео» и выберите модель Veo 3.1.

Загрузите полученное на предыдущем этапе изображение.

В поле для текстового запроса вставьте следующий промпт:

«Персонаж с загруженного изображения оживает. Он смотрит прямо в объектив камеры, поддерживает зрительный контакт и тепло улыбается. Он говорит на русском языке глубоким, добрым голосом, артикуляция губ полностью синхронизирована с речью. Он произносит фразу: "Здравствуй, [ИМЯ]! От всей души поздравляю тебя с Новым годом! Пусть этот год принесет тебе счастье!»

Важно: В промпте обязательно замените [ИМЯ] на имя человека, которого вы хотите поздравить.

Нажмите кнопку «Начать генерацию»

🎄 Обработка займет около минуты, после чего вы получите готовое видео с персональным поздравлением.

➡️ Наш бот в тг: https://t.me/gptcyber_bot?start=utm_sotr