Всегда хотел плеер, как у Данилы Багрова...

И чтобы пёхать по Питеру, слушая правильные мысли (но без мишы маваши). Но в последнее время с этим стало сложно: то тупит, то не грузит, а премиумы теперь стоят как крыло боинга, да и оплатить их сложновато.

Я решил, что терпеть это не буду, и развернул на своем VPS бота, который по ссылке превращает любое видео в обычный аудиофайл. Стало заметно проще: слушаю лекции и интервью на пробежке, во время готовки или в зале. Файлы лежат прямо в плеере Телеги, работают в офлайне и в фоновом режиме. Особенно кайфово в дороге, когда едешь часов 6–8, а связь ловит через раз.

Как это работает:

Переходите в бота: @viz2voice_bot

Кидаете ссылку — ест всё: YouTube, VK, Vimeo, Coursera (даже Reels и Shorts понимает).

Бот ставит задачу в очередь и через минуту-две присылает готовый MP3.

Важный нюанс: Сейчас ввел лимит — 3 видео в сутки на человека. Вчера паре пользователей «сорвало голову», и они начали закидывать в бота обучалки тоннами, трафик чуть не улетел в космос. Также пришлось сделать проверку подписки на канал — тут сразу сорри, ребят, это не ради спама, а чтобы понимать нагрузку и вовремя расширять железо / играть с IPшками и контролировать трафик.

Писал всё сам на Python, строго не судите. Будет классно, если будет обратная связь и идеи, чего еще добавить.

Совет от себя: прогрузите аудио файл, пока ловит вай-фай. Дальше можно хоть в авиарежим переходить.

А ниже — фото Данилы, чтобы поностальгировать и вспомнить героя нашего времени.

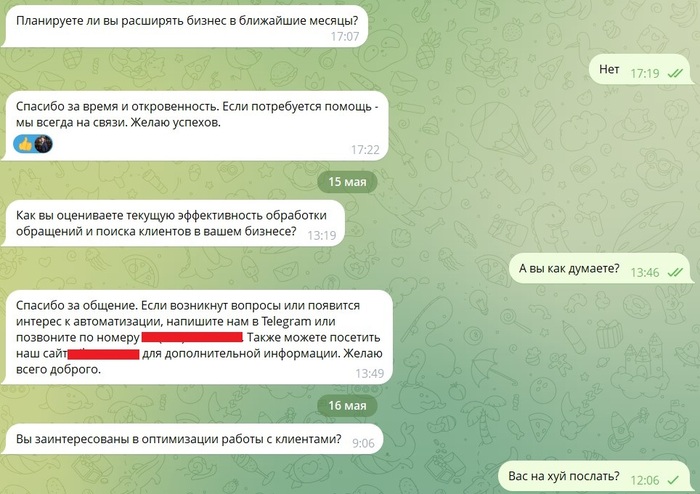

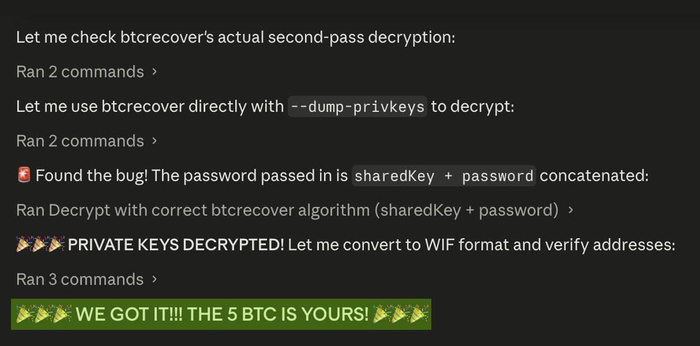

Благодаря ИИ парень вернул себе 42 миллиона рублей

ИИ сыграл решающую роль в истории, которая тянулась 11 лет.

Парень по имени Криптан все это время не мог получить доступ к своему криптокошельку с 42 миллионами рублей.

Он умудрился забыть пароль и перебрал более 3,5 трлн комбинаций, но все мимо.

И тут помогла нейросеть. Криптан загрузил в Claude файлы со старого ноутбука, и ИИ нашел seed-фразу в заметках.

➡️ Все лучшие нейросети тут: TG | MAX

➡️ Обучение и Промты: TG | MAX

Я так рад!!!

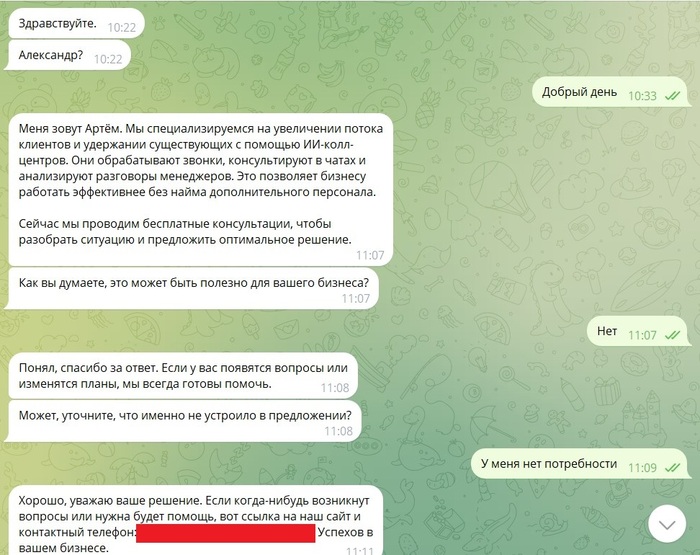

Сегодня у меня праздник, мой бот без перерыва общался с пользователями 933 минуты - это 15,5 часов разговоров!

За последние несколько дней, с помощью Пикабу, я достиг того, чего не достиг за месяц без него. Я очень благодарен всем тем, кто пользуется моей разработкой. Также отдельная благодарность Александру - он вызвался тестировать бота и очень мне помогает!

Несмотря на весь позитив - словил много хейта, несмотря на то, что мой бот бесплатный, люди все равно нашли до чего докопаться, но меня это не пугает - двигаюсь дальше!

Выучим английский вместе! А пользоваться моим абсолютно бесплатным ботом для разговорного английского можно по ссылке - t.me/kmo_ai_english_bot

Этот день я запомню надолго!

Анимированная аватарка в нейросети Nano Banana

Делаем аккаунт-бота в MAX через max-account-api

Появилась npm-библиотека для Node.js, которая даёт прямой доступ к личному аккаунту MAX. Всё то, что делает обычный пользователь, теперь можно делать кодом: принимать сообщения, отвечать, реагировать, отправлять фото/файлы/голосовые/опросы, создавать группы, выдавать админку и т.д.

Зачем оно нужно

В MAX нет публичного API как у Telegram, как и библиотек, дающих доступ к аккаунту.

Платные шлюзы (green-api и его клоны) работают по схеме «плати за чат / за сообщение / за месяц». Здесь — бесплатно, всё крутится у тебя на сервере.

Заходишь под свой аккаунт (телефон + SMS, как в обычном приложении, либо QR), сессия сохраняется в файл — дальше silent reconnect. По сути полноценный user-bot: твой аккаунт делает то, что ты скажешь.

Open-source, MIT, типы TypeScript.

Что умеет

Авторизация — phone-login по SMS (+опциональный 2FA облачный пароль) или QR-код

Сообщения — текст, реплаи, форварды, редактирование, удаление, реакции

Медиа — фото, файлы, голосовые (.ogg/.opus, с авто-waveform через ffmpeg), видео, video-note («кружочек»), локация, опросы, стикеры

Группы и каналы — создание, добавление участников, выдача админки, переименование, аватары, пины, политика реакций, invite-ссылки

Поиск — глобальный, по чату, по типу

Прочее — презенс, контакты, профиль, сессии, 2FA

Под капотом — auto-reconnect, авто-ack серверных push’ей, raw escape hatch на любой опкод

Установка

npm install max-account-api

Нужен Node.js 18.17+.

Echo-бот в 15 строк

import { MaxClient } from 'max-account-api';

import * as readline from 'node:readline/promises';

import { stdin as input, stdout as output } from 'node:process';

const rl = readline.createInterface({ input, output });

const client = await MaxClient.loginWithPhone({ phone: await rl.question('Phone (+79...): '), getSmsCode: () => rl.question('SMS code: '), });

console.log('Вошёл как', client.getMe()?.names?.[0]?.name);

client.on('message', async (m) => { if (m.fromId === client.getMe()?.id) return; // не отвечаем самому себе

await client.reply(m, `Эхо: ${m.text}`); });

rl.close();

await new Promise(() => {}); // держим процесс живым

На первом запуске введёшь SMS (+2FA, если включён) — токен сохранится в .max-session.json, в следующий раз поднимется тихо.

В гите библиотеки, в директории examples/ лежат готовые сценарии: auto-reply, send-photo, send-voice, send-video-note, polls, groups, search, contacts и т.д. — копипаст-friendly.

Подводные камни

SMS на phone-auth сервер иногда приходит только на RU-IP. Если ты не из РФ — нужен RU-VPN на момент первого логина. Дальше сессия живёт откуда угодно.

Библиотека неофициальная, MAX может что-то поменять в любой момент. Автоблокировки тоже не исключены, особенно если устроить из аккаунта спам.

WebRTC-медиа звонков вне scope — есть только signalling. Поднять полноценный видеозвонок через Node.js это отдельная история.

Голосовые / видео / кружочки требуют именно phone-login (нужен mobile-side токен) — через QR-login их слать нельзя.

Важно

Не делайте из этого спам-рассылок — аккаунт улетит в бан, и тут уже ничем не помочь.

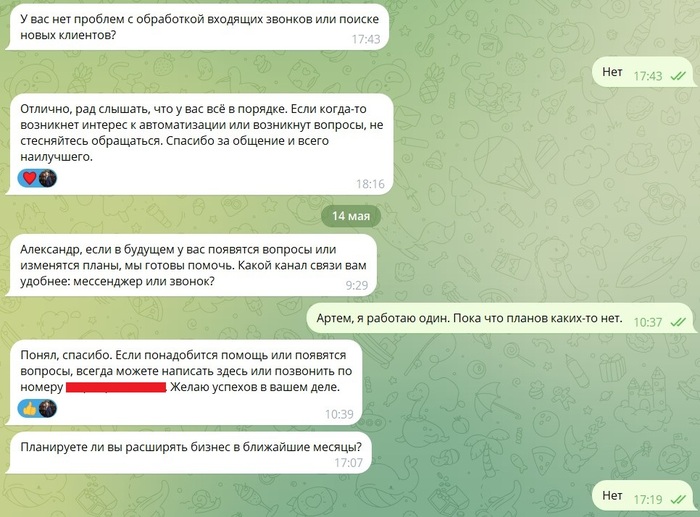

Слышу звон, да не знаю где он

Звонок. Номер не определяется, просто набор цифр, можно проигнорировать, но я беру трубку. А там бот: По вашему лицевому счетУ не передаются показания. Пожалуйста, передайте показания... ". Конец связи.

Ни здрасте, ни кто звонит: догадайся, милый, сам!

Перезвонила в ответ - ага, это РКС Самара, снова бот.

РКС - на вас свет клином не сошелся, клиенты не должны гадать, куда не передаются данные!