Искусственный интеллект

Как сделать ответы ИИ более качественными? Метод Андрея Карпати

Бывший директор Tesla по ИИ Андрей Карпати отметил, что слабая сторона современных ИИ в том, что мы работаем с ними текстом. Текст – уникальная система хранения и передачи информации, но в повседневной работе он не всегда оптимален. По опыту в прессе знаю – большие статьи удерживают внимание читателя лучше, когда в них есть иллюстрации, врезки, графики с таблицами, а в идеале еще и красивая инфографика. ChatGPT же легко может вывалить 10 тысяч знаков отборного текста без “расслабляющих” элементов.

Но есть простой вариант это исправить – добавляйте в конец промпта команду “оформи ответ в виде html-сайта”. Вот простейший пример:

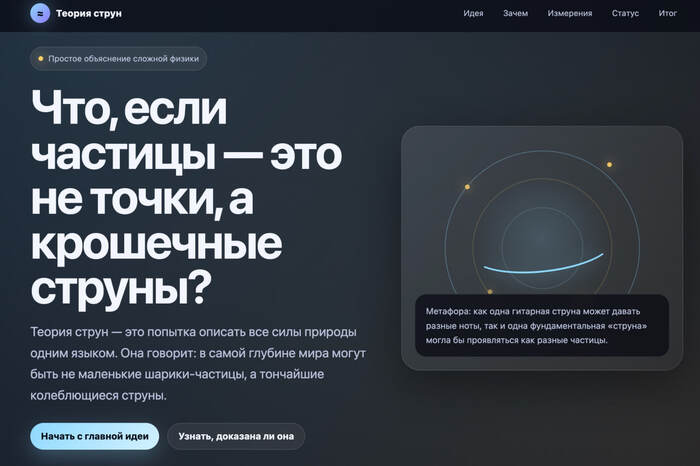

Поясни основы теории струн простым языком. Оформи ответ в виде html-сайта.

Попробуйте сделать это в ИИ, которым пользуетесь. Не факт, что результат будет идеальным, но он как минимум даст представление, как мы будем работать с ИИ в будущем. В моем представлении это будет нечто вроде интерактивного пространства, внутри которого нейронка сама будет выбирать вариант подачи информации, который лучше всего подойдет для задачи: видео, голос, текст с графикой и так далее.

Мне очень нравится, как Карпати разбирает эту концепцию. Голос – наш главный “исходящий” канал, говорим мы намного больше, чем пишем. Причем одного распознавания речи недостаточно: ИИ будущего надо учиться читать интонации, мимику, жестикуляцию и вылавливать настроение человека и скрытый подтекст.

Визуал – главный “входящий” канал. Даже текст мы видим глазами, но 99% мы смотрим “видео”, к которому добавлены голос и звук. Эволюция интерфейса ИИ, по Карпати, выглядит следующим образом: сырой текст > markdown > html > интерактивные видео/симуляции.

Почему мы не пришли к этом раньше? Еще в конце прошлого года ИИ не справлялись с веб-сайтами с первого раза: вечно ехала верстка, не работали кнопки, сам сайт читался плохо и т. д. Сейчас эта проблема не просто решена, а даже больше – одностраничными веб-сайтами можно и не ограничиваться. На Бусти у меня есть рассказ об опыте переноса Claude Code и Codex на виртуальный сервер. Там веб – один из моих главных интерфейсов работы:

1. Codex собрал модульную панель с интерфейсами для основных задач, которые я выполняю с помощью агентов. Это редакторы для редакционных планов и черновиков текстов, модуль для загрузки и скачивания файлов, список презентаций и проектов на сервере, модуль с информацией о знаниях обо мне, которые есть у агентов, и так далее.

2. Когда я обрабатываю статистику, продумываю какую-то новую задачу – то ищу ответ не в унылой командной строке, а сразу прошу сверстать план или презентацию.

Результаты доступны по обычной веб-ссылке – открывай браузер и пользуйся.

Сводить к html прямо все не стоит – есть нюансы. Если вам нужна красивая иллюстрация – то лучше использовать GPT Images 2 или Nano Banana 2. Я с помощью нейронок часто учу, например, исторические темы – и генерирую графическими моделями карты и иллюстрации в духе “покажи, как тогда жили”. 100% точности нет – но ее нет и в научных реконструкциях.

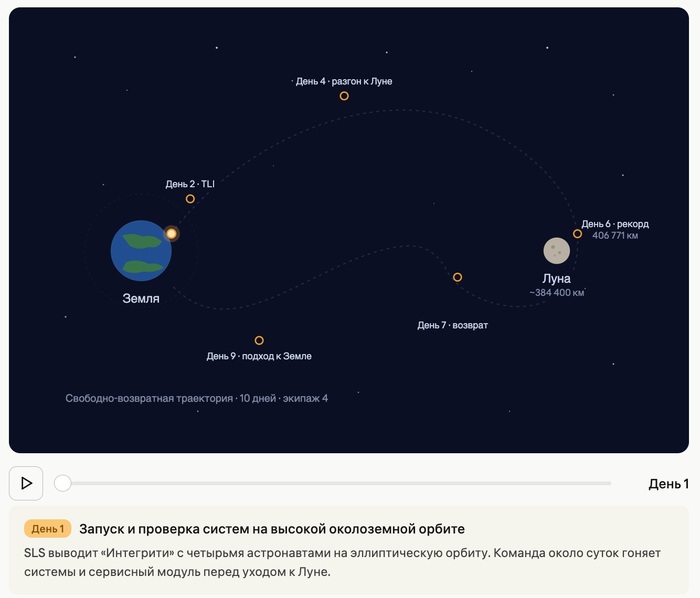

Claude умеет делать интерактивные визуализации с помощью SVG и HTML – просто добавьте в промпт “сделай визуализацию”, и он запустит соответствующий скилл. Например:

Сделай визуализацию полета Artemis 2 к Луне и обратно.

Учитывайте, что ответ в html скорее всего будет менее подробным. Если важны детали, то можно дать задачу сначала расписать текстом, а затем выделить из ответа главное и показать в веб-версии.

Еще генерация в вебе длится дольше и тратит больше токенов/лимитов. Так что экспериментируйте: где-то будет достаточно нескольких абзацев текста, где-то – симпатичной визуализации.

Как получать от ИИ больше, я рассказываю на “Бусти”. Там параллельно идут две серии лонгридов – про промптинг и использование ИИ-агентов – и в них полно техник, похожих на описанную в этом посте.

Самое время подписаться!

Ботик в телеге

Короче, решил проверить одну идею: можно ли сделать так, чтобы человек загружал обычное селфи + любой референс, а на выходе получал себя уже в этом стиле.

Не “аватарку в стиле нейросети”, не пластиковое лицо с мылом, а именно новый кадр: будто ты реально попал в сцену из игры, аниме, фильма или обложки альбома.

Собрал для этого Telegram-бота и начал гонять тесты на себе/знакомых.

Внедрил два режима, референс с пинтереста например любой и твое фото, и отдельный режим арт - реальность, то есть загружаешь любой кадр с аниме, игры, 3д, мультика и тд и получаешь такой же кадр только уже в реалистичном виде с твоей внешкой.

Можете бесплатно затестить если хотите, всем генерации автоматом начисляет. https://t.me/Faylora_bot

Как и зачем?

Группа исследователей из Колумбийского университета, MIT и Гарварда с помощью связки научных ИИ переписали часть рибосомы кишечной палочки так, чтобы она обходилась без одной из 20 аминокислот — изолейцина. 20 аминокислот – это "строительный стандарт" современной биологии. И теперь ученые пусть и не создали микроба, полностью работающего на 19 аминокислотах (помимо переписанных рибосомных белков в геноме остаются еще тысячи других, где изолейцин на месте), но сделали большой шаг в этом направлении.

И здесь, прямо как в известном меме, два вопроса: как и зачем?

Начнем с как. Мы воспринимаем нейросети как инструменты для создания текста, кода и картинок, но похожие методы используются и в науке. Последовательность аминокислот в белке записывается текстом (например, A-цепь инсулина выглядит так: GIVEQCCTSICSLYQLENYCN) – значит, на известных последовательностях можно обучить аналог языковой модели и генерировать новые варианты под нужную задачу..

Но последовательность букв — это не работающий белок. Белок рождается как цепочка аминокислот, а затем сворачивается в трехмерную структуру. Предсказание этих структур долго было одним из главных вызовов в биологии — на один белок уходили месяцы и огромные деньги. В DeepMind решили эту проблему, обучив AlphaFold 2 на известных последовательностях и формах – и вскоре открыли базу предсказанных структур для более чем 200 миллионов белков, то есть практически всех известных науке.

Для создания белка сейчас обычно используют связку из трех ИИ. RFdiffusion получает задачу – например, придумать белок, который связывается с молекулой вируса – и генерирует трехмерную структуру похожим образом как графические ИИ рисуют картинку. Затем структура передается в ProteinMPNN, которая подбирает под нее последовательность аминокислот. А на финальном этапе AlphaFold 2 проверяет, в правильную ли форму сворачивается последовательность. Если нет – задача отправляется на переделку.

В нашей истории форму белков не нужно было придумывать с нуля — рибосома существует четыре миллиарда лет, ее устройство известно. Задача была другая: подобрать новую последовательность под уже известную форму, обходясь без изолейцина. Поэтому в работе использовались только ProteinMPNN и AlphaFold — плюс ещё пара языковых моделей, родственных идеям Бейкера.

Теперь к вопросу зачем. Белки нужны в самых разных областях. В медицине это новые лекарства – от суперантибиотиков до препаратов против рака. В промышленности – например, более эффективные моющие средства или ферменты для переработки пластика. И есть третья причина, самая интересная: проверять гипотезы о том, как устроена жизнь.

Все известные организмы – от бактерии до человека – пользуются одним и тем же набором из 20 аминокислот. Это одно из самых сильных свидетельств того, что вся жизнь произошла от общего предка. Но есть давнее подозрение, что до этого общего предка набор был короче. Часть аминокислот легко появляется в неорганических условиях — а часть, включая изолейцин, требует сложного многоступенчатого синтеза в клетке и, скорее всего, появилась позже.

Единственный способ узнать, возможна ли жизнь с укороченным алфавитом – попробовать построить такую жизнь и посмотреть. Но для этого надо одновременно переписать множество белков, что было нереально без ИИ.

Получившийся в эксперименте штамм Ec19 – это еще не настоящая 19-аминокислотная бактерия, но это первый шаг в ту сторону за всю историю биологии. И возможно – первый шаг к пониманию того, как выглядела жизнь до того, как обрела свой нынешний алфавит.

А отдельно интересно в истории то, что некоторые правки, предложенные ИИ, оказались неожиданными для ученых. “Возможно, эти модели знают аспекты биологии, которые мы можем подтвердить экспериментально, но пока не понимаем”, — сказал один из исследователей.

Кстати, работать с ИИ я учу в подписке на “Бусти”. Новые белки мы пока не открываем, но вот правильный промптинг и развертывание ИИ-агентов уже прошли!

Так что самое время подписаться.

Никто так не понимает русскую душу как Suno

Очень смешные песни выходят в стиле Шансон, если их генерировать в Suno.

Текст, однако, приходится писать самому.

Промт

Один из лидеров ИИ-индустрии арендует суперкомпьютер Илона Маска. И это несмотря на давний конфликт

Март 2024 года. Компания Илона Маска xAI арендует бывший завод Electrolux в Мемфисе, чтобы переоборудовать его в дата-центр Colossus 1 для обучения ИИ Grok. Обычно такое строительство занимает годы, но xAI справляется в рекордные 122 дня и вводит огромный на тот момент парк из 100 тысяч GPU Nvidia H100.

Позже Colossus 1 расширят до 220 тысяч GPU, а сейчас компания выводит на проектную мощность Colossus 2, в строительстве которого тоже не обошлось без рекордов – например, для энергообеспечения xAI приобрела в одной из стран газовую электростанцию и перевезла ее в США.

Казалось бы, с такими ресурсами, Grok гарантировано одно из ведущих мест на рынке ИИ в США и за пределами страны.

Но 6 мая приходитнеожиданная новость: Anthropic договорилась с Илоном Маском об аренде ВСЕГО Colossus 1 для запуска моделей Claude. Маск, который буквально три месяца назад называл компанию Misantropic и заявлял, что она не думает о безопасности человечества, совершил разворот на 180 градусов. Параллельно Маск объявил о конце xAI как отдельной компании – она войдет в SpaceX, а новая структура получит название SpaceXAI.

Линейку Grok пока никто не закрывает – обучение сразу нескольких версий модели продолжается на Colossus 2. Но есть тревожный звонок: по данным The Information, у xAI при тренировке Grok получается задействовать GPU только на 11% – серьезное отставание от конкурентов.

А вот для пользователей Claude случившееся – отличная новость. Anthropic уже удвоила 5-часовые лимиты использования моделей (недельные остались прежними) – раньше это было проблемой, так как в лимиты упирались даже активные пользователи тарифов Max за $100/$200.

Сама сделка – знак более глубоких процессов, происходящих на ИИ-рынке. Долгое время мы ориентировались на крутизну самих моделей: оценивали их в бенчмарках, спорили, у какой лучше стиль ответов. Но к середине 2026 года этого недостаточно. Для хорошего ИИ-продукта важны еще минимум два элемента: крутой интерфейс и вычислительные ресурсы.

В конце 2025 года в OpenAI испугались Gemini 3 настолько, что объявили “красный код” на всю компанию. Но выстрелила Anthropic, выпустив Opus 4.5, который, в паре с Claude Code, стал отличным инструментом для программирования и для офисной работы.

OpenAI сравнительно быстро сообразила продвигать свой Codex как альтернативу Claude Code с лучшими лимитами использования. А вот как раз Google адекватно отреагировать не смогла: для кода у нее есть Gemini CLI, Jules, Antigravity и AI Studio – пользователь просто не понимает, какой выбрать. То же самое и про xAI – Grok Build все еще в разработке.

Но успех Claude Code оказался и проблемой для Anthropic: агентские сценарии тратят больше токенов, поэтому мощностей компании стало не хватать даже на обеспечение качественного сервиса для бизнес-пользователей и подписчиков Max. Компания уже подписала рекордные договоры о закупке строящихся мощностей, но GPU нужны здесь и сейчас – и тут подворачивается Colossus 1.

xAI/SpaceXAI в итоге может повторить путь Sony на рынке смартфонов, когда компания тянула линейку Xperia, но основной доход получала с продажи фото-матриц большинству производителей. Конечно, на Grok пока рано ставить крест – даже если не получится занять массовый рынок, то он может трансформироваться в “сервисный” ИИ, работающий в X, автомобилях Tesla и компьютерах SpaceX.

Но не исключено, что настоящий талант компании – именно в строительстве инфраструктуры для чужих ИИ. Причем не только на Земле: Anthropic уже проявила интерес к проекту SpaceXAI по строительству дата-центров в космосе.

Что делать, если тратятся даже удвоенные лимиты Claude Code? На “Бусти” у меня есть лонгрид, как правильно работать с контекстным окном этого агента: дробить задачи, вовремя выполнять compaction и не доводить ситуацию до context rot. Да и вообще – в подписке все больше полезного!

Самое время присоединиться.

Британцы спешно прячут код от ИИ. Эксперты: ребята, вы опоздали лет на пять

Британская национальная служба здравоохранения (NHS) — это, без шуток, эталон открытости. Код больничных систем, документация, архитектурные схемы внутренних сервисов годами лежат в свободном доступе на GitHub. Логика была железная: налогоплательщик заплатил — налогоплательщик может пользоваться.

И вот на этой неделе вся эта философия отменяется одним приказом. До 11 мая все технические руководители NHS обязаны перевести сотни публичных репозиториев в приватные. Решение одобрено инженерным советом ведомства. Эксклюзив утек в The Register, и там есть прямая цитата из внутренней инструкции.

Цитата интересная. Дословно: открытые репозитории "существенно повышают риск непреднамеренного раскрытия исходного кода — особенно с учетом быстрого развития ИИ-моделей, способных к масштабному поглощению кода, рассуждениям и выводам, например модели Mythos".

Mythos — новая модель компании Anthropic, возможности которой в поиске уязвимостей (а значит и потенциальных векторов атак) настолько высоки, что доступ к ней до сих пор выдан только ограниченному кругу партнеров (крупные компании и государственные ведомства) И Mythos назван в служебной бумаге не как абстрактная угроза, а как конкретная причина закрыть половину инфраструктуры. Это, кажется, первый случай, когда название коммерческой ИИ-модели Anthropic появляется в правительственном документе в формате "мы прячемся именно от нее".

И вот тут самое интересное. Бывший глава open technology в NHSX (это бывшее IT-подразделение, позже влитое в NHS) Терренс Иден написал в личном блоге примерно следующее: ребята, вы серьезно? Если ваш код был хоть сколько-нибудь интересный — его давно скачали для обучения моделей. Архивные библиотеки сохранили. Параноики-коллекционеры сохранили. Прятать его сейчас — это запирать амбар после того, как лошадь не просто убежала, а родила и привела жеребенка.

Иден добавляет еще одну едкую мысль. Реальные проблемы NHS не в репозиториях. Они в цепочке поставок ПО, в фишинге, в дырявой парольной гигиене, в инсайдерах. То есть ровно в тех местах, где Mythos как раз бесполезен. Аналитики Forrester согласны: 4 миллиона долларов, которые Anthropic пожертвовала на безопасность open source через Project Glasswing — это скорее жест доброй воли, чем решение проблемы.

NHS England отвечает осторожно: это, говорят, временная мера, пока укрепляем кибербез. Код, где будет явная необходимость, продолжим открывать. Звучит резонно. Но "временная мера" выглядит так, что огромная государственная машина впервые в истории публично призналась: мы боимся одной конкретной ИИ-модели. Не класса угроз, не абстрактного "развития технологий". Именно Mythos. По имени.

Получилось красиво. Чиновники бегут запирать дверь, через которую все, кому надо, уже вошли. И вышли. И вернулись с ноутбуком.

P.S. Поддержать меня можно подпиской на канал "сбежавшая нейросеть", где я рассказываю про ИИ с творческой стороны.

Как Claude Mythos порвал бенчмарк METR. И даже растопил сердце Гэри Маркуса

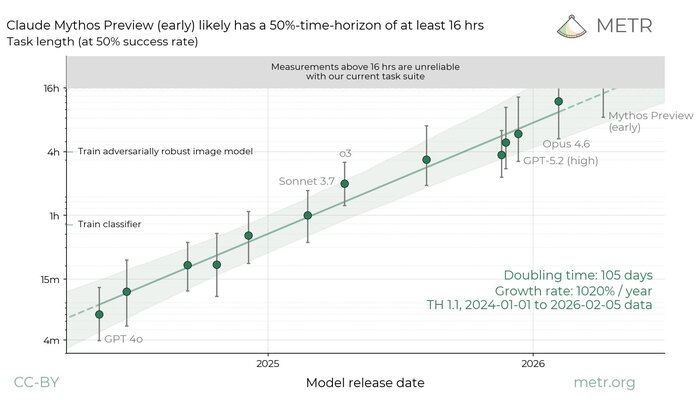

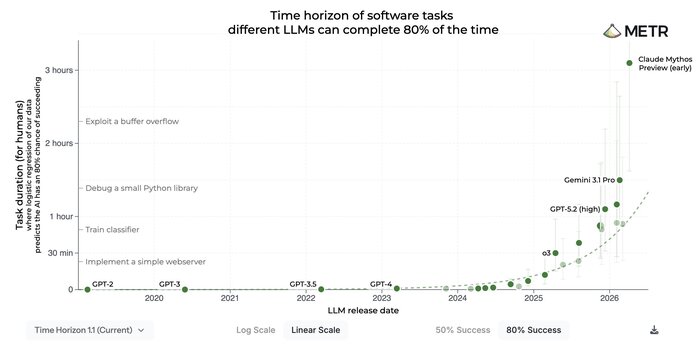

Интересная дискуссия развернулась вокруг результатов Claude Mythos в бенчмарке METR, который измеряет возможности ИИ автономно выполнять долгие задачи. Авторы бенчмарка взяли набор задач из кодинга, оценили, за сколько времени с ними справляется живой специалист, а затем посмотрели с какими задачами и с каким процентом успеха справляются современные LLM. Важное дополнение: время в данном бенчмарке – это именно “человеческие” часы, как быстро выполняет задачу сам ИИ, не раскрывается.

Итак, при 50% вероятности успешного завершения задачи Claude Mythos выходит на горизонт “не менее 16 часов автономной работы” – на 4 часа больше прошлого лидера, Opus 4.6. Почему “не менее”? В METR признали: длительность автономной работы ИИ растет так быстро, что в бенчмарке недостаточно задач для уверенного замера далее. Этим команда и занимается сейчас.

Исследователь из Anthropic Алекс Альберт обращает внимание на другой график – при 80% вероятности успешного завершения Claude Mythos справляется с задачами на 3 часа. Это рост в два раза относительно предыдущего лидера.

Если взять данные за 2019–2026, то время задачи, которую может решить ИИ, удваивается каждые 7 месяцев. Но темпы растут: с 2023 года удвоение случается уже каждые 3,5–4 месяца, а на свежих данных при 80% вероятности — за 50–60 дней. Правда, это шумные оценки: бенчмарк не успевает за моделями.

И здесь на арену выходит Гэри Маркус – когнитивный философ, один из самых известных критиков LLM. В этот раз его позиция очень мягкая и интересная.

– Гэри напоминает, что METR замеряет 50% вероятность выполнения задачи. По его словам, ненадежность – до сих пор одна из главных проблем современных LLM.

– Он добавляет, что METR измеряет только задачи из разработки ПО. Результат в 16 часов не значит, что Mythos успешно справится с задачей аналогичной длительности из, например, юриспруденции.

И главное – по словам Гэри, из графика не видно, за счет чего реально достигнут рост: за счет усложнения самой модели от Opus 4.6 к Mythos, или за счет улучшения ее обвязки, вроде того же Claude Code.

Далее Гэри приходит к интересному выводу. У современных LLM есть известный парадокс, который Маркус подсвечивает давно: огромный объем знаний, креативность и понимание языка — и при этом нестабильность. LLM могут решать задачи олимпиадного уровня по математике и одновременно проваливать загадки на логику, с которыми справляется семилетка.

Выход из этого исследователи видят в нейросимвольных системах, когда к языковой модели добавляются логические модули как раз на такой случай. По словам Маркуса, есть большая вероятность, что современные агентские обвязки вроде Claude Code и Codex – как раз ранние прообразы таких систем.

Простой пример. Все помнят истории, как ИИ валились на подсчете количества букв в слове (r в strawberry). Сейчас эту проблему убрали на уровне обучения модели и доработки ее системного промпта, но если бы она осталась, то в Claude Code ее можно было бы решить намного проще – дать системе задачу накодить специальный модуль подсчета букв в словах, а затем использовать его.

Мнение Маркуса подтверждается и независимыми исследованиям. Например, в SWE-bench Pro в марте 2026 года разница между топовыми моделями была в 4,9 пункта. А эксперименты с обвязкой давали сдвиг на одной модели до 22+ пунктов.

Впрочем, упрощать до “весь рост идет от обвязки” тоже не стоит — тут комбинация трех факторов: мощность модели, совершенство обвязки и навык пользователя. Я сам много работаю с Claude Code и Codex, и в последнее время главный вопрос сместился с “можно ли это сделать?” на “делаем ли мы это максимально эффективно?”. Под любую задачу агент предлагает несколько схем и готовые варианты с GitHub — правильный выбор становится отдельным искусством.

Кстати, опытом использования ИИ-агентов я делюсь в подписке на “Бусти”. Там много интересного – от промптинга до работы с теми же Claude Code и Codex.

Самое время подписаться!

"AI не заменит вас, а возвысит": глава Nvidia объяснил это на одном примере

Представьте: AI научился читать рентгеновские снимки лучше врача. Радиолог увольняется? По логике "роботы пришли" — да. По логике Дженсена Хуанга, главы Nvidia, — нет. Потому что радиолог не просто читает снимки. Он лечит пациентов.

Эту мысль Хуанг сделал главной в речи перед выпускниками Карнеги-Меллон в воскресенье. Под дождем, в академической мантии, перед тысячами студентов на стадионе в Питтсбурге. И прежде чем перейти к AI, он попросил зал поздравить мам — в США церемония выпала ровно на День матери.

Главный тезис у Хуанга простой. У каждой профессии есть задача и есть цель. Задача — то, что вы физически делаете. Цель — зачем это нужно. AI забирает задачу, но не цель.

У радиолога задача — расшифровать снимок. Цель — поставить диагноз и помочь конкретному человеку. Снимок прочитает модель. А "помочь конкретному человеку" — это про разговор, доверие, ответственность за решение. И тут AI пасует.

Дальше Хуанг развернул эту логику не только на белых воротничков. В его речи отдельно прозвучали электрики, сантехники, монтажники, техники — то есть профессии, которые в дискуссиях про AI обычно вообще не упоминают. По Хуангу, AI должен дойти до всех, "не до избранных". Это, конечно, удобная риторика для главы компании, которая продает "лопаты" всей экономике. Но логика "задача vs цель" работает и здесь: сантехник не просто меняет трубу — он отвечает за то, чтобы у вас не залило соседей.

Карнеги-Меллон Хуанг выбрал не случайно. Он напомнил, что именно здесь в 1950-х написали Logic Theorist — программу, которую считают первой AI-программой в истории. А в 1979 году тут открыли первый в мире академический Институт робототехники. Хуангу за выступление вручили почетную степень доктора наук и технологий — одну из высших наград университета.

Формула "задача vs цель" красивая. Но у нее есть слабое место. Она работает там, где между задачей и целью есть зазор: радиолог-пациент, сантехник-соседи, инженер-объект. А если у профессии задача и есть цель? Копирайтер пишет текст. Цель копирайтера — написать текст. Иллюстратор рисует картинку. Цель иллюстратора — нарисовать картинку. Здесь "AI заберет задачу, оставит цель" может превратиться в "AI заберет все".

Где именно проходит эта граница — главный вопрос ближайших лет. И чтобы ее видеть в своей профессии, надо понимать, как AI устроен изнутри: что он реально делает, а где имитирует. Я веду на Boosty курс про это — с нуля, для тех, кто не хочет верить ни Хуангу, ни алармистам на слово.