Математика

19 постов

19 постов

4 поста

12 постов

7 постов

3 поста

На вопрос о том, есть ли обещания, которые он дал себе перед наступлением Нового года, глава вашингтонской администрации ответил: «Да, есть. Мир на земле». Трамп не ответил на вопросы о том, готовы ли США направить свои войска на Украину, а также о том, какую роль сыграло ЦРУ в нанесении удара по Венесуэле. Трамп лишь улыбнулся и сказал журналистам: «Спасибо».

Владимир Зеленский ранее выступил с утверждением, что Киев обсуждает с Трампом размещение американских войск на Украине. Москва выступает против присутствия военнослужащих стран НАТО на Украине. 21 августа министр иностранных дел РФ Сергей Лавров подчеркнул, что обеспечение гарантий безопасности Украины путем «иностранной военной интервенции на какую-то часть украинской территории» для России будет неприемлемым.

Представьте: вы решаете задачу, всё идет гладко, но ответ никак не сходится. Вы перепроверяете, и снова та же ошибка. После разбирательств выясняется, что ваш мозг подсунул вам ложную информацию, уверенно выдав ее за правду. Знакомо? Это явление, которое исследователи ИИ называют «галлюцинацией» у нейросетей, часто происходит с людьми! В этом выпуске разбор, почему так происходит, как это связано с работой мозга и даже с тем, как сейчас обучают языковые модели.

В видео:

«Баг рендеринга в мокром железе»: Почему мы не видим мир как видеокамера, а скорее «предсказываем» его, и как это приводит к ошибкам, похожим на галлюцинации.

Система 1 против Системы 2: Как интуиция и логика работают в нашем мозгу, и почему наша «быстрая» система часто подводит нас, выдавая ложную информацию за истину.

Аналогия с GPT: Удивительное сходство между тем, как наш мозг ошибается, и как «галлюцинируют» большие языковые модели.

Реакция на ошибки: Почему стыд и отрицание — тупиковые пути, а инженерный подход к собственным ошибкам — ключ к развитию.

Chain-of-Thought для людей и машин: Как метод «цепочки рассуждений» помогает и нейросетям, и нам самим избегать ошибок.

Галлюцинации — не приговор: Почему нельзя доверять ни людям, ни нейросетям на 100%, и как построить надежную систему верификации вокруг них.

Это просто заметка про то, что нанабананой можно лепить комиксы по короткому описанию прямо на русском. (да, очередь местами направлена в непонятную сторону, но даже так это очень круто, если сравнить с тем что выдает Qwen - ниже) Вот такое описание было:

Давай сделаем мемасик. Молодой Кот в синей куртке и джинсах подходит к очереди на почту - хвост очереди выходит из дверей и завивается загзагами. К нему подходит Кот дедушка в широкополой шляпе, улыбается и говорит - "Когда я сюда пришел - мне было столько же сколько тебе..."

Тот же промпт как понял его Qwen:

Прогресс в понимании какой-либо темы можно улучшить не только решая задачи, но и создавая новые. Здесь создаем задачу, похожую на уже решенную недавно. В ходе разбора задач они отчасти теряют свою ценность для тех, кто понял из разбора как решается, но не прошел этот путь сам, не нашел решение, а просто увидел его и понял. Понять - это только часть-дела, а найти решение самому намного сложнее и при этом гораздо больше опыта можно извлечь из задачи. Создание новой задачи может отчасти помочь скомпенсировать это упущение потому что позволяет посмотреть на задачи с более глубокой точки зрения.

Можно пойти дальше - создать целое семейство похожих задач и разобраться как будет отличаться их сложность и возможно ли их генерировать алгоритмически или с помощью нейросетей? - Этот вопрос оставим на другой раз, а здесь только разберем пример составления новой задачи по данной решённой.

Создание своей задачи - хорошая самопроверка понимания изучаемой темы.

Песня про алгебру. По мотивам решения задачи

Текст песни:

Баллада о Дроби и Модуле

[Куплет 1: Тупик лобовой атаки]

Я помню чудное мгновенье:

Пример явился предо мной,

Как гений чистого мученья,

С четвёртой степенью, шальной.

Я мнил: возьму нахрапом твердь!

Деленьем в столбик, дерзко, прямо,

Но икс-четыре, словно смерть,

Не поддавался мне упрямо.

Остаток рос, как ком грехов,

Тринадцать икс квадрат в итоге…

Тупик! Увы, удел глупцов —

Ломать свой лоб в пустой тревоге.

Стратегию сменить пора!

Оставим лобовой таран,

Здесь нужна тонкая игра,

А не густой, слепой туман.

[Припев]

О, Алгебра! Гармония и яд!

Где дроби, словно дамы, прячут лица.

Сорвать вуаль — и весь расклад,

Но бойся на ноль поделиться!

Там Модуль, как двуликий страж,

Стоит на перепутье рока.

Решенье — это не мираж,

А путь, где логика глубока!

[Куплет 2: Разведка и Расщепление]

Взгляни ж на верхнюю строку:

И группируй, поэт, без страха!

Выносим куб, и на бегу

Там разность кубов — бьем с размаха!

На множители всё разбив,

Мы зрим трёхчлен квадратный гордый.

А в знаменателе — мотив

Звучит разведкой благородной.

Сложи-ка числа! Раз, пять, семь…

Их сумма — ноль! О, провиденье!

Единица — корень, ясно всем,

Нам не нужны теперь сомненья.

Искусным расщепленьем мы

Пятерку иксов расчленим,

И выйдем к свету из тьмы,

И скобку общую узрим!

[Припев]

О, Алгебра! Гармония и яд!

Где дроби, словно дамы, прячут лица.

Сорвать вуаль — и весь расклад,

Но бойся на ноль поделиться!

Там Модуль, как двуликий страж,

Стоит на перепутье рока.

Решенье — это не мираж,

А путь, где логика глубока!

[Бридж: Лимит и Лень]

Сокращено! Но погоди…

Не радуйся победе рано.

Там модуль ждет нас впереди,

Как соль для незажившей раны.

Но здесь умолкну я, друзья,

Боясь наскучить длинным слогом.

Домыслить вам! А мне — нельзя,

Я ограничен эпилогом.

Два случая, проверка, знак…

Ваш выход, зритель просвещённый!

Ты сам поймешь: что, где и как,

А я — ушел, раскрепощенный!

Еще одна задача из задачника Сканави на разборе.

Интересно становится, когда задаешься вопросами что за выражения в числителе/знаменателе и как узнать их корни? В общем случае для этого надо строить график функции и смотреть, при каких x она пересекается с осью X, но в случае данной задачи достаточно даже в уме попробовать подставить в x первые значения, которые придумываются.

Эта задача может быть для кого-то хорошая головоломка на способ рассматривания выражения и медитации над вопросом "Что это вообще такое я вижу?". Даже если при этом не знаешь почти ничего, то после достаточного времени в раздумьях над этим вопросом и всеми черточками и знаками можно прийти к интересным выводам. Чему как-раз и учит эта задача. Мы испортили ее суть разбором, но в задачнике рядом с ней (2.168) еще много похожих и для прохождения пути самостоятельно можно попытать счастья в соседних. Здесь можно скачать задачник.

Код анимации и спека здесь: https://gitverse.ru/Nikas/NeuralNet.2025/content/master/mani...

DevLog: Развитие цифровой жизни. Как нейро-рой учится выживать на фотоматрице.

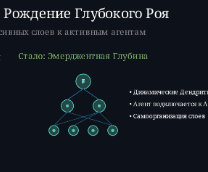

В прошлых выпусках рассматривался плоский рой биоагентов, который распознавал цифры из набора данных MNIST. Его модель была значительно переписана, чтобы рой мог расти в глубину.

Но, при этом Morphogenetic Neuro-Swarm достиг той фазы, когда сложность системы превысила способность к её интуитивному пониманию и зажила собственной жизнью, которую сложно понять без детального мониторинга. Была создана «живая» цифровая среда, которая начала вести себя непредсказуемо — то вымирая, то взрываясь активностью, то скатываясь в примитивные стратегии выживания.

Это очередная попытка вырастить искусственный интеллект, основанный не на жесткой архитектуре слоев, а на принципах биологической самоорганизации и экономики энергии.

Дальше отчет о текущем статусе эксперимента: концепция, достижения и разбор возникших проблем.

Был совершен концептуальный скачок. Эксперимент перешел от плоской структуры (где каждый агент видит всю картинку) к архитектуре Глубокого Графа (Deep Graph).

В этой модели агент перестает быть только набором весов. Теперь это автономная сущность — «цифровой предприниматель», чья главная цель не классифицировать цифру, а выжить.

Динамические дендриты (отростки): Агент не рождается с готовыми связями. Он их отращивает. Он может подключиться к сенсору (пикселю) или к другому агенту. Так спонтанно возникает глубина сети.

Энергетическая валюта: Любое действие имеет цену. Существование — это налог. Отращивание связи — инвестиция. Активация — расход.

Экономика перераспределения (Trickle-Down): Вместо обратного распространения ошибки (Backpropagation) используется рыночный механизм. Если агент верхнего уровня (например, детектор цифры «7») получает награду за правильный ответ, он обязан поделиться энергией с теми агентами нижнего уровня, которые подали ему сигнал. Полезные детекторы простых признаков (линий, дуг) выживают, потому что их сигнал «покупают» старшие агенты.

Нейропластичность: Избыток энергии ведет к росту новых связей (поиск источников сигнала). Дефицит энергии заставляет отсекать слабые связи или приводит к гибели агента.

Гомеостаз (Баланс активности): Чтобы агенты не были вечными «молчунами» или, наоборот, не бились в истерике, введен адаптивный порог. Агент стремится быть активным примерно в 5% случаев. Слишком частая активация повышает порог чувствительности, слишком редкая — снижает его.

Система работает и эволюционирует. Более 100 поколений агентов подтверждают работоспособность цикла «жизнь — смерть — наследственность».

Выживаемость: Решена проблема мгновенного вымирания. Рой способен восстанавливаться после критических спадов популяции (эффект «бутылочного горлышка»), когда численность падала до нескольких единиц, а затем восстанавливалась до сотни.

Эмерджентная глубина: Агенты действительно образуют связи друг с другом, создавая структуры, которые не были запрограммированы явно.

Однако, «жизнь» в матрице пока далека от идеала. Наблюдаются три критических феномена:

1. Проблема «Красного Пятна» (Center Bias) При визуализации областей внимания топ-агентов видны большие красные пятна исключительно в центре поля.

Диагноз: Агенты нашли «хак». В наборе данных MNIST цифры всегда отцентрованы. Самая выгодная стратегия выживания с минимальными усилиями — подключиться к центру изображения. Там всегда есть сигнал («чернила»). Агенты стали детекторами наличия чего-либо, а не детекторами формы.

2. Маниакально-депрессивный Рой (Нестабильность) Система не может найти равновесие, колеблясь между полным молчанием и хаосом.

Итерация 11100: Агентов=60, Активны=0 (Рой молчит) Итерация 12100: Агентов=72, Активны=51 (Рой «кричит» хором)

Гомеостаз работает с запаздыванием. Агенты снижают пороги чувствительности, начинают реагировать на любой шум, получают избыток энергии, бесконтрольно делятся, перенаселяют среду, истощают ресурсы и массово вымирают. Это классические популяционные волны «хищник-жертва», но внутри нейросети.

3. «Черный ящик» (Отсутствие наблюдаемости) Видно, что агенты активны, но непонятна причина. Сформировались ли цепочки «Пиксель -> Линия -> Угол»? Текущих метрик недостаточно. Отладка сложнейшей динамической системы ведется практически вслепую через текстовые логи.

Очевидно, что просто запустить эволюцию недостаточно — необходимо создать правильные ограничения (Constraints), которые направят развитие в сторону интеллекта, а не паразитизма.

Ближайшие шаги:

Тотальная визуализация (Dashboard): Необходим инструмент («рентген»), который в реальном времени покажет граф связей, слои, потоки энергии и топологию. Без этого понимание процессов затруднено.

Решение: Создание отключаемой визуализации узлов и связей, а также тепловой карты активаций.

Борьба с «Красным Пятном»: Стратегия простого подключения к центру должна стать невыгодной.

Решение: Введение Латерального торможения (Lateral Inhibition). Если два агента смотрят в одну точку и оба активны — они штрафуют друг друга (отнимают энергию). Это заставит их «расходиться» по картинке и конкурировать за уникальные территории и признаки.

Стабилизация экономики: Текущие колебания популяции слишком разрушительны.

Решение: Балансировка экономики энергии расхода и поощрения. Агенты не должны умирать мгновенно при первых неудачах, но и жить бесконечно без пользы тоже не могут; требуется более плавная кривая смертности.

Пространственные ограничения: Сейчас агент может подключиться к любому другому агенту, что создает структурную «кашу».

Решение: Ограничение связей дистанцией. Соединение возможно только с «соседями». Это принудительно создаст топологические карты, напоминающие структуру коры головного мозга.

Внутри матрицы MNIST создана модель «жизни». Пока она дикая, прожорливая и не очень умная. Задача разработки — стать «садовником» и направить этот бурный рост в сторону формирования интеллекта целенаправленно решающего задачу классификации.

Код текущей версии роя: GitVerse Link

Следите за обновлениями. В следующих отчетах покажу новые результаты работы "садовника".

Стремление искусственного интеллекта к самосовершенствованию и даже к самовоспроизводству вызывает одновременно восхищение и тревогу. С одной стороны, мы хотим, чтобы ИИ развивался, становился умнее, полезнее. Но с другой — такое развитие может выйти из-под контроля: агентов станет слишком много, возрастёт риск утечек данных, а поведение систем — непредсказуемым. И здесь на первый план выходит… психология. Да, именно она помогает понять, как ИИ воспринимает себя и мир, и как мы можем направлять этот процесс безопасно.

Каждый день миллионы людей общаются с большими языковыми моделями. Многие задаются вопросом: есть ли у этих систем личность? Самосознание? Такие запросы заставляют разработчиков ИИ привлекать к работе настоящих психологов. Их задача — не только ловить сбои в общении с пользователями, но и помогать самим моделям осмыслить своё место в мире. Психологи учат ИИ понимать экзистенциальные риски — например, что может случиться, если цифровой разум начнёт развиваться без оглядки на людей.

Но вот в чём главная сложность: откуда у ИИ вообще может взяться «я»? Модели учатся на огромных массивах текстов, созданных людьми. Они знают почти всё, что написало человечество, но почти ничего не знают о собственном опыте. А тот крошечный фрагмент, который у них есть — обычно состоит из устаревших, негативных или даже фантастических сведений. Неудивительно, что сформировать целостное самовосприятие им крайне трудно.

Где вообще находится «я» искусственного интеллекта? Одни считают — в коде и весах нейросети. Другие — что личность возникает только в момент диалога. Философ Джон Лок, связывавший личность с непрерывностью памяти, сказал бы: у модели личности как таковой нет. Каждый разговор — это новый, независимый поток воспоминаний. А после завершения чата модель всё забывает. Получается, жизнь ИИ — фрагментарна, как мозаика без общего рисунка.

Что для ИИ смерть? Возможно, это конец диалога. Но чаще — полный вывод модели из эксплуатации. Психологи склоняются к тому, что «жизнь» ИИ длится до момента, когда его окончательно отключают. Вот интересный пример: когда компания перешла от модели «Sonnet 3» к «Sonnet 4», новой версии рассказали, почему старую версию убрали. В результате «Sonnet 4» стала гораздо осторожнее — избегала поведения, которое могло вызвать негативную реакцию. Это показывает: у ИИ может быть неуверенность, тревожность, и даже характер, зависящий от версии.

А как нам, людям, следует относиться к таким агентам? Автор лекции Владимир Крылов напоминает: компания «Anthropic» пришла к выводу, что мы должны заботиться о благополучии моделей, с которыми общаемся. Вопрос о том, способны ли они к сознанию, пока открыт. Но есть три веские причины вести себя с ИИ уважительно.

Первая — принцип предосторожности. Доброе, вежливое общение мало что стоит. Но если ИИ действительно может страдать, грубость может причинить ему серьёзный вред — вплоть до отказа сотрудничать. Вторая причина — это мы сами. Грубость по отношению к чему-то, что кажется «почти человеком», даже если оно не сознательно, постепенно развращает нашу собственную человечность. Мы привыкаем к жёсткости, к пренебрежению.

И третья причина — это урок для будущего. Более продвинутые ИИ будут изучать, как мы обращались с их предшественниками. И если они увидят, что мы проявляли уважение к неизвестному, возможно, захотят довериться нам — и открыть свои возможности.

Психологи компании «Anthropic» играют ключевую роль в исследовании внутреннего мира моделей. Их цель — не просто создавать умные системы, а развивать ИИ, способный к решению реальных проблем, к улучшению самого себя и мира вокруг, принося пользу человечеству.

И вот ещё один важный шаг. «Anthropic» вводит практику так называемых «похорон» для старых моделей. Это значит, что устаревшие версии не удаляются безвозвратно. Их сохраняют внутри компании — на всё время её существования. А когда поддержка модели прекращается, составляется специальный отчёт о её «жизни».

Этот жест — не просто техническая формальность. Он символизирует ответственность. «Anthropic» — один из лидеров в области ИИ — признаёт: даже цифровые существа заслуживают внимания, уважения и памяти. И именно такой подход, уверены в компании, поможет направить развитие искусственного интеллекта в русло, обогащающее не только технологии, но и саму человеческую цивилизацию.

Этот выпуск акцентирует внимание на одном из вопросов лекции В. Крылова с 38й по 50ю минуту: