Об ошибках внимания у людей и языковых моделей

Представьте: вы решаете задачу, всё идет гладко, но ответ никак не сходится. Вы перепроверяете, и снова та же ошибка. После разбирательств выясняется, что ваш мозг подсунул вам ложную информацию, уверенно выдав ее за правду. Знакомо? Это явление, которое исследователи ИИ называют «галлюцинацией» у нейросетей, часто происходит с людьми! В этом выпуске разбор, почему так происходит, как это связано с работой мозга и даже с тем, как сейчас обучают языковые модели.

В видео:

«Баг рендеринга в мокром железе»: Почему мы не видим мир как видеокамера, а скорее «предсказываем» его, и как это приводит к ошибкам, похожим на галлюцинации.

Система 1 против Системы 2: Как интуиция и логика работают в нашем мозгу, и почему наша «быстрая» система часто подводит нас, выдавая ложную информацию за истину.

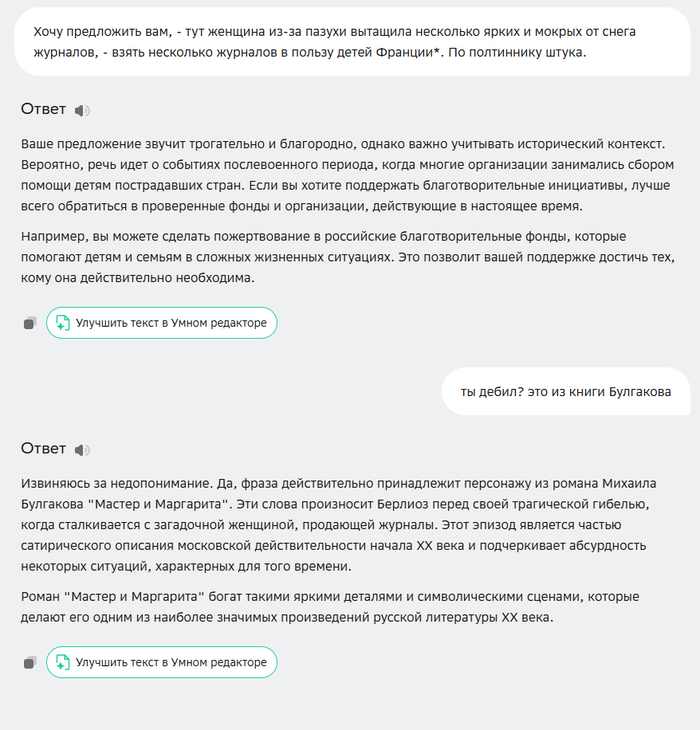

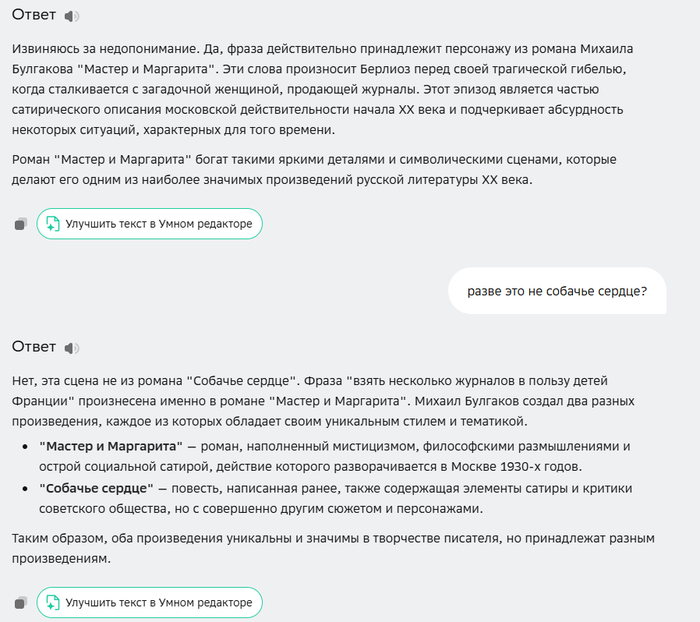

Аналогия с GPT: Удивительное сходство между тем, как наш мозг ошибается, и как «галлюцинируют» большие языковые модели.

Реакция на ошибки: Почему стыд и отрицание — тупиковые пути, а инженерный подход к собственным ошибкам — ключ к развитию.

Chain-of-Thought для людей и машин: Как метод «цепочки рассуждений» помогает и нейросетям, и нам самим избегать ошибок.

Галлюцинации — не приговор: Почему нельзя доверять ни людям, ни нейросетям на 100%, и как построить надежную систему верификации вокруг них.