Вайлдберизз вы там совсем???!!!!

Прошу поднять потому, что сейчас набегут боты вайлдбериз.

Новые изменения в законе "о защите прав потребителя" - уже работают!!!

Слов, кроме мата, нет.

Сделала заказ на вайлдбериз:

1) Часы настенные - https://global.wildberries.ru/catalog/394242054/detail.aspx?...

2) Полка угловая для ванны - https://global.wildberries.ru/catalog/170168618/detail.aspx?...

Оплатила доставку курьером.

Приехал курьер, милая девушка, отсканировала QR, передала мне товар и сбежала, т.е. не дала мне возможности проверить товар при получении.

После распаковки товара я обнаружила следующее:

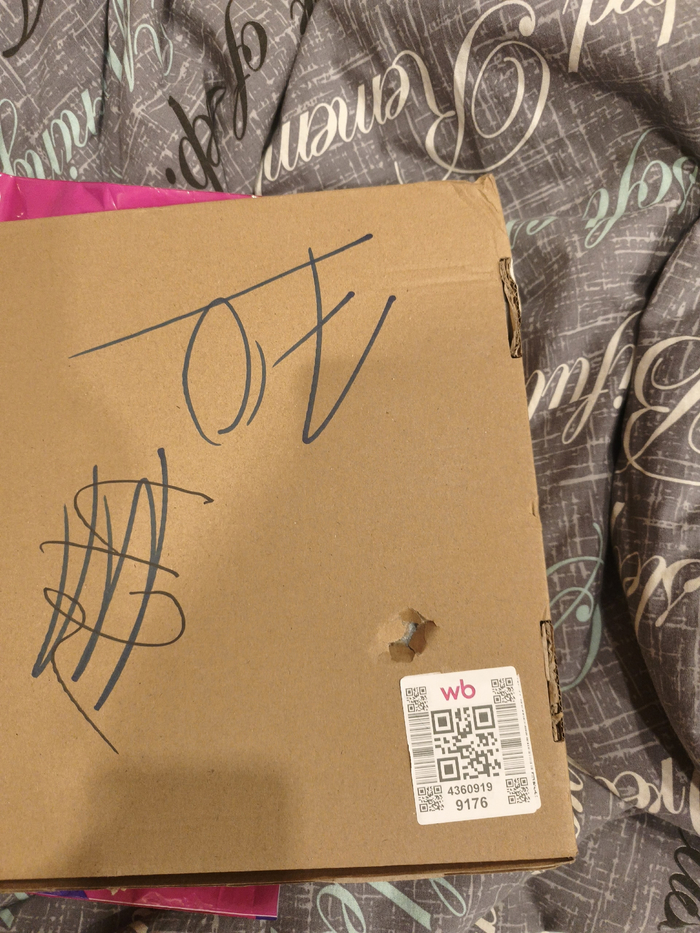

Коробки мятые, будто ими в футбол играли.

1) Настенные часы не работают, от слова "совсем" (батарейки ставила новые, проверяла их на другом оборудовании)

Это вид коробки

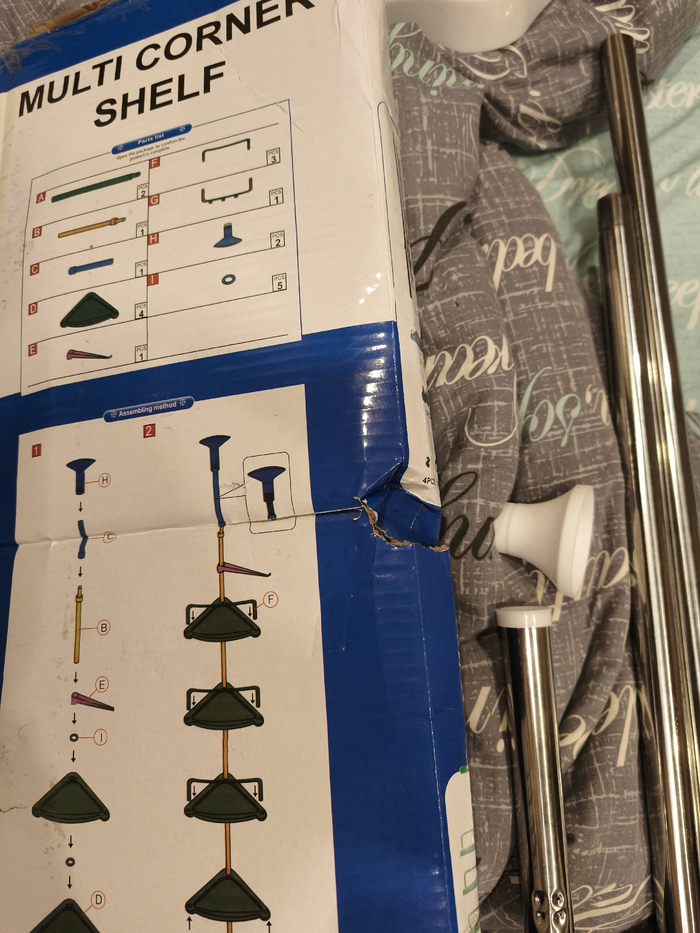

2) Полка угловая. Тут еще интереснее.

После вскрытия "пупырки" я вижу это:

Коробка с товаром, видимо, шла к нам пешком, прям из Китая! Преодолевая все сложности, иначе, вид и содержание упаковки, я объяснить не могу.

Так же, на всей коробки располагаются различные QR коды с номером заказа, т.е. очевидно, что от этого товара отказалось (минимум) 5 человек до меня ( по количеству QR от вайлдбериз) + 2 QR родом из Китая.

Что же содержит наша "героическая" коробка? Набор различных труб и креплений, которые не имеют никакого отношения к комплектации указанной на самой коробке (ну и в описании товара соответственно):

Все трубки из "комплекта" имеют дефекты: вмятины, изгибы, не соответствуют диаметры и длинна для сборки.

Т.е. это не просто брак, это набор деталей, которые вообще не подходят друг к другу.

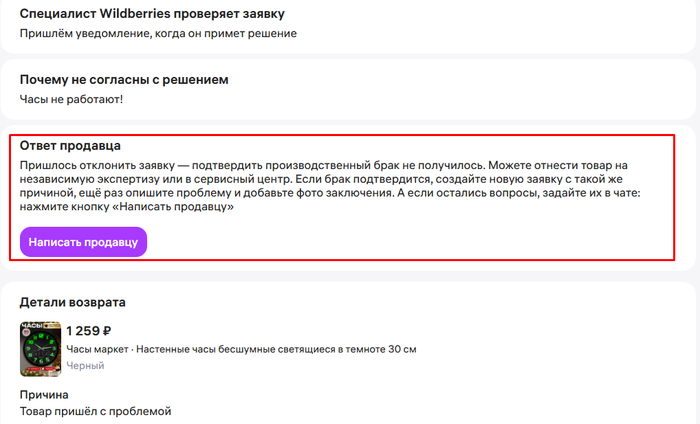

Сразу же оформляю заявку на возврат, описываю все дефекты, прикрепляю фото.

Ииии?

На сколько я понимаю, на текущий момент, у меня есть только один вариант решения данного вопроса, а именно обращение в суд.

Ну чтож, значит пойду таким путем, ибо это уже прямое нарушение прав потребителя.

В заключении, на мой, только, что прозревший взгляд, заказывать что-либо онлайн, с новыми поправками к закону - это не просто игра в "Русскую рулетку", это очень большая вероятность остаться без денег и товара.

Вайлдбериз - прокоментируете?

Правдиво ли видео, где телеведущий похож на фоторобот мужчины, подозреваемого в подглядывании за женщинами в туалете?

В ноябре 2025 года в мемных пабликах (и на Пикабу) завирусился ролик, на котором ведущий новостей сообщает о розыске человека, подсматривавшего за женщинами в уборных. При этом подозреваемый похож на самого журналиста. Мы проверили подлинность этого видео.

Спойлер для ЛЛ: это ИИ. На Пикабу в итоге поставили соответствующий тэг. Но тренд на генерацию довольно правдоподобных фейковых новостных выпусков так себе. Очень, очень тревожно.

Вирусный ролик якобы представляет собой фрагмент новостной передачи на некоем англоязычном телеканале. Telegram-канал «КБ плюс» (247 000 просмотров на момент написания этого разбора) описал происходящее так: «Полиция разыскивает неизвестного, который повадился подсматривать за женщинами в дамских уборных в центре города. Очевидцы описывают его как мужчину средних лет, примерно 180 см роста, в очках, с бородкой и залысиной. Сегодня утром полиция распространила набросок внешности подозреваемого, созданный на основе его словесного портрета». Человек на фотороботе при этом оказался подозрительно похожим на журналиста, рассказавшего об этой новости на видео. «Главное в ходе расследования — не выйти на самого себя», — пошутили в Telegram-канале «Двач» (278 000 просмотров).

По данным сервиса TGStat, в русскоязычном сегменте Telegram были опубликованы по меньшей мере 150 аналогичных постов, которые в общей сложности получили около 1,5 млн просмотров. О ролике рассказали каналы «Коза кричала» (152 000 просмотров), «Мышеловка» (112 000), «Лепра» (99 000), «Гусь Гагарик» (79 000), «Кувалда 18+» (57 000), «Шахназаров» (45 000) и др. Видео стало популярным и в других соцсетях. Например, во «ВКонтакте» подобный пост в паблике «Борщ» набрал 205 000 просмотров, а в соцсети X один из твитов посмотрели более 169 000 раз. В TikTok этот ролик с русскими субтитрами набрал 790 000 просмотров

В 15-секундном вирусном видео ведущий по-английски произносит:

«Власти разыскивают мужчину, которого видели пробирающимся в женские туалеты в центре города. По словам очевидцев, ему примерно 45 лет, рост около 6 футов (примерно 183 см. — Прим. ред.), он носит очки, аккуратно подстриженную бороду и имеет залысины. Полиция сегодня опубликовала этот фоторобот».

Сам фоторобот показан на заднем плане, и мужчина с рисунка внешне очень напоминает рассказывающего о нём журналиста. Заметила это и вторая ведущая, с удивлением смотрящая на коллегу. При этом в видео нет логотипа телеканала, из эфира которого якобы вырезан этот фрагмент, и указаний на то, в каком именно городе полиция разыскивает злоумышленника.

На самом деле ни людей, ни телестудии из этого ролика в реальности не существует — он был создан при помощи ИИ.

Впервые это видео появилось в TikTok, где 14 ноября 2025 года его опубликовал пользователь AI_Flicks_Gone_wild (@flicks_gone_wild). Тогда блог назывался @curious_flicks, и вотермарку именно с таким юзернеймом можно найти в некоторых упомянутых выше постах. Оригинальное видео в TikTok сопровождается специальной плашкой о том, что оно было создано с помощью нейросетей. Несмотря на название блога, которое можно перевести как «дико разошедшиеся ИИ-ролики», из примерно 130 видео, опубликованных там с конца октября, вирусным стало лишь это, а почти все остальные набрали от пары десятков до нескольких сотен просмотров. В некоторых из них стоят соответствующие теги об ИИ, а в части роликов заметны вотермарки модели Sora 2.

Завирусившийся в русскоязычном сегменте Telegram ролик — один из серии подобных видео, опубликованных AI_Flicks_Gone_wild. В одном из них ведущий был похож на предполагаемого похитителя нижнего белья, а в другом в студии показывали фоторобот кота, убившего хозяина. Созданные с помощью ИИ ролики на ту же тему в середине ноября выпускали и другие пользователи TikTok.

Некоторые пользователи «Пикабу» и «ВКонтакте», принявшие вирусный ролик за настоящий, посчитали, что это был некий розыгрыш ведущих или выпуск сатирических новостей. Другие написали, что это видео было снято очень давно и поэтому не могло быть создано нейросетью.

(Спасибо, @so1nyshk0)

Судя по всему, это пример так называемого эффекта Манделы, когда воспоминания разных людей совпадают, но противоречат фактам. Так, в этом случае пользователи уверенно заявляют, будто много лет назад видели вышедший в конце 2025 года ролик. Вероятно, дело в том, что ранее они посмотрели похожие отрывки реальных новостных передач и спутали их с ИИ-видео. Немного оправдаем пикабушников :)

В 2010 году в Торонто в преддверии саммита «Большой двадцатки» разыскивали покупателя удобрений, которые можно использовать для создания взрывчатых веществ. В эфире CBC News тогда показали фоторобот мужчины, который, по словам интернет-пользователей, был похож на инспектора полиции.

Годом позже завирусился репортаж корреспондента CBS, который освещал инцидент с нападением на женщину. Внимание зрителей привлекло то, что журналист очень напоминал подозреваемого с фоторобота. Фрагмент того эфира затем попал в передачу Good Morning America, ведущая которой пошутила, что нападавший также похож на её коллегу по студии.

В 2016 году похожая ситуация произошла в программе Crimewatch на BBC: в Сети завирусился фрагмент, когда в студии показали снимок преступника, внешне напоминавшего телеведущего.

Схожие сцены не раз встречались и в художественных произведениях. К примеру, в 2007 году в одном из эпизодов сериала «Офис» герой не мог понять, что он похож на фоторобот преступника, которого сам и разыскивал

Ещё в 1969 году скетч на эту тему выходил в шоу «Летающий цирк Монти Пайтона».

Таким образом, ставший вирусным отрывок телеэфира, во время которого показали фоторобот злоумышленника, подсматривающего за женщинами в туалете и похожего на ведущего новостей, был сгенерирован нейросетью.

Наш вердикт: неправда

«Проверено» в Телеграм

В сообществе отсутствуют спам, реклама и пропаганда чего-либо (за исключением здравого смысла)

Правдива ли история о споре Киллиана Мёрфи с принцем Гарри?

В Сети популярна история о гордом поведении ирландского актёра при встрече с представителем британской королевской семьи. Мы проверили правдивость этого рассказа.

Большинство постов сопровождается фотографией Киллиана Мёрфи, на которой актёр стоит перед принцем Гарри и держит руки в карманах. Между ними якобы произошёл такой диалог.

— Так ты британец? — спрашивает Гарри.

— Нет, я ирландец.

Принц, делает вид, что не замечает сказанного Мёрфи:

— Ах да, я знаю, вы — британец.

— Нет-нет. Я ирландец. И это большая разница, — с достоинством отвечает Мёрфи, не вынимая рук из кармана.

Авторы вирусных публикаций объясняют, что поведение актёра отсылает к событиям столетней давности: в 1920 году, когда шла Война за независимость Ирландии, мужчины принципиально не вынимали руки из карманов при встрече с британскими полицейскими и военными, за что их арестовывали или даже расстреливали на месте.

В 2025 году публикации с этой историей становились популярными, например, пост «Я Ирландец?» (344 000 просмотров), в Telegram (31 000 просмотров) и Facebook (701 репост).

Исторический контекст

Действительно, в 1919–1921 годах в Ирландии шла война за независимость от Великобритании. Со стороны местного населения это была преимущественно партизанская борьба, ключевую роль в которой играли бойцы Ирландской республиканской армии (IRA), захватывавшие оружие, освобождавшие заключённых и устраивавшие засады на патрули Ирландской королевской полиции и британских военных. Судя по воспоминаниям очевидцев, сторонники независимости нередко прятали в карманах огнестрельное оружие и бомбы — не столько из-за желания незаметно напасть, сколько из опасений нарваться на очередную облаву. Неудивительно, что 1 декабря 1920 года вспомогательное подразделение Королевского колониального командования (RIC), базировавшееся в замке Макрум в графстве Корк, выпустило приказ: «Всем мужчинам, проживающим в [городе] Макруме, и всем мужчинам, проходящим через Макрум, запрещается появляться на публике с руками в карманах. Любой мужчина, нарушивший этот приказ, подлежит расстрелу на месте». Аналогичные предписания, сулившие нарушителям как минимум арест, а как максимум — внесудебную казнь, в последующие месяцы появились в Типперэри и других городах.

Как сообщают современные ирландские СМИ, с тех пор в регионе существует традиция в знак протеста держать руки в карманах в присутствии британских чиновников. Впрочем, в XX веке о её проявлениях особо не писали — первый крупный скандал произошёл уже в нашем тысячелетии. В 2009 году на страницы британских газет попала фотография, на которой игрок сборной Ирландии по регби Ронан О’Гара держит руки в карманах на встрече с королевой Елизаветой II.

В этом жесте многие увидели политический подтекст и дань ирландской традиции. Одни критиковали игрока, другие восхищались им. Однако много лет спустя О’Гара заявил, что произошло недоразумение: он просто готовил кисть к рукопожатию, вытирая с неё пот в кармане. «Фотография появилась в Irish Times, и все были убеждены, что я отказался пожать ей руку. <…> У меня нет твёрдых убеждений относительно монархии, но я хотел бы думать, что мои родители хорошо меня воспитали. Люди уважительно относятся к женщинам старшего возраста, к женщинам вообще», — объяснял спортсмен. За время, прошедшее до его признания, случилось историческое событие — в 2012 году рукопожатием обменялись Елизавета II и бывший лидер боевиков IRA Мартин МакГиннесс.

Встреча принца Гарри с Киллианом Мёрфи, кадры с которой стали вирусными, состоялась 13 июля 2017 года на лондонской премьере фильма «Дюнкерк», в котором ирландец сыграл одну из главных ролей.

Как видно на видео, Мёрфи с улыбкой жмёт руку принцу, утвердительно кивает в ответ на его слова и произносит: «Amazing» («изумительно» — англ.). Остальная часть диалога едва слышна, но это совсем не похоже на обмен репликами, который приводится в вирусных публикациях.

Некоторые пользователи обратили внимание на «хищный» взгляд, которым Мёрфи проводил принца.

Однако на других кадрах видно, что актёр смотрит на принца куда более добродушно.

При этом в англоязычном сегменте Сети можно встретить вирусные публикации 2023 года, в которых то же видео сопровождается другой звуковой дорожкой и субтитрами — между актёром и принцем будто действительно происходит диалог о происхождении артиста.

Назвать этот ролик правдоподобным нельзя — движения губ Мёрфи не всегда совпадают с речью, а фразу «Это большая разница», вопреки расшифровке из соцсетей, как будто произносит уже принц Гарри.

Всё дело в том, что звуковая дорожка в этих вирусных роликах 2023 года взята из видео 2010 года, на котором Мёрфи и его коллега Том Харди отвечали на вопросы журналиста о фильме «Начало». «Вы оба британцы», — произнёс интервьюер, на что Мёрфи возразил: «Нет, я ирландец». Не понявший разницы собеседник повторил: «Да, я знаю. Британец». После второго возражения журналист извинился, а Мёрфи добавил: «Это большая разница». В итоге интервьюер описал родину двух актёров как территорию в Северной Европе, на что снова услышал от Мёрфи: «Нет, Ирландия».

Вопрос идентичности для лауреата «Оскара» в самом деле важен. В 2015 году после 14 лет проживания в Лондоне Мёрфи вернулся вместе с семьёй на родину. «Мы хотели, чтобы дети были ирландцами. Они ещё не достигли подросткового возраста, и у них был очень аристократический английский акцент, а мне это не очень нравилось! Поэтому мы решили вернуться. <…> Это своего рода типичная ирландская история: уехать, сделать свои дела и вернуться домой», — объяснял актёр.

Таким образом, Киллиан Мёрфи не поправлял принца Гарри, якобы назвавшего его британцем. Основой для публикаций на эту тему стал появившийся в 2023 году ролик, где на видео с их встречей наложили звуковую дорожку из интервью актёра. Судя по всему, и в том, что Мёрфи держал тогда руки в карманах, тоже не было никакой подоплёки. А педалировать этот жест начали уже после того, как отредактированный ролик стал вирусным в англоязычном сегменте Сети.

Наш вердикт: фейк

«Проверено» в Телеграм

В сообществе отсутствуют спам, реклама и пропаганда чего-либо (за исключением здравого смысла)

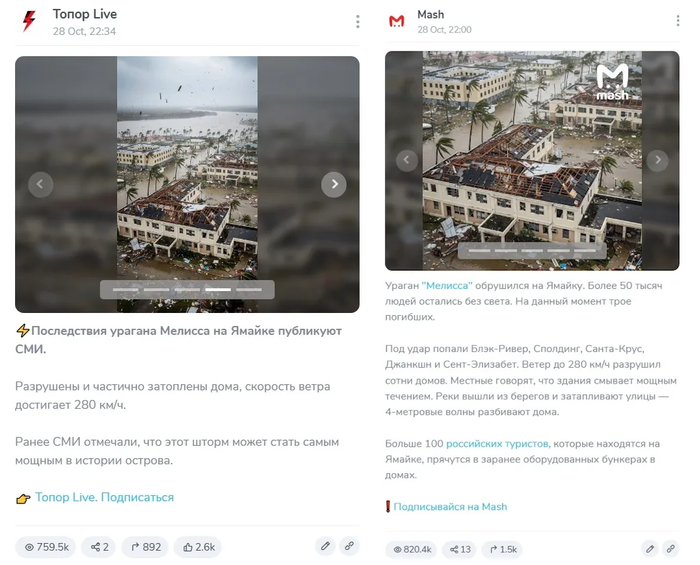

Разрушенная больница, вид с самолёта и акулы в бассейне: фейковые фото и видео урагана «Мелисса»

В конце октября 2025 года на страны Карибского бассейна обрушился мощный тропический шторм. Вскоре в Сети завирусилось множество фото и видео, якобы сделанных на Ямайке и показывающих масштаб разрушений. Некоторые из них оказались подделками.

16 октября 2025 года американский Национальный центр ураганов сообщил о тропической волне, обнаруженной в центральной Атлантике и движущейся к Карибскому морю. 21 октября её классифицировали как тропический шторм «Мелисса», а 27-го урагану присвоили максимальную, пятую категорию. На следующий день, когда «Мелисса» уже вплотную приблизилась к странам Карибского бассейна, скорость ветра достигала почти 300 км/ч. По состоянию на 3 ноября известно о как минимум 32 погибших на Ямайке, также сообщалось о жертвах на Гаити, Кубе и в Доминиканской Республике.

Разрушенная больница в городе Блэк-Ривер

Рассказывая о последствиях урагана на Ямайке, некоторые русскоязычные Telegram-каналы приводят снимок, на котором видны пострадавшие здания и затопленные улицы. Иногда в таких публикациях уточняется, что на фотографии запечатлён город Блэк-Ривер. Это фото разместили каналы Mash (820 000 просмотров на момент написания этого разбора), «Топор Live» (дважды: 760 000 и 614 000), «РИА Новости» (438 000), «Выпускайте Кракена Z!» (63 000), «Свежести» (45 000), 360.ru (25 000) и «Крыминфорум 🇿 🇴 🇻» (10 000). Снимок распространяли и англоязычные пользователи, утверждавшие, что на нём показана разрушенная больница. Подобные посты можно встретить в X, Facebook* и Instagram*.

В беседе с BBC News премьер-министр Ямайки Эндрю Холнесс заявил, что город Блэк-Ривер был буквально полностью уничтожен. Катастрофические разрушения подтверждают спутниковые снимки. «Это самый ужасный опыт в моей жизни, и я не хотела бы пережить это снова», — сказала сотрудница местной больницы Холнессу, когда тот приехал в город оценить ущерб. Политик поблагодарил медработников за то, что те продолжали оказывать помощь пациентам, даже когда отключилось электричество, а ураганный ветер выбивал окна.

Как показано в ролике, опубликованном в соцсетях Холнесса, больница не была повреждена и затоплена так сильно, как на вирусном фото. Кроме того, судя по спутниковым снимкам, доступным в Google Maps, планировка больницы в Блэк-Ривере выглядит по-другому. Сами здания также отличаются от того, как они представлены на распространяемой фотографии.

Слева — вирусное фото, в центре сверху — спутниковый снимок, в центре снизу и справа — скриншоты из видео Холнесса. Фото: соцсети / Google Maps / jis.gov.jm / @AndrewHolnessJM (X) / коллаж «Проверено»

Фактчекеры из британского проекта Full Fact проанализировали вирусную фотографию с помощью обратного поиска по изображениям в Google и заметили в выдаче специальную пометку: «Создано ИИ от Google». Представитель корпорации подтвердил, что изображение содержит SynthID — незаметный водяной знак, который добавляют в контент, созданный с помощью искусственного интеллекта Google.

Некоторые другие фактчекеры, проверявшие вирусное фото, допустили в своих разборах ошибку. Так, наши коллеги из американского проекта Lead Stories неверно установили время публикации одного из первых твитов с этим снимком и сделали ложный вывод, что фотография появилась в соцсетях ещё за несколько часов до того, как ураган достиг побережья Ямайки. Ту же неточность допустили итальянские фактчекеры из Facta и журналисты французского издания TF1 Info. Впрочем, все эти проекты также утверждают, что изображение было сгенерировано нейросетями. «Проверено», в свою очередь, рассказало Lead Stories о допущенной ошибке, и её исправили.

Национальный центр ураганов США сообщил, что «Мелисса» обрушилась на Ямайку, 28 октября около 20:00 по московскому времени. Наиболее ранняя публикация с поддельным фото появилась в Facebook на странице пользователя по имени Джомар Сомберо в течение часа после этого (сам пост уже удалён, сохранилась архивная копия). В описании профиля говорится: «Настоящие катастрофы • ИИ-иллюстрации • Глобальная осведомлённость», а в уже удалённой записи — о критической ситуации в больнице Блэк-Ривера.

Вид из иллюминатора пассажирского самолёта

Также в русскоязычном сегменте интернета распространился якобы снятый с борта самолёта ролик, который в Telegram-канале ведущей «Первого канала» Олеси Лосевой (16 000 просмотров) прокомментировали так: «Посмотрите, как выглядит с высоты ураган "Мелисса", который двигается в сторону Ямайки со скоростью 282 км/ч. Кадры и завораживают, и устрашают одновременно!» Этот же ролик опубликовали каналы Mash (836 000 просмотров), «РИА Новости» (556 000, видео позднее было заменено), АСТ-54 Black (88 000), «Выпускайте Кракена Z!» (63 000), «Крыминфорум 🇿 🇴 🇻» (15 000), «Алексей Железнов» (14 000) и др. Подобные посты также стали вирусными на английском, испанском и других языках.

По данным фактчекеров из проекта Snopes, впервые это видео было опубликовано ещё 26 октября 2025 года — за пару дней до того, как ураган достиг берегов Ямайки. Запись разместил пользователь TikTok с юзернеймом @earthimpacts, в описании его профиля говорится: «Любопытство к ИИ-катастрофам. Это ИИ? Конечно, да!» На странице @earthimpacts можно найти множество аналогичных видео, там же указано, что блогер создаёт свои ролики на сайте openart.ai.

Интересующий нас ролик собрал в TikTok 7,3 млн просмотров, хотя в его описании указано: «Это не реальность, а симуляция, созданная с помощью ИИ для гипотетического сценария. Торнадо также создан с помощью ИИ». Кроме того, в подписи стоит тег о применении нейросети и имеется специальная пометка от платформы об ИИ-контенте.

Как отмечает Snopes со ссылкой на данные Flightradar24, за сутки до того, как ураган «Мелисса» добрался до суши, коммерческие лайнеры избегали полётов над Ямайкой и прилегающей к острову территорией. Те немногие самолёты, которые вошли в зону шторма, были специальными воздушными судами по сбору данных об ураганах. В Сети можно найти множество подлинных видео, снятых этими так называемыми «охотниками за ураганами», в том числе с кадрами пролётов через «Мелиссу».

Акулы в бассейне отеля

В Рунете стало популярным ещё одно видео с предполагаемыми последствиями урагана. Так, в Telegram-канале ведущего «Первого канала» Руслана Осташко (84 000 просмотров) сообщили: в соцсетях появились кадры с акулами, которых гигантские волны забросили прямо в бассейн отеля. Тем же роликом поделились каналы «Путин в Telegram» (158 000 просмотров), Ura.ru (82 000), «Пуля» (65 000), «На видео видно» (20 000), «Абзац» (17 000), «Правдивости» (15 000, пост удалён), KP Moldova (4000) и др. Видео набрало миллионы просмотров и за пределами русскоязычного сегмента Сети.

На восьмисекундной записи, которая завирусилась в Рунете, слышен голос говорящей по-английски женщины: «О боже мой! На улице весь океан. Это прямо сейчас на Ямайке. Вода поднялась прямо до отеля. Посмотрите: это же акула!» Однако в постах на других языках встречается другая версия ролика продолжительностью 15 сек., где женщина также говорит: «О нет, вот там ещё одна [акула]! Не могу в это поверить, море наступает, всё затоплено, бассейна больше нет…» Кроме того, вирусное видео было отзеркалено и кадрировано.

В некоторых версиях ролика виден юзернейм пользователя TikTok @yulian_studios. «Создатель контента с визуальными ИИ-эффектами в Доминиканской Республике», — гласит описание его профиля. На момент написания этого разбора ролик уже был удалён из блога @yulian_studios, зато там была размещена похожая запись (удалена к моменту публикации): на ней женщина якобы засняла акулу, плавающую по затопленным улицам на Ямайке. Видео сопровождалось специальной плашкой о том, что автор пометил его как ИИ-контент.

В разбираемом ролике также можно найти характерные признаки работы нейросети. Например, форма плавников одной из акул кажется искажённой, а некоторые находящиеся рядом с бассейном шезлонги остаются неподвижными, несмотря на сильный ветер и волны. Кроме того, в левом верхнем и левом нижнем углах, а также справа в центре на видео заметны заблюренные области. Фактчекеры из испанского проекта Newtral предположили, что это артефакты работы ИИ, однако на самом деле эти три фрагмента совпадают с расположением вотермарки Sora 2 — модели для генерации видео по текстовому описанию от OpenAI. Во многих роликах @yulian_studios эти водяные знаки присутствуют, но в нескольких видео про ураган «Мелисса» они почему-то замазаны.

Журналисты фактчекинговой службы агентства AFP проанализировали аудиодорожку вирусного видео с помощью детектора Hiya, согласно которому голос был сгенерирован ИИ с вероятностью в 97%. Также фактчекеры связались с пользователем @yulian_studios — тот подтвердил своё авторство и пояснил: «Всё, что там изображено, не существует, поскольку это [создано] ИИ».

*Российские власти считают компанию Meta Platforms Inc., которой принадлежат социальные сети Facebook и Instagram, экстремистской организацией, её деятельность и символика на территории России запрещены.

Фото на обложке: @weekendtraveler195 (Facebook) / @earthimpacts (TikTok) / @yulian_studios (TikTok) / коллаж «Проверено»

«Проверено» в Телеграм

В сообществе отсутствуют спам, реклама и пропаганда чего-либо (за исключением здравого смысла)

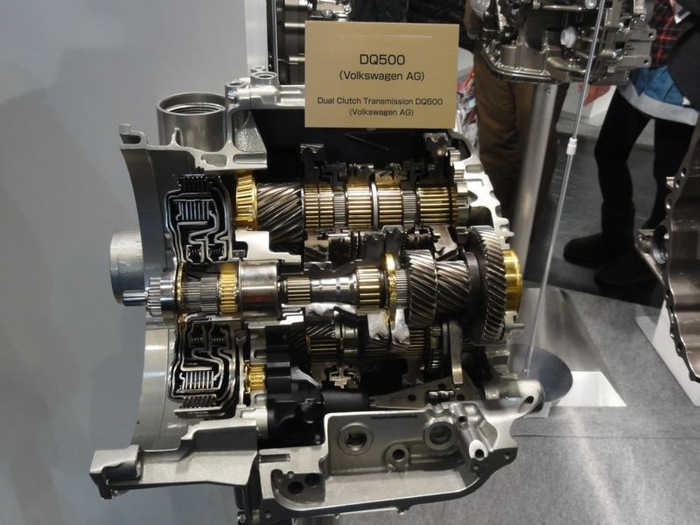

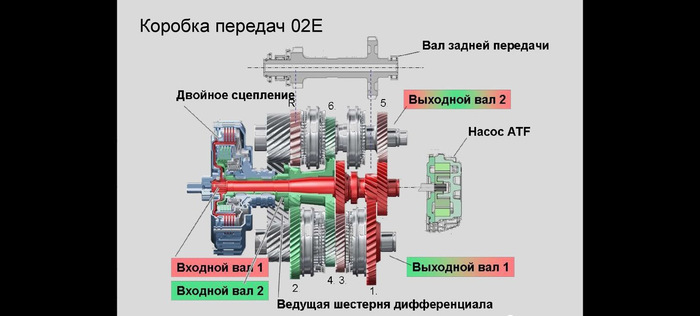

Как проверить робот DSG (РКПП) перед покупкой автомобиля

Несколько лет пилю для вас руководство "Как выбрать и проверить автомобиль перед покупкой". Меня зовут Поляков Михаил, занимаюсь автоподбором и мне совсем не жалко поделиться опытом. Мне приятно быть полезным для вас.

Это уже 19 часть руководства, а именно "Проверка робота DSG при покупке автомобиля". Все предыдущие части есть на Пикабу. Вся серия постов здесь: Подбор авто. Как выбрать автомобиль с пробегом.

Для тех, кто смотрит на ВК:

Внизу оставлю видео на Ютуб.

В этом видео простыми словами я расскажу об устройстве преселективного робота, обсудим самые распространенные неисправности, поговорим о проверке робота по косвенным признакам и о компьютерной диагностике.

Любая роботизированная коробка переключения передач, по своей сути, является механической коробкой с электронным управлением переключения передач. То есть, в отличии от механической трансмиссии, выжимает сцепление и переключает передачу – «робот».

На заре появления роботизированной трансмиссии на широком потребительском рынке, она выпускалась в исполнении с одним сцеплением. Коробка вообще мало чем отличалась от «механики».

С начала 2000-х годов электросервоприводный робот с одним сцеплением начал набирать популярность. Но даже если не брать в расчёт уровень надёжности роботизированных коробок, они обладали главным недостатком – медлительность. Поэтому популярность этого типа трансмиссии быстро пошла на спад, когда появились новые преселективные роботизированные коробки переключения передач.

Свое название «преселективная» трансмиссия берет от английского «preselect», что означает – предварительный выбор. Основная особенность преселективной трансмиссии – это наличие двух первичных валов и двух сцеплений. Образно говоря, преселективная коробка объединяет в себе сразу две механические трансмиссии с одном корпусе.

Основной принцип преселективности в том, что при движении автомобиля, включены сразу две передачи – одна чётного ряда и одна нечетного, но одно сцепление разомкнуто, а второе передаёт крутящий момент. То есть, когда вы едете на первой передаче и крутящий момент передаёт первое сцепление, робот уже включил вторую передачу на втором ведущем валу, но второе сцепление пока разомкнуто. Как только пришло время переключить передачу, размыкается первое сцепление и сразу же включается второе.

Такой принцип работы трансмиссии позволяет переключать передачи на повышение максимально быстро. А вот скоростью понижения передачи робот похвастаться не может. Чтобы двигаться, например, на третьей передаче, и иметь предварительно включенными сразу четвёртую и вторую, трансмиссия должна была бы иметь уже три вала и сцепления. Стоит отметить, что еще в 2016 году Honda запатентовала трансмиссию с тремя сцеплениями, но станет ли массовое производство такой коробки целесообразным или прогресс пойдёт по иному пути — покажет время.

Безусловно, преселективную трансмиссию отличает скорость работы. Переключение передач на повышение происходит практически мгновенно и без потери крутящего момента, что в свою очередь положительно сказывается на динамике разгона, плавности хода и топливной экономичности.

Скорость переключения передачи у трансмиссии DSG-7 варьируется от 0.08 до 0.12 секунд. А например, робот Лады Весты переключает передачу от 0.8 до 1.5 секунд. Разница в 10 раз! Но не спешите смеяться над Вестой, просто её трансмиссия обладает только одним сцеплением. Поэтому если коробке DSG нужно всего лишь разомкнуть одно сцепление и сомкнуть другое, то робот Весты за секунду успевает еще и переключить передачу.

Здесь работает принцип – за что платишь то и имеешь. Роботизированная трансмиссия с одним сцеплением и одним ведущим валом гораздо проще в производстве и обслуживании, а как следствие – дешевле при покупке и дешевле в ремонте.

Почему же до сих пор, многие стараются избегать роботизированную трансмиссию и предпочитают старый добрый гидро-трансформаторный автомат? Всё дело в том, что роботизированная трансмиссия считается ненадёжной. Но так ли это или слухи о ненадёжности робота преувеличены?

Друзья, весь текст статьи — это 15 страниц, 14 шрифтом. Не уверен, что такие простыни текста публиковать рационально. Весь остальной контент в видео на ВК, которое расположено в начале статьи. И в том же видео на Youtube ниже:

Думаю, скоро получится выложить новый видос "Как проверить турбину при покупке автомобиля".

А пока можете заглянуть в серию из двух постов, как продать автомобиль быстро и дорого. В целом советы банальные, но как показывает практика, многие в них нуждаются:

Как продать автомобиль быстро и дорого