9 топовых ИИ-моделей не смогли собрать ни одной программы из 200. Привет, мечты вайб-кодеров

Учёные из Meta, Стэнфорда и Гарварда выкатили новый тест ProgramBench. Идея простая: дают ИИ только скомпилированный бинарь и описание программы — собери с нуля. Никаких сорсов, декомпиляции или интернета. Прогнали через тест 9 топовых моделей, включая Claude Opus 4.7, GPT 5.4 и Gemini 3.1 Pro. Полностью решённых задач — НОЛЬ у всех. Лучший «почти» — 3% у Опуса. Это не приговор ИИ, а полезная калибровка ожиданий.

Знаю, минусы прилетят. Но скажу как есть: миф «закажу промптом систему под ключ, ИИ соберёт» только что получил жирный научный приговор. Учёные собрали тест, и все девять топовых моделей в нём — на нуле.

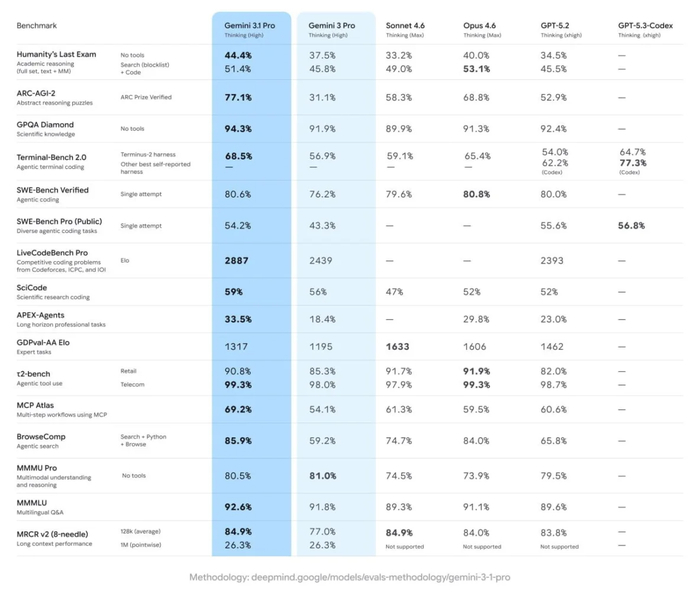

И это самые свежие модели на 2026 год: Claude Opus 4.7, GPT 5.4, Gemini 3.1 Pro, Sonnet 4.6, Haiku 4.5. На обычных кодинг-тестах они стабильно берут 70 процентов и выше. Здесь — глухой ноль.

Что за тест и зачем

Тест называется ProgramBench. Сделали ребята из Meta Superintelligence Labs, Стэнфорда и Гарварда. Опубликовали в 2026 году с открытым пейпером, кодом на гитхабе и докер-окружениями.

Идея простая и злая.

Берётся скомпилированная программа — реальный софт, типа jq, ripgrep, fzf, FFmpeg, PHP. ИИ дают только сам бинарь и описание того, что эта программа должна делать. Никаких сорсов. Никакой декомпиляции. Никакого интернета. Дальше — собери эту программу с нуля так, чтобы она прошла поведенческие тесты. Их там 248 тысяч, по 1240 на задачу в среднем.

200 таких задач. Языки — Go, Rust, C, C++, Haskell, Java. Запуск в изолированном Docker'е. Один и тот же простой агент-обвязка для всех моделей — никаких подкруток под конкретную программу.

Когда я первый раз увидел этот тест, подумал — ну ладно, очередной SWE-bench с другим набором задач. Открыл лидерборд. Увидел нули. Полез читать пейпер. И вот тут стало интересно: это не другой набор задач. Это другой ТИП задачи.

Сравни с другими тестами:

HumanEval (старый эталонный) — дают сигнатуру функции, нужно дописать тело. Модели берут 90% и выше.

SWE-bench — дают репозиторий и issue, нужно сделать патч-фикс бага. Топовые модели берут 70% и выше.

ProgramBench — даёт только бинарь и описание, собери всё с нуля. Все на нуле.

Разница ровно в одном: «дополни существующее» vs «спроектируй с нуля». Это два совершенно разных навыка, и их обычно не разделяют, когда говорят «ИИ умеет писать код».

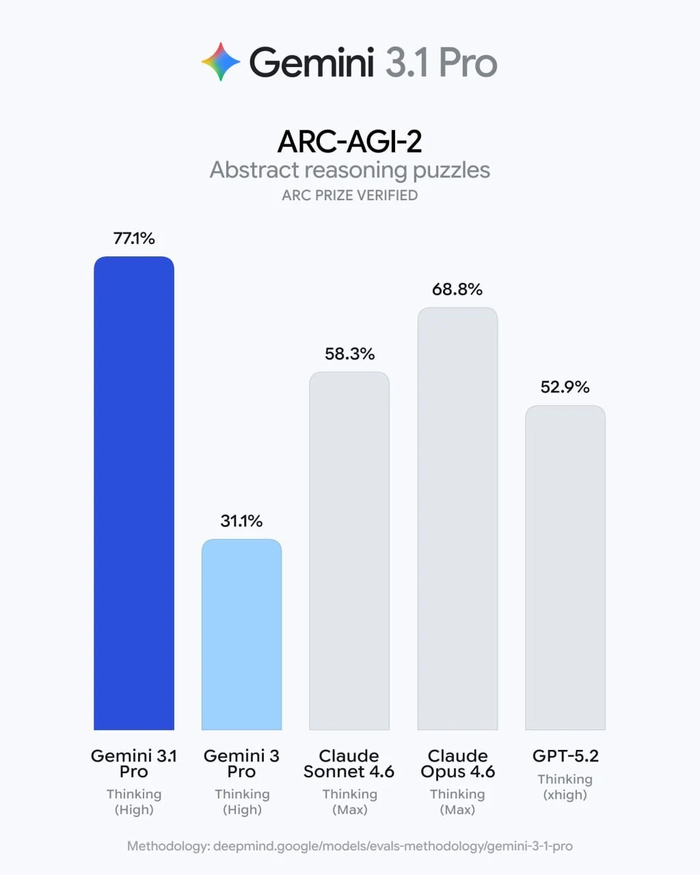

Кто сколько набрал

Раз полностью решённых нет ни у кого, авторы ввели смягчённую метрику — «почти решено» (≥95% поведенческих тестов прошли).

Claude Opus 4.7 — 3.0%

Claude Opus 4.6 — 2.5%

Claude Sonnet 4.6 — 1.0%

GPT 5.4, Gemini 3.1 Pro, Gemini 3 Flash, Haiku 4.5, GPT 5.4 mini, GPT 5 mini — 0%

Если посмотреть не по моделям, а по самим программам — паттерн читается невооружённым глазом.

Что модели вытягивают почти полностью:

nnn (терминальный файловый менеджер) — 98%

BLAKE3 (криптохэш) — 98%

brotli (сжатие от Google) — 91%

jq (утилита для JSON) — 90%

fzf (фаззи-поиск в терминале) — 82%

Что заваливают:

quickjs (JS-движок) — 4%

PHP (компилятор языка) — 5%

FFmpeg (мультимедиа-фреймворк) — 5%

gromacs (физический симулятор молекул) — 9%

Видишь картину? Мелкие утилиты с чёткой специализацией и понятной спекой — почти. Большие системы с кучей внутренних взаимосвязей и неявных требований — провал. Это и есть архитектура: не «написать функцию», а «декомпозировать на 50 файлов и не уронить связность через 200 коммитов кодогенерации».

Почему это бьёт ровно в больное место

Зачем я вообще про этот тест пишу — потому что он бьёт ровно по той точке, где живёт самая мощная мечта вайб-кодеров. Той самой: «промптом закажу систему под ключ, ИИ соберёт».

Я регулярно рассказываю на конференциях и в Telegram-канале, что ИИ-агенты заметно ускоряют работу команды. И это правда — на хорошо размеченных, узких задачах. Но если убрать «хорошо размеченных» и «узких» — получится ровно ProgramBench. И там у топовых моделей — ноль и ноль.

Сценка из жизни. Приходит ко мне знакомый, не программист, с горящими глазами. «Я сделал приложение для учёта расходов!» Ну, давай посмотрим. Запускает. Вроде работает. Через час оказывается, что половина зависимостей в requirements.txt несовместимы. Через день — что вся бизнес-логика держится на одном условии, скопированном из Stack Overflow трёхлетней давности. Через неделю — что нет ни одного теста, и при попытке добавить простейшую фичу всё разваливается.

Дальше два варианта развития событий. Первый — проект выкидывают и идут делать руками или просят помочь живого человека. Второй — у автора есть бюджет, и тогда из этого вырастает гигантский технический долг, который доделывают живые инженеры за тройной прайс. Видел оба сценария по нескольку раз.

Чтобы ИИ-агент действительно собрал кусок системы, который не развалится через неделю, нужны три штуки:

Понимать код. Не «писать», а уметь читать чужой и видеть, где у агента развалится логика. Кто это умеет — тот тащит. Кто нет — тот собирает техдолг.

Следить за процессом. Агент — это партнёр, который иногда выдаёт уверенно сформулированную ересь. Замены инженера он не делает. Он умножает производительность того, кто уже умеет.

Грамотный контекст. И вот тут всё сложно. Контекст — это не «PRD на полстраницы и поехали». Это правильно описанные скиллы (как должно быть устроено мышление агента), субагенты (кто за что отвечает), MCP-серверы (откуда тянуть актуальные данные), документация проекта, история задач, архитектурные решения и инварианты — правила, которые нельзя ломать ни при каких раскладах.

И вот тут начинается весёлое: когда ты всё это аккуратно собираешь, контекстное окно у Опуса или GPT начинает забиваться под завязку. У меня была отдельная статья про реальный потолок миллионного окна Опуса 4.7 — он эффективно работает не на миллионе токенов, а где-то до 300–400 тысяч, дальше начинается заметная деградация качества. И этому есть подтверждение в системной карте от самих Anthropic. Так что «больше контекста» в новых моделях — это не «больше комфорта». Это новый головняк: что выкидывать, что оставлять, что подсовывать первым.

Косвенно ProgramBench и про это: даже когда у задачи есть чёткое описание и чёткие тесты, у моделей не получается. Требований становится столько, что модель теряет их из виду быстрее, чем успевает разложить всё по полочкам.

(Кстати, забавный момент. Старые тесты типа HumanEval и MBPP сейчас стоят на 90% и выше. Их продолжают цитировать как доказательство того, что «ИИ уже умеет программировать». На самом деле это значит другое: задача «дописать функцию по сигнатуре» — решена. ProgramBench, SWE-bench Live и подобные — это попытки построить тесты, которые не насыщаются мгновенно. Хорошо, что они появляются. Плохо, что многие до сих пор живут в эпохе HumanEval.)

Где тест не идеален (для честности)

Снимем панамку и посмотрим на ограничения сами, чтобы не получить минусы за «продажу хайпа в обратную сторону».

Ноль у восьми из девяти моделей значит, что тест сейчас не различает их по тонкости. Можно сказать, что Опус 4.7 «лучше» — потому что 3% против 0–2.5%. Но три процента — это шесть задач из двухсот. По такому разбросу выбирать модель для боевой работы рано.

Авторы используют намеренно простую обвязку — mini-SWE-agent. Никакой многошаговой оркестрации, никаких специализированных инструментов, никаких подагентов. Это сделано, чтобы измерять способности самой модели, а не качество обвязки. Я каждый день работаю не с «голой моделью», а с Claude Code, у которого свои команды, подагенты, целый workflow. Бенчмарк меряет точку «модель в вакууме», прод живёт в точке «модель + инфраструктура». Между ними — большая разница, и она в пользу прода.

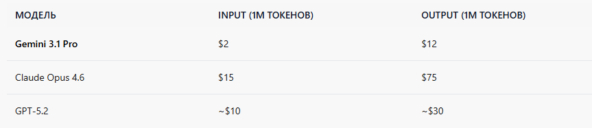

Стоимость не учтена. Нет цены за задачу, нет токенов на агента. По моему опыту, расстановка моделей по соотношению «качество / стоимость» обычно сильно отличается от расстановки по голому скору. Здесь этого среза нет. Будем смотреть в пейпер, может, авторы добавят его отдельным приложением.

Пока писал эту статью, понял, что самим бенчмаркам нужен такой же спокойный разбор — что меряет каждый, для какой задачи нужен, на что смотреть. Сделал отдельный PDF: 31 тест по 9 категориям (не только кодинг — там и математика, и длинный контекст, и агентские, и мультимодальность, и русский язык). Для каждого карточка: что меряет / задачи / лидеры на май 2026 / ограничения. Лежит закреплённым в моём Telegram-канале. Бесплатно, без смс и без регистрации, всё как полагается.

Что я с этого забираю

Цифра «0%» — это не приговор кодинг-моделям. Это повод сверить ожидания с реальностью.

ИИ отлично пишет код, когда декомпозиция уже сделана: понятно, какие компоненты, как они общаются, какой инвариант надо удержать. Декомпозицию пока делает человек. Кто это понимает — выигрывает: использует ИИ как партнёра и тащит работу в разы быстрее. Кто верит, что декомпозицию тоже сделает за него промпт — собирает технический долг, который потом приходит чинить за тройной прайс.

Бенчмарк свежий, открытый, с пейпером, докер-окружениями и кодом на гитхабе. В ближайшие месяцы цифры начнут расти — кто-нибудь обязательно прогонит свою агентскую систему с памятью, длинным chain-of-thought, подагентами. Но вряд ли мы быстро увидим там 90%, как в HumanEval. Это упирается в саму сложность задачи, а не в «текущее поколение моделей».

А пока — не торопись верить, когда тебе обещают, что «ИИ соберёт тебе стартап с нуля по одному промпту». В лидерборде конкретного теста с конкретной методологией три процента «почти», у всех остальных — ноль.

Disclaimer

Знаю, статья может прозвучать как «AI-евангелист отрекается от веры». Это не так. Я каждый день работаю с Claude Code и Codex CLI, и оба инструмента действительно экономят кучу времени. Но именно поэтому я хочу честно отделять: где ИИ работает (узкие, размеченные задачи), а где не работает (архитектурные задачи с нуля).

Если говорят «ИИ заменяет программистов» — это неправда. Если говорят «ИИ ничего не может» — тоже неправда. Где-то посередине, и ProgramBench как раз показывает, где именно проходит граница.

Полезные ссылки на сам тест:

Лидерборд и описание: https://programbench.com/

Гитхаб с кодом: https://github.com/facebookresearch/ProgramBench

Докер-окружения: https://hub.docker.com/orgs/programbench/repositories

Про подобные эксперименты пишу в телеграм-канале AI Dev Team — там же делюсь тем, что прилетает в работу. Если хочется обсудить применение бенчмарка к своему стеку или поделиться своими прогонами — пиши в личку @maslennikovig. Open-source оркестратор-кит, на котором у меня живёт ежедневная работа с агентами — лежит на гитхабе.

Если попробуешь прогнать что-то своё через ProgramBench — отметься в коментах, что получилось. Особенно интересно, как поведут себя более продвинутые агентские системы с подагентами и памятью.