Рассуждение о дискретных динамических системах и алгоритмах

Дискретные динамические системы бывают разные — бывают со статичными правилами эволюции, например правило +1 создаёт систему для начального нуля такую: 0, 1, 2, 3, 4...

А бывают и с динамическими правилами эволюции, например правило x(t+1) = x(t) + 1 + g, g(t+1) = g(t) * 2. Но в общем случае g(t) тоже можно считать частью динамической системы и добавить её в качестве новой переменной к динамической системе. Тогда динамическая система с любыми динамическими правилами эволюции преобразуется в динамическую систему со статичными правилами эволюции. В общем случае это означает, что не существует динамических систем с нестатичными правилами эволюции (если мы не берём внешнее управление в расчёт и недетерминистичные функции — такие как случайность). А значит, любая динамическая система обладает марковским свойством — её будущее зависит только от её текущего состояния и правил перехода, но не от истории того, как она в это состояние пришла.

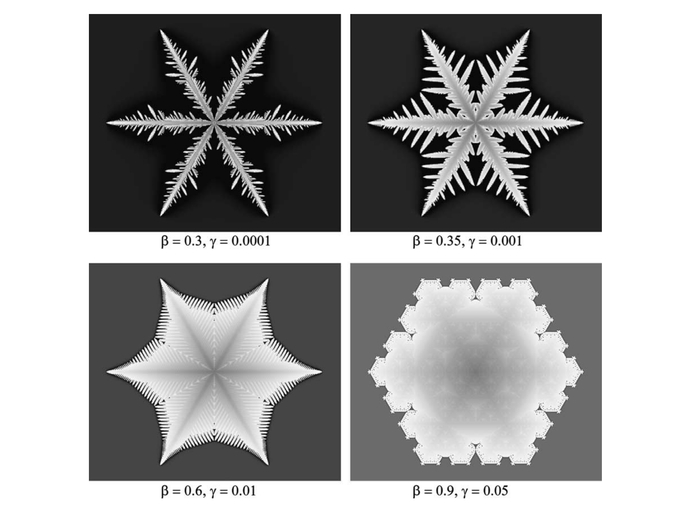

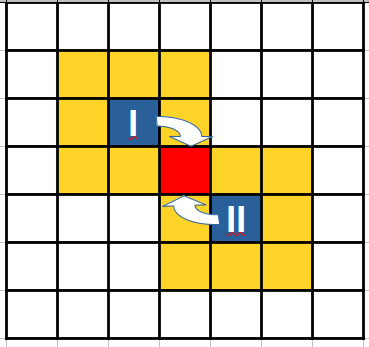

Итак, у нас есть дискретные динамические системы со статичными правилами эволюции, и очевидно, что внутри них можно создавать машины Тьюринга и алгоритмы (к примеру, клеточный автомат с правилом 110, если количество переменных в динамической системе не ограничено). Мы понимаем, что раз правила статичны и внутри них нет внутренней памяти, то по сути функция перехода во времени для дискретной динамической системы выражается в виде конечных таблиц перехода из состояния t в состояние t+1. Часть этих таблиц можно представить как матрицы, умножающиеся на вектор текущего состояния (для линейных случаев эволюции), с результатом в виде вектора для t+1.

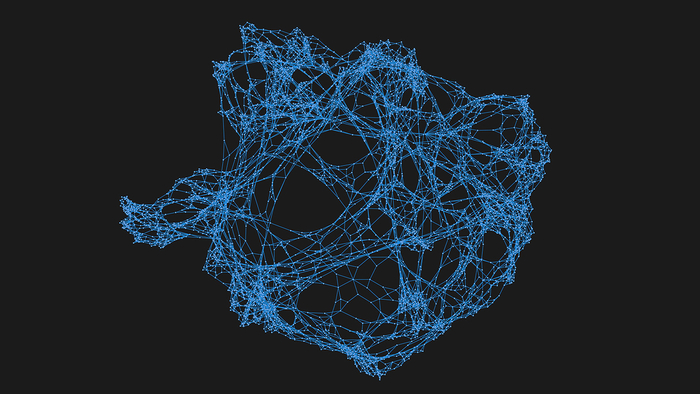

Дискретная динамическая система состоит из переменных. Для каждого значения каждой из этих переменных возможен свой направленный граф влияния во времени на состояния других переменных во времени вперёд, а также наоборот — граф значений переменных в прошлом, которые повлияли на то, что значение переменной стало таким, каким оно стало сейчас, во времени назад. То есть возможна ситуация в теории динамических систем, когда значение переменной может быть привилегированным, а значит значение другой переменной сильно зависит от значения привилегированной, а может быть ситуация, когда управление будущим состоянием равномерно распределено по переменным.

В этом смысле довольно интересно, что так как задание динамической системы (как мы уже выяснили) невозможно без статических правил, получается, статические правила являются привилегированными переменными по отношению к переменным состояния динамической системы. Состояние динамической системы не способно поменять правила эволюции. Значит, концепция управления (и победителя, который получает всё) зашита в определение любой динамической системы.

Входные (из прошлого) и выходные (в будущее) графы влияния значения одной переменной можно очевидно объединить в общий граф потенциального влияния переменной на другие переменные в прошлом и будущем. Для этого случая возможны две возможности — граф влияния для одной и той же переменной не меняется со временем, граф влияния переменной меняется со временем. Мы можем задать такой математический вопрос: как связана форма таблицы функции эволюции со строением графов влияния?

Очевидно, раз в динамическую систему можно добавлять машины Тьюринга, значит можно добавлять игры и игроков. Игры возможны такие, что состояние переменной выигрыша в игре определяется обширным статичным графом влияния, так и узким статичным графом влияния, так и неопределённым графом влияния (меняющимся со временем). Для случая обширного статичного графа влияния это означает, что состояние переменной выигрыша определяется большим числом переменных в прошлом в этой игре, а значит для алгоритма, который будет моделировать эту зависимость, нужно будет, вероятно, много памяти для этого самого моделирования. Для игры, в которой граф влияния не обширен, количество вычислений для его моделирования должно в общем случае уменьшаться (при равной временной сложности). Для случая же, когда граф влияния не определён, сложность выигрыша в игре зависит от того, насколько легко вычислить этот граф влияния для будущего. То есть как бы граф влияния в прошлом и будущем определяет, насколько много памяти нужно агенту для выигрыша в игре, и в части случаев (когда граф влияния отсечен) он связан с тем сколько временных итераций нужно сделать, чтобы получить выигрыш (но не полностью).