Whisper - это мультиязычная нейросеть, позволяющая распознавать речь в видео или аудиофайле и расшифровывать их в текст, а также в режиме реального времени переводить речь в текст за счет аудиозахвата.

Кому будет полезна:

- Людям, кому нужны субтитры для видеоконтента (Ютуберы, телевиденье)

- Работающим со стенограммами

Мы с вами будем разбирать версию на C++, которую очень легко использовать и которая не требует установки кучи зависимостей.

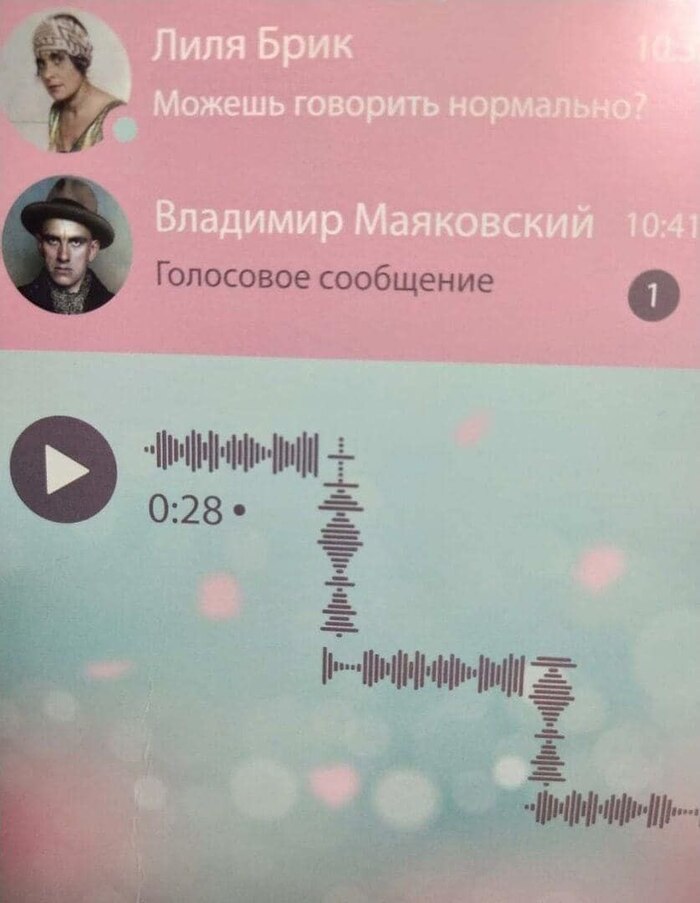

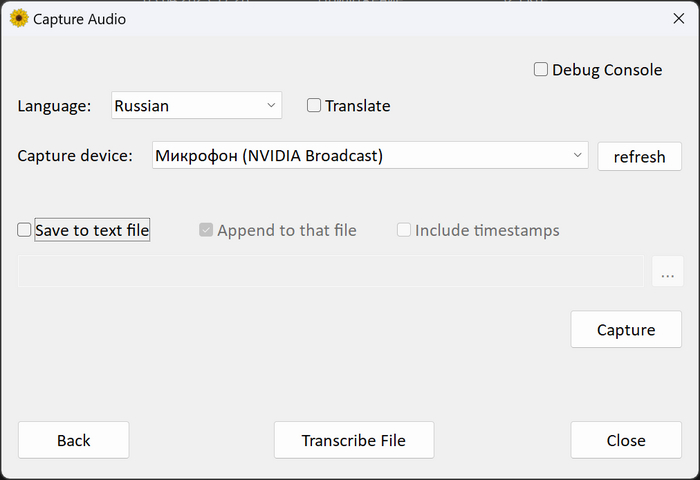

Интерфейс выглядит довольно просто.

Нам надо выбрать язык нашего источника. Если хотите сразу же перевести текст на английский - выберите Translate.

В Transcribe File вы выбираете файл, из которого будем извлекать текст.

Output format: формат, в котором сохраним текст. Есть как обычный текстовый файл, так и различные стандарты субтитров.

Ну и в поле ниже выбираете, куда сохранится текст.

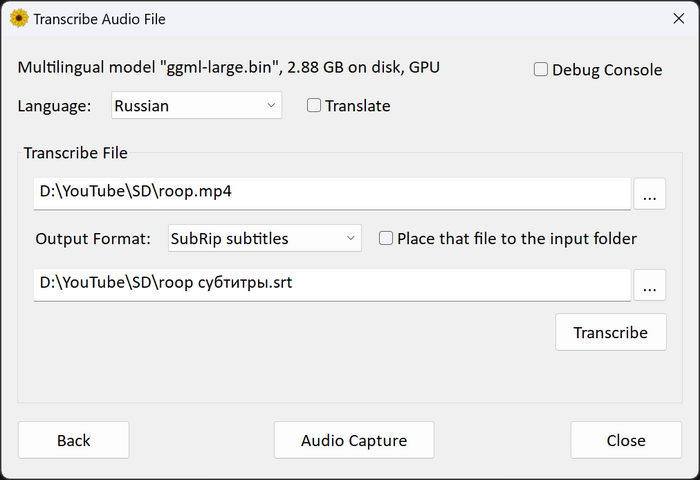

После всех настроек нажимаем Transcribe и обработка начнется. За процессом можно следить, нажав Debug Console, выглядит это как-то так:

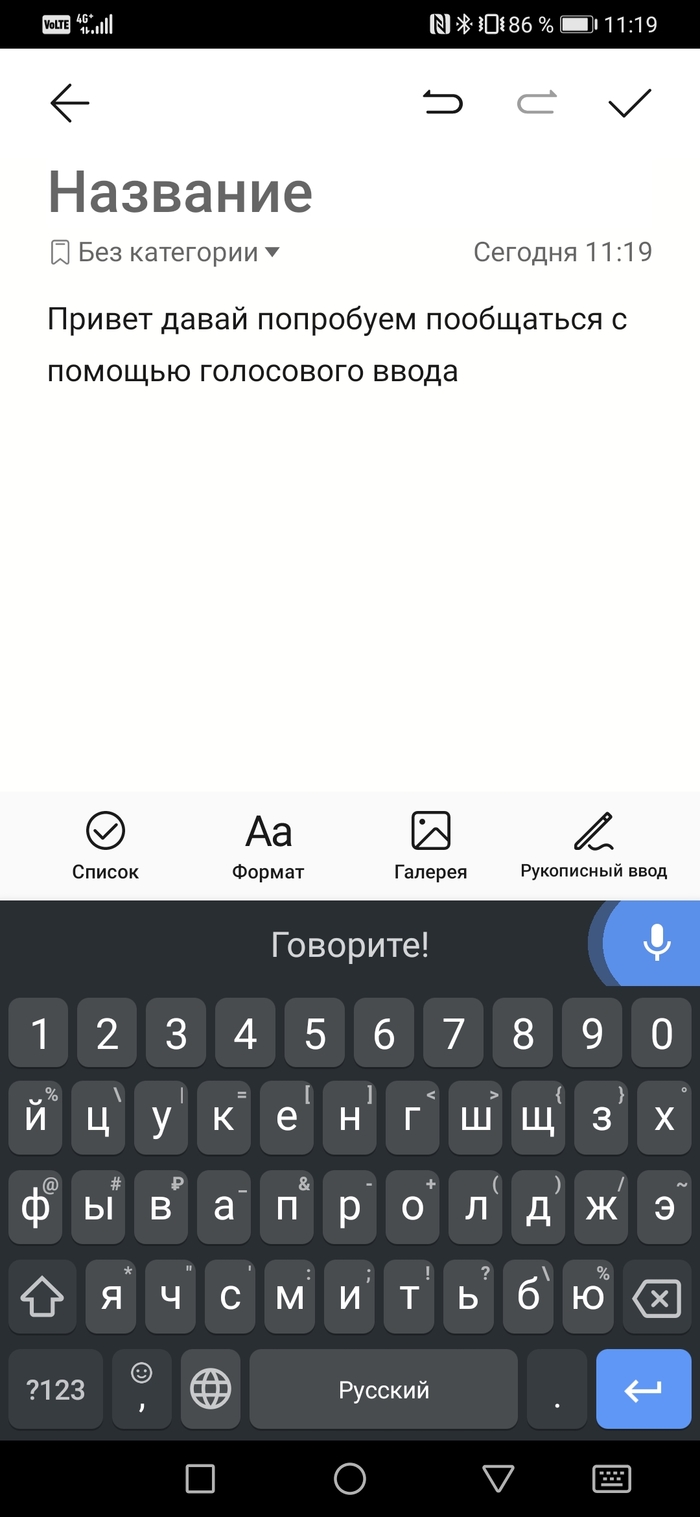

Нажав Audio Capture мы переходим в режим захвата звука с микрофона.

1) Качаем архив WhisperDesktop.zip с Github и распаковываем.

2) С Huggingface качаем модель. Чем больше модель весит, тем более точно будет работать расшифровка, но и больше использоваться видеопамяти. Рекомендую попробовать модели ggml-medium.bin и ggml-large.bin

3) Закидываем нашу модель в папку, с WhisperDesktop.exe и запускаем его.

Вот в принципе и всё. Больше различных статей по полезным и интересным нейросетям, а также мои сборки можно найти у меня в телеграм канале.