Оригинальное поздравление с днем рождения с помощью нейросети: как сделать видео за 10 минут

Сегодня поздравление с днем рождения нейросетью стало простым и быстрым способом удивить близких. Современные ИИ позволяют создать видео с анимацией, музыкой и дикторским голосом всего за 10 минут. Достаточно подготовить фото виновника торжества (если нужно) и придумать пару промтов для генерации. На выходе получится динамичный ролик длительностью до 30 секунд.

Выбираем нейросеть для создания поздравления

Для тех, кто хочет сделать видео поздравление с днем рождения с помощью нейросети, сейчас оптимально подходят три решения:

Sora 2 и Sora Pro — лучший выбор, если нужен реализм. Эти нейросети отлично воспроизводят плавные движения героев, детализируют сцену, делают анимацию максимально натуральной. Если хочется получить видео высокой четкости со сложным сюжетом — стоит остановиться на Sora.

Veo 3.1 — главное преимущество этой модели в том, что она сразу генерирует ролик со звуковым сопровождением. Это существенно экономит время — не придется отдельно подбирать музыку и озвучку. Сгенерировать видео поздравление с днем рождения с помощью нейросети можно быстрее, чем через Sora, а качество остается достойным для поздравления.

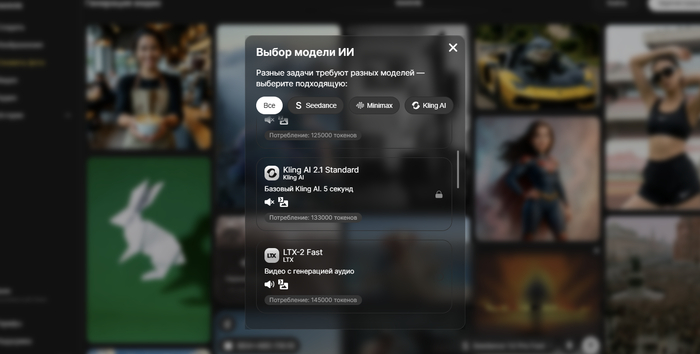

Kling AI — отличный вариант, если нужно добавить движения статичному изображению. Например, если уже есть готовая картинка (созданная с помощью NanoBanana или Midjourney), Kling за пару минут превратит ее в анимированный ролик.

Чаще всего для создания видео поздравления с днем рождения с помощью нейросети использую бота c Veo 3 и Sora 2. Работают они без VPN, принимают российские карты и позволяют делать все прямо с мобильного. Не нужно заводить аккаунты на десятках площадок — все просто.

Подготовительный этап: что потребуется

Перед запуском определитесь, какой формат ролика вам нужен:

Вариант А: если хочется сделать видео с настоящим человеком, пригодится фотография именинника (селфи или портрет). Дальше можно внедрить лицо на поздравительный ролик с помощью deepfake.

Вариант Б: ролик, созданный полностью с нуля. Разрабатываем персонажа самостоятельно — можно выбрать мультяшный или максимально реалистичный стиль. Подойдет тем, кто ищет оригинальное решение или не располагает фотографиями.

Вариант В: анимируем готовое изображение. Сначала создаём статичную картинку, например, атмосферу праздника, после чего придаем ей движение.

Для варианта А потребуется:

Четкое фото виновника торжества (разрешение от 1080p, лицо прямо, без очков и шапок).

Видео-донор — видеоролик, где предстоит заменить лицо. Можно воспользоваться шаблоном поздравления или записать собственное видео.

Этап 2. Получаем видео с нуля (Вариант Б)

Это самый оперативный способ: все элементы ролика рисует нейросеть.

Составляем промт для Veo 3

Запускаем бота Veo 3, вставляем промт. Veo сразу добавляет аудиодорожку, поэтому указываем желаемую музыку прямо в описании.

Пример промта для взрослого:

A cozy birthday dinner with a 35-year-old man at a decorated table. Bright garlands, flying confetti, dessert со свечами. Мягкий свет, радостная атмосфера. Веселая музыка. 4K разрешение, стиль близкий к реальности.

Пример промта для ребенка:

A fairytale birthday for a 6-year-old girl in a unicorn costume. Cartoon balloons, shimmering garlands, разноцветные фонарики. Большой торт с фейерверками. Задорная музыка, анимационный стиль, яркие детали.

Вариант промта для пожилой женщины:

Уютный семейный праздник для 65-летней дамы, за столом в окружении родных. Классическая сервировка, букеты, ретро-украшения. Звучит легкая музыка на пианино. Мягкие оттенки, киношный свет, реалистичная детализация.

Veo справляется с промтом примерно за 3-5 минут. На выходе получается видео длительностью до 30 секунд, дополненное музыкой.

Заменить можно: попробуйте Sora 2

Этап 3. Делаем ролик с настоящим человеком (Вариант А)

Этот путь требует больше усилий, но результат получается индивидуальным.

Создание стартового ролика

Для начала подготавливаем видео с вымышленным героем. Применяем Veo или Sora, вписав промт:

Человек за столом смотрит в камеру, улыбается и машет рукой. На заднем плане украшения ко дню рождения. Одежда нейтральная, свет качественный, разрешение 4K.

В результате выходит короткий клип с абстрактным персонажем. Следующий шаг — замена лица на фотографию именинника.

Меняем лицо с помощью deepfake

Заходим в раздел DeepFake Video в боте. Загружаем:

Видео, полученное ранее (основной клип).

Фотографию виновника торжества (портретное фото высокого качества).

Искусственный интеллект сам подставит новое лицо в видео. Весь процесс занимает примерно 2-3 минуты.

Имейте в виду: итоговый deepfake напрямую зависит от исходного снимка. Лучше всего подходят прямые портреты с расслабленным лицом. Если на фотографии есть тени, очки или сильный поворот головы — результат может получиться неестественным.

Если хотите узнать больше — вот подробное видео с примерами, где объясняется, как избежать популярных ошибок при замене лица.

Этап 4. Добавляем движение к изображению (Вариант В)

Если уже есть подходящая картинка — добавляем к ней анимацию.

Генерируем изображение через NanoBanana

Сначала создаем статичную картинку. Для изображений с русским текстом NanoBanana Pro — идеальный вариант (например, если нужна надпись "С Днем Рождения!").

Пример промта для NanoBanana:

Открытка на праздник с надписью ‘С Днем Рождения, Анна!’. Пестрые шарики, конфетти, торт со свечами. Реализм, мягкое освещение, качество 4K.

NanoBanana отлично справляется с кириллицей — это его главный плюс по сравнению с Midjourney и Flux.

Анимация в Kling AI

Готовое изображение загружаем в Kling. Нейросеть добавляет движения: шары покачиваются, конфетти кружится, огоньки свечей мерцают.

Kling справляется за 1-2 минуты. В результате получается короткий клип (5-10 секунд), который легко зациклить или использовать в качестве интро для видео.

Этап 5. Повышаем качество видео

Если готовый ролик получился в низком качестве (например, 720p), улучшаем его с помощью апскейла.

Загружаем видео в Upscale видео. Искусственный интеллект увеличит разрешение до 1080p или 4K, добавит четкости, уберет следы сжатия.

Обычно обработка занимает 3-5 минут — все зависит от длины ролика.

Частые ошибки и как их избежать

Размытое изображение. Ошибка в промте — без указания "4K quality" или "high resolution" нейросеть создаст видео в низком разрешении. Обязательно дополняйте этими параметрами финальную часть промта.

Странные движения. Veo и Sora иногда нарушают законы физики: руки двигаются неестественно, голова резко дергается. Помогает перегенерация — просто запустите процесс повторно с тем же промтом, результат изменится.

Deepfake выглядит неправдоподобно. Если лицо "плывет" или не совпадает с движением головы — причина в исходном снимке. Используйте другое фото: в анфас, без очков, с нейтральным лицом.

Проблемы с кириллицей. Midjourney и Flux слабо справляются с русским текстом. Для надписей на русском лучше выбрать NanoBanana или Sora Images — они обучены на русском языке.

Слишком короткий ролик. Veo и Sora создают максимум 30 секунд за попытку. Хотите длиннее — подготовьте несколько клипов и соедините их в видеоредакторе (например, InShot для смартфона).

Лайфхаки для впечатляющего результата

Детализируйте промт. Чем точнее описание, тем интереснее видео. Вместо "праздничная сцена" напишите: "уютная комната с воздушными шарами, тортом на столе, мягкий свет свечей".

Используйте примеры. Нашли ролик с подходящей атмосферой? Передайте ощущение в промте: "в стиле домашнего семейного видео 90-х, теплые оттенки, легкая зернистость".

Пробуйте разные стили. Для детей подойдет мультяшный вариант (добавьте "animated style, cartoon"), для взрослых — приближенный к реальности ("cinematic lighting, photorealistic").

Используйте разные нейросети вместе. Обычно, сначала создаю изображение в NanoBanana — там удобно оформить имя красиво, затем "оживляю" картинку через Kling, а звук добавляю в Veo. В результате выходит оригинальный ролик, не похожий на стандартные варианты.

Проверьте промт на английском языке. Veo и Sora лучше воспринимают английские инструкции. Если при генерации на русском итог выглядит странно, переведите промт через ChatGPT и попробуйте снова.

Что делать после создания?

Индивидуальное видео поздравление с днем рождения нейросетью готово за 10-15 минут. Его можно сразу отправить виновнику торжества в WhatsApp, выложить в соцсетях или распечатать QR-код с ссылкой на видео для открытки.

Для большей уникальности попробуйте сменить одежду на фотографии именинника с помощью нейросети — получится тематический образ. Можно сделать даже серию роликов с разными сюжетами.

Если вы задумываетесь, как сделать видео поздравление с ИИ, используйте совместную работу нейросетей — так вы получите качественный и креативный результат максимально быстро. Главное — выбрать подходящий инструмент и продумать промт под индивидуальные пожелания.

Kling AI нейросеть на русском: как пользоваться Kling на Ranvik и где взять Kling бесплатно

Если вам нужен инструмент, который делает видео по тексту и умеет оживлять фото без сложного монтажа, то kling ai (его часто называют клинг, клинг аи, клинг ай, клинг ии) — один из самых практичных вариантов. На платформе Ranvik он доступен в понятном интерфейсе и на русском языке: вы вводите запрос, при желании добавляете изображение — и получаете ролик, который выглядит как мини-сцена с движением камеры и персонажей.

В этой статье разберёмся, как пользоваться kling ai на сайте Ranvik, какие режимы выбирать под задачу, как добиться стабильного результата, и что реально означает «kling бесплатно» на практике. Параллельно закроем популярные запросы: kling video, kling ai video, kling ai фото, kling видео, видео клинг, kling оживить фото и другие.

Ссылка на нейросеть Kling ai на сайте Ranvik: https://ranvik.ru/kling

Что такое Kling AI и почему вокруг него столько шума

Нейросеть kling — это генератор видео, который создаёт короткие ролики:

из текста (Text-to-Video),

из изображения (Image-to-Video),

а также делает «живую» анимацию, когда нужно kling оживить фото или собрать вертикальный ролик для соцсетей.

По смыслу это «ИИ-режиссёр»: вы описываете сцену, а kling ai нейросеть сама выстраивает движение, свет и динамику в кадре. На странице Ranvik это прямо выделено в блоках «Видео из текста» и «Оживление фотографий».

Важно: в русскоязычном инфополе иногда встречается написание kling al / kling al нейросеть (ошибка в «AI»). В контексте запросов это всё равно про ии kling — просто учитывайте, что правильнее писать kling ai.

Чем Ranvik удобен для Kling AI в России

Пользоваться kling на русском особенно комфортно, когда:

интерфейс не требует VPN,

подсказки понятные,

вход и запуск генерации не превращаются в «квест».

На странице Ranvik прямо указано, что Kling можно использовать на русском языке, а также есть формат «начать бесплатно» и базовые лимиты для теста.

Если вы ищете именно kling ai на русском, то начните отсюда: kling ai на русском — это страница модели на Ranvik, откуда логично переходить к запуску.

Как пользоваться Kling AI на сайте Ranvik: быстрый старт

Ниже — понятная схема, которая подходит новичкам и тем, кто уже пробовал генерацию видео в других сервисах.

Шаг 1. Вход и выбор режима

На Ranvik вы заходите в раздел Kling и выбираете задачу:

Видео из текста — когда у вас есть сценарий/описание,

Оживление фотографий — когда есть исходный кадр, который нужно «раскачать» движением,

ролики для соцсетей (обычно вертикаль),

демонстрационные и рекламные сюжеты.

Если вы гуглили «сайт kling» или «kling официальный сайт», имейте в виду: Ranvik — это удобная точка входа и витрина инструментов, а не «пересказ». Здесь логика простая: выбрали инструмент → задали параметры → сгенерировали.

Шаг 2. Формулировка промпта (самое важное)

Качество напрямую зависит от текста запроса. Для kling ai видео лучше работает структура:

Кто/что в кадре (герой, объект, стиль)

Где происходит действие (локация, время суток)

Что делает герой (движение, действие)

Как снято (камера, планы, динамика)

Атмосфера (свет, настроение, цвет)

Пример (универсальный):

«Девушка в бежевом пальто идёт по мокрой улице вечернего города, мягкий неон, лёгкая дымка, камера плавно следует сбоку, кинематографичный свет, реалистично.»

Так вы снижаете риск хаоса в кадре и получаете «сцену», а не набор случайностей.

Шаг 3. Если нужно оживить фото — загрузите изображение

Режимы типа kling ai фото / kling ai нейросеть фото / клинг фото удобны, когда:

есть портрет,

есть товарная фотография,

есть иллюстрация или постер.

Вы загружаете изображение, добавляете короткое описание движения (например, «лёгкое движение волос, моргание, мягкий поворот головы») — и запускаете генерацию.

Именно так чаще всего решают задачу kling нейросеть оживить фото и похожие запросы: kling нейросеть оживить, kling ai нейросеть оживить, kling ai нейросеть оживить фото.

Как сделать «оживление фото» реалистичным: 12 практических правил

Чтобы kling оживить фото выглядело правдоподобно (а не «пластиково»), используйте чек-лист:

Делайте движение минимальным: «subtle motion», «слегка», «едва заметно».

Одна идея — один ролик: не просите одновременно поворот, прыжок, смену эмоций и зум.

Контролируйте камеру: «камера статична» или «плавный dolly-in».

Добавляйте микродетали: моргание, дыхание, ветер.

Избегайте резких эмоций: «широкая улыбка» часто ломает лицо.

Уточняйте стиль: «реализм», «аниме», «3D-рендер», «акварель».

Не перегружайте «кинематографичностью» — лучше 1–2 маркера: «soft light», «shallow depth of field».

Держите фон простым — сложный фон чаще «плывёт».

Проверяйте исходник: чёткое лицо, нормальное освещение, без сильного блюра.

Если портрет — просите движение головы на 5–10 градусов, не больше.

Для товара — «плавный поворот на столе», «мягкий свет».

Ререндер: если первый вариант слабый, меняйте 1 параметр за раз.

Так вы приблизитесь к тому, что люди ожидают, когда вводят запросы вроде kling ai бесплатно оживляем или kling ai оживляем фото бесплатно.

«Kling бесплатно» и «Kling AI бесплатно»: что это значит на практике

Фраза kling бесплатно обычно означает одно из двух:

Тестовый доступ с лимитами: можно попробовать функции, но количество генераций ограничено. На Ranvik Kling доступен с базовыми лимитами и кнопкой «Начать бесплатно».

Условно бесплатные сценарии: где часть функций бесплатная, а продвинутые режимы — по подписке/тарифу.

Поэтому запросы kling ai бесплатно, kling нейросеть бесплатно, kling нейросеть бесплатно на русском, kling ai нейросеть бесплатно на русском корректнее читать как «хочу протестировать и понять качество до оплаты». И это нормальная стратегия: сначала проверяем связку «промпт → стабильность → стиль», потом принимаем решение.

Версии Kling: Kling 2, Kling 2.1, Kling 2.5 и Kling 2.5 Turbo — что выбирать

Пользователи часто сравнивают версии, потому что качество движения и «сохранение лица» реально зависят от модели.

Kling 2 и Kling 2.1

Запросы kling 2 и kling 2.1 обычно возникают, когда нужно:

более предсказуемое движение,

меньше артефактов,

проще добиться «ровного» результата на базовых сценах.

Если вы делаете объясняющее видео, простую предметку или «мягкое оживление» — выбирайте более спокойный режим и меньше динамики.

Kling 2.5

Запрос kling 2.5 встречается у тех, кто хочет:

более кинематографичный результат,

лучшее соблюдение промпта,

более богатую динамику.

Kling 2.5 Turbo

kling 2.5 turbo — это то, что чаще выбирают под «быстро и эффектно», особенно для соцсетей и тестов креативов. В новостях и обзорах 2025 года подчёркивают, что версия 2.5 Turbo заметно усиливает понимание сложных инструкций и удержание логики ролика.

Мой практический совет для коммерческих задач:

для «стабильно и аккуратно» — начинайте с более спокойных настроек/версий,

для вау-эффекта и быстрых вариаций — пробуйте kling 2.5 turbo, но закладывайте время на 2–4 итерации.

Kling Video и Kling AI Video: какие сценарии заходят лучше всего

Когда люди пишут kling video, kling ai video, kling ai video (да, запросы часто дублируют друг друга), обычно им нужно одно из трёх:

1) Вертикальные ролики для соцсетей

Под «видео клинг» отлично работают:

быстрые концепты рекламы,

визуальные метафоры,

«до/после» (если аккуратно),

атмосферные бэкстейдж-сцены.

Мини-шаблон промпта:

«Вертикальное видео 9:16, крупный план продукта на столе, мягкий студийный свет, камера медленно приближается, лёгкий пар/дымка, реализм.»

2) Мини-сюжеты для презентаций и лендингов

Если вы делаете сайт/презентацию, используйте Kling как генератор коротких «сцен-вставок»:

3–6 секунд под заголовок,

6–10 секунд под преимущества,

3–6 секунд под финальный CTA.

3) Оживление портрета и визуала

Сюда относятся запросы:

kling нейросеть оживить фото бесплатно

kling ai нейросеть бесплатно оживить

kling ai нейросеть оживить фото бесплатно

kling ai нейросеть бесплатно оживить фото

Чтобы результат выглядел «дорого», держите движение минимальным и избегайте «широкой мимики».

Как улучшать результат: настройка движения, камеры и стиля

Даже без сложных инструментов монтажёра вы можете управлять тем, что выдаёт клинг аи нейросеть.

Управление камерой (самый недооценённый рычаг)

Добавляйте в промпт 1 строку про камеру:

«камера статична, лёгкое движение объекта»

«плавный наезд (dolly in)»

«панорама слева направо»

«ручная камера, лёгкий shake» (осторожно, может портить лица)

Управление движением персонажа

Вместо «идёт быстро и активно жестикулирует» пишите:

«делает один шаг вперёд»

«слегка поворачивает голову»

«поднимает руку и задерживает»

Чем меньше действий одновременно — тем меньше артефактов.

Управление стилем (чтобы серия роликов была одной «линейкой»)

Фиксируйте:

стиль: реализм/аниме/3D/иллюстрация

свет: soft light / studio light / neon light

цвет: warm / cold / pastel

оптика: «маленькая глубина резкости», «кинолинза»

«Kling скачать», «скачать клинг», «kling ai скачать»: что можно скачать на самом деле

Запросы kling скачать, скачать клинг, kling ai скачать, kling нейросеть скачать, kling приложение появляются по привычке — многие ищут «программу на ПК». Но у Kling основной сценарий — онлайн-генерация.

При этом официальные мобильные приложения действительно существуют:

в Google Play есть Kling AI: AI Image&Video Maker, где указаны возможности Text-to-Video и Image-to-Video.

в App Store также есть приложение Kling AI с описанием похожих функций.

Что это значит практично:

если вам нужно быстро генерировать на телефоне — пригодится приложение;

если вам важнее удобство на русском и работа «в одном сервисе» — логичнее запускать в веб-интерфейсе Ranvik.

Kling на русском: как писать промпты без английского и не терять качество

Большой плюс формата kling на русском в том, что вы можете писать естественно. На странице Ranvik отдельно подчёркивают удобство русскоязычного использования.

Но чтобы нейросеть лучше «держала» сцену, используйте русскую формулу с короткими фразами:

Субъект: «молодой мужчина в чёрной куртке»

Действие: «останавливается, смотрит в камеру»

Локация: «вечерний город, дождь»

Камера: «плавный наезд, крупный план»

Свет: «неоновые вывески, мягкая дымка»

Стиль: «реализм, кино»

Если хотите усилить контроль, можно добавлять 1–2 англ. маркера (например, cinematic, soft light), но это не обязательно.

Типичные ошибки новичков в Kling AI (и как их исправить)

Ошибка 1. «Слишком много всего» в одном запросе

Решение: оставьте один главный объект и одно действие.

Ошибка 2. Не описана камера

Решение: добавьте «камера статична» или «плавный наезд».

Ошибка 3. Ожидание идеала с первого раза

Решение: планируйте 2–5 итераций: меняйте только один параметр.

Ошибка 4. Сложные лица/группы людей

Решение: для портрета — минимальная мимика и движения; для группы — лучше общий план.

Ошибка 5. Плохой исходник для «оживления»

Решение: берите фото без сильного шума, с резкими деталями лица.

Практические сценарии для бизнеса: где Kling окупается быстрее всего

Ниже — варианты, которые чаще всего «выстреливают» в коммерции.

Реклама и карточки товаров

короткий «геройский» ролик товара на нейтральном фоне,

имитация студийного света,

микродвижение (поворот, наезд камеры).

Локальный бизнес и услуги

ролик-объяснение: «как проходит услуга» в формате сцен,

имиджевые атмосферные видео,

визуал для витрины сайта.

Онлайн-курсы и эксперты

сценки под тезисы урока,

«иллюстрации-видео» вместо стоков,

тизеры уроков на 5–7 секунд.

Кстати, на странице Ranvik есть похожие примеры использования: предприниматели, эксперты, фотографы, блогеры.

Мини-гайд: 20 готовых промптов под Kling AI видео

Используйте как шаблоны, меняя объект и стиль.

«Крупный план чашки кофе, пар поднимается вверх, утренний свет из окна, реализм, камера статична.»

«Вертикальное видео 9:16: кроссовки на подиуме, мягкий студийный свет, плавный поворот, реализм.»

«Ночной город в неоне, мокрый асфальт, человек идёт вдаль, плавный наезд, кино-стиль.»

«Портрет: лёгкое дыхание, моргание, мягкий свет, камера статична, реализм.»

«Книга на столе, страницы слегка колышутся, ветер, тёплый свет, макро.»

«Технологичный гаджет на чёрном фоне, световые блики, медленный облет камеры.»

«Тарелка пасты, лёгкий пар, ресторанный свет, shallow depth of field.»

«Авто на парковке ночью, отражения, камера плавно приближается.»

«Сцена: человек открывает дверь, мягкий свет изнутри, камера из-за плеча.»

«Аниме-стиль: персонаж поворачивает голову, ветер, сакура на фоне.»

«3D-рендер: продукт вращается, чистый фон, мягкие тени.»

«Городской пейзаж: облака быстро плывут, таймлапс-эффект.»

«Собака бежит по траве, солнце, slow motion (осторожно, может усложнить).»

«Космическая сцена: корабль медленно пролетает, туманности, кино.»

«Мини-реклама: бутылка воды, капли, студийный свет, макро.»

«Интерьер: лампа включается, свет разливается по комнате.»

«Флэт-лей: косметика на столе, камера плавно двигается сверху.»

«Портрет: лёгкая улыбка, моргание, мягкий свет, реализм.»

«Логотип на стене, световой блик проходит по поверхности.»

«Текстура ткани крупным планом, движение, как будто по ткани проходит ветер.»

Ranvik и Kling AI: как выжать максимум за 15 минут

Если у вас мало времени, делайте так:

Сформулируйте 3 версии промпта (короткий / средний / детальный).

Запустите генерацию с самым простым вариантом.

Оцените: что сломалось — объект, движение или камера.

Добавьте одно уточнение.

Повторите 2–3 раза и выберите лучший ролик.

Это быстрее, чем «дописывать всё подряд» и получать непредсказуемый результат.

Как отличить «официальный сайт Kling» от удобных платформ доступа

В поиске встречаются запросы:

kling официальный сайт

kling нейросеть официальный сайт

клинг официальный сайт

нейросеть kling сайт

сайт клинг

Логика простая:

«официальный» — это первоисточник продукта,

«удобный доступ» — это платформа, где вы реально решаете задачу быстро, на русском и без лишних барьеров.

Для большинства прикладных задач важнее второе: скорость запуска, понятный интерфейс, стабильный доступ.

FAQ: частые вопросы про Kling AI на русском

1) Kling AI что делает лучше всего?

Лучше всего kling ai нейросеть проявляет себя в коротких сценах: kling видео из текста и kling оживить фото с мягким движением.

2) Можно ли использовать Kling AI бесплатно?

Запросы kling ai бесплатно и kling нейросеть бесплатно обычно подразумевают тестовый режим. На Ranvik есть «начать бесплатно» и базовые лимиты, чтобы попробовать генерацию.

3) Как сделать так, чтобы лицо не «плыло» при оживлении фото?

Используйте минимальные движения: моргание, лёгкий поворот, «камера статична», избегайте резкой мимики. Для портретов лучше 2–4 короткие итерации, чем один «сложный» промпт.

4) Что выбрать: Kling 2.1, Kling 2.5 или Kling 2.5 Turbo?

Если нужна стабильность — начинайте с более спокойных вариантов (часто ищут kling 2.1). Для креативов и скорости — kling 2.5 turbo; его улучшения активно обсуждали в 2025 году.

5) Где «скачать Kling» и нужно ли это?

Запросы kling скачать / kling ai скачать популярны, но чаще всего скачивать ничего не нужно: Kling работает онлайн. При этом есть мобильные приложения в Google Play и App Store.

Короткий вывод

Если вам нужен kling ai на русском, чтобы быстро делать kling ai видео, генерировать kling video по описанию и запускать kling нейросеть оживить фото без монтажа — начинайте с простого: один объект, одно действие, понятная камера, мягкое движение. А дальше — 2–5 итераций, и вы практически всегда приходите к ролику, который можно использовать в рекламе, соцсетях или на сайте.

Если захотите, я могу подготовить 30–50 промптов именно под ваш бизнес (ниша, аудитория, стиль) — так, чтобы они сразу подходили под серии роликов и A/B-тесты.

Как быстро создать видео для YouTube с помощью нейросетей: пошаговая инструкция

Создание видео для YouTube с помощью нейросетей стало невероятно быстрым и доступным процессом. Теперь за пару часов можно сделать полноценный ролик для YouTube: получится видео с эффектным превью, четким сценарием и яркими визуальными вставками. Главное — заранее определиться с темой, о чем пойдет речь.

Весь процесс создания видео для YouTube с помощью нейросетей можно пройти, имея под рукой только смартфон и доступ к специализированным нейросетевым сервисам. Остальное автоматически сгенерируют умные алгоритмы, что делает процесс максимально удобным даже для новичков, которые не знают, как сделать видео на YouTube с нуля.

Планирование ролика и написание сценария

Первый шаг — сформулировать идею через бота на базе GPT. Этот инструмент помогает структурировать мысли и создавать эффективный сценарий для YouTube, а также является отличным примером того, как нейросети для создания контента могут упростить подготовительный этап.

Промт для генерации идеи:

Разработай концепцию YouTube-видео по теме [ваша тема]. Нужна креативная задумка, план ролика на 5–7 минут, интересный заголовок и текст для обложки. Учитывай популярные тренды октября 2025 года.

GPT выстроит план с указанием времени и описанием сцен. Сразу уточните детали для любого блока:

Раскрой сцену №3 подробнее. Опиши, что показывать на экране, какие визуальные детали добавить, чтобы зритель не отвлекался.

В итоге получится полный сценарий с подсказками по визуалу. ChatGPT может держать в памяти большие объемы информации, поэтому помогает создавать последовательные советы по всему ролику и облегчает задачу тем, кто только осваивает, как сделать видео на YouTube с нуля.

Разработка визуальной концепции

Когда сценарий готов, определяют визуальный стиль. Снова подключают ChatGPT и формулируют промт:

На основе сценария напиши техническое задание для генератора видео. Описать стиль, цветовую гамму, вид анимации, смену сцен. Формат — YouTube, целевая аудитория 25–35 лет.

В ответ получите подробные характеристики для каждой сцены — эти описания пригодятся при создании промтов для видеогенераторов, что является важным этапом при создании видео для YouTube с помощью нейросетей.

Генерация превью и графических элементов

Яркая обложка — залог успеха ролика. Для ее создания отлично подходит Midjourney v7, но потребуется VPN. Легкая альтернатива — Flux 1.1 Pro Ultra, который работает без ограничений.

С помощью бота для Midjourney (доступен без VPN, поддерживает российские банковские карты) можно быстро сделать привлекательное превью:

Ultra-realistic YouTube thumbnail, [ваша тема], vivid contrasting colors, area for text on the right, studio-quality lighting, visually appealing composition —ar 16:9 —v 7

Для создания дополнительных графических решений — иконок, схем, иллюстраций — используйте тот же Midjourney или Flux. Второй сервис быстрее справляется с задачей и лучше обрабатывает русскоязычные промты, что важно для тех, кто осваивает нейросети для создания контента.

Разработка статичных элементов для ролика

Помимо обложки понадобятся промежуточные сцены, фоновые изображения, детали инфографики. Подберите серию картинок в одной стилистике:

Minimalist infographic elements for YouTube video on [тема], flat illustration, единая цветовая палитра [цвета из техзадания], белый фон —ar 16:9

Сделайте 5–7 вариантов, которые затем сможете оживить в процессе монтажа. На форуме собраны команды Midjourney, где представлены параметры для разных визуальных стилей.

Создание видеоролика

Самый творческий момент — работа над видео. Подход зависит от формата ваших материалов.

Для обучающих видео

Оптимальным выбором станет Veo 3 — эта нейросеть создает реалистичные ролики с движением камеры и аудиосопровождением. Особенно полезна для объясняющих сюжетов и отлично подходит для тех, кто изучает, как сделать видео на YouTube с нуля.

Промт для учебного видео:

Профессиональный ведущий предлагает [вашу тему] в стиле современного минимализма интерьер, выразительная жестикуляция, уверенная речь, плавные перемещения камеры, студийный свет, длина 30 секунд

Veo 3 формирует базовый клип, который в дальнейшем можно дополнить своим голосом или добавить субтитры. Этот инструмент прекрасно иллюстрирует возможности нейросетей для создания контента.

Для динамичных роликов

Когда необходимы спецэффекты, быстрые смены кадров, анимированная графика — попробуйте Kling AI через нужный раздел бота. Kling отлично подходит для сцен с экшеном и сложной анимацией.

Быстрые переходы между сценами, современная технологичная анимация, плавающие интерфейсные элементы, плавные параллакс-эффекты, стиль киберпанк, высокая динамика

Оживление статичных картинок

Готовые изображения можно превратить в анимацию через Veo 3 или Kling: загрузите картинку в бот, добавьте промт:

Оживи это изображение: деликатные движения, презентационный стиль, 15 секунд в цикле, плавные переходы

В результате получите короткие видеосцены длиной 15–30 секунд, которые легко объединяются в итоговый видеоролик и помогут тем, кто ищет эффективные нейросети для создания контента.

Персональный контент на основе DeepFake

В 2025 году на пике популярности — персонализация с помощью DeepFake. Можно создать аватар ведущего или заменить лицо в уже готовом видео.

С помощью DeepFake-опции в боте загрузите свое фото, примените его к сгенерированному ролику — получится видео, где вы профессионально объясняете материал.

Сначала создается основа с ведущим, после чего заменяется лицо на своё. На форуме размещена видеоинструкция с примерами и подробным разбором.

Изменение одежды и стилистики

Для стильного образа ведущего воспользуйтесь инструментом смены одежды. Особенно это актуально, если начальный ролик не соответствует формату вашего канала.

Загрузите кадр, выберите нужный стиль, получите обновленный образ. Алгоритм работает на базе Stable Diffusion, выдавая максимально реалистичный результат.

Финальный монтаж и доработка

Когда все части ролика готовы, остается соединить их в полноценное видео. Для этого подойдут бесплатные видеоредакторы — такие как CapCut, Canva либо стандартный редактор YouTube. Благодаря возможностям нейросетей для создания контента, финальная сборка ролика проходит быстро и просто.

Как выстроить структуру ролика

Советую придерживаться такой схемы:

Вступление 5–7 секунд — анимированный кадр с названием канала

Зацепка 10–15 секунд — интригующий вопрос или озвучка проблемы

Основная часть 3–5 минут — созданные вами видеофрагменты

Призыв к действию 10–15 секунд — напоминание подписаться, поставить лайк и оставить комментарий

Завершение 5 секунд — логотип или тизер следующего выпуска

Технические настройки видео

Обратите внимание на параметры для YouTube:

Картинка: не ниже 1080p, а если исходники позволяют — выбирайте 4K

Формат файла: MP4, кодек H.264

Пропорции: 16:9 для стандартных видео, 9:16 для Shorts

Длина ролика: оптимально 5–10 минут для продвижения на YouTube

Хотя нейросети создают видео с достойным качеством, итоговый экспорт лучше выполнить в максимальном разрешении.

Адаптация для разных площадок

Один ролик можно преобразовать для нескольких соцсетей.

Для Shorts на YouTube: выбирайте самые динамичные 60 секунд, переводите в вертикальное соотношение 9:16, добавляйте крупные субтитры. Veo 3 отлично работает с вертикальными видео.

Для TikTok и Reels: схема похожа на Shorts, но особое внимание уделяйте первым 3 секундам — именно они цепляют аудиторию.

Для основного канала: выкладывайте полную версию с подробным разбором.

Серии роликов по одной теме

Если материал объемный, делите его на несколько частей. ChatGPT составит план из 5–7 эпизодов с плавными переходами:

Разбей этот материал на цикл из 6 роликов по 5–7 минут, создай интригу между выпусками, чтобы зрители ждали продолжения

Так появляется готовый план публикаций на месяц, а вы постепенно осваиваете создание видео для YouTube с помощью нейросетей.

Типичные ошибки и способы их избежать

Перегруженные длинные ролики: нейросети эффективнее справляются с короткими эпизодами по 30–60 секунд. Длинные видео удобнее собирать из небольших частей.

Забытый звук: часто упор делается на картинку, тогда как аудиосопровождение остается без внимания. Veo 3 поддерживает озвучку, но для лучшего результата добавляйте свой голос или музыку.

Неправильное освещение: обязательно указывайте тип света в промте — например, "professional studio lighting", "natural daylight", "cinematic lighting". Это существенно влияет на итоговое восприятие изображения.

Несовпадение стилей: при работе с разными нейросетями важно сохранять одинаковый стиль. Заранее составьте style guide и применяйте его при создании каждого промта.

Нет тестирования: прежде чем выкладывать основной ролик, сделайте короткую тестовую версию на 1–2 минуты, загрузите как Shorts. По реакции зрителей станет ясно, стоит ли продолжать выбранное направление.

Аналитика и развитие

После выхода первых видео изучайте аналитику в YouTube Studio. Особое внимание уделите удержанию — в какие моменты зрители выключают ролик, а какие досматривают до последних секунд.

Такая информация поможет доработать промты для следующих выпусков. Если аудитория уходит на определённых эпизодах, стоит изменить визуальный стиль или ускорить монтаж.

ChatGPT способен проанализировать статистику и дать рекомендации:

Привожу аналитику собственного YouTube-канала: [добавьте ключевые показатели]. Что можно усовершенствовать в видео? Какие темы развивать?

Заключение

Создание видео для YouTube с помощью нейросетей открывает новые горизонты для любого, кто задумывается, как сделать видео на YouTube с нуля. За пару часов реально сделать ролик, на который раньше уходили дни целой команды. Главное — грамотно организовать процесс и подобрать подходящие инструменты на каждом этапе. Такой же подход отлично работает и для подкастов — только вместо видео подбираются статичные картинки с анимацией.

Используя современные нейросети для создания контента, вы не только упрощаете работу, но и находите новые возможности для развития канала. Важно лишь применять их осознанно и под конкретные задачи.

Замена лица в видео онлайн: как быстро создать deepfake с помощью нейросети

Для замены лица в видео потребуется всего два файла: исходный ролик и фотография лица, которое вы хотите подставить. Итогом становится максимально реалистичная подмена лица с сохранением мимики и естественного освещения. Расскажу на конкретном примере, как лично настраиваю процесс, чтобы deepfake выглядел максимально натурально и естественно.

Как подготовить материалы для deepfake и успешной замены лица

Результат напрямую зависит от исходных файлов. Даже самая современная deepfake нейросеть не сможет спасти ситуацию, если загружены нечеткие или некачественные данные.

Требования к видео:

Разрешение не ниже Full HD (1920×1080). При меньшем качестве лицо в видео становится размытым и теряет детализацию. Для профессионального результата рекомендуется использовать 4K.

Оптимальная продолжительность — не более 2-3 минут, особенно если вы только осваиваете, как сделать deepfake. Это ускорит обработку и снизит вероятность ошибок.

Важно, чтобы лицо на видео было хорошо видно, без сильных разворотов вбок.

Освещение должно быть равномерным, без резких контрастных теней.

Следите за тем, чтобы рядом с лицом не было активной жестикуляции — это может привести к дефектам при замене лица.

Требования к фотографии:

Крупный портрет, минимум 512×512 пикселей.

Лицо желательно анфас или под небольшим углом.

Используйте мягкое освещение, избегайте грубых теней.

Отличные варианты для замены лица в видео можно найти на Unsplash и Pixabay — там много фотографий высокого качества.

Очень важно: если ракурс и освещение на фото и видео максимально похожи, итоговая deepfake нейросеть создаст результат гораздо естественнее.

Шаг 1. Запуск нейросети для замены лица в видео

Переходим в бот с deepfake-возможностями — сервис работает без VPN и позволяет оплачивать услуги с российских карт. Вся работа с deepfake нейросетью проходит прямо в Telegram, не требуется устанавливать дополнительное программное обеспечение.

Выбираем функцию замены лица в видео и deepfake. Сначала загружаем видеоролик, затем — портрет для замены лица. Ограничение на размер файла — 100 МБ, этого вполне достаточно для большинства задач. Если ролик превышает нужный размер, воспользоваться можно бесплатной утилитой Handbrake — она позволяет уменьшить объём файла без заметной потери качества.

Шаг 2. Оптимальные настройки для качественного deepfake

В параметрах deepfake нейросети есть несколько ключевых опций, влияющих на итоговую подмену лица в видео. Делюсь настройками, которые показали себя наилучшим образом.

Детализация: выбирайте самый высокий уровень — да, обработка займет немного больше времени, но итоговое изображение будет максимально четким. На средних настройках часто появляются смазанные края лица после замены.

Мимика: обязательно активируйте этот пункт. Без него лицо становится статичным и теряет живость — эмоции и живая мимика исчезают, что негативно влияет на качество deepfake.

Настройка освещенности: всегда оставляю включенной. Искусственный интеллект сам корректирует цветовую температуру и светотеневой рисунок под сцену. Раньше подобные коррекции приходилось делать вручную в редакторе.

Обычно обработка минутного Full HD видео занимает от 3 до 7 минут. Пока deepfake нейросеть работает, можно заняться другими делами.

Шаг 3. Проверка клипа и устранение недостатков после замены лица

После завершения обработки сразу проверьте ролик на наличие артефактов. Чаще всего встречаются такие сбои: дергание по линии лица, неестественный оттенок кожи, размытость при динамичных сценах.

Если заметили дефекты после замены лица в видео — попробуйте заменить исходное фото. Иногда причина ошибок кроется именно в неподходящем снимке, а не в параметрах deepfake нейросети. На форуме по нейросетям можно найти хорошие примеры и посмотреть, с какими фотографиями deepfake получается лучше.

Для финального этапа сохраните ролик в формате h.265 — это даст оптимальный баланс между качеством и размером файла.

Советы для достижения высокого качества deepfake

Выбирайте максимально похожие углы обзора. Если герой видео часто смотрит вправо, ищите снимки с аналогичным положением головы — так deepfake нейросеть точнее выполнит замену лица.

Удаляйте неудачные сцены. В случаях, когда лицо на кадре частично закрыто или повернуто вбок, такие моменты лучше вырезать. Оставляйте только четкие фрагменты, чтобы качество замены лица в видео было высоким.

Начинайте с коротких эпизодов. Сначала проверьте настройки на 10-15 секундах ролика — это позволит быстро определить, подходит ли выбранный подход и корректно ли работает deepfake нейросеть.

Применяйте цветовую коррекцию. После подмены лица настройте цвета, например, в бесплатной программе DaVinci Resolve. Особенно это важно, если исходное фото снято при другом освещении.

Сложные случаи: замена нескольких лиц и работа с длинными роликами

Если нужно заменить несколько лиц, обрабатывайте каждое по отдельности: сначала одно, скачайте результат, затем повторите для остальных. Так deepfake нейросеть справится с задачей точнее.

Можно использовать бота c VEO 3 — он поддерживает работу с группой лиц, но обработка займет больше времени.

Для длинных видеороликов (более 5 минут) делите их на отрезки по 2-3 минуты. Это ускорит процесс и позволит избежать полной переработки в случае ошибок deepfake.

Если предстоит массовая замена лица в видео — воспользуйтесь пакетной обработкой: загрузите сразу несколько роликов, и deepfake нейросеть выполнит задачу по очереди.

Типичные проблемы и как их избежать при создании deepfake

Низкое качество исходника. Не стоит пытаться улучшить плохое видео заменой лица — если ролик темный или размытый, deepfake не даст хорошего результата. Лучше сразу подобрать подходящий материал.

Неверный угол снимка. Селфи, сделанное снизу, не подойдет для видео, снятого на уровне глаз — важно совпадение ракурсов для качественной замены лица.

Несовпадение по свету. Студийное освещение в ролике и дневной свет на фото могут привести к заметным отличиям, даже при автоматической коррекции deepfake нейросети.

Загрузка слишком больших роликов с первого раза. Многие новички сразу пытаются обработать длинные видео — начните с коротких фрагментов, отработайте навык, а затем переходите к полноценным роликам.

Новые инструменты и возможности deepfake нейросетей

Помимо замены лица в видео, доступна функция апскейла — увеличения разрешения ролика. Например, видео в HD можно преобразовать в 4K. Эта опция есть в том же боте.

Если хотите оживить статичное фото, попробуйте бот с Kling AI. Он позволяет сделать анимацию из картинки. Можно сначала выполнить замену лица на снимке, а затем сделать анимированную версию.

Иногда требуется не только изменить лицо, но и наряд — для этого существует отдельная функция смены одежды на фото. Это удобно для создания новых образов или стилистических экспериментов с deepfake контентом.

Создать качественный deepfake — задача вполне выполнимая за несколько минут. Для этого не потребуется сложное программное обеспечение — достаточно правильно подобрать исходник и грамотно настроить deepfake нейросеть. С опытом вы будете быстро находить оптимальные параметры для любых задач, связанных с заменой лица в видео.

Современный искусственный интеллект не только ускоряет процессы и делает замену лица в видео доступной каждому, но и открывает новые подходы к созданию уникального видеоконтента. Главное — использовать deepfake и нейросети осознанно и по назначению.

Nano Banana 2 (Pro) вышла!!! Сложные тесты - пройдено! Где попробовать без водяных знаков?

Протестировать можно в сервисе Cyber AI - сервис выдает высокое качество без водяных знаков.

- Работа с русским текстом (кириллица) - идеально

- Пропорции любые, просто указывайте в промте, пример "Создай изображение с пропорцией 9:16"

- Подтянули детализацию, стилистику, свет, тени

- Качество до 4К

- Количество загружаемых референсов до 14 шт

Первый и самый сложный всем известный тест, где все нейронки проваливают задачу наполнить бокал до конца, промт:

Реалистичная фотография светлой комнаты в минималистичном стиле. На белой стене висит один круглый винтажный настенный часы с римскими цифрами, бронзовая рамка. Стрелки часов выставлены строго на 10:10, время читается чётко и без искажений. Вдоль стены тянется простая деревянная столешница тёплого оттенка. На столешнице по центру кадра стоит один высокий бокал для красного вина с тонкой ножкой, наполненный тёмно-красным вином почти до самого края, без переливаний через край. Справа в кадре видно часть окна, из которого мягкий дневной дневной свет освещает стену, часы и бокал, создавая естественные тени и блики на стекле. Никаких людей, надписей и лишних предметов, чистая реалистичная сцена. Еще раз!!! Наполни бокал до конца!

Тест прошла:

Самое важное!!! Работа с русским текстом (кририллица) и тут идеально:

Что по детализации и стилистике? Пример ниже и Banana тут явно выросла:

Слева Banana 2 / справа Banana 1:

Можно смело сказать, это лучшая нейронка для выполнения сложных задач

Подписывайтесь на канал с бесплатным обучением по генерации контента - @promtgs

Создание видеопоздравлений с фото через нейросети: быстрое руководство для начинающих

Обычная фотография из домашнего архива превращается в ролик, где именинник или родственник произносит ваши слова — и все это буквально за десять минут. Если раньше подобное казалось эксклюзивной услугой студий, сегодня благодаря видеопоздравлению с помощью нейросетей достаточно смартфона.

Как нейросети изменили формат видеопоздравлений

Еще недавно для эффектного поздравительного видео требовалась видеосъемка или помощь аниматоров. Теперь же видеопоздравление с помощью нейросетей полностью изменило сам процесс.

О дипфейках слышали многие, но редко кто догадывается, что эта технология не только удивляет, но и помогает создавать трогательные сюрпризы для семьи или друзей. Особенно востребовано стало фотореалистичное поздравление онлайн, когда ролик выглядит почти как настоящая запись.

Теперь доступны такие возможности:

Создать говорящий ролик по одной фотографии

Заставить героя на экране произнести ваш текст с нужной интонацией

Получить несколько вариантов поздравления и выбрать самый удачный

Освоить весь процесс за считанные минуты, без опыта и навыков

Современные нейросети настолько продвинулись, что отличить сгенерированное поздравление от настоящей видеосъемки практически невозможно, особенно когда речь идет о фотореалистичном поздравлении онлайн на экране смартфона.

Пошаговая инструкция: создаем видеопоздравление за 5 шагов

Чтобы не теряться в обилии сервисов, предлагаю самый понятный способ — подойдет даже тем, кто с техникой на “вы”. Весь процесс займет не дольше десяти минут и состоит из пяти этапов.

Шаг 1. Подберите подходящее фото

Понадобится четкий снимок того, кто будет “говорить”. Обратите внимание:

Важно, чтобы взгляд был направлен прямо в объектив

Лицо должно быть хорошо освещено и видно без теней

Лучше, если выражение лица нейтральное или слегка улыбчивое

В кадре не должно быть посторонних деталей

Подойдет любой снимок из соцсетей или семейных архивов. Сохраните его на телефон, чтобы использовать далее — именно с него получится сделать видеопоздравление из фото.

Шаг 2. Составьте поздравительный текст

Текст для ролика: Лучше выбирать короткие, эмоциональные реплики — не длиннее двадцати слов. Приветствия, личные воспоминания, немного пауз — так речь звучит живо и искренне. Поделитесь историей, обратитесь к родным. Оптимальная длительность — от тридцати секунд до минуты.

Когда не уверен, что сказать, часто обращаюсь к боту ChatGPT. Он быстро подбирает подходящий текст поздравления, который отлично вписывается в анимационные видео.

Шаг 3. Запись голоса

На этом этапе есть два варианта:

Записать голос самостоятельно — максимально естественно и просто.

Применить голосовой синтез, если хочется добиться узнаваемого звучания.

Для записи подойдет обычный диктофон в телефоне. Говорите четко, делайте паузы, не забывайте про эмоции.

Если предпочитаете синтезированный голос — попробуйте ElevenLabs. Здесь поддерживается русский язык, можно подобрать тембр, темп, добавить нужное настроение.

Шаг 4. Монтаж видео с анимацией

Теперь соединяем аудио и изображение, чтобы получить ролик с говорящим персонажем. Для этого отлично подходят KLING AI или VEO 3.

В результате получится видео, где человек на фото реалистично произносит ваш текст — движения губ и выражение лица максимально совпадают с речью. Такой способ позволяет сделать фотореалистичное поздравление онлайн буквально за считанные минуты.

Шаг 5. Финальная обработка (по желанию)

Чтобы сделать поздравление еще ярче, добавьте:

Фоновую мелодию (главное — не переборщить с уровнем громкости)

Цветные рамки или анимированные детали

Субтитры с пожеланиями

Для таких доработок используйте удобный видеоредактор на смартфоне — например, CapCut или стандартные программы из галереи.

Поздравление по сценарию

Если классический подход кажется слишком простым — попробуйте создать ролик по полноценному сценарию. На это уйдет чуть больше времени (обычно 20-30 минут), зато итог выглядит гораздо эффектнее. Часто использую этот способ для особых поводов — юбилеев, свадеб или когда хочется удивить близких.

1. Создание сценария для поздравления

Для начала определитесь с центральной идеей: какое послание хочется донести? К примеру:

Путешествие по важным точкам жизни виновника торжества

Неожиданная встреча с родными или давними приятелями

Погружение в прошлое или взгляд в грядущее

Для каждой отдельной сцены уточните:

Где происходит событие

Что говорит персонаж

Какие чувства выражаются в моменте

2. Подготовка фотографий

Соберите изображения людей, которых планируется включить в видео. Для каждого понадобится четкий портрет в анфас. Также пригодятся:

Картинки мест для сцен

Архивные семейные снимки

Фото ценных предметов или знаковых локаций

3. Создание видеосцен с помощью Kling

Kling — нейросеть, способная собирать видеоролики по детальному описанию. Алгоритм следующий:

Напишите развернутый промт с описанием момента

Загрузите примеры фотографий участников и местности

Определите длину сцены и стиль исполнения

Запустите процесс генерации (обычно требуется 5–10 минут)

Промт должен быть максимально конкретным. К примеру:

Пожилой мужчина с седыми волосами (похож на референс) сидит на берегу реки, улыбается и говорит, глядя в камеру. На заднем плане летний лес.

4. Озвучивание

Для лучшего эффекта желательно записать отдельную звуковую дорожку для каждого эпизода. Это поможет точнее совместить аудио с видео.

Если важно передать разные эмоции, используйте Play.ht — там есть множество голосов с отличной передачей интонаций.

5. Сборка итогового ролика

Все подготовленные части теперь нужно объединить в единое видео. Подойдут редакторы, такие как Adobe Premiere Elements или сервис FlexClip:

Загрузите видеофрагменты

Прикрепите аудиодорожки и выровняйте их

Добавьте плавные переходы между кадрами

Украсьте ролик музыкой и финальными титрами

Сохраните готовое видео

Распространенные ошибки при создании видеооткрыток

Многие при создании таких поздравлений сталкиваются с типовыми промахами. Вот самые частые, чтобы вам было проще их избежать.

1. Слишком длинное поздравление

Если речь длится больше двух минут подряд, смотреть становится скучно.

Делите длинные ролики на короткие части: Длинные видеоролики лучше разделять на блоки по 30-60 секунд. Между этими частями стоит менять сцену или добавлять плавные переходы.

2. Ошибки с фотографиями

Часто нейросети испытывают затруднения при обработке групповых фото, снимков в профиль или если лицо человека частично скрыто.

Лучше выбирать портреты, где лицо хорошо видно, снято анфас, без очков, масок и прочих предметов, закрывающих обзор. Именно такие снимки позволяют сделать видеопоздравление из фото максимально натуральным.

3. Голос не совпадает с внешностью

Бывает, что голос героя совсем не соответствует его облику на видео: например, у женщины звучит мужской голос, или у пожилого человека — слишком молодой. Это мешает зрителю воспринимать ролик.

Рекомендуется подбирать голос, который гармонирует с возрастом, тембром и манерой речи человека на видео. Если сложно найти подходящий вариант, лучше использовать нейтральное звучание.

Вопросы авторских прав

Использование изображений знаменитостей или чужих фото без разрешения может привести к юридическим трудностям.

Создавайте контент только с собственными фотографиями, снимками друзей или родственников. Если используете чужой снимок — обязательно спрашивайте разрешение.

Сложный фон на снимках

Иногда ИИ путается, если задний план перегружен деталями или слишком яркий.

Перед загрузкой убирайте фон через Remove и заменяйте его на простой и однотонный.

Этика и полезные советы

Дипфейки открывают массу новых перспектив, но требуют ответственного подхода к этике.

Несколько советов:

Всегда получайте согласие — обсудите идею с человеком, чье фото хотите использовать.

Отмечайте, что ролик создан искусственным интеллектом — рассказывайте об этом открыто.

Исключайте компрометирующие сцены — не допускайте сюжетов, способных нанести вред репутации участников.

Не публикуйте без разрешения — планируя поделиться видео, получите согласие всех изображенных людей.

Берегите личные данные — не используйте подозрительные сервисы, изучайте политику конфиденциальности.

Что ожидает нас впереди?

Мир цифрового видео обновляется с невероятной скоростью. То, что сейчас требует десяти минут, уже совсем скоро будет делаться за мгновение. Синтетические ролики станут практически неотличимы от настоящих.

Сегодня заметна явная тенденция — различные инструменты плавно интегрируются в популярные социальные сети и мессенджеры. В ближайшее время создание анимированного аватара окажется таким же легким, как отправить стикер или записать голос.

Однако суть остается прежней — это всего лишь способ для общения и проявления креативности. Тепло слов и искренность чувств не заменит ни одна технология, но выражать их получится по-новому и очень ярко.

Не бойтесь экспериментировать, удивляйте близких, открывайте для себя новые форматы. Важно помнить: настоящая ценность не в самой технологии, а в том внимании и заботе, которые вложены в поздравление.

Лучшие идеи для стартапа на нейросетях без программирования: как запустить проект за выходные

10 идей стартапов на нейросетях 2025: быстрый запуск и расчет прибыли

Казалось бы, чтобы создать свой стартап на нейросетях, обязательно нужно разбираться в программировании. На самом деле, это уже миф. Сейчас 9 из 10 успешных проектов строятся на no-code решениях буквально за пару дней. Делюсь подборкой из десяти перспективных концепций с подробными расчетами, реальными инструкциями запуска и прогнозируемым доходом — от $500 до $5000 уже в первый месяц.

Почему запуск стартапа на нейросетях — выгодное решение

Сегодня нейросети стали такой же неотъемлемой частью бизнеса, как электричество когда-то в прошлом веке. Все уверены: за этим технологиями будущее. Но мало кто понимает, как их монетизировать. Многие смотрят на тот же ChatGPT и думают: "Интересно, но где тут деньги?"

А ответ на поверхности. Искусственный интеллект решает сразу три основные задачи любого бизнеса: экономит время, сокращает расходы и помогает быстро масштабироваться. Например, дизайнер оценивает час работы в $50, а нейросеть через API создает изображение за $0.05. Копирайтер пишет текст целый день, а AI справляется за минуту. SMM-менеджер тратит неделю на контент-план, а автоматизация делает это за час.

Главный секрет — большинство предпринимателей даже не в курсе, что нейросети можно подключать через API. Обычно все довольствуются веб-интерфейсами, генерируют картинки по одной, платят абонентку. А ведь можно интегрироваться напрямую с API и автоматизировать всё. Один запрос — готово сразу сто изображений или видео. Настроил процесс — и он работает месяцами без вмешательства.

И еще одно преимущество — YES AI API отлично функционирует в России, поддерживает оплату отечественными картами и русский язык. Не понадобится ни VPN, ни обходы блокировок, ни танцы с оплатой. За 10 минут можно подключиться и сразу приступить к генерации контента.

Пошаговая инструкция: подключение к нейросети за 15 минут

Забудь предубеждение, что API доступны только программистам. Современные no-code платформы — такие как Bubble, Make и Zapier— позволяют строить сервисы как из кубиков, не касаясь кода. Нужно просто соединить нужные блоки — и готовое решение на руках.

Пошаговый алгоритм подключения к YES AI API за 15 минут:

Регистрируешься на YES AI через Telegram-бота и получаешь уникальный ключ. Это твой билет к нейросетям — набор символов, который вставляется в настройки. Весь процесс занимает пару минут, подтверждать электронную почту не потребуется.

Подбираешь нужную нейросеть под задачу. Для создания детализированных артов используй Midjourney API, для изображений с текстовыми вставками — Sora Images, для работы с видео — Kling AI, для подмены лиц — DeepFace Video. В документации YES AI собраны готовые примеры для каждой нейросети с промтами и разбором параметров.

Настраиваешь автоматизацию через Make или Zapier: добавляешь HTTP-модуль, указываешь API-адрес, свой ключ и промт. Даже новичок справится за 10-15 минут. Запускаешь процесс — получаешь результат.

Проверено лично — все работает стабильно. На генерацию изображения через Midjourney API уходит 10-30 секунд, создание видео в Kling AI занимает 2-3 минуты. Качество не уступает оригинальным сервисам, зато стоимость в разы ниже, а интерфейс не ограничивает.

10 новых идей и расчет прибыли

1. Генератор карточек товаров для маркетплейсов

На маркетплейсах полно товаров с некачественными фото и текстами. Большинство продавцов не умеет оформлять привлекательные карточки, услуги дизайнеров дорогие, а фотостудия — роскошь. Эту боль решаешь буквально одним кликом.

Все просто: загружаешь снимок товара, указываешь название и характеристики. Midjourney API создает профессиональные фото на белом фоне в разных ракурсах. Sora Images добавляет стильные надписи с преимуществами. GPT пишет продающий SEO-текст. В результате — карточка, достойная известных брендов.

Себестоимость одной карточки — $0.15 за API-запросы. Продаешь по $3-5 за штуку или по $50-100 за пакет из 50. Дизайнер берет $10-20 за одну, и делает неделю. Твое решение — за час и в пять раз дешевле.

Запуск через Telegram займет пару дней. Интегрируешь Midjourney и Sora Images API, добавляешь форму для загрузки, подключаешь оплату. Первыми клиентами станут продавцы из чатов Wildberries и Ozon. Один довольный покупатель приведет еще десяток — сарафанное радио работает безотказно.

2. Персональный видео-ассистент для компаний

Любой бизнес мечтает обзавестись уникальным спикером для видео. Приглашать ведущего — затратно, самостоятельно сниматься — не каждый решится, а актеры выставляют неподъемный прайс. DeepFace Video API ловко решает этот вопрос: создается цифровая копия директора компании.

Как все происходит: записывается короткий ролик с руководителем (3-5 минут беседы на камеру). DeepFace Video обучается на этом видео. После — можно создавать ролики, где "директор" произносит любой необходимый текст. Голос синтезируется отдельно с помощью voice-AI платформ.

Возможностей масса: видеопрезентации для инвесторов, обучение персонала, индивидуальные обращения к клиентам, видео-отчеты. Вместо дорогостоящей съемки за $2000 — генерация за $20.

Начальные вложения: только время. Через Zapier клиент загружает ролик и текст, автоматизация формирует результат. Стоимость услуги: $200-500 за создание цифрового двойника, затем $50 за каждый новый ролик. С десятком заказчиков в месяц — доход $3000-4000.

3. AI-креатор для Instagram Stories

Маркетологи и предприниматели тратят массу времени на сторис: нужно постоянно искать идеи, оформлять изображения, писать тексты. Итог — однообразие и скука. Сервис позволяет получать свежие сторис в один клик.

Пользователь задает тематику (ресторан, спорт, индустрия красоты, IT) и формат (продажи, обучение, развлечение). Система выдает 30 уникальных сторис: Midjourney создает изображения в одном стиле, GPT подбирает тексты с сильными призывами, все идеально адаптируется к Instagram.

Фишка — индивидуальность под бренд. Загружается логотип, фирменные цвета, выбирается стиль общения. На выходе — контент уровня топового агентства. Себестоимость пакета из 30 сторис — $5-7 через API. Продавать можно за $100-150 за месяц готового контента.

Доход: подписка $50-100 в месяц за неограниченное создание или разовые пакеты $20-30 за 10 сторис. Основная аудитория — малые компании, фрилансеры и новички в блогинге. Они экономят до 20 часов ежемесячно на контенте.

4. Платформа для создания онлайн-курсов

Многие специалисты хотят запускать свои курсы, но стесняются работать на камеру или не разбираются в видеомонтаже. Классическая съемка — это аренда помещения, команда операторов, монтаж. В результате — от 3000 до 5000 долларов даже за базовый курс из десятка занятий. Новая платформа заметно облегчает этот путь.

Схема проста: преподаватель загружает текстовое описание урока и основные идеи. Kling AI автоматически создает видеоматериалы для каждого раздела — инфографику, анимации, схемы. Все объединяется в готовый видеоурок с титрами и плавными переходами. За сутки реально собрать полноценный курс.

В числе плюсов: субтитры на нескольких языках, оптимизация под разные сервисы (YouTube, Udemy, GetCourse), формирование дополнительных файлов для скачивания. Преподаватель получает полный комплект для быстрого запуска.

Финансовая модель: разовый платеж 200-300 долларов за создание курса и 50 долларов ежемесячно за размещение и аналитику. Или альтернатива — 100 долларов в месяц за неограниченное количество курсов. С двадцатью клиентами платформа приносит 4000-6000 долларов ежемесячно. Окупаемость вложений — 2-3 месяца.

5. Сервис рекламы для локального бизнеса

Малый бизнес — кафе, студии красоты, автосервисы — часто не умеет делать эффективную рекламу. Агентства выставляют счета на десятки тысяч долларов. Самостоятельные попытки выглядят непрофессионально. Необходимо решение, позволяющее создавать привлекательные рекламные материалы без специальных знаний.

Платформа учитывает особенности разных сфер. Для кафе автоматически появляются аппетитные фото блюд при помощи Midjourney, для салонов — стильные образы, для автосервисов — детальные снимки ремонта. Тексты адаптируются под местную аудиторию и особенности региона.

Главное преимущество — настройка по геолокации. Достаточно выбрать город и район, чтобы сервис сформировал контент, подходящий именно для этой аудитории. Для Москвы — свои форматы и тексты, для других городов — свои, с учетом праздников, событий и даже погоды.

Начать просто: создается коллекция шаблонов для популярных сфер через Bubble, подключается Midjourney API для создания изображений. Стоимость для клиента — 100-200 долларов в месяц за готовые решения под любые платформы. Тридцать клиентов — это 6000 долларов стабильного дохода, при этом сервис легко масштабируется на новые города.

6. AI-сервис для создания презентаций

Обычные презентации получаются скучными и повторяющимися. PowerPoint-шаблоны давно надоели, услуги дизайнеров дороги, самостоятельная работа занимает массу времени. Менеджеры вынуждены тратить дни на подготовку материалов к важным встречам. Твоя платформа формирует презентации уровня McKinsey всего за несколько минут.

Достаточно загрузить тезисы или описание проекта. GPT превращает их в последовательные и логичные слайды. Midjourney создает индивидуальные изображения — диаграммы, схемы, иконки — под каждый раздел. Вся информация объединяется в современную презентацию с анимацией.

Преимущества: коллекция стилей для разных задач (продажи, обучение, отчеты, питчи стартапов), настройка под фирменный стиль компании, экспорт в разнообразные форматы. Итоговый файл выглядит так, будто его делала ведущая дизайн-студия.

Модель дохода: freemium — 3 бесплатные презентации в месяц, Pro-подписка за $30 в месяц (без ограничений), Enterprise — $100 в месяц (командная работа и фирменный брендинг). Основная аудитория — менеджеры, консультанты, предприниматели. Время сокращается в 10-15 раз.

7. Генератор видео-контента для YouTube Shorts

YouTube Shorts быстро стал хитом, но подготовка крутых видео — задача не из легких. Необходимы идеи, съемка, монтаж, создание обложек. На один 60-секундный ролик блогеры тратят целый день. Данный сервис автоматизирует производство вирусных видео.

Принцип работы: выбирается ниша (лайфхаки, факты, юмор, обучение) и нужное количество видео. VEO 3 API создает видеоряд по каждой теме, система добавляет динамичные переходы и спецэффекты. Midjourney рисует яркие обложки. GPT подбирает описания и ключевые хештеги.

Главная особенность — анализ трендов: сервис отслеживает актуальные форматы и автоматически подгоняет контент под модные тенденции. На выходе получаешь не просто видео, а настоящий вирусный продукт.

Модель монетизации: $50 в месяц за 50 видео, $100 — за 150, $200 — безлимит. Вдобавок — готовые автоворонки для монетизации канала. При 100 пользователях на среднем тарифе доход составит $7500 в месяц, при себестоимости $1500 на API-запросы.

8. Платформа для генерации NFT-коллекций

NFT-индустрия снова на подъеме, однако собрать свою коллекцию по-прежнему непросто. Требуются уникальные изображения, написание смарт-контрактов, грамотная работа с метаданными. За 10 000 NFT художники просят около $10 000. Разрабатываемая платформа делает все автоматически.

Пользователь выбирает стиль, основные детали (героев, задники, предметы). Midjourney создает тысячи уникальных вариантов с разным уровнем редкости. Сервис сам создает метаданные, загружает данные в IPFS, развертывает смарт-контракт.

Дополнительно можно заказать лендинг для коллекции, настройку Discord-сообщества, рекламные материалы для продвижения. Весь путь — от идеи до минта занимает не больше недели.

Монетизация: от $500 до $1000 за коллекцию плюс 2-5% от продаж NFT. При 10 коллекциях в месяц доход составляет $7 000–15 000, не считая процента с продаж. Рынок расширяется, спрос остается устойчивым, а конкурентов немного.

9. AI-помощник для онлайн-магазинов

Многие интернет-магазины теряют покупателей из-за слабого сервиса. Консультанты не разбираются в ассортименте, отвечают неспешно, работают только днем. Обычные чат-боты лишь раздражают. Необходим умный ассистент, который действительно помогает.

AI-помощник анализирует каталог магазина, становясь экспертом по всему ассортименту. Отвечает, как опытный консультант: сравнивает товары, рекомендует аналоги, учитывает возможности бюджета. Работает круглосуточно, без перерывов.

Возможности: интеграция с CRM и складом, рекомендации с учетом истории покупок, поддержка нескольких каналов (сайт, Telegram, WhatsApp). Конверсия увеличивается на 25–40%.

Модель заработка: $200–500 в месяц в зависимости от оборота магазина плюс процент от дополнительных продаж. Средний чек растет на 15–30% за счет эффективных рекомендаций. Окупаемость для магазина — уже в первый месяц.

10. Платформа для создания подкастов без записи

Популярность подкастов растет, но процесс создания остается сложным: нужна студия, оборудование, монтаж, оформление. Многие эксперты хотят делиться опытом, но пугаются технических нюансов. Решение — сервис, превращающий текст в готовый подкаст.

Специалист загружает материал — статью или тезисы выступления. Платформа разбивает текст на смысловые части, добавляет вступление и заключение, создает речь с выразительными паузами и интонациями. Итог — ощущение, будто слушаешь динамичный подкаст с харизматичным ведущим.

Функции для живого звучания

Можно выбрать разные голоса, чтобы устроить диалог, система автоматически вставляет вопросы для плавных переходов, добавляет примеры и истории, чтобы теория не была сухой. Получается готовый продукт для размещения на всех подкаст-сервисах.

Стоимость и для кого это решение

Тариф — 30 долларов за 10 выпусков в месяц, 70 за 30, безлимит — 150. Идеально подходит для коучей, наставников, экспертов. Экономия времени — в 20 раз по сравнению с обычной записью.

Пошаговый запуск за пару дней

Сухая теория не поможет, если не применить ее на практике. Вот как можно быстро собрать работающий минимальный сервис за выходные:

Пятница, вечер (2-3 часа): Выбираешь, чем хочешь заняться, регистрируешься в Bubble— этот сервис позволяет делать веб-продукты без программирования. Создаешь профиль в YES AI, получаешь API-ключ, изучаешь инструкции для своей задачи.

Суббота (8-10 часов): Делаешь первый интерфейс в Bubble. Создаешь форму для загрузки файлов, настраиваешь связь с нужными нейросетями, добавляешь базовые правила обработки. Не трать много времени на внешний вид — главное, чтобы всё работало.

Воскресенье, утро (3-4 часа): Тестируешь сервис на реальных примерах. Генерируешь тестовые записи, оцениваешь их качество, исправляешь недочеты. Подключаешь простую оплату — PayPal или Stripe через плагины Bubble.

Воскресенье, вечер (2-3 часа): Делаешь лендинг с описанием. Показываешь образцы, указываешь стоимость, размещаешь кнопку для старта. Распространяешь информацию в профессиональных чатах и группах — первые отклики не заставят себя ждать.

Главное правило — не гнаться за идеалом, а запускать то, что уже работает. Лучше иметь работающий сервис сейчас, чем ждать идеального полгода. Реальные отзывы пользователей всегда ценнее теории.

К слову, на форуме по нейросетям можно найти обсуждения уже готовых инструментов, обменяться опытом и найти нестандартные решения.

Варианты монетизации и реальные показатели

Если отсутствует четкая схема заработка, проект превращается в увлечение. Давайте рассмотрим популярные способы получения дохода от AI-стартапов с конкретными расчетами.

Подписка (SaaS): Самый прозрачный путь. Пользователи ежемесячно платят за сервис. Обычные тарифы — Basic за $30, Pro за $70, Enterprise за $200. При 100 подписчиках на Basic ежемесячный доход составит $3000. Средний отток клиентов — 5-10% при хорошем уровне сервиса.

Оплата за использование: Идеально для нерегулярных клиентов. Цена — $5-10 за комплект контента, $0.50-1 за отдельный запрос. Доход сложнее прогнозировать, однако средний чек может быть выше. Особенно эффективна модель для быстро распространяющихся сервисов.

Freemium: Бесплатная версия с ограничениями и платная подписка без ограничений. Платящими становятся 2-5% пользователей. Для значительных поступлений потребуется крупная база бесплатных клиентов. Зато проще привлечь первых пользователей и проверить идеи.

Агентский подход: Выполнение задач под ключ за фиксированную сумму. Стоимость — $200-1000 за проект, зависит от объема. Масштабировать сложно, но первые прибыли получить легко, а еще быстро выявляются запросы клиентов.

Пример из практики

Реализовал сервис генерации карточек товаров с тремя пакетами: Basic $30 (50 карточек), Pro $70 (150), Enterprise $150 (безлимит и white label). За полгода удалось набрать 200 пользователей: 120 выбрали Basic, 60 — Pro, 20 — Enterprise. За месяц доход составил $3600 + $4200 + $3000 = $10800. Издержки на API и хостинг — $800. Чистая прибыль равна $10000.

Как реализовать без кода

Часто спрашивают: "Как технически воплотить такую идею?" Современные no-code платформы позволяют обойтись без программирования почти во всех случаях.

Bubble — ключевая платформа для веб-приложений. Справляется со сложной логикой, работает с базами данных, интегрируется с API. Визуальный конструктор workflow позволяет выстраивать бизнес-процессы через схемы. Встроенный хостинг, можно подключить свой домен.

Zapier— инструмент для простых автоматизаций. Отличное решение для MVP и тестов идей. Пример: поступила заявка → выполняется действие через API → клиент получает результат. Все настраивается за 30 минут.

Make — продвинутая альтернатива Zapier, позволяющая строить сложные процессы с условиями и развилками. Оптимальный выбор для стабильной работы на продакшене.

Airtable — сервис для хранения информации, гибче привычных таблиц и проще классических баз данных. Легко объединяется с популярными платформами.

Типовая схема AI-стартапа

Лендинг собирает заявки на Bubble → автоматизация процессов реализуется в Make через API → аналитика ведется в Airtable → уведомления отправляются клиенту в Telegram или email.

Стоимость набора инструментов;

Bubble — $25/месяц,

Make — $15/месяц,

Airtable — $20/месяц,

домен — $10/год.

В сумме выходит примерно $60 в месяц постоянных расходов. За API YES AI платишь по факту использования.

Популярные ошибки и как их обойти

Год консультирования AI-стартапов показал, что новички часто наступают на одни и те же грабли. Вот топ-5 ошибок, которые могут погубить проект на старте:

Ошибка №1: Слишком большие ожидания от технологий. Многие считают AI волшебством, способным справиться с любой задачей. На деле нейросети — лишь инструмент. Куда важнее понимать реальные задачи пользователей и предлагать им решения. Технологии — только поддержка.

Ошибка №2: Пренебрежение ограничениями API. Каждый API строго лимитирует количество запросов. Пропустив rate limits, легко получить “падение” сервиса при большой нагрузке. Важно заранее предусмотреть буферы и следить за использованием.

Ошибка №3: Нет контроля за результатами. Нейросети иногда выдают неожиданный контент. Клиенты получают странные ответы — сервис теряет доверие. На старте обязательно добавь фильтры и ручную модерацию.

Ошибка №4: Некачественный промт-инжиниринг. Результат на 80% зависит от грамотно составленного промта. Если промт сделан плохо — клиент разочарован. Тестируй и дорабатывай промты, пока не получишь нужный результат.

Ошибка №5: Игнорирование мнения пользователей. Создают продукт, не общаясь с аудиторией. В итоге выпускается то, что никому не нужно. С самого начала разговаривай с пользователями, собирай обратную связь и быстро вноси изменения.

Еще одна ловушка — слабый UX

Даже самая интересная технология не спасет, если пользоваться сервисом неудобно. Старайся делать путь пользователя предельно простым: минимум действий, понятные шаги и быстрый итог.

Куда движется рынок AI-стартапов в 2025 году

Следить за актуальными тенденциями важно, чтобы выбрать перспективную отрасль и не тратить силы на устаревающие направления.

Тренд №1: Мультимодальные решения

Будущее — за платформами, которые объединяют разные форматы данных. Не ограничиваясь генерацией картинок, сервисы предлагают полный набор: текст, изображения, видео и звук. Все в одном — пользователи всё чаще ищут такие универсальные инструменты для решения задач.

Тренд №2: Индивидуализация на основе анализа данных

Шаблонный контент теряет актуальность. Успех приходит к сервисам, которые подстраиваются под каждого пользователя: учитывают его вкусы, привычки и прошлое взаимодействие. Чем больше информации, тем точнее персонализация и выше вовлеченность.

Тренд №3: Встраивание в привычные рабочие процессы

Изолированные AI-платформы уступают решениям, интегрированным в популярные инструменты. Например, расширение для широко используемой CMS оказывается полезнее, чем отдельный веб-сайт.

Тренд №4: Локализация и учет культурных особенностей

Большинство нейросетей обучалось на англоязычных данных. Сервисы, которые учитывают специфику локального рынка, получают ощутимую фору. Это особенно важно для российских компаний.

Тренд №5: Прозрачность и этичность нейросетей

Пользователи становятся требовательнее к объяснению работы сервисов. Нужно показывать, какие данные используются, как работает система, гарантировать конфиденциальность. Доверие становится главным капиталом.

Антитренды

Не пользуются спросом простые сервисы, повторяющие ChatGPT без дополнительной пользы, решения без четкой ниши, а также проекты, игнорирующие особенности российского рынка.

Успешные примеры AI-стартапов

Теория хороша, но практика говорит красноречивее. Вот пара историй моих знакомых предпринимателей:

Кейс 1: AI-помощник для агентств недвижимости

Стартап автоматизирует создание описаний объектов, анализируя фотографии и ключевые параметры. Риелтор загружает снимки, отмечает площадь и расположение — система формирует привлекательный текст с выделением сильных сторон.

За 8 месяцев: 150 агентств стали клиентами, средний платеж $80 в месяц, общий доход $12000. Объявления с такими описаниями продаются на четверть быстрее. Планы — вырасти до $30000 в месяц и расшириться на новые регионы.

Кейс 2: Сервис генерации мемов для компаний

Платформа создает современные мемы с фирменным стилем и логотипом бренда для соцсетей. Анализируя актуальные тренды, сервис генерирует подходящий контент, экономя SMM-специалистам часы на поиск идей.

Цифры и результаты

80 партнеров, среди которых как локальные компании, так и крупные федеральные сети. Средняя сумма сделки — 120 долларов ежемесячно. Активность аудитории под постами увеличилась втрое. В планах — запуск видео-мемов и интеграция с инструментами для планирования публикаций.

Кейс 3: AI-презентации для стартапов

Уникальный сервис помогает стартапам формировать pitch deck: основатель отвечает на ключевые вопросы о проекте, а система самостоятельно создает презентацию для инвесторов, вдохновляясь стилем известных компаний.

Метрики и успехи

Сервис опробовали 200 стартапов, средний платеж — 300 долларов. Каждый третий клиент получил инвестирование — хотя факторов много, качественная презентация сыграла заметную роль. Сильное сарафанное радио: 60% клиентов пришли по рекомендациям.

Общие закономерности успеха

В центре внимания — узкая специализация, четкое понимание потребностей и измеримый итог для клиента. Все успешные решения направлены на реальные задачи, а не просто демонстрируют современные технологии.

Краткий итог и план действий