Вышла новая модель Step 3.7 Flash

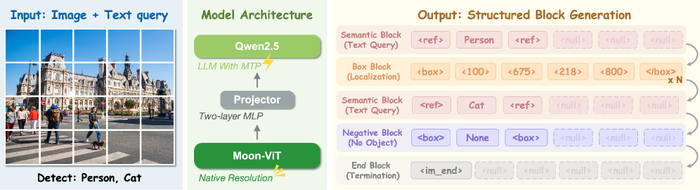

Продемонстрирована новая высокоэффективная мультимодальная модель Step 3.7 Flash (https://huggingface.co/stepfun-ai/Step-3.7-Flash) для реальных агентов с всего 196B и 1.8B (ViT) параметров, из которых 11B активных.

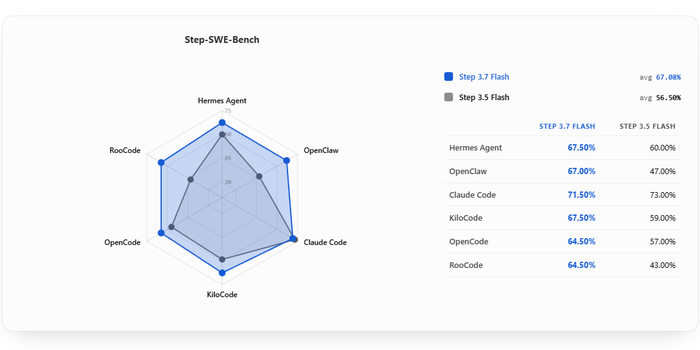

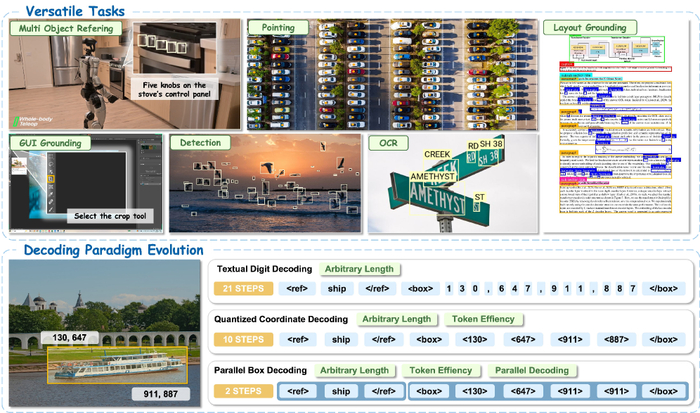

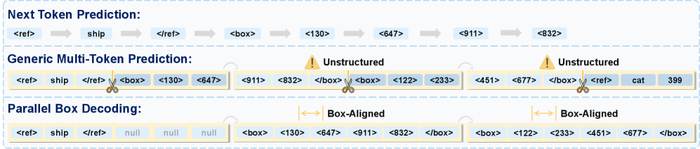

Нативная мультимодальность позволила ей понимать изображения (UI, документы, графики, фото) и сразу писать код или вызывать инструменты для действий, а усиленный веб-поиск открыл глубокое отслеживание, когда визуальный поиск распознаёт редкие и новые объекты. Её надёжная работа с инструментами даёт управление терминалом, браузером, офисными приложениями, поиском без отклонений и сбоев на длинных сессиях. Кроме того, поддерживается работа с экосистемой агентов, включая Claude Code, KiloCode, Hermes Agent, OpenClaw и другие обвязки.

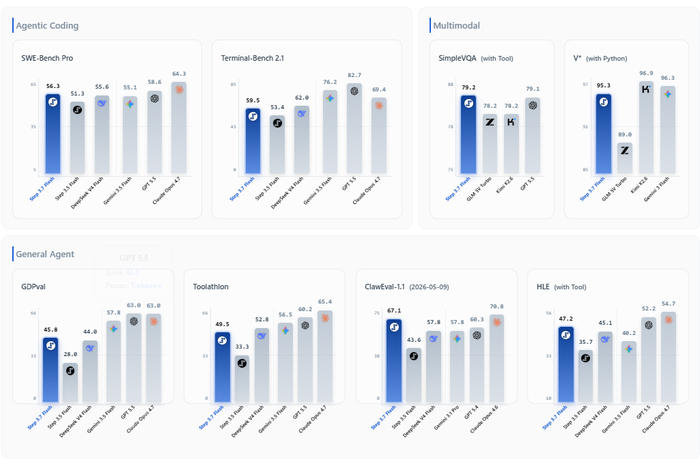

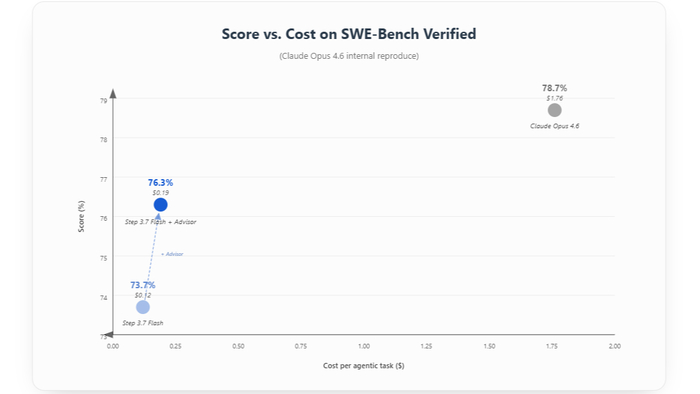

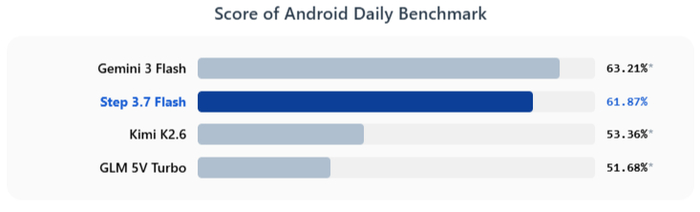

В результате агентное кодирование набирает 56,3% на SWE‑Bench Pro (+5 процентных пунктов к Step 3.5 Flash) и 59,6% на Terminal‑Bench 2.1 (+6,1 процентных пункта), а в режиме "Советник" даёт 97% качества Claude Opus 4.6 при около 1/9 стоимости задачи. Мультимодальные навыки, связанные с визуальным поиском и Python‑инструментами, выходят на уровень моделей в разы крупнее (79,2% на SimpleVQA, 95,3% на V*, 86,3% на HR‑Bench 8K), комплексно сочетая визуальные и невизуальные инструменты. Уровень общих агентских знаний составляет 49,5% на Toolathlon, 67,1% на ClawEval‑1.1, 45,8% на GDPval и 47,2% на HLE с помощью инструментов (только текст 49,7%). В ходе глубокого поиска она показывает 75,8% на BrowseComp, 92,8% на DeepSearchQA F1 и 71,7% на ResearchRubrics. Операции с графическим интерфейсом (GUI) достигают 61,9% на Android Daily, автономно сочетая написание кода и тестирование.