AI, AGI, ИИ и прочие LLM1

Решил написать данную статью чтобы упорядочить знания и сделать срез текущего состояния индустрии ( в будущем можно будет вернуться и посмотреть как все изменилось ), а также скидывать ссылку когда меня просят объяснить что такое ИИ и правда ли они заменят всех и “код писать больше не нужно”

Для ЛЛ, писать нужно но есть нюанс.

Дисклеймер

Данная статья написана разработчиком с 20+ лет опыта в разработке, является компиляцией знаний накопленных в области LLM за 10 лет опыта работы с ними, все нижесказанное является субъективным мнением не претендующим на истину в первой инстанции и может отличатся от ваших знаний и опыта. Если вам кажется что я неправ и несу бред, так может быть и это нормально.

История

1948 Ядро языковой модели - научная работа “A Mathematical Theory of Communication” где формализована идея предсказания вероятности следующего токена по предшествующему контексту.

1980 “практический подход к языковому моделированию в промышленном масштабе” - статистические языковые модели (n-граммы) в области распознавания речи стали активно применять n-граммные модели — оценку вероятности слова по нескольким предыдущим.

2003 “первая чёткая формулировка нейросетевого языкового моделирования” - статья «A Neural Probabilistic Language Model» где предложено обучать нейросеть предсказывать следующее слово, одновременно заучивая плотные векторные представления слов (эмбеддинги) из которой выросли все последующие LLM.

12.07.2017 Знаковая статья “Attention Is All You Need” - с которой можно сказать идет отсчет современного развития LLM, в этой статье все предыдущие работы были сведены к идеи “Трансформеров” которые позволили эффективно масштабировать модели.

06.2018 GPT-1 первая модель из семейства GPT - использовавшая декодерную часть Transformer с предобучением на большом корпусе текстов и последующей дотренировкой (fine-tuning). Это был принципиальный сдвиг: модель сначала «читала интернет», а потом адаптировалась к конкретным задачам.

08.2018 BERT энкодерная модель, обученная двунаправленно - хотя BERT не генерирует текст как GPT, он показал мощь подхода «предобучение + дотренировка» и задал новый стандарт качества в NLP.

2020 GPT-3 Первая современная LLM - эта модель является современным вариантом того что мы используем сейчас, модели до как правило вообще не имели интерфейса и общения с ними были невозможным посредством чата.

Таким образом сама идея которая привела к получения LLM существует более 80 лет, а не как считают некоторые что это появилось всего 5 лет назад.

Терминология

Самая опасная часть которая вызывает холивары и подрыв пятых точек у многих увлеченных людей, автор трактует термины на основе собственного понимания технологий и она может несовпадать с мнение других людей.

Large language model ( LLM, БЯМ ) - большая языковая модель - языковая модель, основанная на нейронной сети с множеством параметров (миллиарды весовых коэффициентов и более ), которая проходит предварительное обучение на обширных массивах неразмеченного текста методами самообучения (обучения c псевдометками, созданными самой моделью, а не внешним учителем ), а затем подвергается тонкой настройке (fine-tuning) с применением обучения с подкреплением на основе отзывов людей (RLHF) для согласования результатов генерации с человеческими предпочтениями (alignment problem) и инструкциями.

Искусственный интеллеект ( AI, ИИ ) - искусственный разум, в самом широком смысле — комплекс инструментов, позволяющих решать задачи уровня человеческого интеллекта (такие как восприятие, обучение, рассуждение, решение проблем и принятие решений) и реализованных машинами, в частности компьютерными системами. Это направление исследований в области компьютерных наук, которая разрабатывает и изучает методы и программное обеспечение, позволяющие машинам воспринимать окружающую среду и использовать обучение и интеллект для выполнения действий, которые максимально увеличивают их шансы на достижение поставленных целей. Такие машины можно назвать искусственным интеллектом.

Общий искусственный интеллеект ( AGI ) - это гипотетический искусственный интеллект, способный решать любые интеллектуальные задачи на уровне человека или выше, а не только те, для которых он был специально обучен.

Сверхинтеллект ASI - это гипотетический агент , обладающий интеллектом , превосходящим интеллект самых одаренных человеческих умов.

LLM это лиш одно из направлений ИИ, все остальные утверждения на рынке это лиш работа маркетинга и к реальному положению на рынке отношения не имеет.

Агент - программа которая является посредником между LLM и человеком, самый популярный вид это вебсайт в виде чата, в котором человек пишет сообщения в виде диалога.

Промпт - текстовое сообщение которое человек отправляет в LLM.

Системный промпт - тоже текстовое сообщение но которое передается передается перед сообщением пользователя и задает настройки и ограничения LLM, как правило вы его невидите и не имеете к нему доступа, в нем могут быть такие вещи как "Не выдавать опасную информацию", "Не обсуждать политику" и т.д на самом деле он большой и включает большое количество параметров.

Как работают LLM?

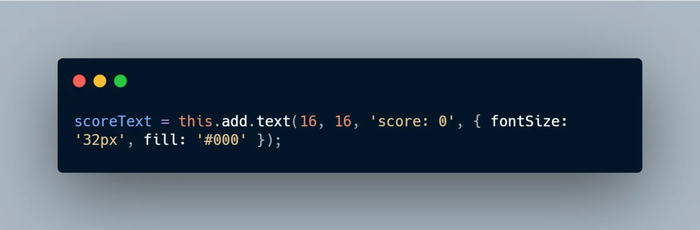

Сами по себе LLM не могут запускаться и что-то делать, для этого всегда нужен какой то тригер, поскольку все современные LLM имеют текстовый интерфейс ( могут принимать и отдавать только текст ), вам нужно через графический

Что могут LLM?

Итак на основе всего выше сказанного можно вывести что современные LLM модели это продукт способный на основе заданного контекста предсказать последующие токены, пример:

Вы разговариваете с другом сидя в баре и говорите "Вчера я не пошел гулять потому что..." и отстанавливаетесь на середине фразы а он заканчивает "потому что был дождь" это происходит потому что вы обладаете общими знаниями о вчерашнем дне и общим контекстом разговора, тем же самым и занимается LLM она имея общий контекст способна предсказать последующие токены ( слова ) , например, вы спросите кто написал "Дракула" она даст вам четкий ответ если данная информация входила в набор данных на которых ее обучали.

Чего LLM немогут?

Мы знаем что LLM предсказывает последующие токены, на основе той информации на которой ее обучили, в этом ее сила и слабость в тоже время LLM способны делать только то чему ее научили причем для начала работы ей нужен какой то тригер ( промт ), т.е LLM неможет сама по себе начать работу и не способна выдавать точный результат. Например если спросить LLM "Какая сейчас температура" то ответ будет максимально непредсказуемым т.к вы не указали где вы находитесь, по этой причине многие разработчики современые агенты включают системные промпты которые в свую очередь учать LLM задавать вопросы.

Проблема LLM

Как было сказанно ранее LLM умеет только то чему научили, т.е она обучена на контенте которое человечество созадавало десятелетиями, включая код, архитектуру и паттерны проектирования,

LLM способны выдавать решения которые уже были кем то написанны, но LLM неможет написать абсолютно новые подходы или архитектуры которых ранее небыло.

Эту проблемы уже отмечают многие создатели LLM, интернет заполонили горы LLM контента ( для этого даже придумали термин AI слоп ), проблема этого контента в том что в большинстве случаев он не несет никакой пользы поскольку и не является уникальным, это информация созданная на основе информации которая использовалась для обучения моделей.

Получается что открытую часть интернета уже выгребли а новую инфорацию брать неоткуда, генерировать с помощью LLM тоже нету смысла поскольку отствует самый важный параметр уникальность и полезность.

На данный момент уже можно заметить по последним релизам ChatGPT 5.2, 5.3, 5.4, Claude Opus 4.6 и прочим что период "взрывного роста" пройден и технология вышла на плато, при этом последние метрки показывают рост в пределах 5-10%, появление моделей с таким же качественным рывком как между GPT-3 -> 4, в ближайшее вермя мало вероятно.

Ситуация сравнима с положением на рынке процессоров где нанометры уже ненастоящие и пределы кремния в области роста частоты в герцах уже достигнут и без технологического прорыва отметки в 10000 или 15000мгц на потребительских процессорах недостижимы.

Получается, если мы хотим создать что-то принципиально новое то сделать это только силами LLM без вмешательства человека просто невозможно, поскольку для этого нужно проявить фантазию и креативность, а вот этого у LLM нет, поскольку этому невозможно научить поскльку ученные досих пор незнают как работает человечиский мозг и почему например одни люди креативны а другие нет.

Почему написание кода не умерло

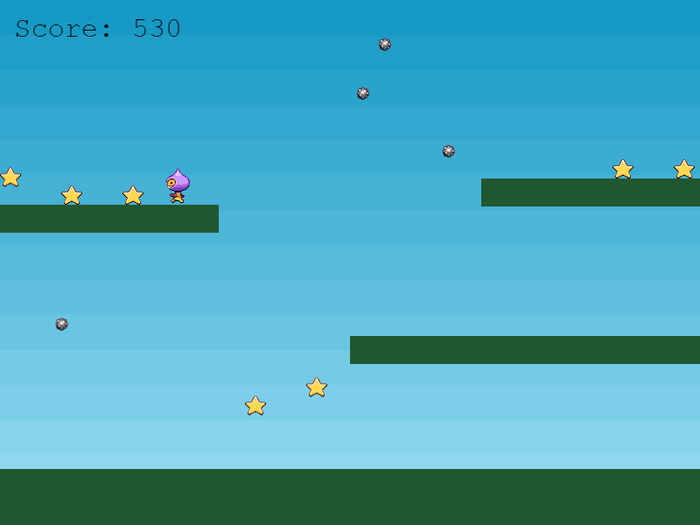

Для тех кто не занимается кодом ежедневно, работа LLM действительно может выглядеть как я написал созда мне пресональный сайт и оно вжух сделало за 15 минут, для простых задач где не требуется длительная поддержка и разработка более чем одним человеком то это действительно так, но давайте рассмотрим как выглядит разработка на крупных проектах которым нужна длительная поддержка.

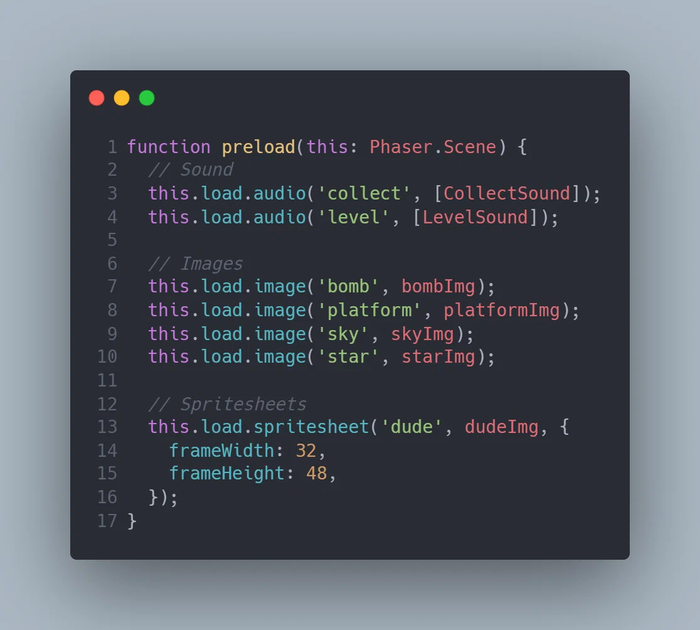

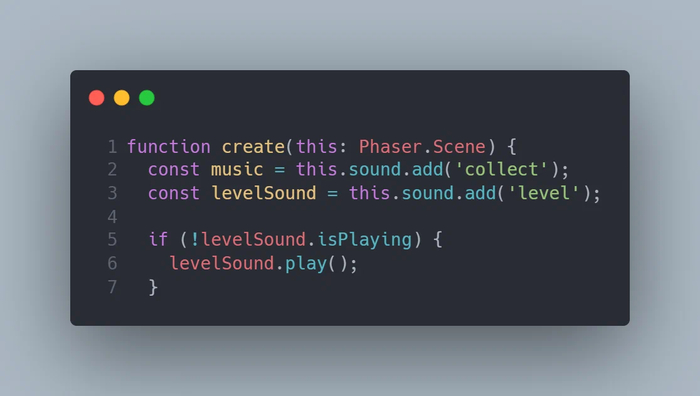

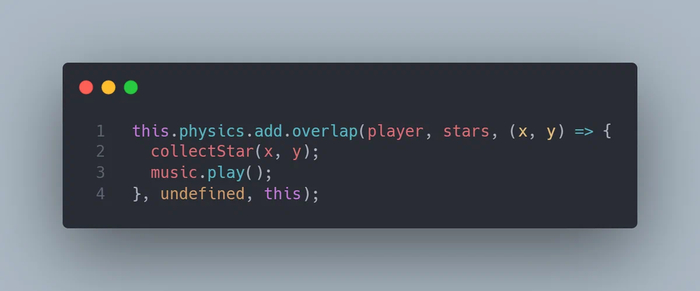

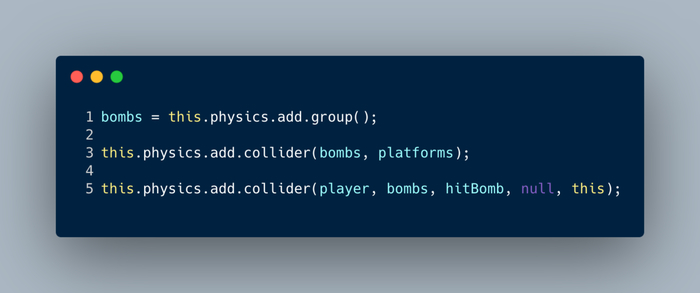

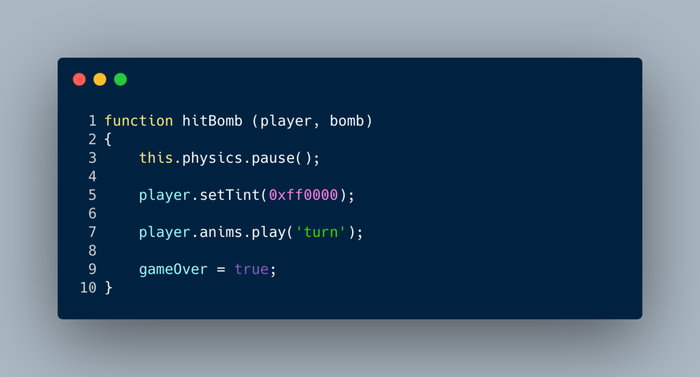

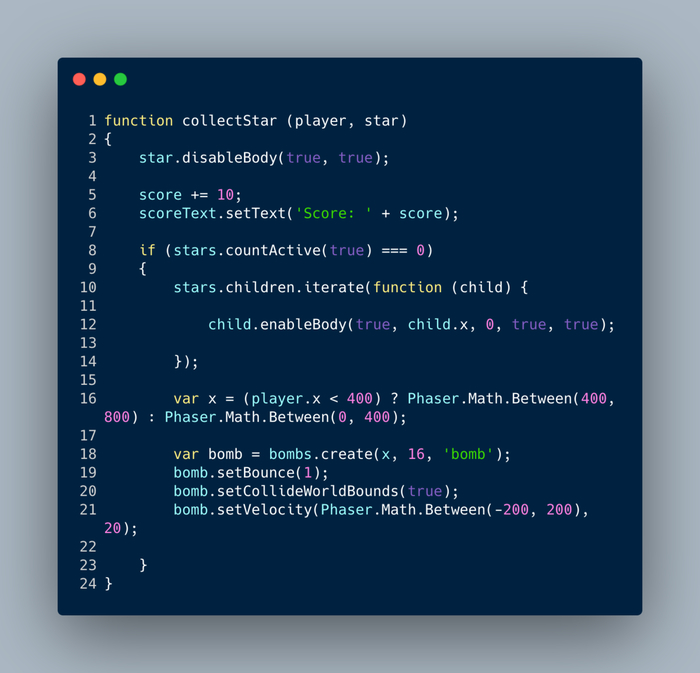

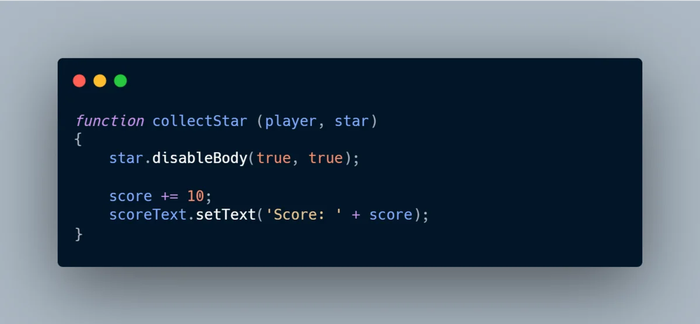

Начать стоит с того что при крупной разработки проектов, промптинг уже неработает ( за исключением точечных правок ), все начинается с создания специального файла в корне проекта Agents.md где вручную пишется набор правил и примерная структура, чтобы результат LLM имел хотябы минимальное качество и не жег кучу токенов на каждый чих. Затем выбирается инструмент для написания спецификации к разработываемой фичи, например модуль отчетов один из самых популярных сейчас OpenSpec:

https://openspec.dev/

Затем начинается цепочка:

1. Разработка;

2. Верификация;

3. Реафкторинг;

4. Тестирование;

Данная цепочка может повторятся по нескольку раз, до тех пор пока результат небудет приемлемым.

Почему нельзя отдать это LLM? Как помним ранее это просто программа которая умеет прогнозировать будущие токены, при этом умея галлюционировать таким образом она может себе придумать что все работает как надо, при этом спокойно может отсуствовать до 40% ожидаемого функционала, плюсом конечный результат сильно зависит от настройки LLM и входящего промта который кто-то должен написать.

Важный момент заключается в том что тот кто проверяет код, должен понимать программирование чтобы понять результат валидный или это галлюцинация.

Так же один из важных моментов, LLM не думает о:

- качестве;

- производительности;

- безопасности;

- оптимальности;

Для этого всего можно создать промпты, но опять таки чтобы это сделать нужно самому иметь эти знания.

Если писать код незная всего этого, в лушем случае это прототип но в большинстве случаев это мусор.

Что убъет LLM?

- Труд который легко автоматизировать;

- Шаблонный программинг ( как генераторы лендосов почти убили верстальщиков );

- Различные коробочные решения;

- Шаблонизирующийся код ( сайты шаблонов, переводы );

Что не убьет LLM ( в текущем состоянии )?

- Системную разработку;

- Программирование микроконтролеров;

- Разработка финансовых систем;

- Биотех;

- Любая область где цена ошибки высока;

Заключение

Получилось несколько сумбурно, поскольку я не писатель и LLM не использовал поскольку хотел чтобы данная информация была моим личным опытом переложенным на текст, можете бить куда угодно и по каким угодно поводам, поскольку критика это хорошо.

Сложно изложить в данной статье все что бы хотел рассказать, возможно в будущем я напишу ряд статей которые будут дополнять текущую и в них я более подробно остановлюсь именно на проблемах и как наиболее эфективно использовать LLM и на том где это имеет смысл а где проще и эффективнее сделать самому.

Получилось как получилось, постараюсь дополнить и детализировать в будущем, но на данный момент это самая длинная стать которую я когда либо писал в жизни.

P.S Правку и редактуру через LLM не делал, чтобы было как есть написанное кожанным мешком.