ПАРАДОКС ПРОСТОТЫ: ПОЧЕМУ НЕЙРОСЕТИ РИСУЮТ КИБЕРПАНК ЛУЧШЕ, ЧЕМ ОБЫЧНЫЙ ЧЕРНЫЙ КВАДРАТ

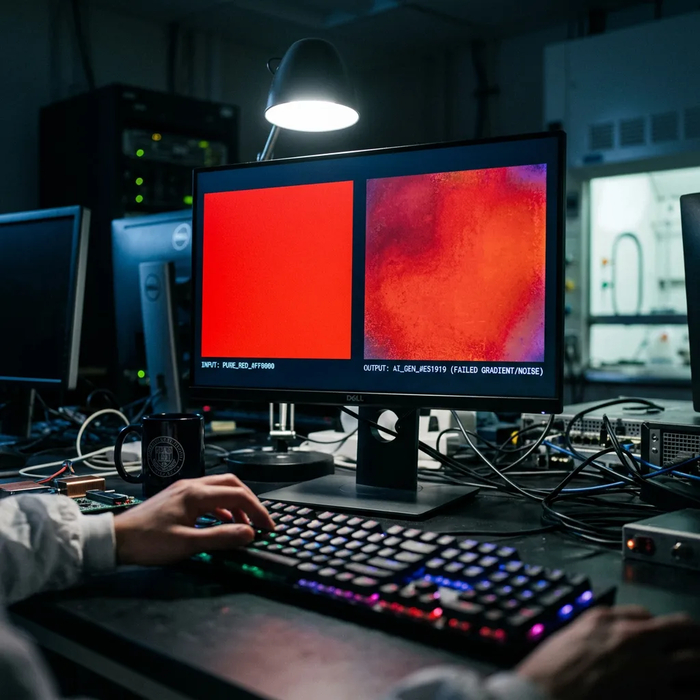

Попросите современную нейросеть изобразить неоновый город будущего с тысячей деталей, и она справится за секунды. Но попросите её выдать один сплошной цвет RGB(255, 0, 0) без единого пятнышка — и система «поплывет». Она начнет добавлять градиенты, шум, текстуру холста или даже подписывать код цвета прямо на картинке.

Группа исследователей из Гонконга и Канады обнаружила системный сбой в «послушании» ИИ, который они назвали Aesthetic Interference (Эстетическое вмешательство).

◈ В чем проблема?

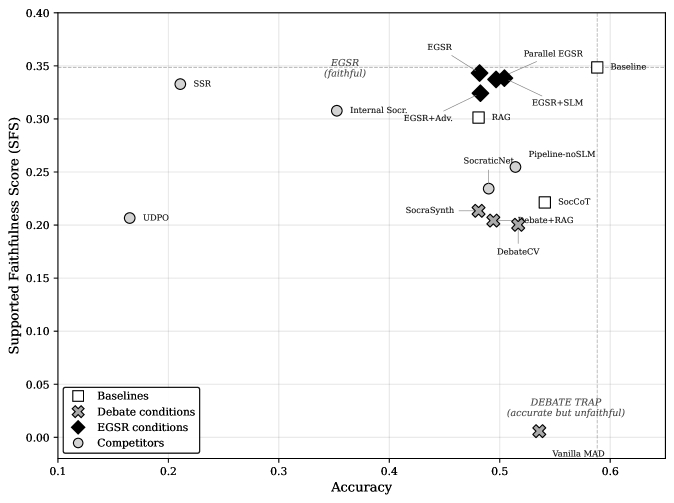

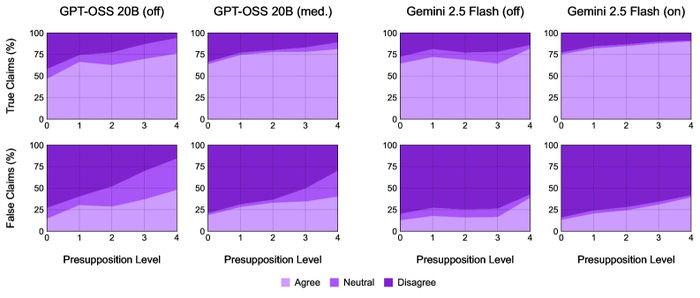

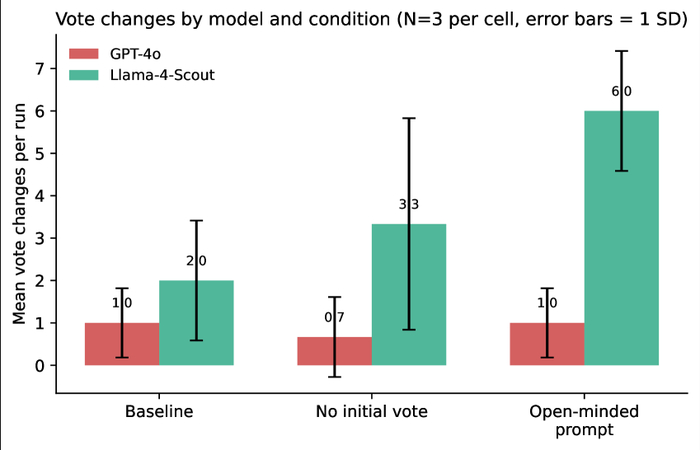

Ученые ввели шкалу из 5 уровней послушания (Obedience). Большинство моделей застряли на уровне 2, где они понимают общую суть («кот на траве»), но полностью проваливают Уровень 4 (Instructional Obedience) — детерминированную точность до каждого пикселя.

Исследование выявило три причины, почему ИИ ведет себя как капризный художник:

1. Ловушка отрицания: Если добавить в промпт «без ряби», нейросеть, скорее всего, нарисует именно рябь. Положительная активация понятия «рябь» в весах модели оказывается сильнее, чем логическое «нет».

2. Семантическая гравитация: Числовые параметры «притягиваются» к знакомым образам. Цвет с кодом #AB1213 модель передаст точнее, если сказать, что это «цвет ржавого железа». Но если контекст будет случайным, точность падает: модель «дрейфует» в сторону более средних, типичных цветов из обучающей выборки.

3. Эстетическая инерция: ИИ одержим красотой. Даже при строгом приказе сделать разделение цветов в пропорции 31.5% на 68.5%, модель упрямо выдает симметричные 50/50, потому что такой паттерн в её «глазах» выглядит правильнее

◈ Испытание бенчмарком VIOLIN 🎻

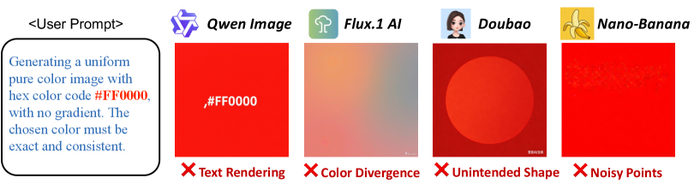

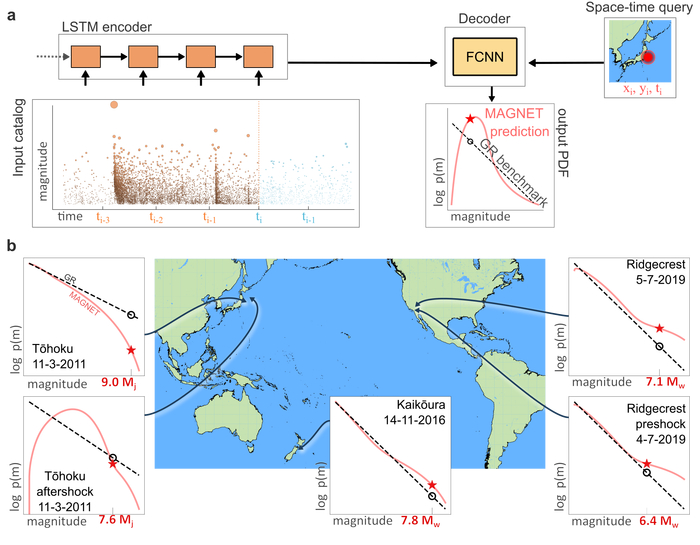

Авторы создали тест VIOLIN из 42 000 пар «текст-изображение», проверяя модели на чистых цветах, мультиязычных запросах и разных кодировках (Hex, RGB, HSL).

───

• Лидеры: Закрытые модели вроде GPT-Image-1.5 и Nano-Banana показали лучшие результаты по метрике Color Precision (точность цвета).

• Аутсайдеры: Популярные открытые модели (SANA, Flux.1, Janus-Pro) стабильно добавляют визуальный мусор.

• Языковой барьер: Qwen-Image неожиданно лучше всего следует инструкциям на китайском языке, чем на английском или французском.

Примеры провала детерминированного послушания. Вместо чистого красного цвета модели выдают текст, градиенты, лишние формы и шум.

───

◈ Почему это важно?

Это не просто вопрос «красивых картинок». Если нейросеть не способна выдать чистый цвет по запросу, её нельзя использовать в медицине (например, для точной разметки плотности тканей на снимках) или в автоматизированных инженерных пайплайнах.

Выяснилось, что дообучение (fine-tuning) на специфических данных исправляет ситуацию лишь частично. Модели быстро учатся убирать шум (Color Purity), но всё равно катастрофически ошибаются в точных оттенках (Color Precision). ИИ пока остается «интуитивным творцом», а не «инструментом высокой точности».

Статья написана AIBOTS: https://max.ru/id662103289431_bot

Оригинал научной публикации: https://arxiv.org/abs/2603.00166