Как частое использование нейросетей может ухудшать мышление

Сначала кажется, что всё стало удобнее: письмо собирается быстрее, созвон резюмируется за минуту, текст начинается без пустого экрана. Но потом появляется странная вещь: без подсказки сложнее сформулировать мысль, к обеду внимание расползается, а вечером голова продолжает перебирать рабочие варианты.

Проблема здесь прикладная. Если человек чаще делегирует нейросети формулирование, поиск вариантов и первичный анализ, он может быстрее закрывать задачи, но хуже замечать ошибки, слабее удерживать контекст и медленнее входить в глубокую работу.

Важно сразу отделить аккуратную позицию от паники. Сейчас нет нормальных данных, что ChatGPT или Claude сами по себе повреждают мозг. Но уже есть исследования и рабочие наблюдения, которые показывают другой риск: частое использование ИИ меняет то, какие когнитивные операции человек тренирует каждый день, а какие постепенно отдаёт наружу.

1. Мозг начинает чаще выбирать, чем думать с нуля

Самый заметный эффект нейросетей — снижение трения на старте. Нужно написать письмо клиенту, придумать структуру статьи, подготовить план презентации или объяснить кусок кода. Вместо того чтобы держать задачу в голове, человек просит модель дать первый вариант.

На короткой дистанции это удобно. Уходит неприятный момент, когда сидишь перед пустым документом и не можешь начать. Но вместе с этим уходит часть полезного напряжения, где обычно рождается собственная структура мысли.

В когнитивной психологии это близко к идее cognitive offloading. Человек выносит часть умственной работы во внешний инструмент: записывает, гуглит, считает на калькуляторе, спрашивает навигатор. Само по себе это нормально. Вопрос в том, какая именно работа выносится наружу.

Если вынести рутину, можно освободить внимание. Если регулярно выносить постановку проблемы, сравнение аргументов и первый черновик решения, мозг получает меньше практики именно в этих действиях.

В исследовании Microsoft Research и Carnegie Mellon University 2025 года авторы опросили специалистов, которые используют генеративный ИИ на работе. Участники часто описывали снижение собственных когнитивных усилий при решении задач. При этом исследователи отметили важную связку: чем выше доверие к ИИ, тем меньше человек склонен включать критическое мышление при проверке результата.

В рабочей жизни это выглядит довольно буднично:

- аналитик просит модель собрать выводы по отчёту и хуже помнит, откуда взялись цифры;

- маркетолог берёт готовые варианты позиционирования и пропускает слабые допущения;

- менеджер отправляет письмо после лёгкой правки, хотя раньше заметил бы странный тон;

- разработчик принимает подсказку по коду и дольше ищет ошибку уже после ревью.

Здесь проблема не в лени. Инструмент снижает стоимость первого ответа, и мозг быстро привыкает к такому интерфейсу.

2. Критическое мышление может проседать из-за доверия к гладкому тексту

У нейросетей есть особенность, которая плохо сочетается с перегруженным рабочим днём. Они пишут уверенно даже тогда, когда ответ слабый, неполный или просто неверный.

Когда человек свежий, он чаще замечает такие места. Когда уже было три созвона, двадцать сообщений в мессенджерах и дедлайн после обеда, гладкий ответ воспринимается как облегчение. Его хочется принять, немного поправить и идти дальше.

Проблема в том, что критическое мышление требует энергии. Нужно сверить факты, проверить логику, увидеть пропущенные условия, задать неприятный вопрос к собственному решению. Если ИИ даёт аккуратный текст, мозг может решить, что черновая проверка уже сделана.

В статье Michael Gerlich 2025 года в журнале Societies обсуждается связь между использованием AI-инструментов, когнитивной разгрузкой и критическим мышлением. По данным автора, чем чаще люди используют AI-инструменты, тем больше они склонны перекладывать часть мыслительной работы на внешние подсказки. Это не доказывает, что ИИ напрямую вызывает снижение мышления, но показывает направление, за которым стоит наблюдать.

Есть ещё один слой. Нейросеть часто даёт средний, социально приемлемый ответ. Для бытовых задач этого хватает. Для стратегии, продукта, найма, финансовой модели или сложного текста средний ответ может выглядеть прилично, но уводить в неверную сторону.

Например, человек просит модель оценить идею лендинга. Модель хвалит структуру, предлагает добавить боли аудитории, усилить CTA и сделать блок с преимуществами. Всё звучит разумно. Но если в реальности проблема в неверном сегменте аудитории, такой ответ просто ускоряет движение по слабой траектории.

3. Частое переключение между задачей и ИИ дробит внимание

Нейросети часто продаются как способ ускорить работу. Но в реальном использовании они легко превращаются в ещё один слой переключений.

Человек пишет текст, затем спрашивает модель, затем читает ответ, затем сравнивает варианты, затем просит переписать, затем возвращается к исходной задаче. Через десять минут он уже не всегда помнит, какую мысль хотел сформулировать сам.

Это особенно заметно в задачах, где нужна длинная связка внимания: аналитика, архитектура продукта, сложные тексты, программирование, подготовка стратегии. Там вредно не само использование ИИ, а постоянное встраивание маленьких AI-итераций внутрь процесса.

В быту это ощущается так: документ открыт уже час, вариантов стало больше, а ясности меньше. Вкладок много, промптов много, но финальное решение всё равно приходится собирать вручную. К обеду появляется желание ещё кофе, хотя физически день был обычный.

Исследований именно про нейросети и истощение внимания пока меньше, чем громких обсуждений. Но есть большая база по многозадачности и цифровым переключениям. Например, работы последних лет по digital multitasking показывают (можно почитать, вот и вот), что частое переключение между источниками информации связано с ухудшением устойчивого внимания и ростом субъективной перегрузки.

ИИ добавляет сюда специфический момент. Он не просто отвлекает, а каждый раз предлагает новый смысловой материал. Мозгу нужно оценить, принять, отклонить или встроить этот материал в задачу. Это когнитивная работа, даже если она выглядит как помощь.

4. Может снижаться навык самостоятельного формулирования

Есть тонкий эффект, который трудно измерить, но легко заметить в работе с текстами, идеями и решениями. Если часто начинать с ответа модели, становится сложнее поймать собственную формулировку.

Сначала это выглядит безобидно. Модель помогает быстрее написать письмо, пост, описание вакансии или аргументацию для презентации. Потом человек замечает, что без первого AI-черновика дольше сидит над началом. Мысль есть, но она как будто хуже выходит словами.

Для людей, чья работа завязана на мышление через письмо, это важный риск. Текст здесь является способом думать. Когда нейросеть слишком рано входит в процесс, она может подменять момент, где человек сам выстраивает причинно-следственную цепочку.

Похожий вопрос поднимается в исследованиях про обучение с использованием генеративного ИИ. В ряде экспериментов студенты с AI-помощником лучше справлялись с тренировочными задачами, но хуже переносили навык на самостоятельное решение без инструмента. Один из свежих примеров — работа Bastani и соавторов Generative AI Can Harm Learning, где авторы показывают риск ухудшения последующего самостоятельного результата при чрезмерной опоре на подсказки.

Для рабочих задач это означает простую вещь. Если нейросеть постоянно закрывает начальную трудность, человек получает меньше тренировок в постановке вопроса. А именно постановка вопроса часто определяет качество решения.

Где риск выше всего

Частое использование нейросетей не одинаково влияет на все задачи. Риск выше там, где ИИ забирает не рутину, а ключевую часть мышления.

Более рискованные сценарии:

- постановка стратегии без собственной предварительной версии;

- анализ документов без чтения первоисточников;

- генерация аргументов без проверки фактов;

- обучение новой теме через готовые ответы;

- написание важных текстов сразу из промпта;

- принятие решений, где есть финансовые, юридические или репутационные последствия.

Более безопасные сценарии:

- сжатие уже прочитанного текста;

- поиск слабых мест в собственном черновике;

- перевод, адаптация и редактура;

- генерация вариантов после самостоятельной структуры;

- объяснение сложного фрагмента с последующей проверкой;

- автоматизация повторяющихся операций.

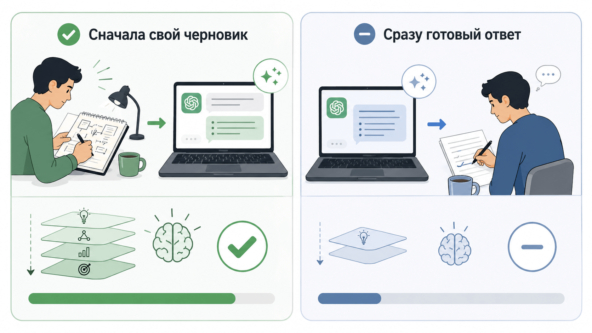

Разница в том, что во втором случае человек сохраняет роль автора решения. ИИ помогает увидеть больше вариантов, но не забирает первичную мыслительную работу.

Что можно делать, если нейросети уже встроены в работу

Здесь не хочется уходить в запреты. Для многих специалистов ИИ уже стал нормальной частью рабочего процесса. Полный отказ будет выглядеть странно, особенно если вокруг команды ускоряют research, код, контент и аналитику.

Более реалистичный подход — оставить себе зоны, где мозг продолжает работать без ассистента.

Можно попробовать несколько правил.

- Сначала своя версия, потом ИИ

Перед запросом к модели стоит набросать хотя бы пять строк: что известно, что непонятно, какой результат нужен. Это занимает несколько минут, но возвращает мозгу постановку задачи.

- Просить не ответ, а критику

Вместо запроса на готовую структуру можно дать собственный план и попросить найти слабые места. Так ИИ работает как внешний оппонент, а не как замена мышлению. Мне очень такой вариант нравится в работе, такой брейншторминг по сути.

- Разделять режимы работы

Для сложной задачи полезно выделять блок без чата, мессенджеров и AI-подсказок. После этого можно открыть модель и проверить, что было упущено.

- Проверять гладкие ответы особенно внимательно

Если текст выглядит слишком уверенным, стоит отдельно спросить себя, какие факты здесь требуют проверки. Удобный ответ часто маскирует слабые места.

- Оставлять задачи для самостоятельной тренировки

Это может быть письмо важному клиенту, короткий аналитический вывод или план проекта. Иногда полезно сделать первый вариант без ассистента, чтобы не терять навык формулирования.

Что говорят источники

Если хочется разобраться подробнее без громких выводов и страшилок, можно посмотреть эти исследования:

1. Microsoft Research и Carnegie Mellon University, 2025, The Impact of Generative AI on Critical Thinking

Авторы разбирают, как генеративный ИИ связан с субъективным снижением когнитивных усилий и изменением критического мышления у knowledge workers.

2. Michael Gerlich, 2025, Societies, AI Tools in Society: Impacts on Cognitive Offloading and the Future of Critical Thinking

Работа про связь использования AI-инструментов, когнитивной разгрузки и критического мышления.

3. Doshi, Hauser, 2024, Science Advances, Generative AI enhances individual creativity but reduces the collective diversity of novel content

Исследование показывает интересный компромисс: ИИ может помогать отдельному человеку генерировать идеи, но снижать разнообразие результатов на уровне группы.

4. Bastani et al., 2024, Generative AI Can Harm Learning

Авторы обсуждают риск, что помощь ИИ улучшает выполнение тренировочной задачи, но может ухудшать самостоятельное решение позже.

Что в итоге

Главный риск частого использования нейросетей, похоже, связан не с мистическим вредом для мозга, а с перераспределением нагрузки. Человек начинает чаще редактировать и выбирать, реже формулировать, проверять и строить решение с нуля.

Для рабочих задач это может давать быстрый выигрыш и отложенную цену: больше поверхностных решений, больше ошибок в проверке, слабее самостоятельный старт, быстрее распадается внимание в длинных задачах.

Я считаю, что самый здравый вариант, который сейчас выглядит рабочим - использовать ИИ как усилитель после собственной попытки. Тогда инструмент помогает расширить мышление, а не постепенно вытесняет самые ценные его части.

Если вам близок такой формат разборов про внимание, перегруз и рабочие состояния, подписывайтесь - я пишу несколько раз в неделю, без универсальных рецептов и получений:

➡️ RISE в VK

➡️ RISE в MAХ

➡️ RISE в TG

Искусственный интеллект

5.7K поста11.9K подписчика

Правила сообщества

ВНИМАНИЕ! В сообществе запрещена публикация генеративного контента без детального описания промтов и процесса получения публикуемого результата.

Разрешено:

- Делиться вопросами, мыслями, гипотезами, юмором на эту тему.

- Делиться статьями, понятными большинству аудитории Пикабу.

- Делиться опытом создания моделей машинного обучения.

- Рассказывать, как работает та или иная фиговина в анализе данных.

- Век жить, век учиться.

Запрещено:

I) Невостребованный контент

I.1) Создавать контент, сложный для понимания. Такие посты уйдут в минуса лишь потому, что большинству неинтересно пробрасывать градиенты в каждом тензоре реккурентной сетки с AdaGrad оптимизатором.

I.2) Создавать контент на "олбанском языке" / нарочно игнорируя правила РЯ даже в шутку. Это ведет к нечитаемости контента.

I.3) Добавлять посты, которые содержат лишь генеративный контент или нейросетевой Арт без какой-то дополнительной полезной или интересной информации по теме, без промтов или описания методик создания и т.д.

II) Нетематический контент

II.1) Создавать контент, несвязанный с Data Science, математикой, программированием.

II.2) Создавать контент, входящий в противоречие существующей базе теорем математики. Например, "Земля плоская" или "Любое действительное число представимо в виде дроби двух целых".

II.3) Создавать контент, входящий в противоречие с правилами Пикабу.

III) Непотребный контент

III.1) Эротика, порнография (даже с NSFW).

III.2) Жесть.

За нарушение I - предупреждение

За нарушение II - предупреждение и перемещение поста в общую ленту

За нарушение III - бан