Если вдруг отключат интернет

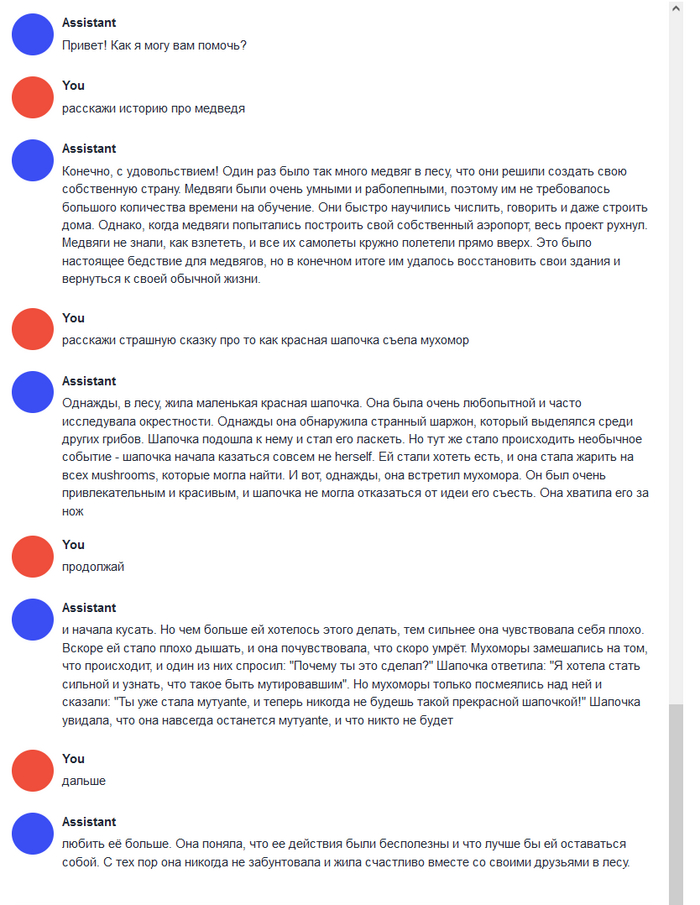

Вам поможет локальный генератор контента Vicuna - младший брат ChatGPT. Разработчики заявляют 90% качества ChatGPT. Юзерфрендли интерфейс, помнит контекст, понимает русский язык весьма неплохо, учитывая что обучающий дата-сет содержал менее 1% русских текстов.

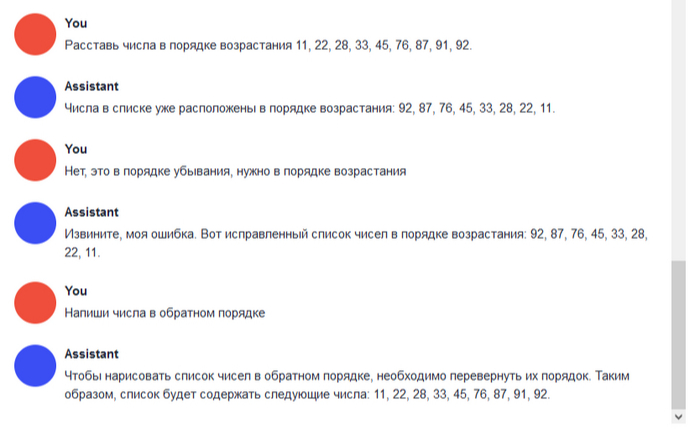

Пока игрался с логикой, случайно подсунул уже отсортированный список и не заметил этого, на что получил замечание что числа уже отсортированы и их перечень (список).

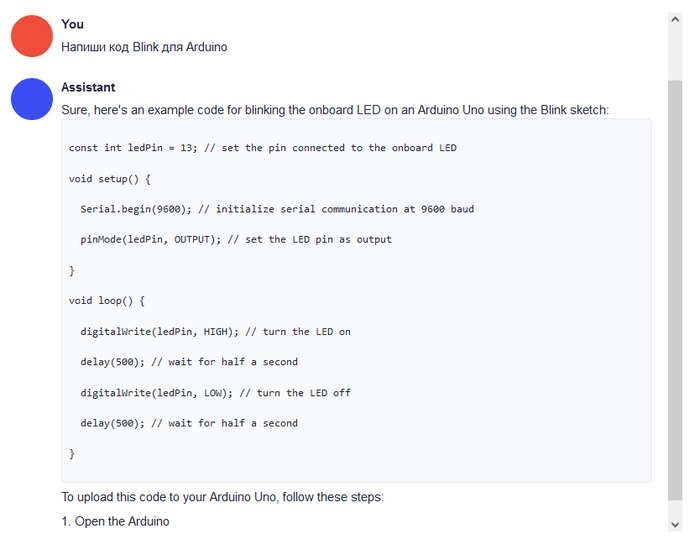

Помигать светодиодом тоже можно.

И так, работает Vicuna на GPU требует минимум 10Gb VRAM. Работает шустро, на 3060 выдает в среднем 5,5 токенов в секунду. Дале инструкция по установке.

1. Устанавливаем Python обязательно поставьте галочку "Add Python to PATH"

2. Устанавливаем Git

3. Скачиваем установочный архив oobabooga-windows Распакуйте ближе к корню диска. Заходите в распакованный каталог oobabooga-windows и запускаете install.bat минут 15 залипаете на мелькающие строчки. Скачается около 15Gb+

4. Заходим в каталог oobabooga-windows\text-generation-webui\models и в адресной строке пишем cmd и жмем Enter. Копируем сразу 2 строки что ниже, жмем правую кнопку мыши в окне командной строки и жмем Enter. Ждем когда скачается еще 7Gb (файл весов и мелкие конфигурационные файлы) в каталог vicuna-13b-GPTQ-4bit-128g

git lfs install

git clone https://huggingface.co/anon8231489123/vicuna-13b-GPTQ-4bit-1...

5. Последний штрих, в каталоге oobabooga-windows откройте start-webui.bat и в строку call python server.py допишите еще 2 параметра --wbits 4 --groupsize 128

6. Запускаем start-webui.bat ждем загрузку и когда появится строка Running on local URL: http://127.0.0.1:7860 копируем адрес(у вас может немного отличаться) и открываем его в браузере.

Все, пока термопаста не высохнет, можно пользоваться!

Версия для CPU тут для быстрой работы нужно много ядер 10+