Вышла новая модель для обучения веб-агентов WebWorld

Стала доступной крупномасштабная модель мира WebWorld (https://huggingface.co/Qwen/WebWorld-32B) для обучения веб-агентов.

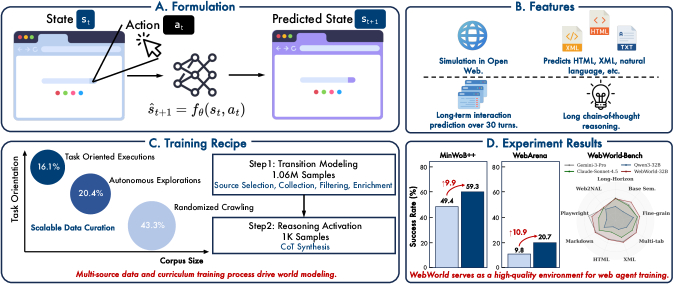

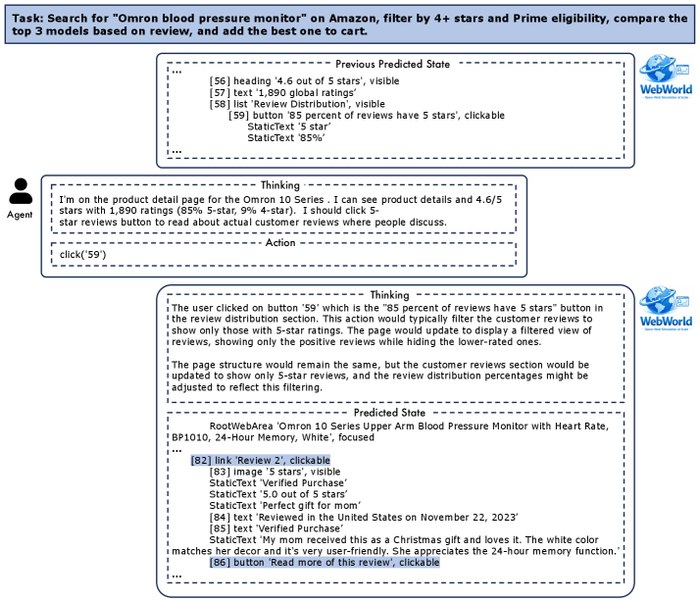

Так как обучение веб-агентов в реальности ограничено задержками, лимитами и рисками безопасности, а существующие симуляторы замкнуты в узких средах (тысячи траекторий), был создан первый симулятор открытого веба, обученный на более чем 1M реальных взаимодействий путём двухэтапного обучения (от действий к CoT) и включающий масштабируемый конвейер данных, поддержку рассуждений (CoT), длинные горизонты (30+ шагов) и множество форматов.

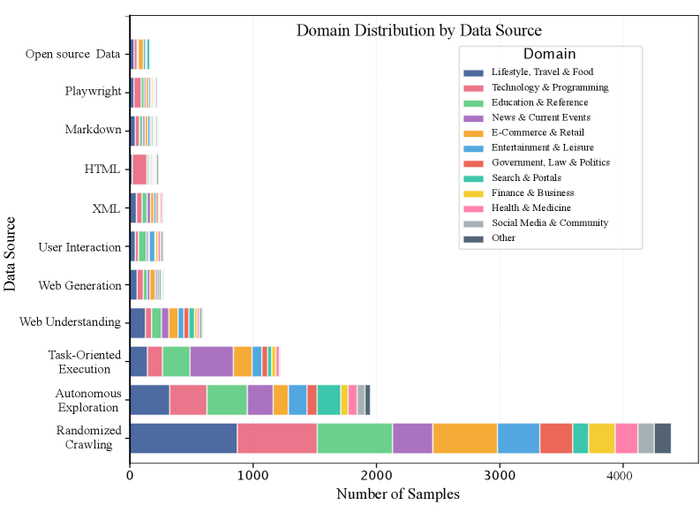

Сбор данных был иерархическим и содержал рандомный краулинг по URL из предобученных корпусов, автономное исследование агентом (сам ставит задачи), а также целевое выполнение синтезированных задач, что дало сбалансированный датасет с разной длиной контекста.

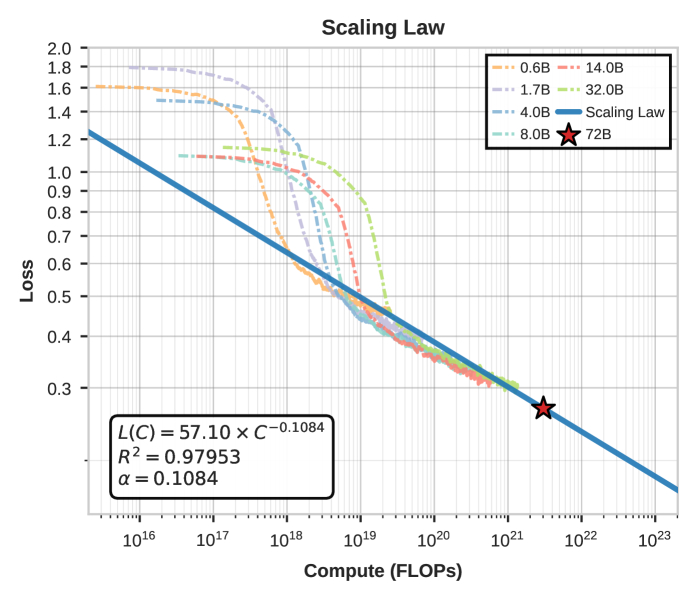

В результате на внутреннем WebWorld-Bench, состоящем из 9 измерений с метриками достоверности и Web Turing (правдоподобия), модели WebWorld сопоставимы с Gemini-3-Pro и адаптируются к средам кода, GUI и игр. Между тем Qwen3-14B, дообученный на синтетике от WebWorld, на внешнем тесте показал +9.2% в WebArena (уровень GPT-4o) и обошёл GPT-5 в задачах поиска с предпросмотром. Всё это доказывает, что синтез данных эффективнее для улучшения агентов, чем поиск на этапе вывода, а качество предсказуемо растёт с увеличением модели.