Вышла новая модель Xiaomi MiMo-V2.5

Появилась новая модель Xiaomi MiMo-V2.5 (https://huggingface.co/XiaomiMiMo/MiMo-V2.5) со скачком в агентности и мультимодальности, которая одновременно может видеть, слышать и действовать, обрабатывая контекст до 1 млн токенов.

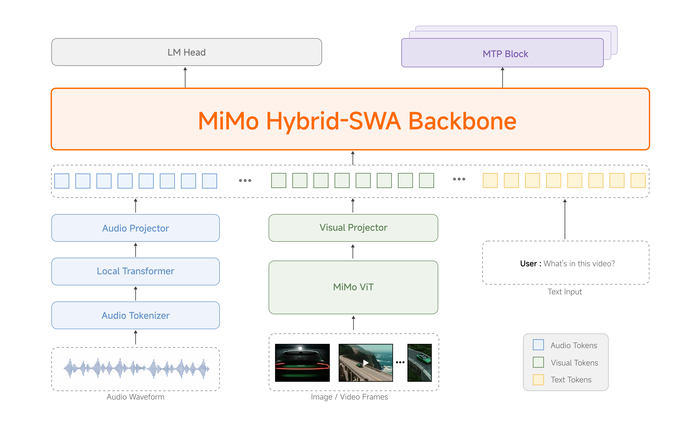

Тут разреженная MoE-архитектура с всего 310B параметров и 15B активных, которые обучались на 48T токенах, а языковая основа унаследована от MiMo-V2-Flash (гибридное sliding-window внимание), но дополнена собственными визуальным и аудио кодировщиками через лёгкие проекторы.

Обучение состояло из 5 этапов. Сначала был текстовый претрейн, потом прогрев проекторов, затем мультимодальный претрейн, дальше наступил SFT и агентный посттренинг (окно расширили с 32K до 256K и до 1M), а в завершение провели RL и MOPD.

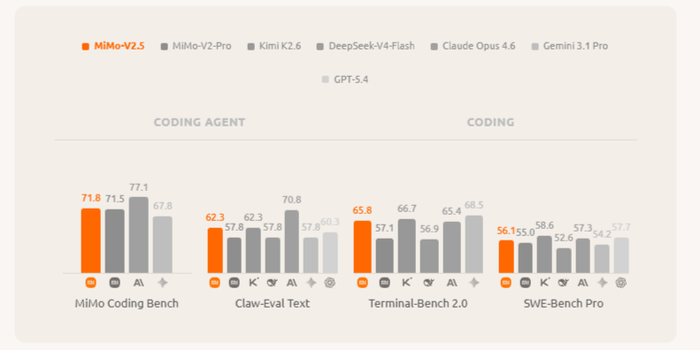

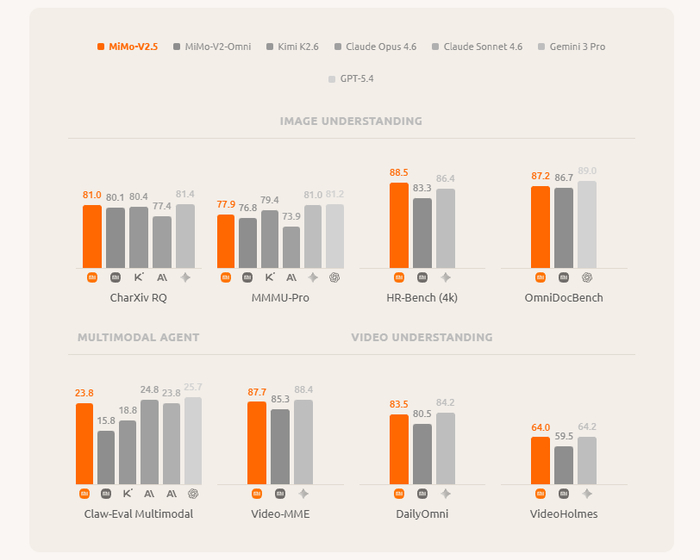

В результате её агентские навыки являются лучшими в своём классе, демонстрируя 71.8 на MiMo Coding Bench (уровень MiMo V2 Pro, но дешевле), 62.3 на Claw-Eval (текст), 65.8 на Terminal-Bench 2.0 и 56.1 на SWE-Bench Pro, между тем мультимодальное восприятие сравнимо с топовыми закрытыми моделями (Gemini 3 Pro, Claude Sonnet 4.6) и, например, достигает 81.0 на CharXiv RQ, 77.9 на MMMU-Pro, 87.7 на Video-MME, 83.5 на DailyOmni и 64.0 на VideoHolmes.