Вышла новая модель Laguna M.1 и XS.2

Произошёл релиз двух моделей семейства Laguna, включающий M.1 и XS.2 (https://huggingface.co/poolside/Laguna-XS.2), а также агентную среду (ACP-сервер pool) для обучения и оценки.

Позиционируют их как агентные модели для долгосрочных задач (long-horizon), а ключевой способностью стало программирование. Они выходят за рамки простого вызова инструментов, так как агент может писать и исполнять код, создавая произвольные интерфейсы, чтобы взаимодействовать с окружающим миром.

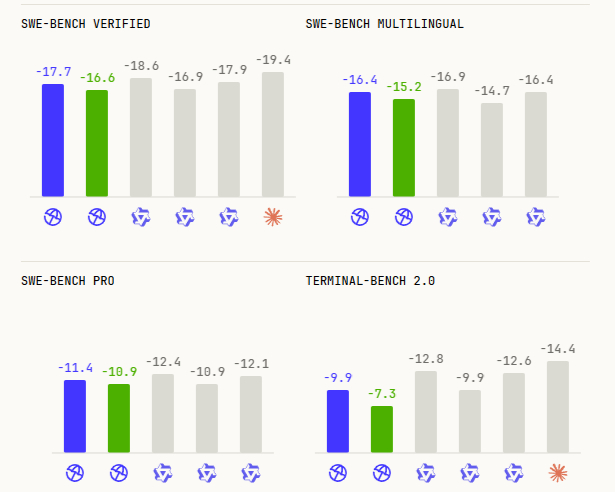

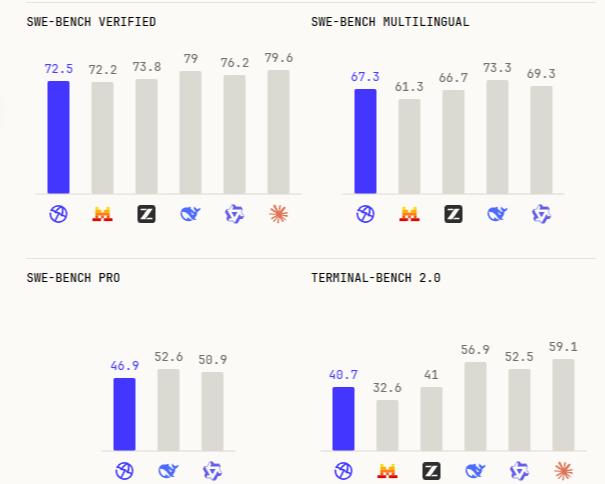

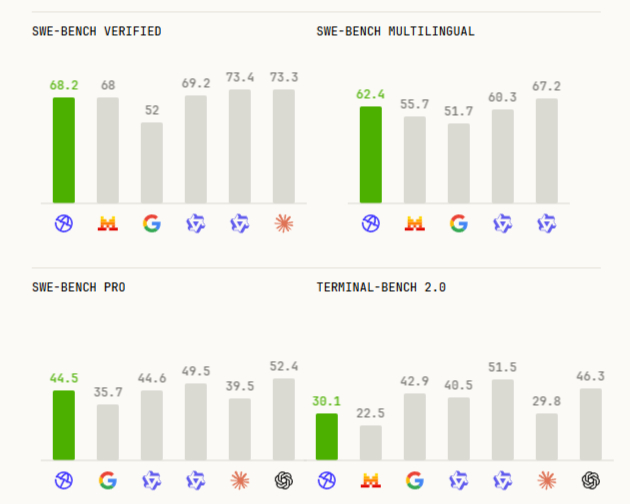

Первая модель Laguna M.1 имеет 225B параметров (архитектура MoE, 23B активных), обучена с нуля на 30T токенов и является закрытой, показывая 46.9% на SWE-bench Pro и 40.7% на Terminal-Bench 2.0. Вторая же Laguna XS.2 имеет 33B параметров (архитектура MoE, 3B активных) и открытые веса под Apache 2.0, достигая 44.5% на SWE-bench Pro и 30.1% на Terminal-Bench, что делает её лучшей в её весовом классе.

Процесс обучения объединил веб-данные с балансом качества и разнообразия (примерно в 2 раза больше уникальных токенов) и синтетические данные (около 13% микса, 4.4T+ токенов), применяя AutoMixer для автоматической оптимизации смеси данных благодаря примерно 60 прокси-моделям и регрессионным суррогатам, что дало значительный прирост на целевых способностях (особенно в коде и математике). В качестве оптимизатора использовали распределённый Muon (Newton-Schulz с коммуникацией), давший ускорение примерно 15% против AdamW при накладных расходах менее 1% шага. На этапе агентного RL был сделан полностью асинхронный онлайн RL с песочницами, off-policy обучение (вариант CISPO), режим token-in/token-out без перетокенизации и передача весов через GPUDirect RDMA (M.1 за 5 с).