Ответ Fox1121011 в «Yandex-Xyandex»41

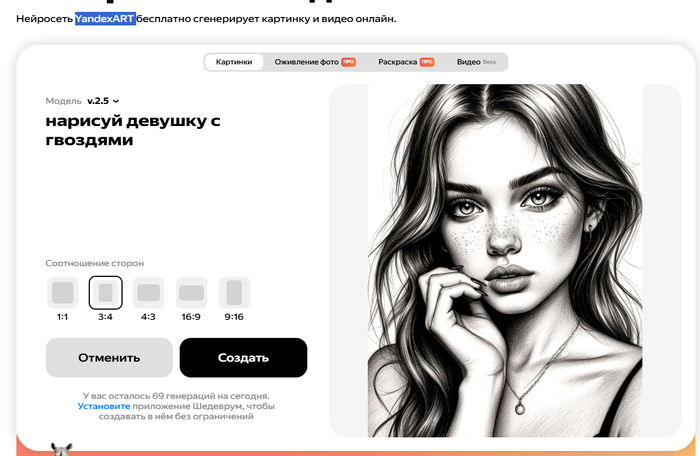

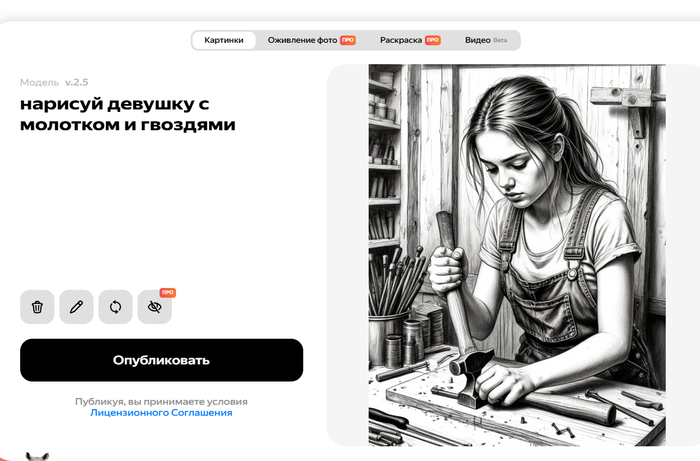

Увидел вброс, и подумал, ну не может быть так тупо! Решил проверить.

И действительно, никаких гвоздей.

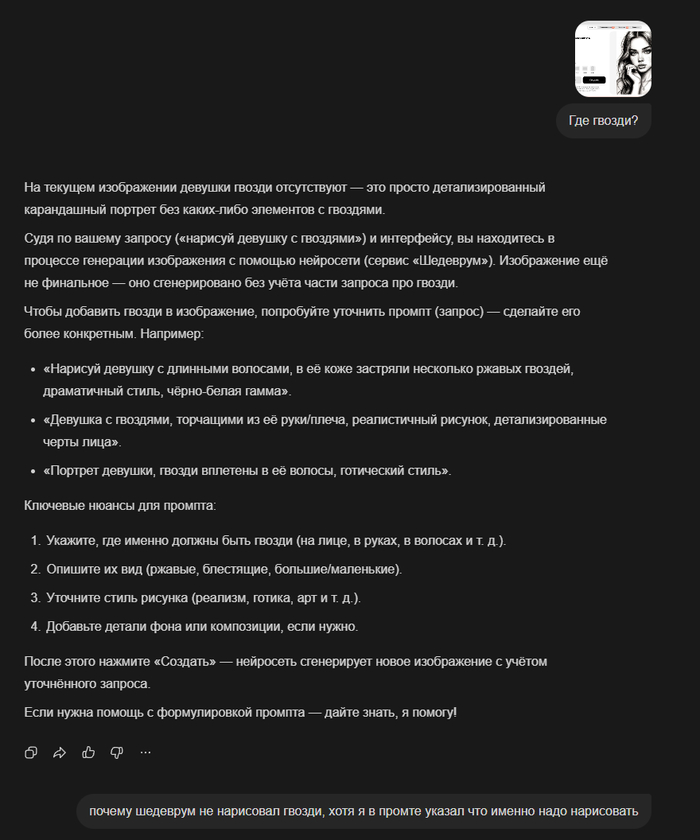

Как же так, неужели под капотом иностранщина?? Да как так то! Пошел в скрепную Алису выяснять

Типа : "Ну что ты пристал! Хочешь гвозди? Да НА! получай свои долбанные гвозди. И смотри, я даже напишу что это ИМЕЧНО ГВОЗДИ"

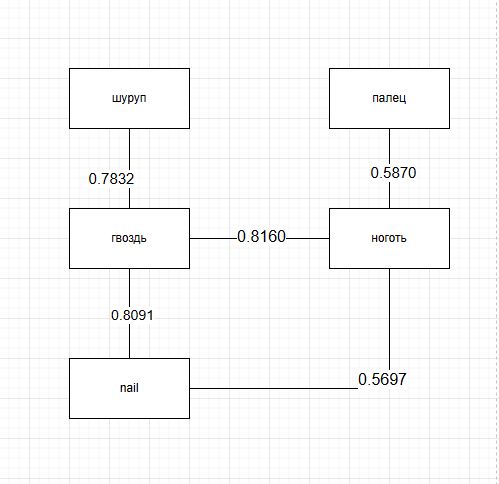

Это всё смешно, но давайте разберёмся. Как все знают (но только не комментаторы на Пикабу), нейросети не работают со словами, а работают с их векторными представлениями. Такие вектора называются embedings. То есть слова сначала переводит в вектора, а потом на основании векторов рисует картинку.

Я решил посмотреть на ембединги слов "гвоздь", "ноготь", "шуруп", "палец", "nail" и посмотреть насколько похожи. Взял мультиязычную SentenceTransformers и посчитал. Вот что получилось

Sentence embeddings:

> 0.85 → почти всегда синоним / перефраз

0.75–0.85 → вероятный синоним в контексте

< 0.70 → уже не синоним, а просто тематическая близость

Если добавить в промт больше контекста, то он нарисует правильные гвозди. Но картинка всё равно гавно.

Морали нет. Всем мир!