Чат GPT для создания видео: может ли ChatGPT сгенерировать видео

Одна из самых обсуждаемых тем в мире искусственного интеллекта — чат GPT для создания видео. ChatGPT — это продвинутый языковой искусственный интеллект, разработанный американской компанией OpenAI в 2022 году на основе архитектуры GPT (Generative Pre-trained Transformer). Над его разработкой работала команда исследователей и инженеров под руководством OpenAI, среди основателей компании — Сэм Альтман, Илья Сутскевер, Грег Брокман и другие специалисты в области машинного обучения. Первоначально ChatGPT использовался для диалогов и написания текстов, но по мере развития технологий его интеграции начали применять для написания подробных сценариев, описаний сцен, раскадровок и подсказок для нейросетей, генерирующих изображение и видео.

В этой статье я расскажу, как именно ChatGPT может быть задействован в процессе создания видео и можно ли считать, что он «сам» генерирует видеоролики.

Может ли ChatGPT генерировать видео?

Несмотря на популярность ChatGPT и его продвинутые языковые возможности, сам по себе этот искусственный интеллект не способен напрямую создавать или рендерить видеофайлы. Чат GPT работает с текстом: принимает текстовый запрос и возвращает текстовый ответ. Однако именно на этапе подготовки и планирования ролика он может стать мощным инструментом и заметно ускорить работу над видео.

ChatGPT может помочь следующим образом:

Генерация идей для роликов

подбор тем под нишу и аудиторию;

варианты форматов (обзор, туториал, скетч, сторителлинг, шортсы и т.д.);

помощь в придумывании серий контента.

Написание сценариев

полный сценарий от приветствия до призыва к действию;

разбивка на сцены и блоки;

варианты диалогов, шуток, переходов.

Создание раскадровки в текстовом виде

описание каждого кадра: что в кадре, какая эмоция, план (крупный, средний, общий);

подсказки для ракурсов и динамики;

текстовые подсказки (промпты) для нейросетей, которые уже умеют генерировать изображение или видео.

Помощь в монтаже и структуре

предложения по структуре ролика, чтобы удерживать внимание;

идеи для хук-начала (первых 3–5 секунд);

варианты переходов, вставок, надписей, экранного текста.

Тексты вокруг видео

заголовки, описания и теги для соцсетей;

варианты кликабельных названий;

текст для обложки (thumbnail), слоганы, цепляющие фразы.

Работа с голосом и субтитрами

подготовка текста для озвучки;

упрощение сложного текста под разговорную речь;

черновик субтитров или тайм-кодов по уже готовому сценарию.

Анализ и улучшение контента

разбор сценария: что можно сделать динамичнее, короче, понятнее;

предложения по доработке ролика под цели: обучающий, продающий, развлекательный;

подбор альтернативных версий для A/B-тестов (название, описание, первые фразы).

Далее рассмотрим, какие инструменты наподобие ChatGPT делают видео.

ТОП-10 нейросетей, которые умеют создавать видео

Sora — модель от OpenAI, которая по текстовому описанию или загруженному изображению создает до минутного видео с высокой детализацией, реалистичной физикой и любым стилем.

Kling — видеомодель от Kuaishou, генерирующая фотореалистичные ролики до 2 минут в 1080p из текста или изображений, с плавным движением и продвинутым управлением камерой.

Google Veo — флагманская модель Google для генерации коротких видео (с аудио) по тексту и картинкам, оптимизированная для создателей контента и встроенная в Gemini/AI Studio.

Hailuo — линейка видеомоделей MiniMax, которая превращает текст и фото в короткие кинематографичные клипы 1080p с реалистичной анимацией и сложной физикой движения.

Seedance — модель от экосистемы ByteDance, поддерживающая мульти-шот генерацию видео из текста и изображений с упором на точное следование промпту и плавное 1080p-движение.

PixVerse — сервис, который по тексту или загруженным фото делает короткие, «вирусные» ролики с трендовыми эффектами, кинематографичными и анимированными сценами для соцсетей.

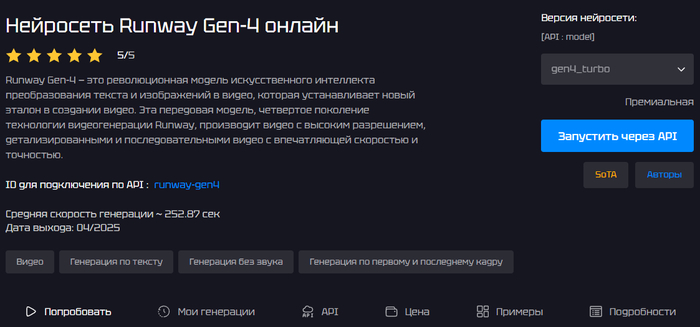

Runway — поколение Gen-4 от Runway, профессиональная видеомодель для продакшн-класса, позволяющая задавать персонажей, объекты и сцены и получать консистентное, монтажно-готовое видео.

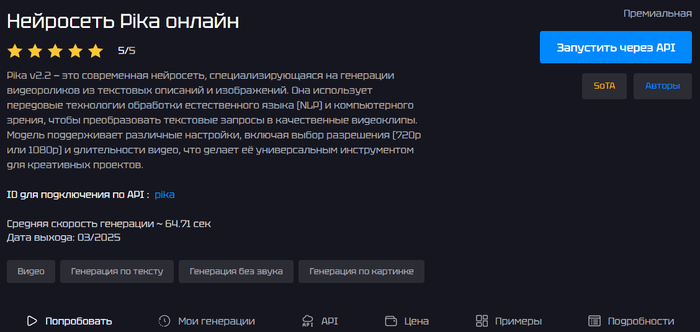

Pika — «idea-to-video» платформа, которая превращает текст, картинки и исходное видео в динамичные ролики с множеством встроенных инструментов редактирования и эффектов.

MiniMax — набор видеомоделей от китайского стартапа MiniMax, ориентированный на текст- и image-to-video генерацию высококачественных коротких клипов.

CogVideo — открытая текст-to-video модель CogVideoX-5B от Zhipu AI, создающая ~10-секундные высокодетализированные ролики с временной согласованностью кадров и поддержкой высокого разрешения.

1. Sora

Видеонейросеть от OpenAI, встроенная в сервис GPTunneL и предназначенная для генерации коротких реалистичных роликов по текстовому описанию. Она понимает запросы на русском и английском, поддерживает вертикальный и горизонтальный форматы и создает видео до ~20 секунд с реалистичной физикой и синхронным звуком. Через GPTunneL Sora доступна пользователям из России прямо в браузере, а итоговый ролик можно сразу скачать в MP4 в 1080p или 720p.

Стоимость: без абонентской подписки, по модели pay-as-you-go

Тестовый период: нет

Регистрация: требуется

Преимущества:

Поддержка русского и английского языка, форматы 16:9 и 9:16, разрешения 1080p и 720p.

Короткое время ожидания: ролик генерируется примерно за 2–3 минуты.

Реалистичная физика движения, сложная анимация и синхронный звук уже «из коробки».

Удобная оплата: без подписок, платите только за сделанные генерации, можно оплачивать российскими картами и криптовалютой.

Встроенная модерация и фильтрация запросов для более безопасного использования.

Недостатки:

Оплата за каждую генерацию: при большом количестве роликов стоимость может ощутимо вырасти.

Длительность роликов ограничена коротким форматом (около 20 секунд).

2. Kling

Это видеонейросеть от китайской компании Kuaishou, которая в Study24.ai используется для генерации реалистичных роликов по тексту и картинкам. Модель умеет работать в режимах text-to-video и image-to-video, создавая короткие HD-видео с движением камеры и хорошей сохранностью лица и мимики. Через Study24 Kling доступен в одном интерфейсе вместе с другими мощными видеомоделями (Runway, Veo, Luma и др.), на русском языке. Такой связкой удобно оживлять фото, делать клипы для соцсетей, сторис и рекламные тизеры без ручного монтажа.

Стоимость: от 199 ₽ в неделю

Тестовый период: есть

Регистрация: требуется

Преимущества:

В одном месте доступны Kling и другие топовые видеомодели (Runway, Veo, Luma и др.) — удобно сравнивать результат разных нейросетей.

Kling хорошо держит портретное сходство и мимику в движении, особенно при оживлении фото.

Есть бесплатный тест, можно попробовать генерацию видео до оформления платного тарифа.

Относительно низкий порог входа: стартовый тариф с токенами подходит, чтобы регулярно тестировать видео и другие ИИ-инструменты.

Недостатки:

Бесплатные лимиты быстро заканчиваются, если активно генерировать видео.

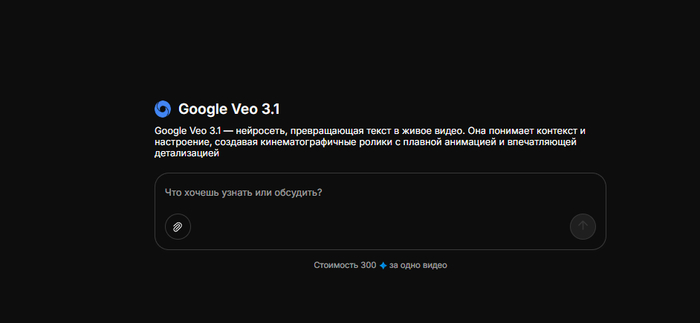

3. Google Veo

Генеративная видеонейросеть от Google, созданная в 2024 году и встроенная в экосистему Gemini (Flow, Vertex AI и др.), которая умеет превращать текст и изображения в кинематографичные ролики. Она поддерживает режимы text-to-video и image-to-video, сложные движения камеры, расширение сцены и нативную генерацию звука (музыка, эффекты, голоса).

Стоимость: от ≈20 $ в месяц

Тестовый период: есть бесплатная версия Veo 3

Регистрация: требуется

Преимущества:

Кинематографическое качество: плавная анимация, реалистичный свет, тени и физика движения.

Гибкий контроль сцены через Flow: движение камеры, смена планов, расширение сцены (Extend).

Поддержка разных режимов: text-to-video, image-to-video, видео-продление и генерация со звуком.

Официальный доступ в России без иностранных карт через Study24, оплата рублями, СБП и др.

Есть бесплатный дневной лимит, позволяющий тестировать модель и делать простые ролики без вложений.

Недостатки:

Базовый бесплатный режим ограничен: всего 3 коротких видео в день, до ~10 секунд и 720p.

4. Hailuo

Видеонейросеть в GenAPI, которая превращает одно статичное изображение в короткий 1080p-ролик с плавной анимацией ветра, воды, тканей и движений тела. Она не «перерисовывает» сцену, а аккуратно оживляет уже существующую картинку, сохраняя композицию и стиль. Модель особенно хорошо подходит для портретов, артов, атмосферных пейзажей и любых сцен, где важны живые, но ненавязчивые движения. Hailuo 2 помечена как премиальная SoTA-модель и генерирует ролики за несколько минут, обеспечивая более качественную анимацию, чем многие аналоги.

Стоимость: абонентской подписки нет, списываются токены за каждую генерацию

Тестовый период: новым пользователям обычно дают стартовый бонус в токенах/кредитах

Регистрация: требуется

Преимущества:

Делает плавную анимацию волос, воды, ткани и других «живых» деталей без рывков и ломанных движений.

Сохраняет композицию и стиль — не превращает кадр в новую картинку, а мягко оживляет исходное изображение.

Поддерживает разрешение до 1080p, подходит для реалистичных сцен и персонажей.

Простота использования: нужен только один кадр, без сложной подготовки и монтажа.

Работает через GenAPI без подписок, с оплатой только за реально сделанные генерации и поддержкой на русском.

Недостатки:

Делает очень короткие ролики (несколько секунд) — не подходит для длинных сюжетных видео.

5. Seedance

Это видеонейросеть в GenAPI, которая превращает текст или картинку в короткий сценарный видеоклип продолжительностью 5–10 секунд в разрешении до 1080p. Модель создает плавное, осмысленное движение: смену ракурсов, микропауз, жестов и взгляда так, будто сцена снята живой камерой режиссера. Она поддерживает мультикадровый (multi-shot) подход: в одном ролике могут сменяться сцены, при этом персонажи, фон и стиль остаются согласованными. Seedance 1.0 Pro умеет работать в разных стилях — от фотореализма до аниме и акварели — и рассчитана на создание коротких, кинематографичных мини-историй без классического видеомонтажа.

Стоимость: оплата токенами за каждую генерацию, без абонентской подписки

Тестовый период: новым пользователям дают стартовый бесплатный баланс

Регистрация: требуется

Преимущества:

Кинематографичные мини-ролики: 5–10 секунд в 1080p с логичной сменой планов и ракурсов.

Multi-shot / мультикадровый подход — в одном видео может быть несколько сцен, при этом персонажи, фон и стиль остаются стабильными.

Очень плавное и естественное движение без дерганий переходов, даже на мелких деталях.

Хорошо передает эмоции и позы: взгляд, жесты, микропаузу в движении.

Поддерживает широкий спектр стилей — от реалистичного «кино» до аниме, акварели и других художественных эффектов.

Интеграция через GenAPI: можно использовать как из веб-интерфейса, так и по API в своих проектах.

Недостатки:

Жесткое ограничение по длительности — ролики максимум до 10 секунд.

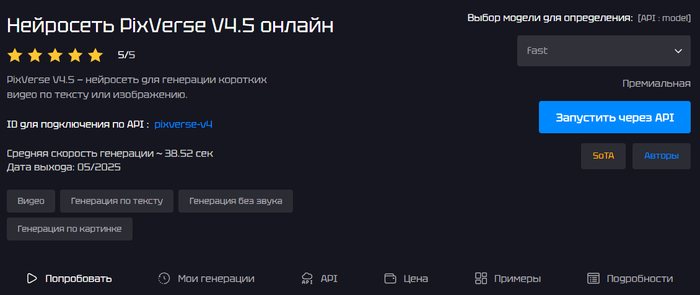

6. PixVerse

Нейросеть в GenAPI для создания коротких видео по тексту или изображению, заточенная под ролики в стиле TikTok, анимации, рекламные клипы и быстрые визуальные концепты. Она поддерживает режимы text-to-video и image-to-video, умеет анимировать загруженную картинку с учетом промпта и генерировать осмысленное движение в кадре. Есть два режима генерации: быстрый (до ~5 секунд видео, до 720p) и обычный (до ~8 секунд, 1080p, с более сложными эффектами). Поддерживается выбор художественного стиля (реализм, 3D-анимация, киберпанк, комикс и др.), работа с ключевыми кадрами и автоматическое добавление звуков, синхронизированных с видео.

Стоимость: оплачивается через баланс GenAPI по системе pay-per-use — вы платите токенами за каждую генерацию, без абонентской подписки

Тестовый период: есть

Регистрация: требуется

Преимущества:

Делает короткие ролики для соцсетей (TikTok-формат, рекламные клипы, анимации, визуальные концепты).

Поддерживает и text-to-video, и image-to-video: можно как генерировать сцену с нуля, так и оживлять загруженное изображение с учетом текста.

Два режима генерации: быстрый (за ~5 секунд генерации, до 720p) и обычный (до 8 сек, 1080p, более сложные эффекты) — можно выбирать баланс скорости и качества

Богатые стили и контроль: выбор художественного стиля, ключевые кадры для начала и конца сцены, автоматическое звуковое сопровождение, синхронизированное с видео.

Недостатки:

Модель ориентирована на очень короткие ролики (5–8 секунд), для длинных сюжетных видео нужен дополнительный монтаж.

В быстром режиме есть ограничения по длительности и разрешению (до 5 секунд и 720p).

7. Runway

Премиальная видеонейросеть в GenAPI, которая по текстовому описанию или загруженному изображению генерирует короткие кинематографичные ролики. Модель — четвертое поколение технологии Runway, дает высокое разрешение, детализированную картинку и последовательные кадры, хорошо понимает сложные промпты и «чувствует» операторские приемы: поворот камеры, крупность плана, свет. Gen-4 особенно сильна в передаче эмоций, жестов и действий людей, поэтому подходит для рекламных креативов, клипов, концептов и визуальных сторителлингов.

Стоимость: от 60 ₽

Тестовый период: есть

Регистрация: требуется

Преимущества:

Премиальное качество: высокое разрешение, детализированные и последовательные кадры, одна из топовых видеомоделей на рынке.

Отлично передает эмоции, жесты и движения, учитывает кинематографические нюансы — угол камеры, свет, композицию.

Поддерживает text-to-video и image-to-video: можно генерировать сцену с нуля или на основе загруженной картинки.

Интеграция с GenAPI: нет подписок, оплата только за фактические генерации, удобный веб-интерфейс и API.

Средняя скорость генерации порядка 1,5 минуты за ролик, что неплохо для такого уровня качества.

Недостатки:

Стоимость выше, чем у простых видеомоделей: 60–120 ₽ за короткий ролик быстро набегают при массовой генерации.

Длина видео ограничена (5–10 секунд), для длинных сюжетных роликов придется собирать монтаж из нескольких генераций.

8. Pika

Современная видеонейросеть в GenAPI, которая генерирует ролики из текстовых описаний и/или загруженных изображений. Она использует связку NLP и компьютерного зрения, чтобы превратить промпт в осмысленный видеоклип с различными стилями — от реалистики до более художественных эффектов. Модель поддерживает выбор разрешения (720p или 1080p) и длительности, поэтому ее удобно использовать и для рекламных тизеров, и для соцсетей, и для образовательного контента. Среднее время генерации на GenAPI — около 2–3 минут (~145 секунд) за одно видео.

Стоимость: от 40 ₽

Тестовый период: есть

Регистрация: требуется

Преимущества:

Генерация видео из текста и/или изображения: удобно как для роликов «с нуля», так и для анимации статичных картинок.

Разрешение до 1080p и настраиваемая длительность (на GenAPI доступны варианты 5 и 10 секунд).

Поддержка разных визуальных стилей: кинематографичный, анимационный, более реалистичный и др.

Простая интеграция через API плюс работа из веб-интерфейса — подходит и разработчикам, и «некодерам».

Облачный рендеринг: не нужен собственный GPU, все крутится на стороне GenAPI.

Прозрачная тарификация: известная цена за конкретный ролик, удобно планировать бюджет.

Недостатки:

На GenAPI сейчас доступны только короткие ролики 5–10 секунд, длинные видео нужно собирать монтажом из нескольких клипов.

Нет очень тонких/профессиональных настроек — для сложного продакшна возможностей может не хватать.

9. MiniMax

Видеонейросеть Hailuo AI, доступная в GenAPI, которая создает короткие ролики по текстовым описаниям и картинкам. Она генерирует видео длительностью около 6 секунд с разрешением 1280×720 и частотой 25 кадров в секунду, делая ставку на кинематографичность, реалистичную физику и естественную анимацию. MiniMax умеет как text-to-video, так и image2video: можно оживлять или продолжать уже существующее изображение, управлять движением камеры и анимацией объектов. Модель позиционируется как премиальная SoTA-нейросеть с высоким качеством картинки и связным сюжетом, среднее время генерации на GenAPI — около 320 секунд за ролик.

Стоимость: без абонентской подписки и привязки к конкретному тарифу

Тестовый период: бесплатный доступ по реферальной ссылке

Регистрация: требуется

Преимущества:

MiniMax создает качественные короткие видео с хорошей детализацией, связным сюжетом и реалистичной физикой движения.

Фиксированные параметры для стабильного результата — 6 секунд, 1280×720, 25 fps: этого хватает для заставок, тизеров, коротких сцен и рекламных вставок.

Мощный режим image2video.

Минимум странных артефактов: разработчики подчеркивают, что модель хорошо понимает физику мира и помогает избежать «ломаных» поз и «плавающих» объектов.

Недостатки:

Ограничение по длительности — один ролик максимум около 6 секунд, для более длинного сюжета нужно собирать видео из нескольких клипов и монтировать вручную.

10. CogVideo

Открытая видеонейросеть от компании Zhipu AI, одна из самых продвинутых моделей для генерации видео по текстовому запросу. Она использует 3D Causal VAE и архитектуру Expert Transformer, благодаря чему кадры получаются согласованными, а переходы — плавными, без «дерганой» анимации. Модель хорошо подходит для коротких роликов: от простых визуализаций до промо-видео, обучающих фрагментов и продуктовых обзоров. В GenAPI CogVideoX 5B доступна как премиальная модель с удобным подключением по API (cog-video-x-5b) и средней скоростью генерации около 70 секунд за видео.

Стоимость: нет абонентских подписок — оплата только за отдельные генерации

Тестовый период: есть

Регистрация: требуется

Преимущества:

Одна из самых продвинутых open-source text-to-video моделей на рынке.

Использует 3D Causal VAE и Expert Transformer, поэтому делает плавные переходы и согласованные кадры, без резких рывков.

Подходит для широкого спектра задач: медицина, маркетинг, архитектура, e-commerce и др. (обучающие ролики, туры по объектам, 3D-обзоры товаров).

Средняя скорость генерации порядка ~69 секунд за видео, что довольно быстро для SOTA-модели.

Недостатки:

Премиальный статус означает, что стоимость выше, чем у базовых видеомоделей GenAPI (особенно при массовой генерации).

Фокус на коротких роликах: для длинных сюжетных видео все равно нужен монтаж из нескольких клипов.

Возможности ChatGPT: кому подходит и какие задачи решает при создании видео

Хотя сам ChatGPT не создает видео и не выдает готовые .mp4, он отлично закрывает «мозговую» и текстовую часть производства: от идеи и сценария до промптов для видеонейросетей и оформления ролика под публикацию. По сути это универсальный ассистент, который помогает вам думать, структурировать, писать и улучшать все, что связано с видео — а уже потом вы загружаете эти идеи в видеоредактор или нейросеть для генерации.

Кому подходит ChatGPT при работе с видео:

Блогерам и создателям контента

Нужны регулярные идеи и сценарии, а времени мало.

Маркетологам и владельцам бизнеса

Рекламные ролики, промо, продуктовые презентации.

Нужны продающие сценарии, УТП, четкая структура.

Продюсерам и сценаристам

Черновики сценариев, варианты сцен, диалоги, сториборд в текстовом виде.

Быстрый перебор десятков версий без «боли» правок.

Образовательным проектам и экспертам

Обучающие видео, курсы, уроки, вебинары.

Помощь в упрощении сложных тем и логичной подаче материала.

Дизайнерам и motion-дизайнерам

Текстовые промпты для видеонейросетей (Sora, Runway, Pika и др.).

Описание сцены, света, стиля, движения камеры.

Новичкам в видео

Тем, кто только начинает и не знает, с чего подступиться к идее и структуре ролика.

Какие задачи ChatGPT помогает решать при создании видео

Идея и концепция ролика

Генерация идей под нишу, продукт, формат площадки.

Придумывание рубрик, серий, циклов роликов.

Помощь в позиционировании: «о чем канал?» и «для кого?».

Разработка сценария

Полный сценарий: вступление, основная часть, вывод, призыв к действию.

Разбивка на сцены и тайм-коды (примерно: 0:00–0:05 — хук, 0:05–0:30 — боль и т.д.).

Диалоги, шутки, варианты формулировок под стиль автора.

Структура и удержание внимания

Придумывание сильного hook для первых 3–5 секунд.

Варианты «поворотов», интриги, мини-клаймаксов по ходу ролика.Подсказки, где сократить, что переставить местами, чтобы ролик смотрели до конца.

Промпты для видеонейросетей

Составление детальных текстовых запросов для Sora, Runway, Pika, PixVerse и других моделей.

Описание персонажей, окружения, света, динамики камеры, стиля (аниме, кино, 3D, акварель и т.п.).

Генерация нескольких вариаций промпта для A/B-теста.

Раскадровка и визуальное описание

Текстовая раскадровка: «Кадр 1 — общий план… Кадр 2 — крупный план лица…».

Подсказки по ракурсам, движению камеры, переходам.

Описание ключевых кадров для дальнейшей работы в редакторе или нейросети.

Тексты вокруг видео

Заголовки, описания, теги, хештеги для разных платформ.

Текст для обложек и превью: короткие цепляющие фразы.

Варианты кликабельных названий под SEO/рекомендации.

Озвучка и субтитры

Подготовка текста для диктора или нейросинтеза голоса.

Адаптация «сухого» текста под живую разговорную речь.

Черновик субтитров на основе сценария или краткого конспекта ролика.

Аналитика и улучшение контента

Разбор вашего сценария: что неясно, скучно, длинно, где много воды.

Предложения по улучшению под конкретную цель: обучать, продавать, развлекать.

Генерация альтернативных версий ролика для тестирования (другая подача, длина, тон).

В итоге мы приходим к простому выводу: сам ChatGPT пока не умеет напрямую рендерить ролики и создавать готовые видеофайлы, но отлично справляется с «мозговой» частью процесса. Если смотреть шире, чат GPT для создания видео — это связка: вы получаете идеи, сценарии, раскадровку, промпты для видеонейросетей и тексты для оформления, а уже другие сервисы занимаются генерацией и монтажом. Такой подход особенно полезен блогерам, бизнесу, экспертам и всем, кто хочет делать больше контента при тех же ресурсах. Используя ChatGPT как сценариста и идеолога, а нейросети вроде Sora, Runway, Kling, Pika и других — как «виртуальную съемочную группу», вы получаете полноценный продакшн без студии и большой команды.

Если у вас есть опыт использования ChatGPT для видео, обязательно поделитесь в комментариях — напишите, какие нейросети вы уже пробовали.