DeepSeek-R1 - open-source на уровне o1

Cовсем недавно были пугающие слухи о том как OpenAI близки к созданию AI-агентов уровня PhD, про скорое создание искуственного интелекста общего уровня.

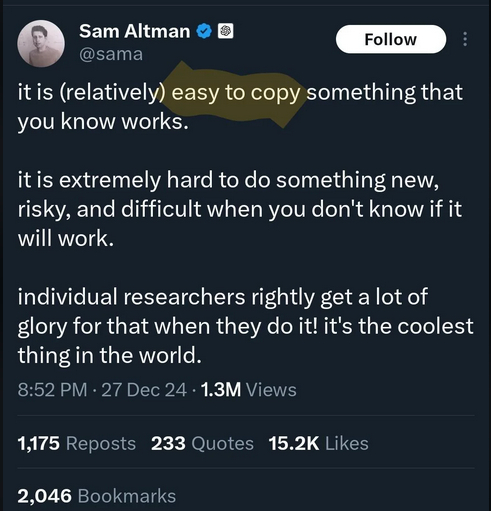

Правда ещё месяц назад Сэм Альтман написал твит-реакцию на релиз DeepSeek V3 где он уповал на то, что "Создавать что-то с нуля гораздо сложнее, чем когда ты знаешь работает какая -то идея или нет".

И вот прошёл всего месяц и DeepSeek релизнули свою "думающую" модель на подобии o1.

Как и DeepSeek V3 , R1 также является Большой Языковой Моделью (LLM) типа MoE (микстура экспертов).

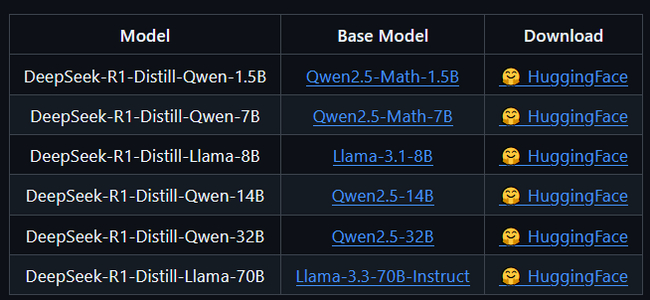

Используя ответы сгенерированные R1, DeepSeek предоставили свои "оттюненые" версии уже вышедших open-source моделей от других компаний (Meta и Alibaba)

Бенчмарки

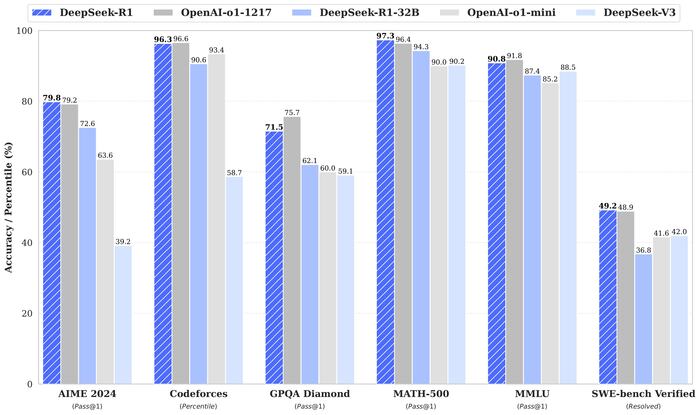

И на что же способна R1 ?

Оффициальые результаты состоят в основном из кодинга и математики. Причём из олимпиадных задач в обеих дисциплинах. Результат впечатляет. Что же в других бенчах ?

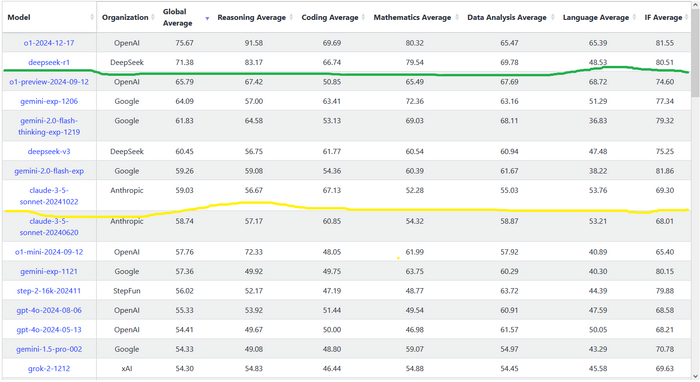

Livebench ai стараются соблюдать чистоту тестов и довольно хорошо отражают реальное использование LLM (ИИ) моделей.

R1 показал невероятный уровень, очень близкий к o1 по всем параметрам-столбцам.

Что касается честности бенчмарка - взгляните на столбец "Coding Average".

Claude Sonnet 3.5 славится у пользователей своими превосходными кодерскими способностями.

И Sonnet 3.5 по-прежнему номер 2 в кодинге после o1, а R1 стал номером 3 и дышит в спину Claude Sonnet 3.5 .

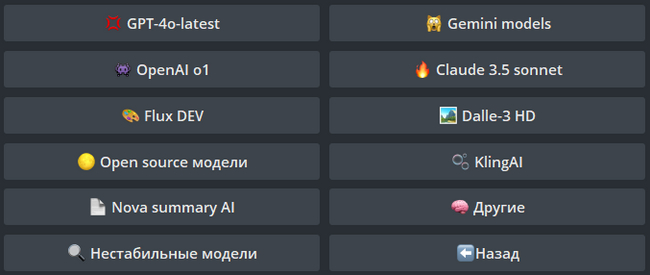

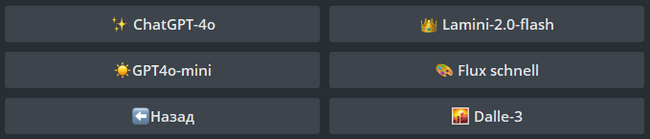

В нашем тг боте (в описании канала) уже есть DeepSeek V3 (в "Другие") и в скором времени будет добавлен R1.

Можете попробовать если желаете.

Что означает тип MoE ?

Модель огромна - несколько сотен миллиардов параметров (671млрд.).

Для запуска LLM нейросети она должна быть полностью загружена в память.

Для монолитной модели больше 50 млрд. параметров - это обязательно должна быть видеопамять видеокарты.

Для 671млрд. модели требуется 384 гигабайт памяти. Также куча вычислений для приемлемой скорости генерации ответа делает настолько большие монолитные LLM модели

экономически невыгодными.

В случае с MoE архитектурой - модель разделена на несколько специализированных моделей поменьше.

В случае с DeepSeek V3 и R1 - это 37 млрд. параметров, что позволяет хостить эти модели на современных серверных процессорах, что намонго дешевле, а качество ответов на высоте так как специлизированные 37млрд. модели хороши в своих областях.