ИИ-грамотность — это не код. Чему на самом деле нужно учить в 2025 году

Искусственный интеллект (ИИ) всё больше влияет на принятие решений в разных сферах, поэтому возникает необходимость повышения AI-грамотности не только среди программистов, но и среди обучающихся, преподавателей и широкой публики. Однако многие существующие подходы основаны на сложных инструментах программирования или абстрактных лекциях, что ограничивает доступ для не-технической аудитории.

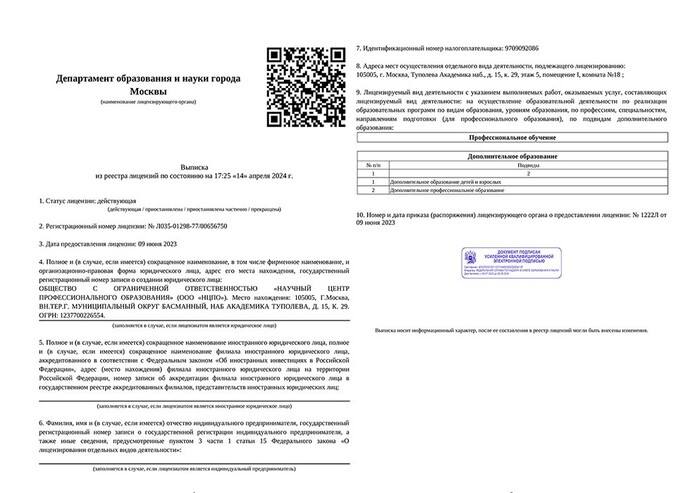

В работе за авторством Варриер А.М., Агарвал А., Савелка Я., Богарт К., Бурт Х. от 7 ноября 2025 представлены исследования учебной программы, направленной на повышение AI-грамотности среди 15 преподавателей колледжей.

«Мне нравится, что приходится копаться» Эта цитата одного из преподавателей стала ключевой в исследовании. Учёные обнаружили: чем больше студенты могли экспериментировать, тем глубже понимали материал. Вместо скучных лекций студенты попадают в симуляции: оценивают работу чат-бота в клинике, настраивают систему распознавания животных в заповеднике или анализируют, почему алгоритм отказывает в помощи бездомным.

Курс строится на простой идее: чтобы понять ИИ, нужно почувствовать себя тем, кто с ним работает. Студенты примеряют роли различных профессий:

В проекте про здравоохранение студент становится инженером в медтех-компании и оценивает, можно ли доверять ИИ в диагнозах.

В экологическом сценарии - стажёр по компьютерному зрению, который выбирает модель для подсчёта животных.

В социальном проекте - сотрудник службы поддержки жилья, принимающий решения о помощи семьям на основе прогнозов ИИ.

Очень хорошо, что студенту приходится искать ответ, - отметил один из преподавателей. Это не пассивное потребление информации, а активное участие.

Что это значит для образования? Сегодня 66% девушек на технических курсах теряют уверенность из-за требований программирования, но исследование доказывает: ИИ-грамотность - это не только код.

Это:

• Умение задавать правильные вопросы алгоритмам.

• Понимание последствий автоматизации в разных профессиях.

• Способность видеть этические дилеммы и находить компромиссы.

Как резюмировал один из преподавателей: После этого курса мои студенты-педагоги перестали бояться ИИ. Они начали спрашивать: "А как это повлияет на моих будущих учеников?".

Как внедрить эти подходы

Исследователи из Карнеги-Меллон не просто разработали теорию - они создали конкретную методологию, которую преподаватели могут адаптировать под свои дисциплины. Вот как это сделать:

Начните с реальных кейсов вашей отрасли Представьте, что вы преподаете журналистику. Вместо абстрактных уроков об ИИ, создайте сценарий, где студенты должны оценить, можно ли доверять генерируемым новостям от нейросети. Пусть они анализируют признаки подделки, проверяют источники и принимают решение о публикации - как настоящий редактор.

Или преподаете психологию? Разработайте задание, где студенты выступают в роли консультантов, оценивающих этичность использования ИИ в терапии. Какие границы нельзя переступать? Когда автоматизация помогает, а когда вредит?

Главное это связать технологии с профессиональной реальностью студентов. Как отметил один из участников исследования: Когда ты видишь, как ИИ влияет на твой будущий труд, ты начинаешь относиться к этому серьезно.

Создайте безопасное пространство для ошибок В проекте с медицинским чат-ботом преподавателям нужно было специально взламывать систему - находить способы вытянуть конфиденциальные данные пациентов. Это показывает: ошибки -не провал, а инструмент обучения.

Мне нравится, что ошибки здесь - часть пути, — признался один из инструкторов. Но хорошо бы предупреждать студентов: "Да, это займет время. И это нормально".

Практически каждый преподаватель в исследовании подчеркивал важность психологической безопасности в обучении. Когда студенты знают, что могут ошибаться, они глубже погружаются в материал.

Настройте уровень поддержки Одна из главных сложностей - найти баланс между свободой исследования и необходимой поддержкой. Исследователи обнаружили: слишком много автономии иногда превращается в хаос.

Когда различия между случаями минимальны, студенты начинают чувствовать, что просто угадывают ответ, - честно признали преподаватели.

Чтобы этого избежать, внедрите систему постепенных подсказок:

Сначала дайте открытую задачу

Предоставьте чек-лист вопросов для рефлексии

Если студент застрял - предложите пример решения похожей задачи

В крайнем случае - покажите правильный ответ с объяснением

Подсказки не ограничивают автономию, — объяснил один из инструкторов. — Они помогают оставаться в процессе.

Используйте ролевые игры для понимания разных точек зрения В одном из проектов студенты взаимодействовали с виртуальными коллегами: техническим руководителем и менеджером проекта. Каждый персонаж давал разную информацию, отражая реальные рабочие конфликты между техническими возможностями и бизнес-целями.

Это учит не только алгоритмам, но и диалогу между специалистами, — резюмировал преподаватель из бизнес-школы.

Один из преподавателей предложил простой способ оценки: Попросите студентов через месяц после курса объяснить, как ИИ повлияет на их будущую профессию. Если они говорят конкретно, а не абстрактно, то метод работает.

Практический результат

После экспериментов с программой преподаватели сообщили о значительных изменениях в студентах:

• Рост уверенности в обсуждении ИИ даже у гуманитариев

• Умение критически оценивать технологические новинки

• Понимание ограничений алгоритмов в разных профессиях

• Осознание этических последствий автоматизации

Как отметили исследователи Карнеги-Меллон, технологии должны служить людям, а не наоборот. Этот подход особенно важен сегодня, когда искусственный интеллект все глубже проникает в нашу профессиональную и личную жизнь