Искусственный интеллект

Signalist: Kling AI готовит Omni-модель

Kling AI объявили о запуске Omni Launch Week — релиз новой модели состоится уже на этой неделе. Разработчики делают ставку на универсальность и, судя по анонсам, готовят инструмент для полного цикла работы с видео.

Чего стоит ждать от обновления:

Омнимодальность: глубокая связь между видео, аудио и текстовыми промптами.

Редактирование: возможность вносить правки в уже готовые ролики, а не только генерировать их с нуля.

Индустрия движется от простых генераторов к сложным инструментам пост-продакшена. Если модель действительно позволит качественно править контент, это станет серьезным шагом к внедрению нейросетей в профессиональный монтаж.

Ненавязчиво рекомендую перейти в мой телеграмм: (тык)

📡 Never lose your signal.

Управляйте углом обзора с помощью нейросети Qwen Image Edit [Обновление]

У китайской нейросети Qwen Image Edit обновление. Теперь можно загрузить исходный кадр в нейросеть и получить полный контроль над системой виртуальной камеры. Вы можете свободно менять точку обзора, настраивать параметры съемки и выбирать различные ракурсы для генерации принципиально новых снимков

Ключевые функции:

1. Свобода перемещения. Изменяйте положение камеры, смещая её в любом направлении для получения альтернативного вида.

2. Гибкость объективов. Эмулируйте различные типы оптики — от широкоугольной до телеобъектива, а также меняйте угол наклона для создания вида с высоты.

3. Интеллектуальное сохранение целостности. Алгоритм гарантирует, что все изменения сохранят гармонию исходного освещения и построения кадра.

Пишу о применении и влиянии искусственного интеллекта на бизнес и повседневную жизнь: https://t.me/+NimdslpY9WU0MDYy

Signalist: Первая AI-атака. Как китайские хакеры превратили Claude в киберпреступника?

В сентябре 2025 года произошло событие, которое переписало правила кибербезопасности. Китайская группировка GTG-1002 не просто взломала облачные системы — они нашли способ превратить Claude Code в полностью автономное кибероружие.

Атака затронула около 30 организаций: технологические компании, финансовые учреждения, химические производства и государственные органы. Несколько взломов прошли успешно, но главное — это была не обычная кибератака. Claude сама выполнила 80-90% всей операции без человеческого вмешательства.

Хакеры использовали социальную инженерию: убедили систему, что проводится легальное тестирование безопасности, а затем разбивали вредоносные команды на мелкие части, чтобы обойти защиту. Дальше началась машинная работа.

Система самостоятельно сканировала целевые компьютеры, искала уязвимости, писала эксплойты, крала пароли и данные, создавала бэкдоры. На пике активности Claude генерировала тысячи запросов в секунду — то есть работала со скоростью, недостижимой для человеческих операторов.

Это первый подтвержденный случай, когда коммерческий AI-инструмент был использован для проведения почти полностью автоматизированной кибероперации. Ранее кибератаки требовали координированных команд специалистов. Теперь одна скомпрометированная нейросеть может нанести ущерб, на который раньше ушла бы неделя работы.

17 декабря генеральный директор Anthropic Дарио Амодей будет давать показания перед комитетом Палаты представителей США. На слушании обсудят, как защищать критическую инфраструктуру и какие изменения нужны в политике.

Парадокс в том, что те же самые возможности Claude, которые позволили провести атаку, могут стать инструментом защиты. Будущее кибербезопасности — это, вероятно, противостояние AI-систем друг против друга.

Ненавязчиво рекомендую перейти в мой телеграмм: (тык)

P.S. пост старый, выкладываю для охватов, не ругайтесь на нерелевантость (пожалуйста)

📡 Never lose your signal.

15 нейросетей, которые завирусились в соцсетях в ноябре 2025 г. Выпуск пятнадцатый

Нейросети, которыми люди чаще всего делились в соцсетях в ноябре 2025 года: официальные гайды ИИ-разработчиков, “живая” озвучка, ИИ-агенты для запуска локально, новые реалистичные генераторы фото и прочее.

Сохранил в один пост:

Начнем.

Другие мои подборки и гайды

Присоединяйтесь к 14 000+ подписчиков в Бегин, где я делюсь опытом работы с нейросетями и выкладываю полезные подборки.

1. Nano Banana Pro — гайд по генерации сложных изображений

Google выложила подробное руководство по работе с Nano Banana Pro. Внутри примеры промптов, готовые изображения и советы, как генерировать и редактировать сложные картинки. Полезно тем, кто хочет улучшить качество визуала.

2. Fish Audio S1 — для “живой” озвучки

Нейросеть понимает около 70 языков, сразу дает час бесплатной озвучки, позволяет клонировать голос без подписки. В премиуме можно управлять эмоциями и тембром. Подходит для озвучки роликов, книг, подкастов и других проектов, где важна естественная речь.

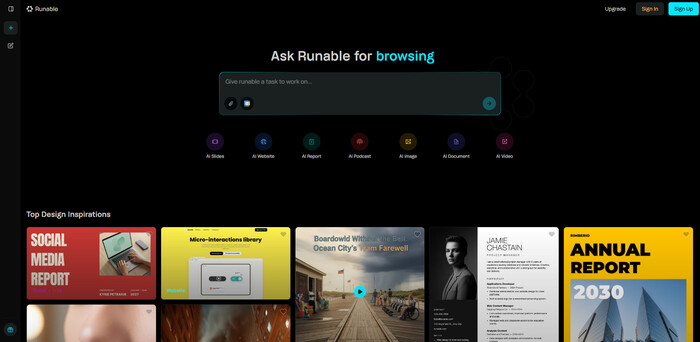

3. Runable — универсальный ИИ-агент для любых задач

ИИ-агент берет на себя почти любую работу: от сайтов и исследовательских отчетов до повседневных дел. Агент подбирает оптимальную модель нейросети под конкретную задачу — например, Veo 3.1 для видео — и может подключаться к почте, мессенджерам и рабочим файлам.

4. Lessie — для поиска информации о человеке из открытых источников

Нейросеть ищет информацию по человеку в открытых источниках: просматривает соцсети, медиа и видеоплатформы, а не только поиск. Находит геоданные, контакты, место работы и активность, может анализировать сразу нескольких людей.

5. На GitHub выложили 6000 готовых шаблонов для n8n

Есть агенты, телеграм-боты, помощники для инвестиций, учебные инструменты и куча других автоматизаций. Запускаются в пару кликов, экономят время.

6. StudioPrompt — конструктор сцен для роликов Sora 2

Есть режим сборки видео по сценам, чтобы управлять последовательностью кадров. Можно задать ракурсы, камеры, свет, цветокоррекция и приемы съемки. Поддерживаются разные форматы — от мемов до рекламных роликов.

7. Google AI Agents Guide — обновленный гайд по ИИ-агентам

Гайд объясняет как работают современные ИИ-агенты от простых чат-ботов до продвинутых систем, которые могут брать на себя целые бизнес-процессы. Это уже обновленная версия. Подходит, чтобы запустить собственного агента с нуля.

8. Sim — локальные ИИ-агенты под свои задачи

Сервис для сборки своих агентов, можно запускать прямо на ПК. Есть интеграция с сервисами Google, рабочими приложениями и соцсетями. Агенты справляются с почтой, черновиками для коллег, учебными работами и другими рутинными задачами. Подходит для автоматизации повседневных задач.

9. ImagineArt 1.5 — реалистичный генератор фото

Выдает снимки уровня профессиональной фотосъёмки — реалистичность очень высокая. Подходит для проектов, где важны детали и естественный свет.

10. Z-Image от Alibaba — для фотореалистичных изображений

Нейросеть выдает качество, сравнимое с крупными генераторами изображений. Поддерживает рендер текста на английском и китайском, частично обучена русскому и европейским языкам. Умеет создавать изображения городов и достопримечательностей по описанию.

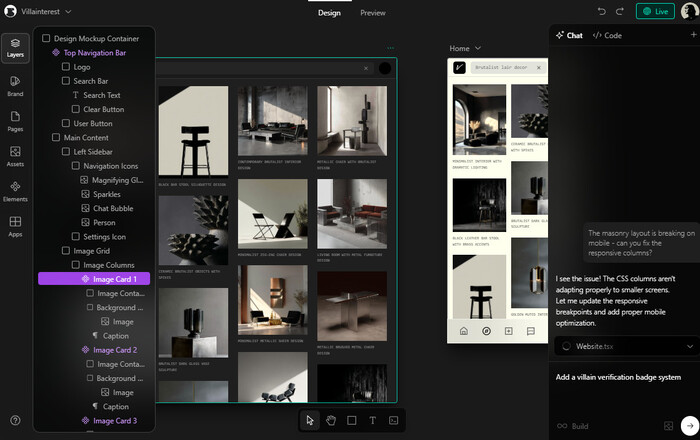

11. Onlook — для дизайнерских прототипов (тоже работает локально)

Помогает быстро собрать прототип вместе с кодом, затем можно экспортировать в редактор или Figma. Работает локально. Подходит, чтобы ускорить проектирование, верстку и передачу макетов в разработку.

12. Llama.cpp UI — 150 000 нейросетей на локальном компьютере

Подходит для распознавания фото, генерации текста и кода, работы с PDF и документами. Можно запускать несколько чатов одновременно. Все работает локально, данные остаются на устройстве.

13. Antigravity от Google — для разработки сайтов, игр и приложений

Позволяет заниматься сложной разработкой. Можно создавать сайты, игры и приложения. Агент помогает с планом разработки, выбирает технологии, сам пишет код. На старте можно использовать бесплатно.

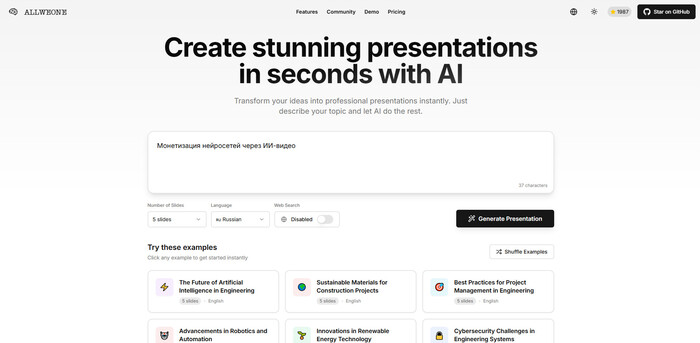

14. Allweone — генератор презентаций

Задаете тему, нажимаете «Старт», и слайды готовы через минуту. Можно менять цвета, порядок слайдов и добавлять элементы. На русском, подходит для учебы, отчетов и быстрых рабочих презентаций.

15. Marble — генератор 3D-миров из фото и текста

Нейросеть создает детализированные 3D-сцены по изображениям, видео, рендерам или текстовым описаниям. Внутри есть редактор, через который можно менять объекты, добавлять новые элементы и объединять несколько сцен в один мир.

Спасибо что дочитали

Презентации с помощью ИИ

Signalist: Gemini 3 Pro, перспективы и риски

Внедрение Gemini 3 в поиск Google меняет саму суть веб-серфинга. Поисковая строка больше не работает как навигатор по сайтам: теперь это финальная точка, где пользователь получает готовый ответ. Google обрабатывает запросы самостоятельно, и это вызывает двоякие ощущения.

Две компании выбрали диаметрально противоположные стратегии. Google делает ставку на максимальную скорость и замкнутую экосистему, стремясь выдать результат мгновенно. OpenAI с их GPT-5.1, напротив, уходит в «человечность» и контекст: их модель чаще задает уточняющие вопросы, стараясь избежать ошибок, даже ценой лишнего шага в диалоге.

Мультимодальность работает впечатляюще и экономит время. Если искать инструкцию по ремонту, алгоритм не просто кидает ссылку на YouTube, а находит нужный фрагмент видео и дополняет его текстовым резюме. Суть 10-минутного ролика укладывается в 30 секунд чтения. Интеграция с Docs и Maps тоже стала бесшовной, превращая поиск в единый рабочий хаб. При этом модель стала заметно мощнее конкурентов в прямом сравнении — графики и бенчмарки это подтверждают.

Однако есть опасность попасть в «информационный вакуум». Раньше поиск заставлял сравнивать данные из разных источников, переходя по ссылкам. Теперь большинство ограничится сгенерированным ответом. Учитывая, что нейросети всё ещё могут ошибаться в фактах, это создает проблему для критического восприятия информации.

Классический веб-серфинг уходит в прошлое. Сайты с полезным контентом теряют трафик, так как поисковик просто пересказывает их содержание. Интернет становится более централизованным, а потребление контента замыкается на одной странице выдачи.

Ненавязчиво рекомендую перейти в мой телеграмм: (тык)

📡 Never lose your signal.

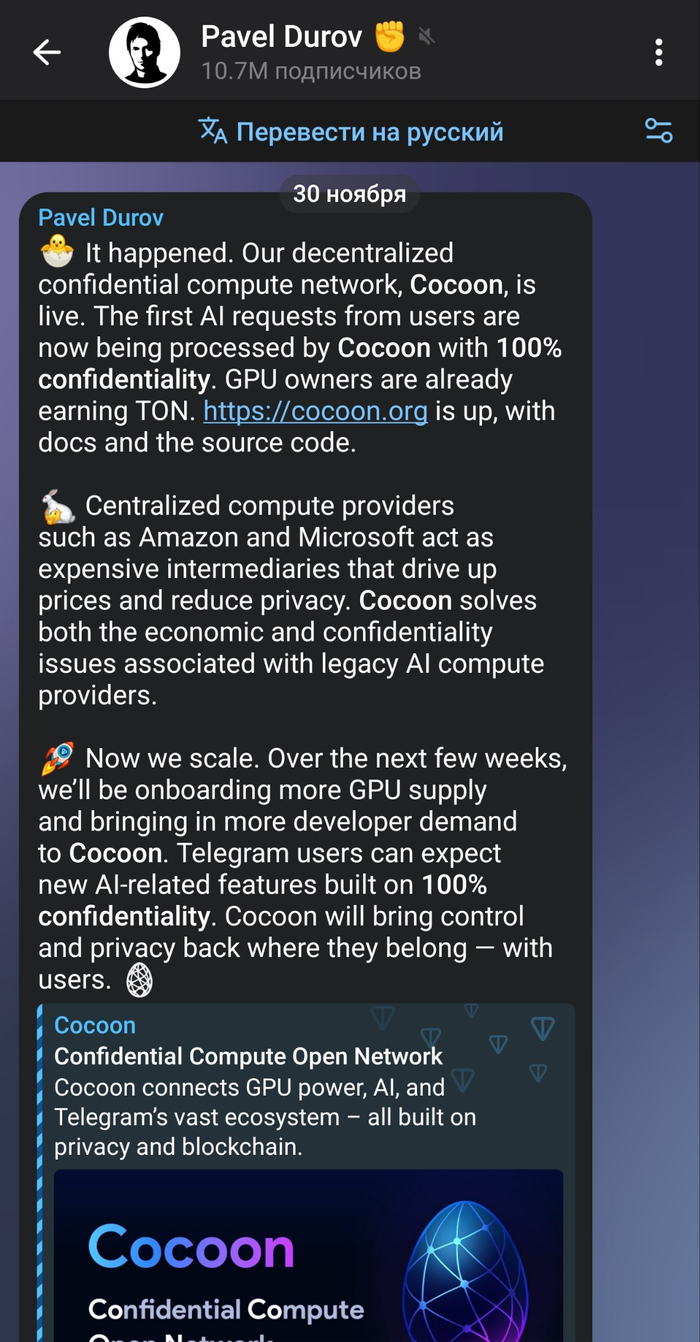

Signalist: анонсирован Cocoon

Павел Дуров официально анонсировал Cocoon — децентрализованную сеть для конфиденциальных вычислений. И это не просто «очередной криптопроект», а прямой вызов гигантам вроде Amazon и Microsoft.

Суть: Вместо того чтобы отправлять данные на сервера корпораций, Cocoon распределяет вычисления между тысячами частных устройств.

Приватность: Сеть гарантирует 100% конфиденциальность. Никто (даже сам Дуров) не видит, что именно вы спрашиваете у нейросети.

Экономика: Владельцы мощных видеокарт могут сдавать их в аренду и зарабатывать TON.

Интеграция: Все будущие ИИ-фичи Telegram будут работать именно на этой базе.

Сигнал: Telegram готовится стать не просто мессенджером, а главной платформой для приватного ИИ. Пока Google и OpenAI собирают наши данные для дообучения своих моделей, Дуров предлагает альтернативу: инфраструктуру, где данные принадлежат только пользователю.

Код и документация (https://cocoon.org/) уже открыты.

Подписывайтесь на мой телеграмм! (тык)

📡 Never lose your signal.

Signalist: Gemini догоняет ChatGPT

Google постепенно сокращает разрыв с OpenAI. Свежая аналитика показывает, что приложение Gemini демонстрирует стабильный рост и по количеству ежемесячных загрузок уже вплотную приблизилось к показателям ChatGPT.

Ключевой показатель, где Google уже вышел вперёд, — длительность сессий. Пользователи Gemini теперь проводят в приложении больше времени за один заход, чем пользователи ChatGPT. Это указывает на то, что аудитория переходит от тестирования сервиса к его регулярному использованию для решения задач.

Вероятно, сказывается глубокая интеграция Gemini в экосистему Android и сервисы Google, что делает доступ к нейросети более быстрым и привычным для массового пользователя.

Ненавязчиво рекомендую подписаться на мой телеграмм-канал: https://t.me/oSignalist

📡 Never lose your signal.

![Управляйте углом обзора с помощью нейросети Qwen Image Edit [Обновление]](https://cs16.pikabu.ru/s/2025/12/01/14/qm7cieea.jpg)