Сможете найти на картинке цифру среди букв?

Справились? Тогда попробуйте пройти нашу новую игру на внимательность. Приз — награда в профиль на Пикабу: https://pikabu.ru/link/-oD8sjtmAi

Экспериментирую с 360 камерой. Часть 2

В прошлом посте я показал оригинальную работу, снятую на 360 камеру. Здесь же раскрываю секреты, как это была достигнута бесшовность съёмки.

Первая часть. Для кадра с коробкой мы использовали оригинальную селфи палку, которая вставлялась в паз жесткой конструкции внутри коробки. Так мы добились кадра, когда камера притрекана к коробке. Саму селфи палку камера умеет вычитать и затирать на видео. Ну и дополнительные артефакты я заклинапил на посте.

Вторая часть. Для того, чтобы иметь возможность перемещать камеру по салону, мы распечатили на 3d принтере короткую рукоятку, к которой приклеили сильный магнит. Сама рукоятка вставлялась в пазы селфи палки без магнита, поэтому ее легко можно было отсоединить. Это момент, когда я залажу в машину, достаю из пазов рукоятку и перемещаю по салону.

Третья часть. Магнит на рукоятке был нужен для соединения с дроном, который находился над люком. На днище дрона был прикреплен другой магнит. Магниты были подобраны той мощности, чтобы с одной стороны, не было рывка при присоединении, а со второй, вся конструкция не раскачивалась и не отвалилась при подъеме.

Четвертая часть. На 3d принтере была напечатана сфера, которую я подставил под знакомый многим многим "tiny planet" эффект у 360 камер. Конец дубля с этим эффектом повторяет начальную композицию кадра. Поэтому на посте мне оставалось только подогнать крупности объектов, чтобы они были идентичны и чуть поколдовать с цветом неба для более ровного сшития.

Если еще есть вопросы, задавайте.

Meta* представила новые ИИ-модели для обработки фото и видео

Корпорация Meta* анонсировала нейронные сети Emu Video и Emu Edit — инструменты на основе генеративного искусственного интеллекта для редактирования и создания контента.

Оба инструмента все еще находятся на стадии тестирования. Согласно заявлению, продукты уже демонстрируют потенциальную пользу для художников, аниматоров и других специалистов творческого направления.

Нейросеть обучалась в два этапа, что позволило инструменту реагировать на различные входные данные: «Сначала Emu Video создает изображения с учетом текстового запроса, а затем на его основе генерирует видео. Этот разделенный подход к генерации позволяет нам эффективно обучать модели для видеороликов», — объяснили в Meta*.

Emu Video способен генерировать видеоклипы на основе введенного текста и прикрепленных изображений в формате 512×512 с частотой 16 кадров в секунду.

Emu Edit позволяет удалять или добавлять фон на фото, выполнять преобразования цвета и геометрии, а также поддерживает локальное и глобальное редактирование.

ИИ обучен на наборе данных из 10 млн образцов, каждый из которых имеет входной вариант изображения и описание задачи, а также целевой результат.

Напомним, в августе корпорация анонсировала нейросеть AudioCraft, которая создает звуки и музыку по текстовому описанию. Про неё и то, как генерировать музыку с помощью ИИ, можете почитать в моей статье.

* - запрещённая в России организация.

Больше о нейросетях в источнике - Арт-нейросети от Nerual Dreming💫

Обновление Runway: Создавайте объемные видео прямо в браузере и приложении!

Runway научилась делать объемные видео. Теперь можно создавать захватывающие объемные видео с эффектом пролета камеры, не выходя из приложения или браузера. Встроенный видео редактор с возможностью настройки ключевых точек и фокусного расстояния делает этот процесс удивительно простым и интуитивно понятным.

Помимо этого, видеоредактор предлагает набор инструментов как для основного видеомонтажа, так и для продвинутой постобработки, позволяя пользователям работать над проектами непосредственно в веб-браузере. Это профессиональное программное обеспечение для видеомонтажа включает в себя возможности для создания визуальных эффектов, форматирования видео, коррекции цвета и многого другого.

Что еще крутого?

Кроме того, инструмент для редактирования видео с помощью ИИ от Runway использует инструменты машинного обучения для упрощения процесса видеомонтажа, предоставляя такие функции, как маски, цветокоррекция, композитинг, генерация и визуальные эффекты (VFX). Также есть функция динамического ключинга, которая может превратить видео в "зеленый экран" для быстрого редактирования. А еще автоматическое удаление фона, превращение текста в изображение и генерацию 3D-текстур, стирание и замену, отслеживание движения, маскировку "зеленого экрана", удаление шума и многое другое.

Помимо крутого ИИ-видеоредактора, у Runway есть GEN-1 - это новаторская модель ИИ, которая позволяет преобразовывать существующие видео в новые, используя текстовые запросы или образцы изображений. То есть можно изменить визуальный стиль существующих видеороликов и фильмов, применяя любой стиль.

Так же, у Runway есть одна из лучших нейросетей для генерации видео по текстовому описанию - GEN-2. В этом посте я подробно рассказала об этих двух нейронках, обработала отрывок из фильма Криминальное чтиво и создала альтернативное видео с героем Джона Траволты. GEN-2 шагнул вперед, и теперь там можно создавать крутые видео до 16 секунд. Как их делать я подробно рассказала в этом посте

Хотите узнавать первыми о полезных сервисах с искусственным интеллектом для работы, учебы и облегчения жизни? Подпишитесь на мой тг НейроProfit, там я рассказываю, как можно использовать нейросети для бизнеса

Ответ на пост «Что это?»

моя попытка замутить "че-нить эдакое" в блендере

Если вы профи в своем деле — покажите!

Такую задачу поставил Little.Bit пикабушникам. И на его призыв откликнулись PILOTMISHA, MorGott и Lei Radna. Поэтому теперь вы знаете, как сделать игру, скрафтить косплей, написать историю и посадить самолет. А если еще не знаете, то смотрите и учитесь.

SadTalker - Делаем LipSync в видео и оживляем изображения при помощи нейросети

SadTalker - нейросеть от китайских разработчиков, изначально предназначенная для анимации лиц на различных изображениях - от артов до фотографий. Ознакомиться с проектом подробнее можно на их GitHub

SadTalker VideoLip - это форк SadTalker, предназначенный для синхронизации движения губ на видео с аудиодорожкой. Исходный код проекта: GitHub

Обе программы работают на видеокартах от Nvidia и CPU. Но на CPU обработка может занять несколько часов.

Сегодня поговорим о портативных версиях обеих программ, которые я подготовил для вас.

Видеообзор и примеры готовых видео можно посмотреть на YouTube.

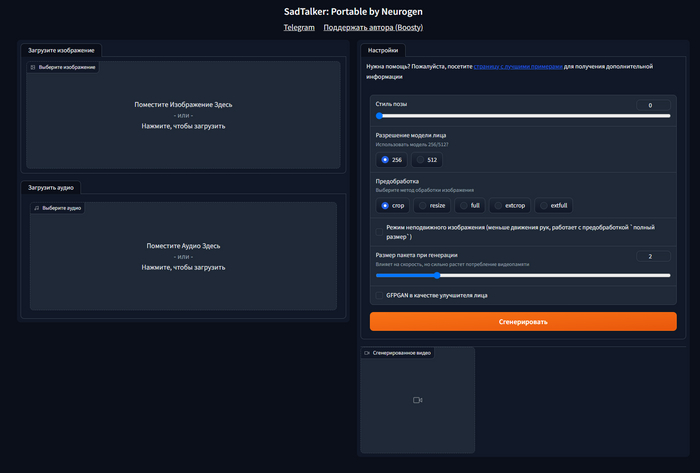

SadTalker

Интерфейс простой (представлен выше) и содержит следующие элементы:

Поле загрузки изображения

Поле загрузки аудио

Настройки:

Стиль позы: вариации анимации лица

Разрешение лица - чем больше, тем лучше итоговое качество. Увеличивает потребление видеопамяти

Предобработка влияет на то, в каком формате будет итоговое видео. Кроп - обрезает лицо до квадрата. Full оставляет видео таким каким вы его загрузили. При использовании Full крайне рекомендуется использовать "Режим неподвижного изображения"

Размер пакета (Batch Size) влияет на скорость обработки: выше - лучше - больше видеопамяти потребляется

GFPGAN улучшает качество лица на выходе.

Итоговые файлы сохраняются в папке results.

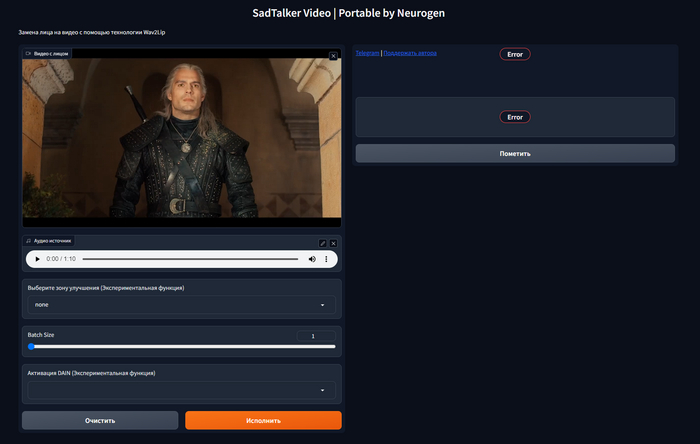

Интерфейс тоже достаточно прост. Он состоит из следующих элементов:

Поле загрузки видео

Поле загрузки аудио

Выбор режима улучшения (опционально). Можно улучшить качество губ или качество лица, но влияет на потребление видеопамяти и скорость обработки.

Batch Size. В теории - чем выше значение тем лучше, надо выбирать целые числа. Но по факту, чем больше - тем сильнее потребление памяти, а прироста скорости я особо не заметил.

DAIN - экспериментальная и нестабильная функция. Призван улучшить качество липсинка, путем дорисовки кадров.

После конца обработки, результат будет сохранен в папку results внутри папки с программой. Вам нужен будет файл, который заканчивается на full.

Как обычно, я подготовил портативные версии с запуском в 1 клик. Вам надо лишь скачать архив, распаковать и запустить bat файл с названием start.

Скачать их можно тут:

Яндекс Диск

Будущие обновления, а также другие портативные сборки различных нейронок можно найти в моем Телеграм канале.

Ну, а задать вопросы можно в нашем чате.