Разработчики китайской платформы Alibaba создали нейронку для оживления изображений

Анимация персонажей направлена на создание видеороликов с персонажами из изображений с помощью управляющих сигналов. Цветное очертание скелета, как в ControlNet, позволяет точечно задать и настроить движения объекта с фото.

В настоящее время Diffusion-модели стали основным направлением в исследованиях визуальной генерации благодаря их мощным возможностям. Чтобы сохранить согласованность сложных элементов внешнего вида с эталонным изображением, мы разрабатываем ReferenceNet для объединения деталей с помощью пространственного внимания.

Обзор процесса создания видео: последовательность поз первоначально кодируется с помощью Pose Guider и объединяется с многокадровым шумом, после чего система UNet выполняет процесс шумоподавления. Вычислительный блок системы UNet состоит из пространственного, перекрестного и временного внимания. Интеграция эталонного изображения включает в себя два аспекта. Во-первых, главные очертания извлекаются через ReferenceNet и используются для пространственного внимания. Во-вторых, остальные детали извлекаются с помощью кодера изображений клипов для перекрестного внимания. Темпоральное внимание работает во временном измерении. Наконец, декодер VAE декодирует результат в видеоклип.

Ждём релиза Animate Anyone!

Интересуешься нейросетями? Больше такого в источнике - 💫Арт-нейросети от Nerual Dreming

Про Paint помните?

Тот самый, где школьники когда-то мулевали на уроках информатики.

Он круто обновился и в него завезли Paint Cocreator — прокачанный DALLE-3, с помощью которого можно генерировать картинки.

Станет Фотошопом 2.0?

Каждый день в своем блоге Telegram я публикую интересные новости об интернет-культуре, разработках, технологиях, полезных сервисах и нейросетях!

Обновление Pika Labs 1.0 - бесплатный сервис для генерации видео из текста

Встречаем обновление бесплатного сервиса для анимации и видео - Pika и залипаем на трейлер:

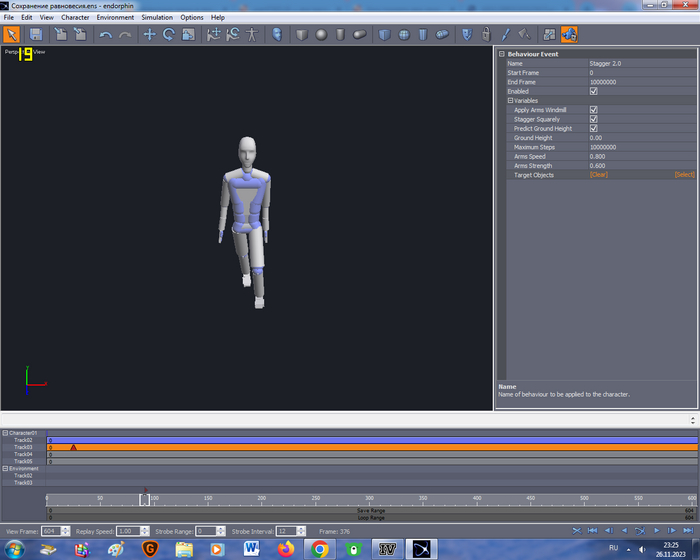

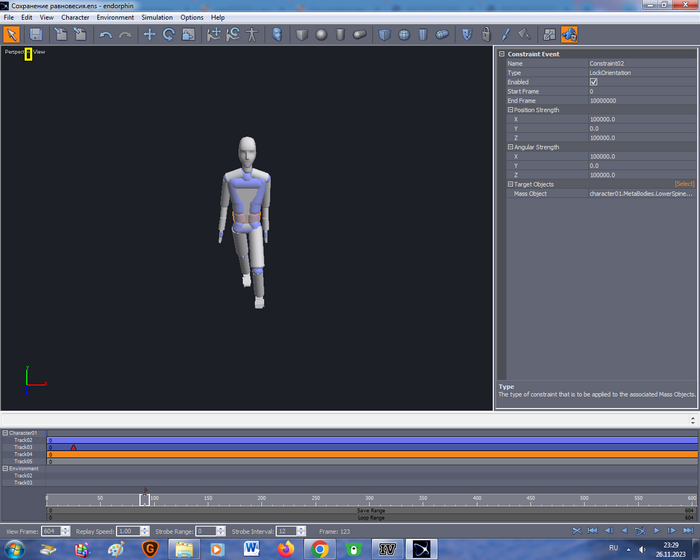

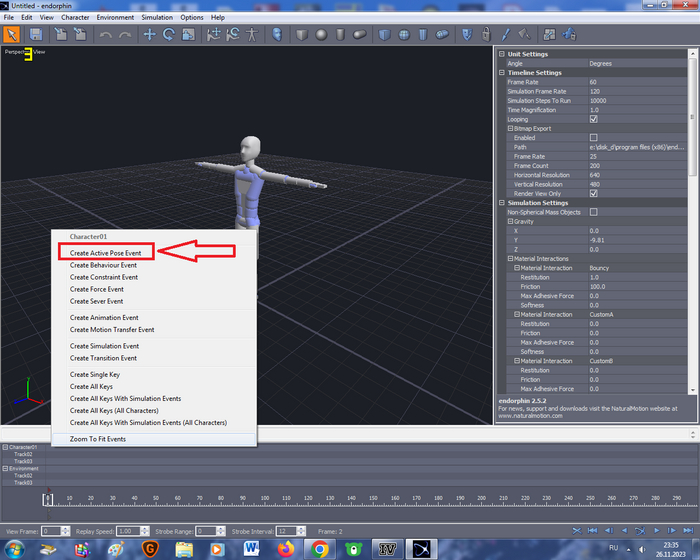

Эффективное сохранение равновесия в программе Endorphin 2.5.2 как в GTA 4

Кадры из Gta 4(хватание за место попадания можно легко добавить. Я этого не сделал чтобы показать вам как можно сделать, а уже какие действия персонаж должен сделать вы сами сможете придумать, и ещё вы можете сами решить когда персонаж должен будет упасть):

Endorphin — это программный пакет для динамического синтеза движений, разработанный NaturalMotion . Эндорфин можно использовать для создания компьютерных симуляций большого количества независимых персонажей, взаимодействующих друг с другом и с миром в соответствии с краткими сценариями или «поведениями». Он сочетает в себе физику, искусственный интеллект и генетические алгоритмы для создания реалистичной анимации. В отличие от Euphoria , также разработанной NaturalMotion, Endorphin — это не движок, а инструмент 3D-анимации для Microsoft Windows.

В Endorphin 2.5.2 можно загружать собственных персонажей например монстров, пришельцев и собственные объекты например танк, самолёт, вертолёт и т.д.

Длина записи анимации 5 тысяч кадров.

Заранее сделанные анимации можно соединить с симуляцией например персонаж будет идти по анимации, а его руки будут вести себя по симуляции в той позе в которую вы их поставили в Endorphin.

Добился я этого с помощью:

1) Поведения Stagger 2.0.

Значок поведений:

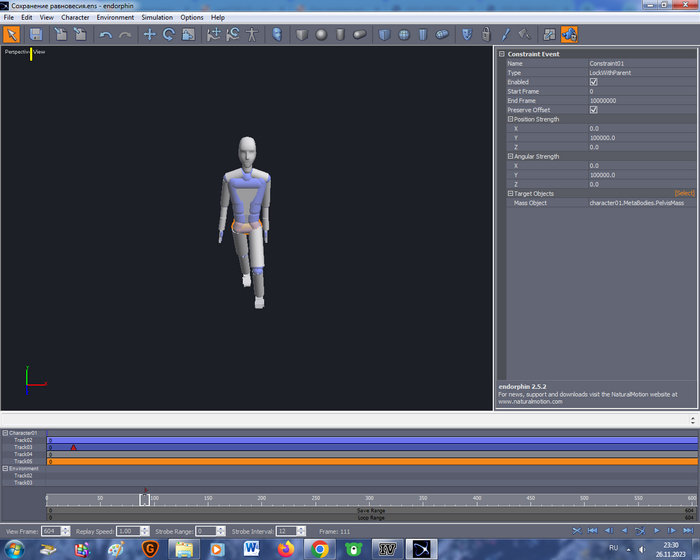

2) Constraint 1.

Значок Constraint:

И Constraint 2.

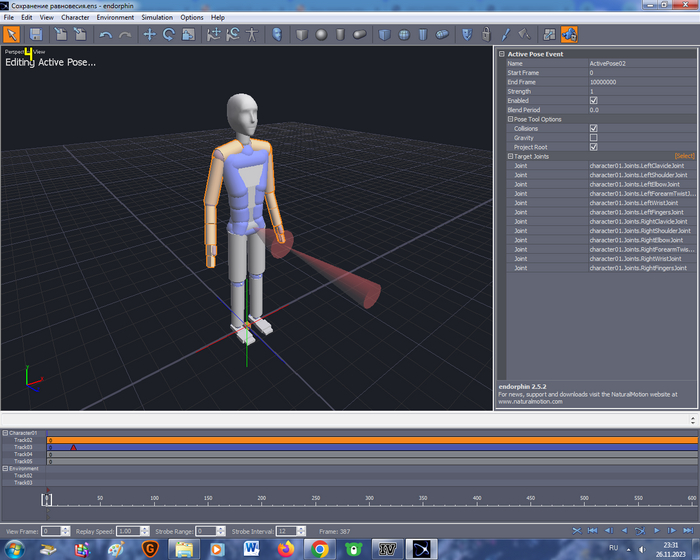

3) Активная поза:

Параметры в правом углу. И И И самое главное надо используя Select с зажатым шифтом выбрать только руки как показанно на фото.

4) Сохранение анимации:

Доработанная за несколько секунд версия анимации:

Бесплатно скачать Endorphin 2.5.2 можно по этим ссылкам:

Яндекс диск: https://disk.yandex.ru/d/rz13Hk8uAiOv1A

Лучшая нейросеть для генерации видео БЕСПЛАТНО

Stability AI представила модель для генерации видео по тексту Stable Video Diffusion. Она основана на модели изображений Stable Diffusion.

Проще говоря, если вы хотите сделать видео, но у вас нет камеры или актеров, вы можете ввести описание того, что хотите увидеть, и модель превратит ваши слова в видеоклип.

Этот инструмент может быть очень полезен для разных людей: журналистам он поможет сделать репортажи без выезда на место, учителям - создать обучающие видео, рассказывающие о сложных вещах простым и понятным языком, а рекламщикам - визуализировать продукты и услуги для клиентов.

Важно то, что компания сделала эту программу открытой, то есть любой желающий может ей пользоваться и даже улучшать ее.

Модель уже лежит в открытом доступе на GitHub, так же можно попробовать на huggingface

Stable Video Diffusion выпущена в двух вариантах: для генерации видео в 14 и 25 кадрах в секунду. Говорят, что модель обходит конкурентов с закрытым кодом от Runway и Pika Labs.

Подробнее про Runway я рассказывала в этом посте

Про модели Runway GEN-1 GEN-2 в этом посте

Как сделать видео в Runway GEN-2 я подробно рассказала в этом посте

Как бесплатно сделать видео в нейросети Pika Labs я показывала в этой статье

Вскоре Stability AI запустит сайт для генерации видео, доступ к которому будет выдаваться через лист ожидания.

Хотите узнавать первыми о полезных сервисах с искусственным интеллектом для работы, учебы и облегчения жизни? Подпишитесь на мой тг НейроProfit, там я рассказываю, как можно использовать нейросети для бизнеса

AI антиутопия GEN-2 и Pika Labs: Тайны Футуристического Метрополиса

Перевела с помощью нейросети ElevenLabs

Ролик, сделан в нейросети GEN-2 и Pika Labs, автор Aze Alter, оригинал на YouTube

Как сделать видео в нейросети GEN-2 я показывала в этой статье

Как сделать видео в нейросети Pika Labs я показывала в этой статье

Хотите узнавать первыми о полезных сервисах с искусственным интеллектом для работы, учебы и облегчения жизни? Подпишитесь на мой тг НейроProfit, там я рассказываю, как можно использовать нейросети для бизнеса

Поиграем в бизнесменов?

Одна вакансия, два кандидата. Сможете выбрать лучшего? И так пять раз.

Танцор-путешественник - AI Анимация

Телеграм - 🎥Text2Video