Полное погружение в виртуальную реальность

Новейшие технологии дошли полного реализма в шутерах - передают реальную отдачу и даже эффект от ослепляющей гранаты. Апл вижин про летит в помойку.

Новейшие технологии дошли полного реализма в шутерах - передают реальную отдачу и даже эффект от ослепляющей гранаты. Апл вижин про летит в помойку.

Nvidia - одна из ключевых компаний мира прямо сейчас. Существует популярное мнение, что они просто везунчики, которые всегда оказываются с нужным продуктом в нужное время. Однако, если историю развития этой компании, то станет отчетливо видно, что эти ребята умеют мастерски конкурировать, делают полезные выводы из провалов и отлично "ловят волны". Сегодня разберемся, как им это удается.

Главный секрет Nvidia в том, что её основатель ходит с стильной кожанке. Спасибо за внимание. Ладно, шучу, сейчас во всем разберемся.

Nvidia обогнала по стоимости Saudi Aramco, и теперь выше детища Дженсена Хуанга лишь Microsoft да Apple. Microsoft за последние годы ИИ-бума влезли в очень плотную зависимость от чипов Nvidia, из-за чего сейчас экстренно пилят собственную замену. Apple же слез с чипов Nvidia в 2010-х, но, уверен, у Nvidia неплохие шансы пободаться и с этим гигантом.

Возможно, кто-то спросит "Аффтар, почему ты так уверено назвал Nvidia главной компанией нашего будущего?". Отвечу: "Потому что Nvidia продает те самые пресловутые лопаты современным золотоискателям. А это самая надежная и устойчивая бизнес-стратегия независимо от эпохи и контекста".

Ладно, к делу. Изучая материалы про Nvidia, я регулярно сталкивался со следующим лейтмотивом:

"Да просто чуваки каждый раз оказывались вовремя с востребованным продуктом. Они просто крайне везучие".

Так вот, если компания умудряется несколько раз подряд оказаться с востребованным продуктом (причем, самым популярным на рынке, или одним из самых) в нужные моменты времени, то это означает, что у компании офигеть какая мощная стратегия, а СЕО - крутой визионер.

Поэтому, в этом материале я хочу не просто рассказать историю развития компании и основные этапы её развития. Но также понять, как Дженсену и ко. удавалось делать настолько верные и точные стратегические ставки. А еще, по ходу дела расскажу, что же за продукцию такую производит эта Nvidia, что на неё всегда есть устойчивый спрос в самых разных индустриях и сегментах рынка.

Disclaimer. История Nvidia - это большой и яркий путь с россыпью крутых бизнес-решений. Так что, я поделю материал на две части. Сегодня расскажу, как из небольшого перспективного "стартапа из кафешки" Nvidia превратилась в важнейшего производителя железа для современной технологических отраслей. А во второй части (coming soon) мы разберемся, как Nvidia из просто крупной и важного игрока превратилась в главную компанию будущего, которая (очень возможно), скоро станет самой дорогой корпорацией в истории.

Думаю, многие из вас слышали историю, как Дженсен Хуанг, Крис Малаховски и Кертис Прэм сели за столик в дешевой кафешке в Сан-Хосе и стали думать, какая технология станет the next big thing в этом мире. Еще ходит байка, что эта забегаловка была в таком суровом районе, что в её стенах зияли дырки от гангстерских пуль.

Последний факт, наверно, должен был символизировать стартаперский дух начинания, но на самом деле все трое фаундеров на тот момент уже были состоявшимися взрослыми спецами. Например, наш главный герой трудился руководителем направления в LSI Logic - довольно крупном производителе интегральных схем, а два других партнера инженерили в Sun Microsystems (эту компанию позже поглотит Oracle). В общем, ребята были весьма матерыми профи, а не какими-то оборванцами, бросившими колледж ради стартапа в гараже.

Приятели сходились во мнении, что компьютерная отрасль только набирает обороты, и что в самое ближайшее время машины будут использоваться для все более широкого спектра вычислительных задач. А значит, центральным процессорам (CPU) явно понадобится помощь. Эта помощь называется аппаратное ускорение вычисления.

В двух словах. CPU - это такой "мозг компьютера". Он обрабатывает сигналы и распределяет вычислительные команды. А теперь представьте, что вам на работе подкинули 10-20 задач одновременно. Что случится с вашим мозгом? Правильно, он "перегреется" и вы поймаете мощный приступ прокрастинации (=зависнете). То же самое и с центральным процессором компьютера, который должен выполнять все больше и больше задач одновременно.

Так вот, элементы аппаратного ускорения - это такие вспомогательные мини-мозги, призванные разгрузить основной мыслительный центр.

Без этих штук мы едва бы смогли параллельно запустить на ноутбуке несколько вкладок браузера, эксель, фотошоп, Телегу, и игру в отдельном окошке.

Кстати, на счет игр. Дженсен, Крис и Кертис не сомневались, что за аппаратным ускорением будущее. Оставалось лишь выбрать направление внутри этого тренда. Решили, что это будет гейминг. Если конкретнее, то их особенно привлекала бурно развивающаяся 3D-графика для этого самого гейминга. Продвинутый графон - это штука энергозатратная, вычислительные мощности она жрет как конь. Так что, друзья решили софкусироваться на графических процессорах (GPU).

В 1995 г. Nvidia выпустила свой первый продукт - мультимедийную видеокарту NV1.

NV1 отличалась от аналогов тем, что на одной плате размещалось сразу несколько модулей - блок обработи 2D-графики, ускоритель 3D-графики, звуковая карта и порт для игрового геймпада приставки Sega Saturn. Кстати, в рамках этой карты Nvidia сотрудничала с Sega, что позволило портировать некоторые популярные эксклюзивы для этой консоли на ПК.

Нужно отметить, что Nvidia - это fabless (=fabricless) company, т.е. компания без своего производства. По сути, это просто конструкторское бюро. Очень большое и крутое конструкторское бюро! Они всего лишь (ну, если сравнивать с полноценной сборкой) придумывают и разрабатывают свои технологии и продукты, а непосредственной изготовкой занимаются подрядчики по контракту. Например, первый чип NV1 для Nvidia производила компания SGS Thomson-Microelectronics на своем заводе во Франции. Сейчас, конечно, у Nvidia есть кое-какие собственные производственные мощности, но львиная доля производства все равно происходит на стороне - например, с помощью тайваньских компаний.

В итоге NV1 стал прорывом и принес компании известность... хотелось бы мне написать. Но нет, он провалился! Да-да, история третьей по стоимости компании в мире началась с провала.

Дело в том, что NV1 был больше всего заточен на игровую консоль Sega. А в те годы происходит бум ПК-гейминга. Большинство ПК же работает на операционной системе Microsoft. NV1 вышел в мае 1995, а уже в сентября Microsoft представил свой API под названием DirectX.

Если упрощенно, DirectX - это специальный модуль, позволяющий разработчикам задействовать все мощности железа без написания специального кода под каждый элемент комплектующих.

Помните, большинство игрух на ПК в конце 1990-х и начале 2000-х требовали вместе с установкой самой игры поставить DirectX?

Так вот, принцип ускорения графики у чипсета NV1 принципиально расходился с таковым у DirectX. Следовательно, первый продукт Nvidia оказался принипицально несовместим с подавляющим большинством игр, которые геймеры ставили на ПК!

А учитывая, что в создание NV1 стартап бахнул почти все первые привлеченные инвестиции (первый раунд был 10 миллионов долларов - довольно серьезная сумма по тем временам), это был epic fail. Хуангу даже пришлось сократить половину сотрудников, которых к тому моменту уже успели нанять... Был момент, когда у Nvidia хватало денег всего лишь на один месяц зарплат. Тогда родился негласный девиз компании: "У нас есть всего лишь 30 дней, чтобы продолжать делать бизнес".

Так что, да, в начале своего пути сооснователи получили довольно мощный апперкот от жестоких реалий рыночной экономики.

Впрочем, Nvidia сделала правильные выводы. С пор они редко промахивались с трендами рынка, особенно в сегменте ПК.

Интересный факт. Первые годы у Nvidia не было названия. В рабочих переписках компания называла свои первые продукты "NV" - Next Version. Ну типа, новая версия этих ваших видеокарт. Когда компания развилась до такого масштаба, что без названия уже было сложно, основатели решили открыть словарь и найти что-то прикольное из похожего на NV. В итоге остановились на слове "'invidia"', что на латыни значит... "зависть". Да-да, тот самый дух неуёмной конкурентной борьбы, который позже проявился в схватках с 3dfx, ATI, AMD и другими крутыми компаниями.

Есть такой миф, что Nvidia придумала видеокарты. На самом деле, это не так. Первый графический видеоадаптеры с поддержкой 3D-графики еще в бородатом 1982 году запилила IBM. Чуть позже многие другие компании выпустили свои версии. Однако первые версии были очень дорогими и не слишком производительными. В общем, узкоспециализированная история для избранных.

Действительно массовые, доступные, универсальные и широкосовместимые 3D-видеокарты появились во второй половине девяностых. Первый образец выпустила та же IBM в 1995 г., был еще чипсет S3 ViRGE от компании S3 Graphics (сейчас принадлежит тайваньской HTC). Еще было сразу несколько популярных моделей от компании Matrox, да и японцы из Yamaha тоже что-то делали... В общем, хотя океан еще не был алым, он уже стремительно краснел.

В 1996 г. на рынок выбрасывается сразу несколько успешных моделей, но настоящий прорыв происходит, когда компания 3dfx выпускает свой 3D-ускоритель под названием Voodoo Graphics.

3dfx специализировалась на графике для игровых автоматов, и их чип выдавал скорость и качество рендера, близкое к автоматам. Тогда это была вершина крутости. К тому же, их карты хорошо совмещались с ПК-играми.

Справа - графон в Quake 1 на чипсете Voodoo, слева - без оного. Как говорится, почувствуйте разницу.

Короче говоря, это был очень крутой 3D-ускоритель, который быстро завоевал популярность. Сначала среди производителей видеокарт, а позже и среди геймдев-компаний, которые целенаправленно начали оптимизировать графон своих проектов под него.

В 1998 г. 3dfx выпустила чипсет Voodoo2, который был еще производительнее первой версии. И вот с этой штукой Nvidia пришлось конкурировать. Скажу сразу, Nvidia выиграла, а позже вообще выкупила 3dfx, интегрировав к себе их наработки. Как же им это удалось?

Если вычленять самую суть, то более массовый и простой продукт победил более продвинутый. В общем, классика. Voodoo2 показывал исключительную производительность и качество текстур, к которым не могли приблизиться конкуренты. Однако Nvidia выпустил свой новый продукт - NV4, также известный как Riva TNT. Дело в том, что поверх набора ускорителей Voodoo2 нужно было отдельно прикрутить внешнюю видеокарту. А Riva TNT имела изначально встроенную видеокарту внутри своего набора (т.е. предлагала готовое решение под ключ). К тому же, Riva TNT была банально дешевле ("дешевые карты Nvidia" сейчас звучит как плохой анекдот, но тогда реально было так). Так что, Nvidia начал активно отжирать бюджетный и средний сегменты, которые благодаря растущей доступности 3D-игр росли быстрее всего.

Тем не менее, Nvidia и 3dfx активно конкурировали следующие 2-3 года. Но Дженсен Хуанг победил. Во-первых, пока у 3dfx каждый следующий чипсеть был масштабным мегапроектом, Nvidia намеренно минимизировал цикл разработки, научившись быстро выкатывать новые версии на рынок. Это позволяло еще быстрее отжимать бюджетный и средний сегмент. К тому же, Nvidia изначально заложила в конструкцию своих продуктов систему проверки чипов на брак, за счет чего у них была ниже доля неисправной продукции.

Закончилось все тем, что в 2002 г. 3dfx проиграла Дженсену Хуангу патентный спор, что окончательно добило некогда мощного игрока. В итоге Nvidia выкупила своего закадычного конкурента за 70 миллионов долларов. Первый громкий триумф.

В 1999 г. компания выпустила один из своих главных продуктов - GeForce 256, который Nvidia с гордостью называла "первым графическим процессором". На самом деле, это было не совсем так. Хотя GeForce 256 умел создавать более сложные и реалистичные трехмерные объекты за счет наложения структур, был способен обрабатывать солидный объем графических примитивов (примитивы - это простейшие объекты, из которых на экране складывается изображение), и вообще очень резво работал с графикой, он точно не был первым графическим процессором. Более того, он был даже не самым мощным в свое время. Однако, он точно выдавал оптимальную "цену-качество", а еще Nvidia весьма талантливо его пиарила (в хорошем смысле этого слова).

GeForce 256. Как говорится, найдите 10 отличий с фото NV1 выше. Но на самом деле, разница примерно как между Nokia 3310 и пятым (ну ладно, четвертым) Айфоном.

К тому моменту Nvidia уже стала крупным поставщиком графических ускорителей и видеокарт. Её выручка была в районе 200 миллионов в год, капитализация достигала 700 млн долл., а в 1999 г. компания провела IPO на NASDAQ, окончательно перестав быть стартапом.

В начале 2000-х на рынке графических процессоров уже миновал этап бешеной конкуренции между кучей стартапов. Сформировались три явных лидера - Nvidia, Intel и ATI. У Nvidia и Intel было примерно по 30% рынка, у ATI - чуть меньше. Однако в 1998 г. Intel выпустил неудачный внешний ускоритель i740, так что, через некоторое время решил забить на рынок дискретных (т.е. внешних) видеокарт, состредоточившись на внутренней графике, а также других направлениях, коих у этого диверсифицированного гиганта было предостаточно.

В итоге в сегменте внешних графических модулей образовалась дуополия - Nvidia против ATI. Тут-то Дженсен Хуанг и попал в свою любимую среду ультраконкуренции. В 2000 г. ATI как раз выпустила свой самый жирный продукт, название которого вы наверняка слышали - это чипсет Radeon (сейчас это флагман компании AMD, но об этом позже).

В общем, две компании начали бодаться за самые жирные сегменты и контракты.

Сначала Nvidia стала поставщиком чипов для консоли Xbox, которую только-только начинал развивать Microsoft. Однако в дальнейшем Microsoft ушел к конкурентам из ATI. Дженсен Хуанг подумал "А чем я хуже?", и пошел к Sony с их PlayStation. Вдобавок, Nvidia стала эксклюзивным поставщиком внешних видеокарт для компов Apple. Кстати, в рамках партнерства с Sony Хуанг поступил очень мудро - Nvidia не просто продавала свои чипы, но и помогала Sony разрабатывать собственную графику для PlayStation 3 и PSP. Конечно, в перспективе Sony мог полностью перейти на свои решения, но глава Nvidia понимал, что рано или поздно это случится в любом случае (так и случилось). Так что, лучше поучаствовать в процессе, выжав из сотрудничества максимум хотя бы до создания японцами своего GPU.

Параллельно, Nvidia начала себя вести как настоящая взрослая корпорация. Она начала скупать перспективные компании и стартапы, диверсифицируя технологическую и продуктовую базу. В частности, прикупили:

Exluna - разработчика оборудования для 3D-рендеров в кино.

MediaQ - производителя чипов, которые оптимизируют работу дисплеев и аккумуляторов мобильных телефонов и прочих "беспроводных устройств".

iReady - разработчика чипов, которые "разгружали мозги" сетевого адаптера (это штука внутри компьютера, с помощью которой он ловит сеть или вайфай).

А еще, что любопытно, в 2005 г. хитрая Nvidia купила некую тайваньскую компанию ULI Electronics (сейчас она называется чуть по-другому), которая была важным поставщиком компонентов для главного конкурента - ATI. Этот удар Хуанга был крайне чувствительным для конкурента.

Второй удар по себе нанесла сама ATI. Компания продалась диверсифицированному производителю микропроцессоров AMD. В итоге ATI стала "графическим юнитом" в составе AMD, при этом лишившись большинства контрактов со своим основным потребителем - Intel (ведь AMD - это уже прямой конкурент Intel, а не какой-то там поставщик графических чипов). Угадайте, кому после этого достались безхозные контракты от Intel?

В итоге получилась очень характерная ситуация. С одной стороны, огромный процессорный холдинг купил главного конкурента Nvidia (а также, соответственно, их главный продукт - чип Radeon). С другой стороны, сама Nvidia активно диверсифицировалась, скупала компании в смежных сегментах и готовилась играть по-крупному. Все это предзнаменовало главное противостояние в сегменте графики, рендеров, процессоров и всего что с этим связано - Nvidia vs AMD ("зеленые" против "красных").

Классическое противостояние, которое идет уже почти 20 лет. Иногда еще сюда добавляют Intel, но Intel - это все же прямой конкурент для AMD. Для Nvidia Intel и конкурент, и партнер и покупатель одновременно.

Кстати, есть версия, что AMD сначала хотели купить Nvidia, но Дженсен Хуанг их послал. Этот хитрый CEO что-то знал уже тогда.

Середина 2000-х. Nvidia - уже совсем серьезная корпорация, зарабатывающая по 200-300 миллионов баксов за квартал.

В 2007 г. компания выпускает свой, возможно, самый важный продукт. Очень вероятно, что именно он открыл ей путь к нынешним триллионам. Он назывался CUDA (Compute Unified Device Architecture). CUDA - это GPGPU (General-purpose computing on graphics processing units). И здесь я остановлюсь подробнее.

Дженсен Хуанг понимал, что одними ускорениями графона и рендерами сыт не будешь. Так что, Nvidia выпустил, скажем так, адаптер (ну или прееходник), который позволял задействовать мощности большинства своих графическиих чипов для обработки математических вычислений, алгоритмов и прочих веселых штук, которыми занимаются разработчики самых продвинутых технологий.

Проще говоря, с помощью CUDA разрабы смогли делать запросы на упрощенных диалектах языков C, С++ и Fortran, которые обрабатывались прямо на мощностях чипов Nvidia. Позже прикрутили еще Python, MATLAB и другие популярные языки.

Отдельно выделю крайне удачное решение добавить язык Fortran. С одной стороны, этот язык сложно назвать самым популярным для разработки (видели хоть один войтивайтишный курс про Фортран?). С другой стороны, он считается "высоким языком", на котором программисты-ученые любят вести научные изыскания. В том числе, именно Fortran стал одним из ключевых языков для ранних наработок в области искусственного интеллекта и машинного обучения (есть версия, что это вообще первый язык для ИИ).

Таким образом, помимо очевидного стимулирования спроса на чипы, успешный выпуск CUDA, вероятно, стал фундаментом (или хотя бы первым кирпичиком) для лидерства компания в вычислительных мощностях для искусственного интеллекта.

Интересный факт. В 2012 г. прошел ImageNet Large Scale Visual Recognition Challenge - крупный конкурс, где разработчики соревновались, чья технология круче всех распознает разные картинки. Лучший результат показала нейронная модель AlexNet, которая обучалась через мощности графических чипов Nvidia с помощью CUDA. Тогда окончательно стало ясно, что графические чипы в целом и Nvidia в частности ой как пошумят по мере развития ИИ. Кстати, одним из создателей AlexNet был Илья Сутцкевер, который теперь нам известен как сооснователь OpenAI и один из самых важных людей в мире современных технологий.

Молодые Илья Сутцкевер и Алекс Крижевский, а также уже солидный Джеффри Хинтон (один из самых видных ученых в области deep learning) работают над AlexNet.

В конце 2000-х Nvidia продолжила усиленную диверсификацию. В частности, был куплен Ageia - разработчик движка PhysX, который позволяет моделировать и разрабатывать симуляции физических явлений. PhysX - крайне важная штука для гейминга, которую активно используют Unreal Engine, Unity и другие игровые движки. Он стал весьма важным продуктом для компании.

Однако, к началу 2010-х перед Nvidia встал серьезный вызов - стремительно набирал обороты сегмент интегрированной (внутренней) графики. Это означало, что диверсифицированный крупняк вроде Intel, Sony, Microsoft, Apple и прочих становились гораздо более самостоятельными в плане работе с графическими задачами. Если в 2007 г. Intel контролировал 30% рынка графики, то к началу 2010-х - уже более половины, и продолжал усиливать свои позиции за счет поглощения целой россыпи мелких производителей.

Позиции основного бизнеса Nvidia (дискретных, т.е. "встраиваемых", решений для графики) оказались под серьезной угрозой. К тому же, в 2008 г. Nvidia выпустила большую партию чипов с дефектами, которые отгрузили Apple, Dell, HP и другим крупным ребятам. В итоге Nvidia получила серьезный репутационный ущерб, а еще пришлось раскошелиться на компенсации.

Нужно было что-то менять. В первую очередь - еще активнее диверсифицироваться, чтобы сделать бизнес-модель прочной и устойчивой.

Действовать решили по всем фронтам:

Радикально усилили чипы и прочие вычислительные продукты для игр на ПК и консоли.

Активно пошли в мобильный сегмент. Еще в 2007 г. Nvidia купила разработчика системных чипов PortalPlayer. В 2010-х на основе технологий PortalPlayer была выпущена серия процессоров (не GPU, а полноценных CPU) для мобильных устройств под названием Tegra (их еще называют "кристаллы"). Правда, на мой взгляд, Nvidia слегка промахнулась с операционной системой, ведь большинство Tegra применялось в смарфтонах и планшетах на Windows. Впрочем, это сейчас мы видим, что мобильные потуги Microsoft оказались провалом, а в начале 2010-х это была весьма перспективная история с неплохой долей рынка. Так что, бизнес Nvidia неплохо на этом вырос. Даже CEO Microsoft Сатья Наделла недавно признавался, что сворачивание мобильного бизнеса Microsoft было главной стратегической ошибкой компании.

Nvidia даже отважилась на нетипичный для себя эксперимент - выпустила собственную портативную игровую консоль Nvidia Shield Portable:

Вообще, консоль Shield - это крайне нетипичный продукт для Nvidia. Компания всегда отличалась высокой прагматичностью при выборе конфигурации продуктов и оценке будущего спроса, всегда стараясь сделать относительно доступный продукт, который найдет отклик у массовой аудитории. Но тут получилось с точностью до наоборот. Shield стоила дороже аналогов, а игр для неё было крайне мало (хотя Nvidia даже запилила собственную платформу для разработки). Так что, хотя эксперты и игровые издания хвалили консоль за весьма недурную графику и производительность, особой популярности продукт не сыскал. Что ж, видимо, если умеешь производить чипы и процессоры, то не стоит лезть в истории про платформы и пользовательские девайсы.

Еще Nvidia начал активничать в сегменте автомобильной электроники. В том числе, в области начинки для беспилотного управления.

Но про это я расскажу во второй части. Как и про конкуренцию с AMD, качели из-за криптомайнинга, партнерства с китайцами и, собственно, путь к триллионной капитализации за счет лидерства в ИИ в последние годы. Там много интересных историй. А на сегодня хватит.

Если эта статья круто зайдет, то я быстрее сяду за вторую часть. Так что, если вам понравилось, то можете подкинуть мне дополнительной мотивации в виде плюсов, комментов и репостов статьи друзьям.

Если вам заходит такой контент, то подпишитесь на мои тг-каналы. Мне будет приятно, а вы найдете там еще больше подобного:

На своем основном канале Дизраптор я простым человечьим языком разбираю инновации, технологические продукты и знаковые компании (а еще анонсирую все свои статьи, чтобы вы ничего не пропустили).

А на втором канале под названием Фичизм более точечно пишу про новые фичи и функции продвинутых компаний и сервисов.

Месяц назад довелось посетить офис компании Pimax в Шанхае. Денег мне не платили, спонсоров нет, сходил из любопытства :)

Для тех, кто не в курсе, Pimax производит недешёвые шлемы для ПК VR (тогда как шлемы Quest 2 и Quest 3 - это самостоятельные гаджеты, для которых подключение к ПК не обязательно). Pimax с самого начала работают по формуле "долго, дорого, лучший визуал", и Pimax Crystal не стал исключением.

Видео визита на английском (Яндекс браузер поможет перевести на русский):

Pimax Crystal, конечно, внушает уважение:

1. Очень высокое разрешение (2880х2880 на глаз), "сетка пикселей" ("screen door effect") уже не видна. Непередаваемая четкость картинки при запуске игры в родном разрешении: все мелкие буковки, детали текстур, цифры и показания на панели приборов транспорта, царапинки и потерости на оружии - всё это в Crystal приобретает необычайную четкость. За это Crystal и любят :)

2. Хороший угол обзора (FOV повыше чем у Quest 2);

3. Трекинг глаз позволяет запускать игры на более слабом железе (за счет "ямкового рендеринга" изображения) и добавлять, собственно, трекинг направления взгляда в проекты формата VR Chat;

4. Достаточно комфортная для таких размеров шлема посадка.

5. Великолепный over ear звук, как в шлеме Valve Index. Звучит как наушники, комфорт как у динамиков.

У Pimax Crystal, конечно, есть и минусы:

1. Провод. Над беспроводной передачей картинки Pimax еще работает (они показывали мне функционирующие прототипы). С проводом от шлема до системного блока ПК, после Quest 2, мне конечно играть уже не так интересно.

2. Вес, размер шлема. Все-таки, шлем весит почти 1 килограмм, и даже при комфортной посадке шлем на голове ощущается; но более того ощущается инерция "на лице" при резких движениях головой в динамичных играх. Не критично, но иметь в виду это стоит.

3. В целом, "гиковость" как шлема, так и сопутствующих программ. Сделать и оптимизировать можно очень многое, но для этого придется изрядно поковыряться во всевозможных лончерах, утилитах, сторонних протоколах и командных строках отдельных игр чтобы всё это заработало "идеально, на всю катушку". Сразу "из коробки" получится в лучшем случае "ну, нормально".

4. Цена. В зависимости от того, где и как покупать, цена Crystal гуляет от 1500 до 2000 долларов (а может и выше?)

В общем же впечатления и выводы такие: Pimax Crystal для тех, кто знает, что ему нужен именно Pimax Crystal. Всем остальным я в первую очередь порекомендую Quest 3.

- Если у вас видеокарта слабее RTX 3080, и вам не нужен eye tracking для какой-нибудь уникальной задачи - я бы c Crystal не связывался и взял Quest 3.

- Если вы играете в очень динамичные/фитнес игры - берите Quest 3

- Если вы - ПК VR симуляторщик, с уже обустроенными кабинами, рулями-педалями-РУДами и прочим для как можно более реалистичных гонок/полетов, и у вас очень хорошая видеокарта (в идеале, конечно, 4090 на начало 2024 года), то Pimax Crystal - это то, что доктор прописал; и более подходящий вариант будет найти очень сложно.

- Если вы новичок в VR - берите Quest 3 и не вздрагивайте. Если вы однозначно "упарываетесь" в ПК VR и у вас очень хорошее железо, а визуала Quest 2/3 уже недостаточно - то Pimax Crystal - отличный вариант.

Спрашивайте, если есть вопросы. Чем смогу - помогу :)

Одна вакансия, два кандидата. Сможете выбрать лучшего? И так пять раз.

Добрый день!

В связи с постоянными командировками вместо стационарного ПК имею игровой ноутбук AORUS 17 XE4, который постоянно путешествует со мной. Не так давно решил организовать себе дома небольшое рабочее место, чтобы можно было проводить время с комфортом, без ноутбука на коленках и табуретки с девайсами рядом. Когда дело дошло до выбора монитора, предстоял не простой выбор.

Критерии поиска монитора были следующие:

Диагональ не менее 27 дюймов; Обязательно широкий формат 21:9 - сейчас с ним практически все приложения и сама ОС Windows работает отлично; Частота обновления не менее 120 Гц; Разрешение не меньше 1440p.

Потребитель всегда диктует моду на те или иные технологии, форматы и устройства. Сейчас на рынке мониторов огромное количество практически идентичных, подходящих под мои критерии, широкоформатных мониторов для потребления мультимедиа контента. Отличаются они лишь маркировкой производителя, ценой и небольшими конструктивными изменениями.

Почему был сделан выбор именно в пользу Samsung Odyssey G5? Для меня он стал идеальным сочетанием цена/качество. На бумаге, конечно-же. Итак, что может предложить этот монитор на основании голых характеристик:

Диагональ: 34 дюйма; Изогнутый экран: 1000R; Соотношение сторон: 21:9; Разрешение: 3440х1440 пикселей; Частота обновления: 165 Гц; Время отклика: 1 мс; Тип матрицы: VA; Глубина цвета: 8 бит; Яркость: 250 Кд/м2; Контрастность: 2500:1; Крепление: VESA 75x75; Технология HDR10; AMD FreeSync Premium;

За среднюю стоимость в 35 тысяч рублей выглядит довольно вкусно. Конечно, хотелось бы матрицу QLED или OLED, побольше яркость и глубину цвета 10 бит, но такие модели уже минимум в два раза дороже. Было решено этим пренебречь, тем более что здесь имеется HDR и FreeSync, что подсластило пилюлю. На практике все не так радужно.

Монитор поставляется в простой картонной коробке. Внутри все надежно упаковано в полиэтилен и транспортировочный пенопласт, переживать, что изогнутый монитор сильнее подвержен повреждениям не стоит, упаковка достойная. При получении не проверял, но никаких битых пикселей или артефактов при подключении не обнаружил. Корпус также в порядке.

В комплекте имеется лишь ножка для установки на стол и кабель DisplayPort-DisplayPort. Производитель так намекает на предпочтительное подключение к данному монитору, однако с ноутбуком таким кабелем не соединить, пришлось специально заказать кабель DisplayPort-miniDisplayPort.

Также в комплекте имеется шнур питания с внешним трансформаторным блоком, что мне нравится больше, нежели его расположение внутри корпуса. Так габариты монитора становятся меньше, а его ремонтопригодность возрастает.

Сам монитор довольно большой не только по длине и высоте, но и по ширине из-за большого радиуса изгиба 1000R. Корпус из матового черного пластика, экран также матовый, что хорошо (не будет бликовать). При установке на стол вместе с комплектной ножкой, расстояние от стены должно быть еще больше, это нужно учитывать при расчете пространства под монитор. Стол нужен достаточно широкий.

Ни для кого не секрет, что любой производитель, выпуская линейку товаров под разный ценовой сегмент, сначала выпускает флагманское устройство, а уже позже, блокируя различные его возможности создается средний и бюджетный вариант. Также и здесь сразу читаются рудиментарные элементы более старших моделей, например, выступы по бокам корпуса внизу. Многие могут подумать, что это динамики, но динамиков на этом мониторе не предусмотрено. На обратной стороне центральный элемент в форме кольца также сделан не просто так. В более старших моделях так реализуется подсветка тыльной стороны монитора, которой в G5 нет.

В числе портов на тыльной стороне: разъем питания, сервисное USB-гнездо, DisplayPort, HDMI и разъем 3.5 мм для подключения наушников.

Сильная сторона монитора – удобство использования. Производитель озаботился толщиной монитора и сделал разъемы утопленными в корпус с вертикальным подключением. При отсутствии кронштейна, подключать их не так просто из-за огромных размеров монитора, который нужно повернуть минимум на 90 градусов, чтобы добраться до нужного входа. С поворотным кронштейном данная операция становится намного проще.

Навигация по меню монитора также хорошо реализована, больше никаких невидимых кнопок, которые нужно нащупывать и запоминать их назначение. Всё управление завязано на один джойстик, расположенный на нижнем торце под названием бренда. Элемент управления никак не выделается внешне и найти его можно только тактильно.

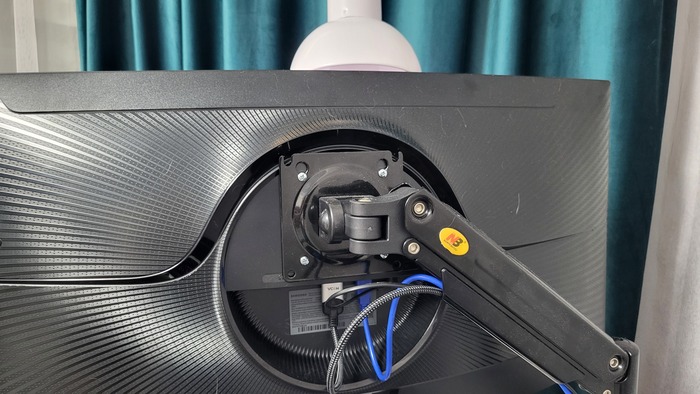

Производителем предусмотрено крепление монитора на кронштейн по стандарту VESA 75x75. Узлы крепления находятся на тыльной стороне не центрировано, а над блоком разъемов в верхней части корпуса.

Мое рабочее место не отличается большими размерами, столешница 60х100 см, для такого монстра места там маловато, поэтому сразу было решено использовать монитор Samsung Odyssey G5 с кронштейном, который будет крепиться к столу. В качестве такого крепления был выбран NB G40B, который имел положительные отзывы и имел большой запас по максимальной диагонали панели и ее весу.

Устройство действительно надежное, имеется газлифт для регулировки и удержания высоты монитора над поверхностью стола. Можно повернуть монитор в двух осях, а также регулировать его высоту. В самом кронштейне заложен кабель-канал, который скрывает все провода, идущие к монитору, так же имеется USB-разъем, который использовал для подключения к сервисному гнезду монитора. При необходимости можно легко обновить прошивку, а в повседневном использовании от него производится зарядка нетребовательных по силе тока девайсов.

Благодаря кронштейну NB G40B поверхность стола полностью свободна, а под монитором расположился ноутбук, к которому и подключен монитор.

Первое впечатление было положительное, покупая большой дисплей с хорошим разрешением и частотой кадров, невольно перестаешь надеяться на хорошую цветопередачу и контрастность, но здесь все просто отлично. Цвета сочные, контрастные, картинка достаточно четкая, несмотря на низкую плотность пикселей столь большой диагонали.

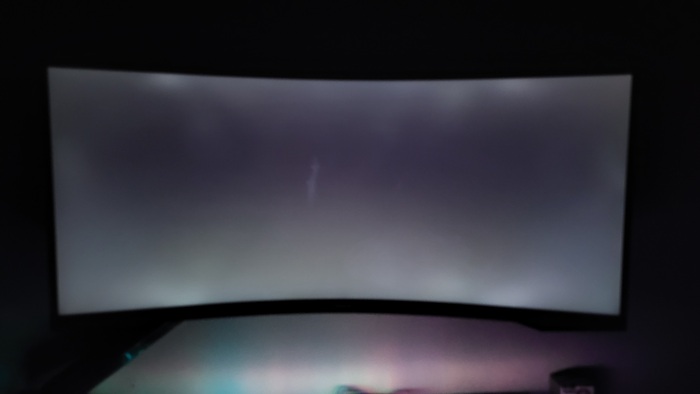

Засветы на черном в темноте практически не видны. Никакого акцента на них при повседневной работе не обращаешь, да, они есть, но сценарий использования, при котором они могут испортить картинку лично у меня не возник до сих пор. На фотографиях все кажется ужасно, особенно под углом сверху, однако глаз видит совсем не то, что камера.

С подключением Samsung Odyssey G5 таким образом, чтобы использовать весь его потенциал и предоставляемые технологии все не так просто. Первое подключение производилось через HDMI кабель версии 1.2, в таком режиме максимальное разрешение 3440х1440 пикселей удавалось установить только при режиме работы монитора на частоте 100 Гц. Для работы при максимальном разрешении и частоте кадров 165 Гц пришлось докупить DP-кабель версии 1.4, наиболее актуальной на текущий момент. Тогда все заработало в нужном режиме.

Меню монитора полностью на русском языке, что радует. В главном колесе меню можно перейти к выбору входа, настройке изображения, включить режим двойного экрана или выключить монитор. Режим двойного экрана позволяет разделить монитор пополам, при этом одна половина изображения будет отображать сигнал с разъема HDMI, а вторая через DisplayPort. Такая функция способна заменить два монитора при некоторых сценариях использования.

Настройка изображения встречает нас меню, в верхней части которого расположены статус-бары в виде пяти круглых элементов. Первый отображает установленный режим эквализации черного цвета, второй показывает текущее время отклика монитора. Отклик в 1 мс работает далеко не всегда и вряд ли вы захотите использовать монитор в таком режиме, об это чуть позже. Третий элемент интерфейса показывает текущую частоту обновления. Четвёртый элемент сигнализирует о включенном режиме FreeSync, пятый указывает о включенном и выключенном режиме понижения задержки ввода.

На данном этапе не все из описанного выше понятно, поэтому предлагаю углубиться в настройку более глубоко. Само меню подразделяется на 6 разделов.

Раздел «Игра» предоставляет основные настройки монитора, здесь можно вручную выбрать частоту кадров монитора. Частота обновления позволяет выбрать один из трех вариантов: это 60, 100 и 165 Гц. Эквализация черного – это настройка от 1 до 20, которая позволяет сделать черный цвет изображения темнее или светлее. Чем больше параметр, тем черный цвет чернее, как бы странно это не звучало.

Время отклика подразумевает четыре параметра, где «Самый быстрый», то есть 1 мс, полностью блокирует настройку яркости монитора. В данном режиме отклик управляется LED подсветкой и изображение становится чудовищно тусклым. Поэтому вряд ли кто-то захочет терять в качестве картинки, имея пару миллисекунд преимущества в отклике матрицы.

Результат хорошо виден даже невооруженным глазом, шлейфы от курсора и окон при быстром перемещении максимально уменьшаются, но изображение при этом удручает. Таким образом заявленное время отклика переходит в разряд маркетинговых уловок, хотя практически, оно соответствует 1 мс, но с оговорками.

Опция «FreeSync» позволяет включить режим адаптивной частоты кадров. Крайне рекомендую данный режим, если вы будете играть в игры.

«Низкая задержка ввода» позволяет сократить время отрисовки видеосигнала силами монитора, у меня включено. На качество не влияет. Следующая опция позволяет отобразить на мониторе прицельное перекрестие, что может помочь в играх, где прицел не предусмотрен или, например, установлен высокий уровень сложности, где приходится играть без прицела.

Опция «Размер экрана» позволяет регулировать отношение сторон дисплея от 4:3 до заводских 21:9. Может помочь при проблемах совместимости в устаревшем ПО, когда картинка растягивается.

Второе меню «Изображение» позволяет настроить качество выдаваемой картинки. «Режим изображения» позволяет установить заранее заготовленный пресет настроек, которым пользоваться я бы не советовал. Лучше настроить индивидуально под себя.

Следующие три пункта отвечают за уровень яркости, контрастности и четкости соответственно. Если яркость можно смело выставлять на 100, то с контрастностью и четкостью все не просто. При максимальном уровне контрастности, оттенки серого съедаются, что видно в любом интерфейсе с элементами серого цвета. Максимальная четкость делает картинку слишком резкой и рябящей. Поэтому контрастность и четкость у меня выставлены на оптимальном уровне в 80%.

Настройка цвета позволяет подобрать под себя нужный цветовой оттенок, можно настроить каждый из трех цветов вручную или выбрать заготовленный пресет.

«Уровень черного» доступен для настройки интенсивности черного цвета при подключении по HDMI. Режим отдыха глаз делает картинку блеклой с минимальным содержанием синего цвета во избежание раздражения зрения. Стандартный режим, который присутствует на любом телефоне. «Настройка экрана» позволяет отрегулировать положение экрана или повысить качество изображения. У меня она заблокирована, возможно, также работает только с HDMI.

Третий пункт меню отвечает за настройку PBP, того самого режима с разделением экрана и выводом изображения из разных источников.

Остальные три раздела отвечают уже за настройку самого монитора и его диагностику, поэтому большого интереса не представляют. Единственное, что может пригодиться, это динамическая яркость в разделе «Система», монитор будет автоматически подгонять уровень яркости в зависимости от содержимого, что также хорошо сказывается на отдыхе глаз.

Частота генерации кадров видеоадаптера и частота монитора в любой момент времени будут с вероятностью 99% отличаться. Это приводит к тому, что монитор не до конца отрисовав один кадр, начинает отрисовывать другой, что в итоге приводит к горизонтальным искажениям картинки. С этим эффектом пытаются бороться уже не один десяток лет.

Изначально альтернатив не было и можно было включить лишь вертикальную синхронизацию, тогда частота генерации кадров всегда была кратна частоте обновления монитора. Например, если монитор 60 Гц, то FPS в игре мог быть либо 60, либо 30. Такое устраивало практически никого, поэтому Nvidia на своих адаптерах внедрила технологию G-Sync, которая полностью синхронизировала частоту обновления видеокарты и монитора.

Это была панацея, однако G-Sync требует установки дополнительного оборудования внутри монитора, что сильно удорожало его стоимость. Промежуточным вариантом стала технология AdaptiveSync, которую AMD позже подхватила и доработав представила FreeSync. Суть в том, что монитор обновляет монитор только тогда, когда новый кадр будет полностью отрисован. Наличие данной технологии в мониторе незначительно сказывается на его стоимости, что привело к ее повсеместному использованию.

Компания Nvidia пошла навстречу пользователям и в итоге в современных драйверах их видеокарт существует возможность включить G-Sync на мониторах с FreeSync, однако далеко не все мониторы официально совместимы Nvidia для такого режима работы.

На данном мониторе Samsung Odyssey G5 при попытке включить режим FreeSync, система фактически находит новое устройство, которое при необходимости нужно настраивать в системе отдельно. На самом же мониторе абсолютно все вышеописанные настройки по понятным причинам блокируются, доступно лишь отображения прицела в центре экрана, а также установка уровня яркости, контрастности и цвета во втором меню.

При первом тесте монитора в таком режиме, частота кадров жутко проседала. Плюнув, я отключил FreeSync. Чуть позже получилось заставить его нормально работать, для этого я установил монитор через программу с официального сайта, а также обновил драйвера Nvidia. В следствие этих манипуляций, при включении галочки G-Sync в панели управления Nvidia, частота кадров не проседала, а разрывы изображения исчезли.

Технология HDR - High Dynamic Range (перев. высокий динамический диапазон) позволяет сделать картинку максимально приближенную к реальности путем повышения яркости между темными и светлыми участками изображения. В Windows 11 данная технология сегодня работает наилучшим образом. Именно там ее и нужно задействовать. В самом мониторе G5 настроек HDR нет.

Чтобы включить HDR нужно нажать правой кнопкой на рабочем столе и перейти в параметры экрана, выбрать монитор Samsung G5, если у вас более одного монитора как у меня. В настройках «Яркость и контраст» необходимо установить флажок в опции «Использовать HDR».

Качество изображения сразу станет отвратительным. «Очередная маркетинговая чушь» - подумал я и отключил это исчадье ада. Первое впечатление складывается такое, будто монитор делает изображение блеклым, а во время воспроизведения HDR-контента качество картинки восстанавливается до стандартных значений. Тогда не понятно зачем пользоваться такой функцией, если тот же липовый «HDR» можно получить на постоянной основе. Но все не так просто. HDR тоже нужно настраивать.

Первым делом нужно устранить проблему с некорректным отображением цвета. Для этого в панели управления Nvidia в разделе «Дисплей» подразделе «Регулировка параметров цвета рабочего стола» нужно поставить галочку на «Приоритет эталонного режима». Цвета стали более реалистичными. Далее нужно что-то сделать с пересвеченным изображением, на котором все серые элементы высвечиваются, как это было при установке параметров контрастности монитора на максимальные 100%.

Для этого перейдем в параметры экрана туда, где включали HDR. Здесь не самый удачный ход со стороны дизайна интерфейса никак не намекает нам о том, что «Использовать HDR» это целое меню, а не только переключатель. Нажимаем на кнопку «Использовать HDR» и переходим в настройки. Для устранения засветов нужно откорректировать ползунок «Яркость SDR-содержимого», оптимальное значение в 30-40%. Так изображения становится адекватным, немного блеклым и менее контрастным, но адекватным.

Также здесь можно смело ставить галочки «Потоковая передача HDR-видео» и «Авто HDR». Последняя опция будет эмулировать HDR в полноэкранных приложениях, где HDR не заложено разработчиком, работает хорошо.

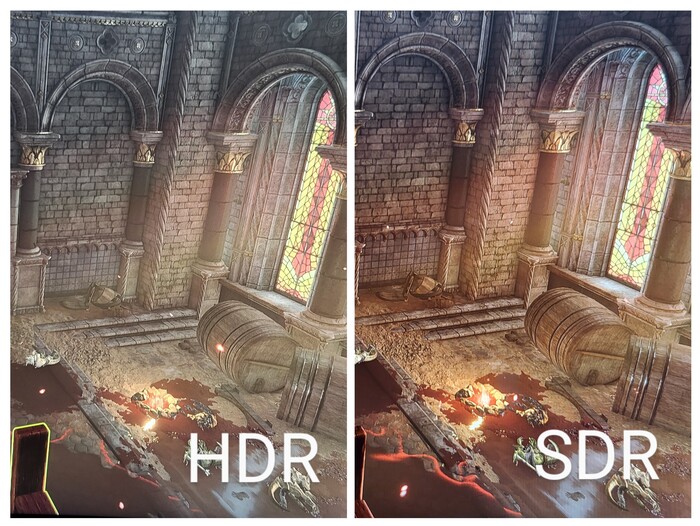

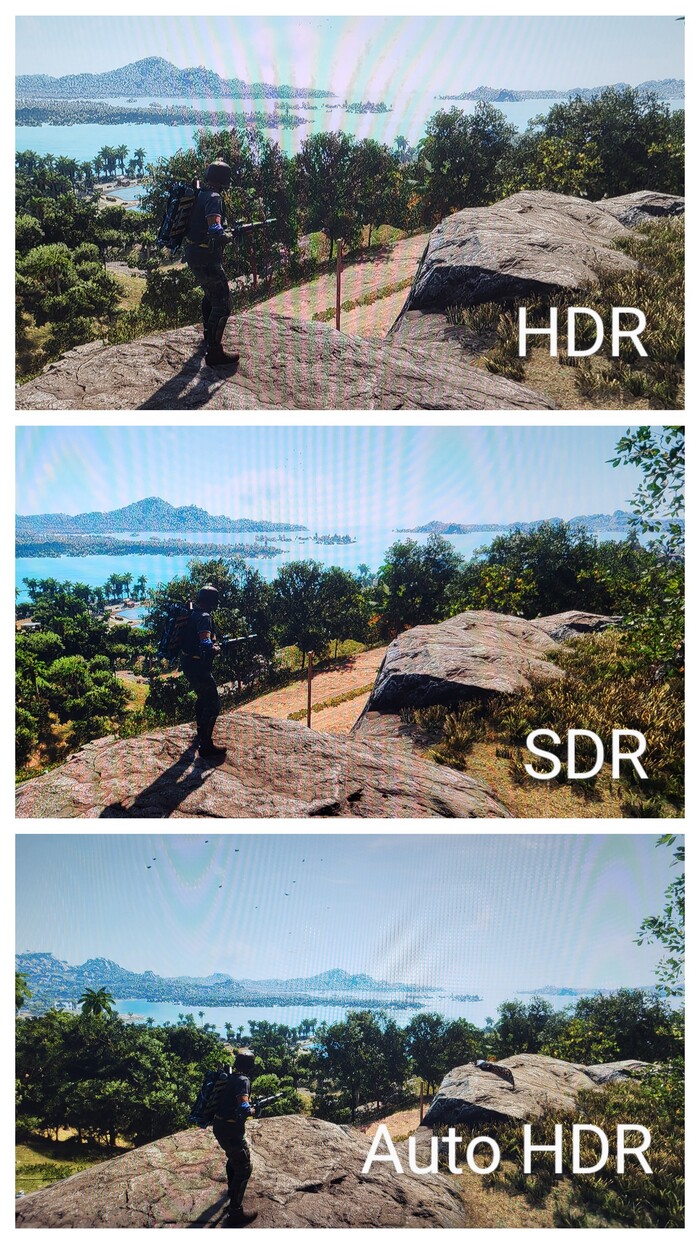

Что же нам дает HDR в играх, например? Контрастность цветов в целом снижается, повышается яркость. Вместе с тем темные участки высветляются. Изображение в целом становится более реалистичным. Авто HDR работает хорошо, но, если функция заложена разработчиком в саму игру, ее желательно настроить. Приведу несколько примеров с HDR и без ниже. На данной модели использование функции все же спорное, но лично мне так нравится больше.

Монитор Samsung Odyssey G5 однозначно можно рекомендовать к покупке не только заядлым геймером и потребителям контента. Его форма-фактор и характеристики позволяют прекрасно и удобно работать с текстом (в Word, например, монитор отображает сразу 4 страницы в ряд), в фото- и видео-редакторах и других программных продуктах. В целом это отличный представитель среднего ценового диапазона с хорошим функционалом и запасом прочности под любые задачи.

Справились? Тогда попробуйте пройти нашу новую игру на внимательность. Приз — награда в профиль на Пикабу: https://pikabu.ru/link/-oD8sjtmAi

Реклама от Ридли Скотта:

До этого тоже выходили ПК Apple, но все они были не такими удачными. так что можно считать, что этот ПК был первым коммерческим успехом Apple. К 1998 году их было продано более миллиона штук.

Macintosh 128K, первоначально представленный как Apple Macintosh — первый персональный компьютер Apple семейства Macintosh. В комплекте с ним шли мышь и клавиатура. Ручка, расположенная в верхней части корпуса, облегчает подъём и переноску компьютера. Его первоначальная стоимость составляла 2495 долларов. Macintosh был представлен в телевизионном рекламном ролике Ридли Скотта «1984», который транслировался на CBS 22 января 1984 года (см. выше).

Продажи Macintosh были высокими с момента его первоначального выпуска 24 января 1984 г. и достигли 70 000 единиц к 3 мая 1984 г. После выпуска его преемника, Macintosh 512K, он был переименован в Macintosh 128K. Компьютер — модель M0001.

Мой первый комп появился у меня примерно в 1995 году И выглядел так. 386 IBM