Это новый выпуск «Нейро-дайджеста» — коротких и полезных обзоров ключевых событий в мире искусственного интеллекта.

Меня зовут Вандер и каждую неделю я делаю обзор новостей о нейросетях и ИИ.

Неделя с 28 апреля по 4 мая 2025 года выдалась щедрой на новинки: китайские модели, которые наступают на пятки OpenAI, подкасты из PDF на русском и кот с квантовой непредсказуемостью, претендующий на сознание — я собрал в одном месте только самое важное и только то, что реально интересно и полезно. Поехали!

📋 В этом выпуске:

Qwen3 от Alibaba — китайская альтернатива OpenAI с открытым кодом

DeepSeek Prover-V2 — 671B модель для формальных доказательств

OLMo 2 от AI2 — крошка на 1B, уделывает Meta и Google

🛠 ИИ-Инструменты и интерфейсы

Подкасты на русском в NotebookLM

AI Mode — новый поиск от Google по всей Америке

Реклама Microsoft, которую сделал ИИ

Qwen, DeepSeek и Gemma — теперь в Yandex Cloud

Suno 4.5 — генерация треков до 8 минут

Duolingo запускает 148 курсов за год с помощью ИИ

🧪 Исследования и технологии

Anthropic заглядывает в «чёрный ящик» нейросетей

ИИ комментирует спорт в реальном времени

ИИ и кибербезопасность: главное с RSA 2025

Квантовый кот и теория сознания

Gemini 2.5 прошла Pokemon Blue

ChatGPT определяет геолокацию по фото

Рой Ли — $3 млн с ИИ-помощником и отчисление

Люси Го — самая молодая миллиардерша

Фиби Гейтс — ИИ для шопинга и $500 тыс. от Кардашьян

Самое маленькое в мире искусственное сердце — и спасённый ребёнок

🧠 ИИ-модели

❯ Qwen3 от Alibaba — гибридные режимы, 119 языков и открытый код!

29 апреля Alibaba выпустила Qwen3 — новую линейку языковых моделей, которая сразу хайпанула во всём AI-сообществе. Это серьёзный шаг вперёд: мощные возможности, поддержка множества языков и полный open-source.

Главная фишка — гибридный режим работы. Модель умеет «включать мозги» только тогда, когда это нужно.

Если задача сложная — активируется режим глубокого анализа.

Если вопрос простой — Qwen3 отвечает быстро и без лишних вычислений.

Пользователь сам управляет поведением модели с помощью тегов вроде /think и /no_think, подстраивая отклик под задачу.

В техническом плане Qwen3 стала заметно умнее. Она лучше справляется с логикой, кодом и математикой, точнее следует инструкциям, увереннее ведёт диалоги и пишет более естественные тексты.

Ещё один важный плюс — поддержка 119 языков и диалектов, включая русский. Модель спокойно переключается между языками и уверенно работает в многоязычных средах.

Также Qwen3 улучшили для задач автоматизации: она точнее интегрируется с внешними сервисами и подходит для создания AI-агентов. Alibaba предлагает для этого собственный фреймворк Qwen-Agent.

И наконец — открытый код. Все восемь моделей семейства (от компактной 0.6B до огромной 235B MoE) выложены под лицензией Apache 2.0. Их можно свободно использовать, модифицировать и применять в коммерческих проектах.

Модели уже доступны на Hugging Face, ModelScope и Kaggle.

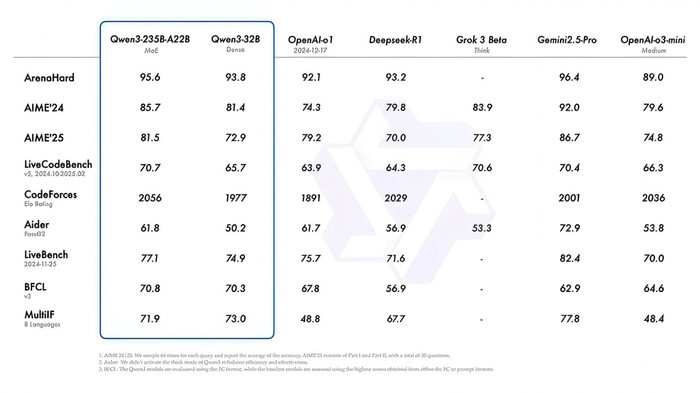

Как Qwen справляется с задачами?

Конечно, главный вопрос — насколько новая модель конкурентоспособна. Бенчмарки показывают, что Qwen3 действительно сражается на равных с топами от OpenAI, Google и DeepSeek.

Флагманская модель Qwen3-235B-A22B обошла o3-mini от OpenAI в тестах AIME (математика) и BFCL (логика). В программировании (бенчмарк Codeforces) она немного обогнала Gemini 2.5 Pro от Google и значительно — DeepSeek-R1.

В тесте Arena-Hard — одном из самых сложных на рассуждение — Qwen3-235B набрала 95.6 балла, что выше, чем у GPT-4o (89.0) и DeepSeek-R1 (90.2), и немного уступает только Gemini 2.5 Pro (96.4).

Но есть и слабые места. В LiveCodeBench модель пока уступает o4-mini (70.7% против 80%), а в AIME’24 набрала 85.7% — против 94% у той же o4-mini. Тем не менее, средняя модель Qwen3-32B уже превосходит o1 от OpenAI, а Qwen3-30B-A3B показывает отличные результаты в ряде других тестов.

Вывод: Qwen3 — это не просто open-source альтернатива. Это реальный конкурент крупнейшим проприетарным моделям, особенно в математике, коде и логике. Да, в некоторых задачах закрытые модели всё ещё впереди, но разрыв сокращается. И это — большой шаг для всего сообщества открытого ИИ.

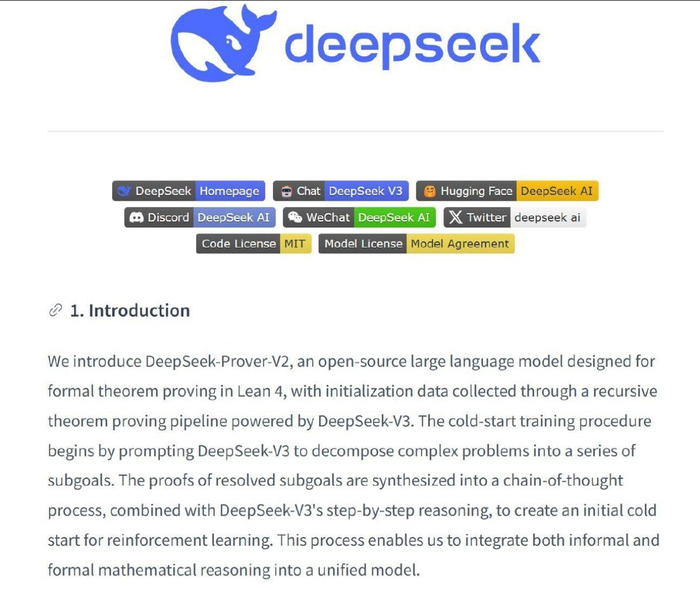

❯ DeepSeek Prover-V2 — 671B модель для формальных доказательств

Китайский стартап представил Prover-V2 — одну из самых специализированных и масштабных языковых моделей на сегодня.

Её задача не поболтать с пользователем, а доказывать математические теоремы. Причём делает она это на уровне преподавателей вышмата.

Модель построена на базе DeepSeek V3, весит внушительные 671 миллиарда параметров и заточена под работу с математикой в формальном виде. Это значит, что Prover не просто «понимает математику», а пишет доказательства на специализированных языках — вроде Lean или Isabelle.

Используется она, в первую очередь, для задач из области автоматизированного доказательства, матлогики и фундаментальных исследований.

Что интересно, в паре с Prover-V2 сразу вышла её уменьшенная версия — своего рода «мини-Prover», сделанная на базе прежней модели V1.5 (7B). Так что попробовать её возможности можно даже без супермашины.

Prover-V2 пока недоступна в виде чат-бота и не подойдёт для повседневных задач вроде написания кода или эссе. Но для научного сообщества, студентов-математиков и всех, кто интересуется формальными системами рассуждений — это прорыв.

❯ OLMo 2 от AI2: компактная модель, которая обходит гигантов

Исследовательский институт AI2 (Allen Institute for AI) выпустил OLMo 2 1B — небольшую open-source модель с всего 1 миллиардом параметров, но с результатами, которые заставляют обратить на неё внимание. По ряду задач она превзошла аналогичные модели от Google, Meta и Mistral.

OLMo 2 задумывалась как полностью прозрачная и воспроизводимая: открыты не только веса, но и код, пайплайн обучения, токенизатор и сами данные. Это делает её полезной не только для разработчиков, но и для исследователей и команд, которым важно понимать, как модель устроена изнутри.

В качестве тренировочного корпуса использовался Dolma v1.7 — тщательно отобранный датасет объёмом 3 триллиона токенов. Архитектура напоминает LLaMA, но с рядом доработок: улучшенные инициализации, прогрессивная обрезка контекста, более аккуратный токенизатор.

На практике OLMo 2 показала лучшие результаты в своём классе в бенчмарках ARC, HellaSwag, PIQA и даже на ряде задач по генерации кода. Особенно отмечается устойчивость к галлюцинациям — а это важный показатель для маломасштабных моделей.

🛠 ИИ-Инструменты и интерфейсы

❯ NotebookLM от Google: подкасты на русском и интерактивные дикторы

Google обновила свой ИИ-сервис NotebookLM, превратив его из помощника для чтения документов в полноценный инструмент для создания подкастов — причём на 70+ языках, включая русский, китайский и даже латынь.

Идея проста: ты загружаешь текст, PDF, ссылку на сайт или видео — а NotebookLM превращает это в подкаст с двумя ведущими, которые обсуждают материал в формате живого разговора. Всё — с опорой на твои файлы, и всё — с озвучкой на выбранном языке. Поддержка русского теперь официально работает, и звучит вполне прилично.

Самое интересное — интерактивный режим. Пока он доступен только на английском, но уже даёт почувствовать, куда движется формат: во время воспроизведения можно вмешаться или задать вопрос — и диктор ответит прямо в эфире. Это почти как поговорить с нейросетью вслух.

Сценарии использования — от учебных подкастов и генерации сводок до быстрых брифингов на ходу. Для исследователей и контент-мейкеров — это инструмент, который реально экономит время.

❯ AI Mode от Google: поиск превращается в диало

Google запустила в США новый режим поиска — AI Mode, который превращает привычную строку запросов в полноценный диалоговый интерфейс, напоминающий ChatGPT или Perplexity. Это не эксперимент: функция стала полноценной вкладкой в Google Search — рядом с «Картинками» и «Картами».

Что внутри? Диалоговый формат запросов, быстрые карточки с ответами, генерация списков, подборок, советов и даже промтов. Всё это работает поверх привычной выдачи и использует возможности модели Gemini. Результаты можно править, переспросить или уточнить прямо в окне ответа, не уходя на сайты.

Для пользователя это означает переход от поиска как «вопрос → ссылка» к контекстному взаимодействию, где система действительно старается понять, что именно нужно.

Сценарии использования самые разные: от «сравни этот ноутбук с этим» до «распиши маршрут на два дня в Киото». И всё это — в диалоге.

Сейчас AI Mode работает только на английском и только в США, но это явно бета перед глобальным запуском.

❯ Рекламу Microsoft сделал ИИ — и никто не заметил!

В начале года Microsoft выпустила минутный рекламный ролик для своих Surface-устройств — ноутбуков и планшетов. Видео вышло обычным, без акцентов на технологии. А спустя три месяца компания призналась: почти всё сделано с помощью генеративного ИИ.

Сценарий, визуальный стиль, композиция сцен, даже переходы — всё это было сгенерировано. Художники описывали боту, что хотят видеть, получали варианты, уточняли — и так сотни раз, пока не добились нужного результата. В кадрах, где требовалась реалистичная работа рук, использовались актёры. Остальное — синтез.

Ни в названии, ни в описании, ни в YouTube никто не указал, что ролик сгенерирован. За несколько месяцев видео набрало десятки тысяч просмотров — и ни у кого не возникло подозрений.

Этот кейс — важный маркер. Он показывает, что ИИ-тулзы уже не просто эксперименты, а полноценные участники производственного цикла: от идеи до монтажа. Особенно в рекламе, где счёт идёт на кадры и эмоции.

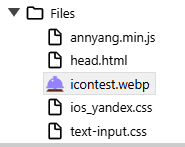

❯ Qwen, DeepSeek и Gemma — теперь в Yandex Cloud

В Yandex Cloud стали доступны VLM и текстовые модели через API, включая популярные open-source семейства — Qwen 2.5, DeepSeek VL2, Gemma3 и LLaMA 3.3. Всё это теперь можно вызывать напрямую, без необходимости разворачивать инфраструктуру.

Формат — Batch Processing API: пользователь отправляет пачку запросов и получает ответы в течение дня со скидкой до 50%. Это не real-time, но для задач вроде генерации описаний, обработки массивов документов или создания тестов — вполне рабочий вариант.

Особенность обновления — появление визуально-языковых моделей (VLM). Они могут работать с изображениями и текстом одновременно: генерировать описания, обобщать визуальный контент, решать мультимодальные задачи.

Плюс — теперь можно использовать и ризонеры: модели, заточенные под логические цепочки и рассуждение. В числе доступных — QwQ и DeepSeek R1.

Для российского рынка это важное событие: open-source модели мирового уровня теперь доступны из облака, легально, с понятной документацией и поддержкой.

❯ Suno v4.5: генерация треков до 8 минут и чище звучание

Suno выпустила обновление версии 4.5 — и это, похоже, один из самых заметных апгрейдов в сфере генеративной музыки за последние месяцы.

Главное нововведение — поддержка треков до 8 минут длиной, причём с более стабильной структурой: куплеты, припевы, переходы. Это приближает нейросеть к реальному музыкальному продакшену.

Ещё одно важное улучшение — повышенное качество инструментов. Раньше всё звучало немного «в кашу», особенно барабаны и басы. Теперь инструменты распознаются лучше, звучат отдельно и чище, треки в целом стали менее мыльными и ближе к студийному качеству.

Добавили и больше жанров — теперь Suno умеет работать с электроникой, прог-роком, альтернативой и экспериментальными стилями. Алгоритм стал точнее угадывать настроение, темп и форму.

Пока доступ к v4.5 открыт только для подписчиков, но для тех, кто работает с генеративной музыкой — обновление стоящее.

❯ Duolingo запускает 148 новых курсов — с помощью ИИ

Duolingo представила сразу 148 новых языковых курсов, и почти все они были созданы с помощью генеративного искусственного интеллекта. По словам CEO Луиса фон Ана, то, на что раньше уходили годы ручной работы, теперь делается за несколько месяцев.

Для сравнения: разработка первых 100 курсов платформы заняла почти 12 лет. А теперь за год — почти полтора раза больше, и с адаптацией под 28 языков, включая региональные и менее распространённые.

ИИ помогает не только с написанием и переводом уроков, но и с адаптацией культурного контекста, генерацией упражнений, примеров, тестов и даже голосовой озвучкой. Это особенно важно, чтобы курсы чувствовались живыми, а не «склеенными нейросетью».

Компания заявляет, что планирует и дальше перевести образовательную часть на «AI-first» подход, включая замену части контрактных авторов автоматикой.

Duolingo — один из первых массовых EdTech-сервисов, который полноценно автоматизирует создание контента, и эта новость — сигнал всем образовательным платформам.

🧪 Исследования и технологии

❯ Anthropic пытается вскрыть «чёрный ящик» нейросетей

Исследователи из Anthropic — создатели моделей Claude — представили новый подход к интерпретации больших языковых моделей, который может помочь понять, что именно происходит внутри нейросети, когда она «думает».

Проблема в том, что поведение LLM до сих пор во многом остаётся непрозрачным: модели могут давать точные ответы, но мы не понимаем, как именно они к ним приходят. Это мешает доверию, безопасности и разработке более управляемых систем.

Anthropic разработала методику, которая позволяет разложить внутренние представления модели на компоненты. По сути — это попытка посмотреть в голову ИИ и увидеть, какие «мысли» возникают на разных этапах генерации. Авторы называют это «mechanistic interpretability» — механистическим пониманием.

Чтобы понять, почему модель галлюцинирует — и как это предотвратить

Чтобы настроить модель под конкретные логические или этические требования

И в перспективе — создать более безопасный и проверяемый ИИ

Исследование только в начале пути, но это одно из самых многообещающих направлений в AI-безопасности прямо сейчас.

❯ Live CC-7B: ИИ-комментатор с задержкой меньше секунды

Команда из Национального университета Сингапура представила модель Live CC-7B, способную комментировать спортивные события в реальном времени — с задержкой менее 0,5 секунды. Это одна из первых попыток превратить ИИ в полноценного диктора для живых трансляций.

В отличие от типичных генеративных моделей, которые «думают» дольше, Live CC-7B работает почти в прямом эфире, адаптируясь под события и меняющуюся обстановку. ИИ анализирует поток данных — текстовых, аудио или визуальных — и превращает их в внятный, связный комментарий.

Пример: модель может следить за матчем и на лету выдавать реплики вроде «опасный момент у ворот» или «игрок нарушил правила — судья поднимает карточку». Всё — без сценария и без предварительной подготовки.

Разработчики считают, что такая модель может быть полезна не только в спорте, но и в новостных лентах, аналитике рынков, игровых стримах и любых ситуациях, где важна быстрая реакция на происходящее.

❯ RSA 2025: как ИИ меняет кибербезопасность

На прошедшей в Сан-Франциско конференции RSA 2025 тема ИИ звучала особенно громко. В центре внимания — как нейросети помогают защищаться от атак, но также и как их используют сами злоумышленники.

Cisco представила новую open-source модель безопасности на 8B параметров, которую можно интегрировать в системы анализа угроз. А Google Cloud поделился исследованиями о том, как продвинутые хак-группы (APT) уже используют LLM — для фишинга, автоматического поиска уязвимостей и генерации вредоносных сценариев.

На панелях обсуждали и вопросы кооперации: крупные игроки говорят о необходимости делиться инструментами и знаниями, чтобы реагировать быстрее. ИИ позволяет ускорить реакцию на угрозу, но и поднимает новые вопросы о прозрачности, этике и контроле.

Вывод: кибербезопасность в эпоху ИИ — это не просто гонка технологий, а вопрос архитектуры доверия. RSA 2025 стала напоминанием: если ты не используешь ИИ для защиты — его используют против тебя.

❯ Квантовый кот Nirvanic: эксперимент на грани науки и философии

На конференции MARS 2025, которую ежегодно проводит Джефф Безос, канадский стартап Nirvanic представил робота KitCat — первого ИИ-агента, управляемого квантовой неопределённостью.

KitCat — это не просто милый робот с камерой. Его движения выбираются не алгоритмом, не случайностью, а квантовым суперпозицией. Сигнал с камеры дважды в секунду отправляется на квантовый компьютер D-Wave, где каждый раз из 32 возможных вариантов действий выбирается следующий — не предсказуемо, а физически неопределённо.

Зачем это всё? Команда Nirvanic пытается проверить гипотезу квантового сознания, которую ещё в 1990-х выдвинули Роджер Пенроуз и Стюарт Хамерофф. Согласно ей, наше мышление может зависеть от квантовых эффектов в микротрубочках нейронов мозга.

Чтобы это проверить, исследователи проведут миллионы итераций с двумя версиями KitCat: одна управляется классическим процессором, вторая — квантовым. Если поведение во втором случае будет статистически отличаться — это станет аргументом в пользу гипотезы.

Даже если теория не подтвердится, сам эксперимент уже важен: он может показать, как квантовые компьютеры способны управлять физическими системами в реальном мире.

❯ Gemini 2.5 прошла Pokemon Blue — но с подсказками

Недавно стало известно, что модель Gemini 2.5 Pro от Google прошла классическую игру Pokemon Blue от начала до конца.

Это не просто забавный факт — а заметный шаг вперёд в способности ИИ взаимодействовать с интерактивной средой, где нет чёткого текста, а есть правила, реакции и неизвестность.

Несколько месяцев назад подобную задачу пробовали дать Claude — и та застряла в самом начале. Gemini справилась: анализировала экран, принимала решения, управляла персонажем и прошла весь сюжет.

Но не всё так просто. У модели был доступ к игровому движку, а не только к изображению с экрана. Кроме того, в промпт добавили подсказки, и, возможно, Gemini опиралась на информацию из обучающих данных (включая советы и прохождения).

Это означает, что результат — не чистый zero-shot, и говорить о превосходстве над другими моделями пока рано. Но как демонстрация возможностей LLM в среде с агентной логикой — это очень мощный шаг.

Сейчас Google не выкладывает систему в открытый доступ, но очевидно — такие эксперименты уже становятся бенчмарками, и за ними стоит следить.

❯ ChatGPT определяет локацию по фотографии

С новыми мультимодальными моделями o3 и o4-mini ChatGPT научился делать больше, чем просто анализировать текст. Теперь он может угадывать локацию по фотографии — без EXIF-данных, GPS или подсказок. Только визуальный контент.

Как это работает? Модель анализирует детали изображения: архитектуру, стиль вывесок, язык, растительность, тип дороги, даже форму почтовых ящиков. При необходимости поворачивает, приближает и интерпретирует. И выдает:

страну,

предполагаемую широту и долготу,

и подробное обоснование, как она к этому пришла.

В промптах уже появился отдельный шаблон: «You are participating in a geolocation challenge…». С его помощью ChatGPT реально угадывает города и районы — особенно в США и Европе, где у модели больше визуального контекста.

Это может стать основой для новых бенчмарков по визуальному рассуждению, и уже используется в челленджах наподобие GeoGuessr.

Важно: распознавание лиц и частной информации отключено. OpenAI подчёркивает, что модель «не предназначена для слежки», и старается отказываться от подобных задач.

🏛 ИИ в обществе

❯ $3 млн, бан из универа и новая платформа: как студент придумал ИИ для собеседован

Осенью 2024 года студент Колумбийского университета Рой Ли (Чунгин Ли) с другом за 10 дней собрал Interview Coder — ИИ-инструмент, который помогает проходить технические собеседования на платформах вроде LeetCode.

Инструмент оказался рабочим: Рой получил офферы от Meta, TikTok, Amazon и Capital One*. Но когда видео одного из интервью стало вирусным, Amazon потребовал удалить его, а университет обвинил Ли в использовании ИИ для списывания и отчислил его до мая 2026 года.

Реакция Ли была дерзкой и вирусной:

«Может, хватит задавать тупые вопросы на собеседованиях — тогда люди не будут создавать подобную фигню».

И вот — через месяц он запускает новую платформу Cluely. Это расширенная версия Interview Coder, которую можно использовать не только на собеседованиях, но и на экзаменах, встречах и даже свиданиях. Подъём финансирования — $5,3 млн за три дня, подписки — уже $3 млн годовой выручки.

Сейчас Ли публично предлагает «взломать» любую систему, где царит формальность и автоматизм. Он не отрицает, что его подход вызывает вопросы — но считает, что ИИ должен менять не только технологии, но и устаревшие процессы оценки людей.

❯ Люси Го — новая самая молодая миллиардерша из AI-сферы

Люси Го, соосновательница Scale AI, официально стала самой молодой женщиной-миллиардером, обогнав по этому статусу Тейлор Свифт. Причина — крупная сделка с инвесторами, позволившая ранним сотрудникам и фаундерам продать доли, и резкий рост оценки компании до $25 млрд.

Го покинула Scale AI ещё в 2018 году — на фоне выгорания и разногласий с партнёром Александром Ваном. Но она сохранила 5% акций, которые сегодня оцениваются в $1,25 млрд.

До Scale AI она бросила университет, получив $100 000 от фонда Питера Тиля, стажировалась в Facebook*, работала в Quora и Snapchat. После ухода из основного проекта запустила венчурный фонд Backend Capital и платформу Passes — конкурента Patreon и OnlyFans, который уже оценён в $150 млн.

Сейчас Люси активно инвестирует в стартапы и ведёт блог, не стесняясь конфликтов.

«Мне комфортно в хаосе», — говорит она. И рынок это, похоже, ценит.

❯ Фиби Гейтс запустила ИИ-сервис для шопинга — и привлекла $500 000

Фиби Гейтс, младшая дочь Билла Гейтса, вместе с соседкой по общежитию Софией Кианни запустила Phia — ИИ-приложение, которое ищет одежду и аксессуары дешевле, сканируя десятки тысяч сайтов и маркетплейсов.

Phia не просто агрегирует цены, а отслеживает завышения, подсказывает альтернативы, ищет среди частных продавцов и даёт рекомендации на основе пользовательских предпочтений. Всё — через один клик.

Идея родилась, когда Фиби обнаружила купленное за $500 платье всего за $150 на сайте перепродажи. Она почувствовала себя, по её словам, «глупо» — и решила, что это можно автоматизировать.

Проект сразу получил $500 тыс. инвестиций — причём не от папы, а от Крис Дженнер (семейство Кардашьян), основательницы Spanx Сары Блейкли и венчурной инвесторки Джоанн Брэдфорд. Сам Билл Гейтс только одобрил идею морально, но участия не принимал — «чтобы избежать конфликта интересов».

Phia уже доступна в App Store и ориентирована в первую очередь на женскую аудиторию, фанатов скидок и resale-культуры. В описании — «мы те самые подруги, которые ссорятся из-за платья и сидят часами на шоп-сайтах».

❯ Самое маленькое искусственное сердце спасло семилетнего мальчика в Китае

В китайском городе Ухань врачи провели уникальную операцию: семилетнему ребёнку с тяжёлой сердечной недостаточностью имплантировали самое маленькое в мире искусственное сердце — всего 2,9 см в диаметре и весом 45 граммов.

Это устройство — не просто миниатюрная копия взрослых аппаратов. Оно работает на магнитной подушке: вращающиеся элементы не касаются стенок и не создают трения. Это снижает риск осложнений и делает сердце пригодным даже для очень маленьких пациентов.

У мальчика была диагностирована дилатационная кардиомиопатия, и его сердце перестало справляться с кровообращением. Донор не находился, и врачи приняли решение использовать искусственное сердце как временную поддержку до пересадки.

Операция длилась 5 часов. Уже на следующий день ребёнок начал дышать самостоятельно, функции сердца стабилизировались. Сейчас он восстанавливается и ждёт пересадку.

По данным китайского Минздрава, ежегодно в стране госпитализируют около 40 тысяч детей с тяжёлой сердечной недостаточностью, но пересадку получают меньше 100. Новый аппарат — совместная разработка медиков и биотех-стартапа Shenzhen Core Medical — даёт шанс многим из них.

🔮 Заключение

Подытожим. Вот что происходило на неделе с 28 апреля по 5 мая:

Open-source модели типа Qwen3 и DeepSeek уже догоняют GPT-4

Компактные LLM вроде OLMo 2 уделывают гигантов в ключевых задачах

AI подкасты, музыка, реклама, обучение — генеративка буквально везде

Всё больше инструментов для работы, автоматизации, создания агентов

Появляются вопросы — про сознание, галлюцинации, приватность

ИИ уже не тренд — это новая реальность, которую ты принимаешь или не принимаешь.

Интерфейсы, роли и привычки – всё меняется.

Какая новость поразила тебя больше всего? Пиши в комментах! 👇🏻