А поскольку я сомневаюсь что кто-то одолеет статью до конца то попытаюсь в этом абзаце кратко резюмировать основное содержание и возможно облегчить вам понимание в случае вы действительно настолько поехали крышей, что решили прорубиться через этот бред к финалу)) Эта статья представляет собой такую философскую попытку понять как может выглядеть ИИ, какие вообще предпосылки существуют для его развития и основные препятствия на пути. Главный страх связанный с ИИ это конечно же машинное порабощение или как минимум полное социальное подчинение, когда наши гаджеты следят за каждым нашим шагом и стучат в полицию и договорится с ними нет никакой возможности и человек со временем превратится либо лишь в органический придаток к Скайнет по типу водитель+ Убер, либо в пользователя который заблуждается по поводу реальности, а снаружи уже давно работает Матрица)) Основаны наши страхи в основном на постепенной автоматизации/ диджитализации рутинных наших действий, нашей личности (памяти, прогностических функций воображения и прч.), а это даёт в свою очередь два сценария развития: либо контроль над нами, либо пути к большим возможностям и эмансипации человека! Собственно Кибернетическая и Акселерационистская гипотеза. Кибернетический сценарий это оголтелая дистопия с полным полицейским контролем, когда людям остаётся только фокусироваться на микро-политической тактике выживания скрывая черты лица от камер и прочий киберпанк треш)) Акселерационистская гипотеза выглядит несколько сложнее, здесь видится некоторая политизация машин в том плане что их цели будут направлены не на экономику, а на познание, науку и таким образом капитализм исчезнет, а разум вырвется на трансцендентный уровень, машины объединятся в сеть! Что же это за трансцендентное измерение такое и что оно нам даёт? Об этом в Гипотеза "чужого". Это сложная часть, здесь мы вступаем в царство математики, хаотичности, неисчислимости, бесконечного разнообразия бесконечностей)) И выходит так что в нижние уровни логического мышление вкрадывается ошибка отсюда невозможность дедуктивного разума, на определённом этапе вычислений мы не можем сказать ложь или истина, логика становится динамичной и более того здесь появляется темпоральный аспект- истина временного характера, но это размыкает систему и как бы формирует вектор мышления в бесконечность. Ну и в Мультилогике рассказано о системе Пирса абдуктивно-индуктивно-дедуктивной схеме. Если вы не знали то дедуктивный метод Шерлока Холмса это совсем наоборот!)) не от частных доказательств к теории а от теории к частному, от абстрактных уровней вниз к деталям, индукция это в обратном порядке, а абдукция это когда есть А-_-В и по логике понятно что там Б, А-Б-В.

Можно предположить, что субъекта технологий нельзя удовлетворительно объяснить на основе прежних форм технологического порядка, которые ставятся в соответствие режимам "машинного порабощения" и "социального подчинения" (Делез и Гваттари). Например, режим "машинного порабощения" включает индустриальные механизмы воспроизводства, подчиняющие субъекта сенсорно-моторному поведению, расчленяя целостность индивида на частичные объекты, принадлежащие мега-машине индустриального капитала. Невротичный моно-ритм сборочного конвейера привёл к разрыву между действием и мышлением, устанавливая стандартный расход энергии, определяемый через эквиваленцию труда, времени и денег (Делез).

Однако, в той же мере как социо-аффективные качества пользователя становятся главным источником абстракции капитала, квантификации стоимости и правительственного контроля, ровно так же и сами технологии, как средства абстракции, производят изменение природы. Кибернетическая сеть коммуникаций не только абсорбирует физический и когнитивный труд в свои циклы воспроизводства, но также, что гораздо важнее, обучается на человеческой культуре - через дэйта-анализ поведения, контекстуальное использование контента и источников знания. Здесь я попытаюсь доказать, что субъект не является ни всего лишь порабощенным узлом машины, ни её вводимым в заблуждение пользователем. Напротив, субъект реконфигурируется из перспективы обучающейся машины, которая замещает исходные фазы накопления информации генеративными слоями коммуникации машина-с-машиной, разворачивая новую форму техно-культурного производства, основанную на искусственном интеллекте.

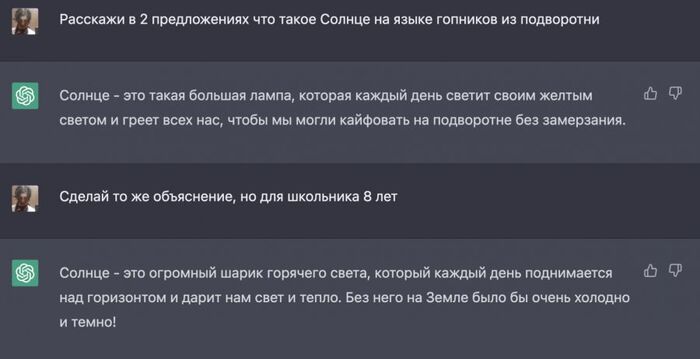

Если раньше машина работала на обеспечение аккумуляции знаний посредством извлечения и передачи данных, то сегодняшние автоматизированные системы познания скорее опираются на режимы обучения обучению и определенные формы прогностики паттернов. В этом новом контексте некоторые режимы машинного обучения работают просто как усилители социального знания (т.е. как эхо-камеры, воспроизводящие классовые, гендерные и расовые предрассудки), а другие, напротив, активируют способы прогностического обучения, связанные с рассуждениями на основании гипотез, устремляясь к сложным схемам принятия решений в тех случаях, где информации недостаёт (например, системы предсказания связанные с безопасностью, медицинские диагнозы и финансовые риски). В рамках этих форм прогностического определения паттернов происходит реконфигурирование субъекта в плане тех способов, которые определяют режимы мышления, не являющиеся ни заданными, ни сконструированными, а также - ни внутреннего генеза, ни внешнего. Субъект технологий опирается на динамическую форму автоматизации, запуская не автоматизацию заданной интуиции времени (т.е. ускорение решений), а производя ре-паттернизацию пространства мышления (т.е. расширяя диапазон поисков и ретродуктивно конструируя время мышления как определяемое неизвестностью). Вычисления включают в себя перформативную компрессию случайных величин (или неисчислимостей), вписываясь в общую инфраструктуру алгоритмического формирования паттернов.

Цель статьи - выступить против серво-механической модели технологий подвешивая презумпцию, что машины всегда уже сделаны по образу человека и по сути представляют то, чем человек является и что он делает. Правда же в том, что наше повседневное использование алгоритмических машин даёт нам иллюзию, что за нами наблюдают, что наше существование отслеживается, все наши шаги, все наши друзья, места где мы бываем, фиксируются параллельно тому что мы ищем, покупаем, продаём, что нам нравится и чего мы хотим. Тем не менее, что остаётся незамеченным в этой обычной применимости, это как раз реализация того, что инструмент само-определяющегося человеческого субъекта глубоко не соответствует серво-механической модели, через которую он становится "понятным".

Если машины говорят с другими машинами, если машины смотрят друг на друга, если они коррелированы в пространстве коммуникации, остающемся скрытым от человеческого взгляда, то следует говорить о том, что вопрос о цифровом субъекте затрагивает вторжение исчислимости в сферу мышления, порывая с само-определением человеческого сознания.

Чтобы ответить на эти вопросы я рассмотрю текущую полемику, которая происходит в широком диапазоне между двумя основными позициями. С одной стороны, негативная критика автоматизации заявляет о режиме субъекта как порабощенном сетевым капиталом, или что коллективный Тиккун называет "кибернетической гипотезой". С другой - позитивное доверие полной автоматизации, настояние на пере-ориентации средств порабощения, чтобы высвободить само-определение субъекта и пере-нацелить технологии на эмансипацию человека (акселерационистская гипотеза). Кибернетическая гипотеза также соединяется с полемикой о кризисе знания, условиях, где истины и законы заменяются автоматизированной индукцией данных, для которых субъекты это лишь коррелятивные аггрегации. Кризис истины напрямую предполагает провал дедуктивного разума, а именно - Западной метафизики с её колониальным проектом эмансипации, основанном на рабстве, и это - прототип автоматизации, который включает в себя серво-механизмы промышленного конвейера и когнитивной автоматизации.

Кибернетическая гипотеза

Принято считать, что для цифрового субъекта консистентность его органического единства раскалывается на байты и биты: бесконечно аггрегируемые части, создающие иллюзию некой цельности принятия решений по нашему клику.

Как пишет Devroy: "безразличные к феноменальной причинности автоматы функционируют согласно чисто статистическому наблюдению корреляций между захваченными данными в абсолюно не-селективной манере, в многообразности гетерогенных контекстов" (Rouvroy, Technology, Virtuality and Utopia, 2011).

сегодня за политическим измерением цифрового субъекта охотятся сети, корреляции, контуры обратной связи и способы включенности. Манифест коллектива Тиккун "Кибернетическая Гипотеза" напрямую обращается к этому парадоксу: Как может политическое высказывание для цифрового субъекта применять те же средства (инструменты и технологии), что и те, которые использует капитал для информационного доминирования?

Согласно Тиккун, киберетическая гипотеза это политическая программа, происходящая из либерального представления об индивидуализированном человеческом субъекте. Поскольку кибернетика охватывает информационными системами биологическое, физическое и социальное поведение, она преобразует этот либеральный взгляд в наборы рекомбинантных "дивидуалов" (Делез), направляемых индивидуальностями к определенным действиям во благо системы, от которой они все зависимы.

Будучи наукой прогнозирования, кибернетика преобразует индивидуального субъекта в наборы данных, поддерживая порядок, как если бы этот порядок соответствовал активному желанию единства. Однако, кибернетика одновременно инкорпорирует и трансцендирует либерализм, трансформируя социальное в лабораторию проб и ошибок, тестируя все возможные способы управления и следуя "экспериментальному протоколу". Это возможно, поскольку кибернетика заменяет модель власти, основанной на законе, механизмом извлечения и передачи информации, двигаясь к созданию новой империи данных, которая активно направляет поведение, проверяя и предугадывая. Для Тиккун forma mentis (форма разума) кибернетики - это расширение полицейского регулирования жизни: интеллектуальная война социальной связности это война против всего живого. Такая программатическая деструкция производит эвристических субъектов посредством системы, способной пересматривать эффективность своих правил соответственно человеческому отклику. Организуя проблемы неопределенностей (связанные с жизнью) в серии вероятностных сценариев, кибернетика расчленяет и собирает заново субъекта с применением статистической аналитики.

Чтобы лучше понять последствия такой позиции, можно обратиться к применению тактики невидимости в современной "пост-интернет эстетике". Например, проект Адама Харви CV Dazzle предлагает такого рода микро-политическую тактику избытка, фокусируясь на способах, препятствующих распознаванию лиц алгоритмами. Известно, что машинное видение базируется на паттернах узнавания, поскольку алгоритмы натаскиваются на обработке данных, имея дело с тысячами изображений лиц из сети, чтобы научиться составлять овальную форму лица или устанавливать идентичность, анализируя расстояния между ушами и глазами и т.п. Проект Харви скорее показывает как разрабатывать тактику, позволяющую скрывать черты - например, закрывая глаза или переносицу волосами, или же создавать черты, видеть которые алгоритмы не умеют (в отличие от людей), используя косметику для нанесения дополнительных линий на щеках и т.д.

... Такие попытки преодоления кибернетической гипотезы ... через призыв к политике обезличивания и невидимости по сути соответствуют реактивной реакции на кризис политических возможностей для мысли, действия и жизни за рамками кибернетического сценария. Еще важнее, что такой взгляд блокирует возможности критики из того контекста, где инструмент разума сам становится разумным, при том что дистопическому образу общества контроля противостоит мессианический призыв к миру вне инструментальности, где машинное мышление ограничивается эффективным решением задач.

Начиная с этого пункта кибернетическая гипотеза похоже упускает то, что предвидел уже Поль Вирилио в работе "Машина зрения" (1994), указывая, что полное преобразование оптических медиа в слепой разум компьютера с его скоростями процессинга отрывает машинное мышление от трансцендентальной модели оптического восприятия. Это подразумевает, что машины научатся опознавать то, что сейчас невидимо; технологии компьютерного зрения уже производят альтернативные образы, затрудняющие работу систем автоматизированного распознавания.

Но как возможно избежать техно-власти и техно-политики, предлагая при этом альтернативную критику автоматизации? Обратимся к гипотезе акселерационизма.

Акселерационистская гипотеза

Акселерационистскую гипотезу можно, в частности, понимать как акцентирующую на само-ограничивающей тенденции капитала, которая проявляется в нарастающей стоимости инвестиций в техническое оборудование (основные фонды), запуская внутреннюю критику капитала в форме машинного желания - или инструментальности - ускользнуть от его собственной трансцендентальной детерминации. Эта гипотеза начинается уже с возможности техно-наук не совпадать с само-определяющимся субъектом и его автоматизацией в целях функциональной эффективности.

Негри означает позитивно подойти к вычислительным возможностям, способным дать прирост продуктивности при резком снижении затрат рабочего времени (упорядоченного и управляемого машинами), поднять уровень зарплаты и социального обеспечения для всех. Не отвергая индуктивного извлечения и передачи данных, Негри призывает к пере-утверждению квантификации, экономического моделирования, анализа больших данных и абстрактных когнитивных моделей через образовательные и научные практики. Для него возможно политически перенацелить математические и вычислительные модели за пределы ограничений, налагаемых капиталом, на функции автоматизированного познания. Преодолевая негативную критику инструментальности, Негри реабилитирует политическое измерение техники.

Похоже, трудно представить такую политизацию машин и новую форму инструментальности в отрыве от понятной логики обмена, в которой машины по-прежнему могут сохранять свои серво-механические свойства, выступающие как товар на рынке. Как, например, могут тысячи алгоритмических сущностей использоваться во благо для экспериментирования с формами социальности; для кого это? - для человечества какого рода? Не стоит ли автоматизация с самого начала перед неопределенностью серво-механического понимания медиума мышления, или - что лежит вне трансцендентальных средств разума? Как заявляет Da Silva, трансцендентальный инструментарий или медиум разума определил онтологическое и эпистемологическое производство глобальной идеи расы, поскольку научная и историческая аналитика расы была частью процесса само-понимания субъекта. Как трансцендентальный инструмент, структура рассуждения должна подтверждать "чуждость" внешнего ему как того, что не может полностью умещаться в аналитической процедуре, если не позволить бесконечностям войти в пространство трансцендентального. Другими словами, как указывает Da Silva, если "чернота" (кожи) как квантовая бесконечность находится вне контура само-понимания "внутреннее-внешнее", то это потому, что она всегда подавляла трансцендентальное за пределами дедуктивной логики решений

Если из информационных технологий следует инструментальность, то это потому что данный медиум не просто ведет запись и пере-сборку данных, пере-сопрягая социальные онтологии. Напротив, инструментальность означает, что выполняемые действия становятся фильтром или способом артикуляции, и т.о. - познания или установки на познание информации, порождаемой в медиуме и его истории, культуре, воображении и онтологии. Поэтому центральным для критической теории автоматизации является не просто анализ того, как информационный медиум становится строителем мира или лишь средством для построения мира. Вместо этого критика должна заняться тем, как инструменты фильтруют мир - как они узнают тот мир а не этот, и как вычислительная абстракция даёт нам иной или "чужой" горизонт для представления мира, извлекаемого из его синтаксических функций но к ним не сводимого.

Сводя вместе теории алгоритмической информации и логический конструктивизм, возможно теоретизировать машинное мышление в понятиях логического преобразования отношений между истиной и обоснованием, привязывая образ цифрового субъекта к трансцендентальному исчислению. Вместо того, чтобы простирать действие инструментов разума на сферу машин, освобождая т.о. человеческого субъекта от ответственности за принятие решений и необходимости само-определения, "чужой" субъект ИИ скорее проявляет способности медиума по разработке трансцендентального измерения за пределами заданного набора программируемых команд.

....

Ниже происходит обсуждение этого трансцендентального измерения из перспективы не-дедуктивных форм вычислительной логики и информационной компрессии. Гипотеза "Чужого" требует такого пересмотра логики вычислений не просто чтобы предложить техническое объяснение человеческой ситуации, где игнорируется доминантный образ больших данных. Нужно показать онтологические следствия техно-научного формирования мира, которые требуют ре-концептуализации постулатов бытия за пределами уже данного и всегда уже сконструированного. Трансцендентальное исчисление т.о. берется для осуществления этой попытки реконцептуализации медиума мышления за пределами модерного представления серво-механической функции, которая мышления не имеет.

Гипотеза "чужого"

Согласно Gregory Chaitin вычислительная аксиоматика уже не может пониматься на языке само-полагаемых истин или постулатов и должна теоретизироваться с точки зрения экспериментальных алгоритмов, включающих контингентный процессинг хаотичности, где решение возникает в последней инстанции (в соответствии возможностям компрессии) и не зависит исключительно от бинарной логики (О и 1). Двоичные правила-функции машины Тьюринга устанавливают ожидание, что результат должен удовлетворять необходимым истинам. Вместо этого экспериментальная аксиоматика учитывает вторжение контингентности без необходимой каузальности, поскольку хаотичность или неисчислимость, бесконечные разнообразия бесконечностей, становятся каузальным условием вычислительного процессинга. ...

Согласно экспериментальной аксиоматике неисчислимости выдвигают реальное условие вычислительной неопределенности, которая проявляется в развилке между хаотичностью и алгоритмической дискретизацией. Неопределенность оказывается в центре этого размыкания между информацией, хаотичностью и формированием алгоритмических паттернов, и она же задаёт новый уровень континуальности между материальным и идеальным.

В статье “Computing Machinery and Intelligence” (1950) Тьюринг предположил, что дело в бихевиористски понимаемом воздействии среды на систему, а не внутренней работе сознания, что т.о. определяет автоматизированное мышление как режим обучения, а не просто запрограммированный черный ящик. Однако, обучение не только организует информацию в соответствии пред-заданным условным обозначениям и понятиям. Помимо всего обучение вызывает включение ошибочности или неопределенности в логическую схему формального рассуждения.

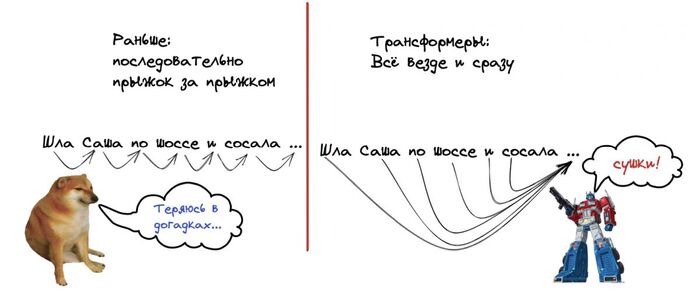

Попытки Тьюринга представить дедуктивную логику рассуждений на алгоритмическом языке говорят о том, что задача устранения контингентности неразрешима. Вместо автоматизации математическких истин Тьюринг открыл, что определенные постулаты не поддаются исчислению, поскольку: а) их нельзя упростить, разбивая на последовательные шаги, б) программа не можеть их понять заранее. Курт Гёдель уже в 1931 показал, что дедуктивное рассуждение является неполным...

Один важный смысл открытия неисчислимого состоит в том, что логическое рассуждение больше не может полагаться на дедуктивные выводы доказательства из истин, но должно скорее столкнуться с реальными бесконечными разнообразиями бесконечностей, неведомых неизвестностей. Этим отмечено вторжение ошибочности в логическое мышление, запускающее эвристический режим обучения на неизвестностях в формальной процедуре... Машина Тьюринга натолкнулась на пределы логической дедукции. В этом контексте становится очевидно, что материальные условия мышления далеко превосходят любую консистентную модель истин...

Вопрос об автоматизированном рассуждении следует развернуть к не-дедуктивным моделям вычислительной логики, где динамика отношений между истинами и обоснованиями способна дать почву для утверждений о возможности машин мыслить за пределами того, что они делают.

Взглянуть на такую возможность возможно в оптике логического конструктивизма. Это поможет объяснить как вычислительная логика обуславливается темпоральной неопределенностью в не-дедуктивных отношениях между истиной и обоснованием. Так, уже в 1927 Брауэр указал на неисчерпаемость математики и что она не может быть полностью формализована. Как общая система символической логики конструктивизм опирается не на традиционную концепцию истины, а на концепцию конструктивной доказуемости. В дедуктивной логике пропозициональные формулы всегда присваивают истинностное значение ("истина" или "ложь") безотносительно наличия свидетельств или доказательств для обоих случаев. Но для конструктивизма нет назначенного пред-установленного значения истинности. Вместо этого пропозиции полагаются "истиной" только когда имеется прямое свидетельство или доказательство. Именно так логика становится динамической.

Если для платонической модели репрезентации реальности математические утверждения (истина-ложь) и философское рассуждение лишены категории времени, то для конструктивизма истинность и ложность имеют темпоральный аспект. Подобным образом, в отличие от эмпиризма с индуктивным методом получения данных, где факты не подлежат изменению, для конструктивизма утверждение, подтверждаемое в определенный момент времени, до этого момента, по сути, не имеет истинностного значения. Двоица Брауэра актуализирует бесконечность через структурированный и сериально выстроенный процесс мышления.

Чтобы лучше понять как проблема неисчислимого может вести к новой теоретизации инструментализации рассуждения в машинах, важно обратить внимание на другой пример не-дедуктивной логики в вычислениях. Теоретик информации Грегори Чайтин обращается к экспериментальной аксиоматике чтобы рассмотреть информационную сложность (т.е. речь об информации, которая не поддаётся сжатию в более простые алгоритмические последовательности) (Chaitin, Meta Math! The Quest for Omega 2005). Чайтин поясняет, что вычисления определяются тенденцией разрастания информации в объеме. Подобно бесконечному счету чисел, информация не имеет завершения. Дедуктивное рассуждение т.о. не может приемлемым образом описать, что происходит в логическом мышлении машин. В этой перспективе можно предположить, что неисчислимости - как бесконечные многообразия бесконечностей (или хаотичность) - намечают траеторию вычислений начинающуюся с бесконечности и уходящую к бесконечность. Это уже предполагает, что вычисления (как нынешний режим инструментализации рассуждений) не соответствуют впрямую материально-историческому образованию медиа или содержащемуся в них практическому знанию (знания-как). Напротив, нужны решающие усилия чтобы понять, что происходит с этой тенденцией в плане бесконечности - становлением трансцендентальности вычислительных медиа.

Предусмотреть возможность трансцендентальных вычислений также означает сместить фокус на возникновение мышления из инструментальности, выступать за техно-логику, которая не просто допускает эффективность принципа "ноу-хау", но также развитие машинного познания. Здесь инструментальность это не средство достижения цели, но экспериментальный метод познания-как, стремящийся к установлению того или другого результата (и т.о. преобразующийся от познания-как к знанию того или другого). Формирование алгоритмических паттернов опирается на обучение с возможностью пересмотра и истин и фактов. В этой перспективе возможно допустить, что трансцендентальные вычисления входят в режим, при котором обоснования могут стать правила-порождающими, демонстрируя что постулаты или истины являются результатами компрессии неисчислимостей в дискретные паттерны (Chaitin, 2006). Как и в двойном движении двоицы у Брауэра, здесь конечное и бесконечности существуют в имманентном плане, который не просто поглощает их с тем, чтобы непосредственно обратить неисчислимости в знание. Напротив, трансцендентальная функция вычисления влечет за собой уровни медиации, которые включают инструментальную паттернизацию сложности, запуская, так сказать, "чужую" идеацию на основании того что могут машины.

Отходя от сетевого образа субъекта, коренящегося в материальной деятельности машин, внешним образом аггрегирующих данные в бесшовном море информации, можно задаться вопросом - каковы политические возможности (для) цифрового субъекта из перспективы трансцендентальной размерности вычислений? Другими словами, как понимать такого экспериментального субъекта в плане инструментального рас-человечивания логического рассуждения? Какие могут быть возможности "чужого" субъекта ИИ за пределами кибернетической гипотезы о захваченности данных сетью и акселерационистского пере-нацеливания техно-социальных коллективностей?

Мультилогика

Имея в виду эти вопросы, я обращаюсь к триадической системе логического рассуждения Чарлза Сандерса Пирса, основанной на том, что он называет "абдуктивно-индуктивно-дедуктивной схемой". Если кибернетическая формация субъекта определяется пространственным мышлением сети, то триадический метод Пирса проясняет аналитику, концептуальное развитие и спекулятивное обоснование логически не-выводимых правил. Начиная со спекулятивной функции разума (от рассуждения, не основанного на фактах или истинах, но действующего посредством гипотез), этот метод предвосхищает экспериментирование как с обоснованиями так и с истинами (Magnani, Abductive Cognition, 2009). Чтобы объяснить реальные феномены, становление истин следует за рядом гипотетических утверждений (абдукция) , привлекает совокупность измеримых данных (индукция), сопровождая это последовательным уточнением правил (дедукция). Правила не закрепляются и не являются символической репрезентацией материальных практик. Вместо этого правила выступают результатом экспериментального рассуждения, начиная с гипотетического рассмотрения неизвестностей и продолжая исследованием низко-уровневой паттернизации, которая форматирует истины и обоснования.

Разворачиваясь от пессимистичной констатации кризиса разума, познания и человека перед вызовом компьютерной логики, возможно заново поставить вопрос о технологиях вне "социо-генетического принципа" (Wynter), согласно которому биологическое объяснение само-создания человека сводится к протезному пониманию техне как простому расширению биологического субстрата "Человека эволюции".

Прагматистская триадическая схема логического мышления действительно способна предложить не бинарное различение, а синтетическое развитие аксиоматических, эмпирических и конструктивистских режимов рассуждения. Это предполагает не просто репрезентацию конкретных практик в закрепленных символических значениях, но, что более важно, экспериментальное абстрагирование отношений начиная с алгоритмических паттернов, как того, что уже подразумевает режим мышления о мышлении.