Купите максофон

Написать этот материал подтолкнула вчерашняя статья на хабре и ранее прочитанная статья на канала ресурса "Сталинград".

Мысли вкратце: Для установки национального мессенджера Мах купите на авито простенький смартфон на андроиде минимум 7 версии с 6 гб оперативы и 128 памяти. Можно с 4/64, но работает медленно.

Посмотрев несколько видео на како-то замедленном видеохостинге я понял, что такой аппарат лучше приобрести заранее и поставить все "стучащие" приложения (см картинку внизу), а также госуслуги, емиас... чтоб какая-никакая история использования наработалась и телефон не выглядел подозрительно на таможне в аэропорту и когда его попросят предъявить сотрудники полиции.

Основной смартфон (с впн, телеграм...) лучше сдавать в багаж.

P.S. Всё вышенаписанное является плодом воспалённого воображения и никакой ответственности за него автор не несёт. Мы живём в прекрасной стране, все нас уважают, скоро догоним и перегоним америку...

Кратко что я нашел

Макс отправляет на сервера VK то какие у вас скачаны приложения

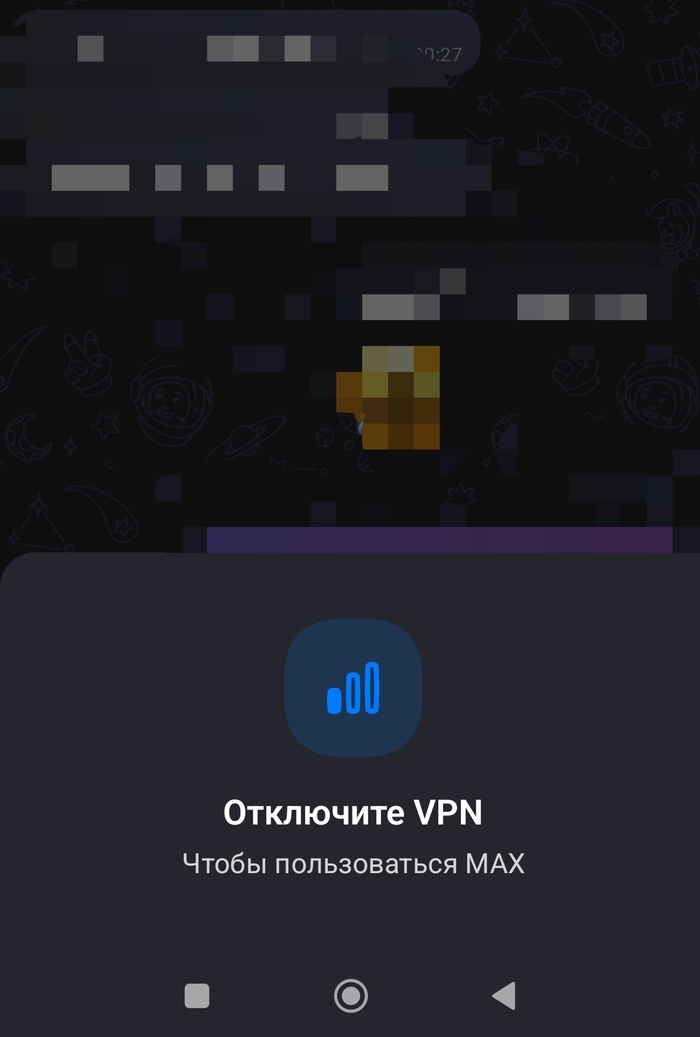

Детекцию VPN — приложение проверяет наличие VPN‑соединения и по команде сервера может полностью заблокировать вам доступ к чатам и мини‑аппам, пока вы его не выключите.

Тотальный трекинг адресной книги — MAX в реальном времени следит за изменениями контактов, отправляет серверу размер вашей телефонной книги и собирает хеши номеров даже тех людей, которые в мессенджере не зарегистрированы.

Обход Google Play и жесткий Force Update — сервер может заблокировать работу текущей версии приложения и принудительно установить апдейт со своего CDN, причем в коде заложена возможность ставить APK в обход системы.

Управление NFC‑чипом из мини‑апп — любое внутреннее мини‑приложение может без предупреждения передать на NFC‑терминал свой кастомный payload (например, имитировать пропуск или карту).

Фейковые чаты

Удаление сообщений из базы пушами — сервер может отправить скрытый пуш‑запрос, который сотрет сообщение прямо из локальной базы данных на вашем телефоне без следа, или незаметно запросить ваши координаты.

Отключение TLS‑валидации и RCE

Передачу номера (Mobile ID) по открытому HTTP — для авторизации без SMS мессенджер шлет запросы операторам в незашифрованном виде, чтобы те вписывали ваш номер в заголовки. Этот же механизм доступен системным мини‑аппам без вашего ведома.

Скрытый SDK деанонимизации и запись звука — обфусцированный модуль trace_flow собирает реальные IP‑адреса в обход VPN, а функция collect-debug-dump позволяет серверу тайно писать сырой звук с микрофона во время звонков и заливать его в аналитику.

Аппаратный фингерпринт через Widevine DRM — для отслеживания используется неизменяемый ID из защищенной зоны процессора (TEE), который невозможно сбросить даже после удаления приложения или Hard Reset устройства.

ZipSlip уязвимость в DownloadService (Удаленное исполнение кода)

И много всего другого

И для тех кто дочитал пост до конца - бонус. Статья о том почему приложения яндекса тоже стоит вынести в максофон - https://habr.com/ru/articles/370411/

Кстати

Как то на хабре проводились расследования, отслеживает ли мессенджер мах наличие ВПН на устройстве. Подошли крайне серьезно, препарировали код, компоненты, службы, отслеживали изменения трафика, какие то метки итд. Ломались копья в комментах, технические термины, эмоции, накал страстей!

Сегодня на моем телефоне:

Ответственно заявляю: да, отслеживает! 🤣🤣🤣

Большой Брат

Залез я тута, на маркетплейс один. Ну помощника виртуального выбрать. На Алис наткнулся. Читаю отзывы и вопросы. Некая дама спрашивает.

Д- Здравствуйте! Может или работать автономно, без зарядки?©

А Яндыкс ей отвечает цитата.

Здравствуйте, Наталья! Наши ИСЛЕДОВАНИЯ ПОКАЗАЛИ, что пользователи часто ПЕРЕНОСЯТ Станцию Лайт внутри дома и берут её с собой в гости, поэтому специально для второго поколения мы создали внешний аккумулятор. ©

Так что выдыхаем, ни кто ни за кем не следит. Это все исследования.

Кого будет щемить налоговая

Каждый день сталкиваясь повсеместно с участниками теневой экономики, уже очень долго задумываюсь о её гигантских реальных масштабах.

Судите сами, идёшь на рынок, приветливые южане, на вопрос об оплате картой, дают тебе картонку с написанным номером Сбера на имя такого то ...Оглы. Едешь на автосервис в гаражах, и там с удовольствием примут твой перевод на карту. Снимаешь квартиру - перевод на карту. Вызываешь сантехника - оплата на карту. Супруга идёт к парикмахеру, косметологу итп, и конечно каждый из них с радостью примет безналичные рубли на свою карту.

Фактически в России существует две экономики: одна белая, легальная и довольно сложная и затратная, а другая серая, простая и очень приятная, поскольку не облагается налогом (...пока не облагается). И долгое время, они довольно мирно сосуществовали, предпочитая, как будто бы не замечать друг друга.

Почему так? Потому что просто, удобно и безнаказанно. Как-то моя супруга спросила у своего косметолога, не боится ли она принимать такое большое количество переводов от клиенток на свою карту? И так без зазрения совести ответила, что её подружка работает в налоговой и рассказала ей, что переводы в сумме до 200000 рублей в месяц, их не интересуют. Удивительно, на сколько она была права...

10 миллионов россиян могут попасть под усиленный контроль ФНС из-за переводов на карты.

Речь о тех, кто регулярно зарабатывает более 200 тыс. рублей в месяц на аренде, подработках, услугах или мелкой торговле, но не оформляет статус самозанятого или ИП и не декларирует доход. В зоне внимания окажутся и самозанятые с выручкой выше 2,4 млн в год, скрывающие часть поступлений, — таких насчитывается примерно 200 тыс. пруф

В условиях продолжающегося сужения кормовой базы, санкционного давления, дефицита бюджета, пятилетней СВОйны, государство, похоже, всеже решилась "пощупать" население, на предмет наличия денежных средств. При чем, самую экономически активную, предприимчивую и лёгкую на подъём, часть населения... Время мирного сосуществования - закончилось.

Нужно больше золота! ©

19.04.2026 Станислав Райт — Русский Инвестор

Откуда спамеры всё знают?

Не знаю, может уже и было, но столкнулся впервые.

Бродил вчера по сети, гуглю и разбираюсь с одним юридическим вопросом.

Захожу на сайты, читаю что там по данному вопросу написано.

Через час звонок на телефон.

- Здравствуйте, я сотрудник такой то организации (довольно известной). Вам нужна юридическая консультация по такому то вопросу? (как раз что я и гуглил).

- Нет спасибо, не нужно.

- Ну тогда извините за беспокойство.

Лезу в историю браузера. Точно, я заходил на их сайт.

Но я там не зарегистрирован, никаких моих данных там не оставлял. Прочитал статью и сайт закрыл.

И вот теперь вопрос.

Конечно отследить параметры компьютера с которого заходили на сайт и даже АР-адрес несложно. Но как узнать что заходил конкретный человек и при этом знать его номер телефона? (не имея данных от сотовой компании)

И это простая коммерческая организация.

P.S. Я работал на ноутбуке, а заходил в сеть через мобильный интернет не в своём городе.

Короче мы под колпаком намного больше чем нам кажется.