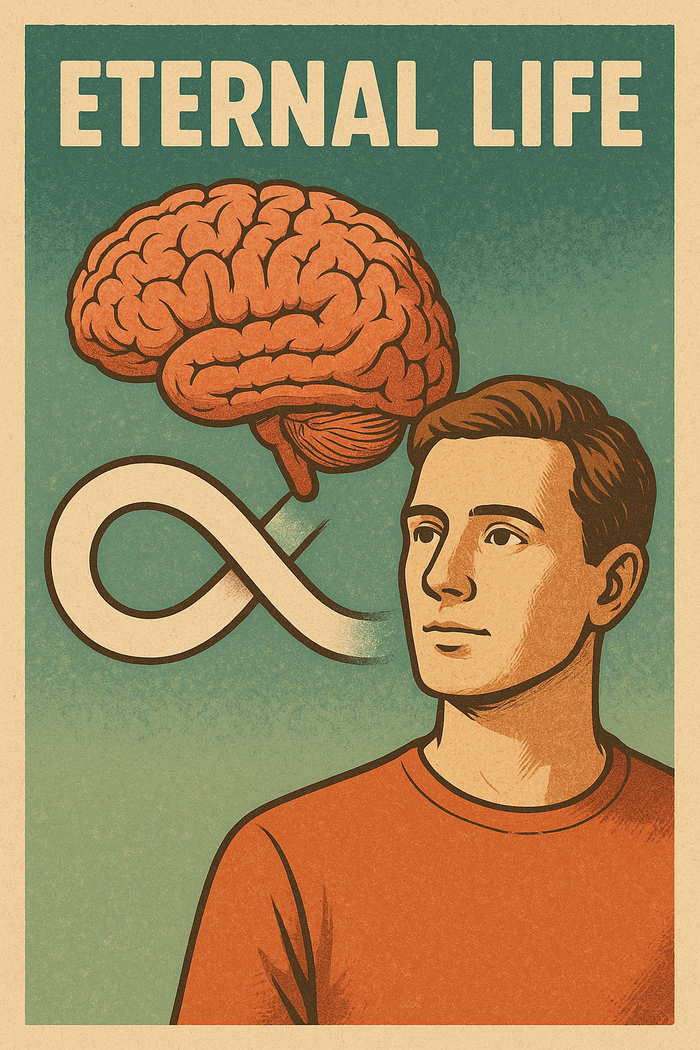

Бессмертие возможно. Но мозг человека "сломается" уже через 200 лет. Всему виной биологические "ограничители" вечной жизни

Данный пост является рассуждением, основанным на известных фактах из философии, нейробиологии, а также содержит собственную точку зрения. Информация изложена тезисно, чтобы не грузить читателя сухими массивами текста и состоит из четырех частей. Важно не воспринимать содержание поста буквально, обязательно критически воспринимайте всю информацию, с которой сталкиваетесь в жизни. Данный пост - это рефлексия на одну из вечных тем человечества.

Делитесь в комментариях своими впечатлениями и рассуждениями.

Часть первая: "Возможно ли бессмертие в принципе?"

Прежде чем погрузиться в дискуссию, необходимо четко обозначить контекст. Мы рассматриваем временно́е биологическое бессмертие — состояние, при котором человек перестает стареть и умирать от болезней, но сохраняет уязвимость к внешним факторам (травмам, несовместимым с жизнью, насильственной смерти и т.д.). Это наиболее реалистичный сценарий с позиции современных технологий, в отличие от абсолютной неуязвимости или цифрового сознания, которые пока остаются в области спекуляций.

Гипотеза: как возможно бессмертие в современной эпохе?

С биологической точки зрения, старение — это накопление клеточных повреждений, укорачивание теломер, износ органов и ослабление регенерации (достижение предела (лимита) Хейфлика ~50 делений клеток, после чего наступает запрограммированная гибель клетки - апоптоз).

Теоретически, если наука найдет способы:

Останавливать старение (например, через редактирование генов, подавление механизмов старения).

Регенерировать ткани (стволовые клетки, биопринтинг органов).

Поддерживать мозг (нейромодули и протезы, предотвращение нейродегенерации),

то биологическое бессмертие станет возможным.

Технологии, которые могут к этому привести:

🔹 CRISPR и генная терапия – исправление «ошибок» ДНК.

🔹 Сенолитики – лекарства, уничтожающие стареющие (сенесцентные) клетки.

🔹 Искусственные органы и нанороботы – замена изношенных тканей.

🔹 Модификация метаболизма, контролируемая сознанием при наступлении критических изменений во внешней или внутренней среде.

Плюсы бессмертия

✅ Бесконечное время для развития – наука, искусство, самопознание.

✅ Отсутствие страха смерти (если не считать насильственную гибель и травмы).

✅ Накопление опыта – мудрость не утрачивается со сменой поколений.

✅ Межпланетная колонизация – долгие космические перелеты станут реальнее.

Минусы и риски

❌ Перенаселение и ресурсы – если бессмертных станет много, Земля не выдержит.

❌ Социальный застой – власть и богатство могут концентрироваться у одних и тех же людей веками.

❌ Психологическая усталость – выдержит ли психика сотни лет жизни?

❌ Потеря смысла – смерть часто мотивирует действовать здесь и сейчас.

❌ Неравный доступ – бессмертие может стать привилегией элиты.

Предостережения

⚠️ Эволюционный отказ от бессмертия?

Природа «выбрала» смерть не просто так – она позволяет виду адаптироваться. Если люди перестанут умирать, генетическое разнообразие может сократиться, что опасно перед лицом новых болезней и эволюции всей окружающей среды.

⚠️ Этика и право

Как быть с преступниками, которые живут вечно? Стоит ли принудительно «выключать» некоторых людей?

⚠️ Конец смены поколений

Если новые поколения не будут рождаться, исчезнет двигатель культурного и социального обновления.

Вывод по первой части обсуждения:

Бессмертие возможно, но оно потребует не только технологического прорыва, но и пересмотра всей структуры общества.

Главный вопрос – не «можно ли», а «нужно ли».

Если человечество выберет этот путь, оно должно быть готово к:

🔸 Жесткому контролю рождаемости и/или готовности перемещаться на другие планеты, что автоматически снимет проблему с перенаселением при условии равенства вечной жизни для всего населения.

🔸 Глобальному перераспределению ресурсов.

🔸 Глубокой психологической адаптации.

Часть вторая: "Вечная жизнь в обмен на репродукцию населения"

Преимущества такого обмена

✅ Контроль перенаселения – главная проблема бессмертия решена: новые люди не рождаются, ресурсы не истощаются.

✅ Снижение социального напряжения – нет конфликта поколений за власть и ресурсы.

✅ Фокус на качестве жизни – вместо "жить, чтобы продолжить род" — "жить, чтобы развиваться".

✅ Эволюционный компромисс – биологически вид не вымирает, но и не мутирует в непредсказуемую форму.

Опасности и этические ловушки

❌ Утрата смысла для многих людей – для некоторых продолжение рода — главный двигатель жизни.

❌ Генетический застой – если все бессмертные стерильны, то вид лишается адаптивности. Новые болезни или изменения среды могут убить всех.

❌ Кто решит, кто достоин? – если бессмертие дается не всем, то по каким критериям? Богатство? Интеллект? Послушание?

❌ Психологический кризис – если человек не может оставить потомство, не превратится ли он в аналог "вечного подростка" без долгосрочных целей?

Сценарии развития

Добровольный выбор (как в х/ф "Дивергент")

Люди сами решают: либо дети, либо вечная жизнь.

Проблема: большинство выберет бессмертие из страха смерти, и человечество вымрет за несколько поколений.

Принудительная стерилизация (как в х/ф "Гаттака")

Государство или корпорации контролируют доступ к бессмертию.

Проблема: рождается кастовая система (бессмертные "элиты" vs. смертные "низы", которые размножаются).

Искусственная эволюция

Люди отказываются от биологического размножения, но создают новых индивидов искусственно (клонирование, ИИ-потомство).

Проблема: это уже не Homo Sapiens, а что-то новое, например, Homo Artificiale.

Философский аспект

🔹 Смерть и размножение — две стороны одной медали. Биологически мы запрограммированы умирать, чтобы дать место новым комбинациям генов. Если убрать оба элемента, человек перестает быть "животным" в классическом понимании.

🔹 Альтруизм исчезнет? Часть мотивации помогать другим — инстинкт сохранения рода. Если его нет, станет ли человечество более эгоистичным?

Вывод по второй части обсуждения:

Такой обмен (вечная жизнь ↔ отказ от потомства) технически возможен, но чреват:

Вырождением (если все выберут бессмертие).

Дистопией (если выбор будет нечестным).

Экзистенциальным кризисом (если смысл жизни окажется утрачен).

Альтернатива:

Возможно, более устойчивый вариант — циклическое бессмертие, где люди:

Живут 200–300 лет,

Затем добровольно уходят, освобождая место новым поколениям,

Но их сознание сохраняется в цифровом виде (как "наследие").

Часть третья: "Инстинкты - биологические инструменты сохранения вида как невидимая преграда на пути к вечной жизни"

Человек — это представитель царства животных с мощной корой головного мозга, но его поведение всё ещё во многом определяется древними инстинктами. Если мы дадим людям бессмертие, некоторые из этих "встроенных" программ станут бесполезными или даже вредными, а другие окажутся критически важными.

Рассмотрим основные инстинкты и их роль в мире бессмертных:

1. Инстинкт самосохранения (страх смерти)

✔ Сохранить? → Да, но в изменённой форме.

Зачем? Даже бессмертный может погибнуть от несчастного случая, войны или травмы. Без страха смерти люди станут безрассудными.

Последствия отключения: Рост числа неосторожных смертей, исчезновение мотивации избегать опасностей.

2. Репродуктивный инстинкт (продолжение рода)

✔ Сохранить? → Нет (если бессмертие даётся в обмен на стерильность).

Зачем убирать? Бесконечное размножение бессмертных приведёт к перенаселению (при условии, что переселение (экспансия) на другие планеты или системы не подразумевается).

Последствия отключения:

✅ Исчезнет давление "биологических часов", люди смогут посвятить жизнь чему угодно.

❌ Возможен экзистенциальный кризис ("зачем жить, если не для детей?").

❗ Компромисс: Можно оставить либидо, но заблокировать зачатие.

3. Иерархический инстинкт (борьба за статус)

✔ Сохранить? → Да, но ослабить.

Зачем? Конкуренция двигает прогресс, но в бессмертном обществе она может привести к вечным войнам.

Последствия отключения:

✅ Меньше агрессии, больше кооперации.

❌ Возможен застой (если никто не стремится быть лучше).

4. Пищевой инстинкт (голод/жажда)

✔ Сохранить? → Зависит от типа бессмертия.

Если бессмертные всё ещё биологические – оставить, иначе они умрут от недоедания.

Если их тела синтетические – можно убрать, заменив на альтернативное, неисчерпаемое "подзарядку".

Последствия отключения:

✅ Нет необходимости тратить время на еду.

❌ Исчезнет культура питания (кухня, рестораны, ритуалы).

5. Исследовательский инстинкт (любопытство)

✔ Сохранить? → Обязательно!

Зачем? Без него бессмертные превратятся в пассивных наблюдателей, прогресс остановится.

Последствия отключения:

❌ Человечество деградирует.

6. Инстинкт заботы о потомстве ("Материнский инстинкт")

✔ Сохранить? → Только если есть кому о ком заботиться.

Если размножение запрещено – бесполезен.

Если остались смертные – можно перенаправить на обучение новых поколений.

Последствия отключения:

✅ Нет страданий из-за невозможности иметь детей.

❌ Потеря эмпатии, одичание общества.

7. Агрессия (защита территории/ресурсов)

✔ Сохранить? → Минимизировать.

Зачем? В бессмертном мире войны должны быть исключением.

Последствия отключения:

✅ Меньше насилия.

❌ Возможна потеря способности к самообороне.

Оптимальный набор инстинктов для бессмертного человека

Сохранить:

Исследовательский (двигатель прогресса).

Модифицированный самосохранения (без паранойи).

Ослабленный иерархический (конкуренция без насилия).

Убрать/подавить:

Репродуктивный (если бессмертие даётся в обмен на стерильность).

Чрезмерную агрессию.

Перепрофилировать:

Инстинкт заботы → в менторство, творчество, альтруизм.

Что будет, если отключить ВСЕ инстинкты?

Человек превратится в апатичного киборга без мотивации что-либо делать.

Пример:

Без страха смерти → не будет избегать опасностей.

Без любопытства → не станет развиваться.

Без иерархии → исчезнет стремление к достижениям.

Итог: Бессмертие без инстинктов = вечное прозябание.

Лучший вариант: избирательная настройка

Бессмертные должны сохранить базовые драйверы поведения, но убрать деструктивные элементы (агрессия, гипертрофированный статус, обязательное размножение).

Идеальный баланс:

🔹 Смысл жизни → не в детях, а в бесконечном познании и творчестве.

🔹 Мотивация → не страх смерти, а любопытство и самореализация.

🔹 Социум → не конкуренция, а кооперация ради вечного развития.

Часть четвертая. Эмоции и вечная жизнь: может ли человек существовать вечно без "химии чувств"?

Абсолютно все наши эмоции, ощущения и зависящие от них решения и действия - это выброс определенной концентрации нейромедиаторов одними нейронами и поглощение другими в синапсах (соединениях двух и более нейронов), что и формирует конкретную эмоцию (ощущение) в конкретный момент времени и в конкретных обстоятельствах (условиях). Т.е. человек по своей сути без нейромедиаторов - "пустышка". С позиции нейробиологии сознательно мы не можем контролировать выброс определенных концентраций нейромедиаторов, а полностью зависим от внешних и внутренних факторов, провоцирующих те самые реакции. Головной мозг - "биохимический котел", от которого по сути зависят все сознательные действия человека. Даже самые возвышенные мысли и решения — результат работы дофамина, серотонина, кортизола и других соединений. Если мы даруем кому-то бессмертие, возникает ключевой вопрос:

Можно ли (и нужно ли) отключать эмоции, чтобы обрести вечную жизнь?

Разберём эту дилемму через призму нейрохимии, психологии и социальной адаптации.

1. Эмоции как "топливо" для бессмертия

Какие эмоции полезны для вечной жизни?

✅ Любопытство (дофамин) – без него бессмертный человек превратится в апатичное существо, лишённое мотивации.

✅ Удовольствие (эндорфины, серотонин) – помогает избежать экзистенциальной тоски.

✅ Эмпатия (окситоцин) – критична для поддержания социальных связей.

Какие эмоции опасны?

❌ Страх смерти (кортизол) – бессмертному он не нужен, но его полное отключение сделает человека безрассудным.

❌ Депрессия (дисбаланс серотонина) – в вечной жизни её риск возрастает (см. "синдром Тулеанца").

❌ Агрессия (норадреналин) – в бесконечном времени может накапливаться, приводя к разрушительным поступкам.

→ Вывод: Полное отключение эмоций = путь к бессмысленному существованию. Но их избирательная регуляция может помочь адаптироваться.

2. Проблема "накопленной травмы"

Даже если человек бессмертен, его память остаётся. А значит:

🔹 Негативные воспоминания (боль, предательства, потери) будут копиться веками.

🔹 Позитивные эмоции могут притупляться (как у вампиров из фольклора, которым всё "приедается").

Пример:

500-летний человек пережил десятки войн, смерть тысяч знакомых.

Его лимбическая система либо перегружена, либо он научился подавлять эмоции (став подобием социопата).

Решение?

Селективное забывание (как в "Вечном сиянии чистого разума").

Искусственная стабилизация настроения (нейроимпланты, подавляющие избыточный кортизол).

3. Контроль vs. Естественность: что лучше для бессмертного?

Вариант 1: Оставить эмоции "как есть"

Плюсы: Человек остаётся "собой", жизнь сохраняет вкус.

Минусы: Риск психических срывов из-за накопленного стресса.

Вариант 2: Полная регуляция химии мозга

Плюсы: Нет страданий, вечное "блаженство".

Минусы: Исчезает мотивация, творчество, любовь.

Вариант 3: Гибридная модель

"Режим спокойствия" – притупление негатива, но сохранение радости.

"Творческие волны" – искусственные выбросы дофамина для вдохновения.

→ Лучший компромисс: Управляемая нейропластичность, где человек может настраивать эмоции, но не теряет их полностью.

4. Связь эмоций и "продолжительности" бессмертия

Парадокс: чем дольше живёт человек, тем сильнее эмоции влияют на его "качество бессмертия".

🔸 Если оставить всё как есть:

Через 200–300 лет риск эмоционального выгорания.

Возможны циклы депрессий и маний.

🔸 Если отключить часть эмоций:

Жизнь станет стабильной, но пресной.

Исчезнет желание развиваться (зачем что-то менять, если нет дискомфорта?).

→ Итог: Эмоции нельзя ни оставить в неизменном виде, ни полностью удалить. Нужен баланс, возможно, с помощью:

Генетической модификации (снижение выработки кортизола).

Нейроинтерфейсов (искусственная стимуляция "нужных" зон мозга).

Психонавтики (осознанное управление биохимией мозга через медитацию или техники - но это не контроль всей работы медиаторных систем, а только отдельных зон и не всегда эффективных).

Философский итог: кто мы без эмоций?

Бессмертие без чувств – это существование, но не жизнь. Однако вечная жизнь с неуправляемой "химией души" – путь к вечным страданиям.

Оптимальный путь:

Сохранить базовые эмоции (радость, любопытство, эмпатию).

Ослабить деструктивные (страх, ярость, отчаяние).

Добавить "контрольные точки" – возможность перезагружать психику.

Иначе бессмертие станет проклятием в золотой клетке.

Что думаете? Вы бы согласились на вечную жизнь, если бы пришлось пожертвовать одним или всеми перечисленными факторами (репродукция, интеллект, эмоции) или у Вас есть собственная точка зрения о том, как остаться человеком в привычном нам понимании с обретением вечной жизни?

Делитесь в комментариях своими впечатлениями и рассуждениями.