В Торонто судья заподозрил, что адвокат направила в суд документ, частично сгенерированный с помощью ИИ (возможно, ChatGPT). И теперь ей грозит разбирательство за неуважение к суду.

Адвокат представляла клиента по сложному делу в сфере наследственного и семейного права. В своём процессуальном документе она сослалась на несколько прецедентных решений. Только вот судья, изучив эти решения, обнаружил, что некоторые из дел просто не существуют, другие - интерпретированы с ошибками, а третьи вообще никак не связаны с рассматриваемым вопросом. Например, одно касалось коммерческой недвижимости, другое - увольнения. А некоторые приведённые в документе ссылки вообще вели на страницы с ошибкой 404.

Когда судья попросил адвоката показать копии этих решений, она этого сделать не смогла. В итоге судья пришёл к выводу, что документ, похоже, был создан ИИ, а адвокат даже не проверила, существуют ли эти дела на самом деле и подтверждают ли они её аргументы.

В своём решении он отметил: у юриста есть обязанности - не ссылаться на выдуманные дела и не вводить суд в заблуждение. А ещё - проверять всё, что он подписывает, и использовать технологии с умом.

Теперь адвоката вызвали на специальное заседание, где она должна объяснить, почему её не стоит привлекать к ответственности за неуважение к суду.

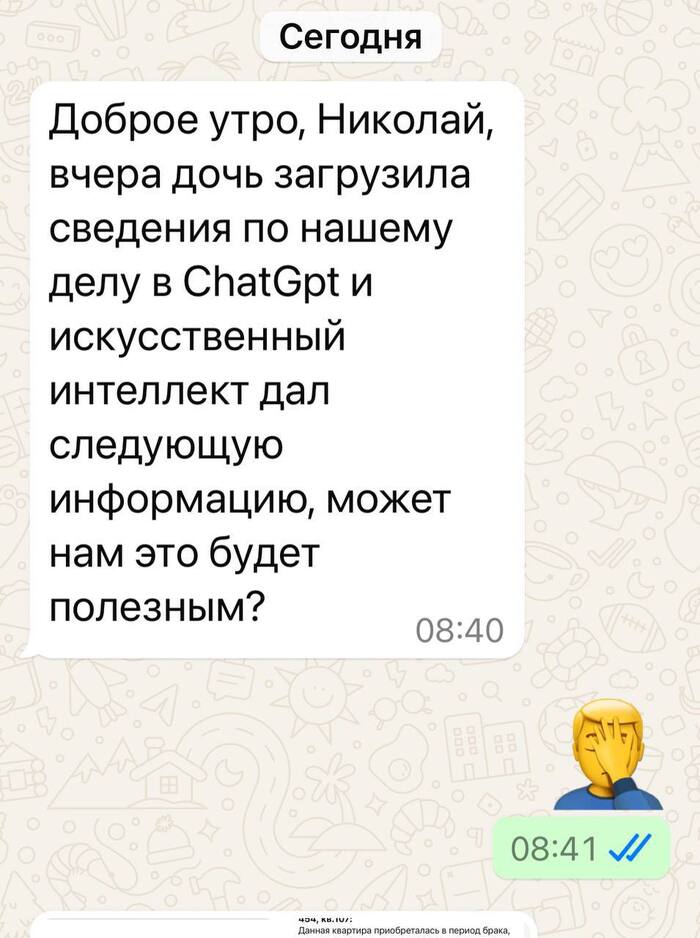

ИИ - не магия, а мощный инструмент. Но не универсальный. И если вы решили его использовать - проверяйте, что он вам "нагенерировал". Иначе можно попасть в неловкую ситуацию.