Искусственный интеллект

Меня обвинили в продвижении китайского ИИ

Написал тут человек насчет моего Ютуб-канала ИИ by AIvengo.

Канальчик-то, похоже, подсадной. Тихой сапой толкает к китайскому ИИ, полегоньку дискредитируя западные ИИ-модели. В бан, гаденышей.

Про китайцев была ровно одна новость - "Новый ИИ от DeepSeek".

То есть человек не пишет Сэму Альтману, который про AGI везде вставляет, модели скрывает, пытается через суд получить неправомерно документы, что аж даже судья офигевает от такого финта.

И ещё мы помним про загадочную смерть свидетеля против OpenAI, который хотел добиться правды и оглашения данных компании - но внезапно умер. Сам. Ну, бывает.

Также он не пишет основателю Anthropic Дарио Амодей, который выпустил заявление и публично защищается от обвинений в политической предвзятости ИИ. Про это в сегодняшнем выпуске будет.

Он прямо перечисляет все способы, которыми компания сотрудничает с правительством Трампа: контракт с Министерством войны на 200 миллионов, партнёрство с Palantir и присутствие на мероприятиях в Белом доме.

Я, видите ли, дискредитирую... Нужно только хорошо про западные модели, и никак иначе. Ишь, замечать косяки вздумал!

--

Мой тг-канал: ИИ by AIvengo, пишу ежедневно про искусственный интеллект

Как быстро и просто создать обучающее видео с искусственным интеллектом: пошаговая инструкция

Как быстро и просто создать обучающее видео с искусственным интеллектом? В нашей пошаговой инструкции вы найдете все необходимые этапы для успешного выполнения этой задачи.

Как ИИ меняет подход к созданию образовательных видео

Многие уверены: чтобы снять хороший учебный ролик, необходима команда специалистов, дорогая техника и долгий монтаж. На деле, современные ИИ-сервисы позволяют собрать качественный обучающий контент буквально за 15–20 минут без особых знаний и опыта.

Видеоуроки сегодня — эффективнейший формат подачи информации. Согласно аналитике 2025 года, Wistia отмечает: образовательные how-to ролики удерживают аудиторию дольше, чем другие типы контента. В среднем зрители досматривают 26% длительности такого видео.

Однако классическое производство видеороликов требует серьезных вложений: аренда студии, покупка аппаратуры, услуги актеров, написание сценария и монтаж — итоговая стоимость может легко перевалить за 100 000 рублей за короткий фильм продолжительностью 3–5 минут.

ИИ-инструменты полностью меняют правила. Сейчас создать профессиональный образовательный ролик можно самостоятельно и с минимальными затратами. Качество при этом не уступает студийным работам.

Как сделать обучающее видео за 20 минут: пошаговая схема

Самый удобный и быстрый вариант — совмещать три инструмента: ChatGPT для написания сценария, нейросети для генерации визуальных материалов и синтезатор речи для озвучивания. Рассмотрим процесс поэтапно.

Этап 1. Написание сценария через Telegram-бот в ChatGPT

Начинать лучше с четкой и логичной структуры. Для учебного видео отлично подходит последовательность: обозначаем проблему → предлагаем решение → показываем результат. Идеальная продолжительность — 3–7 минут. Исследования показывают: ролики до 90 секунд смотрят до конца 54% зрителей, а видео длиннее 10 минут полностью просматривают только 24%.

Пример промта для генерации структуры сценария:

Сформируй структуру обучающего видео по теме [ВАША ТЕМА] с длительностью 5 минут. Целевая аудитория: [ОПИСАНИЕ АУДИТОРИИ]. Формат: вводный крючок (15 сек) + обозначение проблемы (30 сек) + пошаговое решение (3,5 мин) + финальный призыв к действию (45 сек). Укажи тайминг для каждого этапа и выдели ключевые фразы для вовлечения зрителя.

Промт для создания подробного видео-сценария:

Используя предложенную выше структуру, составь расширенный сценарий для обучающего ролика.

Условия:

Описывать каждую сцену по отдельности с детальным изображением того, что видит зритель

Озвучка — простая, разговорная

Добавлять инструкции для оператора: смена планов, движение камеры

Выделять наглядные моменты, которые важно подчеркнуть

Длительность каждой сцены — не более получаса минуты"

Проверенный шаблон распределения времени:

0–15 секунд: вовлекающая сцена с обозначением задачи

15–45 секунд: объяснение, что поможет решить проблему

45 секунд – 4:15 минуты: детальное поэтапное объяснение

4:15–5:00: подведение итогов и приглашение к действию

Шаг 2. Составление промтов для генерации видео

Когда сценарий готов, каждую сцену преобразую в промты для нейросети. Для создания обучающих видеороликов применяю VEO через бота — все просто и быстро, без лишних настроек.

Шаблон промта для VEO:

[ДЕЙСТВИЕ], крупный план кистей, четко видимые движения, профессиональная студийная подсветка, камера статична или мягко двигается, ровный фон, четкое 1080p, длительность 10–15 секунд

Примеры промтов:

Пользователь открывает ноутбук, вводит секретный код, руки крупным планом на клавишах, рассеянный свет, съемка с наклоном 45 градусов, современное рабочее пространство

Кисти настраивают параметры в приложении, курсор выделен, интерфейс занимает весь дисплей, плавные анимации смены окон

Показ итогового результата: сравнение до и после, экран разделен на две части, четкая разница между вариантами, профессиональная подача

Шаг 3. Полный процесс озвучки

Подготовка текста для начитки:

Берется готовый сценарий и трансформируется для устной подачи.

Промт для ChatGPT:

Переделай этот текст так, чтобы он звучал естественно для устной речи. Избавься от сложных конструкций, добавь паузы (отметь как [ПАУЗА]), выдели важные слова ЗАГЛАВНЫМИ, укажи интонацию (вопрос, утверждение). Итог должен звучать как дружеский разговор.

Настройка голоса в Murf:

Воспользуйся Murf с такими настройками: устанавливай темп речи на 95-105% (слегка медленнее стандартного), варьируй высоту тона от -2 до +1, добавляй паузы от 0,5 до 1 секунды между фразами. Для образовательных роликов выбирай уверенные, спокойные голоса.

Шаг 4: Итоговый монтаж в DaVinci Resolve

Открывай DaVinci Resolve — мощный и бесплатный видеоредактор. Следуй этой инструкции:

Импорт и структурирование файлов:

Создай проект с параметрами 1080p, 25 кадров в секунду. Загрузи все видео из VEO в папку "Video". Аудио из Murf — в "Audio". Вспомогательные материалы (титры, иллюстрации) — в "Graphics".

Основной монтаж:

Размести аудиофайл на таймлайне. Совмести видеофрагменты с нужными частями озвучки. Убери лишние паузы, сохранив естественный ритм. Вставь плавные переходы между частями (Cross Dissolve, длительность 0,5–1 секунда).

Промт для генерации титров и графики:

Сделай текстовые титры для образовательного ролика: название урока (большой шрифт, 3 секунды на экране), ключевые слова (появляются при первом появлении), нумерация шагов (в углу), призыв к действию (финальный слайд). Оформи в минималистичном стиле, чтобы все хорошо читалось на мобильных.

Продвинутые методы оформления

После освоения базовых приемов можно переходить к более сложным форматам. Здесь важно учитывать особенности восприятия учебного видео.

Работа с ChatGPT для сложных сценариев

Для детализированных образовательных роликов потребуется продуманная структура сценария.

Промт для изучения аудитории:

Проанализируй целевую аудиторию для обучающего ролика по теме [ТЕМА]. Определи уровень подготовки (начальный/средний/продвинутый), главные трудности и запросы, желаемый стиль подачи материала, среднее время фокусировки, подходящие примеры и сравнения. Оформи все в виде карты аудитории.

Промт для создания структуры обучения:

Основываясь на карте аудитории, составь оптимальный план подачи материала по теме [ТЕМА]. Раздели сложную тему на простые модули с принципом 'от легкого к сложному'. Каждый модуль заверши вопросом для самопроверки или практическим заданием. Укажи, какие знания пригодятся для освоения каждого раздела.

Внедрение интерактивных функций

Аналитика подтверждает: добавление интерактива в видео помогает повысить количество целевых действий. Вот основные шаги по интеграции:

Промт для разработки интерактивного сценария:

Для обучающего ролика по теме [ТЕМА] предложи 5-7 интерактивных механик: тесты с выбором, остановки для самостоятельной работы, дополнительные ресурсы по нажатию. Каждый интерактив появляется вовремя и помогает глубже усвоить знания. Пропиши точное время появления и роль каждого элемента.

Расширенные промты для VEO

В сложных обучающих эпизодах пригодятся структурированные промты:

Промт для показа пошагового выполнения:

Демонстрация поэтапного [ПРОЦЕССА]: стартовая сцена показана детально, плавно переключаемся к действию, каждый этап занимает 3-4 секунды, руки или инструменты отчетливо видны, результат каждого этапа хорошо заметен, финальная сцена ярко отличается от начальной, свет подчеркивает нюансы

Промт для раскрытия сложных идей:

Визуализация идеи [КОНЦЕПЦИЯ]: применяй простые фигуры, цветовое выделение разных частей, анимацию связей между элементами, постепенное приближение к деталям, минимализм в оформлении, акцент на важных связях

Многоязычие с детальными указаниями

74% преподавателей используют ролики для обучения. Если планируется расширение на другие рынки, процесс следующий:

Промт для локализации сценария под другую аудиторию:

Переделай этот сценарий для зрителей из [СТРАНА/РЕГИОН]. Учитывай местные традиции: примеры и сравнения, значение цветов, манеру общения (официальный/неофициальный стиль), темы-табу, источники доверия. Замени все оригинальные для [ИСХОДНАЯ СТРАНА] моменты на привычные для местной публики.

Пошаговая адаптация сценария для разных платформ

Один сюжет — несколько форматов. Вот пошаговый подход:

Для YouTube (горизонтальное видео 5-10 минут):

Промт:

Переделай сценарий для YouTube: включи подробное вступление (30-45 сек), развернуто объясни каждый этап, естественно вставь просьбы подписаться и поставить лайк в логичных паузах, добавь тизер следующего выпуска в финале, разметь тайм-коды для удобной навигации. Итоговая длительность — 7-8 минут.

Для TikTok (вертикальный, 30-60 секунд):

Промт:

Сократи сценарий до 45 секунд: мощный крючок в первые 3 секунды, только главные моменты каждого этапа, динамичная подача, финал — вопрос или неожиданный вывод. Чтение занимает не больше 40 секунд.

Для Instagram Reels (квадратный, 30-90 секунд):

Промт:

Переделай под Instagram: яркое визуальное оформление с самого начала, спокойный ритм повествования, акцент на визуале, хештеги в описании, напоминание сохранить публикацию в конце. Продолжительность — 60-75 секунд.

Недавно пробовал создавать обучающие ролики для сотрудников. Оказалось, что ИИ-видео смотрят до конца на 31% чаще по сравнению с обычными презентациями. Видимо, живое и быстрое объяснение воспринимается лучше, чем стандартные слайды.

Персонализация обучения с помощью ChatGPT

Самое интересное — создание индивидуальных образовательных роликов.

Промт для генерации разных версий одного урока:

Разработай 3 варианта одного учебного сценария для разных этапов: ДЛЯ НАЧИНАЮЩИХ: подробно объяснить термины, больше иллюстраций, медленный темп, акцент на базовых вещах СРЕДНИЙ УРОВЕНЬ: кратко напомнить определения, акцент на упражнениях, средний темп, больше деталей ДЛЯ ОПЫТНЫХ: без разъяснений терминологии, быстрый темп, внимание на нестандартных ситуациях и связях с другими темами

Типичные ошибки и способы их избежать

За время работы с ИИ-видео заметил несколько типичных промахов, которые портят даже перспективные идеи. Давайте разберем их и найдем решения.

Ошибка №1: Слишком много информации

Хочется уместить максимум пользы в короткий ролик, но мозг не успевает все усвоить.

Выход с помощью ChatGPT:

Промт для оценки объема информации:

Оцени этот сценарий на перегрузку. Подсчитай, сколько новых терминов, идей и этапов появляется за каждую минуту. Если свыше 2-3 новых моментов в минуту — посоветуй, что убрать или вынести в отдельный урок.

Главный принцип: один урок — один навык или идея. Лучше сделать три коротких видео, чем один длинный и сложный.

Ошибка №2: Пренебрежение звуковым оформлением

Часто основное внимание уделяется лишь изображению, оставляя звук за кадром. Между тем, через слух воспринимается до 65% всей информации.

Контрольный список для проверки аудио:

Нет лишних фоновых шумов или уровень их ниже -40dB. Речь звучит отчетливо на всех частотах. Оптимальная скорость — 140-160 слов за минуту (удобно для восприятия во время обучения). Паузы между репликами — 0.5-1 секунда. Музыка не мешает голосу, ее громкость на 12-18dB ниже.

Промт для доработки аудиодорожки:

Проанализируй текст озвучки и добавь подходящие звуковые эффекты: в нужных местах вставь уведомления, щелчки интерфейса, сигналы завершенных действий. Каждый эффект должен подчеркивать происходящее на экране и помогать восприятию.

Ошибка №3: Слишком быстрый темп подачи информации

ИИ способен создавать видео с высокой скоростью, но не стоит переносить этот темп на объяснение материала.

Формула комфортного тайминга:

Введение новой темы: 10-15 секунд на объяснение, затем пауза 2-3 секунды. Демонстрация процесса — в реальном времени с повтором важных фрагментов. Между разделами: пауза 1-2 секунды, плюс связующая мысль.

Промт для правильного ритма:

Изучи сценарий и расставь логичные паузы: после новых понятий (2 сек), между разделами (3 сек), перед ключевыми моментами (1 сек). Отметь участки, где зрителю может понадобиться вернуться назад.

Ошибка №4: Отсутствие проверки на живой аудитории

Не стоит думать, что видео от ИИ сразу получится идеальным. Каждый материал важно показать от 3 до 5 представителям целевой группы.

Промт для тест-протокола:

Составь протокол проверки учебного видео: 10 вопросов для зрителя после просмотра. Пусть вопросы определяют, все ли понятно, насколько изложение ясно, полезен ли материал и появилось ли желание продолжить просмотр.

Однажды делал ролик по настройке CRM-системы и был уверен, что все объяснил четко. Однако, проведя показ коллегам, заметил: часть этапов осталась неочевидной для новичков. Пришлось добавить промежуточные пояснения и снять дополнительное видео с разбором базовых терминов.

Ошибка №5: Несбалансированное сочетание теории и практики

В обучающих роликах стоит придерживаться соотношения: 20% объяснений и 80% реальных примеров.

Промт для настройки баланса контента:

Изучи сценарий, определи долю времени, отведенную под теоретическую часть и практические показательные действия. Идеально: 20% на понятия и правила, 80% — на пошаговые демонстрации и кейсы. Если пропорция нарушена, предложи, как изменить структуру.

Ошибка №6: Неэффективные призывы к действию

Многие завершают ролики фразами вроде "попробуйте сделать сами". Такой подход не работает.

Промт для создания четкого CTA:

Сформулируй ясный и конкретный призыв для обучающего видео: что должен выполнить зритель за следующие сутки, какого результата достичь, как проверить, что все сделано верно. Добавь мотивацию и ограничение по времени.

Профессиональные секреты: как вовлечь зрителя

Даже в обучении эмоции цепляют внимание. Вот точные промты для создания вовлекающих элементов:

Промт для яркой статистики:

Подбери актуальные и удивительные данные по теме [ТЕМА], оформи зацепку так: 'X% людей совершают [ДЕЙСТВИЕ] неправильно, из-за чего теряют [ПОСЛЕДСТВИЯ]. За 5 минут покажу, как избежать этой ошибки'. Статистика должна быть доступна для проверки.

Промт для сторителлинга:

Напиши короткий рассказ-зацепку для обучающего ролика: персонаж сталкивается с проблемой [ТЕМА], выбирает простое решение, получает неожиданный результат, находит правильный путь. История должна занимать не больше 20-30 секунд устного изложения.

Визуальные акценты с помощью детализированных промтов

ИИ отлично генерирует картинки, но акценты важны. Примеры промтов для VEO:

Промт для выделения главного:

[ОСНОВНОЙ ОБЪЕКТ] размещен по центру, в фокусе, [ВТОРОСТЕПЕННЫЕ ДЕТАЛИ] размыты, освещение подчеркивает главный элемент, цветовой акцент на [ВАЖНАЯ ЧАСТЬ], композиция по правилу третей

Промт для отображения этапов:

Экран поделен на три зоны: 'До' (слева, приглушенные оттенки), 'Процесс' (центр, яркое освещение, динамика), 'После' (справа, насыщенные цвета), стрелки показывают ход изменений

Методика повторения ключевых идей

Чтобы донести важные моменты, используй схему ПРЕДСТАВЬ-ПОКАЖИ-ПОДВЕДИ ИТОГ:

Промт для подачи ключевого момента:

Для основного пункта [ИНФОРМАЦИЯ] выстрой тройную подачу: 1. ПРЕДСТАВЬ: Скажи, что сейчас покажешь (5-7 секунд) 2. ПОКАЖИ: Отобрази визуально, сопровождая объяснением (15-20 секунд) 3. ПОДВЕДИ ИТОГ: Кратко выдели суть (3-5 секунд) Между этапами вставь плавные переходы.

Профессиональная финальная обработка в DaVinci Resolve

Для достижения высокого качества важно правильно завершить монтаж. Конкретные рекомендации:

Цветокоррекция для учебных роликов:

Контрастность: добавь 15-20%, чтобы детали стали выразительнее. Цвет: убавь насыщенность на 5-10% для натурального вида. Температура: держи нейтральную или слегка теплую (плюс 100-200К). Яркость: объекты всегда должны быть видны.

Работа со звуком:

Основная дорожка: держи уровень между -12dB и -6dB. Фон: музыка на -24dB...-18dB. Эффекты: акценты между -18dB и -12dB. Компрессия голоса: соотношение 3:1, время атаки 10мс.

Встраивание в образовательную систему с помощью инструментов

Видеоурок — только часть целого пути обучения.

Промт для генерации дополнительных материалов:

На базе сценария урока создай набор материалов: 1. Контрольный чек-лист (PDF, 1 лист) 2. Практическая задача для самопроверки 3. Список из 5 популярных вопросов с ответами 4. Краткий анонс следующего занятия 5. Ссылки для глубокого изучения темы Каждый материал должен быть дополнением к видео, не повторять его.

Автоматизация производства серии уроков

Для повышения вовлеченности создай несколько вариантов главных элементов:

Промт для генерации вариантов привлечения внимания:

Сделай 5 разных вариантов начала для одного ролика: 1. С цифрами (неожиданная статистика) 2. Через проблему (актуальная боль) 3. Историю (короткий рассказ) 4. С вопроса (провокационный вопрос) 5. Через противопоставление (разрушение стереотипа) Каждый вариант занимает 15-20 секунд, подача — в одном стиле.

Способы заработка на обучающих видео

Создание обучающего контента с нейросетями открывает новые источники дохода. Вот конкретные методы с расчетами:

Корпоративное обучение: путь от замысла до подписания контракта

Бизнес готов инвестировать 50–200 тысяч рублей в действительно полезный обучающий курс. Искусственный интеллект позволяет создавать такие материалы в разы быстрее — времени потребуется в 10 раз меньше.

Промт для выявления задач корпоративного заказчика:

Изучи компанию [НАЗВАНИЕ] и определи, какие обучающие решения могут быть актуальны: ввод новых сотрудников, знакомство с продуктом, развитие персонала, обучение технике безопасности. Для каждой задачи предложи подходящий формат видео-обучения и предварительную цену.

Этапы работы с корпоративным заказчиком:

Анализ клиента — ознакомься с отраслью, численностью персонала, основными трудностями. Пилотное видео — бесплатно подготовь короткий ролик по их теме (до 3 минут). Демонстрация — покажи, каким образом ИИ помогает решать их задачи. Расчет стоимости — обычно 5–15 тысяч рублей за минуту готового видео.

Онлайн-курсы: весь цикл — от старта до первых продаж

Промт для построения прибыльного курса:

Разработай структуру онлайн-курса по теме [ТЕМА], способного приносить 100–500 тысяч рублей ежемесячно. Определи: анализ конкурентов, лучшую цену, число занятий, дополнительные материалы, план продвижения. Каждый урок обязан решать насущную проблему слушателей.

Экономика курса на практике:

Работа с ИИ над контентом — 20–40 часов. Стоимость для клиента: 3–15 тысяч рублей. План по продажам — 50–200 экземпляров в месяц. После вычета комиссии площадки остается 85–90% чистой прибыли.

YouTube-каналы: старт и монетизация

Образовательные каналы стабильно набирают аудиторию. Важно — выпускать видео регулярно. С помощью ИИ публиковать качественные ролики получится каждые 2–3 дня.

Промт для контент-стратегии YouTube:

"Разработай детальный контент-план на 3 месяца для YouTube-канала по теме [ТЕМА]: 2–3 видео еженедельно, разные форматы (обучение, разборы, вопросы и ответы), сезонные темы, совместные выпуски с другими каналами. Каждое видео отвечает на популярный поисковый запрос."

Дорожная карта монетизации:

0–1000 подписчиков — ставь акцент на полезность и отслеживай аналитику. 1000–10000 — подключай монетизацию и пробуй первую рекламу. 10000+ — запускай свои продукты, курсы, консультации.

Возможности для дополнительного заработка

Продажа готовых решений:

Предлагай на рынке пакеты сценариев, промты для искусственного интеллекта, а также шаблоны для видеомонтажа. Стоимость комплекта составляет 500–5000 рублей.

Промт для генерации востребованных шаблонов:

Собери мой путь создания обучающих роликов в пакет: сценарии для 10 топовых форматов, промты для VEO, параметры для DaVinci Resolve, чек-листы по контролю качества. Каждый шаблон помогает экономить пользователю 5–10 часов личного времени.

Консультационные услуги и анализ:

Делись опытом по оптимизации образовательных материалов с другими. Вознаграждение — от 3000 до 10 000 рублей за час работы.

Продажа лицензий на контент:

Оформи сделку на право использования своих видео для других организаций. Особенно выгодно это для популярных направлений — управление временем, навыки общения, базовые IT-умения.

Инструменты искусственного интеллекта полностью меняют процесс создания обучающих материалов. То, что раньше занимало недели и требовало существенных вложений, теперь реализуется за считанные часы и минимальные средства.

Практические советы и основные выводы

Стартуй с простых форматов: пошаговые инструкции, разъяснения ключевых идей. Перед публикацией тестируй каждый ролик на выбранной аудитории. Формируй серии связанных видео вместо отдельных материалов. Приспосабливай один и тот же контент для разных платформ и форматов.

Следующий шаг — выбери подходящую тему, в которой обладаешь экспертизой, и создай свое первое обучающее видео. Потрать не больше часа, а затем оцени результат и внеси коррективы. Благодаря современным инструментам искусственного интеллекта эксперименты почти ничего не стоят.

Главное: качественный обучающий контент всегда необходим. А с искусственным интеллектом появляется уникальная возможность делать это быстро и легко.

ТОП нейросетей для генерации видео без VPN: лучшие сервисы в 2025 году для пользователей из России

В 2025 году на рынок выходят лучшие ИИ сервисы для генерации видео без использования VPN для пользователей из России. В данном обзоре собран ТОП нейросетей предлагающих реалистичную физику, кинематографичные эффекты и отличное звуковое сопровождение.

Как изменились нейросети для видео: от простых анимаций до реалистичных роликов

Еще пару лет назад, в 2022-м, мы удивлялись примитивным анимациям по тексту — сейчас такие ролики уже вызывают улыбку. Современные нейросети для создания видео выдают настоящую магию: движения выглядят естественно, свет построен по законам физики, а кадры напоминают сцены из кино.

В начале года лидировали SORA и Runway, но ближе к лету вышли новые китайские платформы, а Google презентовал VEO 3. Совсем недавно вышла SORA 2 - которая стала моим фаворитом (и именно в ней я подготовила ролики для примера в этой статье, но об этом позже). Также свежие DeepFake-возможности теперь доступны и российским пользователям.

Почти все зарубежные сервисы теперь открыты для России: где-то доступ официально, где-то — через партнерские платформы. В результате российские пользователи получили те же инструменты, что и на Западе.

Пять лучших нейросетей для создания видео с гарантированным доступом из России

VEO 3 от Google — самая быстрая и многофункциональная

Преимущества платформы:

✓ Молниеносная скорость — ролик готов за 20–60 секунд

✓ Идеальный вариант для коротких видео (Reels, TikTok, Shorts)

✓ Четко понимает текстовые запросы на русском языке

✓ Качество — до 1080p, 24 кадра в секунду

По личному опыту: VEO 3 лучше всего создает динамичные сцены и виды природы. Когда сделала видео с закатом в горах — даже профи не отличили сгенерированный клип от настоящей съемки. С людьми возникают проблемы: иногда руки выглядят непривычно, а выражения лиц могут быть неестественными.

Официально VEO для России недоступен, но существуют легальные обходные пути. Для работы использую бота с поддержкой VEO 3 — сервис работает стабильно, оплата в рублях, никаких проблем с доступом или блокировками.

Kling 2.1 — китайская сенсация с реалистичной физикой

Kling стал открытием 2025 года. Разработчики из Китая представили инструмент, который действительно удивил рынок:

✓ Детализированная физика материалов — вода, ткани, волосы выглядят натурально

✓ Легкость анимации даже в сложных сюжетах

✓ Видео до 30 секунд в высоком разрешении

✓ Понимание русскоязычных запросов благодаря автоматическому переводу

Недавно запускала сцену с танцором в воде — результат поразил. Kling отлично справляется с имитацией жидкостей, движущихся тканей и световых эффектов. Движок физики опережает ближайших конкурентов. Для роликов с правдоподобной передачей материалов — лучший выбор.

Интерфейс не самый простой, с переводом встречаются сложности. Ограничений по доступу из России нет, однако оплатить услугу российской картой не получится. Опробовать возможности можно на официальном сайте или воспользоваться ботом с Kling.

Luma AI Dream Machine — глубина 3D и стиль кино

Luma AI сильна в создании объемного видео с эффектом присутствия:

✓ Регулировка глубины и параллакса

✓ Кинематографичный стиль — боке, световые блики

✓ Превращение обычных снимков в динамичные сцены

✓ Удобная интеграция с видеоредакторами

Создавала промо для клиента — Luma преобразует стандартное фото товара в впечатляющую 3D-композицию с плавным движением камеры. Идеально подходит для интернет-магазинов и презентаций продукции.

Минусы — генерация занимает 3-5 минут, а настройки требуют привыкания. Однако качество восполняет все неудобства.

DeepFake Video — работа с лицами и персональные ролики

DeepFake Video фокусируется на одном направлении, но делает это максимально профессионально:

✓ Мгновенная замена лица в видео

✓ Точная синхронизация мимики и движений губ

✓ "Оживление" статичных снимков

✓ Контроль эмоций и выражения лица

За последние месяцы качество DeepFake заметно выросло.

Для личных задач и развлечений часто использую DeepFake-бота — все интуитивно понятно, нет лишних заморочек, работает шустро.

Runway Gen-4 — инструмент для экспертов и глубокого продакшена

Runway — самый "прокачанный" из всех сервисов:

✓ Полная настройка визуального стиля, динамики, света

✓ Профи-инструменты для видеомонтажа

✓ Можно собирать видео по собственному сценарию

✓ Легко продолжать или редактировать уже готовое видео

Runway выбирают те, кто ценит профессиональное качество. Если в других нейросетях — просто нажал и получил ролик, то здесь чувствуешь себя режиссером. Можно задать путь камеры, плавные переходы, свой фирменный визуальный стиль.

Понадобилось время, чтобы создать рекламный видеоролик — с третьей попытки результат стал напоминать съемку на студии. Настроек пришлось покрутить немало.

После недели экспериментов могу выделить: каждая нейросеть оптимальна для своих целей. VEO и DeepFake — для скорости, Runway — для детальной проработки и качества, Kling — чтобы получить крутые физические эффекты.

SORA 2 - мой фаворит

Sora 2 значительно превосходит другие нейросети для генерации видео благодаря ряду уникальных преимуществ, которые решают основные проблемы предыдущих моделей и конкурентов.

Sora 2 обеспечивает рекордный уровень реалистичности физических процессов: движения объектов, инерция, тени, а также взаимодействие с окружающей средой выглядят максимально естественно. Для большинства аналогов подобное качество остаётся недостижимым.

Модель эффективно сохраняет непрерывность и целостность сцен даже в длинных роликах, поддерживая детали персонажей, реквизита и окружения между кадрами. Важным преимуществом стала интеграция синхронизированного аудио с поддержкой фоновых, голосовых и специальных звуковых эффектов. Для большинства других сетей по-прежнему требуется сторонний монтаж.

SORA 2 может создавать видео в рамках указанной инструкции по таймингу.

Пример промта с таймингом:

[2] Эльфийка, с идеальной укладкой волос, изящно нарезает грибы для своего блюда.

[3] Гном пытается поджарить сосиску на костре, но она мгновенно вспыхивает.

[2] Гном говорит: "Эй! Кто-нибудь, помогите потушить эту штуку!"

[3] Эльфийка с презрительным видом бросает в огонь немного воды.

[3] Гном отплевывается и ворчит обиженно глядя на эльфийку: "Ну вот, ты опять все испортила! Моя сосиска!"

[3] Эльфийка нежно украшает свое блюдо съедобными цветами и гордо демонстрирует его, смотрит на гнома и молча улыбается.

[3] Гном, обгоревший и в саже, пытается запихнуть остатки сосиски себе в рот.

Сложности при создании видео, о которых не говорят в мануалах

Знаешь, что раздражает при работе с видео-ИИ? В официальных руководствах не пишут о важных нюансах. Вот с чем пришлось столкнуться на практике:

Сложности с руками. Большинство нейросетей (кроме DeepFake, который работает на готовом ролике) частенько создают нереалистичные кисти — то пальцев больше, чем нужно, то пропорции странные. Лайфхак: в запросе обязательно указывай "realistic hands, five fingers".

Надписи и логотипы. Хочешь вставить текст или эмблему? Искусственный интеллект чаще всего превращает их в нечитаемые символы. Лучше сразу создавать видео без текста, а нужные слова добавлять уже в редакторе вручную, например в CapCut.

Зацикленные движения. Когда просишь персонажа повторить действие (например, "человек кивает"), сеть часто делает это слишком механично, создавая эффект петли. Безопаснее запрашивать одно движение за раз.

Переменчивое качество. Бывает, что VEO 3 выдает отличные кадры, а иногда — полное разочарование даже при одном и том же промте. Чтобы найти удачный вариант, приходится делать несколько попыток и выбирать лучший результат.

Но есть и приятные новости. Если еще недавно большинство сервисов понимали только четкие промты на английском, теперь многие спокойно работают и с русскими запросами. К тому же, теперь можно соединять текст и картинки в одном запросе — это заметно увеличивает точность генерации.

Пошаговое руководство: как создать хорошее видео с нуля

Вот мой рабочий сценарий, который подходит для практически любой нейросети:

Шаг 1: Формулировка точного запроса

Основная ошибка новичков — слишком размытые запросы. Чем подробнее опишете, тем выше шанс удачи. Например, вместо "закат" лучше написать "яркий закат над морем, на переднем плане силуэты пальм, атмосферный свет".

Что включить в промт:

Локация: где разворачиваются события

Персонаж или предмет: кто или что в кадре

Действие: что происходит

Стиль и эмоция: общее настроение, свет

Технические детали: угол обзора, движение

Шаг 2: Подбор подходящей нейросети

Выбор зависит от задачи:

Шаг 3: Грамотная настройка параметров

Не стоит игнорировать дополнительные опции:

Продолжительность: оптимально 5-15 секунд

Частота кадров: 24-30 fps

Разрешение: стартуйте с 720p, при необходимости увеличивайте

Seed: сохраняйте удачные значения для повторения атмосферы

Шаг 4: Итерационное доработки

Редко с первого раза выходит идеально. Используйте полученное видео как заготовку, дорабатывайте запрос, чтобы получить то, что нужно.

Сделайте первоначальный вариант

Найдите слабые места

Включите корректировки в промт для устранения проблем

Примените негативный промт, чтобы избавиться от лишних деталей

Такой способ обеспечивает устойчивый результат с любой нейросетью. Не стоит ограничиваться одной попыткой — 2-3 последовательных доработки целенаправленно повышают качество.

Видеогенерация: тенденции на конец 2025 года

Проработав на стыке видеогенерации почти год, замечаю явные направления развития на ближайшее время:

Длина роликов растет. В скором будущем короткие 15-секундные видео уйдут в прошлое. Уже сейчас появляются инструменты, способные создавать истории на 1-2 минуты.

Управление через звук. Генерация видео будет возможна не только по тексту, но и по голосу, с точной синхронизацией движений и аудиоряда.

3. Интерактивность. Следующий этап — видео, реагирующее на действия зрителя, в том числе для VR и AR.

Интеграция с локальными решениями. Ожидаются гибридные форматы: часть процесса — на сервере, часть — прямо на устройстве.

Если взглянуть на развитие инструментов за последние полгода, к концу 2025 появятся решения, которые смогут заменить основную часть привычного видеопродакшна.

Какую нейросеть выбрать сейчас для создания видео?

Чтобы быстро освоить тему и создать атмосферное видео — попробуйте SORA 2. Простой и понятный интерфейс, молниеносная генерация, предсказуемые результаты. Подключение через надежные платформы, вроде вышеупомянутого бота.

Тем, кто работает с контентом для соцсетей и маркетплейсов, подойдет DeepFake — отлично помогает делать видео под определенную аудиторию. Если интересна электронная коммерция, обратите внимание на Luma AI: сервис позволяет создавать эффектные 3D-обзоры товаров.

Не бойтесь экспериментов — технологии развиваются стремительно, и уже через несколько месяцев все может измениться. Но базовые принципы видеогенерации сохраняются.

Самое важное — начать действовать прямо сейчас, пока эти решения действительно дают преимущество. Через год-полтора такие инструменты станут обычным делом, и чтобы выделиться, придется искать новые подходы.

Подробно о создании промтов для нейросети SORA 2 я рассказала в этой статье.

Примеры промтов для SORA 2 в нашем сообществе Telegram.

Пошаговое руководство по созданию вирусных мемов и комиксов с нейросетями для соцсетей

Пошаговое руководство по созданию вирусных мемов и комиксов с нейросетями для соцсетей — это ключ к успешной digital-стратегии. Сегодня мы поговорим о том, как легко и эффективно привлечь внимание аудитории!

Мемы уже давно стали не просто забавой — сейчас они выступают настоящим драйвером вирусного маркетинга. Раньше на хороший мем уходили часы, а то и дни. Теперь с нейросетями процесс генерации креативных мемов занимает считанные минуты. Из практики: такие картинки действительно привлекают внимание и часто работают не хуже, чем классические варианты, созданные вручную.

Почему мемы на базе искусственного интеллекта становятся трендом в продвижении

Мемы — это не просто развлечение. Какие реальные выгоды для бизнеса и личного бренда?

Самый доступный путь к росту органического охвата. Пользователи делятся шутками и забавными картинками в разы чаще, чем стандартными рекламными постами.

Шутки обходят "рекламную слепоту". Смех обезоруживает и делает бренд более запоминающимся для аудитории.

Выгода во времени — мгновенный результат. Классическая разработка дизайна занимает дни, а с нейросетями контент для соцсетей можно подготовить за вечер на целый месяц вперед.

Коллега-маркетолог протестировал мем-кампанию из 10 картинок для своего проекта. Итог: органический охват вырос на 27%, а конверсия в переход — на 19% по сравнению с обычными публикациями. Все это — полностью бесплатно, без бюджета на рекламу.

Лучшие сервисы для создания мемов с ИИ в 2025 году

Сначала пробовал стандартные нейросети для генерации изображений. Юмор и контекст такие сервисы понимали слабо. К счастью, появились специальные платформы.

AI-генераторы мемов

Сам часто пользуюсь ботом с Sora — с ним проще обрабатывать русскоязычные мемы. Большой плюс: не требуется VPN и оплата в иностранной валюте, все делается прямо в Телеграме. Отправляешь идею и текст — получаешь готовую картинку.

Kapwing Meme Maker — отлично подходит для создания мемов в формате видео и GIF. Доступно больше 2000 вариантов шаблонов, множество способов экспорта. Интерфейс полностью на английском, но разобраться сможет даже новичок.

Imgflip Meme Generator— проверенный сервис с обновленным искусственным интеллектом. Самое ценное — живое комьюнити, где всегда можно подсмотреть свежие идеи и тренды.

Как подобрать подходящий сервис

Если хочется сделать мемы с анимацией, выбирайте Kapwing — тут расширенные возможности для видеоработы.

Для совместной работы в команде стоит обратить внимание на Imgflip — сервис оснащен групповыми функциями.

Вроде бы все элементарно, правда? Но на практике даже с такими сервисами большинство создаваемых мемов остаются без внимания. Давайте шаг за шагом разберем, как сделать по-настоящему вирусный мем.

Пошаговый план по созданию вирусных мемов с помощью нейросетей

Шаг 1: Оценка трендов и выбор подходящей темы

Перед тем, как приступать к генерации, важно выяснить, что сейчас обсуждают:

Изучите популярные хэштеги в Twitter/X и TikTok

Загляните в разделы "Горячее" на Reddit или Пикабу

Ознакомьтесь с новостями последних 2-3 суток

Самые цепкие мемы обычно появляются на пересечении недавних событий и интересов вашей аудитории.

Совет: не гонитесь за моментальными трендами — лучше брать то, что уже держится пару дней в топе, так вы точно попадете в актуальный контекст.

Шаг 2: Генерация основы для мема

Теперь переходим к действию:

Запустите Sora от OpenAI. Часто пользуюсь ботом Yes AI с нейросетями для доступа

Подберите референс — выберите популярный мем-образ (например, "Дрейк указывает", "Парень с девушкой и другой", "Женщина кричит на кота")

Загрузите подобранное изображение в Sora

Напишите промт, где укажите: Какой мем-формат хотите получить

Тематику (например, "прорывы в технологиях")

Контекст (например, "первый опыт работы с нейросетью")

Чувство (например, "разочарование")

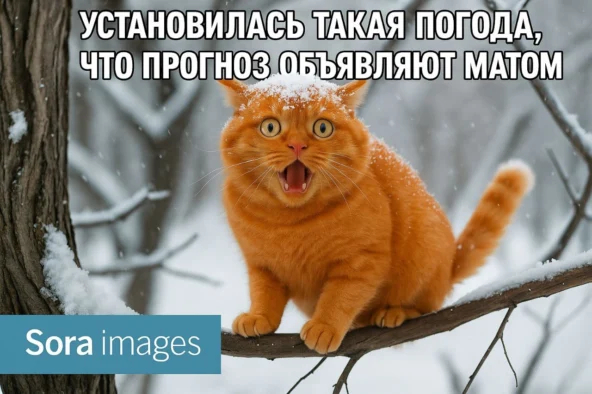

Пример промта:

Рыжий охреневший кот сидит на ветке под снегом, как птица. Текст: Sora images на голубом баннере, Текст сверху: "установилась такая погода, что прогноз объявляют матом"

Придумайте 3-5 идей с разными трендовыми форматами

Выберите наиболее удачный вариант для дальнейшей проработки

Особенность: не останавливайтесь на первом варианте. Интересные и необычные решения часто появляются с 3-4 раза.

Совет: заведите отдельную папку с коллекцией мем-форматов, которые сейчас в топе — это поможет оперативно находить вдохновение для новых идей.

Создание комиксов с помощью нейросетей

Комиксы отлично подходят для более длинных историй. Такой формат удобен, если требуется разъяснить процесс или преподнести целый рассказ.

Этапы создания комикса

Продумайте лаконичный сюжет из 4-6 эпизодов

На каждый эпизод подготовьте отдельную картинку с репликами

Объедините все сцены в общий макет

В отличие от одиночных мемов, комиксы требуют логичной последовательности и целостности. Это сложнее, но и результат — выше по вовлеченности.

Инструменты для AI-комиксов

На 2025 год самым удобным можно считать Kapwing Comic Maker. Сервис дает возможность:

Формировать панели любого размера

Вставлять облака с текстом

Настраивать переходы между эпизодами

Сохранять итог в разных форматах

Если стоит задача сделать продвинутый комикс, комбинируйте Midjourney (генерация героев и фонов) и Kapwing (для сборки и добавления текста).

Главные ошибки при создании мемов и комиксов с ИИ

За время экспериментов накопилась целая подборка промахов. Самые частые:

Излишне сложные или узкоспециализированные шутки

ИИ часто предлагает юмор, который понятен только небольшой группе знатоков. Перед публикацией проверяйте мемы на широкой аудитории.

Использование устаревших мем-форматов

Нейросети обучаются на старых данных, из-за чего могут предлагать мемы в духе 2010-х. Следите, чтобы используемый формат был актуален сегодня.

Неудачный выбор времени

Мемы, появившиеся слишком рано или сильно позже тренда, остаются без внимания. Оптимальный момент для публикации — в течение первых 1-2 суток после важной новости.

Слишком много текста

Частая ошибка новичков — длинные подписи. Идеальный мем должен быть понятен за пару секунд.

Игнорирование особенностей платформ

Контент, который отлично воспринимается в Instagram, может не работать в Twitter. Важно подстраивать мемы под формат каждой соцсети.

Кейс: продуманная AI-мем-кампания

Недавно я сотрудничал с сервисом доставки еды, которому требовалось повысить узнаваемость без значительных затрат. Мы подготовили мемы на тему "Когда программист очень хочет поесть".

Вот как все происходило:

Создали 20 мемов

Отобрали 7 самых удачных и адаптировали для разных соцсетей

Разместили небольшой фирменный знак в уголке каждого изображения

Публиковали по 2-3 мема еженедельно

Результаты оказались такими:

Средний охват вырос почти в 3 раза

Число переходов на сайт стало больше на 34%

Стоимость привлечения клиента снизилась на 22%

Самое важное — юмор точно попал в целевую аудиторию (IT и программисты).

Пошаговый план для создания мемов на постоянной основе

Если хотите, чтобы мемы стали частью контент-стратегии, придерживайтесь такого алгоритма:

Соберите коллекцию шаблонов Подберите 10-15 вариантов, которые вызывают отклик у вашей аудитории

Храните их в отдельной папке для быстрого доступа

Составьте календарь тем Отмечайте профессиональные праздники

Следите за отраслевыми новостями

Добавляйте распространенные праздники и сезонные инфоповоды

Регулярность публикаций Для малого бизнеса достаточно 2-3 мемов каждую неделю

Крупным компаниям подойдет частота 1-2 мема ежедневно

Лучшие дни публикаций: вторник, среда, четверг

Анализируйте результаты Оценивайте, какие форматы собирают больше репостов

Отслеживайте конверсию из просмотра мема в действие

Корректируйте стратегию каждые 2-3 недели

Будущее AI-мемов: прогноз на 2025-2026 годы

Мемы и комиксы, созданные искусственным интеллектом, становятся не просто смешными картинками, а настоящим инструментом маркетинга. Такой контент помогает:

Привлекать больше органических просмотров

Снижать затраты на привлечение клиентов

Делать бренд узнаваемым

Строить эмоциональный контакт с аудиторией

Самое важное — это скорость. То, что раньше требовало часов работы дизайнера и копирайтера, теперь можно сделать за четверть часа. Значит, реагировать на новые тренды получится моментально и оставаться интересным для подписчиков станет проще.

Совет: начните с нескольких мемов на разные темы, проверьте их реакцию среди своей аудитории и выберите те, что зашли лучше всего. Увидев первые репосты и комментарии, наверняка возникнет мысль — почему не начали раньше?

Ведь иногда самое простое объяснение ценности вашего дела — это не длинный пост, а мем, который вызывает улыбку и желание нажать "поделиться".

Почему бизнес заменяет спецов на ИИ в ущерб себе, или как конкурировать с бесплатностью

Давеча попался мне отличный пост о том, как убедить работодателя не увольнять копирайтера и не заменять его на ИИ.

Мысли здравые, аргументы достойные, например, о том, что нейросети профукивают УТП, не разрабатывают нормальных стратегий продвижений и слабо уникализируют пятикратно переваренный... чужие мысли. Из-за этого судебные разбирательства, репутационные риски и много других неприятных событий.

В общем, автор говорит, дескать, в долгосрочной перспективе замена специалиста нейросетью повлечёт больше рисков, чем выгод. И это так. Фатальная ошибка в использовании понятия "долгосрочная перспектива".

Теперь задерживаем дыхание, зажимаем нос и ныряем в царство МСП (малого и среднего предпринимательства) образца 2025 г.

Единиц малого и среднего бизнеса в РФ объективно больше, чем единиц крупного. Все копирайтеры страны не могут трудиться на благо пятидесяти самых известных компаний. Им не нужно столько спецов. Ребята наподобие меня живут в глубинке и за фиксированную плату помогают МСП.

Некрупному бизнесу живётся трудно - он постоянно сокращает траты. Свободных денег становится всё меньше.

Контент-маркетинг и рекламные кампании никогда не дают 100% гарантии результата. Но деньги в них вливать нужно, если решили ими пользоваться. Денег мало. Тех, что есть, жалко.

Двадцать публикаций могут быть проходными, а двадцать первая приведет клиента, готового заказать услуг на миллион рублей.

Но вливать деньги в контент нужно, если решили продвигаться за счёт него. Денег мало. Тех, что есть, жалко.

Знаете, чем руководители, увольняющие копирайтеров, перекроют аргументы об УТП, уникальности, рисках и всём остальном?

Бесплатностью.

ИИ не нужно платить, а копирайтеру нужно.

Будет ли иск в суд, придётся ли нести репутационные риски - вопросы открытые. А платить зарплату специалисту приходится.

Коллеги пишут, что от их услуг отказываются постоянные заказчики текстов (руководители проектов, работа в которых ведётся месяцами или даже годами) в пользу ИИ.

"Сейчас промптик докрутим, ИИ и контент-план составит, и тексты напишет, и для разных соцсетей адаптирует. Не понравится - перепишет за минуту, а не за сутки, как это делает копирайтер. Ещё и бесплатно!" - так рассуждают ооооочень многие, к сожалению. И действуют в соответствии с этими рассуждениями.

В случае моих коллег - ИИшные тексты корректируют менеджеры / координаторы проектов / редакторы / маркетологи. Все те же ребята, что правили тексты живых людей. Если дело совсем плохо, контент берёт на себя сам руководитель.

Итог: менеджеру, маркетологу или кому-то ещё накинули 10к рублей в месяц за время на генерацию контент-плана и ИИ-текстов, троих неплохих спецов с сильными кейсами и достойными портфолио уволили.

ИИ-тексты не работают

Да, особенно в неумелых руках. Дайте профессиональному повару горстку дешёвого риса, обрезков и остатков из холодильника: вероятность того, что он состряпает достойный ужин, велика. Дайте человеку, который не умеет сварить яйцо, отборной говядины, свежих овощей, все приправы мира... Молитесь, чтобы он не испоганил ингредиенты.

Нейросетевые тексты в первозданном виде плохо ранжируются Яндексом, у них мало дочитываний. Но бизнес верит, что это какая-то ошибка - просто другие не смогли найти подход, а он сможет! Он обязательно сможет...

"Сейчас нормальный промптик напишем, текстик опубликуем, и никто не поймёт, что это нейросеть! Даже сам Яндекс"

Вера в ИИ и его безграничные возможности укрепляется с каждым витком тяжёлой экономической обстановки. Кстати, нейросеть, как и копирайтер, тоже не обещает, что контент-маркетинг точно сработает. Только фиксированную оплату не берёт (а копирайтер берёт), не устаёт (а копирайтер устаёт), не просит пару дней подумать над концепцией (а копирайтер просит). ИИ может написать 70 текстов в день, а копирайтер нет.

Ещё моментик. Если работодатель не шибко разбирается в сфере контента, не до конца понимает, как происходит продвижение за счёт качественных текстов, то визуально большой разницы между объективно хорошим текстом хорошего копирайтера и плохо отредактированной нейрошляпой он не увидит.

Внешне тексты нейросети и копирайтера похожи (структурированы, имеют заголовок, иллюстрацию), значит, одинаково эффективны.

Вот и весь разговор.

ИИшные тексты не сработают в конечном итоге? А вдруг и копирайтерские не сработали бы! Только копирайтер видит, в чём причина и знает, как её устранить, куда вырулить, если по какой-то причине зарулил не туда.

А нейросеть прогонит неудачный текст через синонимайзер. А какой синоним к слову неудача? Провал, оплошность, фиаско, крах, поражение...

ИИ вряд ли качественно проанализирует контекст, поведение конкурентов, особенности вашей ниши, адаптирует под неё тренды.

Если у вас непереносимость лактозы, смилостивится ли организм, если вы выпьете молока из бокала, а не из стакана? Неа.

Даже если попробуете из горлышка пластиковой бутылки или из бумажного стаканчика.

Умирает ли копирайтинг? Нет, он трансформируется. Нам, пишущим специалистам, теперь нужно не только быстрее всех осваивать технологии, вникать в тренды и обучаться новым тактикам продвижения бизнеса, но и учиться продавать свои компетенции МСП так, чтобы аргумент "нейросети бесплатны" не выглядел состоятельным и не звучал логично. Только и всего.

#бизнес #мсп #контент #продвижение #маркетинг #ии #нейросеть #малыйбизнес #продвижение #искусственныйинтеллект

Продолжение истории: блики, цифры и немного дзена

Комментариев под прошлым постом было много, ответить каждому мы физически не успеем.

Но ответить хочется. Поэтому короткий инженерный разбор: с цифрами, фактами и долей самоиронии.

Про “чёрный короб”

Да, идея хорошая и часто действительно спасает.

Но у нас было три метра конвейера, по которому летят зеркальные листы со скоростью 2 м/с.

А пыль, тепло, вибрации и необходимость обслуживать оптику делают «чёрный ящик» скорее лабораторным решением, чем промышленным.

Про поляризацию и металл

«Поляризаторы на металле не работают!» — писали вы.

И вы… почти правы.

На идеально зеркальной поверхности эффект действительно слабый.

Но на загрязнённых, частично матовых и неидеальных листах он даёт до 15–20 dB подавления бликов.

Не магия — просто физика, немного геометрии и много проб и ошибок.

Про “дешёвого человека с глазами”

Мы тоже любим людей с глазами. И даже работаем вместе.

Система не заменяет оператора — она отсекает рутину, где глаз устаёт, а блик обманывает.

Раньше контролёр тратил на проверку одного листа около 6–8 секунд и при этом пропускал до 10–12% микродефектов.

Теперь камера справляется за 1.2 секунды, а доля спорных случаев, которые уходят на ручную проверку, не превышает 3–5%.

Вместо бесконечного «вглядывания в зеркало» оператор теперь проверяет только то, где нейросеть не уверена — и делает это в разы быстрее.

Так что не «человек против машины», а человек + машина против скуки и брака.

Про “азов фотографии”

Да, теперь мы знаем про них чуть больше, чем хотели 😅

Но инженерка в цехе — это не студия с софтбоксом.

Там дрожит пол, летит пыль, мигает строб, а под ногами едет металл.

Так что каждый миллиметр света, поляризации и выдержки был добыт потом и кофеином.

Про “всё равно не автономно”

Справедливое замечание.

Промышленное CV пока действительно не живёт без инженеров — но и не должно.

Как и любая сложная система, оно развивается итерационно: данные → обучение → адаптация → стабильность.

Главное, что теперь инженеры на линии решают не “почему камера не видит”, а “как улучшить метрики”.

На сладкое

Теперь точно знаем, что идеальных данных не бывает, что FTP живёт дольше всех,

и что на заводе «хорошее освещение» — это инженерное чудо, а не кнопка в настройках.

Спасибо всем, кто спорил, шутил и предлагал решения — ваши комменты были лучшим продолжением истории, чем любой отчёт по внедрению❤️

Больше живых кейсов моя команда разбирает в новом ТГ-канале https://t.me/brains2up

Подписывайтесь, если хотите чаще читать про настоящий ИИ.

Как заменить одежду на фото с помощью искусственного интеллекта

Узнайте, как заменить одежду на фото с помощью искусственного интеллекта, создавая уникальные образы без необходимости проведения фотосессий. Еще совсем недавно виртуальная примерка одежды — была уделом крупных компаний с огромными ресурсами. Но к 2025 году технологии шагнули так далеко, что теперь заменить наряд на фото может каждый — без специальных знаний и без привлечения Photoshop.

Занимаясь контентом для маркетплейсов, часто сталкиваюсь с задачей: нужно срочно подготовить карточки товаров, а полноценная съемка с разными моделями — это и дорого, и долго.

Вот несколько реальных случаев, когда смена одежды на фото через нейросети помогает решить проблему:

Создание карточек для маркетплейсов без лишних затрат

Проверка разных образов до настоящей фотосессии

Предоставление клиентам возможности примерить вещь виртуально на своем фото

Быстрое создание контента для соцсетей без бесконечных переодеваний

Обновление ассортимента интернет-магазина без дополнительных фотосессий

За последний год качество нейросетевых обработок выросло так, что некоторые компании почти полностью перешли на AI-генерацию для каталогов. Сам удивился, пока не попробовал.

Самый простой способ сменить одежду за 5 минут

Если нужен быстрый результат — вот пошаговая инструкция, понятная даже тем, кто только начал работать с ИИ:

Подготовьте фотографию. Лучше выбирать снимок с ясным лицом и спокойным фоном. Нежелательно, чтобы поза была сложной или руки закрывали одежду.

Откройте Yes Ai Бот для моментальной замены образа.

Отправьте боту фото человека, которому хотите сменить наряд.

В меню выберите опцию "Переодеть".

Загрузите фото той одежды, которую хотите примерить. В новом меню укажите нужную часть: верх, низ или полный комплект.

Скачайте и сохраните результат. Подождите завершения обработки (обычно это занимает 30-60 секунд).

Сохраните полученное изображение

При необходимости откорректируйте оттенки.

Этот способ отлично подойдет для быстрой визуализации без регистрации на множестве платформ, использования VPN и других сложностей, которые напоминают шаманские обряды. Попробуйте несколько раз, чтобы добиться идеального результата.

Профессиональные хитрости при работе с ИИ

Работая с нейросетями для смены нарядов на фото, обнаружил несколько полезных трюков, которые реально делают результат лучше. Тем, кто хочет простоты, подойдут отдельные нейросервисы.

Многослойный промт

Вместо короткой фразы вроде "красное платье", опишите одежду подробнее:

Девушка в утонченном вечернем наряде насыщенного малинового оттенка, шелковый материал, складки на талии, открытая линия плеч, изящные золотые украшения

Чем тщательнее описание, тем выше точность генерации — примерно на 40%.

Референсы для позы и композиции

Часто нейросеть "ломает" естественную позу при смене одежды. Как исправить:

Сначала создайте базовую версию позы и расположения

Потом выполните отдельную генерацию для новой одежды

Совместите полученные изображения, сохраняя исходную позу

Коррекция степени реалистичности

Сначала думал, что максимальный реализм всегда лучше. На деле легкая стилизация иногда выигрывает для рекламы. Попробуйте добавить в промт:

"немного стилизованная фэшн-фотография"

"редакционный стиль"

"коммерческий визуальный стиль"

Типичные ошибки при работе с переодеванием и их предотвращение

За сотни тестов смены одежды на фото увидел частые недочеты:

Нарушение пропорций

Проблема: нейросеть меняет не только гардероб, но и фигуру человека.

Что делать:

Используйте маску, чтобы сохранить силуэт

В YouCam Editor активируйте функцию "Сохранять пропорции тела"

Сравнивайте итог с исходным фото

Неестественные образы

Сгенерированная одежда не гармонирует с позой или окружением.

Как задать правильный контекст:

Добавляйте в промт описание окружения ("деловой стиль", "пляжный образ")

Вставляйте примеры подходящих нарядов

Проверяйте, чтобы аксессуары гармонировали с выбранным стилем

Артефакты и нечеткости

Проблема: нейросеть формирует странные дефекты вдоль линий одежды.

Решение:

Повышайте четкость и разрешение исходника

Включайте функцию детализации (Detail Enhancement)

При необходимости дорабатывайте изображение в фоторедакторе

Недавно оформлял подборку летних нарядов. Первые изображения были неудачными — рукава напоминали размытые тени. Исправить удалось, когда прописал в промте "detailed textile texture, crisp contours, high contrast".

Выбор сервиса для переодевания в зависимости от задачи

За год протестировал множество решений для смены одежды на фото. Вот что советую для разных целей:

Для маркетплейсов и онлайн-магазинов

Здесь важна максимальная точность и скорость генерации:

- Бот Yes AI — отлично создает карточки товаров на лету

- NeuroSnap — удобен для генерации серии вариантов одного изделия

Для виртуальной примерки

Когда важно показать, как конкретная одежда будет смотреться на человеке:

- YouCam Online Editor — удобен для персональной примерки одежды

Что важно знать при переодевании одежды с помощью нейросетей в 2025 году

Технологии развиваются ежедневно. При работе с нейросетями для смены одежды рекомендуется обращать внимание на:

Детализацию текстуры ткани — современные модели различают материалы вроде шелка, джинсы или кожи

Корректное отображение теней и света — ключевой момент для реалистичности

Учет сезонности и стиля — контекст стал гораздо точнее

Законность применения — используйте технологии в рамках закона о персональных данных и соблюдайте права собственности на изображения.

В последнее время заметил интересную тенденцию: современные нейросети научились не только подбирать одежду, но и дополнять образы аксессуарами, макияжем, а также создавать стильные прически. Благодаря этому легко формировать гармоничные комплекты.

Примеры из практики

Кейс 1

Бутик женской одежды столкнулся с задачей обновить каталог под новый сезон, но средств на свежую фотосессию не хватало. Что сделали:

Взяли прошлогодние фотографии

С помощью искусственного интеллекта сменили зимние наряды на весенние

Перекрасили одежду, ориентируясь на актуальные цвета

Итог: удалось сэкономить до 80% бюджета, не потеряв в качестве

Кейс 2

Дизайнеру было важно увидеть, как новые фасоны смотрятся на разных фигурах:

Собрали 10 снимков с моделями разных параметров

Применили нейросети для создания 15 версий каждого дизайна

Получили 150 визуализаций для оценки, не тратя ресурсы на пошив

В результате удалось выявить недочеты и скорректировать их еще до выпуска

Личный опыт после множества тестов

Главный вывод: несмотря на возможности искусственного интеллекта, без участия человека финальный результат не получится безупречным. Нейросеть — всего лишь помощник, а не замена эксперту.

Идеальная схема — автоматизация рутинных процессов с помощью ИИ и творческий контроль со стороны специалиста на завершающем этапе. Именно так сейчас работаю — и получаю лучшее сочетание скорости и качества.

Самое важное — подобрать подходящий инструмент и разобраться с его особенностями. Вложенное время окупается сторицей.

Технологии виртуальной примерки уже сейчас меняют подход к моде, онлайн-шопингу и продвижению. Судя по развитию, в ближайшем будущем появятся еще более удивительные решения.

Как выполнить бесплатную установку Stable Diffusion в России: пошаговая инструкция 2025

Узнайте, как выполнить бесплатную установку Stable Diffusion в России. Пошаговая инструкция поможет вам начать работу с мощной технологией генерации изображений в 2025 году. Мир генеративных нейросетей для создания картинок словно поделился на два лагеря: одни предлагают платные закрытые сервисы, другие — открытые решения, которые работают локально. Использовать зарубежные платформы сейчас непросто из-за ограничений, зато самостоятельный запуск открывает массу новых возможностей.

Stable Diffusion — самая известная открытая нейросеть для генерации изображений. Здесь расскажу, как легко и бесплатно запустить ее на собственном ПК в России, без обходных путей и технических сложностей. Не потребуется ни навыков программирования, ни глубоких настроек системы.

Провел пару уикендов, экспериментируя с разными версиями Stable Diffusion. Большинство инструкций только путают, усложняя процесс и нагоняя технических подробностей. На самом деле работать с большинством популярных моделей можно прямо на домашнем компьютере, не заморачиваясь подписками и без лишних ограничений — если знать несколько незаменимых лайфхаков.

Преимущества локального запуска Stable Diffusion в 2025 году

Перед тем как приступить к пошаговой инструкции, стоит понять, почему стоит запускать Stable Diffusion на своем компьютере:

Абсолютно бесплатно — никаких лимитов, подписок и платежей

Работает без блокировок — полностью доступна в России, VPN не нужен

Все изображения всегда у вас — результаты сохраняются только на вашем устройстве

Гибкая настройка — можно добавлять дополнительные модели и расширять функционал под свои задачи

Нет цензуры — промты и тип изображений не ограничены

Единственный нюанс — понадобится достаточно производительная видеокарта. Но если она уже есть, локальное использование нейросетей обычно выигрывает у облачных платформ.

К слову, если не хочется возиться с ручной установкой Stable Diffusion, можно просто воспользоваться ботом YES AI на русском языке. В боте есть интересный предустановленный шаблон — смена одежды на фото.

Минимальные требования для работы Stable Diffusion

Хотя официальные спецификации могут показаться сложными, на практике все проще:

Графический адаптер NVIDIA с памятью не менее 4 ГБ (оптимально — от 6 ГБ)

Центральный процессор — подойдет любой актуальный Intel Core i5/i7 или AMD Ryzen 5/7

Оперативная память — минимум 8 ГБ (лучше — 16 ГБ)

Место на диске — не менее 10 ГБ для установки программы, для хранения моделей стоит предусмотреть от 50 ГБ

Скорость работы и разрешение изображений напрямую зависят от видеокарты. Вот ориентировочные параметры:

4 ГБ VRAM — генерация картинок 512×512 пикселей, время — до 30 секунд

6 ГБ VRAM — создание изображений 768×768 пикселей, генерация — до 20 секунд

8 ГБ VRAM — картинки 1024×1024 пикселей, генерация — до 10 секунд

12+ ГБ VRAM — быстрое создание изображений 2048×2048 пикселей и более

Владельцы видеокарт AMD и Intel тоже могут использовать Stable Diffusion, но процесс будет менее быстрым и потребует большего количества настроек.

Легкий запуск Stable Diffusion для начинающих

Новичкам проще всего воспользоваться уже настроенной версией программы. Это избавит от сложностей с установкой Python, CUDA и других компонентов.

Шаг 1. Скачайте и установите Automatic1111 WebUI

Перейдите на страницу Stable Diffusion WebUI.

Кликните на зеленую кнопку "Code" и выберите "Download ZIP"

Разархивируйте скачанное в выбранную папку (желательно, чтобы путь был только на латинице и без спецсимволов)

Запустите webui-user.bat (Windows) либо webui.sh (Linux/Mac)

Система сама скачает необходимые библиотеки и модули при первом запуске — обычно это занимает от 10 до 15 минут, в зависимости от скорости интернета.

Шаг 2. Скачайте основную модель

Как только зависимости установлены, потребуется загрузить модель Stable Diffusion. Для генерации одежды, что бывает особенно актуально при создании карточек товаров для маркетплейсов, я часто использую бот с Stable Diffusion — решение не требует инсталляции и отлично подходит для подобных задач.

Для запуска на своем компьютере:

Перейдите на сайт Civitai — это самый известный каталог моделей для Stable Diffusion.

Создайте учетную запись или войдите в свой профиль.

С помощью поиска найдите модель "Stable Diffusion 1.5" или "SDXL Base".

Скачайте модельный файл с расширением .ckpt либо .safetensors.

Переместите загруженный файл в папку models/Stable-diffusion внутри установленной папки WebUI.

Шаг 3. Запуск интерфейса и генерация картинок

Перезапустите webui-user.bat или webui.sh.

Дождитесь появления адреса вида http://127.0.0.1:7860 в консоли.

Откройте этот адрес через браузер.

В интерфейсе выберите только что скачанную модель в выпадающем меню.

В специальное поле вставьте промт с описанием желаемого изображения.

Кликните на "Generate" и дождитесь результата.

Теперь ваша собственная версия Stable Diffusion работает локально и не имеет ограничений.

Гибкая установка для продвинутых пользователей

Если нужна расширенная настройка либо планируете запускать уникальные модели и плагины, обратите внимание на ComfyUI — современный инструмент с поддержкой работы через ноды.

Шаг 1: Установка ComfyUI

Скопируйте репозиторий с GitHub ComfyUI.

Следуйте инструкциям по установке, подходящим вашей системе.

Запустите ComfyUI через консоль или используя ярлык.

Шаг 2: Сборка рабочего процесса

В отличие от Automatic1111, в ComfyUI процесс построен на соединении отдельных блоков-нод. Такой подход сложнее для новичков, но открывает больше возможностей для гибкой настройки.

Чтобы сгенерировать простое изображение:

Добавьте ноду "Load Checkpoint".

Свяжите её с "KSampler" и "VAE Decoder".

Подключите ноды для текстовых промтов.

Задайте нужные параметры сэмплирования.

Запустите генерацию.

Использование специализированных моделей

Главное преимущество локального запуска — возможность применять уникальные модели для конкретных целей. Вот несколько советов:

Для максимально реалистичных картинок подойдут Realistic Vision, Deliberate, SDXL

Для аниме и мультяшных иллюстраций — Anything V5, Counterfeit

Для смены образа и одежды — Инстамодели, DreamShaper Fashion

Для быстрой ретуши — InstantPhoto, ReV Animated

Любую из этих моделей можно загрузить с Civitai и запускать на своем компьютере.

Как сделать Stable Diffusion быстрее

Если изображения создаются слишком медленно, попробуйте такие приемы оптимизации:

Активируйте режим "Half Precision" (FP16) — почти не влияет на детализацию, а ускоряет генерацию

Используйте сэмплер DPM++ 2M Karras — сочетает скорость и хорошее качество

Сократите количество шагов до 20-25 — этого обычно хватает

Загружайте версии моделей с пометкой "-pruned" — они меньше нагружают память

Включите xFormers — так можно заметно сэкономить видеопамять

Эти настройки легко найти в WebUI — после их применения процесс ускорится ощутимо.

Как решить частые проблемы при установке и запуске

Ниже собраны основные сложности и способы их устранения:

CUDA Out of Memory

Если появляется ошибка CUDA Out of Memory, видеокарте не хватает ресурсов:

Сделайте генерируемые изображения меньшего размера

В настройках выберите "Optimize for low VRAM"

Применяйте облегченные модели

WebUI не запускается

Проверьте, что путь к папке не содержит русских букв и символов

Удостоверьтесь в наличии драйверов NVIDIA CUDA

Запустите webui.bat от имени администратора

Модель не загружается

Убедитесь, что файл модели размещен в нужной директории

Проверьте, нет ли в названии файла лишних символов

Попробуйте загрузить файл еще раз с проверенного ресурса

Как составить хороший промт для Stable Diffusion

Результат генерации напрямую зависит от текста промта. Несколько советов:

Опишите детали — например, "портрет девушки с рыжими волосами и зелеными глазами в осеннем парке" даст лучший результат, чем просто "девушка"

Добавляйте стиль — такие слова как "фотореалистичный", "акварель", "концепт-арт" помогают задать нужное настроение

Указывайте фамилии известных художников — например, "в духе работ Грегa Рутковски" или "подобно стилю Альфонса Мухи"

Прописывайте особенности качества — "максимальная детализация", "освещение как в студии", "профессиональный снимок"

Пример удачного промта: "

реалистичный портрет молодой девушки с каштановыми волосами в синем наряде, студийный свет, высокая детализация, выполнено в стиле Энни Лейбовиц, 8k, гармоничное построение кадра

Примеры из практики

Генерация карточек товаров для маркетплейсов

Один из самых полезных способов — создание качественных карточек для Wildberries, Ozon и других торговых площадок:

Сфотографируйте продукт на простом фоне

Загрузите снимок в Stable Diffusion, используя функции ControlNet или inpainting

Пропишите промт с заданием желаемого стиля и фона

Получите разные варианты представления товара

Это заметно улучшает визуальное оформление карточек без привлечения профессионального фотографа.

Виртуальная примерка одежды

Можно создать виртуальную примерку, изменяя гардероб на фотографии:

Загрузите снимок человека

С помощью маскировки выделите нужную зону одежды

Пропишите промт с описанием новой одежды

Получите несколько вариантов лука

Такой подход отлично подходит для интернет-магазинов одежды и предварительной демонстрации образов.

Визуальный контент для соцсетей

Stable Diffusion удобно использовать для оформления соцсетей:

Создавайте неповторимые иллюстрации для публикаций

Делайте обложки для подборок и статей

Формируйте фирменный визуальный стиль бренда

Что дальше? Новые возможности Stable Diffusion

Технология развивается стремительно, и к 2025 году появляются новые тренды:

Внедрение видеогенерации — анимация картинок

Создание 3D-объектов из 2D-картинок — переход к объемным моделям

Персональные модели — обучение на индивидуальных данных

Работаете с изображениями? Стоит держать руку на пульсе обновлений и следить за появлением новых функций.

Вместо заключения

Запуск Stable Diffusion прямо на своем компьютере открывает простор для экспериментов и не ставит рамок, как это бывает в онлайн-сервисах. Это особенно важно для жителей России, где нередко возникают трудности с доступом к зарубежным сайтам.

Надеюсь, что этот разбор помог разобраться с установкой и настройкой Stable Diffusion без лишних хлопот. Если появились вопросы или возникли непредвиденные сложности — не бойтесь пробовать, обращайтесь к форумам или ищите новые решения.

Главное — не забывать: за сложными на первый взгляд шагами скрывается мощный инструмент, способный вдохновить и дать свободу самовыражения.