Это вам не Лего или будущее уже близко

Добрый день господа и дамы, речь сегодня об этом (я устал на пикабу видеть, политику, аварии, преступления).

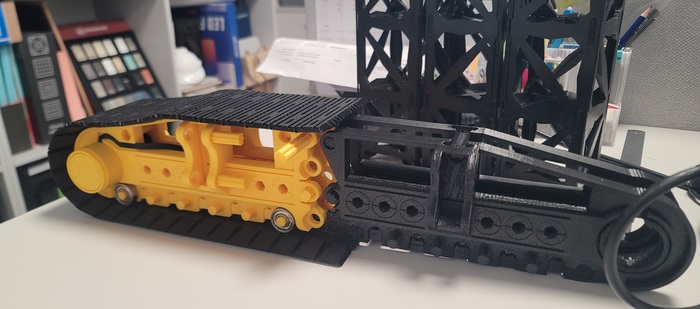

Пока не завершённая (об этом в самом низу, нужна сила пикабу) гусеничная малогаборитная роботизированная платформа, низкой по сравнению с другими стоимости, под различные задачи, разработанная в спб одним мной(

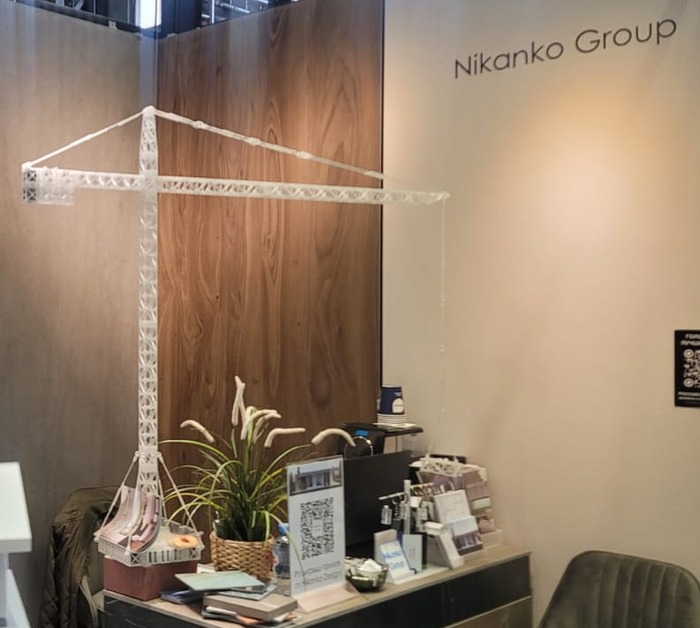

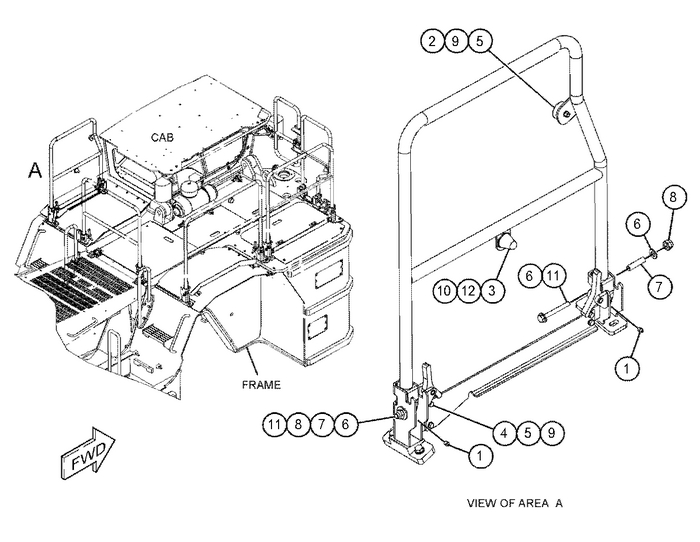

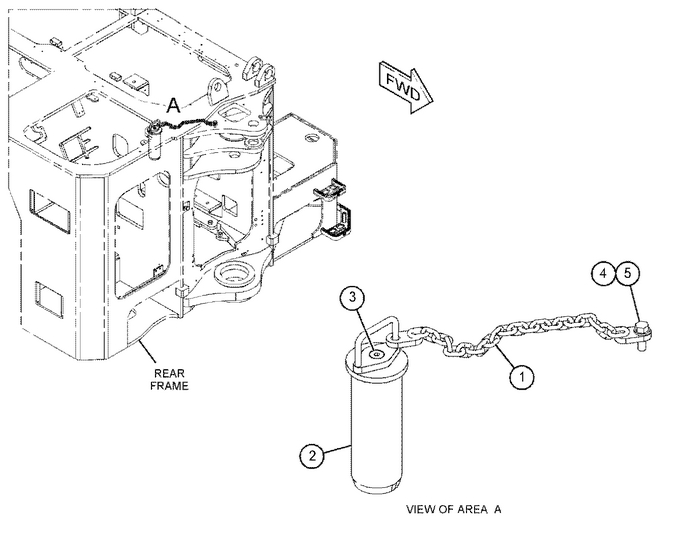

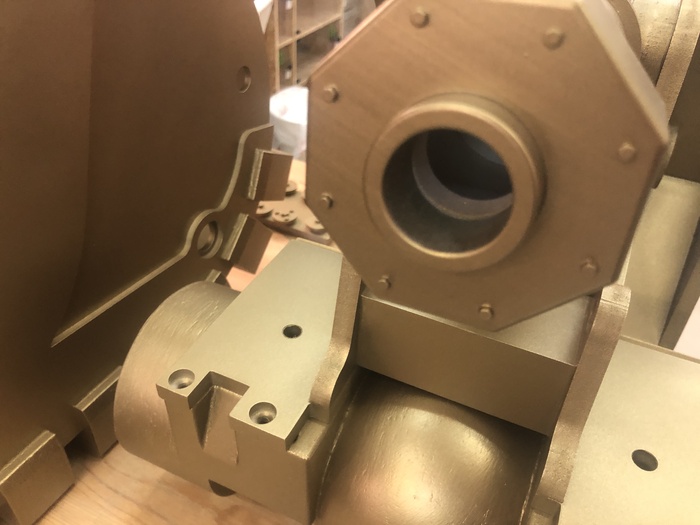

Это кран 3700мм, в таком положении поднимет 2кг, дерик балласт 50кг, механизирован только поворот.

Началось всё с fdm и пошло поехало, само собой получилось разработать свой конструктор начального уровня, функциональность околонулевая.

За пару лет освоено более 200кг пластика, разделы механики, электрики, 3d печати, проектирования.

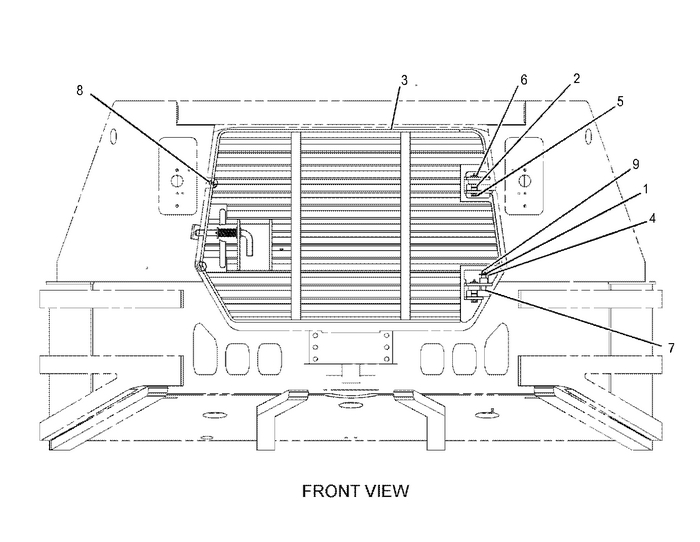

Родилась идея: надо сделать универсального среднеразмерного робота для улучшения окружающего мира будь то строительные работы или уход за садом (уличные задачи) здесь в РФ - не всё же в Китае покупать) У нас столько умов, талантливых людей, бесконечный потенциал)

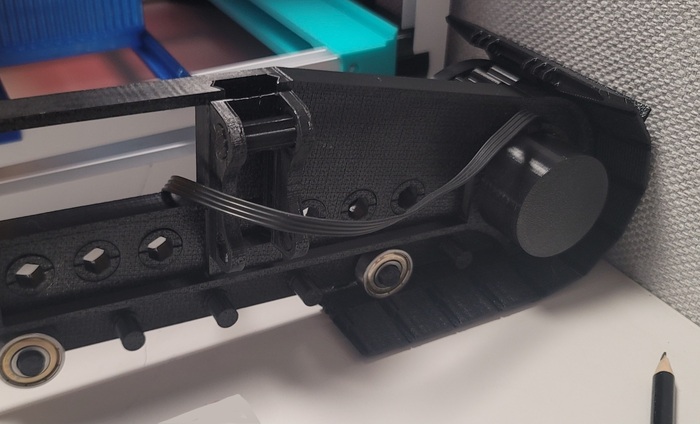

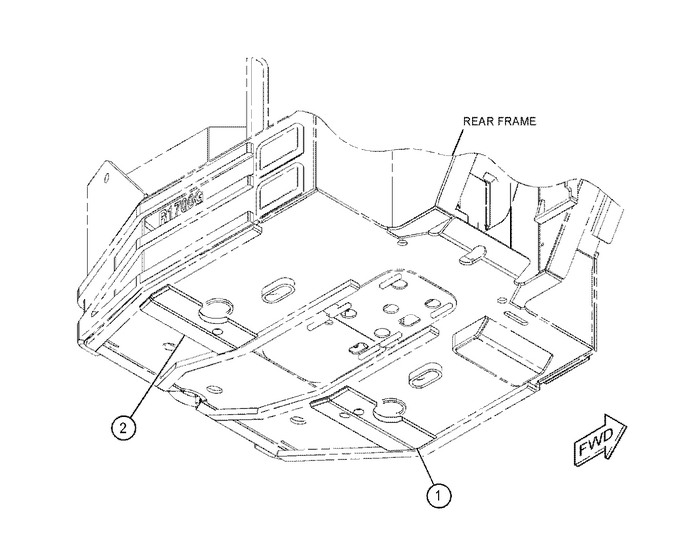

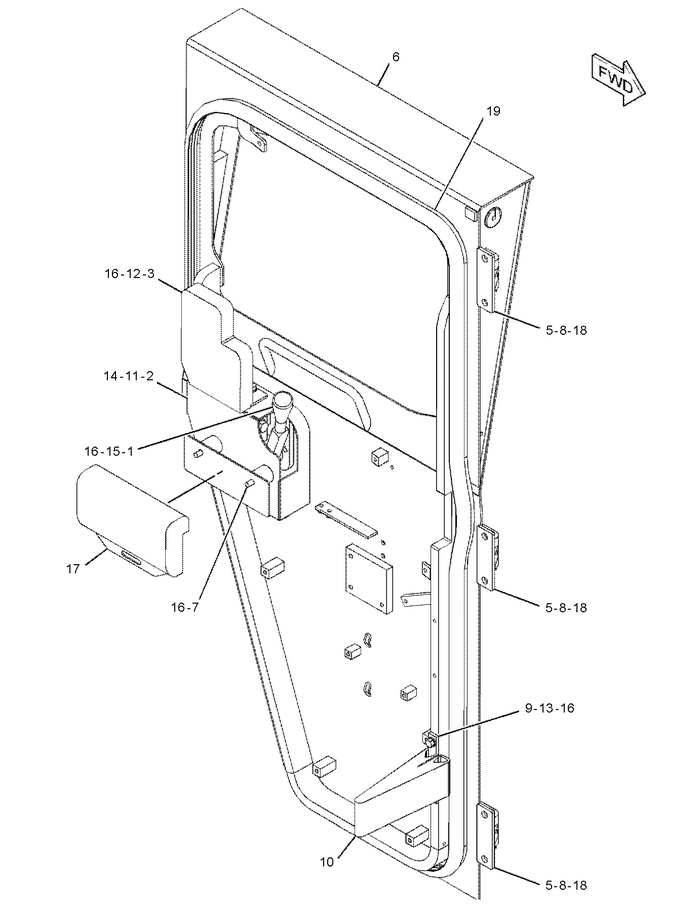

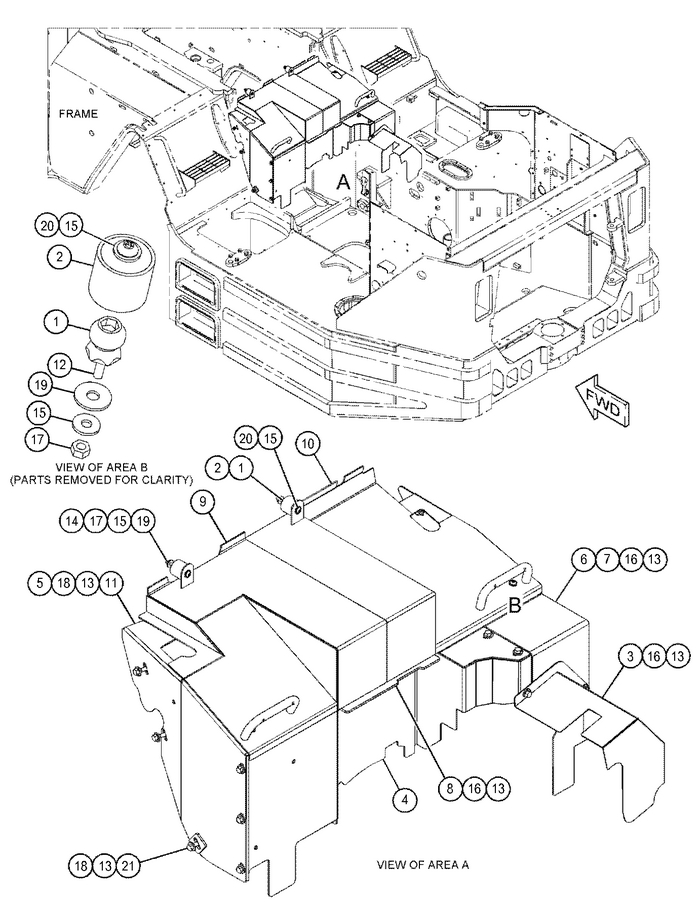

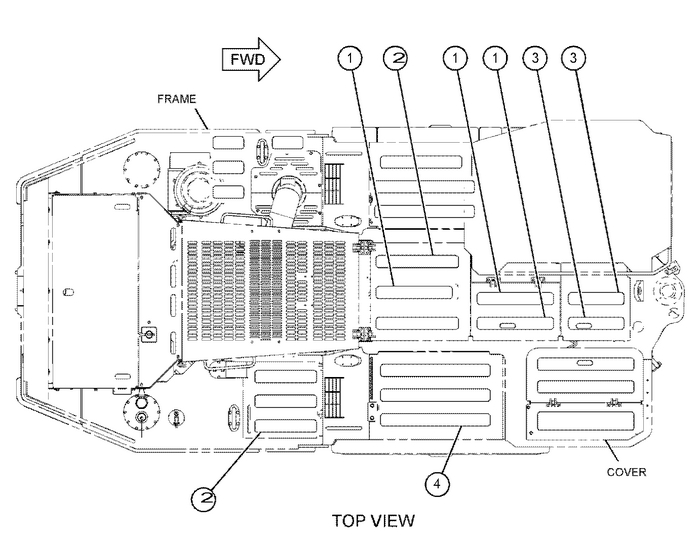

Шасси из минимального количества деталей, без саморезов, без использования сложных инструментов все держится на плотной посадке (компенсация размеров petg 100.4%) зазоры посадки почти магия, все трения на подшипниках rs.

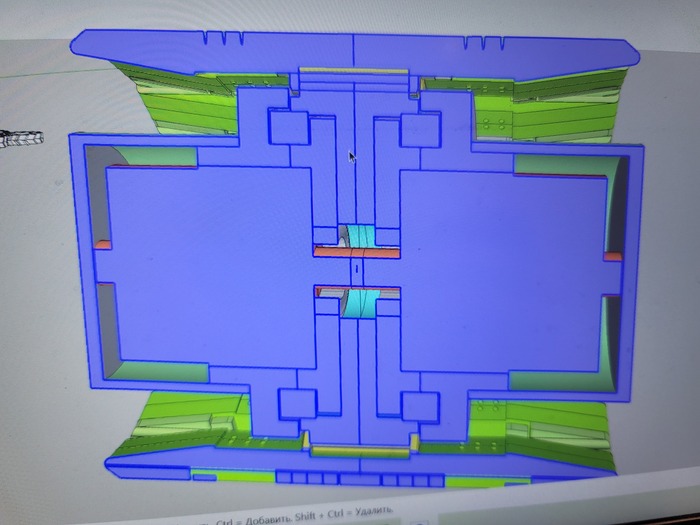

От версии к версии все перепечатыаешь, сейчас версия моделирования более 500, по часам более 1000, скетчуп, бамбук, усиление поперечное Н-профилем.

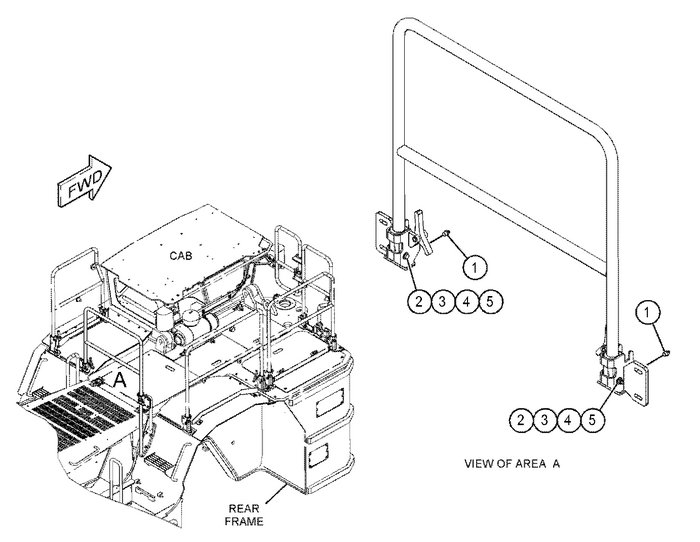

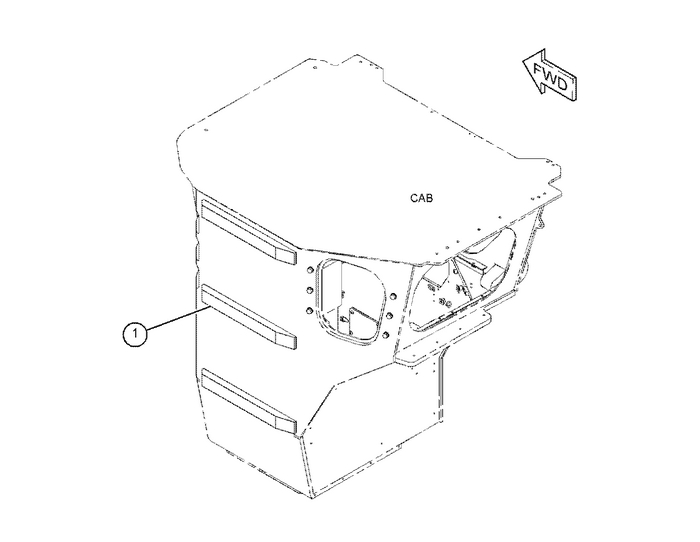

Характеристики конечные, тяга 4 мотора по 100вт, нагрузка до 100кг, тяга до 200кг, все нужные устройства ввода, автономность 8 часов, управление ИИ или как игрушка, размеры 600*800мм.

Мини версия, пробник всех процессов,

дальше на большую версию можем установить ковш/косилку/руку/экскаватор/кузов и т.д. и т.п.

Вариант использования базы функционально.

Теперь самое главное:

Это плаформа для чего-то большего, потенциал для заинтересованных должен быть понятен.

Люблю критику.

Любые советы.

Интересно с кем-то запартнёрится.

НУЖЕН человек который сможет заставить это двигаться, хотя-бы на Ардуино.

НУЖЕН спонсор/инвестор со своим силами.

Возможно и просто приобретение на данном этапе как лего.

Формат партнерства обсудим.

Может есть контакт человека которому будет интересно развитие этого проекта.

О себе: офис, команда, занимаемся стройкой, проектированием, предметным дизайном, есть свои разработки, патенты.