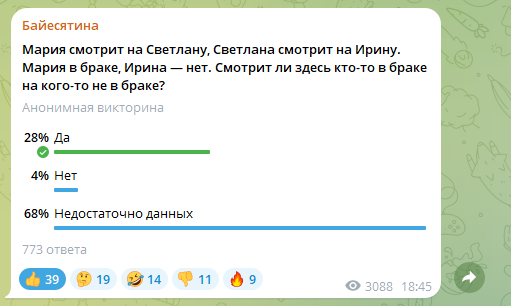

На ком лежит бремя доказательств?

«Если я что-то утверждаю, я не обязан предоставлять доказательства. Если вы утверждаете обратное, опровергая меня, это вы должны доказательства предоставлять», - Никита Михалков.

Так кто же обязан доказывать? Разберёмся в правилах спортивного перекидывания бремени доказательств.

Радикальный скептик (Далее Р): О, привет. Ты же развиваешь критическое мышление?

Сайнстер (далее С): Да, конечно!

Р: Отлично. А ты знаешь, что сепульки существуют?

С: Ха. Специально для подобных утверждений существует Бритва Хитченса. Этот принцип, который изобрёл известный научный скептик Кристофер Хитченс, и гласит он: то, что заявляется без доказательств, может быть отвергнуто без доказательств.

Р: Как же вы любите апеллировать к авторитетам. Но, так чисто для справки, Хитченс ничего не изобретал, а просто пересказал широко используемую ещё с XIX века латинскую пословицу «Quod gratis asseritur, gratis negatur» («Что свободно утверждается, то свободно отбрасывается»). Поэтому я бы не сказал, что он прям изобрёл новый гносеологический принцип. Но давай по существу: я отклоняю бритву Хитченса на основании бритвы Хитченса. Ты заявил этот принцип без доказательств, и я отклоняю его без доказательств.

С: Эй, это не так работает! Тебе знаком термин бремя доказательств? Бремя доказательств лежит на том, кто что-то утверждает! Ты выдвинул утверждение о существовании сепулек, значит, ты и обязан приводить доказательства.

Р: Это очень скользкое правило. Был такой философ Ричард Уэтли, так вот он в своих работах сравнивал подобные стратегии с гарнизоном, обороняющим осаждённый форт. Форт может быть неприступен, пока гарнизон ведёт оборонительную игру, но если командир решит совершить вылазку в открытое поле, поражение может последовать незамедлительно. Так и в споре человеку достаточно только скептических аргументов, чтобы успешно отстаивать свою позицию. Поэтому крайне выгодны стратегии, перекладывающие на оппонента, необходимость выдвигать утверждения. Проблема в том, что почти любое предложение в естественном языке можно переформулировать в негативной форме. Вот смотри: ты утверждаешь, что сепулек нет, значит, бремя доказательств на тебе. Я-то ничего не утверждаю, а лишь скептически отношусь к подобному твоему УТВЕРЖДЕНИЮ. Скажи-ка мне, ты точно везде проверял отсутствие сепулек? Покажи мне мета-анализы, эксперименты, или что ты там используешь в качестве доказательств?

С: Погоди, я же ничего не утверждал.

Р: А, ну вот мы и выяснили, что ты не отрицаешь существования сепулек? Ну, значит, ты согласен, что они существуют.

С: Пфф. Ты просто совершаешь классическую логическую ошибку, о которой писал ещё Джон Локк. Её название Argumentum ad ignorantiam - аргумент к невежеству. Это аргументы вида: Привидения существуют, поскольку никто ещё не доказал, что их нет.

Р: Как же вы любите ссылаться на философов, при этом называя философию бесполезной. Но я, кажется, уловил суть. Нельзя делать выводы из отсутствия свидетельств, так?

С: Ну наконец-то ты понял.

Р: То есть мы не можем сделать вывод о безопасности препарата из того факта, что мы не обнаружили побочные эффекты?

С: Хм…

Б: Если бы сайнстер прочитал статью про логические ошибки, то, вероятно, он бы узнал, что они делятся на формальные и неформальные. Последние, к которым и относится аргумент к невежеству, зачастую вообще не являются ошибками.

С: Ты кто?

Б: Меня зовут Роман Ачисов, вы, кстати, читаете какую-то байесятину, и мы здесь пытаемся меньше ошибаться. Иногда отсутствие свидетельств что-то доказывает, а иногда нет. Например, когда речь идёт о лекарстве, мы считаем препарат безопасным, если в исследованиях не нашли побочных эффектов. Но при этом мы не считаем, что призраки существуют только потому, что у нас нет доказательств обратного. Почему так? Здесь нам поможет немного Байесовской магии.

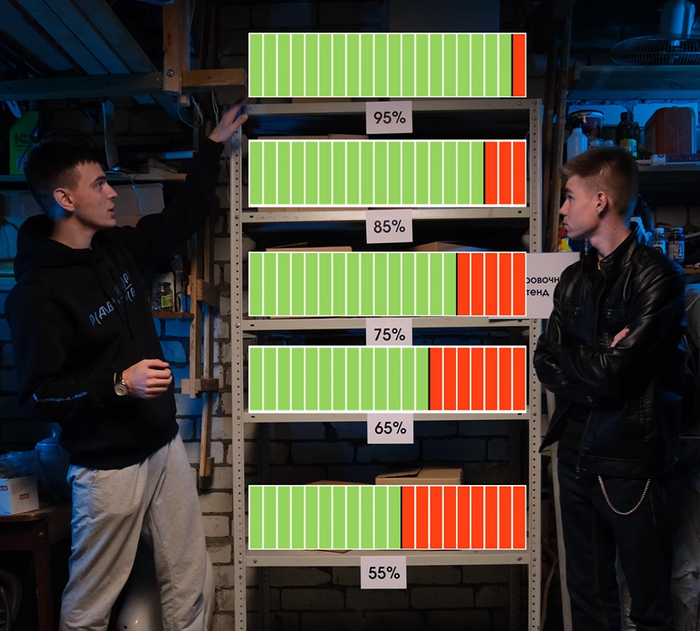

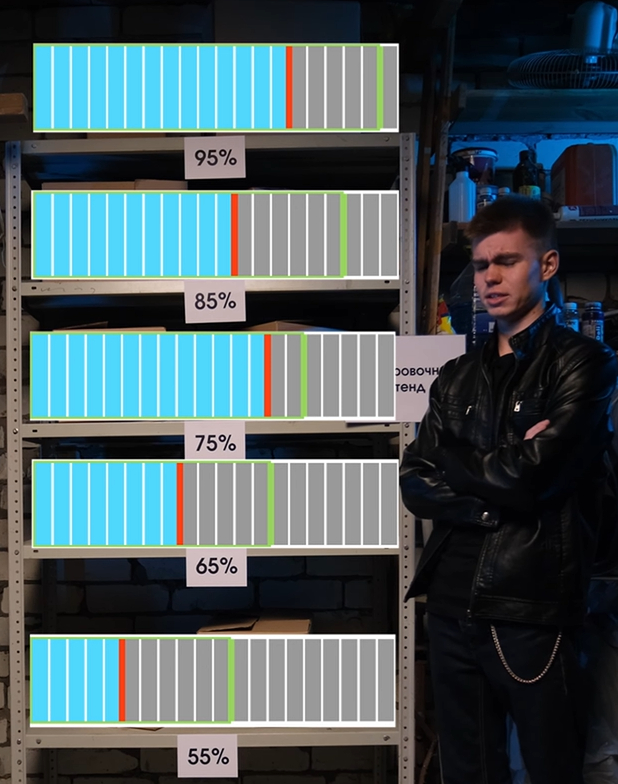

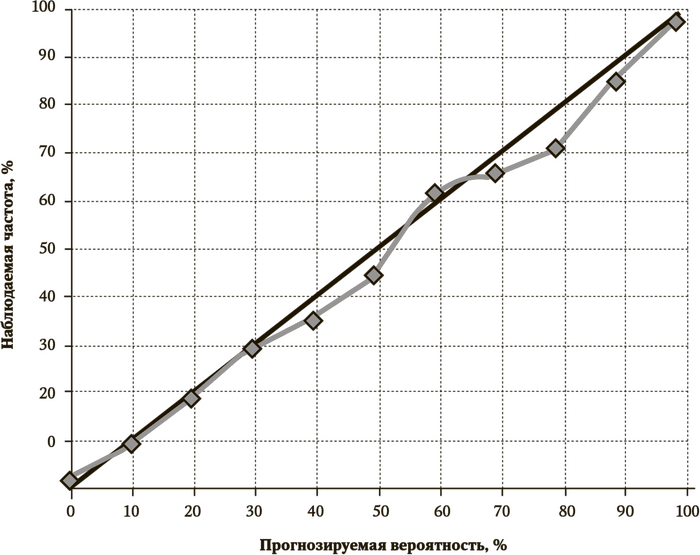

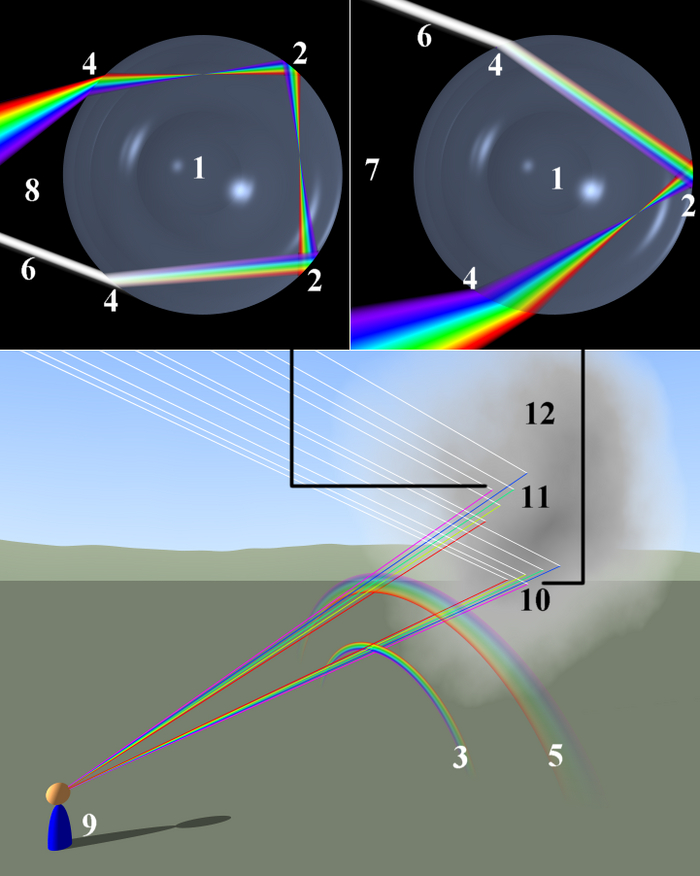

Когда мы получаем какое-то свидетельство, оно изменяет вероятности гипотез. Гипотезы, при которых такое свидетельство было более ожидаемым, становятся вероятнее, а гипотезы, при которых оно маловероятно, наоборот, теряют вес. Это напоминает весы: если одна чаша опускается, другая поднимается.

Допустим, у нас есть две гипотезы:

Г1: препарат безопасен (то есть у него нет ни одной побочки)

Г2: препарат опасен, но его побочные эффекты очень редки и могут не проявиться в исследовании

Эти гипотезы представляют собой два мира, в которых мы можем жить (строгости ради их гораздо больше). И вот мы проводим исследование и не находим побочек. Означает ли это, что лекарство безопасно? Не совсем. Мы могли ожидать такой результат при обеих гипотезах. Именно в этот момент многие восклицают: отсутствие свидетельств - это не свидетельство отсутствия. Но с точки зрения теория вероятностей, наши шансы получить такой результат чуть выше, при Г1 (безопасное лекарство). То есть в первом мире такой результат был бы чуть более вероятным. Значит, наше доверие к Г1 немного растёт, но не слишком сильно.

Если бы Г2 предполагала, что побочки очень частые, то отсутствие их в исследовании стало бы уже сильным свидетельством против неё. Чем больше раз мы повторяем тест (исследование) и не находим побочек, тем сильнее наше доверие к гипотезе о безопасности.

При этом важно учитывать не только количество исследований, но и их качество (например, насколько тесты чувствительны), но это мы обсудим в другой раз.

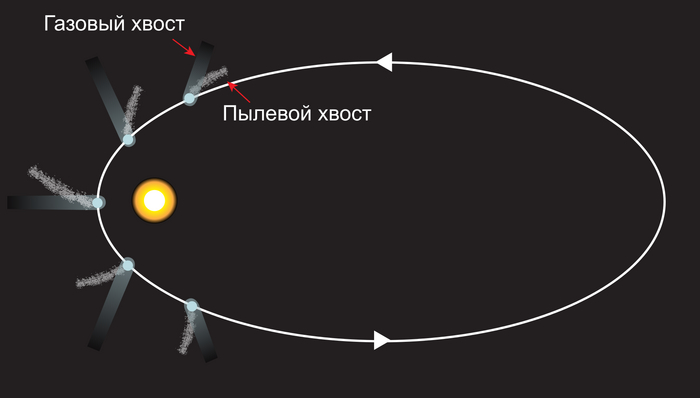

Сейчас я лишь хочу подчеркнуть, что отсутствие свидетельств вообще-то может быть аргументом, но сила этого аргумента определяется тем, с какой вероятностью мы ожидаем различных исходов при разных гипотезах. В мире, где существуют приведения, но они хорошо прячутся, шансы встретить их не высокие. Но в мире где их не существует, шансы ещё ниже. И если мы не встретили их, или не нашли в результате эксперимента, то это нормальный аргумент в пользу их отсутствия.

[Если хотите больше "технических" подробностей, то читайте эту работу]

Р: Ну допустим, отсутствие доказательств существования сепулек является слабым свидетельством в пользу того, что они не существуют. Я согласен с такой формулировкой. Но мы тут, вообще-то, бремя доказательств перекидываем, если ты не заметил. На ком же оно?

С: Конечно, на тебе. Даже без логических ошибок, бремя доказательств падает на того, кто утверждает что-то необычное. А существование сепулек определённо необычное заявление! Как сказал Карл Саган, экстраординарные утверждения требуют экстраординарных доказательств.

Р: Ну, вообще-то, ни сам принцип, ни даже эта формулировка не принадлежат Сагану. Принцип впервые упомянул в своей работе философом Дэвид Юмом за 200 лет до него. Формулировку же в таком виде за несколько лет до Сагана озвучил социолог Марчелло Труцци.

С: Ты здорово уходишь от разговора, но со мной этой не прокатит. Бремя доказательств на тебе, потому что ты утверждаешь нечто отличное от нормы. Ты слышал про чайник Рассела? Если я скажу, что между Землёй и Марсом вращается фарфоровый чайник, слишком маленький, чтобы его могли обнаружить даже самые мощные телескопы, никто не сможет доказать, что я ошибаюсь. Но если я заявлю, что, поскольку никто не может опровергнуть моё утверждение, оно не должно подвергаться сомнению, я буду высмеян.

Р: Да, только позволь мне закончить эту цитату философа Бертрана Рассела, звучит она так: «Однако, если существование такого чайника было бы записано в древних книгах, преподано детям как священная истина и внушалось бы обществу с раннего возраста, сомнение в его существовании выглядело бы странным, а скептик подвергался бы осуждению». Как видишь, Рассел указывал на относительность понятия нормы. Вот в моём окружении большинство определённо верят в сепульки. И заявление, что их не существует не только глубоко возмутительно, но и крайне необычно.

С: Странное у тебя, конечно, окружение. Но к счастью, большинство людей в сепульки не верят. Так что тебе не увернуться от бремени доказательств.

Р: О, любитель неформальных логических ошибок прибегает к аргументу от большинства? То есть продажи гомеопатических препаратов подтверждают их работоспособность?

С: Ладно, ты прав. Мнение большинства не всегда надёжно. Но у нас же есть научный консенсус! Мнение профильных специалистов легко укажет на то, какое мнение сто́ит считать необычным, а стало быть, и на то, кто обязан предоставлять доказательства.

Р: Это резонное предложение. Вот только с ним связана пара проблем. Кого считать специалистами? Вот, например, в вопросе НЛО астрономы небезосновательно считают себя специалистами. Однако всякие там уфологи тоже претендуют на эту роль.

С: Ты что ещё и в НЛО веришь?

Р: Термин абстрактные рассуждения тебе, видимо, неизвестен. Нет, я просто сбиваю твою спесь и пафос. Ну вот есть этот ваш любимый научный метод. А кто является экспертами по нему? Физики, математики или социологи? Может, философы? А, как я мог забыть, философия же не наука.

С: Ну хорошо,не для всех вопросов есть очевидно подходящее сообщество экспертов, но для многих же есть?

Б: У меня была статья про авторитет. Там как раз поднимался вопрос того, кому стоит доверять и почему. Всё, что там было сказано, относится не только к отдельным авторитетам, но и к экспертным сообществам. На уровне сообществ также бывают конфликты интересов. То есть если вы спросите сообщество специалистов по сепулькам, существуют ли сепульки, то они будут иметь сильное давление ответить положительно. Это не значит, что их выводы можно выкинуть в мусорку, но это стоит учитывать наряду с другими свидетельствами. Ещё одной важной тонкостью будет то, что консенсус будет тем более точен, чем более независимы мнения экспертов внутри него. Если все эксперты воспитаны в рамках «одной школы», это создаёт эхо-камеру. Основная суть в том, что разные сообщества заслуживают разной степени доверия.

Р: Ну в такой формулировке я не спорю с рекомендацией оттолкнуться от консенсусного мнения.

С: Получается бремя доказательств на тебе?

Р: Почему?

С: Ну ведь научный консенсус на моей стороне?

Р: А с чего ты это взял?

С: То есть ты думаешь, большинство учёных считают, что сепульки есть?

Р: Каких именно учёных?

С: Да какая разница?

Р: Огромная. Вот ты утверждаешь, что бремя на мне, потому что таков научный консенсус. А сам не удосужился даже проверить есть ли подобные опросы или что пишут в учебниках. В чём сила твоего аргумента, если ты просто говоришь: я верю, что учёные считают так, значит, я прав? Такой подход называется критическим мышлением? Я просто не в курсе.

С: Я так устал от твоей бесполезной демагогии.

Р: Вот так всегда, как только у тебя заканчиваются аргументы, ты объявляешь меня софистом и демагогом. Это ни разу не ad hominem, здесь никаких норм рационального диспута не нарушается.

С: Пусть нас рассудит третья сторона: на ком должно быть бремя доказательств?

Б: Ну вообще ни на ком.

С: В смысле?

Б: Дело в том, что средневековый диспут заимствовал общие нормы римского права, среди которых была идея о том, что бремя доказательства лежит на утверждающем. Оттуда концепция распространилась на руководства по проведению дебатов и теоретические работы по риторике и аргументации, а после популяризовано и, так сказать, ушло в массы. Однако это заимствование не очень уместно. Если целью спора является совместный поиск истины (или более практически наилучшей позиции с обоснованной степенью уверенности), то лучшей стратегией будет просто вывалить на стол лучшие аргументы, перемешать их с аргументами собеседника и взвесить чаши весов. Вообще, крутым лайфхаком для рационального спора является вести обсуждение так, как делал бы это наедине с собой. Ну правда, почему должна быть какая-то разница между самостоятельным рассуждением над темой и диалогом, если цель в установлении истины?

С: А что если собеседник не хочет вести нормальный спор? Как мне его заставить? Вот в чём главный вопрос!

Б: Я считаю - это довольно вредная интуиция, что есть объективные стандарты спора, и если собеседник их не выполняет, то можно принудить его к этому. Отсюда и берётся вся эпопея со списками логических ошибок. У каждого человека есть личные эпистемические стандарты. Я вот считаю, что полезно использовать в некоторых рассуждениях логику и теорию вероятности. Более того, я верю в то, что есть более эффективные познавательные стратегии (эпистемическая нормативность) к обладанию которыми я и стремлюсь. Если у другого человека стандарты отличаются, вам придётся придумать формат в котором вы сможете взаимполезно обмениваться информацией не соблюдая эпистемические стандарты друг друга. Ну или прийти к общим стандартам (что вообще-то отдельная задача).

Р: Погоди, то есть бремя доказательств по-твоему бесполезно? А ничего, что это юридический термин?

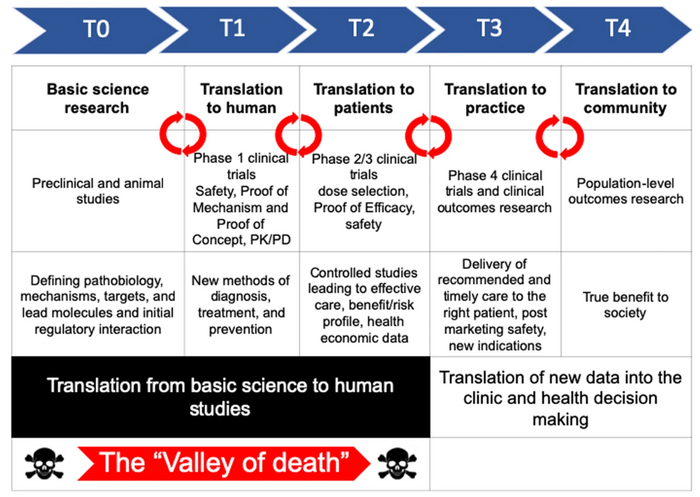

Б: Бремя доказательств — это важная штука, но работает она не везде. Вот в этой работе авторы делят споры на два типа: в одном бремя доказательств только мешает, а в другом — наоборот, необходимо.

Когда спор касается просто установления истины или оценки степени уверенности (то есть, насколько вероятно, что что-то, правда), здесь перекидывание бремени доказательств только мешает. Но есть и споры, где мы не просто ищем истину, а решаем, что с ней делать — и это решение несёт за собой риски и последствия. Например, если мы уверены в чём-то на 70% (ну, к примеру, в безопасности препарата), и мы должны решить: когда стоит действовать (например выпускать его на рынок или нет)? Для таких случаев нужна граница принятия решений. Такие споры называют пруденциальными, потому что здесь важно учитывать риски.

Классический пример — юридическая система. В уголовном праве презумпция невиновности специально создаёт перекос в пользу обвиняемого. Это потому, что наказать невиновного считается гораздо хуже, чем отпустить виновного. С точки зрения поиска истины — да, это искажение и подкручивание. Но с точки зрения принятия решений это оправдано, потому что в долгосрочной перспективе даёт наилучший результат.

Это применимо не только в судах. Бремя доказательств нужно в любой ситуации, где ошибиться в одну сторону хуже, чем в другую. Это называют пруденциальной асимметрией.

Яркий пример из другой сферы, это история с талидомидом. В 1950-х этот препарат активно продвигали как средство от тошноты у беременных. В результате более 10 000 детей родились с тяжёлыми пороками развития, а около 40% из них не выжили.

Но в США лекарство так и не попало на рынок благодаря сотруднице FDA Фрэнсис Келси. Она отказалась одобрять таледомид, потому что на её (субъективный) взгляд доказательств безопасности не достаточно. Этот случай изменил систему регулирования лекарств и принёс Келси президентскую награду.

В жизни мы тоже интуитивно сдвигаем бремя доказательств в подобных ситуациях. Представь, ты берёшь в руки охотничье ружьё. Разумнее считать, что оно заряжено, пока не убедишься в обратном. А вот если ты берёшь банку газировки, логично предполагать, что она не взболтана, пока нет оснований считать иначе.

Конечно, правильно установить бремя доказательств в споре с пруденциальной асимметрией очень сложно и трудозатратно. Есть высокий риск промахнуться, и устанавливащий несёт серьёзную ответственность за последствия. Но в этом случае это неизбежно.

Совершенно другая ситуация в бытовых спорах. Бремя доказательств в них всплывает из интуиции о внешнем судье. Как будто существуют объективные стандарты (не этические), которых необходимо придерживаться в дебатах. И один из них заключается в том, что пока оппонент строго не доказал что-то, вас этот внешний судья признаёт правым. Мол, вы имеете полное право верить в любые убеждения, пока не получили идеальное математическое доказательство своей неправоты. Как я уже говорил в одном из роликов, это наследие аристотелевской логики, в которой ты либо точно прав, либо также точно ошибаешься. Именно в такой ситуации очень важно, кто будет утверждать, ведь, как верно заметил радикальный скептик, гораздо проще указать на ошибки, чем создать идеальную и безошибочную концепцию.

Я же предлагаю байесовскую перспективу, где у тебя и собеседника есть некоторые обоснованные степени уверенности. Обоснованы они доказательствами. И целью спора является вывалить всё свои доказательства на стол, и совместно взвесить. В этом случае бремя доказательств становится обременительно для обеих сторон. Это, конечно, не сделает любое обсуждение идеальным, особенно если собеседник не поддерживает такой подход. Но даже в одностороннем порядке это может увеличить лично вашу пользу от такого диалога.

С: Ну звучит здраво. Но что там с сепульками?

Р: Ой, да нет никаких сепулек. Я просто хотел поспорить. Пошли чай пить.