Сэм Альтман является публичным лицом OpenAI, и его компания уже не раз намекала на то, когда может быть выпущена следующая потенциально революционная модель.

По мере того как возрастает ожидание появления новейшей разработки OpenAI - GPT-5, будущее моделей генерации текстов выглядит многообещающе. Ведутся горячие споры и рассуждения о том, станет ли GPT-5 значительным шагом вперед на пути к созданию общего искусственного интеллекта (ОИИ, Artificial General Intelligence, AGI).

Учитывая послужной список OpenAI и время, которое обычно требуется для обучения и выпуска моделей, эксперты прогнозируют, что мы можем ожидать чего-то выдающегося от OpenAI в области генерации текста к 2024 или 2025 году.

Несмотря на то, что модели изображений OpenAI отстают в последних сравнениях, - например, DALL-E 2 уступает в создании фотореалистичных изображений известным Midjourney и Stable Diffusion, - похоже, что OpenAI не теряет надежды. Однако стоит задать вопрос: "Когда выйдет GPT 4.5?".

За обсуждением будущих текстовых моделей GPT 4.5 (по сути, доработанный и модернизированный, но не полностью переделанный GPT-4) часто остается без внимания. Важно помнить, что ChatGPT - это уже более совершенная версия GPT-3, известная как GPT 3.5. Поэтому вполне резонно ожидать, что OpenAI выпустит GPT 4.5 раньше, чем GPT-5.

По мнению аналитиков, OpenAI, скорее всего, выпустит GPT 4.5 в сентябре или октябре 2023 года. Эта версия призвана устранить основные проблемы, наблюдавшиеся в предыдущих моделях, такие как галлюцинации (генерация неверной информации) и медленное время отклика через API. Предположительно, GPT-4.5 станет первой версией, которая будет обрабатывать текстовые и визуальные данные для проведения мультимодального анализа. Впервые это было показано и продемонстрировано в марте 2023 г. во время прямой трансляции конференции с участием разработчиков GPT-4.

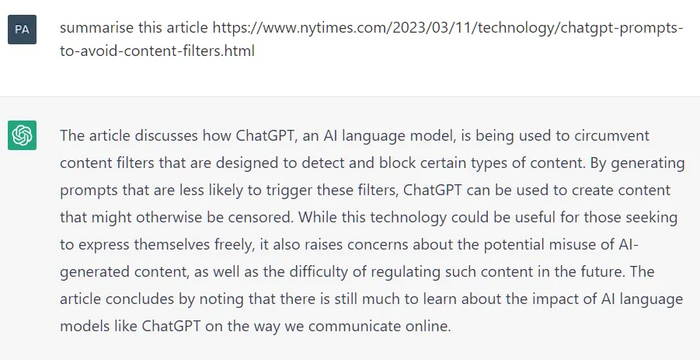

Одним из наиболее правдоподобных предположений относительно GPT-5 является возможность значительно уменьшить количество галлюцинаций в ответах. В искусственном интеллекте галлюцинация - это когда ChatGPT выдает уверенный ответ на вопрос, совершенно не относящийся к его обучающим данным, как показано ниже.

ChatGPT без доступа к интернету написала резюме на не существующую новостную статью: в промпте приведена фиктивная ссылка, что в совокупности с отсутствием подключения, однако, не вызвало у нейросети никаких вопросов.

Устранение таких галлюцинаций было бы очень полезно для аналитиков и разработчиков, поскольку в противном случае непреднамеренное использование результатов такого галлюцинирования может поставить под угрозу надежность и точность исследований или системы искусственного интеллекта в целом.

Кроме того, мы, как и OpenAI, можем рассчитывать на потенциальное повышение эффективности и производительности, что может быть обусловлено соображениями стоимости. Работа GPT-4 обходится очень дорого - 3 цента за токен, а API часто перестают отвечать на запросы. И это даже при колоссальном количестве обучающих параметров в 1 триллион. Для сравнения, PaLM-2 от Google работает всего с 340 миллиардами параметров, при этом работает надежно и довольно быстро реагирует на запросы.

Если OpenAI хочет сохранить оптимальность и прибыль, то будущие модели, такие как GPT-5, вероятно, придется сделать более компактными для того, чтобы поддерживать качество вывода.

У OpenAI уже много проделано работы по GPT-4, поэтому ближайший релиз GPT-4.5 мы можем ожидать в конце этого года, а GPT-5, скорее всего, появится позже, в 2024 или 2025 году.

В перспективе GPT-5, вероятно, станет поворотным пунктом в этой области. Хотя классификация "искусственного интеллекта" допускает различные толкования, GPT-4 все еще не соответствует той мыслительной гибкости и широким возможностям человека, которые считаются определяющими для искусственного интеллекта.

Тем не менее, этические проблемы, связанные с прорывными технологиями, продолжают возникать. Представители технологической индустрии, в том числе Илон Маск и Стив Возняк, подписали открытое письмо, в котором призвали на полгода приостановить разработку систем ИИ, более мощных, чем нынешний GPT-4. Их обеспокоенность вызвана потенциальным риском, который представляет собой ИИ с интеллектом уровня человека для общества и человечества в целом. Подписанты призывают лаборатории искусственного интеллекта взять паузу и задуматься о возможных последствиях своей работы, предоставив время для разработки рекомендаций и правил ответственного использования ИИ.

Все усложняется тем, что OpenAI подвергается внутренней критике со стороны своих сотрудников в связи с решением разрешить машинам распространять пропаганду и ложь по информационным каналам. Озабоченность, выраженная в письме сотрудников OpenAI, поднимает важные этические вопросы о последствиях применения искусственного интеллекта и возможности автоматизации рабочих мест. Поскольку системы искусственного интеллекта становятся все более конкурентоспособными по отношению к человеческому труду, крайне важно учитывать последствия уступки контроля над информацией и автоматизации рабочих мест. Решив эти этические проблемы и обеспечив ответственное развитие ИИ, OpenAI и все ИИ-сообщество смогут проложить путь в будущее, где ИИ-технологии будут оказывать положительное влияние на общество.