Сегодня я вам расскажу про мотоцикл марки QJ Motor. На самом деле в моих прошлых статьях уже были упоминания этого бренда, поэтому настало время поговорить об этих мотоциклах более подробно, потому как экземпляр в этот раз мы тестировали не самый обычный.

Встречайте SVT 650X - это кроссовер с направленностью в сторону бездорожья, правда не сильно серьезного (хотя мне он доказал обратное). И сразу скажу, что тестил я его жёстко, так как всё-таки это участник ралли "Шелковый путь 2024" и перед соревнованиями я решил проверить на что он способен, а на что нет)

*Конечно по традиции мы сделали очень подробный и интересный ролик про этот мотоцикл, поэтому кому хочется еще больше информации, можно посмотреть у нас на YouTube канале GONTAR'

Начну с того, что этот мотоцикл я взял для тренировки к соревнованиям "Adventure Fest 2024 от Project18", которые проходили с 13-16 июня (выпуск про мясо, происходящее там выпустим в ближайшее время, видео обещает быть очень зрелищным, так как таких полётов я никогда в жизни не практиковал), правда мотоцикл для участия у меня был другой, но тоже китайский бренд, который истинно меня поразил...

Так вот, собрались мы с командой в дебрях на юге Москвы и весь день колесили по лесам и полям, сказать что я зае... это ничего не сказать, с учетом того, что подобная тренировка на бездорожье на моём опыте была впервые, я был в полном ахере и в полном говне)) Но так или иначе скилл я получил незабываемый. Из интересного подмечу, что резина на моём мотике была мягко сказать не для бездорожья, поэтому без весёлых падений не обошлось, в видосе эти кадры есть)

Итак, давайте начнем разбираться подробнее в этом байке, ведь тут много есть интересного и даже очень знакомого для бывалых мотоциклистов.

В плане внешки сразу понятно, что компания смотрела в сторону раллийных байков, потому что мордашка у него не вытянутая вперед, а сделана как бы башней, соответственно получился некий спортивный вид. На мой взгляд выглядит симпатично и монументально, плюс яркая раскраска подчеркивает некий спортивный флер.

Но справедливости ради, можно подчеркнуть, что легковесным он не выглядит, ведь ширина его бака и передней части вполне приличная, плюс массивные дуги (которые отлично отрабатывают, проверял на бездоре и ронял на них раз 5-6) добавляют еще ширины и веса.

Зато, благодаря массивной мордашке мы получаем вполне приличную ветрозащиту, которую дополняет регулируемый ветровичек (правда для людей выше 180см нужно поискать его побольше). К тому же на скоростях до 150 км/ч вполне комфортно, но вот после уже конечно хочется пригнуться.

Также из визуала мне понравилась оптика, она максимально самобытная и выглядит немного агрессивно, да и светит вполне прилично, а по задней оптике хочу заметить, что из-за её крупных размеров вас точно будет видно на дороге (все-таки для безопасности это важно).

Хочу отметить важное - качество пластика. Он максимально крепкий и живучий, не смотря на падения, грязь и ветки которые встречались на нашем пути в ходе внедорожных испытаний. После мойки стало ясно, что весь мотик сохранил свой первоначальный вид, а это я вам скажу очень важный аспект, чтобы после первого выезда мот не потерял свой приятный облик. Бездорожье было лютое и я его вообще не щадил)

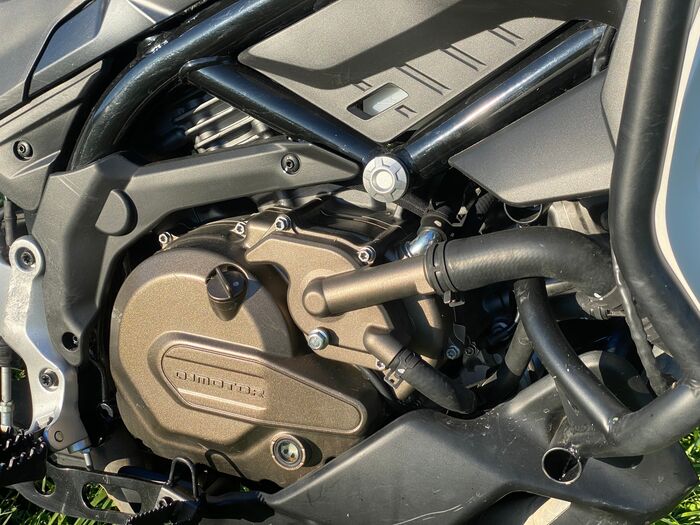

Переходим к самому главному и наверное уже знакомому многим байкерам - это L-образный мотор на 645 кубиков 76 л.с и 65 Нм, по сути это копия мотора от Suzuki SV650 последнего поколения, соответственно тот же мотор использовался и на V-strome 650, поэтому с надежностью и запчастями проблем не будет. По характеру скажу так, максимально линейный, но в тоже время динамичный мотор, который может разгоняться до 200 км/ч и так же иметь комфортный крейсер 130-140 км/ч, а если не топить и ехать к примеру 110, то вы получите расход до 4 литров (что очень мало).

На самом деле, для меня это самый приятный мотор, который я катал на китайских мотиках, и кстати выхлоп приятный и не особо громкий (правда говоря мне его немного не хватило, я бы сделал погромче).

По кпп мне понравилось, что четко переключаются передачки и несмотря на то, что лапка не складываемая, она выжила при падениях и не сломалась, что тоже является плюсом в карму этого мотика)

Также на мотоцикле установлена железная защита двигателя (да она тонковата), но вполне в силах спасти мотор и масляный фильтр от пробития (проверено мною как минимум пару раз).

Начну с того, что шасси здесь максимально сбитое и плотное и это дает уверенность на высоких скоростях (для меня это самый стабильный мот из китайских, на котором было приятно ехать даже после 180 км/ч), его не болтает, он не ловит воблинг, просто катит по прямой как утюг.

Спереди у нас установлена 43 мм вилка с ходом на 155 мм, а сзади моноамортизатор с тем же ходом, регулировками преднатяга пружины и демфированием отбоя. И вот если говорить про подвеску, то мы получаем собранную, сбитую подвеску для трасс, города и быстрых грунтовок ( в этих условиях она дает стабильное поведение мотика). Если начинаются более серьезные выбоины и кочки, то к сожалению она становится жестковатой и при прохождении препятствий ходом, можно довести подвеску до пробоя (правда говоря, я не экспериментировал с настройками, возможно это поправимо), но точно можно сказать что если будете катать на бездоре, то лучше искать мот с подвесками 200мм +

Тормоза уже по классике у QJ Motor стоят Brembo, спереди это 320 мм диска с 4-х поршневыми суппортами , а сзади 260 мм диск и 2-х поршневым суппортом. К тормозам у меня вопросов не было, как на бездоре (отключаешь ABS и наваливаешь дальше), так и по трассам, спокойно можно оттормаживаться с 200км/ч и будет безопасно. Также армированные шланги добавляют информативности.

Когда подходишь к мотику, сразу замечаешь его вытянутый силует, что хорошо и удобно для любителей покатать в стойке (я на бездоре старался ехать только так, потому что действительно удобно и комфортно, ведь подвеска очень упругая и если сидеть то можно что-то отбить). Справедливости ради, сидушка широкая и совсем не маленькая, я при весе в 105 кг могу еще сидеть как ближе к сиденью, так и подальше, что в дальняках очень важно, но покатавшись подольше понял, что она жестковата и я бы туда добавил геля. Также есть подогрев сиденья, очень важная штука, правда почему-то на бездоре он иногда сам включался (а может и я случайно задевал кнопку, кто знает). Дальше мне понравился обхват бака ногами, ничего не мешает, все действительно продуманно.

Классно, что уже в базе тут стоят алюминиевые гарды (кстати которые я по полной проверил на этом моте и с уверенностью хочу сказать, что при падениях на бездорожье они отлично держатся), также в ручках установлен подогрев и это радует👌

Пульты как и у всех QJ и Benelli имеют подсветку по переключениям, они логичны и удобны. А переключать есть что, ведь тут установлен 7-ми дюймовый дисплей, который очень информативен и на него даже можно вывести навигацию (при онлайн режиме она платная) и да, по экрану еще есть момент, не всегда корректно работает автокоррекция режимов день/ночь. В остальном всё гуд)

Как итог хочу сказать, что по характеру мот мне понравился, он задорный и очень приятный, как на повседнев, так и на дальняк (даже в условиях бездора, правда резину лучше поменять на более злую).

К слову, что хотелось бы добавить, так это большие хода подвесок (хотя бы 200мм) и немного меньше сделать вес (ну об этом я говорю постоянно, пока подходящего для себя на все 100% я не нашел, но этот экземпляр меня искренне порадовал, он очень приближён к моим запросам).

Кстати не сказал о цене, тут вполне приемлемо и на данный момент мот стоит 799 000 рублей.

16 июля мы с Танюшей отправляемся в следующий этап нашей мотокругосветки на 2х Bajaj Boxer, поэтому приглашаем вас в наш телеграмм канал, где мы будем транслировать очередные приключения на нашем пути)