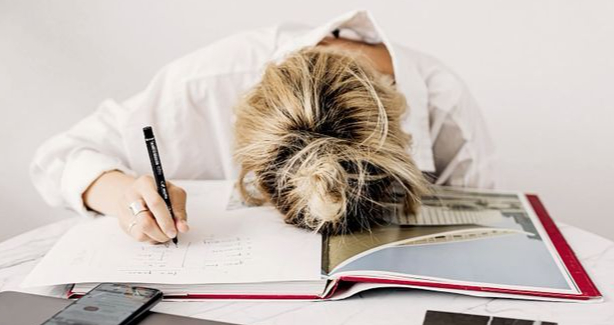

Можно ли выгореть от любимого дела? Да. И это больнее всего. Что делать потом? Профессионализм...Перфекционизм...

«Я же любил это… Почему теперь не могу даже думать об этом без усталости?» — если ты когда-то задавал себе такой вопрос, добро пожаловать. Ты не один.

Профессионализм — это больше, чем скилл. Это потребность.

Что бы мы ни планировали — построить бизнес, пойти в найм, открыть кофейню, научиться рисовать — в каждом из этих сценариев есть общий компонент:

я хочу быть хорош в том, что делаю.

Профессионалу важно ощущать себя компетентным. Но как это ощутить?

Увидеть результат.

Когда ты работаешь, вкладываешься, растёшь — а результат где-то далеко в тумане, внутри начинается ментальное месиво.

Проекты большие, задачи амбициозные, а ты вроде и не стоишь на месте, но как будто всё время бьёшься лбом в стену.

И в этот момент ты смотришь на человека, который спокойно делает что-то простое — варит кофе, водит такси, кладёт плитку — и думаешь:

Вот бы и мне... Просто делать и сразу видеть результат.

Потому что микроуспехи — это не «пустяки», а топливо. Психологически они значат для мозга почти столько же, сколько серьёзные победы. Мы нуждаемся в них, чтобы выжить в профессии.

10 000 часов. И что дальше?

Говорят: «Чтобы стать экспертом, нужно 10 000 часов практики».

Хорошо. Допустим, ты их вложил. А потом?

Потом всё становится... обычным. Ремеслом.

Ты больше не учишься, а повторяешь.

Ты не пробуешь новое — ты оптимизируешь старое.

Это и есть точка, где ты можешь внезапно понять:

Я вроде крутой. Но больше не чувствую кайфа.

Тут и начинается выгорание. Потому что когда рост останавливается, душа начинает скучать.

И тут важно задать себе вопрос: а зачем я продолжаю? Чтобы делать то же, но лучше? Или чтобы дойти до чего-то большего?

Есть история о Паганини. На концерте у него во время исполнения порвались две струны. Осталась одна. И он доиграл всё произведение на одной струне. Но и у этого момента есть своя предыстория... (спойлер: они не случайно порвались)

Вот он — момент истины. Не только мастерство, но и внутренний драйв, ради которого ты вообще занимаешься этим делом.

А если ты уже профессионал — ты всегда доволен собой?

Нет. Часто наоборот.

Чем больше ты знаешь, тем больше сомневаешься.

Внутри тебя живёт синдром самозванца, который шепчет:

Ты просто везунчик. Сегодня получилось, а завтра все поймут, что ты — фейк.

И ты можешь быть хоть трижды с опытом, а всё равно каждый раз проверять, а точно ли ты молодец.

Именно поэтому у профессионалов может быть даже больше тревоги, чем у новичков. Потому что ставки выше, и стандарты — небесные.

Перфекционизм — сладкий яд

Быть хорошим — нормально.

Быть идеальным — смертельно утомительно.

Перфекционист выбирает самую сложную роль в мире — быть всегда правильным.

Он не позволяет себе ошибаться, срываться, быть «просто норм».

Он вечно недоволен — и собой, и другими. А значит, его путь — это не путь развития, а путь выгорания.

Если ты профессионал, у тебя уже и так есть планка.

Не надо делать её недостижимой.

Что делать, если выгорел?

Позволь себе передохнуть. Даже если «нельзя», «неудобно» и «всё рухнет».

Поищи микроуспехи. Делай что-то маленькое, но видимое. Ремонт? Хобби? Короткие задачи?

Переосмысли цель. Зачем ты этим занимаешься? Просто чтобы быть лучше — или чтобы что-то чувствовать?

Да, можно выгореть от любимого дела.

Особенно от любимого. Потому что туда ты вкладывал душу.

Но именно это и делает тебя настоящим профессионалом — ты умеешь не только работать, но и останавливаться, задавать себе вопросы и искать, куда двигаться дальше.

И для поддержки самой себя и тех кому это важно сейчас я создала канал Сила слов

Можно присоединятся и каждый день получать мотивацию для своего движения вперед.