Нейросетевые инструменты для обработки изображений и видео. По крайней мере, собрали всё, что более-менее хайповало. Грубо говоря, данная публикация будет полезна даже новичкам, которые только-только начинают знакомство с нейросетями, проведем для них экскурсию + прикрепляю видео с YouTube, которые будут полезны для заинтересованных, если вы не знаете английского языка, тогда используйте Яндекс браузер с функцией голосового перевода видео.

└ Обработка и генерация фотографий и видео с помощью всяких нейросетей в тренде уже год-полтора, и только сейчас их начинает двигать ChatGPT. Поэтому можно оглянуться назад и вспомнить всё, что понаделали эксперты из больших компаний по этой теме:

Трансфер стиля на фотографии

Парень объясняет как можно стилизовать одно изображение под другое, используя специально натренированную под это дело модель. С примерами кода, само собой.

Великий и ужасный DALL-E, с которого всё началось

DALL-E — это вариация нейросети-трансформера GPT-3, самой современной модели для обработки естественных языков. Русская нейросеть ruDALL-E была основана на зарубежной модели : видео посмотреть здесь.

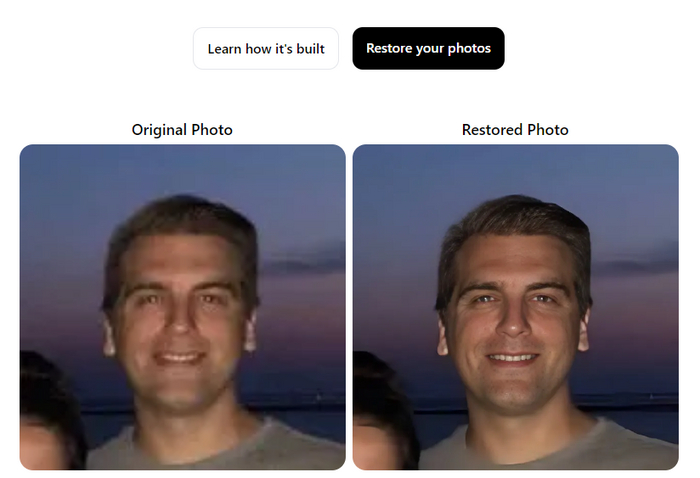

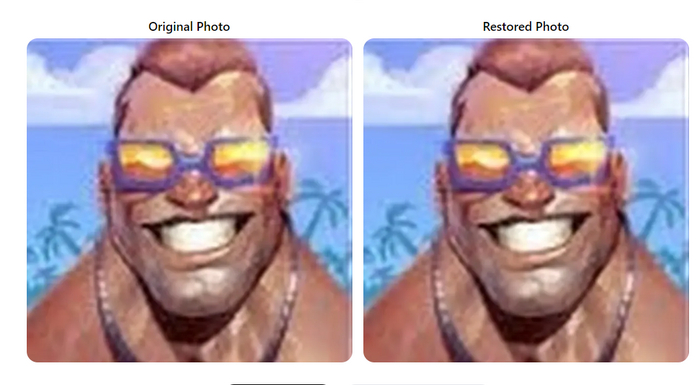

Апскейлинг и восстановление старых видео

Архитектура, примеры, объяснения зачем и почему, всё как вы любите.

Свёрточные нейронные сети широко используются в задачах распознавания изображений. Отличие от стандартных нейронных сетей, где все сигналы передаются от каждого нейрона предыдущего слоя на следующий, то тут используются специальные матрицы свертки разных размеров, которая скользит по изображению, умножается поэлементно на то, что под ней и передает сумму результата дальше в элемент следующего слоя.

Генерация аниме-девочек

Хотите создавать аниме-девочек, которые никогда не существовали? Опять обращаемся к генеративным нейронным сетям. Нам поможет нейросеть StyleGAN2 и её реализация на TensorFlow. Если у вас есть набор лиц одного стиля, то эта нейросеть прекрасно справляется с тем, чтобы поймать этот стиль и начать генерировать.

Генерация реалистичных несуществующих людей

Нейросети научились генерировать лица несуществующих людей, которые человек не может определить. Позже Microsoft решили использовать эти лица, чтобы тренировать другие нейросети.

Результаты исследования показали, что детекторы и мапперы лиц, натренированные на синтетических людях показывают практически те же результаты, что и state of the art модели, которые обучались на реальных данных. И вот таким щелчком пальцев можно избавиться от предвзятости нейронных сетей из-за несбалансированного датасета и проблем с этикой.

Редактирование видео на лету с изменениями стиля

Новый метод позволил ИИ делать сразу много разных вариантов работы с видео. Он позволяет генерировать новые экземпляры, увеличивать длительность, добавлять/убирать элементы с определёнными условиями, при этом всё из одного стартового видео.

Можно создать фарш из воды, добавить футболистов в матч или продлить выступление балерины.

Создание 3D-панорамы из нескольких фото

Создать панораму поможет view synthesis, описывающая недавно разработанный метод под названием NeX.

Чем он лучше других? Качеством (можете посмотреть на примерах), а ещё он работает в тысячу раз быстрее методов, опубликованных всего год назад.

Какие могут быть применения? Представьте что для создания VR-музея вам надо сделать небольшое количество снимков, а остальные точки зрения дорисует нейросеть.

Результаты работы надо обязательно посмотреть в видео, потому что то, как модель ловит и просчитывает различные варианты освещения и отражения просто надо увидеть.

Редактирование видео от Adobe

Исследователи из Adobe представили ИИ, позволяющий редактировать/изменять/добавлять элементы и фон на видеофайлах. Нейросеть отделяет фон от остального, разделяя видео на два атласа, которые затем можно редактировать и запихивать обратно в видеофайл (как пример приведён мальчик катающийся на велосипеде по психоделическому пейзажу).

Создание изображений по описанию от NVIDIA

NVIDIA научилась создавать абсолютно фотореалистичные изображения из описания со скоростью мысли.

На самом деле, просто научились они это делать в 2019 году с помощью нейросети GauGAN, но тут как со Шреком, сиквел получился ещё лучше. Теперь GauGAN 2 оформлена в приложение NVIDIA Canvas, в котором простыми набросками кисти и описанием можно генерировать очень крутые фотореалистичные изображения, с дальнейшей переброской в фотошоп.

Нейросеть GLIDE для локального изменения изображений

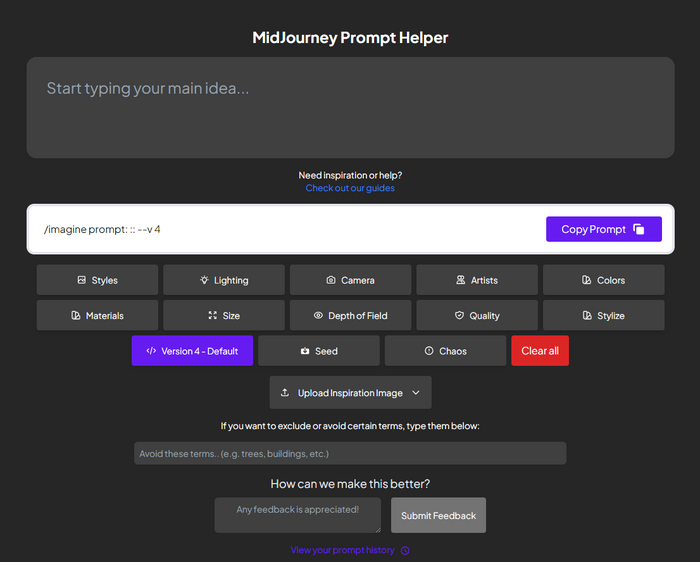

Многие слышали про нейросеть DALL-E, которая генерировала постеры фильмов/картинки по описанию. Так вот, вышла новая нейросеть GLIDE, у которой не только с генерацией всё намного лучше, но и есть способность локально изменять части картинок.

Google Collab с реалистичными фильтрами а-ля Snapchat

Обзор самой новой техники редактирования видео в реальном времени с помощью GAN. Можно приделать себе усы, которые будут весьма натурально шевелиться и перемещаться вместе с вашим лицом (зачем это вам, мы не знаем). Причём редактировать можно не только человеческие лица, а любую отмеченную зону. Ссылка на Google Collab, чтобы провести свои эксперименты прилагается.

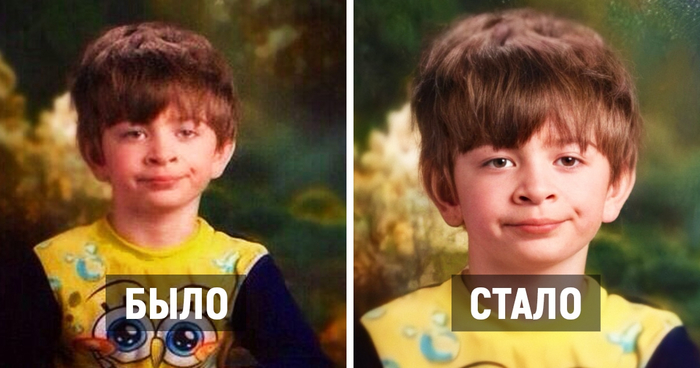

Редактирование людей на видео (эмоции, возраст, макияж)

Улучшенный метод по редактированию людей/персонажей на видео, который позволяет менять эмоции, возраст и макияж. Отличие от предыдущих методов в том, что для обработки одного кадра используются изменения, которые применяли в предыдущих (есть зависимость от времени). Результаты хоть и не идеальны, но очень близки к идеалу. Вариантов применения подобной техники будет масса (если ещё немного доделать).

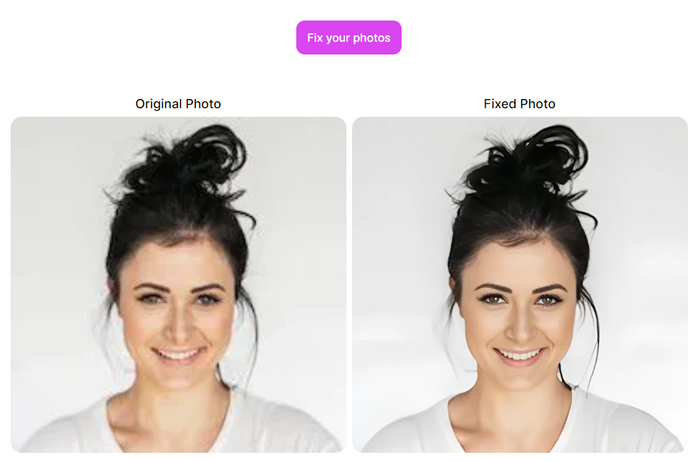

Редактирование изображений от NVIDIA (лучше, чем было)

Семантическое редактирование изображений с помощью EditGAN от NVIDIA. Можно добавлять области редактирования на изображение и прописывать то, что в этих областях должно находиться (например можно добавить номер на машину или нарисовать птицу с помощью только этих областей). Качество лучше чем у предыдущих методов, но это и понятно, иначе никто бы публиковать подобное не стал.

DALL-E 2: Electric Boogalo

Примеры работы нейросети DALL-E 2, которая создаёт изображения из контекстного описания. Тогда digital художники артов забили тревогу, а результаты работы, хоть и не безупречны, очень впечатлили публику.

Нейросеть Imagen для генерации изображений от Google

В игру генерации врывается Google со своей сетью Imagen. Архитектура проще и умеет генерировать изображения из более длинных описаний, плюс правильно отображает текст, который её попросили поместить на изображение.

Стилизованное изменение изображений от NVIDIA (StyleGAN-NADA)

Новый StyleGAN-NADA умеет генерировать лица и натягивать на них контекстные изменения, может вы хотите стать ведьмаком, белым ходаком или картиной в стиле кубизма. Отличается от предыдущих нейросетей этой самой функцией и лучшими результатами.

Ещё одна генерация изображений от Google (Parti AI)

Google Parti AI с ноги врывается в команду искусственных интеллектов генерирующих изображения (таких как DALLE-2 и Imagen). Главное отличие — отрисовка изображения не из базового шума, а из некоторых кусочков общей картины: видео посмотреть здесь.

Дипфейки от Samsung

Новые варианты deepfake-ов в реальном времени с большим разрешением. Конечно, всё ещё не идеально, но намного лучше чем в 2020 году. А если вспомнить, как быстро менялась та же генерация изображений, то вероятно, что до совсем качественных deepfake-ов уже недалеко.

Генерация текстур от OpenAI

То, что DALLE-2 умеет генерировать изображения по тексту мы знаем. А теперь посмотрите, где люди уже навострились применять эту функцию. Генерация текстур, фотореалистичных лиц и виртуальных миров это только часть.

Stable Diffusion 1.4

Код StableDiffusion (альтернатива DALLE-2) для создания изображений и их непрерывного изменения в другие появился в открытом доступе. Можно попробовать запустить у себя или покопаться под капотом и попытаться улучшить (если есть что улучшать).

Модификация фотографий от Google (DreamBooth)

Через ИИ под названием DreamBooth люди могут генерировать изображения, на основе уже существующих с дополнительным описанием. Например, можно загрузить фотографии своей собаки и и попросить нарисовать её плавающей или на приёме у грумера. Можно смешивать изображения, модифицировать детали, бэкграунд или угол зрения.

Генерация изображения «вглубь» от Google (InfiniteNature-Zero)

InfiniteNature-Zero от Google AI, это улучшенная версия предыдущего метода по генерации изображения «вглубь». На этот раз, для обучения ему нужны только фотографии (а не видеоряд), плюс результаты сильно качественнее и контроль за «полётом вглубь» лучше (можно, например, поворачивать): видео посмотреть здесь.

Генерация 3D-ассетов от Google (DreamFusion)

Google, в дополнение к уже существующим DALLE-2 и StableFusion, добавили ИИ под названием DreamFusion, который умеет по тексту генерировать 3D модели. И не просто 3D модели, их сразу можно использовать в качестве ассетов для игр/видео/куда там ещё можно эту модель запихнуть: видео можно посмотреть здесь.

Text-to-video от Google

Google теперь умеет генерировать небольшие видео по входному тексту, при этом сохраняя временную когерентность (то есть кадры переходят друг в друга очень плавно). Правда ИИ с небольшим «костылём», если так вообще можно сказать. Сначала генерируется видео в очень плохом разрешении, а затем с помощью апскейлинга дотягивается до 720p: видео здесь.

Waifu-diffusion (создай свою аниме-девочку)

Может кто-то из вас уже видел результаты работы stable diffusion моделей, которые рисуют красивых девушек. Так вот, таких моделей несколько, можно использовать Stable Diffusion, можно использовать его вариацию Waifu Diffusion (по названию можете понять, на чём конкретно ее обучали), Dreambooth и NovelAI: видео посмотреть здесь.

Анимирование изображений от Google (StyleGAN)

StyleGAN умеет хорошо анимировать различные картинки по нашему запросу того, что должно происходить, причём с хорошей темпоральной когерентностью (от кадра к кадру детали объекта почти не меняются), лучше чем предыдущие text-to-image модели.

Style-трансфер на видео с людьми

Модель с новым подходом может производить стайл-трансфер на видео с реальными людьми, со скоростью от 5 до 10 изображений в секунду, сохраняя темпоральную когерентность (например, при смене кадра волосы не колбасит и они не идут странными узорами).

Спецэффекты на видео с помощью текста от NVIDIA

Новый ИИ от NVIDIA умеет накладывать спецэффекты на видео с помощью всего нескольких предложений. Хотите чтобы пятна на жирафе были из разноцветного стекла? Так и скажите. И вам всё сделают.

Локальное изменение изображений с помощью текста от Google

Новый ИИ от Google под названием Muse умеет изменять части изображений, но теперь вам даже не надо рисовать слой-маску, под которым надо что-то менять. Дали изначальное изображение, написали конечный результат (который должен хоть частично напоминать стартовую точку) и получаем изначальную композицию с изменёнными деталями.

Создание короткометражек по сценарию от Google AI

ИИ от Google под названием Phenaki теперь умеет создавать долгие видео из последовательности строчек сценария, при этом вполне последовательно и с нужными переходами: видео посмотреть здесь.

От переноса стиля на фотографии, до короткометражек из текста всего за 1.5 года. Прогресс действительно не стоит на месте.

Нейросекта — это новый канал в Telegram, где вы сможете найти больше инструкций и полезных публикаций, так как мы потеем над контентом и вручную все тестируем, к слову нас уже почти 3 000 подписчиков, спасибо за поддержку!