Нейросети для 3D-художника. Могут ли они помочь уже сейчас?

Попробуем с помощью нейросетей создать концепт персонажа и окружения, перевести концепт в модель и создать текстуры!

Будем использовать только самые крутые инструменты на базе AI, причем большинство из них бесплатные, а остальные имеют аналоги. В результате выясним, что умеют и чего не умеют нейросети в середине 2023г. с точки зрения работы 3D-художника.

Итак, рассмотрим, насколько сильны нейросети на следующих этапах:

концепт персонажа

концепт окружения

создание моделей

текстурирование

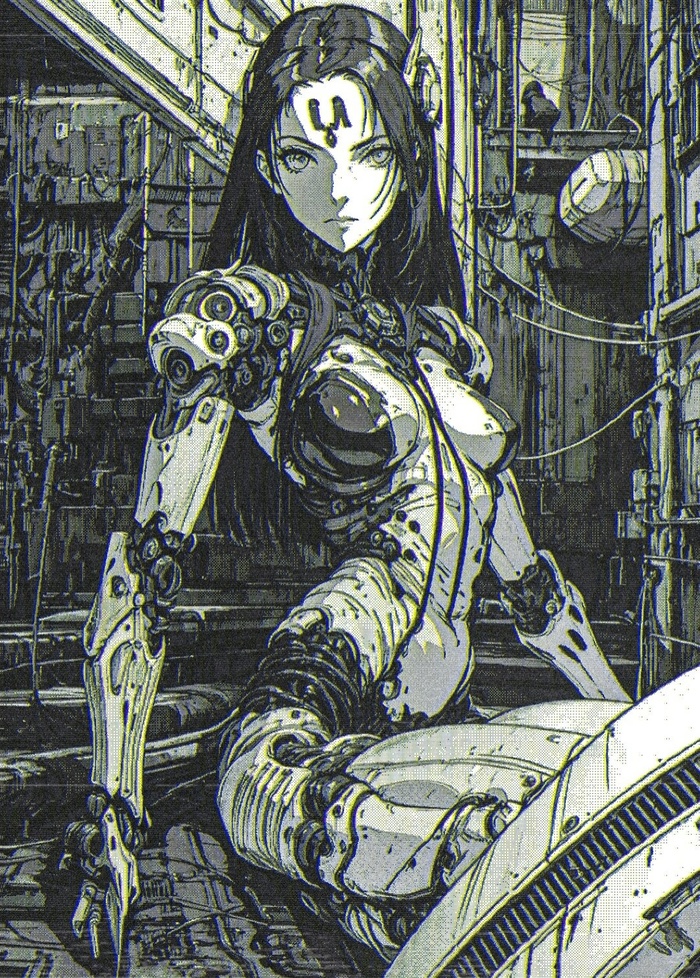

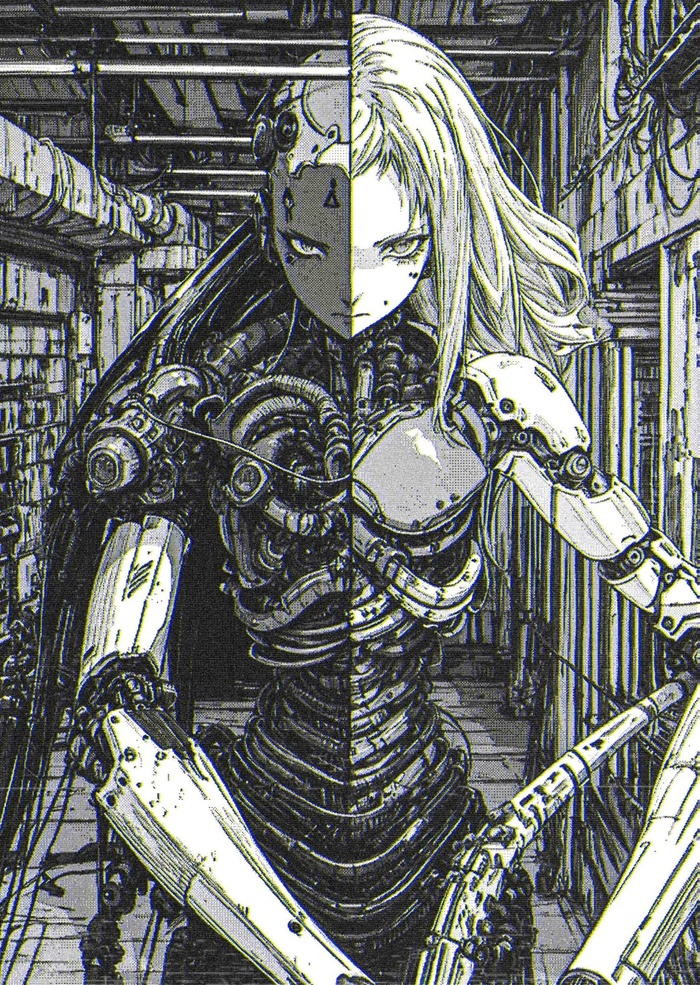

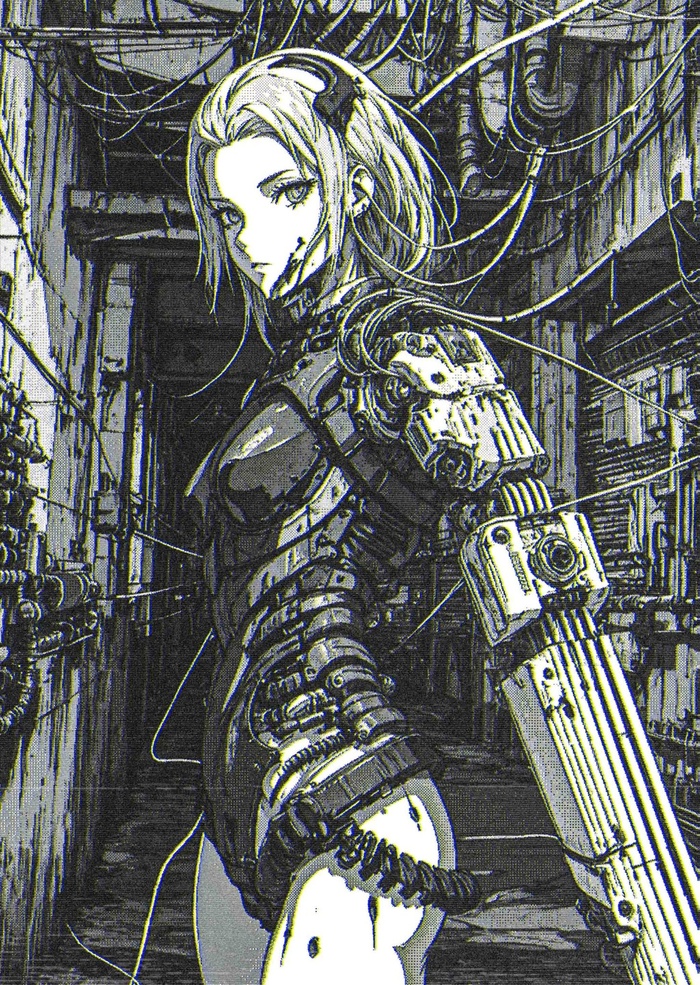

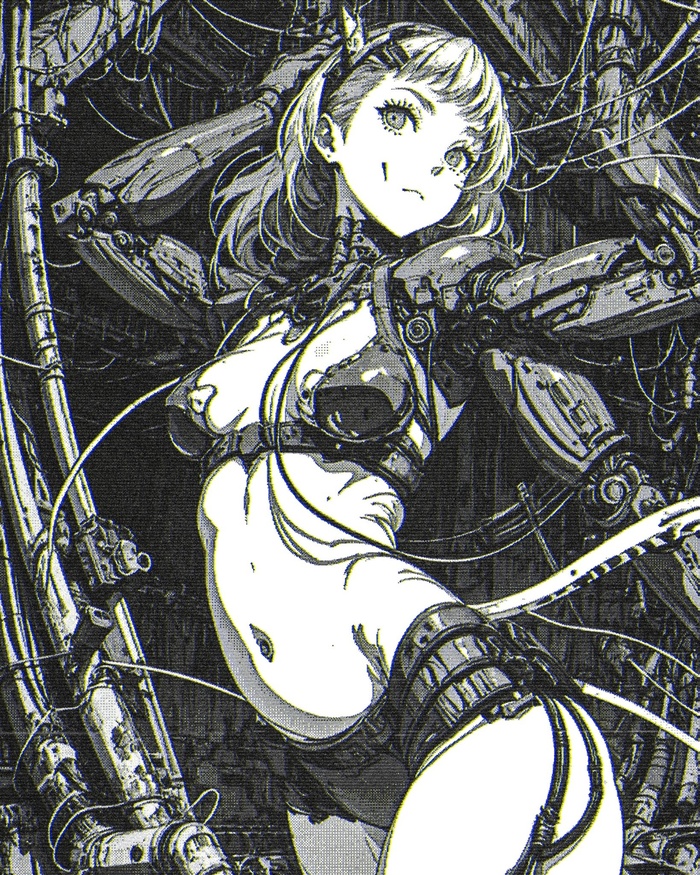

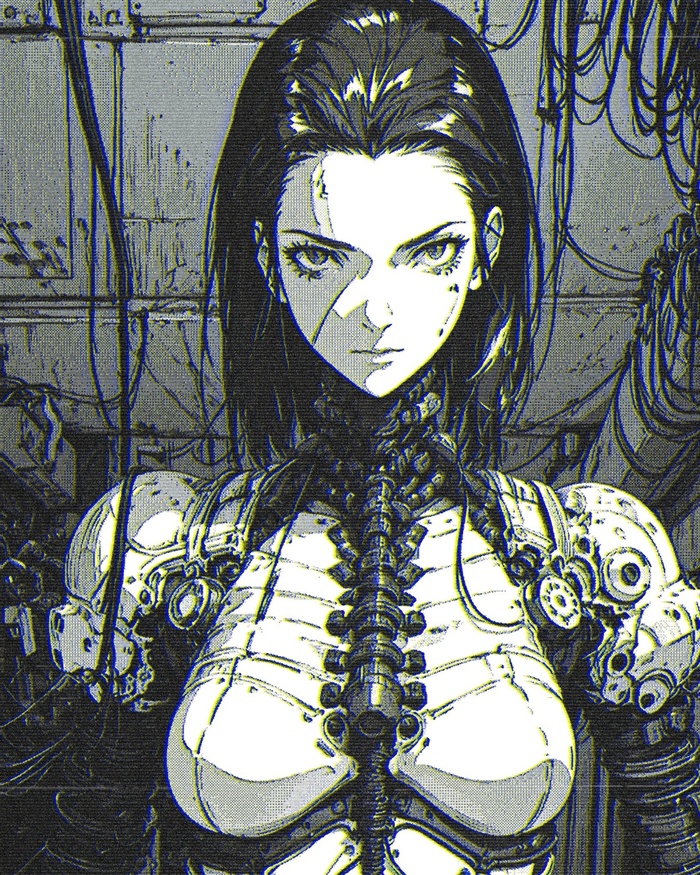

Концепт персонажа

Все начинается с 2D-изображения, чтобы визуализировать идею, оценить ее и, при необходимости, доработать. Нерационально было бы тратить время на моделирование каждой идеи, пришедшей в голову, поэтому протестируем нейросеть на понимание концепции и стилистики.

Цель: создать образы разных персонажей и передать атмосферу в кадре.

Проработку исходного прототипа персонажа доверим Midjourney, она сегодня считается лучшей и чтобы в случае неудач не думать, что какая-то другая нейросеть справилась бы лучше.

Женские персонажи:

1. Амазонка в джунглях

2. Женщина-ниндзя в мегаполисе, стоящая на крыше небоскреба

3. Обитательница пустыни в привычной среде

4. Женщина ацтек, пусть тоже будет в джунглях

Мужские персонажи:

1. Викинг в меховой накидке

2. Восточный борец в стиле 3D-игры

3. Самурай в горах

4. Китайский воин на фоне храма

Дополнительно были заданы: стилистика изображения и цвета.

Промпт для этих изображений был использован такого типа: realistic high quality front view Asia looking armed warrior in a helmet, black and yellow colors, destroyed city as a background

Проанализируем результат: результат устраивает в части качества изображения и соответствия стилю, пожелания по цветам и фактурам также соблюдены и переданы отлично. Но в большинстве случаев персонаж показан лишь до середины бедра, т.е. не в полный рост.

Проверим, будет ли все хорошо с ногами. Опишем, что хотим кожаные сапоги выше колена с металлическими элементами. Вот что получилось:

Оказалось, что получить персонажа в полный рост не так то просто, но получилось составить работающий промпт: a full body shot, destroyed city as a background, Asia looking armed warrior in a helmet, black and yellow colors, black helmet and boots, photorealistic --ar 1:2

Все части промпта использовать обязательно (только изменить под ваш запрос) кроме:

photorealistic — этот запрос делает изображение более фотореалистичным

--ar 1:5— это делает "портретное" соотношение сторон

black and yellow colors — цвета картинки

А что если наш персонаж и не человек вовсе, а, скажем, добрый гном в красном костюме, который катается на качели? И тут начинается интересное: нейросеть не понимает, как такое возможно. Сначала выдает хмурых гномов, причем, модификация промпта лишь утвердила в мысли о том, что, видимо, по представлениям нейросети гном – это вообще не очень-то доброе существо. Добрый гном – это, в лучшем случае, просто грустный.

Гном был выбран не случайно – он пригодится нам для тестирования другого сервиса на следующем этапе работы.

Чтоб хоть как-то исправить ситуацию, пришлось добавить в промпт «смеющийся гном» и после многочисленных итераций появились изображения, которые уже можно считать приемлемыми:

Вывод: уже сейчас нейросети можно использовать для отрисовки прототипа персонажа. Сколько потребуется итераций для получения нужного результата зависит от того насколько хорошо вы составляете промпты и насколько персонаж является нестандартным.

Концепт окружения

Окружение – тоже важная часть работы. Продумаем нашу сцену.

Поставим 4 задачи и посмотрим, какие результаты выдаст Midjourney:

1. Окружение в стиле и цветах Аватара

Также хотим, чтоб была вода, статуя и ступени. Результат соответствует ожиданиям, вот только все в разных картинках:

2. Дорога к храму Ацтеков

К запросу добавлен в качестве освещения вечерний свет:

3. Двор около египетского храма

Весьма интересные детали, также очень удачна в данном контексте дымка в воздухе:

4. Тайский храм

Тайская архитектура имеет множество замысловатых деталей, но все получилось вполне неплохо:

Но что если нужна не одна сцена, а целый мир?! Здесь помогут уже совсем другие инструменты. Совершенно бесплатный инструмент NVIDIA Canvas обновился: теперь можно создавать панорамы из рисунка с помощью базовых инструментов «Море», «Горы», «Пляж», «Облака» и пр. (панель справа с квадратными цветными кнопками):

Достоинства инструмента – можно рисовать по слоям, затем их редактировать, интерфейс предельно понятный, для доступа нужно лишь скачать бета-версию NVIDIA Canvas с официального сайта.

Полученное изображение уже можно установить как HDRI Backdrop в Unreal Engine и вот наш персонаж уже в весьма реалистичной среде!

Этот инструмент идеально подойдет для разработки концепта и когда в рамках проекта не подразумевается интерактивное взаимодействие персонажа с окружающей средой:

Но порой нам нужно создать что-то фантастическое или фантазийное. Идеально было бы описать наш воображаемый мир словами, чтоб он потом взял и материализовался прямо из описания.

Такой инструмент тоже есть, на этот раз от студии Blockade Labs. Это очень крутая штука, попробуйте обязательно. Сервис позволяет создавать панорамы миров в разных стилях. Он создает панораму подобно тому, как это делает NVIDIA Canvas, на основании описания, работает на базе Stable Diffusion, причем, можно выбрать стилистику из предложенных в выпадающем списке:

Что еще круто – в отличие от ранее запущенного сервиса Latent Labs, здесь стык границ панорамы не виден.

Вывод: на сегодняшний день эти сервисы пока не трансформируют исходную идею в трехмерное пространство, однако, это ранний уровень развития технологии, которая уже позволяет сделать часть работы и существенно ускорить процесс, не делая, например, в ряде случаев лишних моделей, расположенных на дальнем плане.

Создание моделей

В 2020г. PIFuHD анонсировала сервис, позволяющий с помощью нейросетей идентифицировать образ одетого человека и трансформировать его в 3D модель. Прошло 3 года – что же изменилось, насколько продвинулась технология, давайте посмотрим.

С тех пор появились новые сервисы. Качество их работы представлено на картинке ниже:

На сегодняшний день лучшие результаты выдает ICON (четкий образ, детали складок одежды, лица). Также интересно, что эта технология позволяет достраивать изображение с обратной стороны, которое на исходной картинке не видно (см нижний ряд в красной рамке):

Применим этот сервис к нашему гному и попробуем получить 3D модель.

После загрузки изображения полученную модель можно скачать. Итак, исходное изображение гнома слева, а полученная скачанная модель – справа:

Как будто нейросеть нам подсунула что-то из имеющихся у нее поз, хоть как-то похожих на позу нашего персонажа. Хотя, гном не так уж сильно отличается от человека, разница, в основном, лишь в пропорциях.

Что ж, похоже, гнома пока придется лепить в ZBrush самостоятельно.

А что если наш персонаж это робот-насекомое. Сервис Latent Labs предлагает создать 3D-модель и скачать ее. Посмотрим на результат.

Далеко до хорошего результата, но уже что-то: бесплатно, на генерацию ушло меньше 1 минуты. Перспективный сервис – нужно за ним наблюдать и держать руку на пульсе.

Если же персонаж это что-то физически существующее (например, трансформер который у вас есть) то здесь все лучше: с помощью нейросетей LumaLabs можно воссоздать объект в 3D.

В сети также много шуму наделала платформа KAEDIM. Генерирует изображения даже из Вашего скетча. Правда, быстро эта платформа обросла слухами. И вот почему. Чтобы сгенерировать 1 изображение нужно 20$ и около часа времени. Оказалось, что к нейросетям этот сервис не имеет никакого отношения – по слухам, компания ищет сотрудников, которые умеют быстро моделировать. Получается такой Upwork с приоритетным принятием заказов, ибо желающих тестировать технологии много и они даже готовы платить.

Вывод: пока у нейросетей не получается создавать пригодные для использования 3D модели, хотя бы на уровне тех же smoothie-3D и MonsterMash (которые работают без них).

Текстурирование

Изображения, которые генерирует Midjourney, прекрасного качества и функция тайлинга работает достаточно хорошо, но эти результаты пока нельзя использовать для получения реалистичных текстур, так как Midjourney слишком творческий – по запросу «бетон» результаты следующие:

Если же нужны какие-то фантазийные текстуры, то здесь другое дело:

В Dall-e мы получим бетон, который ожидаем, но там другая проблема – разрешение не может быть более 1024x1024 и тайлинг не так хорош.

Есть и общая проблема – контролировать перспективу достаточно сложно даже текстом промпта, не говоря уже о том, что для получения всех необходимых карт нужно использовать стороннее ПО.

Но сколько времени уходит обычно на то, чтобы сделать из текстуры бесшовную. Даже в Substance Sampler это часто занимает намного больше времени, чем хотелось бы, более того – уже бесшовную текстуру он умудряется порой наложить как материал все равно с артефактами.

В качестве решения обозначенных проблем, попробуем сервис WITHPOLY, который и генерирует картинки, и делает бесшовные структуры. И здесь мы сразу получаем все нужные карты для материала!

У сервиса есть своя библиотека, но зачем нам стандартные решения, когда мы хотим создать свое. Попробуем что-то нестандартное: первый - рис с овощами, второй – павлиньи перья. Результаты приведены ниже:

Если нажать на 4 серых квадрата, выдаст еще 3 генерации по этому запросу, т.е. будет плитка из 4х вариантов. Также в правом верхнем углу можно включить опцию «Seamless Canvas», тогда все черное поле будет залито этой текстурой, чтобы посмотреть сразу. В бесплатном варианте доступно к генерации разрешение 1К и 2К.

Выводы: в текстурировании нейросети уже наступают на пятки классическим лидерам индустрии.

Подведем итоги

Нейросети уже можно использовать для создания концептов и текстурирования, но все еще нельзя генерировать пригодные для использования 3D модели.

Нейросети пока не заменят 3D-художников, но уже могут им помочь. Это значит, что 3D-художник, который работает с нейросетями, будет обладать преимуществом перед тем, кто с ними не работает.

Так же не стоит забывать, что нейросети активно развиваются и стоит как минимум за ними следить ;)

Следить можно на нашем тг-канале Нейрокульт — там рассказываем как применять нейросети на практике.

Нейросеть для создания 3D окружения с помощью рисования в пространстве

Рисуете основные линии окружения, пишите промт и готово.

Ребята, это просто нечто, надо чекать: https://skybox.blockadelabs.com/

ссылка на пост в телеграм

Устанавливаем Instant NerF на свой компьютер. Генерация изображения в 3D сцену

Прежде всего, чтобы установить данное приложение, вам необходимо обладать видеокартой Nvidia.

Необходимо помнить, что поколение видеокарты определяет, какой дистрибутив приложения вы можете загрузить.

Если у вас комп с операционной системой Linux, то вы также можете установить Instant NeRF. На устройствах с macOS данное приложение работать не будет.

Для загрузки дистрибутива необходимо загрузить пакет разработчика CUDA версии 12 размером 3,4 Гб, а также программу сборки исходного кода CMake версии v3.21. Для компиляции кода вам понадобится компилятор с поддержкой языка C++, например, Visual Studio 2019 или 2022.

После выполнения всех требований, можно приступить к инструкции по установке приложения. Она довольно проста и заключается в загрузке архива и запуске всего одного файла с расширением ".exe".

CUDA: https://developer.nvidia.com/cuda-toolkit

CMake: https://cmake.org/

Ссылка на пост в телеграм

Угроза нейросетей для 2D и 3D-художников

На днях на ArtStation произошло одно событие. Многие 2D-художники стали выкладывать вместо своих работ картинки с протестом. А выступали все они против нейросетей для генерации изображений таких как Midjourney, обученных на миллионах картинок и фотографий со всего мира. Нейросети уже могут выдавать очень приличный результат по заданным параметрам, но пока не в состоянии по итогу генерировать несколько скринов в одном едином арт-стиле. Думаю, что это со временем исправят. Напрямую угроза потери дохода или работы коснулась иллюстраторов и концептеров, да и вообще 2D-шников.

Однако плюсы у Midjourney есть. Ее можно использовать как дополнительный инструмент в своей ежедневной работе с 3D-графикой. С ее помощью можно сгенерировать пару десятков таких изображений и использовать их в качестве референсов.

Похожая ситуация была, когда появилась система захвата движений - Motion Capture. После ее распространения в индустрии, упал спрос на аниматоров. А многие из них востребованы только для чистки "ключей" первичной анимации в софте.

3D-шникам, такая перспектива в ближайшее время не грозит. Однако, "звоночки" уже есть. Так в UE5 появилась виртуализация геометрии, а это можно приравнять к автоматизации LOD-ов. Кроме того, существует нейросеть Kaedim, которая конвертит 2D изображение в 3D ассет в онлайне. Результат работы Kaedim уже можно использовать в качестве рефа или base-mesh для начала моделирования. Но успехи, конечно, не сравнить с Midjourney. Нейросеткам по типу Kaedim еще расти и расти, но вектор уже понятен.

История знает много похожих примеров: телефонистки, извозчики и ямщики, фонарщики, машинистки, трубочисты и так далее. Все эти профессии практически исчезли, а если где-то и применяются, то в единичных количествах.

Прогресс не остановится, а оставаться востребованным специалистом можно только постоянно развиваясь.

Больше материалов по 3D графике и gamedev на канале Записки 3D-шника. Канал мой. Все статьи написаны лично. Делюсь собственным опытом и знаниями.

Ученые показали, как будет выглядеть человек в 3000 году — исследователи с помощью ИИ создали гротескную 3D-модель человека будущего

Ученые показали, как будет выглядеть человек в 3000 году — исследователи с помощью ИИ создали гротескную 3D-модель человека будущего.

Модель назвали "Минди" и по прогнозам ученых, спустя 800 лет использования гаджетов, у людей будущего уменьшится мозг, вечно согнутая шея станет толще, а пальцы приспособятся к основной их функции — держать смартфон.

Минди была создана компанией Toll Free Forwarding как способ визуализации того, как технологии влияют на наши тела.

В беседе с Toll Free Forwarding доктор Никола Джорджевич из Med Alert Help объяснил:

То, как мы держим наши телефоны, может вызвать напряжение в определенных точках контакта, что приводит к "текстовому когтю", который известен как кубитальный туннельный синдром.

Помимо "текстового когтя", у людей может возникнуть "смартфонный локоть" - постоянный угол в 90 градусов, вызванный типичным положением руки при держании устройства.

Поиграем в бизнесменов?

Одна вакансия, два кандидата. Сможете выбрать лучшего? И так пять раз.

Пресловутая кнопка " сделать красиво" появилась?

Всегда хотелось делать картинки, как на обложку. Получалось крайне редко. В 3D и фотошопе трудился самоотверженно не один десяток лет. А результаты более чем скромны Так что же, мечта сбылась? Можно - по быстрому из хренового 3d - наброска сделать шедевр? Поиск какую-то околесицу выдает.

Если было - удалите пожалуйста.