Мегатрон за $1200

Компания Robosen недавно выкатила такие на рынок: умеет превращаться в танк, управляется дистанционно, знает 270 фраз и стреляет.

В комплекте идёт целая куча разных гаджетов, которые можно повесить на робота. Это и пушка, и огромный меч, и цепь с шипами.

Обзор на мотоцикл ZONTES ZT350-R1

Пикабу, привет 👋

Сегодня пришло время рассказать про новый для меня бренд ZONTES, модель которая оказалась у меня на тесте ZT350-R1

Так же по традиции видеообзор будет на моем канале в YouTube, поэтому приятного чтения и просмотра, поееехали 🏍️

1. Внешность

Мотоциклы Zontes все выглядят как будто они из трилогии трансформеров, максимально футуристический вид, каждый из них имеет черты чего-то знакомого, но из будущего.

Часть моделей

Также хочу подметить далеко не все мне нравится, но взгляд и интерес они цепляют. На тесте у нас классический нейкед, но из будущего. Тут тебе и стильные литые 17 диски, консольный маятник, дерзкий выхлоп (правда звука 0, он очень тихий) и куча электронных примочек на которых стоит подробнее остановиться.

Начнем с того как ты подходишь и вставляешь ключ....иииии....ничего, ведь его в классическом виде нет. Тут у нас стоит бесключевой доступ и он у нас в виде брелка на руку или на цепочку (с виду это mi band и чехлы от него так же думаю подойдут).

Дальше по фишкам, тут электронно открываемый лючок бензобака, электронно открываемая сидушка, а чтобы не было вопросов «а что будешь делать если сядет аккум ?» да ничего, просто поставлю на зарядку через порт под задним хвостом. На удивление китайцы продумали и этот момент, плюс как ни крути у мотоцикла крупный АКБ аж 10 Аh.

2. Оптика

По оптике можно сказать так, спереди она эффектная и очень современная, светит в целом нормально, мне не хватило немного яркости и четкости линии, по кругу все на светодиодах, сзади вопросов нет, очень стильно и ярко, вас точно заметят + к безопастности!

3. Управляемость и маневренность

Начнем с того, что это недорогой стрит и ждать от него чего-то феноминального не стоит. Поэтому мне он понравился очень комфортной подвеской, ее не прошибает и на стыках все проходит деликатно. Это будет классно для новичка и людей, которые катаются в регионах (т.к не обязательно выкатываться на улицах, где хороший асфальт). Но у мягкой подвески есть обратная сторона, это повышенные клювки на торможении и разгоне, а также меньший контроль в скоростных поворотах, правда, о чем это я...мы же на 350 кубах)

4. Мотор и КПП

На борту у нас стоит 1 цилиндровый моторчик, похожий на (Хондовский), а если точнее 348 кубов 39.43 л.с, сколько-то крутящего момента, инжектор и водяное охлаждение, причем тут компания прям заморочилась и установила 3 радиатора на ОЖ, и еще один масляный. Помимо всего, из-за экологии здесь установлен просто громадный катализатор под двигателем, который убивает не только звук, но и частично динамику. Кстати максималка тут чуть больше 150, что в целом хорошо и достаточно для стритового мотика.

5. Комфорт и эргономика

В целом, на стрите сидиш почти прямо и от этого у тебя не устает спина, плюс тут уже в базе сиденье с гелием и он помогает при долгих поездках, а также я был удивлен, что даже двойке было комфортно.

Пульты действительно высокого качества, работают четко и установлены на своих местах , правда первое время чувствуешь перегруз по кнопкам , но проехав пару сотен км все становится понятно.

Приборка цветная, многофункциональная, правда много инфы тут отрисовано очень мелко, но самое главное это спидометр (прям четко), также на эту приборку можно дублировать изображение.

6. Тормоза

По тормозам могу сказать так, что для одного их точно достаточно и не было момента, когда хотелось бы побольше, с двойкой в целом тоже хорошо, но если катать на серпантине, то через какое-то время я думаю, их не станет хватать по характеристикам: спереди это около 300 мм J.Juan (Brembo) 4 поршня и ABS , сзади один поршень собственный.

Итого мы получаем сбалансированный мотик с современным и футуристичным дизайном, кучей электронных плюшек, гарантией в 2 года, и как оказалось складом запчастей и каталогом, что не у каждого бренда сейчас есть.

А здесь "ПУТЕШЕСТВИЕ В ЖИЗНЬ" вы можете почитать серию постов про наше кругосветное путешествие)

Благодарю всех за внимание!

Рекуррентные сети против трансформеров

Или история о том, как научная статья "Вам нужно только внимание..." немного перевернула игру и индустрию ИИ.

Трансформеры становятся сотами или попросту попадают в самые последние решения сферы NLP. Кстати, заслужили свою популярность они вообще недавно — только в 2017 году, когда курс доллара был 60 рублей, а для тг-каналов с новыми ИИ не исчислялись тысячами.

Мы уже писали почему трансформаторы стали популярными и как обеспечили компаниям по типу OpenAI успех. Не зря их главный продукт называется GPT, иначе Generative Pre-trained Transformer.

Нет взрывающихся или исчезающих градиентов.

Параллельное и быстрое обучение.

Механизм внимания и больше никакой зависимости от положения слов.

Читайте об этой архитектуре нейронок в нашем новом материале

В чем проблема рекуррентных нейронок?

Задачи машинного перевода, языкового конструирования или распознавания голоса. Когда-то все они решались при помощи RNN, так называемых, рекуррентных нейронных сетей, которые упрощали, сводили огромное число параметров к конечному результату и условному прогнозу.

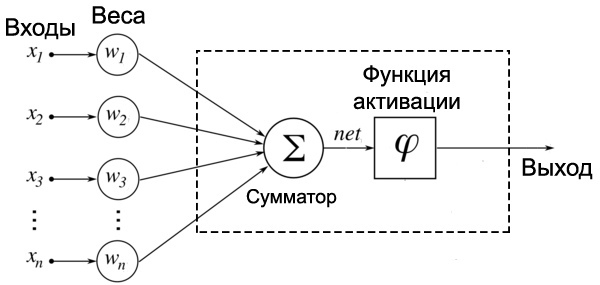

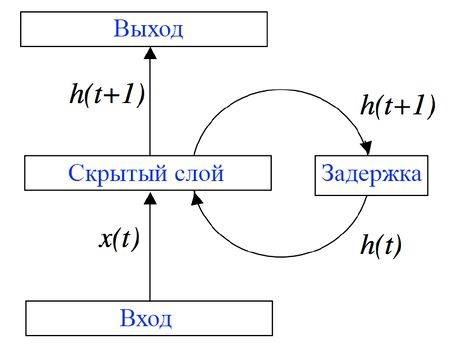

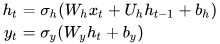

Отличие RNN от обычной нейронки со скрытыми слоями и output/input — наличие временной компоненты и памяти.

Принцип работы рекуррентных нейронных сетей основан на идее обратной связи, где выход одного шага сети используется как часть входа на следующем шаге. Информация из предыдущих шагов последовательности сохраняется и передается на следующие шаги для анализа и прогнозирования. Именно поэтому RNN доминировали в решении задач, связанных с языком.

В этом смысл названия. Рекурсия. Мы постепенно переходим от временного шага t и входных данных к новому скрытому состоянию и так постепенно накапливаем данные. Так и учитывается контекст. Читая книгу, мы запоминаем детали с предыдущих страниц, а в конце неожиданно начинаем сами дописывать прочитанный нами "детектив"...

Создатели RNN-щики попросту учли наш способ чтения — он последовательный. Слово за словом, состояния за состояниями, данные за данными. Обрабатывая токен или слово, ИИ запоминает "информацию" с токена и передает ее дальше для использования при обработке следующего слова/токена. У каждого слоя нейронки появляется своеобразная "память".

Помимо связей между слоями, элемент получает связь с самим с собой, возвращается к себе, передавая информацию с текущего момента времени t1 в следующий момент времени t2.

Возьмем за пример предложение: “I love dogs”. Сначала рекуррентная нейронка пронесет через себя I, которую можно представить в виде вектора, запомнит некоторые данные и использует их при последующей последовательной обработке love.

Формулы рекуррентной сети немного сложнее:

Обучаемая матрица в конкретный момент времени t умножается на входные данные. Все это суммируется с умноженной обучаемой матрицей и скрытым вектором на предыдущем шаге (t-1). Все это безусловно прогоняется через функцию активации.

Новое скрытое состояние умножается на обучаемую матрицу и готово. Наш выход yt!

Вектор скрытого состояния — это и есть "память" слоя.

Мы получили новое скрытое состояние, приправив обработанное старое дополнительными входными данными. Всем понятно, что такие рекуррентные нейросети из-за своего принципа постепенного накопления данных работают дольше. Представьте себе нейросеть, которая прогоняется через тысячи слов и предложений…

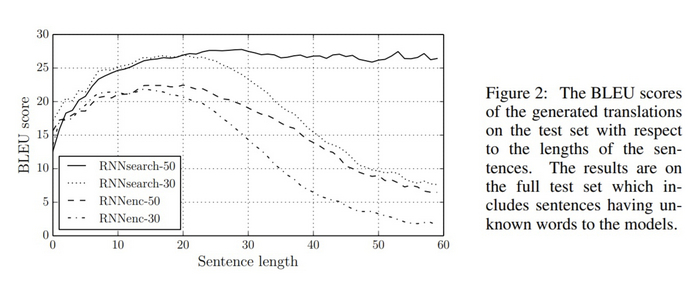

Память у такой рекуррентной сети неизбирательная, так что в какой-то момент мы просто можем забыть "информацию" с самых первых “скормленных” слов… При обработке длинных последовательностей RNN кодеры могут столкнуться с проблемой исчезающего градиента.

Так как нам учитывать все эти злосчастные скрытые состояния, а не только одно последнее? Вот для этого в 2017 году энтузиасты и разработали механизм "Attention".

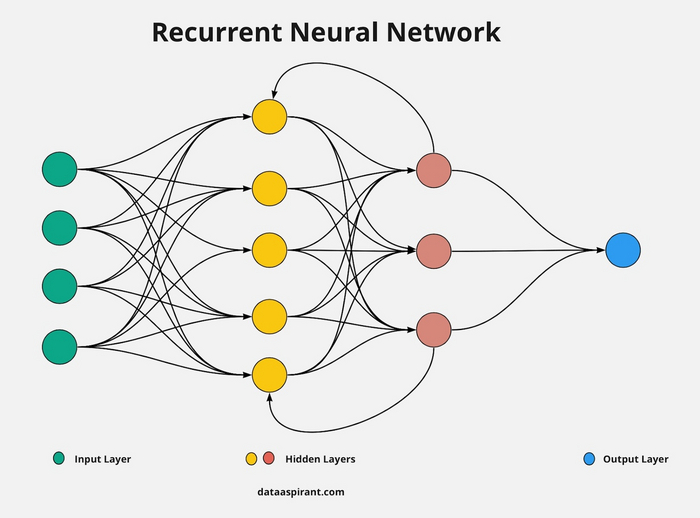

Механизм внимания: RNN + attention

В нужные моменты мы обращаем внимания на нужные слова. А не распределяем токены один к одному. Очевидно, что, например, последовательность слов в разных языках разная. А одни слова чаще употребляются с другими. Принцип Attention, который был разработан ученым-энтузиастами, призван как раз распределять веса или значимость токенов/слов и создавать эффект “контекста”.

Принцип максимально приближен к имитации семантических цепочек.

Например, плитку мы упоминаем в архитектурном, строительном или интерьерном контексте. Для любого слова в языке есть набор постоянно употребляемых в контексте слов. Говорим "выстрели", скорее, из ружья или пистолета... Говорим “включи” чаще ПК, телефон или "в розетку".

Млекопитающее-кит-планктон-вода...

Стул-стол-гарнитур-мебель-вилка...

Мы можем распределить "значимость" одних слов для других. Стулья бывают разные: на улице, на кухне, в банкетном зале, в офисе... Необязательно стул как-то должен быть связан с гарнитуром или вилкой. А вот со столом...

Именно поэтому предпочтительнее в тексте раскидывать значимость слов контекстуально.

Легче понятие "attention" описать концепцией сущности вещей. Вот есть у нас автомобиль, что прежде всего делает автомобиль автомобилем? Безусловно — колеса. Колеса важнее всех остальных элементов.

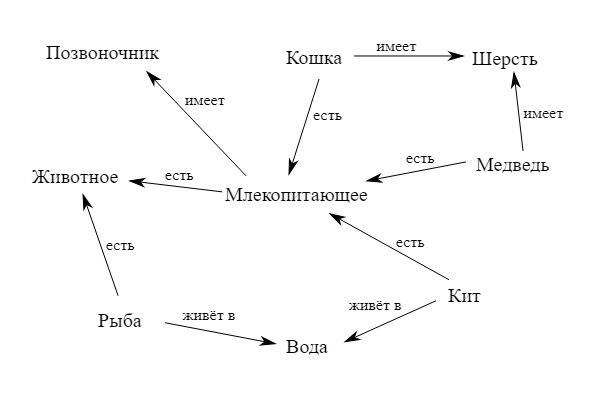

Attention (внимание) в машинном обучении — это механизм, который позволяет модели динамически выбирать, на какие части входных данных сосредоточить своё внимание при выполнении задачи.

Механизм Attention используется для вычисления весового коэффициента для каждого слова во входной последовательности на основе его важности в контексте текущего запроса или задачи. Эти весовые коэффициенты затем используются для взвешенного суммирования представлений всех слов, чтобы получить контекстуализированное представление.

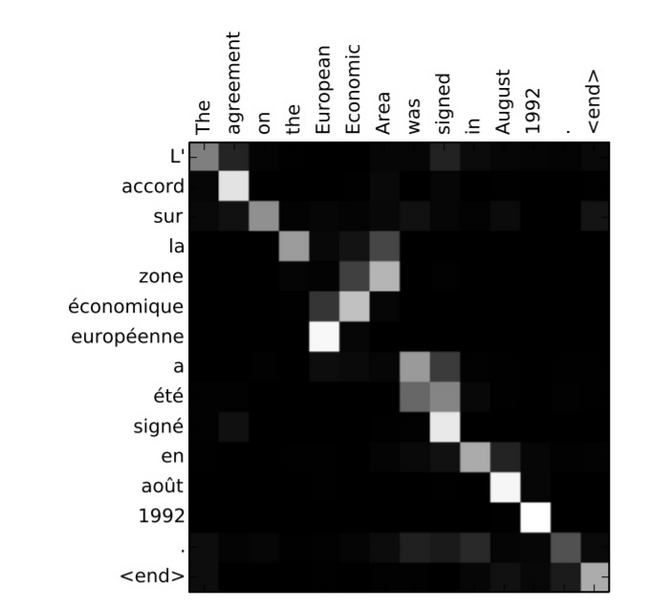

Матрица должна обучаться при тренировке. Для каждого токена она будет считать вектор и распределять места по месту в предложении. Выглядит это примерно так.

Механизм Attention задает матрицу весов или тех самых семантические цепей, где определяется важность одних слов для других. Если открыть обычный google-переводчик, мы увидим целый список переводов одного слова по степени их популярности или важности.

При работе типичных кодеров/декодеров, например, вариационного автокодировщика результаты с применением дополнительного слоя Attention повышаются, значительно. “Внимание” раскрывает вероятностный подход нейросети.

Какая вероятность, что перевод слова sex – любовь, а не пол человека? Но полноценно вся мощь этого механизма разработана в трансформерах.

Attention заменяет каждый эмбеддинг токена/слова на эмбеддинг, содержащий информацию о соседних токенах, вместо использования одинакового эмбеддинга для каждого токена вне зависимости от контекста. Если бы мы кодировали слова по принципу словаря, получили бы просто “мешок слов”, который никак с друг другом не связан.

Трансформеры или сдвиг парадигмы в NLP

Теперь вместо рекуррентных нейронок пришло время трансформеров. Они учитывали контекст избирательно и формировали своеобразные матрицы весов для слов. Теперь процесс обработки естественного языка предполагал не последовательной накопления нагромождения данных, а получения избирательного контекста отдельных слов и их употреблений…

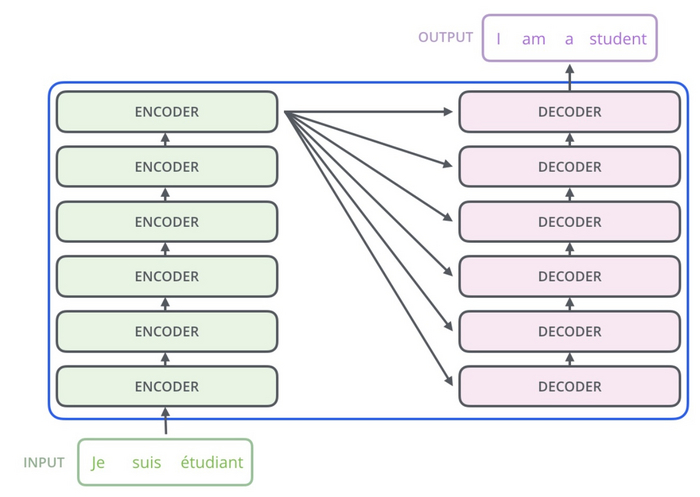

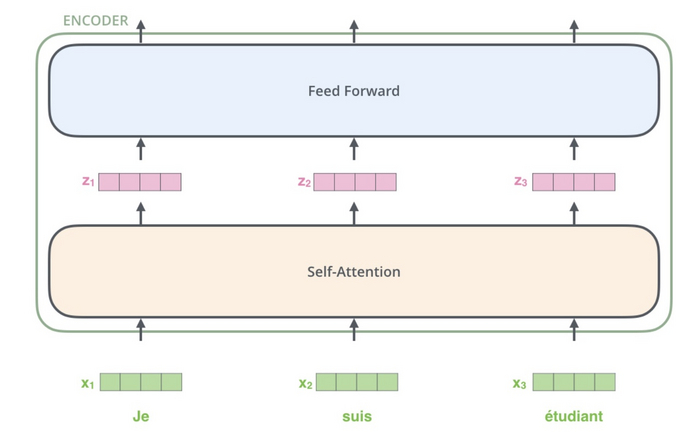

Архитектура трансформера состоит из енкодера и декодера.

Энкодер состоит из слоев, как и декодер.

Каждый из слоев состоит из блоков: self-attention и полносвязной нейронной сети (обычная нейронка, где одни слои связаны со всеми последующими слоями).

Входные данные проходят через механизм self-attention и в новом векторном представлении “скармливаются” обычной полноразмерной нейронной сети.

Self-attention — главный костяк работы трансформера. Давайте представим, что у нас есть предложение "Кот ловит мышь". Каждое слово в этом предложении (кот, ловит, мышь) представлено вектором. Self-Attention — это механизм, который позволяет модели фокусироваться на важных словах в предложении и определять, какие слова имеют большее значение для понимания смысла всего предложения.

Для каждого слова в предложении мы создаем три вектора: запрос (Query), ключ (Key) и значение (Value). Затем мы используем эти векторы, чтобы определить, насколько каждое слово важно для каждого другого слова в предложении. Естественно, что подобное перемножение не работает простым образом.

Главная цель self-attention затащить в нейронную сеть максимальное число векторных представлений, которые бы обрисовывали значимость отдельных слов в разных контекстах.

Когда мы говорим "Кот ловит мышь", модель может сосредоточиться на слове "Кот", чтобы понять, о ком идет речь. Для этого модель вычисляет, насколько слово "Кот" важно для каждого другого слова в предложении. Если важно, она больше обращает на него внимание.

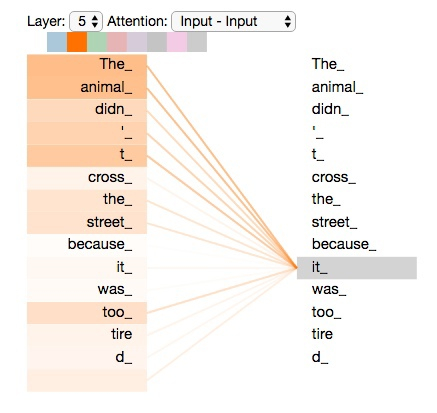

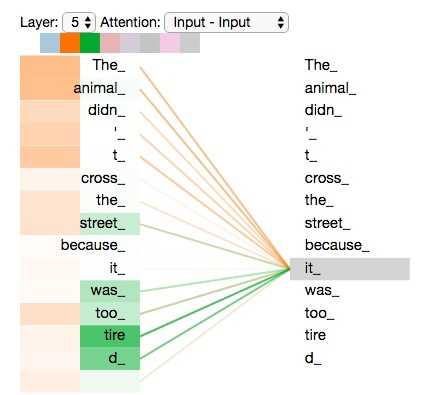

Слово It зависимо в большей степени от animal. Животных в английском языке называют местоимением “Оно”.

Таким образом, благодаря механизму Self-Attention, модель может динамически определять, какие слова в предложении наиболее значимы, учитывая их контекст и взаимосвязь друг с другом. В результате работы механизма мы получаем attention-score.

Если провести такую операцию своеобразного эмбендинга кода, а именно восемь раз и получить на выходе новые матрицы с весами мы получим целый набор весов для разных контекстов, а это еще больше информации! Чем больше информации – тем лучше.

ChatGPT обучается на больших наборах текстовых данных, где модель пытается минимизировать потери (например, перекрестную энтропию) между сгенерированным текстом и правильными ответами. В процессе обучения модель настраивает веса внутри блоков трансформера, чтобы улучшить качество генерации текста. И вот мы получаем мощнейшую нейронку с миллиардами параметров и вполне приемлемым текстом для пользователей.

Какие трансформеры сегодня есть помимо GPT?

1. BERT (Bidirectional Encoder Representations from Transformers): Разработанный в Google, BERT - это модель трансформера, обученная на огромном корпусе текстовых данных для выполнения различных задач NLP, таких, как классификация текста, извлечение информации и вопросно-ответные системы.

2. T5 (Text-to-Text Transfer Transformer): Разработанный Google, T5 – универсальная модель трансформера, которая может решать широкий спектр задач NLP, представленных в формате текст-к-тексту. Такой формат позволяет использовать единый обученный трансформер для различных задач, таких как перевод, классификация, генерация текста и многое другое.

3. XLNet. Этот подход, также разработанный Google, представляет собой расширение и улучшение модели трансформера BERT. XLNet использует перестановочный механизм предложений и предлагает улучшенное моделирование контекста и лучшее качество на различных задачах NLP.

4. RoBERTa (Robustly optimized BERT approach). Разработанный Facebook, RoBERTa – это улучшенная версия модели BERT, которая была обучена с использованием различных стратегий обучения, таких как динамическое маскирование и обучение на длинных последовательностях, что привело к улучшению качества на различных задачах NLP.

Трансформеры

IT-мир впервые узнал о трансформерах в 2017 году, когда команда исследователей из проекта Google Brain представила эту технологию. Это был тот самый момент, когда разработка ИИ вышла на новый уровень.

Почему?

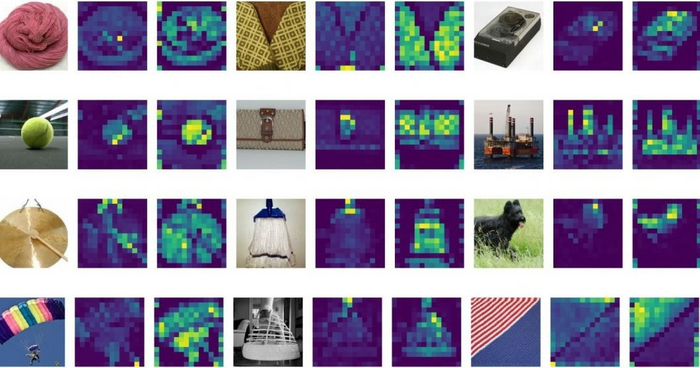

Трансформеры представляют собой архитектурный подход, который отличается от традиционных рекуррентных нейронных сетей (РНС) и сверточных нейронных сетей (CNN). Они используют механизм внимания для обработки входных данных без необходимости в управляемом порядке. Ведь трансформеры могут работать с данными параллельно, в отличие от старых моделей, где обработка шла последовательно.

Это делает их не только быстрее в обучении, но и позволяет им эффективно обрабатывать большие объемы данных.

Технически, трансформеры используют механизм внимания для того, чтобы "сосредоточиться" на разных частях текста одновременно, а также позиционные эмбеддинги для того, чтобы знать, где каждое слово расположено в предложении или тексте.

Помимо обработки текстовых данных, трансформеры, такие как ViT (Vision Transformer), применяются для обработки изображений на различных задачах computer vision.

Сегодня на основе архитектуры трансформер работают практически все большие языковые модели: GPT-4, YandexGPT, Llama, Claude, Gemini и другие.

Японская компания представила робота-трансформера ARCHAX стоимостью $3 млн

Японские разработчики из компании Tsubame Industries собрали робота ARCHAX, стоимость которого составляет 3 миллиона долларов.

Робот имеет кабину без окон, на внутренние экраны которой выводятся данные с девяти наружных видеокамер. В кабине управления есть люк, через который можно попасть внутрь.

Для обеспечения высокого уровня надежности роботов применяются международные стандарты оценки JIS и ISO.

По информации Involta.media, в процессе создания ARCHAX дизайнеры и конструкторы работали вместе, стремясь достичь высокого уровня дизайн-концепции в сочетании с высокой технологичностью.

Высота робота составляет 4,5 метра, а вес — 3,5 тонны.