Официальный roop для Stable Diffusion (плюс разблокированная версия)

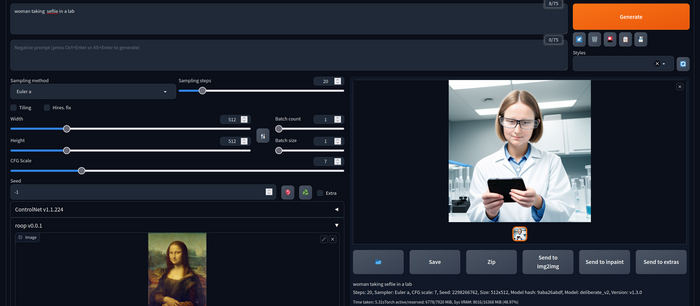

Разработчик roop решил сам сделать собственную версию расширения для automatic1111 и выпустил sd-webui-roop

Под капотом по сути, тот же самый roop, но заточенный конкретно под замену лиц на изображениях. Что он умеет:

При использовании во вкладке txt2img, заменяет лица на всех генерациях на лицо с фото, которое вы выберете.

При использовании во вкладке img2img позволяет менять лица на изображении, как сгенерированном в SD, так и загруженном (например - фото).

Также есть поддержка улучшения лица через Codeformer / gfpgan и возможность использования апскейлеров.

Для установки расширения понадобится установленная Visual Studio (для компиляции Insightface)

Инструкцию по установке без Visual Studio и скомпилированные файлы можно найти тут

Официальный Github

Разумеется, в оригинальной версии стоит проверка на NSFW контент. Если для вас это критично, то я подготовил для вас версию расширения с вырезанной цензурой:

sd-webui-roop без цензуры

Больше различных нейросетей, а также их портативные версии, можно найти в моем телеграм канале Neurogen

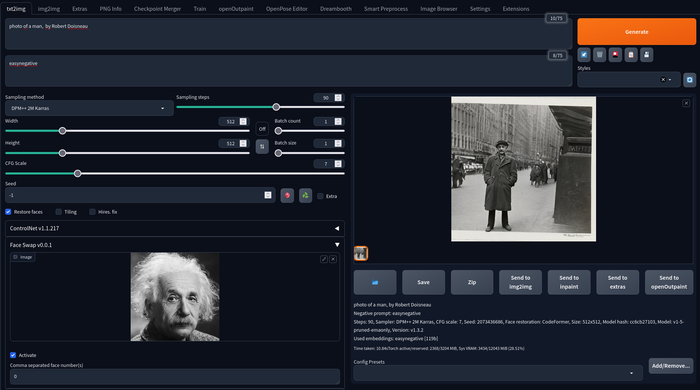

Sd-webui-faceswap - deepfake внутри Stable Diffusion

Данное расширение для automatic1111 вдохновлено приложением roop и использует такой же метод для замены лица, но но акцент сделан не на работу с видео, а с изображением.

Установить расширение можно через функционал Automatic1111 или просто скопировать файлы из github в папку extension внутри вашего automatic

После установки расширения необходимо закинуть файл inswapper_128.onnx в ее каталог.

Взять его можно тут.

Скачать же расширение можно здесь:

Github

Больше новостей о нейронных сетях, а также ссылки на интересные релизы можно найти в моём Telegram канале.

Deep Fake в 1 клик локально и в коллабе! Улучшаем результаты с помощью нейронки Vlad Diffusion! Расширенная видео инструкция

Всем привет, в этом видео рассказываю про то, как любой сможет делать дип фейки (замену лиц) на видео в один клик, все что вам понадобится это само видео и одна фотография. Так же мы поставим Vlad Diffusion, с помощью которого многократно улучшим качество созданных дипфейков.

🔽🔽🔽🔽

Подробная инструкция со всеми ссылками - https://github.com/Nerual-Dreming/Nerual_notes/blob/main/Dee...

🔼🔼🔼🔼

Курс по нейронной сети Vlad Diffusion, от устоновки до апскейла https://neurophotograph.ru/vladdiffusion

Эксклюзивы для подписчиков, записи стримов, секретные гайды, доступ в закрытый чат и многое другое только на бусти - https://boosty.to/neuro_art

Хотите быть в курсе всех нейро-новостей? Подписывайтесь на мои телеграм каналы по волшебной ссылке - https://t.me/addlist/LQ-fUTyhVjEzYjIy

Размышление о будущем кино, мультфильмов и игр

Вот почитал посты о том что одним кликом уже можно сделать качественный DeepFake и о новых возможностях ИИ Фотошопа и о технологиях создания картинок из текстового описания и вырисовывается интересная картина. Получается в недалеком будущем для создания кино, мультфильмов, а кино с мультфильмами это набор чередующихся картинок, будет достаточно книги, сценария, описания по которому ИИ будет создавать в любом указанном стиле кино или мультфильмы, в которых будут играть роли выбранные по желанию зрителя персонажи в том числе уже не живые Виктор Цой, Сергей Бодров, Мэрилин Монро например. То есть в будущем возможно останутся одни сценаристы и писатели, а все остальные люди из мира кино, мультфильмов могут остаться без работы. Да и писателей со сценаристами наверное сможет в будущем заменить ИИ типа Chat GPT.

Или игры, многие игры же похожи друг на друга, вид от первого лица, от третьего и тд. Скормил ИИ в будущем книгу с описанием вселенной, он создал мир, заполнил его растениями и живыми существами и ты по нему бродишь выполняешь задания по той же книге или прописанные сценаристом игры.

Мало кто мог поверить 10 лет назад что ИИ будет создавать сложнейшие реалистичные картинки, какими сейчас заполнен интернет. Так что думаю кино, мультфильмы и игры по книгам, сценариям, описаниям уже не за горами, раньше их делали люди, а в будущем их видимо будет делать ИИ.

Дипфейки в сети: как отличить правду от технологий и имеет ли это значение?

Привет, друзья! На просторах Интернета появляется все больше дипфейков, созданных с помощью нейросети Stable Diffusion.

Один из таких дипфейков - короткое видео, на котором парень азиатской внешности в плохо сделанном парике танцует хореографию на камеру в своем коридоре, но зрители на его странице в Instagram видят красивую девушку, которая идеально повторяет его движения.

Это вызывает интересный вопрос: сможем ли мы отличить реальных людей от виртуальных, если не знаем их лично? Ведь контент создается, чтобы радовать и развлекать, но должен ли он быть честным с нами?

Макс Тигер, профессор компьютерных наук в Университете Стэнфорда, говорит: "Интернет и искусственный интеллект открывают дверь в мир безграничных возможностей, но это также означает, что мы должны быть более бдительными и критическими в отношении того, что мы видим и читаем онлайн." Развитие технологий приносит новые возможности, но и новые риски.

Использование дипфейков и других способов манипуляции может привести к тому, что мы не сможем доверять тому, что мы видим в Интернете. Это подчеркивает необходимость более критического отношения к тому, что мы видим онлайн.

Юджин Гох, директор лаборатории по машинному обучению в Национальном университете Сингапура, говорит: "Искусственный интеллект никогда не будет иметь эмоций или интуиции, которые делают нас людьми."

Независимо от того, насколько хорошо нейросети могут создавать дипфейки и другие формы контента, они все еще не могут имитировать полного человеческого опыта. Это подчеркивает важность помнить, что за экраном всегда стоит реальный человек, который может быть обманут или ранен.

Что вы думаете об этой теме? Какие у вас мысли насчет возможностей и рисков, связанных с использованием дипфейков и других форм манипуляции в Интернете? Можете ли вы доверять тому, что вы видите онлайн?

Одинаково ли важно, чтобы контент и его создатель были честными с нами, или это зависит от целей, которые они преследуют?

Расскажите свое мнение в комментариях. Будьте бдительны и критически относитесь к информации в сети!

Видео взято из канала Арт-нейросети от Nerual Dreming, подпишитесь, там интересно.