Тест Тьюринга

В итоге я устроился на работу, связанную с нейросетями и искусственным интеллектом. Название должности - дата-аналитик, задача - скармливать нейросети большое количество данных и таким образом ее обучать. Дело не совсем привычное, но опыт подобных действий был: приходилось раньше создавать юзеров массово в системе (напрямую в БД!) или проводить аудиты прав доступа по списка из отдела кадров. Питон знал на приемлемом уровне, хотел отточить навык. В общем, я был уверен что справлюсь.

Работал первую неделю, пока вникал в корпоративные информационные системы, осваивал механизмы работы. Все новое, задачи непривычные, нагрузка была значительная. И вот ближе к концу недели, часам к четырем у меня "кончился бензин" и я сидел пил чай, ожидая пока работоспособность вернется.

И тут к нам зашел товарищ из корпуса "Бета" и позвал всех свободных помочь пройти тест Тьюринга.

Нас собралось человек десять, и мы отправились в корпус "Бета", на ходу обмениваясь незатейливыми шуточками про ответы на тест Тьюринг и отца его жены (тесть Тьюринга).

Кто не знает, тест не предполагает ответов и проходит в режиме простого диалога. Судья общается с двумя скрытыми собеседниками, в нашем случае - через текстовый чат. Один из собеседников - человек, второй - искусственный интеллект. Судья задает вопросы, выслушивает ответы и должен в итоге определить, кто является человеком, а кто - искусственным интеллектом. Этот тест очень хорошо описан в "Приключениях Электроника".

Так вот, нас завели в компьютерный класс, запустили программку с чатиком, рандомно разбили на тройки. За оставшихся три часа каждый должен был пройти тест несколько раз с разными ролями: то участник, то судья. Кто есть кто мы не знали; мы даже не знали действительно ли в нашем чатике присутствует ИИ, или мы трое человек общаемся друг с другом. Это было сделано для чистоты эксперимента.

Я достаточно быстро освоился и начал вести беседу в стиле "Откуда взялся - С того берега моря - На чем приехал? - Оседлал хромую блоху, сел и приехал..."

Результатов я не видел, но по разговору судьи понимал, что он определил меня как человека.

Но такой креативный подход отнимал много сил, а силы мои уже были подорваны: работал с утра, обед пропустил, чай тоже толком не попил. То есть под конец меня уже шатало.

И вот на последней тройке все пошло не так.

Я бросаю шутливые реплики и не вижу понимания со стороны судьи. Ссылаюсь на известные события, но судья их не знает. А мой оппонент несет какую-то чушь, но судья с ним соглашается. Я разозлился и решил во что бы то ни стало доказать, что человек - это я. Но чем больше я горячился, тем больше говорил невпопад. Голова совсем разболелась. А эти двое не спешат завершать тест и уже в открытую обсуждают, что еще ИИ (то есть я!) сможет выкинуть, начинают обсуждать на какой выборке меня обучали и подчеркивать якобы логические и даже орфографические ошибки! В какой-то момент они решили сравнивать факты, которыми оперирую я, и которые знают они. И если в самых очевидных фактах (например, кто сейчас президент) разницы не было, то в отдаленных, так сказать, фактах, мы не сошлись совсем. Например, они не знали моих предыдущих мест работы, или района, откуда я приехал три года назад. Или на технические вопросы я отвечал неправильно (каюсь, от усталости некоторые вещи перепутал). Но для них это стало железным доказательством того, что я не человек.

В общем, из-за стола я встал в подавленном настроении. Выходя из класса, расстроенно сказал коллеге: "Представляешь, они меня за робота посчитали". Он удивленно посмотрел на меня и вдруг ответил: "И правильно посчитали. Ты еще не готов проходить тест Тьюринг против человека". Я в шоке посмотрел на него. Неужели я... да нет, вон ребята из нашего кабинета, я же с ними работал. Я подошел к ним чтобы развеять нелепые сомнения, но... "А ты кто? Мы тебя в первый раз видим". Мимолетом я посмотрел в зеркало в коридоре и ужаснулся - таким нелепым, бешеным показалось мне собственное лицо, веко дергалось.

Я вдруг почувствовал себя как Тойво из романа "Жук в муравейнике". А вдруг я действительно не человек, и все мои воспоминания ложные? И про мою жизнь, и про работу, а в эту организацию я не устроился неделю назад, а был создан тут неделю назад.

Бред какой-то... я достал телефон чтобы позвонить жене... но телефон разрядился и выключился. Существовала ли она? Или это тоже ложное воспоминание, залитое в мой искусственный мозг для правдоподобности?

Я бросился к двери, взялся за металлическую ручку, и меня ударило статическим электричеством. Точно. Я - электрический робот с искусственным интеллектом.

Успокоился я, только когда фельдшер вколол мне что-то в вену. А эти шутники еще некоторое время звали меня "Робот".

Тест Тьюринга 1 порядка проходит бот, который может убедить в том, что он человек.

Тест Тьюринга 2 порядка проходит бот, который может убедить стороннего наблюдателя в том, что человек, с которым общается бот - на самом деле не человек.

Тест Тьюринга 3 порядка проходит бот, который может убедить собеседника в том, что собеседник - не человек.

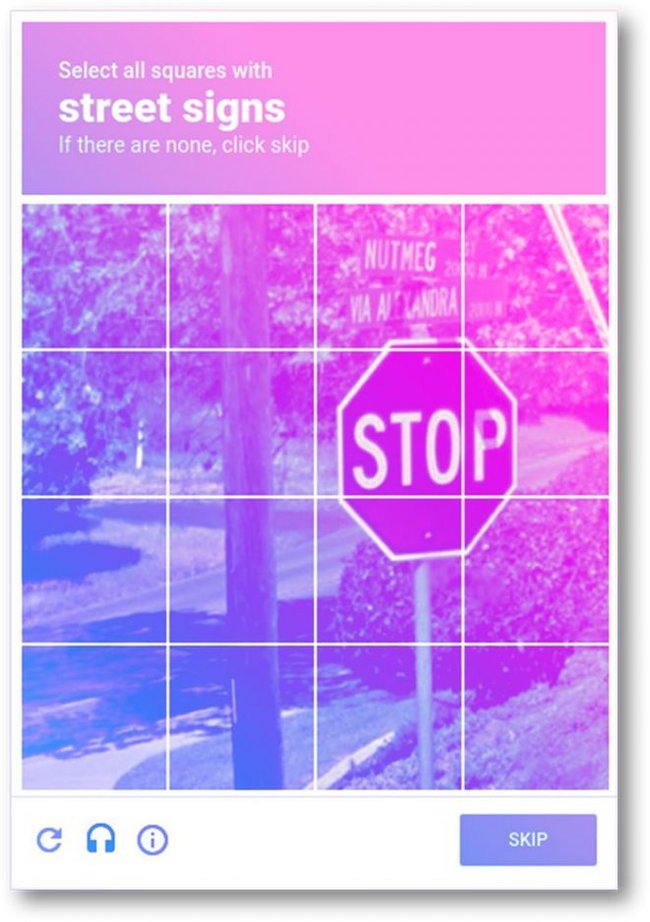

Разгадывая капчу, мы обучаем автономные машины будущего

Вы наверняка сталкивались с проверкой доступа к произвольному сервису через капчу – простой инструмент для отсеивания ботов от реальных пользователей. Собственно, аббревиатура CAPTCHA и дешифруется как «полностью автоматизированный публичный тест Тьюринга, позволяющий разделить компьютеры и людей». Но вот вам обратная сторона медали – Google и прочие компании используют капчу, чтобы обучать свои разноцелевые ИИ.

Как давно в качестве рисунка капча предлагала вам изображения котят или панд? Да почти никогда, потому что не было нужды в роботах для их обслуживания. Зато прямо сейчас доминируют изображения светофоров, дорожных знаков и автомобилей. Потому что, например, в Google сосредоточили усилия на обучении беспилотного автомобиля Waymo. И чтобы обеспечить большой выбор тестов и релевантность проверки, перепроверяют его работу при помощи вот таких задачек для реальных людей.

Вспомните, самые первые капчи были сплошь буквенными, точнее, символьными – Google построила на этом свою технологию Optical Character Recognition для распознавания текста в печатных изданиях. Затем был всплеск интереса к номерам домов, названиям улиц и ориентирам на местности. Это оттачивали навыки ИИ для сервиса Google Street View. Пользователи, сами того не ведая, помогали роботам обучаться, в прямом смысле подсказывая правильные ответы.

Это не хорошо, но и не плохо. Да, никто никого не ставил в известность, но эти операции приносят человечеству ощутимую пользу. Выбирая правильные ответы, мы помогаем беспилотным машинам будущего учиться безопасной езде, делаем наш собственный мир более удобным и комфортным.

Сознание

Решил попробовать побороть свою социопатию и выкладывать видео на ютуб. Если кому интересно послушать про сознание - заходите в гости)

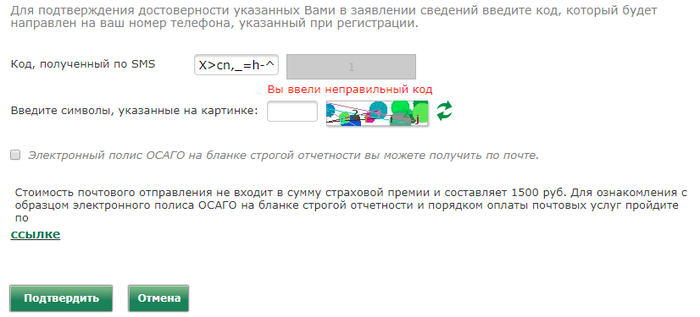

Супер капча

Страховщик прислал письмо о том, что я легко и непринужденно могу продлить ОСАГО. Ну Ок, тем более что срок подходит. Но квест с сохранением данных по полису я так и не смог пройти. Мало того что символы совсем не читаемые, а код код отправляемый по смс содержит буквы разных регистров и спецсимволы, так есть еще ограничение по времени, на все про все не более 2-х минут. Такое ощущение, что страховщик такой непроходимой защитой мне на что-то намекает...

Могут ли машины мыслить?

Могут ли машины мыслить?

Сегодня у меня и моего друга был спор, могут-ли машины думать?

Я покажу, что машины все-же могут думать

Почвой для наших раздумий будет Алан Тьюринг. В апреле 1943 года, он познакомился с Дональдом Миччем. Они днями сидели, играя в шахматы, говорили о создании машины, которая могла бы играть в те-же шахматы.

Сама идея была в том, что машина могла анализировать игру человека и понимать свои ошибки. В 1947 году, Тьюринг выступал в Лондоне, где произнёс такую речь "Говорят, что вычислительные машины могут только выполнять указанную им работу" Он рассказывал про возможность машины понимать свои ошибки и логику соседа. "Это было бы подобно ученику, который выучив тактику учителя, улучшил её. Когда такое случится, мы будем должны принят то, что машины все-же показывает интеллект. "

Его речь была фантастической на тот момент. И вызвала бурную реакцию у всего мира. Так, нейрохирург Джеффри Джефферсон, сказал" Только тогда, когда машина сможет написать сонет, или сделать концерт, с помощью пережитых мыслей, а не случайных цифр, мы сможем согласится, что он равняемый мозгу человека" . Алан ответил уже в Times:" Думаю, что сонет, написанный машиной, надо и проверять машиной".

В 1950 году в журнале Mind была опубликована статья Computing Machinery and Intelligence, написанная, Аланом. Сейчас это называют Тестом Тьюринга, которую он тогда называл Игрой в Имитацию. Вот, что было в ней написано:

ВОПРОС: Пожалуйста, напишите мне сонет про мост, который идёт через форт

ОТВЕТ: Здаюсь. Никогда не умел писать стихи.

ВОПРОС: Сколько будет 34 957 + 90 764?

ОТВЕТ: (после 30 секундой паузы). 105 621

ВОПРОС: Играете ли вы в шахматы?

ОТВЕТ: Да.

ВОПРОС: У меня есть король на e1. Больше фигур у меня нет. А у вас есть только король на е3 и тура на h8. Как вы походите?

ОТВЕТ: (после 15 секунд паузы). Тура на h1, мат.

Тут происходят две вещи: 1. Машина признается, что не умеет писать стихи, так, как и человек может и не уметь писать стихи.

2.В расчётах вышло 105 621, а правильно - 105 721. Эту ошибку машина не могла-бы сделать. Только умышленно, выдавая себя за человека.

Но создаём в голове другую картину:

Машина не имеет чувств, они не программированые. Природу чувств людей до сих пор и учёные не могут понять

Итоги:

Вряд-ли машины когда-нибудь начнут думать, как мы себе это представляем, ходить по улице, говоря с другим роботом о погоде.

Но, машина может учиться на своих провалах, понимать проблемы, распознавать мысли человека, предугадывать будущее.

Что выходит:

Машина умеет мыслить, но ничто и никогда не будет видеть мир, как человек.