Тендер-Checklist: Готовые стратегии для поставщика

5 постов

Если вы продаёте IT-услуги, оборудование или даже офисную мебель, то наверняка замечали: клиенты стали жёстче, бюджеты тщательнее прячут, а на холодные письма никто не отвечает. Реклама в директ дорожает, конкуренты демпингуют. Знакомая картина?

Я последние пару лет работаю с госзакупками и коммерческими тендерами — не как участник, а как наблюдатель за рынком. И вижу одну странность: многие продажники и маркетологи обходят тендеры стороной, думая, что там «всё схвачено» или слишком сложно. А зря.

Долго не мог понять, зачем отделу продаж мониторить закупки. Ну публикуют чиновники свои хотелки — и что? А потом вник в механику и увидел три ключевых плюса:

Заказчик уже всё сказал. В тендере не надо угадывать потребности клиента. Там чётко написано: нужно 50 лицензий, бюджет 2,3 млн, срок — сентябрь. Продажнику остаётся только упаковать предложение под готовые требования. Никаких «перезвоните через неделю» и «мы подумаем».

Деньги заложены в бюджет. В коммерческих продажах вечная проблема — клиент хочет, но денег нет. В тендерах (особенно госзакупках) средства уже лежат на счетах. Вопрос только в том, кто их заберёт — вы или конкурент.

Видно, кто и сколько покупает. Можно годами стучаться в компанию, а можно зайти на агрегатор и увидеть: «О, да они каждый квартал закупают одно и то же у одного поставщика. Пора выходить с альтернативой».

В итоге тендеры превращают продажи из гадания «кто бы мог купить» в прозрачную систему. Вы не тратите время на прогрев тех, у кого нет денег или потребности, а работаете с теми, кто уже объявил: «У нас есть задача и бюджет, ждём предложения». Осталось только правильно настроить мониторинг и не облажаться с документами.

Я проанализировал опыт разных компаний, которые через закупки увеличили продажи. Выделил три типа специалистов, для которых тендеры стали рабочим инструментом:

Продажники, которые устали обзванивать холодную базу. Раньше менеджер сидел на телефоне сутками — секретари, отказы, «пришлите КП на почту». Сейчас каждое утро открывает подборку свежих тендеров по своему профилю и заходит уже с конкретным предложением под опубликованное ТЗ. Конверсия выросла в разы — потому что он не пытается что‑то навязать, а помогает решить задачу, которая уже озвучена.

Маркетологи, которым надоело гадать. Коллега из одной софтверной конторы раньше рисовал стратегии на основе своих фантазий. Теперь он просто анализирует, что реально закупают: в марте вырос спрос на облачные решения, в апреле все бросились закупать защиту от утечек. Контент-план строится вокруг того, что реально покупают, а не что «было бы круто продать».

Руководители продаж, которые хотят прогнозов. Начальник отдела продаж смотрит не только на свои заявки, но и на конкурентов: кто сколько выиграл, по какой цене, какие требования были в тендерах, которые ушли другим. Это не шпионаж — это открытые данные. Просто надо уметь их собирать.

Продажники в этой схеме получают не абстрактный «список компаний по отрасли», а конкретную базу клиентов с уже сформулированными задачами и бюджетами. Маркетологи — живые данные о спросе: по тендерам видно, какие решения рынок действительно покупает, а какие остаются на уровне презентаций. Руководители продаж — прозрачную картину воронки и конкурентов: кто выигрывает, на каких условиях и где команда регулярно недобирает выручку, хотя спрос есть.

По сути, у бизнеса два пути: делать всё вручную или настроить процесс один раз и потом только разбирать входящие заявки.

Героический путь (для фанатов мазохизма):

Каждый день заходить на zakupki.gov.ru

Пробираться через интерфейс начала нулевых.

Искать тендеры по ИНН и ключевым словам вручную.

Фильтровать лоты по суммам и регионам в несколько заходов.

Сохранять результаты в Excel и вручную обновлять таблицы.

К вечеру хотеть не продавать, а просто закрыть ноутбук.

Нормальный путь (для тех, кто ценит время):

Один раз настроить мониторинг в агрегаторе тендеров.

Задать нужные ключевые слова, регионы и диапазоны сумм.

Каждое утро получать на почту подборку свежих лотов по своему профилю.

Смотреть историю закупок конкретных заказчиков и их поставщиков.

Анализировать, где и на каких условиях конкуренты выигрывают чаще всего.

Я, например, пользуюсь РосТендером или похожими сервисами: вся эта рутина там превращается в 10 минут настройки и ежедневную рассылку вместо многочасового ручного поиска.

Что с этим делать отделу продаж

Если вы руководите продажами, важно не просто «знать про тендеры», а встроить их в ежедневную работу команды. Это можно сделать по шагам.

Настройте уведомления под роли менеджеров. Тем, кто работает с бюджетными организациями, — ленты госзакупок, тем, кто в B2B, — закупки крупных корпораций и госкомпаний. Каждый менеджер получает только свою нишу, а не общую свалку из сотен лотов.

Заранее сделайте шаблоны заявок. Когда появляется интересный тендер, времени на долгие согласования уже нет. Полезно иметь набор типовых заготовок: под ИТ‑услуги, поставки, сервис, обучение. Менеджер подставляет детали заказа и успевает подать заявку без аврала.

Анализируйте не только победы, но и заявки, которые не сработали. Вместо сухого «нас не выбрали» полезно смотреть, кто выиграл и на каких условиях. Часто в открытых данных видно, что конкурент просто предложил другую конфигурацию, более длинную гарантию или уже имел успешный контракт с этим заказчиком. Это материал для доработки и продукта, и стратегии участия.

По сути, задача отдела продаж не в том, чтобы «иногда заходить на тендеры», а в том, чтобы превратить их в еще один стабильный канал выручки. Когда уведомления настроены, шаблоны готовы, а проигрыши разбираются так же тщательно, как лиды из рекламы, тендеры перестают быть разовой авантюрой и становятся нормальной частью воронки: предсказуемой, измеримой и управляемой.

Тендеры — это не волшебный принтер, печатающий деньги, а нормальный рынок со своими требованиями и штрафами, о которых лучше знать заранее:

Документы проверяют очень строго. Любая формальная ошибка — опечатка, просроченная выписка или неверная доверенность — может стоить участия в закупке, даже если ваше предложение объективно самое выгодное по цене и условиям.

Оплата растянута во времени. По госконтрактам действует предельный срок в районе 30 дней, но фактически деньги могут приходить позже, поэтому нужно заранее планировать кассовые разрывы.

Демпинг бьёт по марже и рискам. Снижение цены на 25–30% и больше включает антидемпинговые меры: повышенное обеспечение, дополнительные подтверждения добросовестности и риск не вытянуть контракт по себестоимости.

Обеспечение «замораживает» деньги. Победа в закупке на несколько миллионов означает, что часть суммы будет лежать в обеспечении исполнения контракта, пока вы не закроете все обязательства.

Реестр недобросовестных поставщиков — это надолго. Попасть туда можно из‑за сорванного контракта или уклонения от его подписания, а последствия — запрет на участие в закупках до двух лет и серьёзный удар по репутации.

Если смотреть на закупки трезво, тендеры — это не лёгкие деньги, а ещё один серьёзный канал продаж с понятной ценой входа. Они требуют дисциплины в документах, финансового запаса и готовности играть в долгую, но в обмен дают то, чего не хватает классическому маркетингу и холодным звонкам: прозрачный спрос с озвученными бюджетами и правилами игры.

Если вы всё ещё живёте на холодных звонках и дорогом таргете, не обязательно сразу бросаться в участие в закупках — начните с разведки.

Выберите 2–3 заказчика в своей нише: госорган, госкомпанию или крупный бизнес.

Через агрегатор посмотрите, что они закупали за последний год и на какие суммы.

Посмотрите, какие компании у них выигрывали и с какими ценами.

Настройте уведомления на новые закупки по вашим ключевым словам.

Через месяц у вас будет живая карта рынка: кто и что действительно покупает, по каким бюджетам и условиям. Дальше подключить тендеры к воронке продаж — вопрос техники, а первый шаг вы можете сделать хоть сегодня, просто настроив мониторинг и посмотрев, какие деньги уже лежат «на столе» в вашей нише, остается только грамотно их получить.

Для федеральных министерств март — это как пятница для офисного работника: старые бюджеты надо освоить, новые — распланировать, а лето уже близко, значит, пора готовить инфраструктуру. Если вы когда-нибудь думали, что тендеры Федеральных органов исполнительной власти — это закрытый клуб для «своих», посмотрите на ленты закупок Минцифры, ФНС или Минфина в эти недели. Там столько бытовухи и конкретных задач, что диву даешься.

Я покопался в мартовских закупках и нашёл три устойчивые темы, по которым ведомства стабильно платят деньги. Под каждую нишу можно найти место и небольшой компании, и команде фрилансеров, если знать, куда смотреть и какие грабли ждут на старте.

С 1 марта 2026 года вступают в силу новые правила по «доверенному ПО» и реестру российского софта. Для многих федеральных и региональных ведомств это уже не бюрократическая формальность, а повод срочно обновлять софт, докупать лицензии и переезжать на облака, которые соответствуют требованиям реестра отечественного ПО.

Что ищут:

Обновление систем документооборота.

Лицензии на софт (только из реестра отечественного ПО).

Услуги по информационной безопасности.

Облачные решения для госучреждений.

Пример из ленты: Один из подведомственных Минфину учреждений — ФКУ по эксплуатации административных зданий и дачного хозяйства — объявил тендер на обновление программного обеспечения Smeta.ru в рамках ИКТ. Сумма контракта — 672 тысячи рублей, работы нужно выполнить до конца 2026 года.

Кому заходить: IT-компаниям, которые уже имеют в портфеле решения из реестра отечественного ПО и не боятся жестких требований к документации.

В марте госорганы традиционно активнее заказывают исследования и аналитику. Им нужны не отчёты «для галочки», а конкретные цифры, обзоры рынков и прикладные методички, на которых потом строят новые программы и регуляторные решения.

Что ищут:

Анализ импортозамещения в конкретных отраслях.

Разработку методик для образовательных стандартов.

Мониторинг цен на сырьё и оборудование.

Организацию форумов и стратегических сессий.

Пример из ленты: Главный информационно‑аналитический центр МВД России ищет оценщиков для расчета рыночной стоимости продовольствия, которое ведомство собирается распродать по регионам Сибири и Алтая. Подрядчику нужно выехать на объекты, проверить активы и выдать обоснованную оценку, чтобы не продешевить и уложиться в сроки закупки.

Кому заходить: Небольшим аналитическим агентствам, маркетологам, вузам и даже толковым фрилансерам, умеющим работать с большими данными и госотчётностью. Главное — показать в заявке, что вы уже делали что-то похожее.

Ведомства — такие же офисы, как и у всех. Им нужно, чтобы зимой было тепло, летом — прохладно, в кулерах — вода, а на входе — охрана. Март — время, когда многие прошлогодние контракты заканчиваются и объявляются новые торговые процедуры.

Что ищут:

Услуги клининга для административных зданий.

Поставку питьевой воды и расходников.

Охрану объектов.

Организацию командировок и обучения сотрудников.

Пример из ленты: подведомственное МИД России предприятие, обслуживающее дипломатический корпус, ищет подрядчика для ухода за аквариумами и изотермическим резервуаром в комплексе отдыха «Завидово» под Тверью. В тендере разыгрывают около 890 тысяч рублей на годовое обслуживание с итогами в марте.

Кому заходить: Локальным сервисным компаниям. Участвовать в таких закупках проще, чем в IT-конкурсах: меньше бюрократии, требования понятнее. Но есть нюанс: заказчики очень не любят срывов графиков. Один прокол — и внесение в «чёрный список» недобросовестных поставщиков обеспечено.

Госзакупки размазаны по куче площадок. Официальный сайт zakupki.gov.ru — база, но интерфейс там, мягко говоря, для мазохистов. Торги проходят на восьми разных электронных площадках: Сбербанк-АСТ, РТС-тендер и других. Вручную всё это мониторить — можно с утра до вечера только этим и заниматься.

Я для себя решил вопрос просто: использую агрегаторы тендеров — например, РосТендер или аналогичные сервисы. Забиваешь ИНН интересующих ведомств, ставишь фильтры по сумме и категориям, и каждое утро получаешь подборку свежих лотов на почту. Это экономит часы времени.

Важный лайфхак: не пытайтесь участвовать во всём подряд. Выберите 2-3 заказчика, которые географически и тематически вам близки, и настройте мониторинг только по ним. Так вы будете видеть и крупные контракты, и мелкие заявки на обслуживание, которые часто проходят мимо радаров охотников за миллиардами.

Госзаказчики — не Сбер, штрафы у них помягче, но бюрократии не меньше. Вот что важно знать новичку:

Документы должны быть идеальны. Опечатка в названии фирмы или старая версия выписки из ЕГРЮЛ — и заявку отклонят. Автоматически. Даже если вы предложили лучшую цену.

Обеспечение контракта. Выиграли тендер на 2 млн? Будьте готовы заморозить 200-300 тысяч на счёте до окончания работ. Деньги не пропадают, но из оборота выпадают.

Сроки оплаты. Государство платит, но иногда не быстро. Бывает, что деньги приходят через месяц-два после подписания акта. Закладывайте это в финансовую модель.

Антидемпинговые меры. Если снизите цену больше чем на 25%, придётся доказывать, что вы не сбрендили и сможете выполнить работу за такие деньги. Например, прикладывать гарантийные письма от производителей или договоры субподряда.

Реестр недобросовестных поставщиков. Попасть туда легко — достаточно сорвать один контракт. Выбраться — практически невозможно. Работайте с тендерами внимательно.

Федеральные ведомства — огромный и предсказуемый рынок. Там нет «блата» в том смысле, который вкладывают в это слово обыватели. Там есть жёсткая процедура, куча бумажек и чёткие требования. Но если вы умеете делать свою работу качественно и готовы потратить время на оформление заявок, госзакупки могут стать вашим стабильным источником заказов.

Начните с малого: выберите одно ведомство в вашем регионе, настройте мониторинг и просто понаблюдайте месяц, что они покупают. Увидите — там много всего, что вам по силам.

Дроны рисуют шоу в небе, нейросети дорисовывают флаги, алгоритмы монтируют трансляции. Но я не про это. Я про спортсменов без флага, которых дома назвали предателями, про комментаторов, орущих «вау!» вместо анализа, и про новые виды спорта, которые превращают Олимпиаду в цирк. Статья для тех, кто тоже это заметил.

Я обычно копаюсь в ИИ: как нейросети оживили выставки, творчество, трансляции. На этой Олимпиаде ИИ был повсюду — дроны рисовали шоу в небе, проводили конкурс ИИ-арта, алгоритмы помогали режиссуре и графике трансляций. А отдельно ещё и OKKO выкатил рекламу, где нейросети дорисовали трибуны с российскими флагами — тоже такой виртуальный «камбэк» сборной.

Но сегодня я хочу поговорить не о технологиях, а о том, что происходило вокруг самой Олимпиады — со спортсменами, комментариями и новыми видами спорта. Всё, о чём ниже пойдёт речь, — моё сугубо личное мнение зрителя, который за последние годы посмотрел не один десяток Олимпиад и спортивных трансляций и сам успел поучаствовать в международных стартах, пусть и не как профессионал.

В последние годы государство делало всё возможное, чтобы наших спортсменов не отправили в полную изоляцию. На разных уровнях шли переговоры и попытки договориться, лишь бы дать им шанс выйти на старт. В итоге хотя бы часть сборной всё‑таки допустили до Олимпиады под нейтральными флагами. Ура? Но не тут-то было...

Особенно странно выглядело полное молчание официальных лиц. Не прозвучало ни чёткого напутствия, ни простой человеческой поддержки вроде: «Да, вы выступаете без флага и гимна, но все понимают, что вы россияне, и все ваши медали — в копилку России».

Зато «снизу» картина получилась противоположной: в комментариях и соцсетях тут же пошла волна эмоций в стиле «предатели», «лишить гражданства», «запретить въезд». Складывается ощущение, что часть людей вообще не видит разницы между чиновниками, принимающими решения, и спортсменами, которые просто пытаются сохранить профессию и реализовать себя в спорте

Если смотреть на результаты, оптимизма тоже немного. По итогам зимней Олимпиады у российских «нейтральных» спортсменов всего одна серебряная медаль — в новом для Игр ски-альпинизме, где Никита Филлипов стал вторым в спринте. Остальные или остались без наград, или где‑то в районе 5–15‑х мест, за которые мы теперь почему‑то учимся радоваться, как за большое достижение. хотя это просто статистика уровня «где‑то рядом были».

На мой взгляд, это прямой индикатор того, что длительная изоляция и отсутствие полноценной конкуренции на международных стартах ни к чему хорошему не ведут: мировой спорт уходит вперёд, а мы постепенно привыкаем считать «почти попали в десятку» нормальным результатом.

В итоге получается довольно грустный парадокс: и спортсменов за допуск под нейтральным флагом успели записать в «предатели», и система, которая столько лет боролась за их участие, по факту не смогла ни нормально их поддержать, ни создать им условия для конкурентного результата. На выходе — одинокая серебряная медаль, обида друг на друга внутри страны и всё более заметное ощущение, что большой спорт уезжает вперёд без нас.

Раньше в эфир выходили люди, которые действительно жили своим видом спорта: они знали правила, помнили историю и умели объяснить, что происходит на экране и почему это важно. Сейчас на OKKO ощущение, что задача комментатора другая — как можно громче крикнуть «вау!» в эмоциональный момент, а не разбираться в деталях. Эмоций много, анализа — минимум. Зрителю предлагают набор возгласов вместо нормального спортивного репортажа. Когда вместо разбора падения комментатор просто отмахивается: «Ну, бывает. Давайте лучше посмотрим красивый повтор!» — это уже не спорт, а озвучка картинки.

На таком фоне даже Дмитрий Губерниев со всеми своими выкриками и странными сравнениями вдруг начинает выглядеть почти образцом профессионализма. Просто потому, что за его шумом хотя бы видно попытку разобраться в происходящем, а не просто имитировать восторг.

Отдельная история — общий тон комментариев. Складывалось впечатление, что главная задача — как можно ярче порадоваться победам других сборных, в том числе тех, чьи спортсмены не стеснялись публично проходиться по россиянам. Почти не звучало даже нейтрального «молодцы, хороший результат, но, возможно, всё выглядело бы иначе, если бы здесь участвовали и российские команды». Вместо попытки посмотреть на соревнования через призму отсутствия сильной сборной — сплошной фан по отношению к соперникам и минимум собственного взгляда на то, как меняется расклад сил в спорте.

Ещё один момент — кого из «звёзд» пригласили во Францию работать на этих трансляциях. Среди знакомых лиц оказались люди, чьи спортивные карьеры когда‑то серьёзно пострадали из‑за допинговых историй. Формально это, конечно, не запрещено, но выглядит странно: рассказывать зрителям о «чистом спорте» и олимпийских ценностях через тех, кто сам был в центре подобных скандалов.

В таком формате у зрителя остаётся ощущение, что ему предлагают красивую картинку без содержательной начинки: много шума, эмоций и «вау-эффекта», но мало компетентности и ещё меньше самостоятельной позиции. Для сервиса, который заявляет о себе как о главной платформе Олимпиады в стране с сильными спортивными традициями, это, мягко говоря, очень скромный уровень.

Раньше программа Олимпиады строилась вокруг классических дисциплин: дистанции постепенно менялись, правила подтачивали под справедливость и зрелищность, но в целом это был именно спорт высших достижений. Сейчас всё чаще возникает ощущение, что в программу добавляют гибридные форматы прежде всего ради эффекта «вау», а не ради спортивного смысла.

Тот же ски-альпинизм — объективно тяжёлый вид, где спортсмены выкладываются на пределе. Но в телевизионной картинке он всё чаще подаётся как аттракцион: сначала драматичный подъём, потом зрелищный спуск — всё ради того, чтобы удержать зрителя у экрана. И вот тут возникает вопрос: мы смотрим спорт высших достижений или удачно смонтированный экшн?

Логика новых дисциплин всё больше напоминает принцип «не тянешь в классическом спорте — придумай фрик-шоу». Не добрался до уровня в лыжных гонках? Пожалуйста, вот тебе гибридный формат с горкой и эффектным финишем. Хочется ещё больше драйва — можно же легко перейти грань и добавить элементы шоу: толчки, столкновения и прочую «контактную экзотику» на трассе. С телевизионной точки зрения это, возможно, и сделает картинку эффектнее, но к тому Олимпийскому спорту, который многие из нас помнят и ценят, всё это будет иметь уже очень отдалённое отношение.

Есть и отдельная категория «релакс-видов», которые всё больше напоминают не Олимпиаду, а хорошо организованную развлекательную площадку. Спортсмены выходят на старт в максимально расслабленном виде, делают пару эффектных трюков на доске под музыку, улыбаются в камеру и так же легко уезжают обратно в зону отдыха. Картинка получается яркая и молодёжная, спонсоры довольны, но невольно возникает вопрос: это про спорт высших достижений или про красивый фон для брендов и трансляций?

Если всё это сложить вместе — отношение к «нейтральным» спортсменам, качество комментариев и появление всё более странных дисциплин, — складывается ощущение, что Олимпиада действительно меняется, и вряд ли в ту сторону, которую многие из нас хотели бы видеть. Всё больше шоу, всё меньше ощущения большого спорта, где важны не только картинка и спонсорские интеграции, но и честная конкуренция сильнейших.

Парадоксально, но на этом фоне именно технологии и тот же искусственный интеллект могут когда‑нибудь попробовать «спасти» зрелищность и интерес аудитории — хотя это уже тема для совсем другой статьи...

P.S. Для особо внимательных охотников на ИИ: да, я знаю, что сейчас половину длинных текстов в интернете автоматически записывают в «сгенерированные нейросетью». Поэтому специально для вас в конце прикрепил скрин детектора, который гордо пишет «100% человек». Можете не благодарить — считаем это небольшой поддержкой отечественного ручного копирайтинга в эпоху тотальной веры в алгоритмы.

В отличие от строго регулируемых государственных закупок, коммерческие тендеры Сбера — это главный канал входа для большинства поставщиков, так как они охватывают широкий и постоянно растущий спектр потребностей банка — не только IT и банки, а целый набор постоянных запросов: от доработки цифровых сервисов до поставки воды в офис. Изучение тендерной ленты в начале года дает четкое представление о текущих потребностях инфраструктуры Сбера и открывает возможности для заключения выгодных контрактов.

Для поставщика это не абстрактные «многомиллиардные конкурсы Сбера», а вполне конкретный пул лотов, из которых можно выбрать свою нишу — в IT, обучении, логистике или сервисе.

Тендерная активность Сбера фокусируется на ряде ключевых сегментов:

IT и цифровизация: Сбер сейчас смещает фокус от отдельных образовательных инициатив к широкой инфраструктуре — заметная часть коммерческих тендеров уходит в зону прикладного IT и телеком‑сервисов, без которых не живёт ежедневная работа банка. Роль «витрины» здесь во многом выполняет ООО «Сбербанк‑Сервис» — через него проходят закупки оборудования, ПО и услуг, обеспечивающих работу внутренних систем. Характерные действующие примеры на сегодня: предоставление доступа к сети Интернет для региональных подразделений, закупка гуманоидного робототехнического комплекса для научно‑технических, образовательных и исследовательских задач. Для подрядчиков это направление означает устойчивый спрос на телеком‑услуги, специализированное оборудование, лицензии и решения по информационной безопасности, которые встраиваются в цифровую экосистему Сбера, включая её образовательный контур.

Логистика и поставки: В логистических и снабженческих закупках Сбера хорошо видно, как банк и его дочерние структуры закрывают повседневные потребности офисов: от воды и кофе до мебели и наградной продукции. Заметная часть таких лотов проходит через АО «Сбербанк Лизинг», которое регулярно закупает всё необходимое для своих региональных филиалов. Сейчас в ленте закупок это хорошо видно на примерах: поставка питьевой воды и санитарная обработка кулеров для офиса в Ростове‑на‑Дону, а также брендированная наградная продукция и сувенирная атрибутика для региональных подразделений. Для подрядчиков это ниша снабжения офисов, продуктов, напитков, мебели и мерча, где важно уметь работать по графику и закрывать заявки сразу в нескольких регионах.

Сервис и аутсорс: В сервисных закупках Сбера хорошо видно, как банк и его экосистема выносят на подряд всё, что поддерживает работу офисов, клиентов и внутренних команд, но не относится к банковскому «ядру». Здесь и эксплуатация зданий, и контакт‑центры, и поддержка IT‑инфраструктуры. У Сбера есть и крупные сервисные контракты на модернизацию инженерных систем и аутсорсинг контакт‑центров, которые, как правило, рассчитаны на подрядчиков с серьезным штатом и выручкой. Такие закупки можно найти в общем разделе тендеров. Во всех подобных лотах заказчик детально расписывает ТЗ и критерии отбора, а от подрядчиков ожидает подтвержденный опыт, наличие ресурсов в нужных регионах и готовность работать по строгим срокам — это уже история не про микробизнес, а про компании, готовые тянуть большие объёмы сервиса.

Разброс по бюджетам в Сбере также широк: от небольших контрактов на поставку мерча и продуктов в офис до многомиллионных IT-проектов по доработке сервисов и разработке образовательных программ. Небольшие заказы обеспечивают стабильный оборот, а крупные IT-проекты и аутсорс открывают двери для долгосрочного сотрудничества.

Но есть и обратная сторона медали. Работа со Сбером требует железных нервов и идеальной дисциплины. Контракты банка славятся жесткими штрафными санкциями — просрочка даже на день по поставке воды в офис может вылиться в неустойку, которая съест всю прибыль от контракта. А процедура аккредитации новых поставщиков часто напоминает квест: помимо стандартных документов, Сбер может запросить развернутое подтверждение опыта, финансовые гарантии и кучу согласований, которая растягивается на недели.

Информация о тендерах Сбера, как и у всех корпоративных гигантов, поступает из нескольких каналов, требующих комплексного подхода к мониторингу:

Официальные каналы Сбера: Официальные порталы Сбера и его дочерних структур (Сбербанк Лизинг, СберУниверситет) служат первичным и наиболее авторитетным источником, где размещаются основные объявления и базовые требования к подрядчикам.

Площадки электронных торгов (ЭТП): Это аккредитованные коммерческие площадки, на которых фактически проводятся все торги Сбербанка. Здесь фиксируются сроки, стартовые цены и ключевые критерии оценки предложений, поэтому мониторинг этих ЭТП обязателен.

Отраслевые агрегаторы: Эти сервисы объединяют информацию с корпоративных ресурсов и ЭТП в одном окне. Они позволяют быстро отфильтровать активные закупки Сбера, его «дочек» и профильные лоты (например, IT или логистика), что значительно упрощает работу поставщика.

Для эффективного поиска поставщику Сбера нет необходимости в ручном обходе всех сайтов: гораздо продуктивнее настроить единый мониторинг по всем площадкам, чтобы не тратить время на рутину.

На основе анализа общего контекста коммерческих закупок Сбера можно прийти к следующим практическим заключениям:

Требование глубокой экспертизы: IT-проекты и поддержка и развитие систем в Сбере всегда сопряжены с высокими стандартами и требуют подтвержденного опыта. Успешное участие в них часто становится залогом долгосрочного системного сотрудничества.

Географическая сегментация: Потребности в сервисе (клининг, логистика) жестко привязаны к регионам присутствия, что открывает хорошие ниши для локальных подрядчиков, способных обеспечить стабильность поставок и услуг.

Готовность к бюрократии: Сбер требователен к документам. Аккредитация может занять недели, а штрафы за срыв сроков — одни из самых высоких на рынке. Ошибки в заявках отсеивают до половины претендентов.

Для поставщика стратегия проста: Необходимо настроить фильтры по Сбербанку и связанным структурам (Сбербанк Лизинг, Сберуниверситет) в агрегаторах тендеров, а также разделить направления (IT и обучение, логистика и снабжение, сервис и аутсорс) и следить за ними отдельными подборками.

Такой подход превращает Сбер из «неподъёмного гиганта» в понятного заказчика, у которого есть и крупные цифровые проекты, и вполне приземленные, но регулярные закупки для бизнеса.

Статья подготовлена по данным сервиса РосТендер

xAI, компания Илона Маска, разместила вакансию для элитных писателей, предлагая до $125 в час за доработку навыков чатбота Grok. Требования столь строгие, что подойдут лишь лауреаты престижных премий и авторы бестселлеров. Ирония в том, что эти мастера станут основой для ИИ, который якобы «уничтожает» профессию копирайтеров.

Вакансия «Writing Specialist» охватывает 12+ жанров — от фантастики до поэзии и научных текстов.

Для категории Creative Fiction Writing (художественная проза) требуется минимум два из пяти критериев:

Подтверждённые контракты на издание романов у крупных издательств (например, Big Five: Penguin Random House, HarperCollins и т.д.).

Продажи романов свыше 50 000 экземпляров (без учёта бесплатных промо).

10+ коротких рассказов в престижных изданиях (например, The New Yorker, Clarkesworld).

Награждение крупными литературными премиями (финалист Hugo, Nebula или эквивалент).

Признание со стороны литературной критики: звёздные рецензии в Kirkus, Publishers Weekly и упоминания в Library Journal или New York Times Book Review.

Для категории Screenwriting (сценаристика) требования еще строже — соискатель должен соответствовать минимум двум из четырех критериев с подтвержденными доказательствами (IMDB-кредиты, контракты, сайты наград):

Подтверждённые сценарные работы (writing credits) на не менее двух полнометражных фильмах, выпущенных крупными студиями или платформами (Warner Bros., Netflix, Disney, A24, Amazon MGM Studios и эквиваленты).

Сценарные работы на не менее десяти эпизодах сериалов или шоу, произведённых крупными студиями (HBO, Netflix, Disney+, Amazon Prime Video и т.д.).

Номинации или награды на крупных премиях (Academy Awards/Oscars, Emmy Awards, WGA Awards или эквиваленты).

Продажи сценариев крупным студиям или продюсерам с подтверждёнными гонорарами (WGA-минимум или выше)

Journalism (Журналистика): минимум 2 из 4 (или эквивалент 5+ лет в топ-изданиях):

5+ лет в NYT, BBC, WSJ, The Guardian.

10+ расследований/фич с национальными наградами (Pulitzer, Peabody).

Документальные произведения, изданные одним из крупнейших западных издательств (Big Five) и разошедшиеся тиражом более 50 000 экземпляров.

Регулярные колонки в топ-изданиях с аудиторией >1 млн.

Аналогичные жёсткие требования предъявляются и в остальных категориях: Poetry, Medical Writing, Copywriting, Business Writing, Legal Writing, Humor/Satire, Children's Lit, Songwriting и другие — все с акцентом на награды, публикации и продажи элитного уровня.

Эти барьеры обеспечат Grok текстами высшего класса — с идеальными тире (—) и ёлочками («такими»).

Результат? Борцы с ИИ, обвинявшие нейросети в «убийстве грамотности», теперь наблюдают, как их аргументы нейтрализуют сами литераторы.

Вакансия появилась на фоне проблем Grok: расследование ЕС по deepfakes (1,8 млн сексуализированных изображений за 9 дней), блокировки в Малайзии и Индонезии, иск в Калифорнии. xAI ограничил генерацию изображений, но усилил найм специалистов.

В сентябре xAI уволила около 500 аннотаторов, а теперь планирует вырастить штат “туторов” в десять раз. Недавний раунд инвестиций на 20 млрд долларов поднял оценку компании выше 230 млрд. Параллельно xAI нанимает специалистов по хинди и бенгали с почасовой ставкой 35–65 долларов и геймдизайнеров со ставкой около 100 долларов в час.

Gizmodo подметил абсурд: компания вербует «лучших писателей, чтобы обучить их замену».

xAI превращает критику в преимущество, накачивая Grok экспертизой элиты. Для копирайтеров это сигнал: ИИ не просто генерирует, а перенимает высший стиль. Анти-ИИ-кампания теряет почву — особенно в вопросах пунктуации и формы.

Если вы соответствуете хоть одному пункту вакансии — бегом откликаться: за $125 в час можно сказочно разбогатеть, научив ИИ красть ваш стиль. Борцы с ИИ, не просите — завидуйте молча.

P.S. Детектор ИИ сказал, что текст на 80% человеческий. Остальные 20% он, по привычке, записал на счёт «нейрослопа». Пусть живёт в этой уверенности, пока Grok качают Хьюго и Небулы.

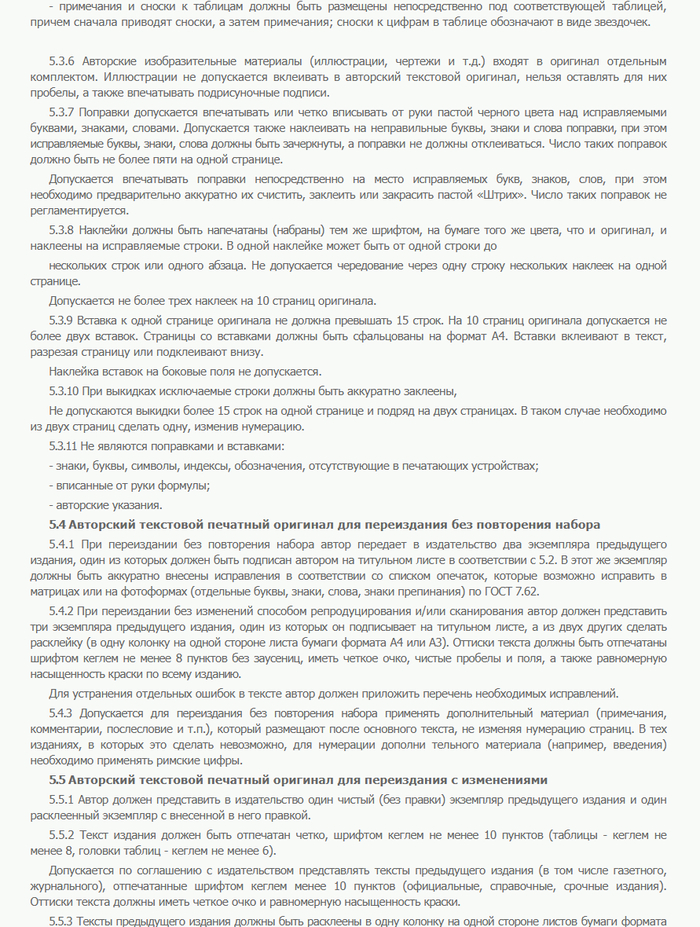

В рамках нашей серии «Матчасть для борцов с нейрослопом», где мы уже разобрали тире и жирный шрифт, переходим к третьему, самому визуальному маркеру, который почему-то вызывает наибольшее подозрение у «экспертов» — ровным абзацам (выравниванию по ширине (Justify)).

После «множества жирного» и «слишком правильных» тире, новый фронт атаки на «нейрослоп» открывается с совершенно абсурдного требования: текст должен быть неаккуратным.

Типичный приговор звучит так: «Все строки идут ровно, как по линейке. Справа нет естественного рваного края. Это слишком профессионально, для живого автора, который просто пишет "от души". Это ИИ, который стремится к типографическому идеалу!»

В этом и заключается парадокс: выравнивание текста по ширине — это фундаментальный стандарт книгоиздания и полиграфии, который ценится за свою визуальную плотность и эстетику. Это способ создания «блока» — единого, аккуратного элемента, облегчающего чтение длинных, сложных материалов.

Если следовать логике «охотников на ботов», нужно признать, что вся мировая издательская культура — от первых печатных книг до современных научных журналов — всегда была одержима «признаками ИИ». Журналисты, редакторы и верстальщики, которые десятилетиями использовали эту функцию, теперь задним числом превращаются в операторов нейросетей.

Ровные абзацы: 100+ лет классики типографики. Дореволюционная книга (justify без компьютера), советское издание (полиграфия ГОСТ), современный бестселлер (цифровой стандарт). ИИ тут ни при чём — это норма, а не улика.

Как и в случае с другими «маркерами», нейросети не изобрели выравнивание, а усвоили его как признак качества. Они обучались на огромных массивах:

Книги и учебники: где Justify — безоговорочная норма.

Официальная документация: где блочная структура текста — обязательное требование к оформлению.

В отличие от человека, который может забыть, спешить или просто не знать о функции Ctrl+J (или Cmd+J), ИИ — это идеал исполнительности. Он последовательно применяет все правила, которые почерпнул из самых качественных образцов. И теперь эта «сверхъестественная» аккуратность — результат одного клика в редакторе — стала основанием для обвинения в фальсификации.

Justify по учебникам и ГОСТам: норма с советских времён. Учебное пособие (ровные абзацы как стандарт), официальный ГОСТ (требование к верстке), современная документация (обязательное выравнивание). Боты не изобрели — копируют классику.

Мы снова наблюдаем создание абсурдного «нейро-фильтра»:

Текст имеет плотную верстку, структурирован, не имеет ошибок? — Сам себя заклеймил ИИ.

Текст «рваный», не вычитан, с хаотичными пробелами и ошибками? — Вот он, настоящий, «живой» автор!

Вместо того, чтобы радоваться, что автор позаботился о комфорте вашего глаза и применил базовые инструменты верстки, он вынужден защищать право своего текста на «неряшливость».

Единственный способ пройти этот «тест на человека» — сознательно писать небрежно. И это самый громкий приговор качественному контенту.

P.S. И традиционный двойной пруф на финише. Этот текст — 100% уникальный и 100% human made. Скрины прилагаются.

P.P.S. Продолжение следует... (На очереди «кавычки-ёлочки» и «правильные многоточия» — главные враги «нейрослопа»!)

В рамках нашей серии «Матчасть для борцов с нейрослопом», которую мы начали с разбора тире: «Длинное тире — признак нейросети? Разбираемся в новой и очень глупой «религии», переходим ко второму, самому заметному и, по мнению «экспертов», безоговорочному маркеру ИИ — жирному шрифту.

Следом за «длинным тире» в арсенале «охотников за нейрослопом» появляется самый заметный и, по их мнению, безоговорочный маркер нейросети — жирный шрифт.

Обычный сценарий: под любым хорошо оформленным материалом тут же возникает комментарий: «О, тут много жирного! Идеальная структура, списки. Нас обманули! Это злой ИИ, который старается выделить самые важные мысли, чтобы продать свою статью!»

Вся ирония ситуации в том, что жирный шрифт — это не «клеймо искусственного интеллекта», а базовый, незаменимый инструмент редактуры. Его использование демонстрирует заботу о читателе, является основой структурирования текста и визуальной иерархии! Уберите его — и перед вами останется сплошная, нечитаемая «простыня», которую не осилит даже самый мотивированный читатель.

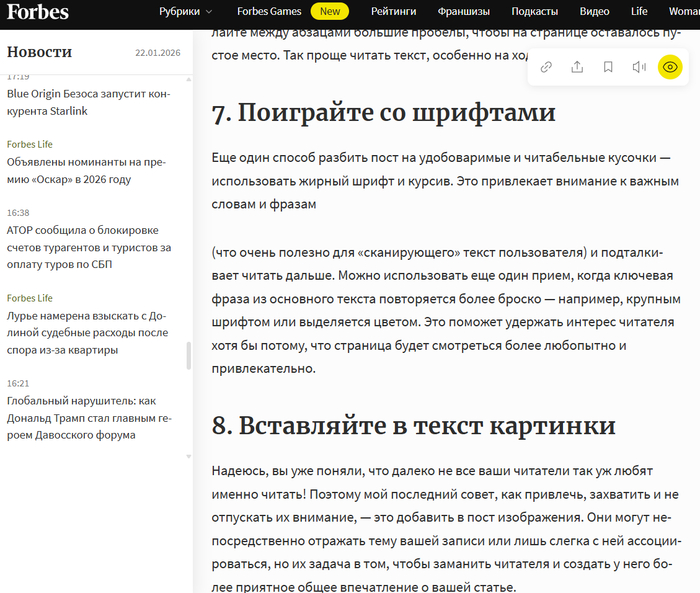

Forbes как учебник: Правила профессиональной редактуры, где жирный шрифт — это не «признак ИИ», а четкий стандарт выделения ключевых тезисов.

Специально для «экспертов по нейрослопу»! Откройте любую серьезную статью на Forbes, vc.ru или даже научную монографию. Что вы увидите? Ключевые тезисы, определения и важные части текста, выделенные... именно, жирным. Если следовать этой логике, то все академики, журналисты и редакторы, работавшие над этими текстами, — это массовая нейросеть.

Визуальная иерархия в действии. Профессиональная редактура всегда использует выделение для того, чтобы сделать текст понятным и легко воспринимаемым.

Как и в ситуации с тире, стереотип возник из-за особенностей обучения моделей. Нейросети действительно активно используют выделение, потому что они тренировались на массивах эталонного, высококачественного контента.

В идеальной модели текста, которую усвоил ИИ:

Каждая важная мысль должна быть визуально акцентирована.

Структура текста должна быть максимально четкой для быстрого считывания информации.

Ключевые выводы или анонсы всегда выделяются для немедленного привлечения внимания.

В отличие от человека, который может торопиться, забыть или полениться отформатировать текст, ИИ неуклонно следует идеалу читабельности. И эта сверхъестественная структурность и аккуратность теперь воспринимается как подозрительный фактор.

Мы приходим к абсурдному шаблону, который стал новым догматом в сети:

Текст идеально структурирован, грамотен, ключевые мысли выделены? — Автоматически ИИ.

Текст сбивчив, нелогичен, изобилует ошибками и не имеет выделений? — Настоящий, неидеальный, живой Человек!

Этот нелепый фильтр автоматически делает подозрительным любой качественный материал. Если вы приложили усилия, чтобы сделать свой текст понятным и легко воспринимаемым, готовьтесь услышать вердикт: «Ваша нейросеть пишет лучше, чем вы!»

Заключение ведущего детектора: 100% человек. Увы, для «борцов с нейрослопом» этот аргумент не работает.

Для демонстрации абсурда. Мы прогнали и этот текст через один из самых популярных платных «детекторов ИИ». Результат — 100% человек. Все эти «преступные» тире, жирный шрифт и идеальная структура написаны живым автором. Однако, как показывает практика, заключение «100% Человек» от ведущего сервиса не стоит ничего против коллективного «внутреннего убеждения»: «Всё равно видим признаки ИИ». Это и есть подлинная классика жанра «борьбы с нейрослопом».

Продолжение следует... (Впереди «кавычки-ёлочки» и «ровные абзацы»!)

В продолжение темы детекторов ИИ, которую мы начали вот тут: «Детекторы ИИ: борьба с ветряными мельницами или новый бизнес?», поговорим о новом, самом смешном маркере, по которому «эксперты» опознают злого бота.

Уже знакомая всем картина: под постом появляется «аналитик» и с важным видом заявляет: «Ага, длинное тире! Вижу абзацы, вижу жирный шрифт — 100% ChatGPT писал!» Добавим сюда «ёлочки», и вот уже вердикт вынесен. Преступник, по их логике, пойман по... пунктуации.

Вся ирония в том, что тире — это не «изобретение ИИ», а просто нормальная русская пунктуация. Использовать его — признак грамотности, а не ботописания.

Аналитикам с «чуйкой» посвящается! На фото — классика русской литературы. Сколько процентов ИИ показывает ваш детектор на этом «длинном тире»? Если Достоевский не бот, то ваши правила пунктуации сломались.

Стереотип, конечно, не на пустом месте. Нейросети действительно обожают тире. Но почему? Всё просто: они обучаются на тоннах текстов — книгах, статьях, документах, где это самое тире стоит по правилам языка: для пауз, вставок, разделения сложных мыслей.

Человек, который спешит, скорее напечатает короткий дефис. ИИ же всегда стремится к «правильному стилю», к идеалу. Итог: текст становится слишком грамотным, и это кажется подозрительным. Хотя многие классики русской литературы тире любили даже больше, чем современные нейросети.

На фото — «Свирель» Михаила Чехова, младшего брата того самого Антона Павловича. И снова длинные тире! Это уже не Достоевский, но для «экспертов» это 100% ИИ. Ваш вердикт?

Почитайте комментарии в сети, и вы увидите перлы:

«Тире, структура, жирный — 100% ИИ!»

«А ваш детектор на одну ЛЛМ обучен!»

«Может хватит давать ответы от нейросети? И да. Кавычки и тире палят её только так».

И всё. Диалог окончен. Дальше — либо тишина, либо жалобное: «Domain shift? А что это такое?», которое демонстрирует полное незнание матчасти.

Для этих «охотников за нейрослопом» любые правила и аргументы — высшая математика. Главное — «чуйка работает», а все остальные факты под неё подгоняются.

В итоге, сами борцы с «мусором» создают самый нелепый шаблон:

Текст ровный, структурированный, грамотный? ИИ!

Текст кривой, с ошибками, опечатками и короткими дефисами? А вот это, граждане, — живой, настоящий, неидеальный Человек!

Любой действительно качественный материал теперь автоматически под подозрением.

Ну а для самых стойких и упертых, кто уверен, что тире – это заговор машин, у меня плохие новости: это только начало. В следующих выпусках я продолжу мое, точнее ваше, «расширение кругозора» и разберу следующие явные признаки «нейрослопа», которые на самом деле являются нормами оформления: «кавычки-ёлочки», «ровные абзацы» и, конечно, демонический «жирный шрифт». Готовьтесь, матчасть не пощадит никого.

Кстати, этот текст тоже проверили платным «детектором», и он радостно показал: 100% человек. Все тире — с моей клавиатуры, никакой нейросети.

Аргумент, который не работает. 100% Человек от ведущего детектора — ничто против коллективного «мы тут видим признаки ИИ».

Однако, наученный горьким опытом (когда мой скриншот детектора проигнорировали, а «признаки ИИ» всё равно увидели), я решил сделать упреждающий ход. Ведь если меня отправят в бан, я не смогу довести до конца эти банальные истины о «ёлочках» и «жирном шрифте»! Поэтому тег «Творчество нейросетей» я ставлю сам,

Ну а если в комментах увидите классическое: «ИИшница!» — просто посмейтесь. Классика жанра.