Альтернативный способ

xхx: Наш бородатый админ мог бы освоить узелковое письмо, чтобы запоминать айпишники, пароли и логины в бороде. Стоять потом с умным видом, поглаживать бороду, и наизусть всё диктовать.

yyy: А вдруг выпадет волосок?

ххх: Путь делает бэкапы на другой волосатой части тела.

yyy: Перед сном? А мама ему говорит: вынь руки из-под одеяла! А он так возмущённо: ну ма-ам, я работаю!

«Звони адвокату». Владелец хостинга случайно уничтожил свою компанию строкой кода.

Руководитель небольшой хостинговой компании на 1534 клиента Марко Марсала уничтожил данные всех своих клиентов, а вместе с ними и свой бизнес, сделав ошибку в коде, пишет Independent.

Марко опубликовал пост на форуме Server Vault, где рассказал о своей проблеме. Он запустил на всех своих серверах код «rm -rf {foo}/{bar}», не задав переменные «foo» и «bar». Как объясняет издание, команда «rm» используется для удаления данных, «r» удаляет всё внутри выбранной директории, а «f» заставляет систему игнорировать предупреждения, которые обычно пользователь видит при удалении файлов.

В итоге запущенный Марсалой код удалил всё на его компьютере, включая вебсайты клиентов. По его словам, не сохранились даже бэкапы. Пользователи форума не смогли сообщить ему ничего хорошего: судя по всему, восстановить данные и компанию Марко уже не удастся.

«Если у тебя действительно нет никаких бекапов, то, к сожалению, ты только что уничтожил всю свою компанию».

«Мне неприятно говорить тебе об этом, но твоя компания действительно мертва. У тебя ещё есть призрачный шанс спасти положение, если ты выключишь всё прямо сейчас и отдашь диски нормальной компании по восстановлению данных. Это будет очень дорого, маловероятно, что это тебя спасёт, а ещё это займёт много времени».

«Ты выходишь из бизнеса. Тебе нужен не технический совет, а звонок адвокату».

Как отмечает газета, Марсала был не первым, кто столкнулся с такой проблемой: два года назад на форуме уже появлялся пост об удалении всех данных скриптом с «rm -rf», в том случае его автор случайно не поставил пробел перед слэшем в команде.

14 апреля Microsoft запустила сервис CaptionBot, который делает подписи к фотографиям, загруженным пользователями. Подписи получаются далёкими от реальности, чем смешат пользователей сети. До этого компания претерпела неудачу с чат-ботом Тай, который буквально за сутки превратился в расиста и женоненавистника.

Источник: http://medialeaks.ru/1504yut_marco

Полный бекап

- В чёрной дыре материя сжимается и сжимается. Это такой офигительный архиватор материи. Вот так сжимается, сжимается, а потом как вывалиться всё наружу.

- Точно, чёрные дыры - это бекапы нашей вселенной. И когда наступит полный п%здец, придёт мега админ и накатит последнюю сохранённую версию. Главное, чтобы не с динозаврами.

Презервативы, ремни безопасности и ..... Бэкап.

Все люди знают что стоит пользоваться презервативами, ну и ремнями безопасности. Не все это делают, до первого "прижатия". Такая же история у меня с бэкапами.

Работаю в небольшой фирме, 3 компьютера (2 ноута Win7 и стационарник Win10).

Перед новым годом, тетя, в обязанности которой входило отправить один очень важный документ, взяла ноутбук домой, и конечно же ее малолетнее чадо пролило на него некую жидкость. Так вот, посидев вечерок 31 числа разбирая ноут, который по моему мнению полили раствором неплохой такой кислотности, я понял что: бэкапы - вещь полезная.

Исходя из скромного бюджета, серверную часть сего процесса, было решено возложить на Cubieboard A20.

Так вот, помогите юзверю, состряпать схему ПК-\Lan(wi-fi)\кубик на убунту.

Мануалов интернетах, найти не удалось, так что рад буду всему, но чем более понятный материал я получу, тем больше будет моя радость, и тем меньше я буду ненавидеть ту самую тетю.

Уважаемые айтишники, посоветуйте аналоги Acronis True Image.

Обязательно чтобы был лайф сд, так как цель, это создание и копирование образов. Acronis В принципе устраивает, но в последнее время пару раз подвёл.

Сможете найти на картинке цифру среди букв?

Справились? Тогда попробуйте пройти нашу новую игру на внимательность. Приз — награда в профиль на Пикабу: https://pikabu.ru/link/-oD8sjtmAi

Мини сервер для бекапов часть 2 (настройка)

Продолжение. Начало в http://pikabu.ru/story/mini_server_dlya_bekapov_chast_1_podgotovitelnaya_3854168

Итак, сервер стоит, сетевой ресурс подключен, все пользователи созданы, права настроены. Но сам по себе он ничего еще не бекапит.

Теперь стоит немного рассказать о логике работы механизма резервного копирования. Изначально все файлы, лежащие на сетевом ресурсе сравниваются с "зеркалом" лежащим на локальном диске сервера с помощью утилиты rsync. Если есть отличие в размере файла или во времени последнего изменения, то копируется более новая версия. Далее во всей красе выступает файловая система ext4 или XFS с ее механизмом жестких ссылок. Об этом чуть позже.

Чтобы обеспечить работу rsync по расписанию, создадим небольшой скрипт.

sudo nano /home/backuper/sync.sh

Данная команда покажет вам окно текстового редактора. Содержимое необходимо сделать таким:

#!/bin/bash

rsync --archive --delete --progress /mnt/nw /backup/now

cp -rval /backup/now /backup/$(date +%Y-%m-%d)/

rm -rdf /backup/$(date --date='30 days ago' +'%Y-%m-%d')

Вот такой вот простенький скрипт. Что же он делает? В первую очередь он синхронизирует сетевую папку /mnt/nw с локальной /backup/now. При этом, сохраняет все атрибуты файлов, в первую очередь, дату изменения. Если файл на сетевом ресурсе был удален, то он удаляется и в локальной папке.

Затем содержимое папки /backup/now копируется жесткими ссылками в папку /backup/"текущая дата" При этом, количество свободного места на диске практически не уменьшается, именно за счет использования жестких ссылок. Файлы, удаленные сегодня, в предыдущих копиях остаются, пока не будет удалена последняя ссылка на них. Файлы, измененные сегодня удаляются в текущей копии и копируются заново, таким образом, предыдущие версии файлов остаются в сохранности все время жизни архивных копий.

Последняя строка удаляет папку с названием, содержащим текущую дату - 30 дней. То есть, мы имеем 30 ежедневных копий, к каждой из которых можно откатиться. При этом, места занимается сравнительно мало, так как все эти папки содержат лишь массив жестких ссылок на файлы. Файл в архивной копии удаляется только тогда, когда удаляется последняя ссылка на него. Ессно, что архивации и сжатия никакого не используется, что в случае ЧП дает нам очень оперативный доступ ко всем данным.

Осталось дело за малым, настроить работу этого скрипта по расписанию. Для этого, в линуксе есть очень хороший инструмент cron.

Вызовем консоль пользователя backuper

sudo -u backuper -sH

И начнем настраивать наш cron

crontab -e

При первом запуске, система спросит, какой редактор использовать. Лично я предпочитаю nano.

В конфигурационном файле пропишем следущее:

SHELL=/bin/bash

MAILTO=backuper

HOME=/home/backuper

0 23 * * * /home/backuper/sync.sh

Последнюю строку в конфигурации необходимо оставить пустой.

Вот и все. Ежедневно в 23:00 будет запускаться наш скрипт, сравнивать сетевой ресурс с локальной папкой, копировать при необходимости измененные и добавленные файлы и удалять архивные копии старше 30 дней. При этом, никаких сетевых ресурсов на нашем сервере извне не видно, никакие трояны и шаловливые руки не имеют доступа к архивным данным. А восстановление производится на сервере, путем копирования необходимых данных из нужной локальной папки в подключенную сетевую шару.

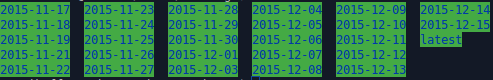

Вот пример того, что хранится в моей папке с бекапами. Одна копия весит примерно 100 ГБ, все вместе занимает чуть более 120. И это без какого-либо сжатия.