Ученые впервые «честно» считали мысли из мозга и озвучили их

Калифорнийские исследователи создали нейрочип и алгоритм, позволяющие напрямую считывать мысли из центра речи человека и озвучивать их, используя виртуальный аналог голосовых связок. Эта система вернет дар речи многим немым инвалидам, пишут ученые в журнале Nature.

"Пока что мы еще далеки от совершенства – наша система вырабатывает почти естественные медленные звуки, такие как "ш" или "з", и хорошо справляется с ритмом и интонацией речи, правильно отражая пол и личные особенности человека, но некоторые резкие звуки пока не очень четкие. С другой стороны, уже сейчас она позволяет общаться в режиме реального времени", — заявил Джош Чартье (Josh Chartier) из университета Калифорнии в Сан-Франциско (США).

В последние 10 лет нейрофизиологам удалось совершить настоящий прорыв в области создания нейроинтерфейсов – набора микрочипов, особых электродов и компьютерных программ, позволяющих подключать к мозгу человека и животных кибер-конечности, искусственные глаза и даже те органы чувств, аналогов которых нет в природе – тепловизоры и рентгеновизоры.

К примеру, в марте 2013 года бразильские и американские ученые смогли объединить мозг двух крыс, живущих в тысячах километров друг от друга, в своеобразную «локальную сеть», или, как назвали эту конструкцию сами ученые, «органический компьютер», и научить их обмениваться информацией.

Позже они создали аналогичный «коллективный разум», объединив мозг трех обезьян, а два года назад другие исследователи смогли заменить поврежденную часть гиппокампа, центра памяти в мозге мышей, и избавить их от «синдрома сурка», неспособности запоминать новую информацию.

Подобные успехи, как отмечает Чартье, заставили нейрофизиологов задуматься над тем, можно ли напрямую считать мысли из центров речи мозга и озвучить их, используя подобные нейроинтерфейсы или электроэнцефалографы. Решение этой задачи оказалось намного более сложной проблемой, чем подключение новых рук и ног к телу парализованного пациента.

Чартье и его коллеги смогли решить ее благодаря тому, что они подошли к этой проблеме с совершенно другой стороны. Они не пытались расшифровать сигналы мозга и напрямую «считать» слова и буквы, а предположили, что наши центры речи кодируют не конкретные звуки, а наборы инструкций для мускулов рта, гортани языка и голосовых связок.

Руководствуясь этой идеей, ученые обратились за помощью к пяти эпилептикам, готовившимся пройти операцию по блокировке очагов эпилептической активности в хирургическом центре университета. Для их поиска врачи имплантировали в мозг этих пациентов набор электродов, которым Чартье и его коллеги воспользовались для того, чтобы следить за активностью центров речи.

Во время этих опытов ученые просили добровольцев зачитывать определенные слова и предложения и записывали сигналы, поступавшие из их нервных клеток. После этого ученые сопоставили подобные наборы электрических импульсов с аудиозаписями речей этих пациентов и создали алгоритм, «расшифровывающий» команды мозга в понятный для компьютера язык.

Используя эти данные и систему искусственного интеллекта, нейрофизиологи из Калифорнии создали еще одну программу, которая представляла собой виртуальную копию голосовых связок, способных обрабатывать эти сигналы и преобразовать их в речь.

Как показали опыты на другой группе добровольцев, прослушивавших подобные записи, эта синтетическая речь была понятной для них примерно в половине случаев, если эпилептики использовали простые наборы слов. При повышении его сложности качество распознавания речи падало до 20%.

Повышение плотности электродов, как надеются Чартье и его коллеги, позволят считывать команды мозга более качественно, что позволит инвалидам заново обрести дар речи в самое ближайшее время.

https://www.n20x.ru/news/science/uchenye-vpervye-chestno-sch...

Возможно ли читать мысли другого человека?

Уникальное событие произошло в семье Хоганов — в их семье родились близняшки- краниопаги, т.е. сиамские близнецы, соединенные в районе головы. Но их особенность среди других криопагов — это единое соединение мозга. Соединение позволяет девочкам общаться между собой, внутри головы, не используя слов. Подобные явления способны помочь ученым разобраться в строение человеческого мозга.

Будущее наступило: немного о чтении мыслей

Несколько невероятной кажется способность заглянуть к кому-нибудь в мысли – любимому человеку, члену семьи, другу. Или, представьте, например, что вы можете нарисовать замечательную картину, не взяв даже и кисти в руку. Не говоря уже о компьютере, который помог бы полностью парализованному человеку общаться с окружающим миром. Ну или так:

Но сейчас чтение мыслей становится возможным. Более того, использование алгоритмов для декодирования мысленных образов не ново. Например, вот работа 2011 года ученых из университета Калифорнии, Беркли, США. В исследовании авторы при помощи функциональной МРТ регистрировали приток крови к определенным областям мозга, который возникал при просмотре различных видео. После этого исследователи показывали испытуемому новый видеоклип. Программа, написанная учеными, вычисляла, какие из множества видеоклипов (ранее не показанных) могли бы вызвать подобный сигнал. Видео, наиболее подходящие по результатам, усреднялись, тем самым создавалась реконструкция. Вот видео с изначально показанным клипом и созданной реконструкцией.

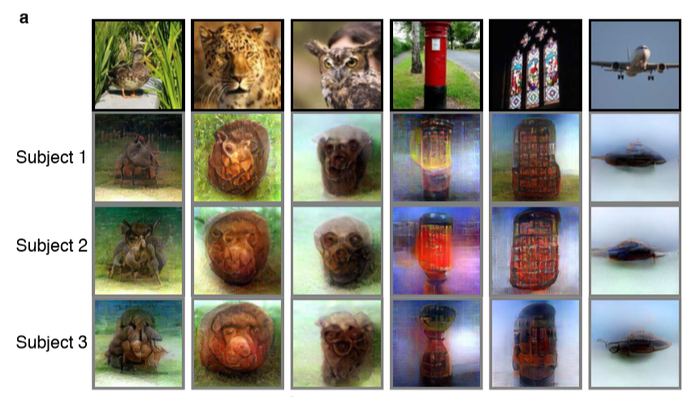

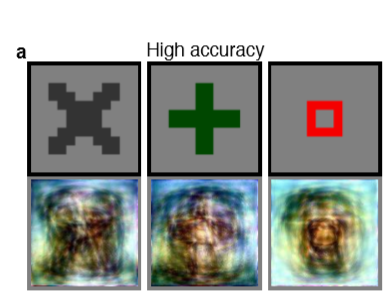

А здесь работа 2017 года ученых из лаборатории Вычислительной нейронауки, Киото, Япония. Трое испытуемых просматривали более 1000 картинок, каждую по несколько раз.

В процессе у них измеряли приток крови функциональной МРТ. А вот изображение они восстанавливали не усреднением нескольких других, а при помощи нейронной сети. Тут можно поподробнее почитать о методе, который они взяли за основу. Я ограничусь картинкой с результатом:

(Рисунок из Guohua Shen et al., 2017)

А еще исследователи попросили испытуемых представить себе какой-нибудь образ и символ. Сложные картины, вроде пейзажей, восстанавливались плохо, но вот некоторые знаки отлично воспроизводились:

(Рисунок снова из Guohua Shen et al., 2017)

Вы только вдумайтесь, это ведь действительно чтение мыслей!

Ставлю тег Мое, потому что это часть моего обзора. Всем добра :3

Слежка

Яндекс, ВК и Телеграм читают мои мысли? Как это происходит?

Ребята, в последнее время не единожды сталкивалась с таким явлением, что лента Яндекс.Дзена и новостная лента в ВК, новости в пабликах Телеграма буквально… читают мысли!

Нет, я в курсе существования современных поисковых алгоритмов, которые анализируют исходящую инфу из поисковиков, возможно, даже личных чатов (да, такое тоже возможно?).

Но когда ты не успеваешь подумать о чем-либо, а ответ на твои мысли моментально вылазит в ТОП новостной ленты, становится совсем страшно. И как-то защищенность Телеги от посягновений спецслужб не кажется уже такой стопроцентной.

Мне озвучили вероятность существования нейросетей, вследствие которых поисковые машины могут не только анализировать входящую инфу, но и «обдумывать ее», экстраполировать на смежные темы. Но не 100%-м же попаданием, причем почти каждый раз, когда ты только ПОДУМАЕШЬ, даже не голосом обсудишь мысль, как тебе подтягивают ответочку!!

Ну да, есть алгоритм оценки контент в ВК, но и он формирует лишь примерную подборку интересных пользователю новостей в ленте, но не идеально же отвечает на его запросы, верно?

Есть еще такая теория, вернее, даже не теория, а доказанное явление, что мышление человека избирательно, и он видит в окружающем инфопространстве ровно то, что хочет видеть и осознавать его мозг, психика. Но даже в этом случае избирательностью восприятия не пояснить феномен, когда тебе подсовывают под нос ответы, которые ты не выбираешь из массива данных. А просто открываешь поисковик — и вот тебе ответ, в первой строчке «чартов». Как так-то? Чего я недопонимаю? Поясните мне, может, пойму.

Явление такого рода заметила не только я, так что… Вот и родился пост.

P.S. Стебаться и троллить заговором НЛО и происками масонов можно. Тапками кидать тоже можно. Все можно. за моей спиной можете меня даже побить. Из стеба порой рождаются гениальные идеи и выводы.

Интерфейс «мозг-мозг»: мы научились передавать мысли без помощи слов или нет

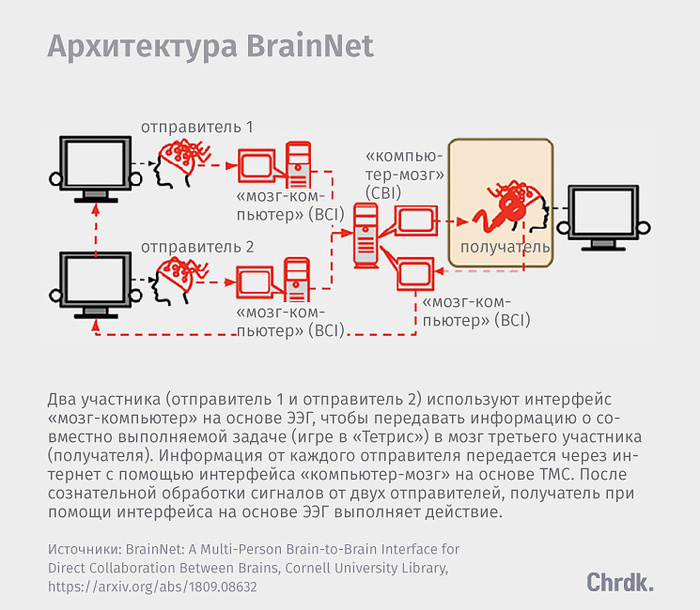

В конце сентября на сайте препринтов научных статей arXiv появилась статья ученых из университетов Вашингтона и Карнеги-Меллон, которые создали «первый мультиперсональный неинвазивный интерфейс „мозг-мозг“ для совместного решения проблем» — они объединили мозги трех людей в сеть, и те смогли силой мысли сыграть в «Тетрис». «Чердак» рассказывает, в чем заключается техническое достижение исследователей и разбирается, можно ли считать, что мы научились передавать друг другу мысли напрямую.

Нынешние интерфейсы «мозг-мозг» — союз технологий нейровизуализации и нейростимуляции. Суть идеи — в том, чтобы передавать информацию от мозга одного человека к мозгу другого напрямую, минуя речь.

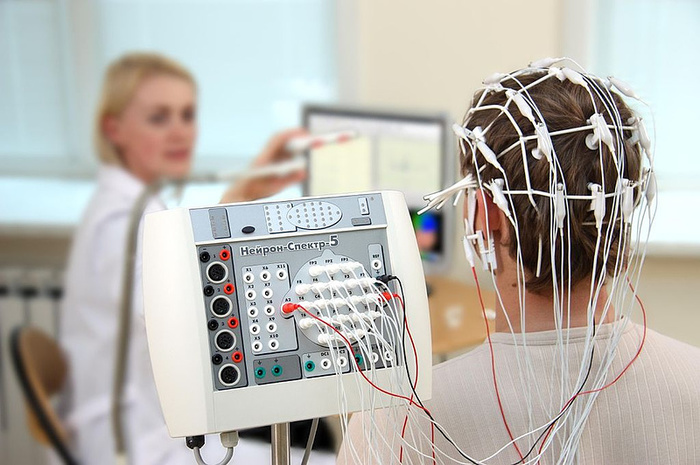

Для этого ученые используют две давно и хорошо изученные технологии: электроэнцефалографию (ЭЭГ), с помощью которой с поверхности головы записывается электрическая активность мозга, и транскраниальная магнитная стимуляция (ТМС), при которой кору головного мозга неинвазивно стимулируют короткими магнитными импульсами.

Инструментально схема такая: ЭЭГ измеряет электрическую активность мозга через электроды, закрепленные на голове. Сегодня ученым уже известны некоторые паттерны активности мозга и то, какие именно переживания с ними коррелируют. К примеру, наблюдение за вспышками света с частотой 15 герц заставляет затылочную кору мозга наблюдателя испускать сильный электрический сигнал на той же частоте. Если переключить внимание на световые вспышки на частоте 17 герц, изменится и частота сигналов, которые фиксируются с помощью ЭЭГ.

В свою очередь, транскраниальная магнитная стимуляция возбуждает электрическую активность в специфических областях мозга. Например, магнитный импульс, посланный в затылочную кору, вызывает у человека фосфен (зрительное ощущение, возникающее без воздействия света на глаз) в виде вспышки света. Используя оба этих инструмента, можно посылать и получать сигналы из мозга и в мозг.

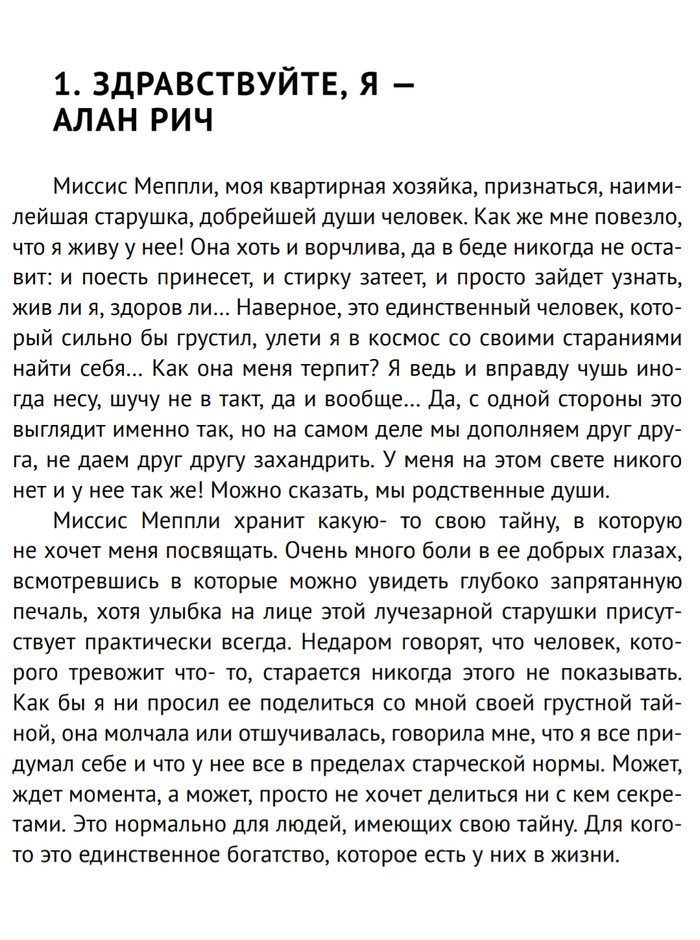

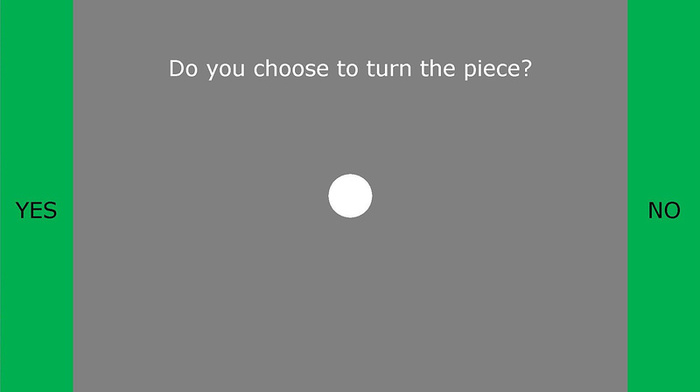

Сама схема подобной передачи сигнала тоже применялась не впервые — 5 лет назад те Раджеш Рао и Андреа Стокко сыграли по сети при помощи интерфейса «мозг-мозг». В этот раз ученые впервые провели эксперимент с тремя участниками-людьми, таким образом реализовав обещанный ими интерфейс BrainNet. В этом эксперименте было два «отправителя» и один «получатель». Каждый сидел в отдельной комнате и не общался с другими. Перед каждым находился монитор с игрой вроде «Тетриса»: с верхней части экрана падал блок, который должен был попасть в соответствующий паз в нижней части экрана. Блоки были двух видов: те, которые нужно повернуть на 180 градусов, чтобы они встали в паз, и те которые поворачивать не надо.

Два отправителя с закрепленными на их головах электродами для ЭЭГ смотрели на экран игры в «Тетрис». Им нужно было решить, нужно ли повернуть фигуру или нет, и передать эту информацию третьему члену группы, который. Контролировать сигнал можно было, взглянув на один из светидиодов, установленных по сторонам от экрана: один мигал с частотой 15 герц, второй — с частотой 17 герц. Взгляд на 15-герцовую лампочку (который считывался на ЭЭГ) означал «надо повернуть», взгляд на другую — обратное.

Получатель, к которому прикреплена и ЭЭГ и ТМС имел другое задание: Он видел только верхнюю часть экрана с падающими блоками, но не знал, надо ли их вращать, чтобы они правильно вставали в паз на дне игрового экрана. Но с помощью ТМС он получал сигнал от каждого отправителя. Преобразованный на стороне получателя сигнал «вращай» состоял из единичного фосфена.

Так выглядел интерфейс, при помощи которого отправитель слал партнеру по игре сигнал

Получив данные от обоих отправителей, получатель выполнял действие. Но главное в том, что игра позволяет еще один раунд взаимодействия: отправители видят падающий блок, поэтому могут определить, сделал ли получатель правильное действие и передать ему следующую команду к действию в следующий раунд коммуникации. В некоторых испытаниях исследователи намеренно меняли информацию от одного из отправителей, чтобы посмотреть, сможет ли получатель определить, стоит ли ее игнорировать. Так в эксперименте появляется элемент ошибки, часто присутствующий в реальных социальных ситуациях.

У экспериментаторов было пять таких групп, которые справились с заданием с довольно высокой точностью 81,25%. Авторы эксперимента считают, что у технологии большие перспективы. «Основанный на облачной технологии интерфейс „мозг-мозг“ может передавать информацию от любого набора устройств в интерфейс „мозг-мозг“ и делать возможным глобальное взаимодействие между мозгами через Интернет».