Большой брат следит

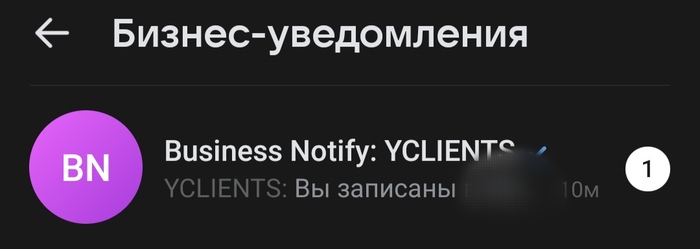

Записывался на стрижку. Через сайт парикмахерской. Из данных оставил только имя и номер телефона.

И вот в ВК пришло уведомление о записи. Как? Через что ВК про это узнал? Интеграция данных по номеру телефона?

Не особо приятно, что без моего ведома третья сторона будет знать, где, когда я буду, и чем при этом заниматься. Хорошо еще, что заранее не оплатил, а то кто его знает, что там еще фиксируется.

Примечание: на сайте парикмахерской я не зарегистрирован, вход ни под каким соусом не делал.

Дядя Яша следит за тобой

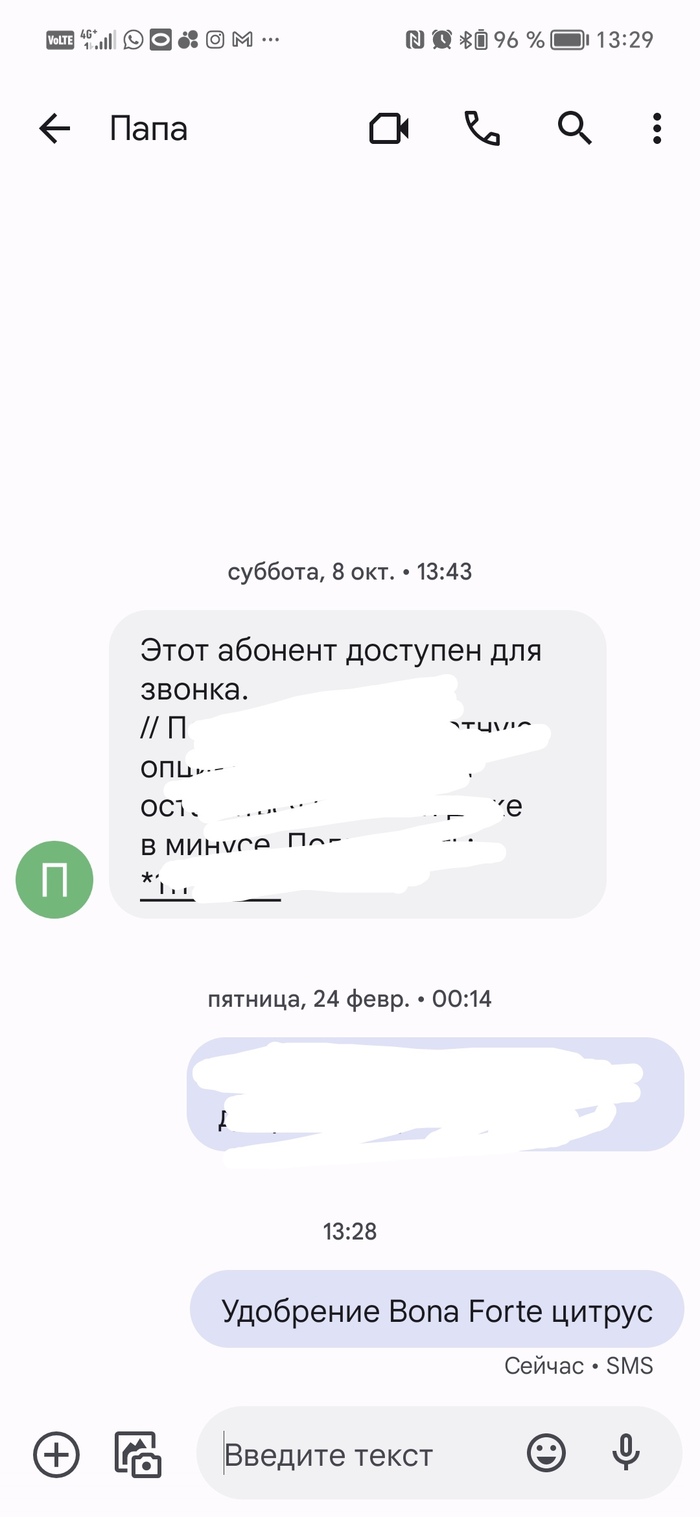

Сегодня отправил отцу в смс название необходимого удобрения, и через минуту получил его в контекстной рекламе

Название ни с компьютера, ни с телефона не гуглилось, вслух не произносилось, фигурировало исключительно в тексте сообщения.

@yandex.ru, каким образом ваше приложение могло получить информацию для контекстной рекламы из моей личной переписки?

Большой брат в курсе твоих проблем

Нахожусь в отпуске. Заглючил телефон и вырубился, думал всё, хана. Но его разглючило, смотрю с него Пикабу и вижу такую рекламу:

Так в Большого заботливого брата верить начнёшь.

Ответ на пост «В Кургане мужчина схватил за шею школьницу, проезжавшую мимо на самокате. Она упала и сломала себе позвоночник»4

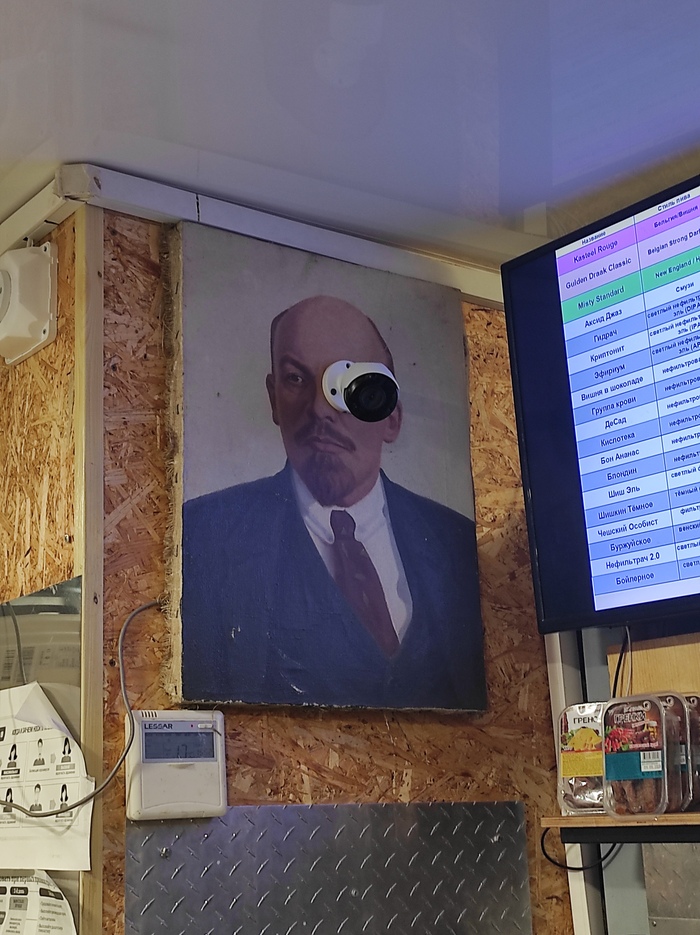

Я вот что в современном мире не понимаю. Я как-то для разнообразия прошёл пешком и внимательно осматривался вокруг, так вот весь путь от дома до работы у меня прослеживается всегда по нескольким камерам. По моему в современном мире найти человека это не такая большая сложность.

У меня как то рядом с гаражом металл лежал, и в одно воскресенье пропал и у соседа тоже. Час времени, я прошёлся по маршруту заметил камеры, вышел на тех, кто ими владеет, нашёл и отсмотрел, нашёл видео, где хорошо виден номер и время, по базам телеграмма нашёл владельца авто и его телефон, позвонил и предложил отдать деньги или пойти в полоцию, приехал и вернул все в двойном размере. Думаю у полиции возможностей получить видео ещё больше.

Замена электросчетчика

Задумал тут сменить древний механический счетчик на нормальный двутарифный. Тем более, что реклама из каждой щели идет, типа поменяйте.

Купил счетчик. Пошел оформлять замену в ЕИРЦ. Там взяли заявку, отправили к "инженеру". Созвонился с этим человеком, тот сходу сказал, что свои счетчики нельзя, и пох что поверенные со всеми документами, ставим только вот такие модели - список смотри на сайте. Цена от 16 тысяч за замену. Да ну нафиг... Полез выяснять, что же там за вундервафлю впаривают. Как оказалось, там впаривают те самые "умные" счетчики, что и на дачах. Дачники с ними говна наелись по самое не хочу: счетчик палит не только расход, но и квоту - включил чайник или плиту, и он тебя на полчаса вырубает полностью, типа превышение квоты. Данные засасывает из интернета, внутри стоит симка. Не заплатил точно в срок - опять выключает.

Заявку отменил и задумался. Нахрен самому себе создавать проблемы, да еще за 16 тысяч? Пусть стоит механический, как раз до реновации микрорайона срок поверки)

А горе-инноватору, который это придумал, в аду выделят самый горячий котёл. Со счетчиком.

Про контекстную рекламу

А что нужно сделать, чтобы большой брат понял, что я уже купил ту вещь, которую искал в интернете весь вчерашний день, и больше не предлагал контекстную рекламу?)