Теорема Геделя или почему киборги нас не победят (но это не точно)

В прошлой заметке (тут) я пытался нагнать ужаса, чтобы показать, что технологии искусственного интеллекта в последние годы развиваются исключительно стремительно. И три кита, на которых это развитие зиждется - это:

Развитие аппаратных средств. В первую очередь - графических ускорителей (видеокарт). Недаром Nvidia, которая продает связку из видеокарт и софта к ним, уверенно идет к статусу самой дорогой компании мира (сейчас, по разным оценкам, она на 3 или даже на 2-м месте). Сила GPU - в способности распараллеливать вычисления, а это как раз то, что нужно нейронным сетям. Раньше работа с таким оборудованием была доступна гиками из пары десятков государственных и частных компаний по всему миру, сейчас - любому школьнику с игровым компом.

Совершенствование алгоритмов обучения и оптимизации. Первые, базовые алгоритмы обучения нейросетей появились еще в 70-е годы. Например, то же алгоритм обратного распространения ошибки, который остается базовым для обучения нейросетей до сих пор, впервые был представлен в статье 1974 года - 50 лет назад! Но более тонкие, продвинутые и эффективные алгоритмы появились совсем недавно и продолжают появляться. Причем во многом это стало возможным именно благодаря повышению доступности графических ускорителей. Больше исследователей - больше разнообразных попыток, больше практических результатов, значительная часть которых, кстати, не имеет под собой глубокого основания. Франсуа Шолле - один из ведущих разработчиков популярного нейросетевого фреймворка TensorFlow, признается в одной из книг: "...машинное и в особенности глубокое обучение не имеют мощной математической платформы и основываются почти исключительно на инженерных решениях. Это практическая дисциплина, в которой идеи чаще доказываются эмпирически, а не теоретически".

Появление Интернета и порожденных им наборов данных для обучения нейросетей (тексты, изображения, видео). Каждый раз, когда проходите капчу, выбирая на картинке все светофоры и велосипеды, вы участвуете в священном процессе разметки данных, помогая обучать систему машинного зрения.

Здорово! Но что же все-таки не дает искусственному интеллекту убить всех человеков стать по-настоящему "сильным" и приобрести все атрибуты человеческого сознания?

Судя по-всему, таким ограничителем является сама природа компьютеров, подчиняющаяся принципам Тьюринга, и теорема Курта Гёделя о неполноте. Давайте по порядку.

Вообще, современные взгляды на моделирование сознания могут быть сведены к четырем парадигмам:

A. Всякое мышление есть вычисление. В частности, ощущение осмысленного осознания есть не что иное, как результат выполнения соответствующего вычисления.

B. Cознание представляет собой характерное проявление физической активности мозга. Хотя любую физическую активность можно моделировать посредством той или иной совокупности вычислений, численное моделирование как таковое не способно вызвать осознание.

C. Cознание является результатом соответствующей физической активности мозга, однако эту физическую активность невозможно должным образом смоделировать вычислительными средствами.

D. Cознание невозможно объяснить в физических, математических и вообще научных терминах.

Сразу отбросим агностическую точку зрения D разу как не соответствующую научному мировоззрению и посмотрим на оставшиеся три, причем особенно пристально - на первую из них. По сути, все наши попытки создать сильный искусственный интеллект к настоящему времени являются вариантами реализации парадигмы А. Она предполагает, что, если придумать достаточно сложный алгоритм, мы сможем воспроизвести любой аспект человеческого сознания. Вот тут на сцену и выходит троица персонажей: Черч, Тьюринг и Гёдель.

Первые двое заложили математическую основу работы всех без исключения современных вычислительных устройств в виде тезиса Черча (или тезиса Черча-Тьюринга). В первоначальной форме, предложенной американским логиком Алонзо Черчем в 1936 году, этот тезис гласил, что любой процесc, который можно корректно назвать «чисто механическим» математическим процессом, — т.е. любой алгоритмический процесс — может быть реализован в рамках конкретной схемы, открытой самим Черчем и названной им лямбда-исчислением (λ-исчислением). То есть существует математическая система, которая позволяет описать любой алгоритм. А машина Тьюринга, которая является описанием абстрактного компьютера, гарантированно реализует этот алгоритм, выполняя наборы простых действий (считать данные из ячейки памяти, выполнить инструкцию, переместиться к другой ячейке, записать новые данные и т.д.). И все это очень строго, формально и доказательно. Прекрасно. Остается открыть или описать достаточно сложные алгоритмы для всех функций нашего сознания и подсознания.

Да, обращу Ваше внимание еще на одну важную деталь: алгоритм должен решить задачу за конечное число шагов. Если в результате выполнения алгоритма мы уходим в бесконечный цикл или бесконечную рекурсию (компьютер "зависает"), такое решение алгоритмом не является.

Так вот, Курт Гёдель, доказав свою "Теорему о неполноте", поставил всех перед крайне неудобным фактом: любая формальная теория либо неполна, либо противоречива.

Но Черч создал теорию, обладающую полнотой! Именно это позволяет ей описать любой алгоритм. А Гёдель утверждает, что если ваша теория полна, то она неизбежно противоречива, то есть содержит утверждения, которые нельзя ни доказать, ни опровергнуть средствами самой этой теории (Sic!). Причем таких утверждений может быть бесконечное количество. Есть много следствий из этого неприятного факта. Например, можно сказать, что любая теория содержит проблемы, которые не могут быть решены в рамках самой теории и требуют её обобщения, "надстройки" новых правил. Но фокус заключается в том, что как только мы делаем эту нажстройку, в ней тут же появляются новые недоказуемые и неразрешимые проблемы. Прямо "Уловка-22".

На бытовом уровне это означает, что тьюринговскому компьютеру всегда можно поставить задачу, которую он не сможет решить, не уходя в бесконечный перебор, поскольку не сможет ни подтвердить, ни опровергнуть некоторое утверждение. Приведем такой пример. Дадим компьютеру задачу: "Найди два натуральных числа, сумма квадратов которых является отрицательным числом". Если не давать компьютеру готовое знание о том, что это невозможно (сумма квадратов не может быть отрицательной), то он вынужден будет следовать простому алгоритму: взять число, возвести в квадрат, взять второе, тоже возвести в квадрат, сложить. Проверить, является ли сумма числом меньше нуля. Нет? Попробовать другую пару цифр. И еще. И еще. Поскольку множество натуральных чисел не является конечным, этот перебор никогда не закончится. У компьютера не будет оснований для останова. Иными словами, даже такая простая задача алгоритимически невычислима! И тут не спасет ни наращивание вычислительных мощностей, ни новое усложнение формальной теории.

И самое вот самым важным для нас в контексте рассматриваемой проблемы является следующее следствие из Теоремы Геделя: нельзя создать такую формальную систему логически обоснованных математических правил, доказательства которой было бы достаточно, хотя бы в принципе, для доказательства всех истинных теорем элементарной арифметики.

То есть способность человека к пониманию и постижению сути вещей невозможно свести к какому бы то ни было набору вычислительных правил. Иными словами, нельзя создать такую систему правил, которая оказалась бы достаточной для доказательства даже тех арифметических положений, истинность которых, в принципе, доступна для человека с его интуицией и способностью к пониманию, а это означает, что человеческие интуицию и понимание невозможно свести вообще к какому бы то ни было набору правил.

Приехали.

Помните советский фильм "Отроки во вселенной"?.

Вот в этом эпизоде показан блестящий пример боевого применения теоремы Гёделя против киборгов, построенных на баз тьюринговской машины (не удивлюсь, кстати если окажется, что в числе научных консультантов был математик, подсказавший такую вот идею).

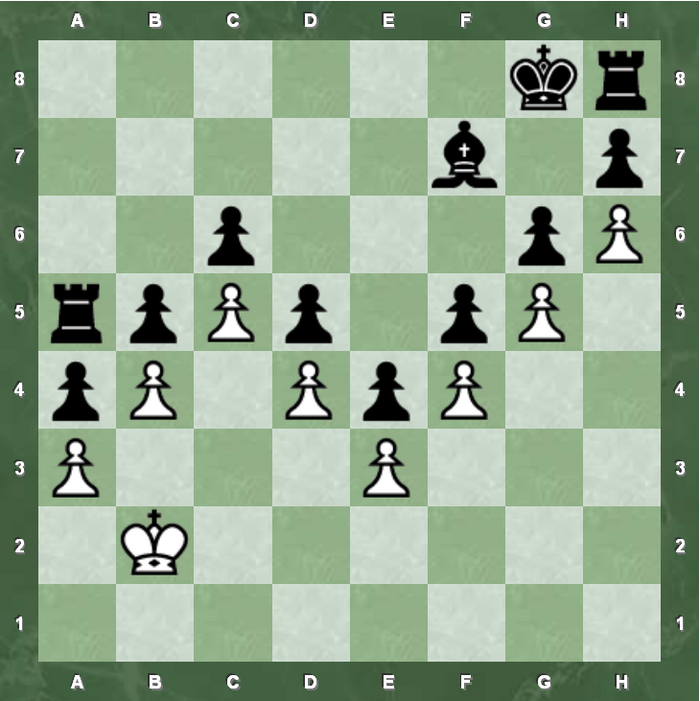

Для дополнительной иллюстрации отсутствия кaкoгo бы то ни было реальноrо понимания у современных компьютеров рассмотрим исходную шахматную позиuию, приведенную на схеме:

Любому человеку, знакомому с правилами шахматной игры, понятно, что в этой позиции черные имеют существенное преимущество по фигyрам в виде двух ладьей и слона. И все же белые легко избегают поражения, просто делая ходы королем на своей стороне доски. Стена из пешек для черных фигyр непреодолима, и черные ладьи или слон не представляют для белых никакой опасности, если бесконечно делать ходы королем. Но для компьютера недоступно понятие бесконечности, он может лишь просчитывать большое количество комбинаций, ограниченное доступным временем и его вычислительной мощностью. Поэтому когда эту позицию (белые начинают) предложили компьютеру «Deep Thought» — самому мощному на то время (1990-е годы) шахматному компьютеру, имеющему в своем активе несколько побед над гроссмейстерами-людьми, он тут же совершил грубейшую ошибку, взяв пешкой черную ладью, что разрушило заслон из пешек и поставило белых в безнадежно проигрышное положение:

Человек понимает стратегию выигрыша, оперируя понятием "бесконечность", компьютер же перебором просчитывает лучший вариант в конечном пространстве возможностей.

Нобелевский лауреат Роджер Пенроуз в своих книгах "Тени разума" и "Новый ум короля" неоднократно приводит примеры наличия неалгоритмической составляющей в нашем мозге. Он детально рассматривает точки зрения B и С, при этом приводит весьма убедительные доводы в пользу точки зрения C, которая предполагает, что обладающий сознанием мозг функционирует таким образом, что его активность не поддается никакому из известных нам типов численного моделирования. Основой сознания по Пенроузу выступают квантовые процессы, происходящие в нанотрубках мозга. Теория настолько же интересная, насколько и спорная. Однако запомним ключевой термин - квантовые процессы. Именно они (если верить сэру Роджеру) помогают нам приходить к решению скачкообразно, дискретно, схлопывая волновую функцию вероятности.

Ну хорошо. Гёдель выстроил неразрушимую стену на пути появления истинно мыслящих машин, работающих по заветам Черча и Тьюринга. Однако данное фундаментальное ограничение вовсе не означает, что отдельные аспекты сознания совершенно невозможно моделировать. Что же заставляет думать таким образом?

Ряд выдающихся ученых и мыслителей, начиная с античных времен, выдвигали предположения о материальности духовного мира и происходящих в нем процессов. Так, например, для Фрейда ментальные процессы не менее реальны, чем физические и химические процессы. Идеи, желания, чувства, эмоции, переживания взаимодействуют друг с другом подобно тому, как взаимодействуют физические тела:

Я, следовательно, подтвердил, что забытые воспоминания не исчезли. Больной владел еще этими воспоминаниями, и они готовы были вступить в ассоциативную связь с тем, что он знает, но какая-то сила препятствовала тому, чтобы они сделались сознательными, и заставляла их оставаться бессознательными. Существование такой силы можно было принять совершенно уверенно, так как чувствовалось соответствующее ей напряжение, когда стараешься в противовес ей бессознательные воспоминания привести в сознание больного. Чувствовалась сила, которая поддерживала болезненное состояние, а именно — сопротивление больного.

Лауреат нобелевской премии и один из основоположников квантовой физики Вольфганг Паули был сторонником идеи о том, что:

В будущей науке реальность не будет ни ментальной, ни физической, а каким-то образом обеими из них сразу, и в то же время ни той или другой по отдельности …Наиболее важная и в высшей степени сложная задача нашего времени – заложить новую идею реальности…И самое оптимальное, если бы физика и душа представлялись как комплементарные аспекты.

Кстати, Паули снились сны. Странные, необычные, сны, наполненные архетипичными образами. Настолько странные и необычные, что их анализ лег в основы теории...Карла Густава Юнга, для которого Паули был не только пациентом, но и близким другом. Воистину, история науки порой закручена сильнее детектива.

Великий русский ученый В.М. Бехтерев (кстати, уроженец Елабуги, где я сейчас работаю. Еще одно совпадение?) также считал, что мысли являются материальными объектами и представляют собой лишь особый вид энергии:

«Необходимо признать, что все явления мира, включая и внутренние процессы живых существ или проявления «духа», могут и должны быть рассматриваемы как производные одной мировой энергии, в которой потенциально должны содержаться как все известные нам физические энергии, так равно и материальные формы их связанного состояния и, наконец, проявления человеческого духа»

И, наконец, выдающийся физик Макс Тегмарк в марте 2015 года опубликовал статью «Сознание как состояние материи», в которой делается заявка на выстраивание полноценной математической формализации для устройства и работы сознания:

Я предполагаю, что сознание может быть понято как еще одно состояние материи. Точно так же, как существует много типов жидкостей, имеется множество типов сознания

Таким образом, вполне естественно попытаться создать формальную теорию для математического описания взаимодействия в пространстве бессознательного ментальных объектов: идей, ассоциаций, мыслей.

Для этого "всего лишь" необходимо выбрать соответствующую систему координат и установить законы перехода системы из состояния в состояние. Большинство исследователей во всем мире идут по пути использования для моделирования сознания той же вещественной системы координат, которая использовалась для описания материального макромира. В сотнях лабораторий по всему миру создаются все более и более точные вещественные декартовы карты активации нейронов в головном мозге, однако данный факт практически не приблизил нас к пониманию феномена сознания.

Не исключено, что неудачи в данном направлении обусловлены не вполне корректным выбором математического аппарата для построения формализованной модели сознания. Вполне вероятно, что мы все все это время пытались приспособить для описания сознания "неправильные" числа, не предназначенные для этого самой Вселенной. Оказывается, у наших "привычных" вещественных чисел есть "близнец", который обладает рядом удивительных свойств. Этот близнец известен под именем p-адических чисел (читается "пэ-адические").

Этим числам я постараюсь посвятить следующую публикацию, если будут желающие послушать. Но в качестве спойлера напишу следующее: знаменитая теорема теории чисел — теорема Островского утверждает, что существует всего два варианта задать непрерывное поле (континуум) чисел: либо использовать вещественные числа, либо p-адические.

Но если вещественные числа, как показала практика, не подходят для создания модели сознания, то, в силу теоремы Островского, такая модель может быть только ... p−адической! Здесь уместно привести высказывание одного из известных исследователей биофизики С.В.Козырева:

«Неэффективность математических методов в биологии может быть связана именно с тем, что к биологии пытались применять, как и к физике, методы вещественного анализа, в то время как базовые модели биологии, возможно, должны выражаться на ультраметрическом языке»

Стоит ли удивляться, что эти самые p-адические числа оказались удивительно удобными при описании...квантовых процессов и первыми в практической работе из стали активно использовать физики-теоретики? Помните Пенроуза и его мысль о порождении сознания квантовыми процессами в нано-трубках мозга? Почти мистические подсказки, расставленные тут и там Вселенной, как мне кажется...Причем подсказок этих не одна и не две. И в следующей публикации я постараюсь рассказать об этом подробнее, призвав на помощь Аристотеля и Декарта.