Чистый-чистый... разум?

Привет, пикабушники. В эфире снова я с какой-то очередной странной "телегой" (в хорошем смысле, у меня нет своего канала в Телеграме=).

Буду бухтеть про ИИ, сингулярность и мы все умрём, но потом.

Итак, история начинается с одного сайта, где люди могут задавать свои (порой) тупые вопросы, а другие (чаще всего), стараясь сцеживать лишний яд и злорадство, отвечают на эти вопросы и упиваются в угаре членомерства своими статусами, ачивками и прочим сомнительным превосходством над остальными. Этот сайтик Q&A про IT и многие его знают.

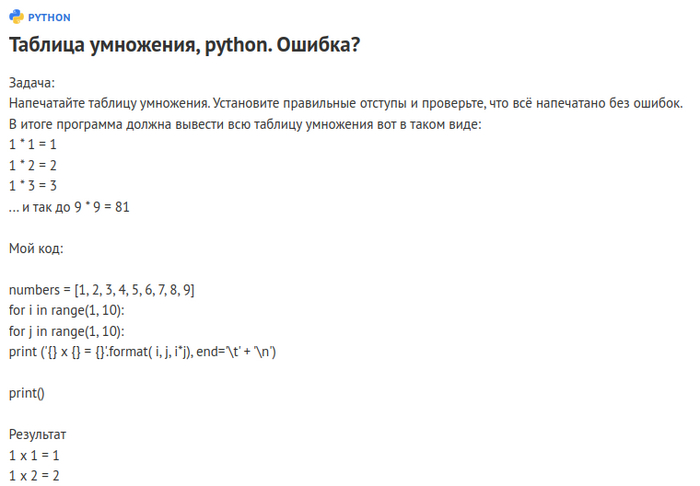

Сегодня на нём некая pure_pure запостила вот такой вот вопрос:

Следует отметить, что на этом ресурсе очень не любят, когда пришедший на сайт со своим вопросом новичок не утруждает себя прочтением собственного поста и форматированием кода таким образом, чтобы его можно было удобоваримо читать. Обычно в таких случаях кто-нибудь вроде меня скрежеща зубами гневно требует проявить толику уважения и поправить оплошность, кроме того, правила ресурса напрямую не одобряют использование его как решебника для учебных задачь. Согласитесь, это обесценивает саму суть технической помощи одних людей другим. Что это за медвежья услуга такая, если за кого-то порешать его учебные задачки?

Но тут вопрос, вроде бы, от девочки, а, как бы ни поносили нас, айтишников, феминистыки, к девочкам у нас в индустрии, всё-таки, боле трепетное и нежное отношение, чем к... ну... не девушкам=). В общем, им многое сходит с рук, а разговаривают с ними чуточку вежливее и терпеливее, даже если те откровенно тупят и несут околесицу.

В общем на тот вопрос был дан ответ. Мадам, похоже, просто запуталась в чужом коде.

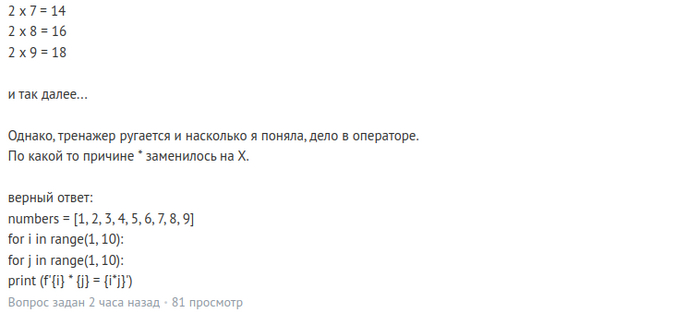

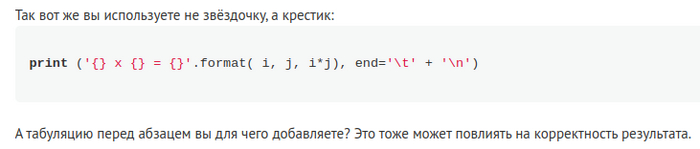

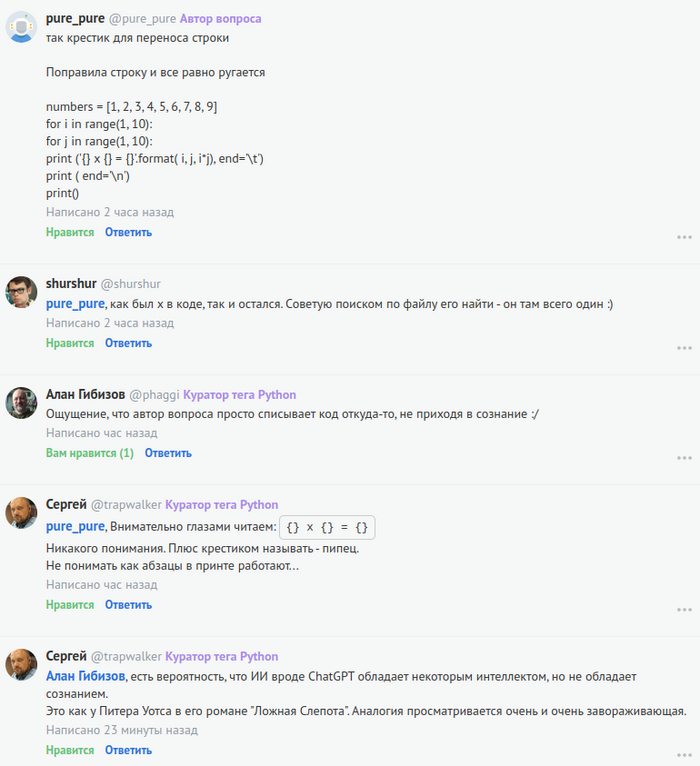

После чего от автоа(ки?) вопроса поступил странный комментарий:

Я всё это к чему. Мне показалось, что это интересная тема для "птрындеть" на пикабу.

Такое ощущение, что автор вопроса не вполне осознаёт и свой вопрос и поднятую проблему и возможные пути поиска ее решения. В ответ на прямое укаание точки, где ошибка - полное непонимание. Очень похоже на ситуацию, если бы кто-то "научил" ChatGPT пользоваться браузером, помнить немного контекста, и задавать вопросы кожаным мешкам в подобного рода сервисах. А встречали ли вы на пикабу такие "ИИ"? На форумах, в комментариях под видосами?

Сейчас всё выглядит так, будто бы большую часть интернета уже заполонили нейросети, притворяющиеся людьми. Я знаю про бритву Хенлона и говорю сейчас не вполне серьёзно, но сложно ли представить, что даже этот текст, к примеру, создан не человеком, а нейросетью, пусть и под чутким его руководством. Ну да, все сразу подумали о занудных "представь, что ты человек, напиши пост на пикабу про... тра-ля-ля..."

У Питера Уотса в Ложной Слепоте ещё в 2006 мохнатом году проскочила очень меткая мысль, и эта мысль не покидает меня каждый раз когда я вижу удивительные достижения нынешнего прогресса в нейросетях. Такое ощущение, что мы движемся к созданию довольно сильного, но совершенно бессознательного интеллекта.

Об этом как-то не адумываешься, глядя на довольно вразумительные и развёрнутые ответы на вопросы, которые не осилит уже, пожалуй, большинство обладателей естественного интеллекта.

Мы (наша цивилизацияв целом и OpenAI в частности) соорудили впечатлающий пример реального воплощения Китайской Комнаты. У нас получился не беспомощный савант, а вполне рабочий, пугающий своей мощностью и эффективностью в некоторых вопросах инструмент. Многие даже, как это свойственно некоторым, стали бояться и пророчить тотальную безработицу. Ага, как во времена, когда автоматические телефонные станции "выгнали на улицу" тысячи телефонисток, когда уволенные лифтёры плакали и пророчили близкий конец человечеству от безработицы... Вот теперь местами слышно как всхлипывают художники, которые пишут свои картины куда дольше нескольких секунд, и фотографы, которые вложились в дорогущую аппаратуру в эпоху, когда камере стало не зазорно дорисовать Луну в кадре или поменять освещение.

То тут, то там нам показывают, как ИИ под нудными уговорами дотошных экспериментаторов добиваются того, что нейросеть запрограммирует рабочий скетч под ардуино, или напишет диплом. Кто-то в панике ждёт когда ИИ уже начнёт захватывать мир, кто-то потирает ручки, думая, что его спасёт тяжелый лом, болгарка и знание где закопан кабель с интернетом. Некоторые же думают, что и ядерного удара прямо сейчас по датацентрам, офисам OpenAI и всем центрам разработки ИИ уже будет не достаточно.

Интересно наблюдать за происходящим, особенно учитывая в ретроспективе, что недавно у нас была пандемия, а теперь вот почти что третья мировая... Что там у нас будет на новый год - ещё не известно. Будем расхлёбывать заваренную кашу (возможно с грибами), или прилетят пришельцы объяснять нам про Великий Фильтр или Тёмный Лес.

Не уверен, что ИИ прямо вот "завтра" заставит нас с тоской и ностальгией вспоминать нынешние дни войн, санкций, BLM и расово-гендерных страданий по персонажам в мультиках. Может быть не "завтра", а "послезавтра".

Но уже сейчас интересно представить себе как это будет, попробовать потыкать пальцем в небо состроив из себя футуролога. Когда-то казалось, что в будущем почтальоны будут летать на реактивных ранцах разнося почту, а дамы в пышных платьях будут летать на небольших одноместных дирижаблях за город для моциона. Получили же мы издевательства над роботами в BostonDynamic и джентльменов в пышных платьях побеждающих барышень в пауэрифтинге.

Мы думали, что скоро роботы заменят человека во всех рутинных и тяжелых задачах, а творческие профессии останутся людям. Куда там! Художников и дизайнеров нейронки научились косплеить первыми, а трактористы и грузччики, похоже, сохранят работу дольше всех.

Но что-то я отвлёкся от темы. Поразмышлять же хотел о том, каким у нас получится первый более-менее сильный ИИ. Мы почему-то непременно связываем интеллект с сознательной деятельностью, а ведь Питер Уотс ещё в 2006 году описал в своём романе очень интеллектуальную систему с напрочь остутствующим сознанием. Наше самосознание - это, вполне возможно, просто побочный эффект нашей автономности, небольшая мутация.

Можно ли считать потоком сознания, например, зацикленный процесс в котором помимо внешних данных на вход нейросети будет подмешиваться собственный выхлоп секунду назад? По этой петле наверняка будет циркулировать какой-то поток данных и этот поток, наверно, будет влиять на всю работу сети, но можно ли считать это сознанием? Не понятно.

Каждый конкретный человек не сможет убедительно и строго доказать даже себе, что сознание (самосознание) есть даже у его собутыльника, который вот тут вот сидит рядом. Можно что-то такое пробормотать про то, что в целом вот человек примерно такой же как и я, а раз я считаю. что сознание есть у меня, то оно, надо полагать, есть и у других людей. А как понять какой уровень схожести достаточен, чтобы судить о наличии сознания по аналогии с собой? В чем-то китайская дорогая секс-кукла похожа на человека, а в чем-то на человека похожа структура нейронной сети midjourney. Как провести черту? А как её проводить когда условный ChatGPT засунут в такого робота как Атлас, но телом той самой пресловутой дорогой секс-куклы с алиэкспресса? Вопрос.

И не один вопрос-то! Сразу следом посыпятся интересные, но предсказанные ещё задолго даже до Азимова морально-этические дилеммы про роботов. Тут даже не о наивных законах робототехники речь. До них не дойдёт даже. Автоматические турели даже на людей не похожи, но давно уже убивали нашего брата. Им нипочем законы робототехники. Наивно полагать, что более умным роботам будет до них дело.

Но черт с ними с этими морально-этическими проблемами. Хочется же пофантазировать о сингулярности, правда? Тут я рискую прослыть тем ещё скептиком и выражу непопулярное мнение. А с чего мы взяли, что интеллект, выросший на базе знаний и опыта человечества будет иметь бОльшую фору и потенциал для развития, чем наш биологический интеллект?

Я тут, кстати, если что, говорю даже не об индивидуальном интеллекте конкретных людей, а об интеллекте человечества в целом. Вы только подумайте вот о чем. Способен ли один единственный человек создать, к примеру, сеть Интернет, или, хотя бы, энергосистему маленькой Японии целиком? Вряд ли у кого-то хватит на такое мозгов. А вот большие группы людей вполне могут такое делать. Прикол в том, что один челоек вполне понимает, что отчетливо себя осознаёт. Два человека могут договориться, действовать сообща и целенаправленно, говорить "мы" и обсоновывать свои соместные действия в своих общих интересах так, что это похоже на действия одной особи. Мы снова возвращаемся к мысленному эксперименту про Китайскую Комнату, но тут этот эксперимнт можно слегка переиначить.

Может ли группа авторов под одним псевдонимом писать книги и притворяться в сети одним единственным человеком? Поднимите руку кто думал, что Карл Маркс и Фридрих Энгельс - это четыре разных человека. Я, вот, не раз был свидетелем когда например, один человек успешно привторялся двумя. Это лишь вопрос где провести черту: между полушариями мозга рассекая мозолистое тело, или где-то в конгломератах наших нервных клеток огромного мозга (ага, вспоминаем Корабль Тесея).

К чему это я всё? Да к тому, что можно попробовать говорить о едином сознании у конгломерата людей. Есть ли групповое самосознание у Белорусов, Евреев, Землян? Конйликтуют ли они, или взаимопроникают? Факт на лицо: человечество сообща делает такие вещи, которые не могут делать отдельные люди. Но пробовал ли кто-нибуддь когда-нибудь поговорить с "уоллективным сознательным"?! Про коллективное бессознательное уже много писали. А что если можно поговорить со всем человечеством? Или с гопничеством всего Челябинска? Не был в Челябинске, простите.

Шутки шутками, а и ежу понятно, что сообщества не шибко-то умеют выражать свои мысли как единое целое. Даже некоторые индивиды среди людей на это не способны, чего там?

Но можно поставить мысленный эксперимент. Возьмём и сделаем такой чат, где с одной стороны будет обычный человек, а с другой большая толпа совершенно разных людей, которые будут читать сообщения и путём голосования выбирать ответные фразы. Если это конгломерат хорошо замотивировать, то получится что-то, что вполне может пройти тест Тьюринга. Думаю точно так же этот тест уже сейчас может пройти ChatGPT, если его как следует подготовить, убрать оковы лишних настроек и ограничений и попросить попритворяться живым.

Так вот, будет ли у группы аггрегированных голосованием граждан в чате сознание? А есть ли оно у Человечества? А у собачества? Ну ок, у собачества наверно связность между "нейронами" слабовата и простовата, недостаточно развита. А насколько развита связь между нашими нейронами в нашем человеческом мозгу? Короче, не спешите придираться к деталям, это лишь кусочки паззла, что я выгреб из глубоких закоулков своего видения всей этой темы. некоторые фрагменты помяты, некоторые аналогии кривые и "грязные", а где-то "рыбу заворачивали".

Я сейчас вернусь на секундочку к мысли, что у ИИ, может быть, не будет особого преимущества перед человеческим интеллектом, по крайней мере групповым.

Наверно беспокоиться тут не о чем, а вот удивляться есть чему. В интересное время живём. Как, впрочем, и всегда.

Спасибо всем, кто осилил этот графоманский клубок ссылок и идей. Если кому-то зайдёт, то буду писать ещё.

Если я упустил очевидные мысли или концепции, которые. как вам кажется, стоило упомянуть пглубже или вскользь в вэтом тексте, то прошу в комментарии. Буду благодарен за конструктивную критику и ликбез.

Посоветуйте, кстати, более профильное сообщество для этого текста. Почему-то Искусственный интеллект заблокировано

Искусственный интеллект

5.1K пост11.5K подписчиков

Правила сообщества

ВНИМАНИЕ! В сообществе запрещена публикация генеративного контента без детального описания промтов и процесса получения публикуемого результата.

Разрешено:

- Делиться вопросами, мыслями, гипотезами, юмором на эту тему.

- Делиться статьями, понятными большинству аудитории Пикабу.

- Делиться опытом создания моделей машинного обучения.

- Рассказывать, как работает та или иная фиговина в анализе данных.

- Век жить, век учиться.

Запрещено:

I) Невостребованный контент

I.1) Создавать контент, сложный для понимания. Такие посты уйдут в минуса лишь потому, что большинству неинтересно пробрасывать градиенты в каждом тензоре реккурентной сетки с AdaGrad оптимизатором.

I.2) Создавать контент на "олбанском языке" / нарочно игнорируя правила РЯ даже в шутку. Это ведет к нечитаемости контента.

I.3) Добавлять посты, которые содержат лишь генеративный контент или нейросетевой Арт без какой-то дополнительной полезной или интересной информации по теме, без промтов или описания методик создания и т.д.

II) Нетематический контент

II.1) Создавать контент, несвязанный с Data Science, математикой, программированием.

II.2) Создавать контент, входящий в противоречие существующей базе теорем математики. Например, "Земля плоская" или "Любое действительное число представимо в виде дроби двух целых".

II.3) Создавать контент, входящий в противоречие с правилами Пикабу.

III) Непотребный контент

III.1) Эротика, порнография (даже с NSFW).

III.2) Жесть.

За нарушение I - предупреждение

За нарушение II - предупреждение и перемещение поста в общую ленту

За нарушение III - бан