Выключение видеокарты RX570

Здравствуйте, надеюсь кто нибудь сможет мне помочь с видеокартой AMD Radeon RX 570 (ASUS ROG STRIX 4G).

Суть заключается в следующем - видеокарта отключается в рандомный момент, в играх, пропадает изображение. Заметил что в некоторых играх карта отключается почти сразу, например в PUBG , когда взрывается граната. Еще я обнаружил, что видеокарта отключается чаще при открытия оверлея AMD Adrenalin ( Версия 22.11.1) , то есть когда я в игре нажимаю комбинацию Ctrl+Shift+O ( комбинация по умолчанию). Играл сегодня в War Thunder продолжительное время, и именно при попытке открытия оверлея видюха выключилась.

После выключения пропадает изображение и кулеры начинают крутиться с максимальной скоростью, помогает нажатие кнопки hard reset , после неё нажимаю обычную кнопку power 2 раза, сначала комп полностью отключается , потом включаю его и всё нормально. Если нажать просто hard reset, то изображение не появляется. После запуска пк выскакивает уведомление - "radeon wattman по умолчанию были восстановлены из-за непредвиденной системной ошибки" .

Прогонял видеокарту FurMarkoм, за 10 минут ничего не выключалось. Прогнал программой - video memory test , там тоже все нормально и ошибок не было.

Видеокарта сама по себе не новая, но работала хорошо и не греется. Почитал на форумах, однозначного ответа нет, гдето пишут что карта скоро помрёт, где то пишут что это ошибка драйверов или биоса(биос у меня стоит правильный, скачивал с сайта именно для своей видеокарты, делал всё по гайдам, смотрел данные программой Gpu-Z).

Если кто сталкивался с подобной проблемой отпишитесь пожалуйста.

Нейровидеокарты?

Не секрет что сейчас видеокарты берут заветные эфпиэсы, а точнее их количество, не только грубой, тупой мощью, а умом и сообразительностью, а именно умным масштабированием, и генерацией промежуточных кадров, и та и другая система даёт как преимущества, так и недостатки, гостинг, артефакты на сложной геометрии, кривые генерации кадров, где часть изменения теряется.

То есть это уже не та чистая изначальная картинка.

Как думаете, производители GPU и дальше будут развивать эту идею, или когда нибудь мы наиграемся в огромные числа FPS, и вернёмся к чистой производительности без ускорялок?

Стоит ли брать Arc 380?

Хочу прикупить низкопрофильную видимокарту, но пока не понимаю что выбрать.

Основная потребность - работа в графических приложениях, побочная - понастольгировать в Skyrim, Fallout 3/4 и что-то в этом духе.

Стоит ли брать A380?

Важный нюанс, карта будет устанавливаться в материнку штеуда 2 поколения.

Выбор между 1650/6400/A380.

Может есть владельцы этой карты, которые смогут рассказать, что это за зверь такой, помимо существующих обзорщиков.

Карта по моим ощущениям сочетает в себе качества как Quadro, так и GF.

Однако как всегда драйвера, наверно, полное дно и хз какие перспективы в эволюции дров.

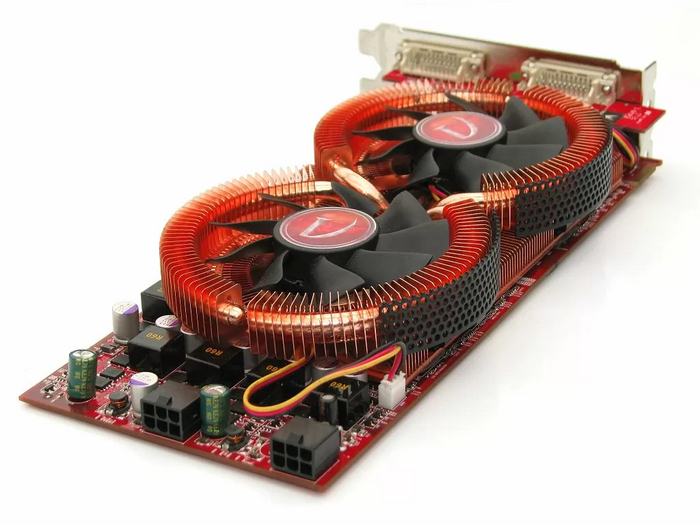

Двухголовые монстры от AMD догнали gforce в топовой производительности

В октябре 2006, в прошлом году произошло знаковое событие - компания ATI была куплена компанией AMD за 5,4 миллиарда долларов США. От самого бренда ATI отказались, полностью оставив только суббренд видеокарт Radeon.

Из-за процесса покупки компании выход ответа на 8800 GTX затянулся и выход нового чипа R600 состоялся только в мае 2007. По аналогии с Nvidia теперь применялась архитектура с большим количеством универсальных процессоров, способных выполнять самые различные задачи. До выхода R600 AMD применяла данный подход при разработке GPU для XBOX 360. Джентльменский набор того времени в виде поддержки шейдеров четвертого поколения, DirectX 11 и улучшенные алгоритмы сглаживания и фильтрации так же был на месте.

И сейчас в конце 2007 года AMD выпустила обновленный чип RV670 и видеокарты с названием Radeon HD 3850 и HD 3870.

По сути это был оптимизированный чип R600, выпускаемый по 55-нм тех.процессу. Данные карты принадлежали к среднему ценовому сегменту и не претендовали на звание флагмана. Чуть позже AMD выпустила своё первое двухчиповое решение Radeon HD 3870X2.

Данная карта могла уверенно бороться с Geforce 8800 Ultra. Бочкой дёгтя здесь выступали драйвера AMD, которые далеко не во всех проектах могли позволить этой видеокарте работать корректно.

Подводя итоги 2005-2007 годов можно увидеть два устоявшихся факта. Первый - компания Nvidia хорошо закрепилась на лидирующей позиции разработчика графических решений. И в целом AMD хоть и будет иногда представлять более мощные и интересные решение, лидерство Nvidia она так и не сможет оспорить до настоящего времени.

Второй факт - гонка производительности привела к тому, что у топовых решений появились монструозные системы охлаждения. Такая картина так же сохранится и по сей день. Сейчас обычное дело, когда радиатор охлаждения занимает два или даже три слота расширения.

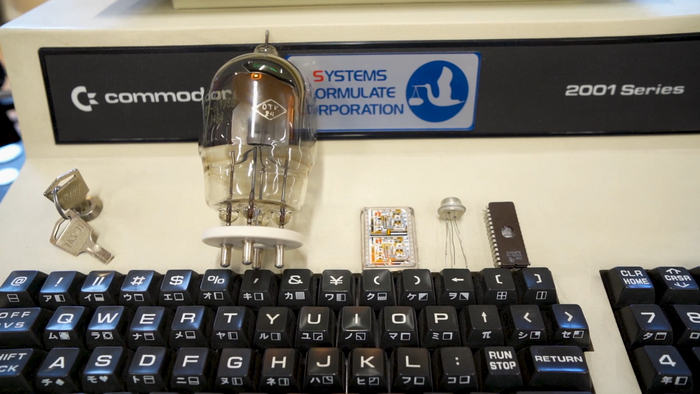

Компьютерная ретроспектива

Привет Пикабу! В комментариях попросили сделать развернутый пост, ну что же, давайте вернемся туда где всё начиналось. Туда, где все эти сокеты, процессоры и видеокарты только зарождались и посмотрим, что изменилось за эти несколько десятилетий.

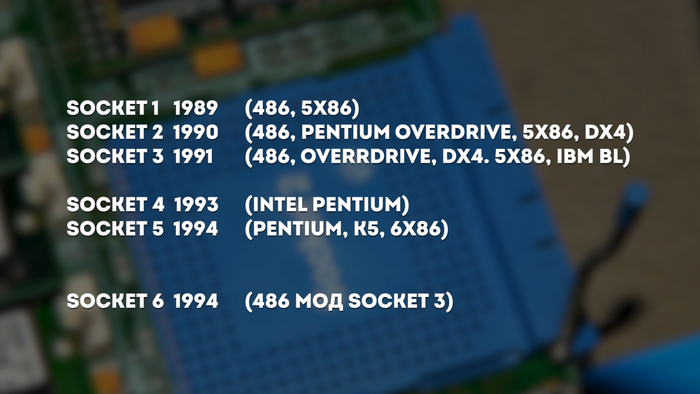

Socket 1

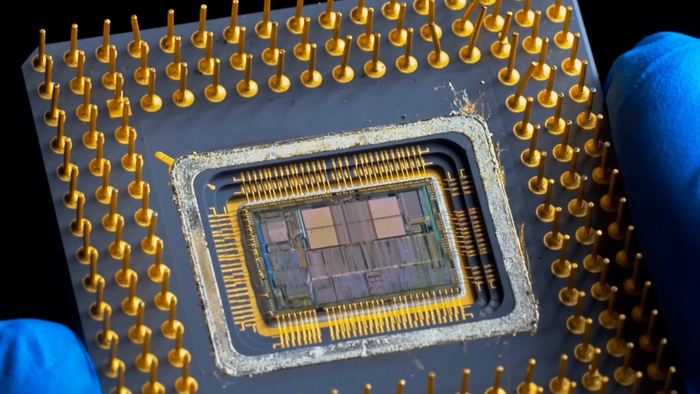

Начнем с разъема для процессора. Самое сложное здесь провести красную черту. Формально самым-самым первым сокетом можно назвать DIP, или по-русски двухрядный корпус.

Два ряда отверстий прямо в плате, куда втыкался процессор, и в случае с x86-решениями впервые использовался еще в 70-ых, с такими легендарными процессорами как Intel 8086 и 8088.

Но это что-то совсем древнее и вообще не похоже на современный сокет, пропускаем. Начало 80-ых, двух рядов уже не хватает – появляется PLCC, или пластиковый держатель чипа. Теперь контакты были со всех четырех сторон, но все еще на современные сокеты он походит лишь отдаленно.

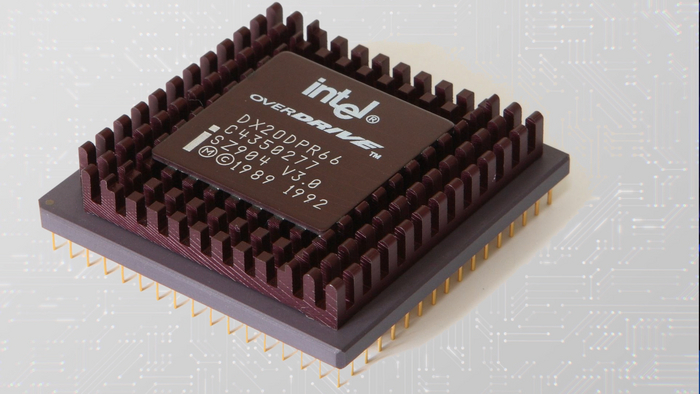

Какое же крепление процессора на плате можно назвать первым сокетом? PGA 169. Да, существовал PGA 168, который неформально называют Socket 0.

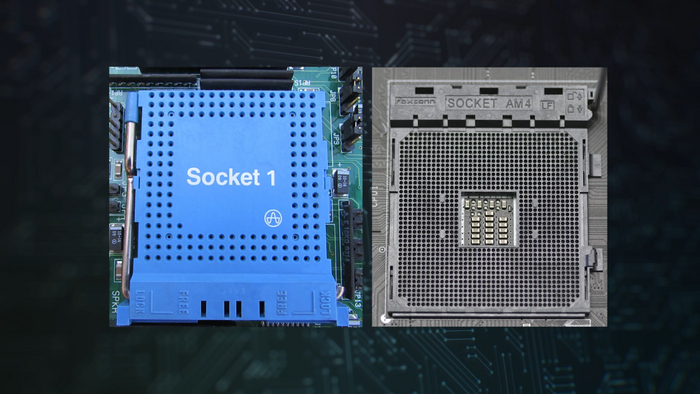

Он поддерживал ранние Intel 486-ые и был достаточно быстро заменен уже официальным Socket 1, который прибавил ровно одну контактную ножку – что-то забыли, ДА, идея быстрой смены сокета у Intel это по канону. Так что именно Socket 1 логично считать первым сокетом. И по современным меркам он поддерживался довольно долго, аж 5 лет, с 1989 по 1994 год, на нем работали множество процессоров вплоть до топовых Intel 486DX4, а также клонов от AMD и Сайрикс.

Это была паразитическая гармония, у процессоров Intel и AMD были общие платы, и «красные» занимались по сути копированием процессоров «синих». К слову, и внешне большой разницы Socket 1 с тем же AMD AM4 почти нет – конечно, возросло число контактов, но основная идея крепления за 30 лет не поменялась.

И да, тогда процессоры от Intel не были бракованными и тоже имели ножки.

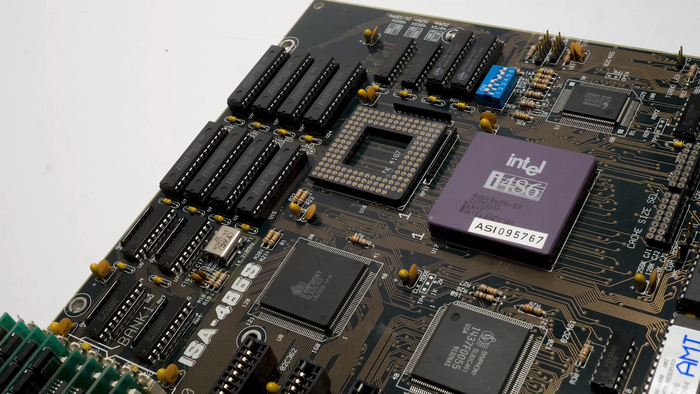

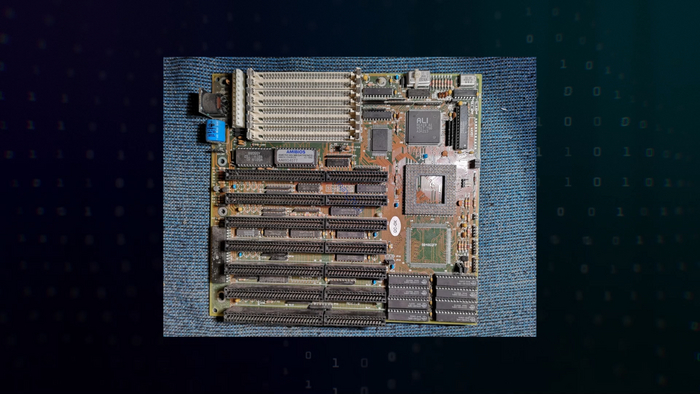

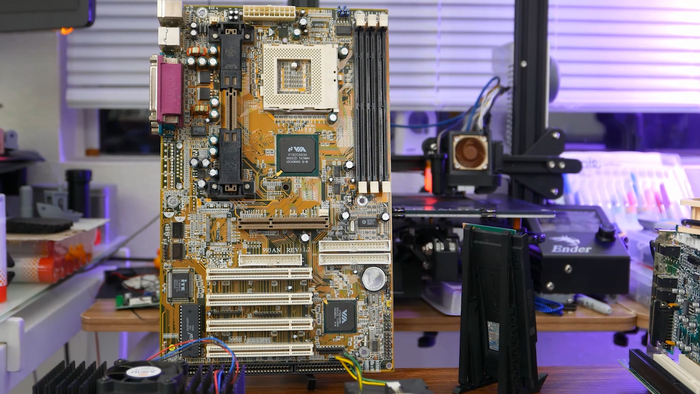

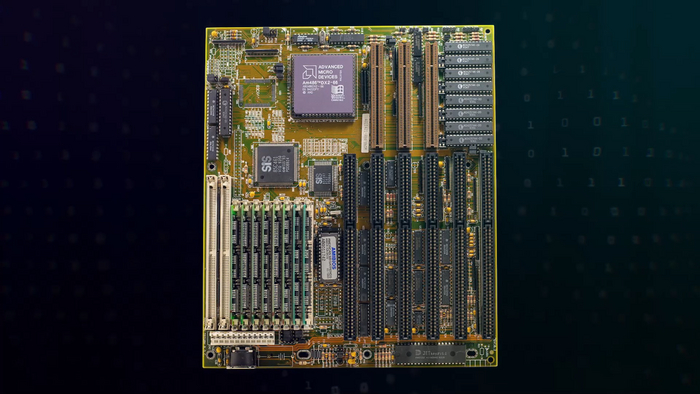

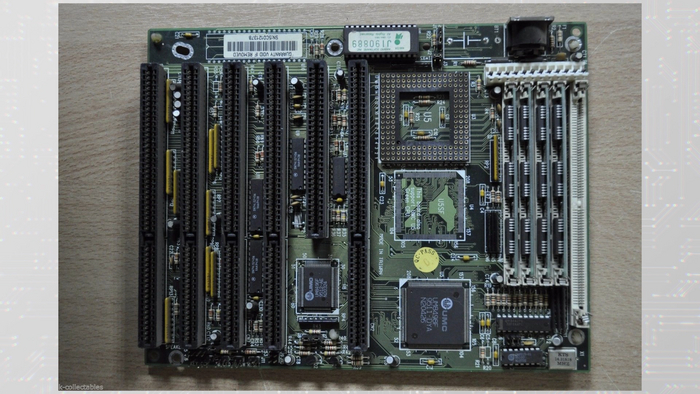

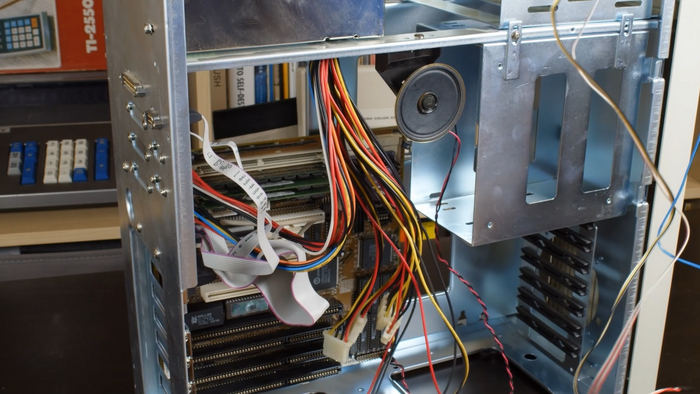

Материнские платы под Socket 1

Но как выглядели платы с таким разъёмом для процессора? Абсолютно не так, как мы привыкли. Это такой ардуино на максималках.

Более-менее привычный нам сейчас вид с процессором в центре, слотами ОЗУ и модулями расширения снизу стали получать лишь на Socket 370 в конце 90-ых, когда ПК стали достаточно массовыми и на рынке уже присутствовали крупные игроки, такие как ASUS, вынужденные договариваться о стандартизации. Производители более ранних плат размещали процессор и ОЗУ так, как было удобно с точки зрения компоновки и производства.

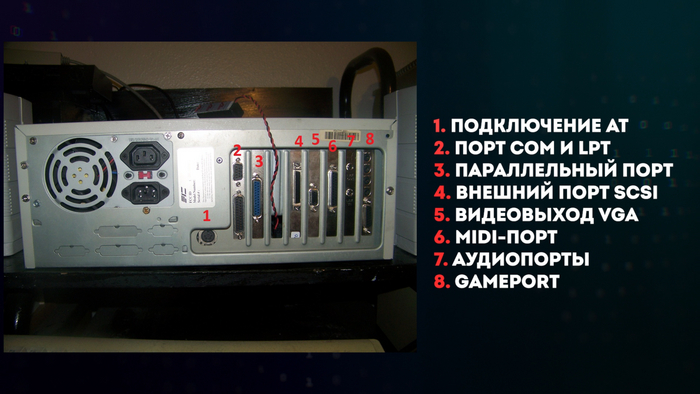

В платах с Socket 1 из начала 90-ых вы не найдете привычной 24-pin колодки питания. Того коннектора, который легко подключить, но очень сложно потом выдрать, появился он лишь в 1995 году с принятием стандарта ATX, и то в форме 20-pin . И это важная точка отсечения: к платам из 1995 года современные БП подключить можно, а к более старым – без танцев с бубном уже нет.Также на плате не было разъема для подключения питания процессора. 486-ые потребляли десяток ватт, поэтому и не требовали дополнительной запитки.

Также на плате не было разъема для подключения питания процессора. 486-ые потребляли десяток ватт, поэтому и не требовали дополнительной запитки.

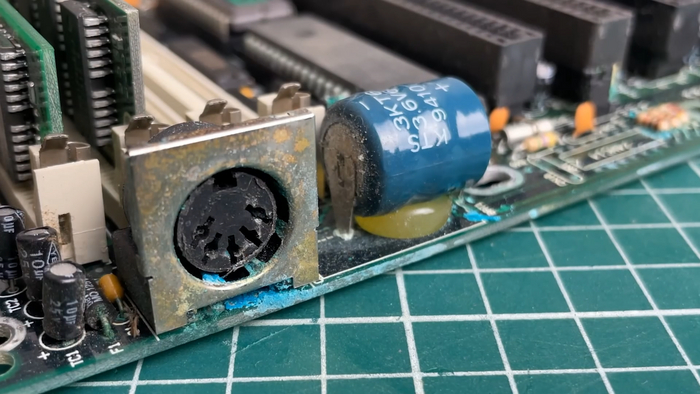

А вместо привычной нам батарейки BIOS стоял небольшой бочонок. От долгого неиспользования такие никель-кадмиевые батарейки могли подтекать, что только усложняло задачу восстановления работоспособности плат. Также у плат тогда было очень мало выходов – нередко один-единственный AT-порт для подключения клавиатуры (мышь тогда была не обязательным атрибутом).

Никаких вам USB и даже LPT с COM – тогда использовался несколько другой подход: минимум всего на плате, зато максимум слотов для подключения – это позволяло здорово сэкономить, так как нередко хорошая звуковая карта стоила как весь ПК. А вместо PCI Express тогда использовалась его бабуля, шина ISA, которая в максимуме выдавала умопомрачительные 4 мбайта/с.

И вот именно в слоты ISA можно было пихать все что душе угодно. Звуковые карты, сетевухи, дисководы для дискет и конечно же видеокарту. По этой причине ISA-слотов на материнской плате было много, нередко по 6-7 штук, чтобы была возможность разместить всю необходимую периферию.

Да, сейчас таким количеством PCI может похвастаться разве что серверная плата, или майнерские никому не нужные франкенштейны.

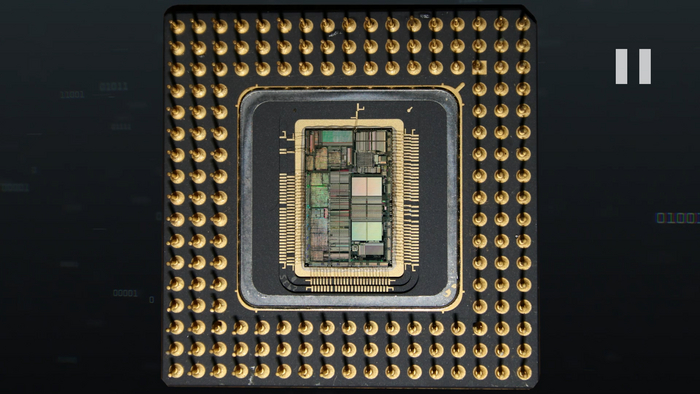

Процессоры Intel 486

Платы с тех пор изменились сильно. А что насчет процессоров? Тут как посмотреть – если снизу, то 486й Intel слабо отличается даже от современных Ryzen – ну разве что ножек стало на порядок больше.

А вот вид сверху поменялся значительно – все современные процессоры имеют медные крышки, а вот решения из 90-ых обычно было керамическими. Причина тут лежит на поверхности: это сейчас процессоры требуют серьезного охлаждения, тогда же нередко хватало обычного радиатора. Собственно, именно поэтому на платах и не было отверстий для крепления кулеров – они если и использовались, то были максимально простыми и легкими, и просто приклеивались на керамику.

Из интересного стоит отметить, что тогда кэш второго уровня находился на самой плате, а максимальная частота процессоров 486-ой серии не превышала сотню мегагерц. Зато у них уже был встроенный математический сопроцессор, он же FPU – предшественники в лице 386-ых были без него. Также можно прикинуть рост производительности за 30 лет. Например, 50-мгц 486DX2 имел производительность около 0.05 ГФЛОПС, а народный Ryzen 5 3600 набирает около 500 ГФЛОПС, то есть он в 10 000 раз быстрее.

ОЗУ FPM

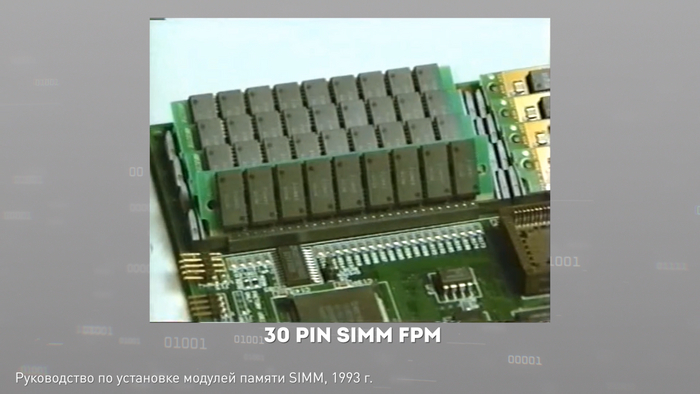

А вот что несильно внешне изменилось за 30 лет, так это модули ОЗУ. По сути разве что сами модули стали больше, чтобы вместить больше контактов и банок памяти. Конечно, внутреннее устройство серьезно отличалось от привычного нам стандарта DDR SDRAM, который появился лишь в 1998 году.

Если же мы откатимся еще лет на 6-7 назад во времена Socket 1, то самым прогрессивным стандартом памяти был 30 pin SIMM FPM, что переводится как модуль памяти с однорядным расположением выводов, поддерживающий быстрый страничный режим. До 200 мбит/с на частоте 25 МГц – вероятно скорость вашего интернета выше.

Емкость тоже не удивляет – 1-2, реже 4 МБ на модуль. А вот количество слотов под ОЗУ внушает уважение – нередко на плате их было по 8 штук. Сейчас таким количеством могут похвастаться в лучшем случае серверные или HEDT-платы. В итоге с 8 модулями по 4 МБ можно было получить 32 МБ – и на начало 90-ых это нереальный объем.

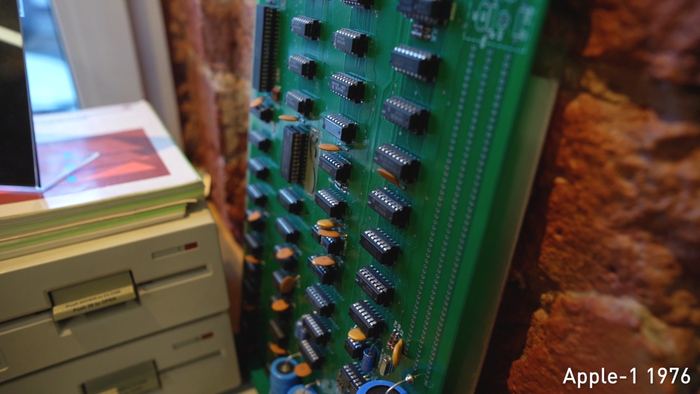

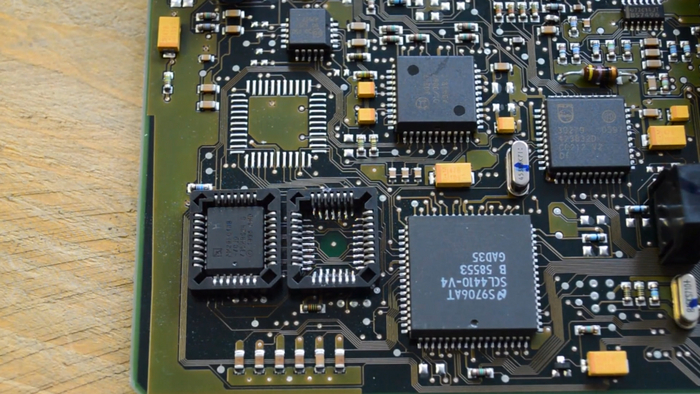

2D-видеокарты

Многие уже заметили, что у плат начала 90-ых не было видеовыхода. Встроенные видеоядра появились лишь в начале 2000х. Тогда дискретная видеокарта была обязательна, без неё полюбоваться на цветную Windows 3 не получится.

И да, никакого ускорения 3D – карты тех лет умели работать только с 2D. Никакого 32-битного цвета – даже 256 цветов было счастьем, которое нередко требовало снижение разрешение до 320х200.

Королём по разрешению было VGA, или 640*480 – нередко всего при 16 цветах. Современные мониторы к таким картам подключить их едва ли получится: скорее всего вы увидите картинку типа «вне диапазона».Так что если вы планируете собрать себе ПК тех лет – запаситесь ЭЛТ-пушкой.

А как же Wolfenstein 3D из 92 года? В те далекие уже времена был софтверный рендеринг, то есть картинку полностью обрабатывал процессор. Разумеется, осилить высокие разрешения он не мог, но тогда это мало кого смущало. У видеокарты была единственная цель – вывести картинку на монитор.

Какой была RTX 4090 в начале 90-ых? Например, S3 911 – могла выводить целых 256 цветов и имела до 1 МБ памяти. К слову, тогда была фишка, которая пригодилась бы сейчас пользователям многих видеокарт – видеопамять можно было самостоятельно увеличить без всякого паяльника, на карте для этого были слоты.

Звук

Окей, картинку из «вульфа» мы вывели. Но хочется же еще и звук? Самым простым вариантом было подключение PC speaker.

Да, издаваемые им звуки сложно назвать музыкой – но это в любом случае было лучше чем ничего. А вот для зажиточных ПК-бояр тех лет существовали ISA-аудиокарты – например, популярные решения Sound Blaster, первая версия которого вышла в далеком 1989 году. Такая карта могла выдавать монозвук с частотой дискретизации в 22 кГц, что вдвое меньше минимально принятых сейчас 44.1 кГц.

К слову, даже по сегодняшим меркам это не так плохо – качество, выдаваемое такой карты, вполне сравнимо с FM-радио, которое до сих пор массово слушают многие водители. Ну а уж в 89 оно вызывало истинный восторг у меломанов, ведь до начала эры MP3 оставалось еще 5 лет.

Еще одним интересным и ожидаемым нюансом аудиокарт тех лет было отсутствие стандартизации, то есть разработчикам тех же игр приходилось оптимизировать их под каждую конкретную карточку – разумеется, обычно брались лишь самые популярные. Именно тогда началась эпоха так называемых Sound Blaster совместимых карт, которые были дешевле оригиналов, но при этом также позволяли насладиться звуком в большинстве проектов.

Сетевая карта

Сейчас нам сложно представить свою жизнь без интернета, компьютер без интернета уже не полноценен. Но 30 лет назад все было иначе. Самый первый HTTP-сайт, который работает до сих пор работает появился лишь в 1991 году . Тогда же появился первый браузер Mosaic, но в целом выход в сеть тогда был необязательным, и тот же Internet Explorer появился лишь в 95.

Однако это не значит, что сетевыми технологиями никто не пользовался. И до интернета существовало множество компьютерных сетей, так называемых BBS или по-русски бордов, самой известной из которых был Фидонет – который, кстати, тоже работает до сих пор, и к нему можно подключиться через обычный эмулятор терминала. Обычно в таких сетях узлами были сами ПК пользователей, на которых хранилась общедоступная информация. Ну и разумеется чтобы обеспечить подключение к таким сетям нужна была сетевая карта.

Лимит картинок на Пикабу закончился, если интересно, будет вторая часть. Полное видео пропитанное подробностями и ностальгическими звуками:

Как качественно стримить и записывать видео на видеокартах AMD

Думаю, ни для кого не станет открытием, что среди известных стримеров популярностью пользуются видеокарты компании Nvidia. Но почему же не AMD? Если коротко, то на это есть весьма весомые причины. В этом материале вы узнаете: "Почему же так сложилось и как качественно стримить и записывать видео, если ты счастливый обладатель видеокарты от компании AMD".

Описание проблемы

Долгое время считалось, что для получения качественной картинки игровой процесс необходимо обязательно захватывать силами CPU с минимальным сжатием, как это делает FRAPS. Однако такой способ захвата хоть и позволял добиться желаемого, но существенно влиял на производительность системы.

Почесав репу и видя набирающую популярность игровых онлайн-трансляций, железные гиганты Nvidia и AMD создали и интегрировали в свои новейшие видеокарты аппаратные кодировщики NVENC и AMF/VCE, что обеспечивали высококачественную обработку видео, которая была быстрее и энергоэффективнее по сравнению с аналогичными кодировщиками на базе CPU. Ещё долгое время после релиза их качество оставляло желать лучшего, но с каждым поколением всё менялось.

Вот тут-то и кроется главная проблема. Если Nvidia работала не только над железом и алгоритмом кодирования, но и со многими разработчиками ПО, то компания AMD попросту забила на возможность проведения онлайн-трансляций силами GPU где-либо ещё, кроме как из своей панели управления драйверов. Такое решение привело к тому, что, запуская Obs-studio c какой-нибудь AMD Radeon RX 580 на борту, бедолаге геймеру было доступно весьма ограниченное количество настроек качества, и максимум, чем он мог поделиться, были лишь рассыпающиеся пиксели. Тем не менее не всё так плохо, потому как обычно, когда многомиллиардная компания не может или не хочет, за дело берутся энтузиасты.

Магия Open Source

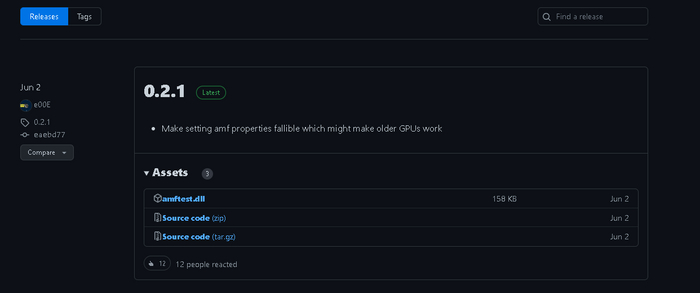

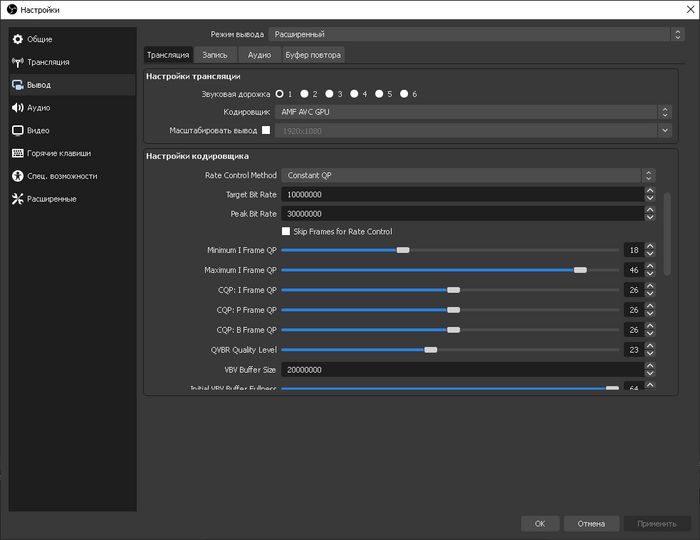

Несмотря на обновление Obs-studio до 28 версии, где была официально добавлена поддержка расширенных настроек для видеокарт AMD, балом продолжают править пользовательские расширения. На текущий момент существует три основных реализации от энтузиастов, что в той или иной мере помогают исправить проблему. Но мы рассмотрим самую лучшую из них.

Пользовательский энкодер amftest устанавливается простым переносом DLL в папку obs-studio/plugins/ и, в отличие от новейшей официальной реализации, позволяет получить доступ не только ко множеству настроек кодирования, но и обойти многие глупые ограничения, накладываемые со стороны производителя видеокарты.

У меня нет желания. Да и не имеет никакого смысла более подробно всё это расписывать. Всё, что вам необходимо знать, так это то, что благодаря amftes автору успешно удаётся стримить World of Tanks в 2K и 60 FPS на своей слабенькой AMD Radeon RX 550 без существенного влияния на производительность.

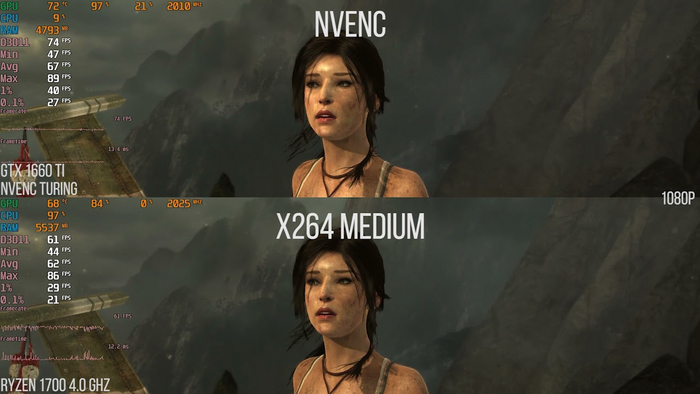

Проведём наглядное тестирование скорости и качества кодировщика AMD при 1080p и 60 FPS в игре World of Tanks на потоковом сервисе Trovo.

Тестовый стенд:

* Процессор: Intel Pentium G4560 2/4 3.5 ГГц* Видеокарта: AMD Radeon RX 550 2 ГБ GDDR5

* Оперативная память: 2x4 2400 МГц

* Материнская плата: H110M-DGS R3.0 Bios 7.50

* Накопитель: 2 Sata 3 SSD 128 и 256 ГБ

* Звуковая система: Asus Strix Soar

Пожалуйста, учитывайте, что автор не имеет второго компьютера для беспроблемного захвата результата, и вся трансляция, запись, а также сама игра, обрабатываются ресурсами одного ПК. Так что смело умножайте нагрузку на 3.

Несмотря на дополнительное сжатие YouTube, преимущество amftest очевидно.

Заключение

Вот, собственно, и всё! Потратив всего 5 минут, мы исправили недоработки многомиллиардной компании и получили возможность проводить качественные онлайн-трансляции на оборудовании стоимостью меньше 5 тыс. рублей. Уважайте свободу, играйте в хорошие игры и ни в коем случае не предавайте себя.

Если вам понравился материал, то, пожалуйста, посетите блог автора ---> ТЫК.