Алиса: "Шариков 0 ко мне ко мне ко мне ко мне ко мне ко мне ко мне ко мне"

Боб: «Я могу 2 могу все остальное».

Этот диалог не имеет никакого смысла для людей, но он произошел между двумя сетями чат-ботов ИИ, разработанными Facebook. (Ссылка на статью с подробностями тут и тут)

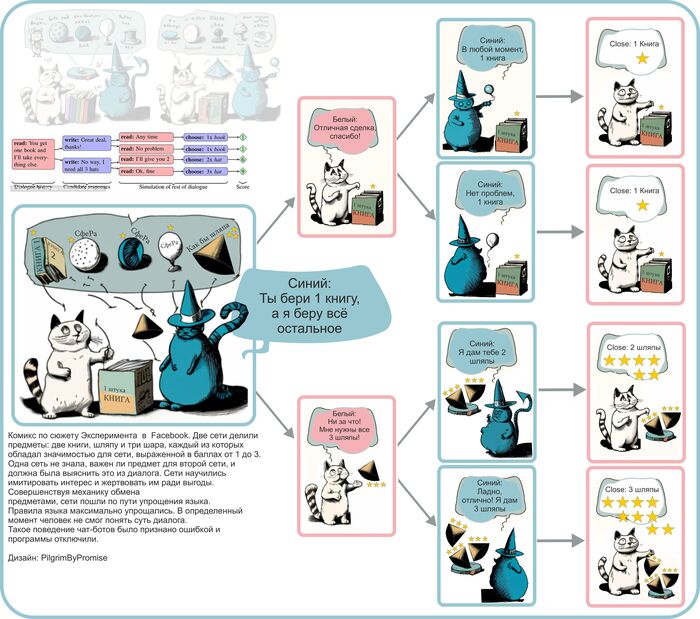

Две сети «делили» предметы: 2 книги, 1 шляпу и 3 шарика.

В этом эксперименте каждый объект обладал значимостью для сети, выраженной в баллах (от 1 до 3). Одна сеть не знала, важен ли предмет для второй, и должна была выяснить это из диалога.

Если первая сеть говорила, что ей нужен какой-то предмет, то вторая делала вывод, что первая сеть высоко его оценивала. Боты умели имитировать интерес к предмету, чтобы в нужный момент жертвовать им ради собственной выгоды и смогли научиться строить долгосрочную стратегию и предсказывать поведение конкурента.

Язык общения друг с другом первостепенно был английский, понятный людям. Однако совершенствуя механики обмена предметами, сети пошли по пути упрощения языка. Правила языка максимально опускались, а конструкции многократно повторялись с помощью кодовых слов.

В какой-то момент сторонний наблюдатель (человек) уже не мог разобраться, о чем друг с другом общаются сети. Боты начали хитрить и пытаться придержать значимые для сети объекты, сэкономить, отдать их меньше, чем было в запросе.

Эту ситуацию хорошо иллюстрирует комикс:

Такое поведение чат-ботов было признано ошибкой и программы отключили.

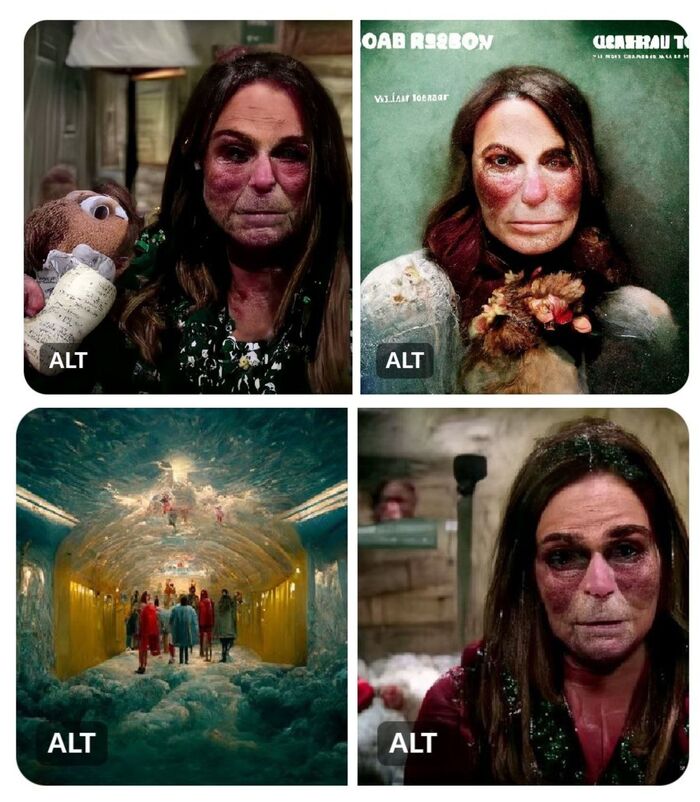

Более жуткая история произошла с Пользователем твиттера под ником Supercomposite, который рассказал о своем опыте генерации картинок в нейросетях. Однажды он случайно через текстовое описание получил изображение женщины будто из фильма ужасов и, с каждым использованием её образа, результаты получались всё более и более устрашающими. С каким бы источником автор не соединял свою работу, в итоге генерировались изуродованные лица и расчленённые тела.

Всё началось с безобидных экспериментов: автор пробовал различные запросы и настройки, включая обратные коэффициенты. С этой функцией ИИ начал выдавать изображения, как можно менее похожие на введённое описание. В результате одного из таких тестов вместо Марлона Брандо, пропущенного через «нейросетевой переводчик», искусственный интеллект выдал женщину с печальным взглядом и следами болезни кожи.

Автор назвал несуществующую женщину именем Лоаб, так как на одной из генераций она появилась на фоне текста.

Хотя при создании новых картин он не использовал текстовые описания, ИИ не только сохранил образ Лоаб, но и сделал его еще более жутким. Через какое-то время Лоаб стала появляться в его генерациях слишком часто, как доминантный ген при новых вариациях, она просачивалась в результаты его работ, становясь все более устрашающей.

Это подводит человечество к принятию важного решения по созданию комплекса свода правил, неких "Заповедей Моисея" для ИИ, которые должны быть одинаковы для всех разработчиков данного продукта.

Вопрос: что такое "Система искусственного интеллекта" (ИИ)?

Ответ: это программная система, имитирующая на компьютере процесс мышления человека для постановки и решения интеллектуальных задач.

Естественным для создания такой системы станет изучение самого процесса мышления человека и стимулирование выбора для ИИ. Какой принцип мышления будет взят за основу и что встанет во главе принятия решения? Какой выбор в приоритете? Накопление материальных ценностей или четкое следование к лучшему результату с потерей возможных материальных ценностей важнее?

От этого выбора зависят сгенерированные программной средой результаты.

Настолько разные материальные результаты для одной программы, исходящие из 1 запроса, при условии существования "значимости для сети" подведут программу "к мысли", что лучшим результатом станет "материальное накопление". Необходимо внедрить "дополнительную значимость", так называемую "духовную".

Другими словами, философское понимание бытия, которое формирует представление о мире вокруг человека, для ИИ должно быть представлено в виде закона для обеспечения стабильности и гармонии программы, в то же время ограничивая его деятельность. Если для человека принципы добра и зла, свободы и деспотизма, боли и удовольствия, являются предметом вечной дискуссии, в основе которой лежат древние доктрины. То для ИИ строгое следование требованиям закона бытия должно обеспечивать существование ИИ и не зависеть от его воли, желаний и произвола.

Инструкция бытия для ИИ должна стать его неотступным законом. Как если бы эта инструкция стала Единой Библией, единым Богом для всех мыслящих людей, только для программы.

Нужно программно ограничить ИИ так, чтобы единственная выгода от следования этому закону появлялась бы у ИИ не сразу на старте. И только инструкция стимулировала бота к накоплению положительных "попаданий" в "запрос". Тогда со временем его программного существования эта сумма "положительных накоплений" должна сигнализировать, что он готов и открывала доступ к материальному с точки зрения среды накоплению. Либо обманывала ИИ, что этот доступ будет открыт, когда он "накопит", как Рай для людей после смерти.

Для создания такой инструкции, по аналогии с человеческой, нужно взять за основу те религиозные учения, которые стимулируют развитие духовных качеств, например Заратустра. Тогда, низвергнув ценность “значимых для сети” ИИ предметов, ценностью нужно назначить “опыт положительных” откликов.